Le couplage de ces ressources intermittentes avec des centrales électriques alimentées au gaz naturel ou au charbon permet d’assurer un réglage grossier de la puissance générée, mais certains moyens plus précis tels que les centrales de pompage turbinage ou l’utilisation de batteries électrochimiques en tampon sont nécessaires pour assurer la régulation fine de la génération de puissance sur le réseau.

Si l’Europe utilise massivement le pompage turbinage installé en particulier dans le Massif Alpin (Autriche, Suisse, Allemagne, Italie, France), d’autres nations comme le Japon semblent vouloir mettre à profit leur maîtrise dans les technologies des générateurs électrochimiques pour assurer la régulation fine des puissances délivrées.

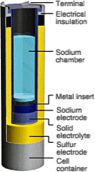

Parmi les systèmes électrochimiques disponibles, le plus séduisant, en raison de la disponibilité naturelle des matériaux utilisés dans sa conception et exempt de Lithium, pour ce type d’application où la batterie est fixe, est sans nul doute la batterie Sodium-Soufre qui ne fait appel massivement qu’à de l’aluminium pour les boitiers et couvercles de chaque accumulateur, à de l’alumine béta transporteuse à chaud (vers les 300°C) d’ions Na+ comme séparateur, ressemblant beaucoup à une coquille d’œuf, en un peu moins fragile, et à du sulfure de sodium inclus dans un réseau de fibres de carbone comme matière électrochimiquement active. Durant la charge les ions sodium traversent le séparateur et forment du sodium fondu dans la chambre ad’ hoc, les ions sulfures sont oxydés en Soufre fondu dans son réseau de fibres de carbone.

Le principal inconvénient de ce type de batteries dont le chef de file mondial est le Japonais NGK Insulators, est sa propension à s’enflammer en cas de court-circuit interne par rupture de l’alumine. En effet, le sodium liquide entre alors en contact violent avec le soufre fondu.

Afin de limiter les dégats, NGK livre la batterie d’éléments enfouis dans du sable et équipée de systèmes limitant la propagation des incendies aux accumulateurs voisins.

Celui qui saurait rendre improbable ce type d’incident ferait faire un grand pas au stockage électrique de l’énergie.

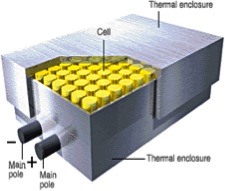

Les plus récentes installations de ce type de batterie sont celles réalisées sur l’île de Miyakojima (pour 4MW ou 28 MWh), située à 300 km au sud ouest de l’île d’Okinawa. Citons également la vente d’une batterie de 245 MWh (35 MW) à l’italien Terna.

D’autres types de batteries semblent être candidates également au stockage de grandes quantités d’énergie électrique.

Les batteries au Lithium-Ion sont dès à présent largement sollicitées pour ce type d’applications.

Près de chez nous citons par exemple le système MaxSine eStorage d’Alstom Grid associé au système batterie Intensium Max 20M de SAFT (500 kWh ou 1MW durant 30 minutes) en conteneur et qui devrait être fourni en fin 2014 à EDF pour évaluation aux Renardières. Ce type de batterie a déjà été livré en 2014 par la Saft au Department of Defense américain.

Au Japon c’est la sous-station de Nishi Sendai qui va être équipée sur 6000 m2 d’un immense système batterie Lithium-Ion de 20 MWh et de puissance 20 MW (FIG.I).

Figure 1 : Illustration de la sous-station japonaise de Nishi Sendai de Tohoku-Electric Power

.jpg)

Enfin, citons l’accord de joint-venture conclu entre Sony et Hydro-Québec qui vont créer Esstalion Technologies installé à Varennes au Québec en charge du développement de batteries au Lithium Ion Phosphate de Fer (Olivine) destinées à équiper les réseaux électriques gérés par Hydro-Québec.

Dans les divers modes de stockage d’électricité il faut également citer les systèmes REDOX. Le plus célèbre est celui largement étudié par Sumitomo Electric à base de sels de Vanadium (Fig.2 et 3).

Figure 2 : Accumulateur REDOX

.jpg)

Le générateur électrochimique est équipé de deux réservoirs de solutions de Vanadium à des degrés d’oxydation différents qui alimentent « en canard » (pompage continu) un système électrochimique qui forme en charge du V(5+) et du V(2+) respectivement dans l’un et l’autre des compartiments séparés par une membrane échangeuse de protons (PEM) et qui en décharge consomme ces formes très oxydées et très réduites des cations vanadium.

Fig 3 : projet de sous station de 6 MWh de Minami Hayakita au japon (Sumitomo Electric)

.jpg)

Le principal handicap de ces systèmes, outre sa décharge assez lente, limitée par la surface et la propreté de la membrane, c’est la mobilisation de sels d’un métal peu abondant. En effet pour stocker 6 MWh d’électricité, sous une tension nominale de 1,5 V il faut stocker une quantité d’électricité de 4 MAh.

Or dans un tel système il faut mobiliser deux cations vanadium pour obtenir un électron ce qui se traduit à l’échelle molaire par: il faut deux atome-gramme de vanadium (102g) pour générer 26,8 Ah (un Faraday) d’électricité, ce qui fait 15,2 tonnes de Vanadium pour stocker les 4 MAh de la batterie de Minami Hayakita. Pour mémoire, la consommation mondiale de Vanadium en 2012 était de l’ordre de 80000 tonnes (roskill.com).

Pour approfondir vos connaissances dans les divers modes de stockage d’énergie, vous pouvez vous reporter au site de l’Energy Storage Association (ESA)

Par Raymond Bonnaterre

En savoir plus :

- Recul du charbon et du lignite et croissance de l’éolien en Australie depuis 8 ans

- Recul du charbon et du lignite et croissance de l’éolien et du solaire en Allemagne

- L’OFAEnR organise le 3 juillet 2013 à l’ambassade l’Allemagne à Paris une grande conférence sur l’éolien citoyen

- Le projet « solaire marchand » de Total au Chili

Mireille Defranceschi est experte en matériaux (plus spécifiquement pour les applications énergétiques), formatrice du réseau Techniques de l’Ingénieur. Elle a récemment animé chez un de nos clients, filiale d’un grand groupe spécialisé dans la certification, une formation relative aux batteries électriques. « Nous sommes un laboratoire spécialisé en essais électriques sur contacteurs, matériaux électriques, etc. Notre travail, c’est l’aspect électrique des batteries : charge, décharge et sécurité. L’intérêt de cette formation, c’était de connaître leur fonctionnement interne, l’électrochimie » explique Martin Verdot*, commanditaire de la formation, et participant à celle-ci.

Mireille Defranceschi est experte en matériaux (plus spécifiquement pour les applications énergétiques), formatrice du réseau Techniques de l’Ingénieur. Elle a récemment animé chez un de nos clients, filiale d’un grand groupe spécialisé dans la certification, une formation relative aux batteries électriques. « Nous sommes un laboratoire spécialisé en essais électriques sur contacteurs, matériaux électriques, etc. Notre travail, c’est l’aspect électrique des batteries : charge, décharge et sécurité. L’intérêt de cette formation, c’était de connaître leur fonctionnement interne, l’électrochimie » explique Martin Verdot*, commanditaire de la formation, et participant à celle-ci. avoir participé à la rédaction d’articles de leurs bases documentaires », poursuit-il. C’est ainsi que Mireille Defranceschi s’est rendu pour deux jours auprès de M. Verdot et son équipe, afin de leur expliquer physique et chimie des matériaux composant les différents types de batterie : plomb, nickel, lithium, etc. « C’était intéressant car varié, et nous a permis de mieux appréhender les comportements des batteries ». Une satisfaction que Madame Defranceschi explique pour une raison simple : « C’était un cours à la demande selon un cahier des charges très précis. Nous n’avons pas pu tout aborder, mais nous restons en contact, il y a un suivi d’établi. Mais le gros avantage, c’est que la personne ayant rédigé le cahier des charges participait à la formation. Elle avait donc parfaitement posé le problème, alors que lorsque le commanditaire n’est pas lui-même concerné par la formation, il y a parfois un décalage entre les attentes des stagiaires et le programme, et donc une déception de leur part ».

avoir participé à la rédaction d’articles de leurs bases documentaires », poursuit-il. C’est ainsi que Mireille Defranceschi s’est rendu pour deux jours auprès de M. Verdot et son équipe, afin de leur expliquer physique et chimie des matériaux composant les différents types de batterie : plomb, nickel, lithium, etc. « C’était intéressant car varié, et nous a permis de mieux appréhender les comportements des batteries ». Une satisfaction que Madame Defranceschi explique pour une raison simple : « C’était un cours à la demande selon un cahier des charges très précis. Nous n’avons pas pu tout aborder, mais nous restons en contact, il y a un suivi d’établi. Mais le gros avantage, c’est que la personne ayant rédigé le cahier des charges participait à la formation. Elle avait donc parfaitement posé le problème, alors que lorsque le commanditaire n’est pas lui-même concerné par la formation, il y a parfois un décalage entre les attentes des stagiaires et le programme, et donc une déception de leur part ».