Cybersécurité : le prochain 11 septembre sera numérique

Cette semaine, les Etats-Unis commémoraient le onzième anniversaire des attaques du World Trade Center à New York. Cette tragédie a marqué le pays entier et a eu d’importantes répercussions dans de multiples domaines : politique, économique, sociétale, financier ou encore militaire pour n’en citer que quelques uns. En décembre 2001, le Congrès avait désigné le 11 septembre comme étant le « Jour des Patriotes », journée nationale de prière et du souvenir des victimes des attaques terroristes du 11 septembre 2001. Et cette année, à cette occasion, le sénateur républicain de l’Indiana, Dan Coats, a tenu à rappeler l’importance de considérer les cyber-attaques comme représentant la plus grande menace à venir. A cette occasion seulement ? Pas tout à fait.

Proposition de loi versus décret présidentiel

Le journal « The Hill » a en effet révélé la semaine dernière que la Maison Blanche préparait un décret présidentiel sur la cybersécurité, le Congrès ayant échoué cet été à faire adopter la proposition de loi sur la cybersécurité face au refus de la Chambre de Commerce américaine. Le sujet est donc sensible et l’équipe de Barrack Obama semble déterminée à renforcer la loi. Mais la méthode ne laisse pas les sénateurs républicains indifférents qui réclament un travail bipartisan républicain-démocrate sur une nouvelle proposition, en collaboration avec la Chambre de Commerce des Etats-Unis. Seulement, le Congrès ne dispose que de très peu de temps ce mois-ci avant la suspension prévue à l’occasion des élections.

Le contenu du décret présidentiel n’est pas encore connu, mais la proposition de loi sur la cybersécurité présentée par les sénateurs Joe Lieberman (Indépendant – Connecticut) et Susan Collins (Republicaine – Maine), elle, avait été dévoilée en Juillet dernier. Elle encourageait notamment les entreprises dites sensibles, telles que les centrales nucléaires, électriques, hydrauliques, les banques et autres industries vitales, a s’engager de manière volontaire à renforcer la sécurité de leurs réseaux et systèmes d’informations. Des règles et standards professionnels pour ces secteurs industriels seraient élaborées à cette fin, avec la collaboration du gouvernement. C’est ce dernier point qui a d’ailleurs conduit au refus de la proposition par la chambre de commerce en août dernier. Le projet présentait aussi un paragraphe sur l’amélioration du partage d’informations sur les menaces informatiques entre les agences gouvernementales et les entreprises pour mieux parer les attaques. Un autre paragraphe évoquait également le renforcement des efforts de recherche et développement dans le domaine de la cybersécurité ainsi que la modification de la loi sur la gestion de la sécurité des informations fédérales (FISMA).

Comment un programme informatique peut-il déplacer une armée ?

Les Etats-Unis cherchent à se protéger des cyber-attaques pour ne pas attendre une « cyber-catastrophe » avant d’agir. Et ils ne sont pas les seuls. Selon Christopher Painter, Coordinateur au Département d’Etat sur les sujets liés au cyberespace, un nombre croissant de pays se dotent d’une stratégie sur la cybersécurité nationale et organisent leur gouvernement autour de ce domaine. De même, les Etats-Unis multiplient les coopérations à l’international avec les proches alliés tels que la Grande-Bretagne, le Canada, la Nouvelle-Zélande ou encore l’Australie. Il faut dire que les cyber-attaques ont pris une ampleur conséquente ces dernières années et que le pays, avec l’un des réseaux informatiques le plus développé de la planète, semble être une cible privilégiée. Et cela a de quoi effrayer les Etats-Unis qui ont adopté en juillet 2011 une stratégie défensive assez radicale. Le Secrétaire adjoint à la Défense a en effet déclaré que le gouvernement américain se réserve le droit de répondre à une importante cyber-attaque par une réponse militaire justifiée et proportionnelle.

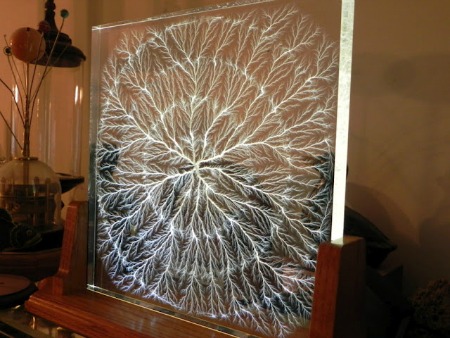

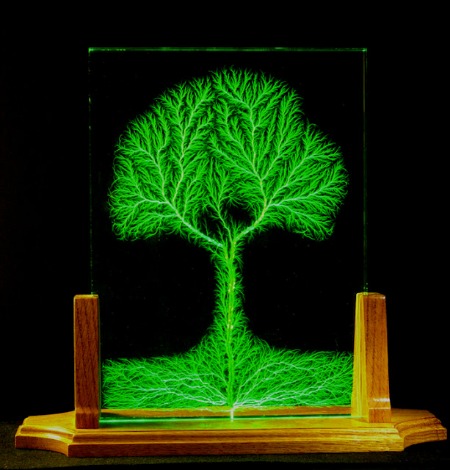

Mais si la Maison Blanche renforce sa défense, elle souhaite également étoffer son arsenal offensif. Elle a ainsi révélé au mois de Juin dernier le programme « Jeux Olympiques », lancé par Georges W. Bush, destiné à développer des cyber-armes. Les Etats-Unis n’en sont pas à leur coup d’essai puisque le gouvernement américain a officiellement déclaré être l’auteur ou co-auteur du ver Stuxnet. Ce programme avait pour but la destruction physique des centrifugeuses iraniennes, une première mondiale. De nombreux experts dont les ingénieurs de Kaspersky jugent par ailleurs que les virus, vers et autres programmes malveillant tels que Flame, Duqu et Gauss ont un lien entre eux et sembleraient provenir de la même source que Stuxnet, Les Etats-Unis. Ces noms ont fait quelques éclats dans la presse internationale en affectant notamment les systèmes d’information des banques libanaises, israéliennes, mais aussi des infrastructures physiques telles que les installations nucléaires iraniennes, une première mondiale.

Source : http://www.bulletins-electroniques.com/actualites/70957.htm

L’ordinateur nuit à la mémoire : des scientifiques mettent en garde contre « la démence numérique »

Le professeur de psychiatrie Manfred Spitzer (basé à Ulm, Bade-Wurtemberg) se prononce après des recherches longitudinales contre un contact précoce et fréquent des enfants avec les ordinateurs et l’Internet. « Les médias numériques sont nuisibles au développement de la mémoire, ne sont pas adaptés à l’encouragement de l’apprentissage et provoque des dépendances », a déclaré le chercheur dans une publication. Il remet donc en question l’utilisation des médias numériques dans les processus d’apprentissage, soutenant que « si l’ordinateur prend en charge une part du travail mental traditionnel, travail mental qui est à la base de développements cognitifs du cerveau, alors il peut arriver que l’utilisation trop fréquente de l’ordinateur nuise au développement de mécanismes cognitifs importants, comme ceux de la concentration et de la mémoire ». Les études PISA, dans lesquelles les données de près de 300.000 élèves de 15 ans avaient été recueillies, ont montré que les adolescents ayant le plus accès à un ordinateur personnel à l’école étaient également ceux ayant en moyenne les moins bonnes notes. Et si le développement de nouvelles compétences informatiques ne saurait être mesuré dans le système scolaire traditionnel, le « zapping » d’information généré par les technologies numériques est pour les études citées le facteur le plus marquant de perte de concentration prolongée.

Le neuroscientifique, dont le livre intitulé « La démence numérique. Comment pouvons-nous apporter un nouvel apprentissage à nos enfants » vient de paraître, se base sur les résultats d’une enquête récente menée par 62 professeurs d’universités allemandes. Selon cette étude, des compétences importantes comme la logique argumentative, la capacité de saisir ou résumer un texte et la capacité de concentration seraient amoindries chez les plus jeunes étudiants universitaires ayant grandi avec l’avènement de l’Internet. Selon les chercheurs en neurosciences, ces déficits seraient dus à une sorte d’overdose numérique, un mécanisme chimique de stress cérébral causé par le zapping informationnel. Ainsi Spitzer ne se prononce pas en faveur du principe généralisé du travail rapide et multitâche, pourtant valorisé dans le monde professionnel. Selon lui, les recherches récentes montrent que cette tendance développe surtout chez l’individu un mécanisme de « saut » rapide entre diverses informations peu ou mal traitées, individu qui s’entraînerait ainsi lui-même à un trouble de l’attention.

Source : http://www.bulletins-electroniques.com/actualites/70864.htm

Des chercheurs imaginent le futur du cloud computing

Les plates-formes de cloud computing IaaS (« Infrastructure as a Service ») actuelles permettent à des clients de louer des serveurs virtualisés et du stockage à la demande, généralement à l’heure. Mais une nouvelle étude annonce qu’à l’avenir, ces services pourraient être vendus d’une manière beaucoup plus efficace et fine, avec des ressources spécifiques, tels des cycles d’horloge (CPU cycle) et de la mémoire, qui pourraient être loués pour quelques secondes.

Ce modèle de cloud computing a été nommé RaaS (« Resource as a Service ») par les chercheurs du Technion Orna Ben-Yehuda Agmon, Muli Ben-Yehuda, Assaf Schuster et Dan Tsafrir, qui ont écrit un article1 sur le sujet qui à été présenté ce mois-ci lors de la conférence USENIX HotCloud ’12 à Boston. L’idée de posséder ses propres ressources informatiques s’effrite au fil du temps, écrivent-ils dans l’article. « Avant le cloud computing, la durée de vie utile moyenne d’un serveur acheté était d’environ trois ans. Avec l’avènement de l’hébergement Web, les clients peuvent louer un serveur sur une base mensuelle, » disent-ils. L’apparition services comme l’ « Amazon’s Elastic Compute Cloud » (EC2) a permis de réduire les durées de location à quelques heures seulement.

Les chercheurs soutiennent qu’avec l’évolution du marché du cloud computing le modèle de location horaire ne sera pas suffisant : « Si vous payez pour une heure ou une partie de celle-ci, vous allez perdre en moyenne une demi-heure sur la durée de vie de chaque machine virtuelle », indique l’article. « Si vous ne payez que pour une seconde ou une fraction de celle-ci, alors vous ne perdrez une demi-seconde sur la durée de vie de chaque machine virtuelle. »

Dans une plates-forme de cloud computing RaaS, les clients pourraient acheter des « graines de machines virtuelles » contenant des ressources de base ainsi qu’un « agent économique » permettant l’ajout de ressources supplémentaires. L’agent « prendra des décisions sur la base des prix courant de ces ressources, de la charge que la machine doit gérer, et de l’évaluation subjective du client de ces différentes ressources au cours du temps. » Les logiciels des fournisseurs de services de cloud computing pourront également incorporer des agents économiques pour défendre leurs propres intérêts. Les agents des clients pourraient également négocier avec ceux contrôlés par d’autres clients qui pourraient avoir des ressources supplémentaires à vendre. Les prix des différents types de ressources se décideraient ainsi en fonction du marché selon la loi de l’offre et de la demande.

Afin de concrétiser le concept de cloud computing Raas il faudra de nouveaux types d’applications et de logiciels système, déclarent les chercheurs. « Dans un nuage Raas, les machines virtuelles ne savent jamais avec précision la quantité de ressources qui pourra être mis à leur disposition à un instant donné, » disent-ils. « Cela oblige les logiciels s’exécutant dans ces machines virtuelles à s’adapter à la disponibilité des ressources et d’exploiter toutes les ressources à leur disposition, quand il les ont. »

Source : http://www.bulletins-electroniques.com/actualites/70812.htm

.jpg)