Récemment, une attaque de pirates a mis à terre toutes les barrières de protection, libérant un flot de pas moins de 77 millions de dossiers personnels sur Internet, où ils furent rapidement happés dans les antres de l’économie souterraine.

Le vol de données, notamment de fichiers liés à la sécurité, nuit non seulement à la réputation des victimes, mais implique également la responsabilité pénale de l’entreprise en question. Peter Schaar, coordinateur de la CNIL Européenne, déclare : « L’entreprise doit être tenue responsable de tout dommage engendré ». La culture d’indemnisation est par tradition encore plus vivace aux États-Unis qu’en Europe.

Les principales faiblesses

Les fuites de données qui ont fait la une de l’actualité étaient évitables et sont dues à des règles de sécurité trop laxistes : les données personnelles des clients, telles que le mot de passe, continuent d’être enregistrées sans cryptage, et l’accès de nombreux clients et employés reste protégé par des systèmes obsolètes. Les entreprises s’efforcent toujours d’élever les niveaux de sécurité sur la base de principes sujets à caution. Toutefois, d’autres lacunes fondamentales continuent de régner.

Les plates-formes de jeux restent la cible privilégiée des hackers car c’est un secteur qui génère beaucoup de capitaux. En effet, selon la dernière étude de PricewaterhouseCoopers sur les perspectives 2008-2012 du marché mondial du divertissement et des médias, nous pouvons prévoir une croissance annuelle moyenne de 10,5 % d’ici 2012, pour atteindre un chiffre d’affaires d’environ 68 milliards de dollars. Dans le domaine du jeu en ligne (les paris et jeux de toutes sortes), les prévisions 2012 devraient même dépasser la barre des 630 milliards. Toutefois, le risque existe que ces prévisions optimistes doivent être revues à la baisse alors que les fuites de données qui se produisent régulièrement sont susceptibles de freiner l’enthousiasme des joueurs.

Prenons l’exemple du compte client. En cas d’accès depuis un PC, il existe un danger d’attaques par des programmes enregistreurs de frappe ou renifleurs. Leur origine est souvent un cheval de Troie. Ils consignent furtivement toutes les saisies de mot de passe et les transfèrent au serveur du hacker, baptisé « drop zone ». Même si un antivirus est installé, même si l’utilisateur se montre prudent, les risques restent immenses face aux stratagèmes sophistiqués des hackers.

Les experts en conviennent : les ordinateurs grand public sont rarement équipés de système de sécurité professionnel. Ils doivent donc être considérés comme non-sécurisés. Ce n’est pas surprenant. En outre, il est reconnu que cela n’aurait aucun sens de confier la responsabilité de la sécurité à l’utilisateur. Peut-on s’attendre à ce qu’il invente chaque semaine un nouveau mot de passe béton contenant des chiffres et des caractères spéciaux… et le mémorise de surcroît ?

Une meilleure prévention passe par l’authentification forte

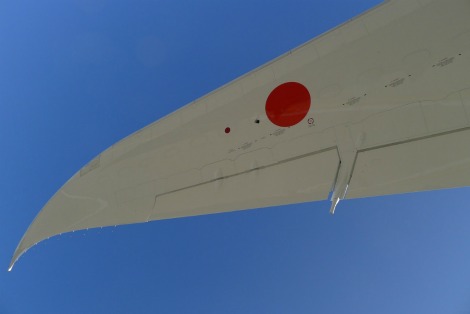

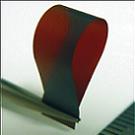

Il n’existe aucune fatalité, comme l’illustre l’exemple de l’entreprise japonaise Square-Enix. Elle protège sa plate-forme de jeux en ligne avec une double-authentification de pointe. Tous les participants à son jeu de rôle Final Fantasy XI reçoivent un authentifieur en forme de porte-clés. D’un clic sur un bouton, il génère un mot de passe unique qui n’est valable que 32 secondes. À chaque connexion de l’utilisateur, il calcule une nouvelle valeur. Les mots de passe glanés par les hackers sont ainsi inutilisables. L’accès est également possible via une console PlayStation ou Xbox 360 et des PC Windows, le mot de passe unique concernant chacun de ces appareils. Dans le cas de Square Enix, le serveur d’authentification gère l’identification.

Cet investissement a porté ses fruits, comme le prouvent les chiffres officiels des ministères japonais : en 2009, 2289 cas d’accès non autorisés aux services en ligne ont été constatés, soit une hausse d’environ 25% par rapport à l’année précédente.

Le site de jeu en ligne PartyGaming protège de longue date ses joueurs par une authentification forte. Après tout, beaucoup d’argent est en jeu, argent que les hackers souhaitent aussi subtiliser. Les utilisateurs de PartyPoker, PartyCasino, PartyBingo et PartyGammon s’inscrivent en téléchargeant le logiciel client PartyGaming. Une fois inscrits, ils peuvent obtenir un authentifieur dénommé PartySecure sur la boutique en ligne. De nouveau, un serveur gère l’authentification. Un porte-parole de PartyGaming affirme : « La solution est très évolutive. Elle peut suivre notre croissance et accueillir aisément le nombre grandissant de joueurs en ligne sur notre plate-forme. »

Vous pouvez aussi jouer au poker et enchérir en toute sécurité sur la plate-forme en ligne BetClic. De nouveau, un authentifieur est utilisé avec un serveur d’authentification. Sargon Petros, directeur Exploitation et infrastructure IT de BetClic, se félicite : « Cela nous a permis d’accroître le revenu par joueur et de réduire le taux de rotation de nos joueurs VIP. La mise en place de la nouvelle solution de sécurité a dopé nos bénéfices. »

Logiquement, une sécurité efficace présente un coût, comme Square Enix, PartyGaming ou BetClic en étaient conscients. Toutefois, les dommages récurrents dus aux hackers montrent que ces entreprises, et bien d’autres de ce secteur, ont agi avec prévoyance. En parallèle, la solution matérielle leur permet de prévenir un partage de compte prohibé et de renforcer la confiance du client, d’où une utilisation plus fréquente qui se traduit en revenus. L’authentification forte offre des avantages économiques, car elle sécurise le trafic.

Concernant les attaques de hackers, la question n’est pas de savoir si l’évènement va se produire, mais l’instant et la gravité de sa frappe. Et l’expérience passée montre qu’il faut ériger des barrières au moment opportun, des barrières avec des réserves suffisantes pour faire face aussi à de graves incidents d’ampleur inconnue à ce jour. Les attaques ciblées sur les entreprises, notamment dans le secteur du divertissement, sont déjà courantes. L’authentification forte protège contre les pertes engendrées par des demandes d’indemnisation et la confiance envolée. D’où l’impératif d’un déploiement généralisé, avant que le barrage ne rompe.

Par Jan Valcke, President de VASCO Data Security / Experts IT