Des scientifiques de Wake Forest University (Caroline du Nord) et de l’Université de Californie de Sud (USC) ont conçu un implant cérébral utilisé sur des rats de laboratoire qui a permis de rétablir des souvenirs auparavant perdus [1,2]. En utilisant cet implant électronique qui reproduit les signaux neuronaux de la mémoire préalablement enregistrés, les scientifiques de ces deux équipes ont réussi à rendre des éléments de mémoire aux rats, après qu’ils les aient perdus.

Ces résultats, cruciaux dans le développement de dispositifs neuro-prosthétiques, devraient permettre dans le futur proche de soigner les déficits de mémoire liés aux maladies neurodégénératives, aux accidents vasculaires cérébraux et aux autres lésions cérébrales.

Identification des zones responsables de l’enregistrement de nouvelles informations

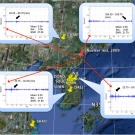

Dans une série d’expériences, Sam Deadwyler et son équipe du département de physiologie et pharmacologie à Wake Forest University ont entraîné 45 rats pour qu’ils se rappellent lequel de deux leviers rétractables devait être actionné pour recevoir de l’eau. Cette cohorte d’animaux voyait d’abord apparaître l’un des deux leviers. Puis, après avoir été distraits, les rats devaient toucher l’autre levier pour être récompensés. Les tests répétés ont permis aux rats de comprendre la règle générale. Dans chaque essai, l’animal doit se rappeler quel levier est apparu en premier afin de pousser l’autre levier pour être récompensé par de l’eau.

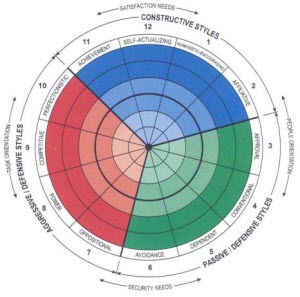

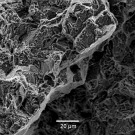

Lors des essais, les chercheurs de Wake Forest ont enregistré des changements d’activité entre deux grandes divisions internes de l’hippocampe du rat : les sous-régions CA1 et CA3. Ces deux structures communiquent ensemble lorsque le cerveau emmagasine et stocke de nouvelles informations. Afin d’étudier les souvenirs des rats, de minuscules électrodes reliant ces deux sous-régions ont été implantées et les signaux échangés ont été enregistrés par ordinateur.

Mise en place de l’implant après avoir neutralisé les zones CA1 et CA3

Après avoir été enregistrées, les interactions neuronales entre CA1 et CA3 ont été bloquées par prise médicamenteuse. Sans CA1 et CA3 connectés, les rats ne se rappelaient pas quel levier pousser pour recevoir de l’eau. Une fois assurées que les sous-parties responsables de la mémoire ne correspondaient plus naturellement l’une avec l’autre, les équipes ont installé l’implant afin de connecter les deux sous-parties et ont reproduit les données auparavant enregistrées. Grâce à ce système artificiel hippocampique reproduisant les interactions entre CA1 et CA3 enregistrées auparavant, les rats ont retrouvé leur mémoire.

De plus, les chercheurs ont ensuite montré que si l’implant et ses électrodes associées étaient implantés sur un rat ne présentant pas de problème de mémoire, le dispositif peut renforcer ou améliorer leur capacité de mémoire.

Débouchés et application chez l’homme

Encore loin d’être testé chez l’homme, l’implant démontre pour la première fois que les fonctions cognitives peuvent être améliorées et retrouvées grâce à un appareil qui imite l’activité des neurones. Ces dernières années, les neurosciences ont connues un grand essor puisque des implants ont été mis au point pour permettre à des personnes paralysées de déplacer des prothèses robotisées voire un curseur d’ordinateur par une suggestion mentale pour activer l’usage d’un appareil [3,4,5,6]. Récemment le professeur Yoon, du département d’ingénierie électrique et informatique de l’université du Michigan [7] a développé un implant appelé BioBolt qui ne pénètre pas le cortex et est complètement recouvert par la peau afin de réduire le plus possible le risque d’infection. C’est vers cette technique d’intégration qu’évolueront les implants neurologiques.

Grâce à la technologie sans fil et aux puces informatiques, ce système pourrait être aisément adapté pour une utilisation humaine. Mais un certain nombre d’obstacles techniques et théoriques persistent :

- l’implant doit tout d’abord enregistrer une trace de mémoire avant son amplification,

- ces signaux, chez l’homme, pourraient être trop faibles pour être enregistrés,

- le système neuronal humain est complexe et implique d’autres zones du cerveau que CA1 et CA3.

Pourtant, la restauration de certains souvenirs (par exemple : retrouver le prénom d’un proche ou la localisation d’un objet) pourrait aider au quotidien les personnes atteintes de perte de mémoire. Avec certains souvenirs retrouvés et réactivés, elles gagneraient en autonomie et éviteraient un placement dans des structures spécialisées.

Daryl Kipke, professeur de bioingénierie à l’Université du Michigan qui n’était pas impliqué dans les recherches pense que « c’est très impressionnant d’arriver à ce niveau de recherche, compte tenu de nos connaissances actuelles de la neurotechnologie. Ces études ne sont qu’un début en ce qui concerne l’exploitation des interactions existantes dans le cerveau, mais cette expérience montre l’énorme potentiel des neurosciences et de leurs technologies » [2].

[1] T. W. Berger, R. E. Hampson, D. Song, A. Goonawardena, V. Z. Marmarelis and S. A Deadwyler « A cortical neural prosthesis for restoring and enhancing memory », Journal of Neural Engineering, 15 juin 2011, 8(4):046017 (Parution en ligne).

[2] B. Carey, « Memory Implant Gives Rats Sharper Recollection », New York Times, 17 juin 2011.

http://www.nytimes.com/2011/06/17/science/17memory.html?_r=3

[3] M. Velliste, S. Perel, M. C. Spalding, A. S. Whitford and A. B. Schwartz « Cortical control of a prosthetic arm for self-feeding », Nature,19 juin 2008, 453, p. 1098-1101.

[4] W. Wang, S. S. Chan, D. A. Heldman, and D. W. Moran « Motor Cortical Representation of Hand Translation and Rotation during Reaching », The Journal of Neuroscience, 20 janvier 2010, 30(3), p. 958-962.

[5] E. C. Leuthardt, G. Schalk, J. Roland, A. Rouse and D. W. Moran « Evolution of brain-computer interfaces: going beyond classic motor physiology », Neurosurgical Focus, juillet 2009, 27(1):E4.

[6] T. Isa, E. E. Fetz and K. R. Müller « Recent advances in brain-machine interfaces. » Neural Networks, novembre 2009, 22(9), p. 1201-1202.

[7] Article « Noninvasive brain implant could someday translate thoughts into movement »sur Eurekalert, 16 juin 2011. http://www.eurekalert.org/pub_releases/2011-06/uom-nbi061511.php

http://www.bulletins-electroniques.com/actualites/67160.htm

.jpg)

.jpg)

.jpg)

.jpg)