Elle est l’autre informatique. Celle que l’on ne voit pas. Pourtant, en moins de 20 ans, les systèmes embarqués se sont imposés comme un des segments les plus dynamiques du secteur de l’électronique en volume et en valeur. Aujourd’hui, selon le livre blanc du Syntec informatique paru début 2010, les systèmes embarqués consomment à eux seuls, 98 % des puces électroniques fabriquées dans le monde. Et la crise n’a rien changé à la situation. En France et dans le monde, cette industrie continue de progresser, certes, plus lentement, mais son ascension est inexorable. Comment et pourquoi ? Le point en chiffres.

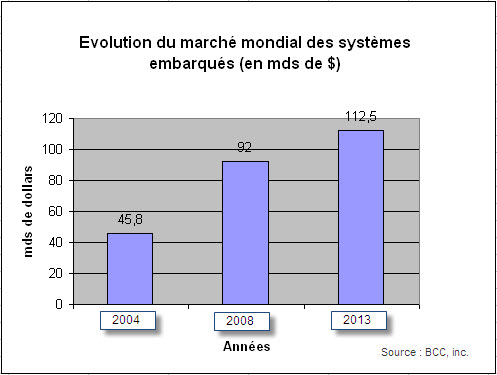

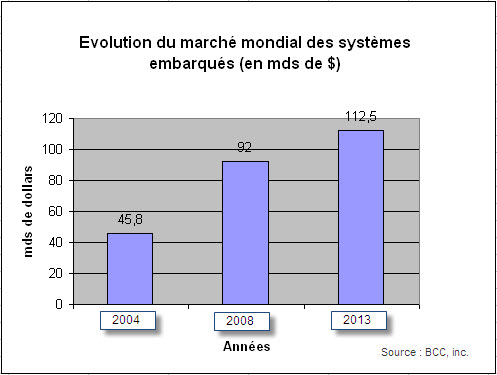

Près de 100 milliards de dollars dans le monde

En 1998, le cabinet BCC Research évaluait le marché mondial des systèmes embarqués à 32 milliards de dollars et estimait qu’il atteindrait 67 milliards de dollars en 2004. Finalement, il s’est développé moins rapidement atteignant en 2004 45,8 milliards de dollars. Mais par la suite, les chiffres s’emballent. Alors que le BCC Research tablait sur 88,1 milliards de dollars en 2009, ce marché frise les 92 milliards de dollars en 2008, affichant une croissance annuelle moyenne de 19 % sur 4 ans. Un dynamisme que le cabinet d’études a tout de même pondéré pour les quelques années à venir afin de tenir compte du ralentissement de certains secteurs moteurs tels que l’automobile. Fin 2013, celui-ci table en effet sur un volume d’affaires de 112,5 milliards de dollars, soit une croissance annuelle moyenne, entre 2008 et 2013, de 4,1 %. L’Idate, quant à lui, est plus confiant dans la conjoncture, puisqu’il estime que le marché mondial des systèmes embarqués représentera, à l’horizon de 2015, 230 milliards de dollars.

Un marché encore dominé par le matériel

Côté structuration, même si le logiciel prend une place de plus en plus importante, assurant de plus en plus des fonctions traditionnellement prises en charge par le matériel, le marché des systèmes embarqués reste tiré par le hardware. En 2008, le matériel a en effet contribué pour 89,8 milliards de dollars au volume d’affaires de ce segment et devrait atteindre 109,6 milliards en 2013, soit une croissance annuelle moyenne de 4,1 %. Les logiciels embarqués, quant à eux, ont généré 2,2 milliards de dollars en 2008 et devraient atteindre les 2,9 milliards en 2013, soit une croissance annuelle moyenne de 5,6 %.

4 milliards d’euros pour la France

En France, la dynamique est similaire. En 2006, selon le livre blanc du Syntec informatique, l’industrie des systèmes embarqués a affiché un volume d’affaires de 4,05 milliards d’euros, dont 750 millions pour les éditeurs de logiciels et 3,3 milliards d’euros pour les sociétés de services (SSII et conseil en technologie), pour une croissance de 13 % par rapport à l’année précédente. Une vitalité qui a perduré en 2007 et 2008 (+13 % par an), avant de s’essouffler, crise oblige, en 2009 avec un rythme de croissance annuel de 5 %. Aujourd’hui, ce secteur emploie quelques 220.000 ingénieurs en France selon le Syntec et devrait créer 34.000 nouveaux postes d’ici 2011.

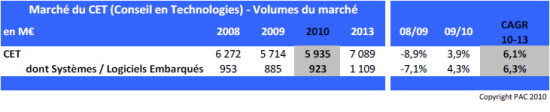

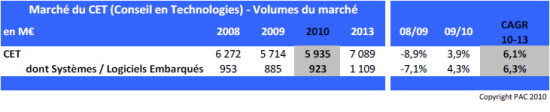

Une tendance que confirme le cabinet Pierre Audouin Consultant (PAC). Certes, le périmètre de leur analyse est plus restreint puisque leur étude ne porte que sur les services relatifs aux systèmes et logiciels embarqués, mais elle reflète assez bien les évolutions de ce marché. Comme pour l’ensemble du secteur des systèmes embarqués, 2009 aura été une année de vache maigre. Avec 885 millions d’euros, le chiffre d’affaires des acteurs de ce segment est en baisse de 7,1 % sur une année glissante. Mais 2010 s’annonce sous de meilleurs auspices. Avec une croissance de 4,3 % par rapport à 2009, le marché des services relatifs aux systèmes embarqués devrait atteindre 923 millions d’euros cette année, même si on est encore loin, contraction des budgets alloués au développement de nouveaux produits dans l’aérospatial et l’automobile oblige, des 953 millions d’euros engrangés en 2008.

Malgré tout, le cabinet se montre optimiste pour les années à venir. Il table sur une croissance moyenne annuelle de 6,3 % par an pour les trois prochaines années, pour atteindre en 2013, 1,1 milliard d’euros de volume d’affaires.

Un développement tout azimut

Mais pourquoi un tel dynamisme ? Deux principaux facteurs y contribuent.

Le premier d’entre eux est l’élargissement du nombre de débouchés. Initialement, les systèmes embarqués ont été développés pour des applications temps réel critique et stratégique, comme le contrôle des fusées ou de satellites ; la production d’énergie ; le contrôle de vol ; les télécommunications… Mais aujourd’hui, ils sont enfouis dans la majeure partie des équipements du quotidien et concernent la quasi-totalité des secteurs d’activité, y compris les produits grand public. La liste de leurs débouchés est désormais longue. Parmi-ceux-ci figurent :

- les transports : à savoir l’automobile, le ferroviaire, le naval, l’aéronautique ;

- le spatial avec les sattellites ;

- la défense pour le contrôle des trajectoires, les lanceurs ;

- le secteur de la santé notamment dans les équipements de diagnostic médical et de soins, les pompes à insuline, la radiothérapie… ;

- le secteur manufacturier : automatismes industriels, dispositifs de sécurité, assistance à la maintenance;

- l’électronique grand public avec tous les appareils photographiques, la vidéo, les lecteurs DVD, les console de jeux, le gros électroménager, les jouets ;

- les télécommunications notamment dans les téléphones mobiles, mais aussi pour les routeurs ;

- l’agriculture ;

- ou encore l’énergie.

Mais tous les acteurs de l’industrie des systèmes embarqués n’ont pas une activité transversale. Selon le Syntec, seuls 31 % d’entre eux travaillent pour l’ensemble des secteurs d’activité, les autres étant plus « spécialisés ». Leurs cinq principaux secteurs-clients sont dans l’ordre :

- l’aéronautique, le spatial et la défense (38 %) ;

- l’automobile (31 %) ;

- l’équipement médical (15 %) ;

- l’industrie de la machine-outil/robotique (14 %) ;

- et le commerce ainsi que la distribution (14 %).

Au delà, le dynamisme de cette industrie tient également au fait que les systèmes embarqués se trouvent au coeur des nouveaux défis de l’industrie. Parmi ceux-ci, citons la possibilité :

- de réduire la consommation d’énergie (transport, domotique) ;

- de piloter le fonctionnement des nouvelles sources d’énergie (éoliennes) ;

- de réduire la pollution (transport) ;

- d’augmenter la sécurité (vidéo surveillance, protection des personnes, sécurité des transports) ;

- d’augmenter le confort et le bien-être des personnes (domotique, transport) ;

- de développer de nouvelles technologies médicales ;

- d’intégrer de nouvelles applications notamment dans les divertissements ;

- d’interagir avec son environnement : Internet des objets, interfaces machine to machine.

Autant de nouveaux challenges qui, pour être relevés, nécessitent d’innover et pour les industries concernées, d’accroître leur budget de R&D. Et dans ce domaine, les prospectives sont plutôt optimistes. Selon l’Idate, les activités de recherche-développement en logiciel embarqué dans le monde devraient connaître une croissance de 130 % entre 2002 et 2015 (ce qui représentera alors 132 milliards d’euros de dépenses de R&D) sur six secteurs : l’aéronautique, l’automobile, les automatismes industriels, les télécommunications, les équipements de santé et l’électronique grand public.

Dans ce domaine, la palme revient d’ailleurs aux industriels de l’automobile. Alors qu’en 2002, 22 % de leurs dépenses de R&D, soit 17 milliards d’euros, étaient consacrés au logiciel embarqué, rapporte l’Idate, elles devraient s’élever à 35 % en 2015 pour atteindre 45 milliards d’euros. L’aéronautique vient ensuite, avec des dépenses de R&D dédiées au logiciel embarqué qui passeront de 10 milliards à 20 milliards, puis l’équipement médical (5 milliards en 2002, 28 milliards d’euros en 2015) et enfin l’équipement télécoms qui passera de plus de 12 milliards d’euros en 2002 à plus de 20 milliards d’euros en 2015.

Le marché des systèmes embarqués est donc loin de se tarir.

Par Anne-Laure Béranger