Face aux projets chinois et américains, on trouve donc de nombreuses autres missions en cours de développement, en projet tout autour du monde. Le plus élaboré sur le papier est celui des Russes, mais tout le monde doute, à commencer par eux-mêmes, qu’ils aient les moyens humains, techniques et financiers de leurs ambitions.

Des Cosmonautes russes en 2030 ?

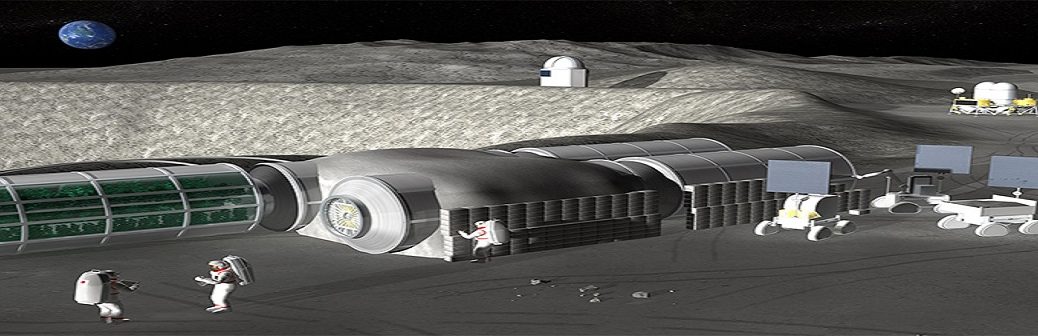

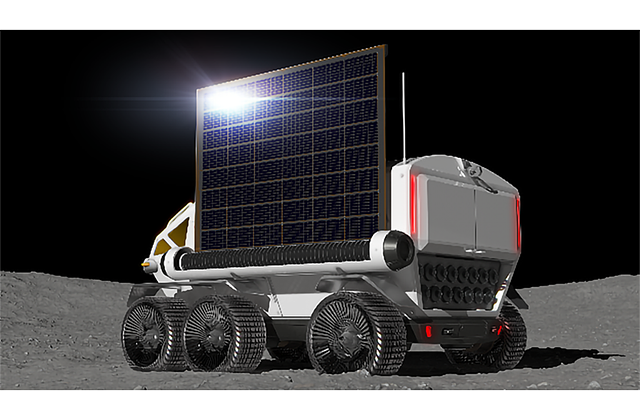

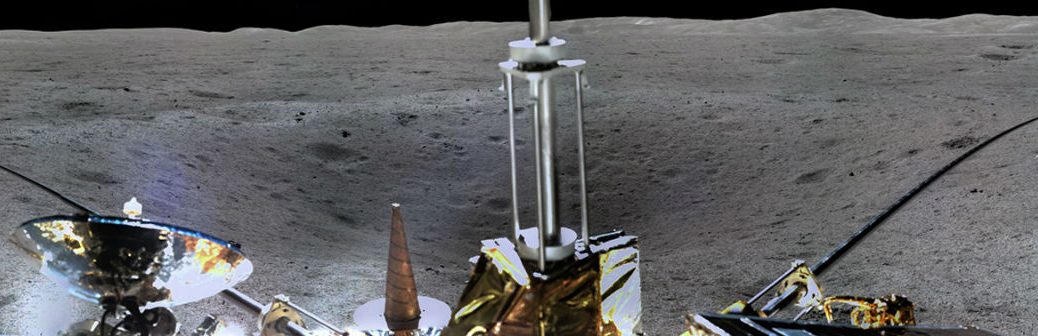

Le programme Luna d’exploration de la Lune par les Russes prévoit encore au moins 5 lancements qui doivent, à terme, permettre l’installation d’observatoires de l’espace profond et du système solaire. Luna 25, constitué d’un atterrisseur Luna-Glob, doit valider les techniques d’atterrissage et les systèmes de télécommunications, et effectuer une analyse du régolithe lunaire dans les régions polaires. La date de lancement est programmée à présent pour 2021. Luna 26 est un orbiteur (Luna Resours) qui doit être placé sur une orbite polaire de 100 km. Sa mission est de cartographier l’ensemble de la Lune, d’analyser l’exosphère et le plasma autour de la lune, d’identifier des sites d’atterrissage dans les régions polaires et de servir de relais de télécommunications pour les missions au sol. Sa date de lancement est prévue vers 2021 ; enfin Luna 27 est un atterrisseur, plus lourd, qui doit effectuer une analyse du régolithe lunaire jusqu’à 2 m de profondeur. Le forage doit être effectué par le système PROSPECT développé par l’ESA qui préserve la température des carottes de terrain prélevées. Lancement prévu pour 2022. Ensuite Luna 28 est une mission de retour d’échantillon et Luna 29 l’envoi d’un astromobile sur le sol. La suite du programme lunaire russe a fuité fin 2018 mais les budgets n’étant pas votés, l’agence Roscosmos a démenti les différentes parties parues dans la presse, précisant notamment que les dates n’étaient pas du tout fixées et que tant que le lanceur ne serait pas développé, aucune décision ne sera acquise. Dans ces documents, les premiers Russes sur la Lune seraient prévus pour 2031 et seraient suivis par l’envoi d’un équipage par an pendant 5 ans. Ces différents équipages devraient utiliser un rover et construire une base lunaire. Mais ce programme doit passer par le développement d’un lanceur lourd. Il devrait s’agir de Ienisseï – un développement qui fait partie du programme fédéral d’exploration de la Lune. Selon le décret signé par Vladimir poutine, l’avant-projet de cette fusée super-lourde doit être présenté en novembre 2019 pour un premier lancement en 2028.

Les modalités d’envoi d’un équipage sur la Lune ne sont pas gravées dans le marbre. Les projets feraient état du développement d’une station orbitale lunaire et de l’utilisation du vaisseau de transport Federatsia qui doit remplacer Soyouz et dont les premiers vols sont prévus dans les années 2020.

Coopération internationale derrière l’imagerie américaine

Si les Américains communiquent sur la grandeur de leur nation à travers la nouvelle conquête de la Lune, il faut tout de même souligner qu’une partie de leur projet s’appuie sur des coopérations internationales essentielles. En effet, la station orbitale Gateway a été conçue avec les partenaires internationaux déjà impliqués dans la gestion de l’ISS (en l’occurrence le Japon (JAXA), le Canada (CSA), l’Europe (ESA) et les Russes (Roscosmos) et les Etats-Unis (Nasa). Par ailleurs, la capsule de transport des astronautes, Orion, est alimentée par le module de service européen, chargé d’injecter la poussée finale du véhicule pour le mettre sur son orbite lunaire.

La Corée du Sud et Israël aussi se veulent lunaires

L’agence spatiale de la Corée du Sud (KARI) a initié un programme lunaire en 2016. Il repose sur la mise au point d’un lanceur de moyenne puissance et le développement d’un orbiteur de 500 kg (KPLO), dont le lancement est prévu fin 2020 et doit orbiter à une centaine de kilomètre au-dessus du pôle. Une deuxième phase envisage le développement d’un astromobile qui serait déposé à la surface de la Lune.

De son côté, Israël, a marqué l’histoire avec sa sonde Beresheet. Malgré un crash le 11 avril 2019, cette petite sonde, développée par une société privée israelienne, SpaceIL, est la première sonde aussi peu chère (90 millions d’euros) à atteindre la Lune. Et cet échec, n’est finalement qu’une étape puisque SpaceIL a d’ores et déjà annoncé travailler à Beresheet 2.

L’Inde, enfin dans les starting blocks ?

En 2019, l’Inde doit réaliser la mission Chandrayaan-2. Il s’agit de placer une sonde spatiale en orbite autour de la Lune et d’y déposer un atterrisseur (Vikram) et un rover (Pragyan). Longtemps retardée en raison d’abord de l’abandon de la coopération des Russes puis de nombreuses anomalies techniques, cette mission doit enfin décoller entre le 9 et le 16 juillet 2019 avec un alunissage prévu le 6 septembre. Le lancement sera assuré par le GSLV de troisième génération, un lanceur indien qui a maintenant fait ses preuves.

Les Japonais visent la précision

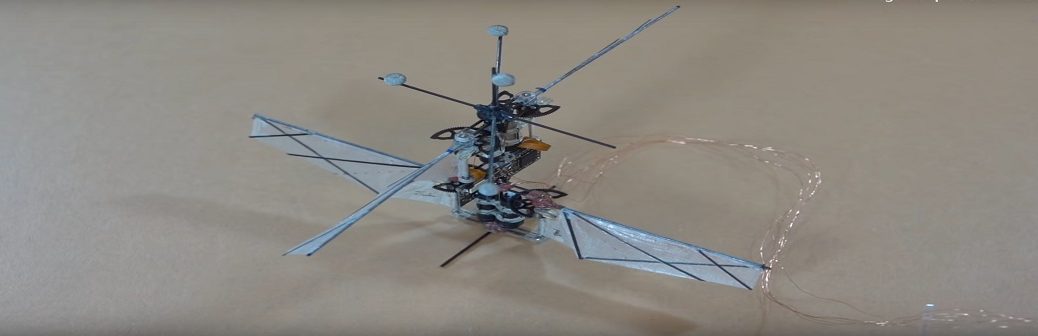

Comme les autres nations spatiales, les Japonais s’intéressent à la Lune. Hors le cadre de coopérations internationales (voir ci-après), ils développent de leur côté la mission SLIM, dont l’objectif est de faire atterrir un engin avec une précision de moins de 100m (l’ordre de grandeur de précision aujourd’hui est de l’ordre de 1km). L’atterrisseur en cours de développement fait quelques 400 kg et devrait être lancé en 2021 par une fusée Epsilon.

L’ESA veut s’appuyer sur des coopérations internationales

Jusqu’à maintenant l’agence spatiale européenne (ESA) envisageait la Lune essentiellement dans le cadre de coopérations internationales : développement d’un village lunaire, participation active à la construction du Gateway et à la capsule Orion, montage d’une mission lunaire Heracles avec l’agence japonaise JAXA et l’agence spatiale canadienne (le financement doit être voté ou non cette année) ou encore le financement de plusieurs projets via le fond LuxIMPULSE, dont par exemple le soutien de la filiale européenne de la société japonaise ispace, finaliste du Lunar GoogleXprize qui vient d’obtenir sa place pour des lancements en 2020 et 2021 avec SpaceX. Cependant, début 2019, l’ESA a demandé à ArianeGroup d’étudier la possibilité de monter des opérations minières sur la Lune d’ici 2025. Il s’agirait dans un premier temps d’extraire de l’eau et de l’oxygène du régolithe lunaire. Un objectif 100 % européen cette fois.

Les privés ne se privent plus

Les entreprises privées lorgnent sur la Lune. Pour faire du tourisme. Pour y exploiter les richesses. Pour y développer des services de transports de marchandises et/ou de personnes au profit des agences ou des nations. Les activités spatiales deviennent un secteur marchand comme un autre. Ou presque. En 2016 SpaceX propose des voyages touristiques cislunaires et le collectionneur d’art contemporain Yusaku Maezawa et sa bande d’artistes annoncent avoir acheté le premier vol prévu à bord du BFR. Mais ce projet prendra du retard et reste pour l’instant en instance car les autres programmes de SpaceX sont prioritaires. Face à cette annonce, les Russes avaient d’ailleurs riposté que le tourisme autour de la Lune était aussi possible à bord d’une capsule Soyouz modifiée : la société russe RKK Energia en partenariat avec Space Adventures l’avait alors proposée pour un coût compris entre 150 et 180 millions de dollars. Pour autant, aucun voyage n’est pour l’instant programmé.

Côté services, deux présentations ont pour l’instant marqué l’année 2019. Celle de Blue Origin et celle de Lockheed Martin. La société spatiale de Jeff Bezos, patron d’Amazon, a présenté en mai dernier Blue Moon, un atterrisseur lunaire grandeur nature qui est conçu pour le transport autant de rovers que de marchandises ou d’astronautes, en lui adjoignant un compartiment pressurisé. Une annonce qui est venue juste un mois après celle d’un autre américain, Lockheed Martin, qui a revu sa copie depuis sa dernière proposition jugée trop lourde. La firme part avec quelques temps d’avance sur d’autre puisque c’est elle qui a développé la capsule spatiale Orion. Cependant sur ce sujet la concurrence est rude. Et certaines petites sociétés, au fonctionnement plus souple et réactif pourraient bien emporter le marché de la Nasa.

Ainsi, comme on le voit, les candidats sont nombreux. Mais à présent, il faut que tous ces projets aboutissent et réussissent.