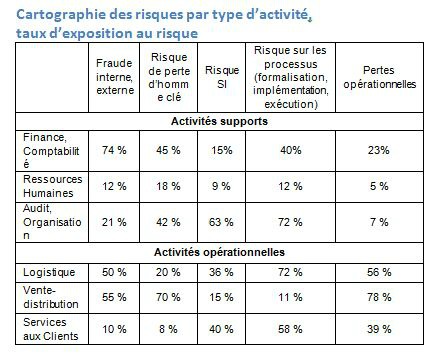

Au moment où les premières applications commerciales grand public arrivent sur le marché, il était temps pour la communauté scientifique qui explore ce nouveau monde de regarder avec un peu de recul ces trente années foisonnantes, de faire le point sur cette aventure, d’en esquisser l’histoire… et de célébrer le 30ème anniversaire de cette découverte.

Les quantum dots (QDs), ou boîtes quantiques, sont des structures matérielles solides de très petite taille, dotées de propriétés remarquables du fait essentiellement de cette petite taille. Leurs dimensions se mesurent en nanomètres, c’est-à-dire en milliardièmes de mètre et ils rassemblent un petit nombre d’atomes, de l’ordre de cent à cent mille. Les QDs peuvent avoir une structure plus ou moins complexe. Les plus simples sont juste des nanocristaux, c’est-à-dire un assemblage régulier d’atomes arrangés selon un motif géométrique précis. Comme des cristaux ordinaires, mais de dimensions extrêmement réduites. Les matériaux les plus étudiés sont des semi-conducteurs, en particulier des composés à base de cadmium, comme le séléniure de cadmium.

Les lois de la physique impliquent que ces dimensions réduites modifient profondément le comportement des électrons gravitant autour des noyaux de ces atomes. Leur confinement impose de nouvelles règles du jeu qui se traduisent par des propriétés électriques et optiques inédites très intéressantes. Par certains côtés, expliquent les chercheurs, un QD se comporte comme un gros atome artificiel.

Des propriétés exceptionnelles

La propriété la plus étudiée et exploitée des QDs est leur fluorescence. La communauté scientifique a découvert qu’un quantum dot, excité par une lumière incidente, émet de la lumière sur une fréquence très précise qui ne dépend que de sa taille. Lorsqu’on a su contrôler la taille des QDs, à partir de 1993, les chercheurs ont commencé à produire à volonté des QDs émettant de la lumière de n’importe quelle couleur, depuis l’ultraviolet jusqu’à l’infrarouge proche et lointain, en passant évidemment par le spectre visible. Une forme de QD plus complexe comporte en plus d’un nanocristal une « coque » constituée d’un second matériau, qui d’une certaine façon protège et donc renforce les propriétés du « cœur » qu’elle renferme. On peut encore attacher à cette coque des molécules, généralement des chaînes carbonées que l’on appelle « ligands », qui permettront notamment au QD de s’attacher à certains sites.

Du simple nanocristal, la recherche a ainsi mené au quantum dot « fonctionnalisé », capable notamment de se fixer sur des cellules présentant certaines caractéristiques, par exemple cancéreuses, et de permettre leur

localisation grâce à la fluorescence. D’autres travaux ont permis de contrôler également la forme des QDs. Des équipes ont ainsi publié des solutions pour réaliser des cylindres, des tétrapodes, des plaquettes. Ces nouvelles formes confèrent à ces QDs des propriétés insoupçonnées. Les premiers QDs étaient réalisés essentiellement à partir de composés du cadmium, un métal lourd, impliquant donc des précautions. De nombreux travaux de recherche ont progressivement démontré qu’il était possible d’utiliser d’autres matériaux, y compris des éléments chimiques moins nocifs et plus répandus.

Les milles usages du quantum dot

Les propriétés remarquables des quantum dots les destinent à un large spectre d’applications. Parmi les plus clairement identifiées, citons la réalisation d’écrans plats, de dispositifs d’éclairage, de panneaux photovoltaïques, de batteries et supercondensateurs, de lasers et de toutes sortes de dispositifs électroniques. Enfin, les qds seront à l’origine de nouvelles techniques d’imagerie par fluorescence et de bien d’autres progrès en médecine et biologie

ÉCRANS

C’est dans le domaine des écrans que les quantum dots ont fait leur percée la plus spectaculaire. On peut même les voir à l’œuvre depuis 2013, d’une part sur des téléviseurs grand format de la gamme Triluminos chez Sony, et d’autre part sur les dernières tablettes d’Amazon, les Kindle Fire HDX. La liste devrait s’allonger au cours de l’année 2014. En particulier, si l’on en croit des rumeurs persistantes, le premier smartphone doté d’un écran à quantum dots pourrait être… le prochain smartphone d’Apple. Pourquoi cet emballement ? Les fabricants d’écrans à cristaux liquides se ruent sur les quantum dots parce qu’ils promettent beaucoup. Notamment une gamme de couleurs bien plus étendue que celle qu’offrent les écrans LCD classiques. Actuellement, l’écran d’une tablette typique est capable de restituer environ 20% des nuances de couleurs qu’un œil humain peut distinguer, tandis que celui d’un téléviseur haute définition peut offrir quelque 35% de cette palette idéale. Les nouveaux écrans incorporant des quantum dots font un grand pas dans ce domaine en atteignant le chiffre de 55%.

SPECTRE DE COULEURS VISIBLE PAR L’OEIL

Cette première génération d’écrans faisant appel aux QDs utilise ces derniers au niveau du rétro-éclairage, où ils permettent de produire une lumière blanche optimisée. Typiquement, un éclairage LED primaire bleu excite deux sortes de QDs qui absorbent ce bleu pour émettre du vert et du rouge. Pas n’importe quel vert ou rouge, mais dans chaque cas une lumière d’une longueur d’onde très précise, ce qui est facile à réaliser à l’aide de QD puisque ceux-ci émettent sur une fréquence qui dépend essentiellement de leur taille, que l’on sait contrôler. La lumière blanche ainsi produite (bleu initial plus vert plus rouge) permet au système de filtres dichroïques de l’écran de produire un maximum de nuances de couleurs. QD Vision (Lexington, Massachusetts), une société créée par des chercheurs du MIT, propose ainsi sa solution Color IQ, qui a été choisie par Sony. De son côté, le pionnier californien Nanosys (Milpitas), spin-off de l’Université de Berkeley, produit en partenariat avec 3M une solution dénommée Quantum Dot Enhancement Film (QDEF) permettant de réaliser des écrans hauts en couleurs comme ceux des dernières tablettes Kindle Fire HDX d’Amazon. Les écrans des téléviseurs Sony Triluminos et les Kindle Fire HDX ne se contentent pas d’offrir un bouquet de couleurs inégalé. Les QDs permettent également de renforcer l’intensité lumineuse tout en réduisant la consommation électrique. Mais ce n’est pas fini. Les QDs devraient être utilisés demain dans une nouvelle génération d’écrans où ils joueront un rôle encore plus déterminant. Au lieu d’aider à produire une meilleure lumière blanche, ils émettront directement les compgosantes rouges, vertes et bleues de chaque pixel On parle de QDLED. Samsung a déjà présenté en 2010 un prototype de 10 cm de diagonale reposant sur ce principe.

ÉCLAIRAGE

Capables d’émettre à la longueur d’onde désirée, simplement en contrôlant leur taille, les QDs offrent ainsi en principe une solution simple pour fabriquer par synthèse additive tout type de lumière blanche adaptée à l’éclairage de nos intérieurs ou de lieux publics. Les ampoules àQD devraient donc prochainement concurrencer les modèles LED existants, dès que les industriels auront trouvé les solutions pour passer de la théorie à l’industrialisation. Ainsi le choix des matériaux utilisés n’est pas anodin. Or les QDs que l’on maîtrise le mieux à l’heure actuelle contiennent du cadmium, un élément chimique toxique que l’on ne peut employer dans un produit qui se retrouvera distribué en énormes quantités, facilement démontable et dont la fin de vie est difficilement contrôlable. C’est dans cette logique que se situent les recherches menées par une équipe du laboratoire Liten du CEA à Grenoble, en collaboration avec l’équipe de Peter Reiss, dans le cadre du projet Luminosurf. Ils ont abouti à la mise au point de quantum dots adaptés à la production de lumière, à fort rendement, mais reposant sur des matériaux non toxiques, ne contenant ni cadmium ni aucune « terre rare » (cette fameuse catégorie d’éléments chimiques disponibles en quantité limitée sur Terre et dont la Chine contrôle actuellement prés de 95% du marché). Le partenaire industriel du projet Luminosurf n’est autre que Philips, un acteur majeur du secteur de l’éclairage.

PHOTOVOLTAÏQUE

Un meilleur rendement à moindre coût, c’est ce que promettent les quantum dots dans le domaine des panneaux solaires photovoltaïques. La raison principale tient autant à des propriétés très complexes que nous nous garderons d’expliquer, qu’à des techniques de production drastiquement simplifiées par rapport aux lourds investissements requis pour les technologies actuelles à base de silicium amorphes ou de cristallin. De nombreuses équipes sont dans la course mais jusqu’à présent les meilleurs rendements obtenus en laboratoire tournentautour de 8,5%, alors que les panneaux du commerce offrent jusqu’à 20% et que le record en laboratoire pour une cellule multicouche est de 44,7%. Mais le jeu en vaut la chandelle puisque la théorie fixe à 87% le rendement maximum d’une cellule à QD. On estime que des rendements de l’ordre de 60% sont atteignables. Ainsi une équipe du MIT a publié l’année dernière dans Advanced Materials sur un nouveau type de cellule solaire utilisant des QDs de PbS et des nanofils d’oxyde de zinc. Un rendement de 4,9% a ainsi été obtenu.

En décembre dernier, une équipe du Los Alamos National Laboratory a publié dans Nature Communications des travaux portant sur une cellule photovoltaïque incluant des QDs CuInSeS, réalisés essentiellement à partir de cuivre, du coup non toxique et promettant un faible prix de revient. Le rendement obtenu dépassait les 5%. De son côté, le laboratoire de Edward Sargent, à l’Université de Toronto au Canada, a publié dans la revue ACS Nano un article annonçant un nouveau record avec un rendement de 8,5 %.

STOCKAGE DE L’ÉLECTRICITÉ

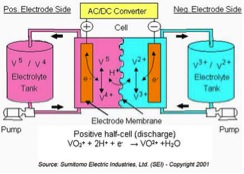

Les quantum dots devraient également trouver leur place dans le domaine du stockage de l’énergie électrique. Des travaux portent actuellement sur des batteries, de supercondensateurs et de dispositifs mixtes, à la fois batteries et supercondensateurs.

Rappelons que les batteries stockent l’énergie par le biais d’une réaction chimique réversible tandis que les supercondensateurs, qui ne sont rien d’autre que de très gros condensateurs, se contentent de stocker des charges électriques. Chez les premières, le procédé est électrochimique, chez les seconds il est électrostatique. Les batteries stockent beaucoup plus d’énergie par kilo que les supercondensateurs, mais ces derniers leurs sont supérieurs en termes de puissance : ils absorbent et délivrent l’énergie en des temps beaucoup plus brefs.

Pourquoi des quantum dots dans ce contexte ? C’est très compliqué, mais disons que l’on est ici à la recherche de surface et que les dimensions infimes des QDs apportent justement cela : un excellent rapport surface sur volume. Les recherches avancent, les produits ne devraient pas tarder

LASERS, CAPTEURS, ÉLECTRONIQUE, INFORMATIQUE…

On peut encore ajouter bien des choses dans la liste des applications des quantum dots. De nouveaux lasers ont ainsi déjà vu le jour. De nouveaux capteurs de lumière, reposant sur les QDs, devraient également trouver de multiples usages. Mais des bouleversements bien plus lourds sont possibles. Ainsi, certains imaginent que c’est une nouvelle ère de l’électronique qui pourrait s’ouvrir. Au moment où l’industrie électronique a poussé la miniaturisation des puces si loin que certains dispositifs ne fonctionnent plus selon les lois habituelles, elle pourrait enfourcher un nouveau cheval avec ces minuscules QDs dotés d’intéressantes propriétés. Enfin, notons que l’une des voies empruntée par l’informatique quantique, qui nous promet de ridiculiser les ordinateurs actuels, est le quantum dot.

MÉDECINE, BIOLOGIE

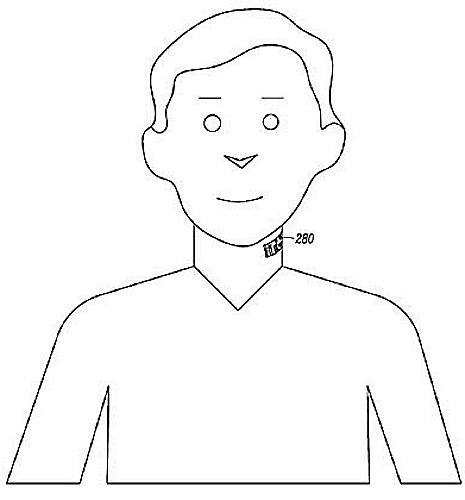

Les quantum dots sont porteurs de grands espoirs en médecine. Leurs propriétés de fluorescence les a rapidement désignés comme potentiels biomarqueurs mais on leur a depuis trouvé encore d’autres emplois, y compris dans le champ de la thérapeutique. Non seulement leur fluorescence est puissante et stable, mais en plus il est possible de choisir la fréquence d’émission, donc la couleur, simplement en contrôlant la taille des QDs, ce que l’on sait très bien faire. La bande d’émission est étroite, ce qui ouvre la perspective d’utiliser de nombreux QDs de couleurs différentes en même temps… Restait à fixer sur ces QDs des molécules « ligands » capables de s’attacher à leur tour aux sites que l’on veut repérer dans un contexte biologique, cellules ou tissus in vitro, ou organisme vivant. Deux équipes, Paul Alivisatos à l’Université de Berkeley et Shuming Nie à l’Université de l’Indiana, démontrent en 1998 la viabilité de cette approche. Depuis lors, les expérimentations de ce type se multiplient.

Une première catégorie de techniques médicales reposant sur les quantum dots consiste à détecter, quantifier, localiser des molécules biologiques sur des prélèvements effectués sur un patient. On parle de diagnostic in vitro. Dans ce type d’applications, les QDs ne sont pas injectés dans le corps du patient et sont manipulés par un personnel qualifié. Les QDs contenant des métaux toxiques comme le cadmium ou le plomb peuvent donc être utilisés dans ce contexte. Ce sont ceux que l’on connaît le mieux et dont on sait aujourd’hui tirer le maximum. Une seconde catégorie d’applications des QDs en médecine relève du diagnostic in vivo. Ainsi, dès 2004, Sungjee Kim au MIT fait appel à des QDs émettant dans le proche infrarouge pour guider la main du chirurgien recherchant chez la souris et le porc un « ganglion lymphatique sentinelle » signalant le début d’une propagation d’un cancer par métastases. D’autres équipes ont depuis développé toutes sortes de techniques d’imagerie reposant sur ce principe, permettant de visualiser directement, in vivo, en temps réel pendant l’intervention,

les limites d’une tumeur ou plus généralement de tissus porteurs de molécules signalant par exemple un état pathologique. Pour ce type d’application, la question de la toxicité des QDs devient cruciale. C’est pourquoi de nombreuses équipes cherchent à remplacer le cadmium et les autres métaux toxiques par des éléments chimiques mieux tolérés par l’organisme.

La liste des applications potentielles des QDs dans le domaine médical et plus généralement en biologie est déjà longue. On sait de mieux en mieux fabriquer des QDs capables de s’attacher à toutes sortes de molécules biologiques, des plus simples à l’ADN en passant par des protéines impliquées dans toutes sortes de processus biologiques. Les QDs ont donc vocation à se retrouver employés dans de nombreuses démarches médicales, de la détection d’agents infectieux, de gènes, protéines ou autres à l’imagerie en cours d’intervention chirurgicale. Aux dernières nouvelles, applications thérapeutiques sont envisageables, le QD servant de véhicule pour une molécule active. Mieux, les QDs se révèlent utiles dans la recherche de nouveaux médicaments.

LES PRÉVISIONS DE CROISSANCE

Une étude de marché publiée en janvier 2014 par la firme Markets and Markets (M&M) estime le marché des quantum dots à 108 millions de dollars (78,5 M€) en 2013 et pronostique un volume de 3,4 milliards de dollars (2,47 milliards d’euros) pour 2020. Le taux de croissance annuel moyen serait de 71%. De son côté, une autre étude de marché sortie en avril 2014 et réalisée par BCC Research annonce un marché des QDs de 121 M$ (87,4 M€) en 2013 et prévoit un chiffre d’affaires de 1100 M$ (795 M€) dès 2016 et de 3100 M$ (2240 M€) en 2018. Ce qui représente une croissance annuelle moyenne de 91%. Ces deux sources envisagent donc une évolution explosive du marché des QDs, qui dépasserait donc les 3 milliards de dollars dès 2020 ou même dès 2018.

LES MARCHÉS D’AVENIR

Les deux études sont d’accord sur un point, le secteur d’applications dominant sera, du moins à court terme, celui des écrans (téléviseurs, ordinateurs, tablettes, portables). M&M prévoit ainsi un chiffre d’affaires de 2,46 milliards de dollars (1,78 milliard d’euros) pour ce secteur en 2020. Ajoutons que QD Vision, qui connaît bien le sujet puisqu’elle fournit Sony, prévoit de son côté un marché de 2 milliards de dollars dès 2014. Ces perspectives ont déjà suscité quelques vocations. Parmi les success stories du quantum dot, il faut d’abord citer celle de QD Corporation. Fondée en 1998 pour industrialiser les QDs mis au point dans l’équipe de Paul Alivisatos au Lawrence Berkeley National Laboratory, QD Corp. trouve rapidement 37,5 M$ de fonds et commercialise en 2002 le premier biomarqueur à QD. Indice de l’intérêt que porte l’industrie à cette percée technologique, le pionnier QD Corp. est racheté dès 2005 par Invitrogen, qui est lui même marié en 2008 à Applied Biosystems pour devenir Life Technologies, à son tour racheté en 2013 par Thermo Fisher Scientific, leader mondial des instruments et réactifs médicaux et scientifiques, qui réalise 17 milliards de dollars (12 milliards d’euros) de chiffre d’affaires. Autre success story édifiante, celle de QD Vision (Lexington, MA), créée par des chercheurs du MIT en 2001.

Elle lève en tout 75 M$ et présente en 2006 le premier écran à quantum dot, et se retrouve dès 2013 fournisseur de Sony pour équiper de la technologie Color IQ ses modèles haut de gamme Triluminos. De son côté, Nanosys (Milpitas, CA) a été créée également en 2001 par des chercheurs de l’Université de Berkeley, dont Paul Alivisatos. Elle a levé depuis quelque 150 M$ de fonds. Sa technologie QDEF est aujourd’hui incorporée dans un produit grand public, la dernière génération de tablettes Kindle Fire HDX d’Amazon.

Pour compléter le tableau, citons une aventure européenne. Nanoco (Manchester, GB) est issue d’équipes de chercheurs de l’Université de Manchester et de l’Imperial College de Londres. Depuis sa création en 2001 elle a levé 25 M$. Nanoco s’intéresse notamment aux QDs sans cadmium, pour lesquels elle a signé un accord de licence exclusif avec le géant de la chimie Dow Chemical. Ses produits visent les marchés des écrans, de l’éclairage et de l’énergie solaire.

L’EQUIPE DE L’ESPCI PARISTECH

En 2002, Benoît Dubertret obtient un poste CNRS à l’École Supérieure de Physique et de Chimie Industrielles de la Ville de Paris (ESPCI ParisTech). Il vient de finir un post-doc de quatre ans et demi à l’Université Rockefeller (NY, NY) auprès d’Albert Libchaber, l’un des spécialistes des quantum dots, encore peu nombreux à cette époque. Benoît Dubertret en est persuadé, les quantum dots représentent un sujet promis à un avenir radieux. Les applications sont innombrables, les débouchés représentent des milliards. Il vient lui-même de réaliser un petit exploit en publiant10 la première utilisation biologique de QD in vivo. En France, les QDs n’ont pas encore suscité beaucoup de vocations. On ne compte guère que les équipes de Peter Reiss au CEA de Grenoble, et de Maxime Dahan à l’École Normale Supérieure de la rue d’Ulm (Paris), les deux depuis 2000. L’ESPCI ParisTech accueille favorablement la proposition de Benoît Dubertret de créer de toutes pièces une nouvelle équipe autour du thème des quantum dots, au sein du Laboratoire de Physique et Études des Matériaux (LPEM). Benoît Dubertret construit brique après brique à partir de 2002 l’équipe qui deviendra connue sous ce nom qui fait irrésistiblement penser à un groupe de rock : les Parisian Quantum Dots.

Pour en savoir plus : blog.espci.fr/qdots

.jpg)

.jpg)

.jpg)