Des dispositifs thermoélectriques sont commercialisés depuis les années 1950 principalement pour la thermométrie et la réfrigération, et, depuis les années 2000, pour la réfrigération d’appareillages portatifs. Cependant, le faible rendement de conversion de ces derniers, dû aux limitations des propriétés des matériaux thermoélectriques courants, ne permet pas une utilisation commerciale à grande échelle de ces propriétés. C’est le cas aussi des premières thermopiles réalisées en 2005, dont le coût élevé et le faible rendement les limitent pour l’instant à des utilisations très ciblées. Depuis les années 1990, les préoccupations énergétiques de la planète ont engendré un nouvel intérêt pour la thermoélectricité dans le cadre du développement des énergies renouvelables. En effet, la thermoélectricité pourrait permettre de recycler la chaleur perdue par de nombreux systèmes. Par exemple, le recyclage de la chaleur accumulée dans les tuyaux d’échappement des voitures ou les cheminées industrielles pourrait permettre la production d’une électricité propre et peu chère. Dans le cas des véhicules motorisés, il suffirait simplement de doubler l’efficacité des modules thermoélectriques pour produire suffisamment d’énergie pour remplacer l’alternateur, ce qui par conséquent augmenterait la durée de vie du véhicule.

Sur les 15 dernières années, la recrudescence des recherches pour les matériaux thermoélectriques a ainsi permis des avancées scientifiques significatives telles que la découverte de nouveaux matériaux, l’utilisation de la nano-structuration afin de maîtriser les propriétés électroniques et thermiques de ces matériaux, une meilleure connaissance de ces matériaux et une meilleure compréhension des différents mécanismes responsables des propriétés thermoélectriques.

Record de performance

Afin d’évaluer la performance thermoélectrique d’un matériau, les scientifiques utilisent une grandeur appelée facteur de mérite ou « ZT ». Ce nombre représente le rapport de la conductivité électrique et de la puissance thermoélectrique du matériau sur sa conductivité thermique. Ainsi, pour améliorer la performance du matériau, il est nécessaire de maximiser sa conductivité électrique et sa puissance thermoélectrique, tout en minimisant sa conductivité thermique. Or, il est difficile d’agir sur l’un de ses paramètres sans en compromettre un autre. A cause de ces exigences contradictoires, le facteur de mérite a stagné à une valeur située autour de l’unité pendant des années.

En septembre 2012, des chimistes, physiciens, spécialistes des matériaux et ingénieurs en mécanique de l’Université Northwestern et de l’Université de l’Etat de Michigan, ont travaillé en étroite collaboration pour développer un nouveau matériau thermoélectrique détenant le record mondial d’efficacité de conversion chaleur-électricité, avec un facteur de mérite de 2,2. L’équipe avait déjà commencé à progresser régulièrement depuis quelques mois, avec des valeurs de ZT de plus en plus hautes, grâce à l’introduction de nanostructures au sein de leurs alliages. Ainsi en janvier 2011, ils avaient déjà atteint une valeur de 1,7 avec leur première utilisation de nanostructures au sein d’une matrice de tellurure de plomb, permettant de réduire la diffusion des électrons au sein du matériau et d’en augmenter la performance thermoélectrique. Le nouveau matériau qu’ils ont réalisé, toujours à base de tellurure de plomb, devrait convertir en électricité utile, de 15 à 20% de la chaleur perdue. La découverte a été publiée dans le journal Nature.

Ce record a été réalisé en diffusant un spectre plus large de phonons (quantums d’énergie vibrationnelle), balayant toutes les longueurs d’onde, ce qui permet de réduire significativement la conductivité thermique. L’équipe est la première à proposer une telle approche dite « panoscopique ». L’approche panoscopique combine trois techniques afin de diffuser simultanément les phonons de petites, moyennes et grandes longueurs d’onde. En particulier, ils ont su améliorer la diffusion des phonons de grandes longueurs d’onde en contrôlant et en adaptant l’architecture du matériau à l’échelle mésoscopique, une approche qui va bien au-delà de la simple nanostructuration.

Selon les auteurs de l’étude, un intérêt remarquable de l’approche panoscopique est qu’elle est applicable à tout matériau thermoélectrique.

Recherche de meilleurs alliages

De nos jours, les matériaux thermoélectriques les plus efficaces sont réalisés à partir d’alliages comportant des matériaux semi-conducteurs relativement rares tels que le bismuth, le tellure et le sélénium. Les propriétés inhabituelles de thermoélectricité proviennent en effet des interactions complexes entre les nombreux électrons contenus dans les alliages de ces métaux lourds. Cependant ceux-ci sont chers, fragiles et souvent toxiques. Les scientifiques cherchent ainsi des alternatives, tout en s’efforçant d’optimiser le rendement de conversion thermoélectrique.

Méthode de recherche

En juin 2013, des chercheurs de l’Institut de Technologie de Californie (Caltech) et de l’Université de Tokyo ont publié un article dans le journal APL Materials, dans lequel ils démontrent l’efficacité d’une approche dite « approximation de bande rigide » pour prédire les propriétés thermoélectriques d’un matériau. Afin de créer de nouveaux matériaux avec un rendement de conversion thermoélectrique toujours plus élevé, plusieurs variables doivent être prises en compte : la composition des alliages évidemment, mais aussi la taille des cristaux ainsi que les dopants. Les combinaisons possibles étant extrêmement nombreuses, des calculs théoriques sont nécessaires pour guider les choix et, vu l’extrême complexité des matériaux thermoélectriques, des hypothèses de calcul sont nécessaires.

Aujourd’hui, les deux principales approches sont : « l’approximation de bande rigide », qui fournit un modèle relativement simple de la structure électronique du matériau, et « l’approche de supercellule », plus complexe mais permettant d’obtenir de façon plus détaillée l’arrangement atomique idéal et donc d’évaluer, pense-t-on, plus précisément les propriétés thermoélectriques du matériau. La découverte des chercheurs de Caltech et de l’Université de Tokyo, contredit ces affirmations : « l’approximation de bande rigide » est en fait la méthode la plus précise. Utilisant cette dernière méthode, ils ont en effet prédit plus précisément les propriétés de l’un des matériaux thermoélectriques les plus connus, le tellurure de plomb dopé au sodium, potassium ou thallium. Ils expliquent que la méthode de supercellule décrit uniquement les matériaux thermoélectriques contenant certains types de dopants car elle ne prend pas en compte les différents défauts présents dans les matériaux réels.

Cette découverte est encourageante, car elle permettra aux chercheurs d’identifier plus rapidement les compositions des alliages ayant les propriétés thermoélectriques les plus prometteuses.

Un alliage non toxique et particulièrement performant

Un nouvel alliage thermoélectrique particulièrement performant, et composé de matériaux non toxiques, a récemment été réalisé par des physiciens de l’Université de Houston et du Centre pour la Superconductivité du Texas. Leur travaux, menés en collaboration avec des chercheurs de l’Institut de Technologie du Massachusetts et du Collège de Boston, ont été publiés en juillet 2013 dans les comptes-rendus des Académies Nationales Scientifiques américaines.

Ce nouveau matériau, particulièrement performant pour la transformation chaleur-électricité, est un alliage de tellurure d’étain, dopé à l’indium. Jusqu’ici le tellurure a beaucoup été étudié pour ses excellentes propriétés thermoélectriques, mais peu utilisé commercialement car il avait toujours été associé à du plomb, lequel présente des risques pour la santé. L’équipe texane a réussi à réaliser un composé similaire mais plus sain en s’affranchissant du plomb. Après plusieurs essais de dopants, ils ont trouvé que les propriétés thermoélectriques du tellurure nanostructuré dopé à l’indium étaient les plus prometteuses. Les impuretés d’indium créent un phénomène de résonance permettant aux électrons de transporter en moyenne plus de chaleur, ce qui induit un « coefficient de Seebeck » plus élevé.

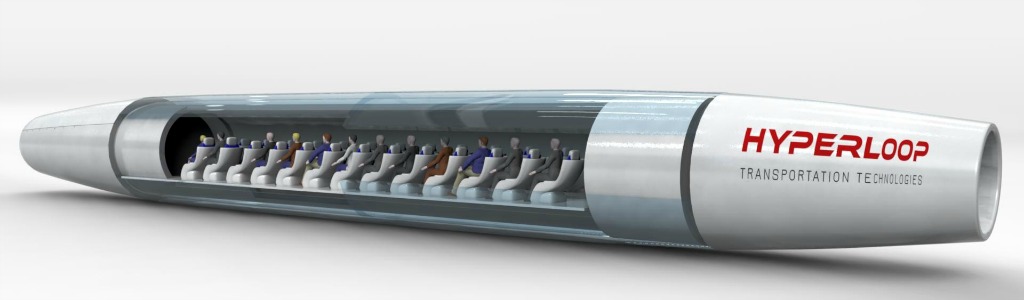

Les auteurs de l’étude travaillent maintenant à la réalisation d’un module thermoélectrique, dont l’intégration au sein de véhicules devrait permettre un gain de 5% sur le kilométrage, et l’intégration au sein de centrales électriques une augmentation de 10% du taux de conversion.

Matériaux thermoélectriques organiques

Utilisation de semi-conducteurs organiques

Des chercheurs de l’Université de Michigan (U-M) se sont intéressés à une classe spécifique de matériaux thermoélectriques, réalisés à partir de semiconducteurs organiques. Alors que ces composés n’étaient jusque là pas considérés comme de bons candidats pour la réalisation de modules thermoélectriques à cause de leur faible facteur de mérite, l’étude publiée en mai 2013 par l’équipe de l’U-M montre qu’ils sont parvenus à en doubler l’efficacité.

L’intérêt d’utiliser des semiconducteurs organiques provient de ce que ces composés riches en carbone sont relativement peu chers, abondants, légers et résistants. Jusqu’ici, leur facteur de mérite était cependant de l’ordre de 0,25, soit un quart de celui des semiconducteurs inorganiques couramment utilisés. Avec la nouvelle méthode proposée par les chercheurs de l’U-M, cette valeur vient de battre un record de 0,42, soit une amélioration de 70%. Pour cela, ils ont utilisé un mélange de deux polymères, « PEDOT-PSS » : le polymère conjugué PEDOT et le polyélectrolyte PSS. Ce composé a été précédemment utilisé en tant qu’électrode transparente pour des dispositifs tels que des LEDs et des cellules solaires organiques, ainsi qu’en tant qu’agent antistatique pour des matériaux tels que les films photographiques.

L’étude explique que lors du dopage du PEDOT par PSS, seule une petite fraction des molécules de PSS se lie au matériau hôte PEDOT. Alors que ces molécules de PPS liées améliorent la conductivité électrique du matériau, le reste des molécules PSS non ionisées et inactives, produisent l’effet inverse : elles séparent les unes des autres les molécules de PEDOT, rendant le passage des électrons d’une molécule de PEDOT à l’autre plus difficile. Pour s’affranchir de cet inconvénient, les chercheurs ont restructuré le matériau à l’échelle nanométrique. Ils ont alors trouvé un moyen de retirer certaines des molécules de PPS non ionisées du mélange grâce à l’utilisation de solvants spécifiques, entrainant ainsi une grosse augmentation à la fois de la conductivité électrique et de l’efficacité de conversion énergétique par thermoélectricité.

Il est intéressant de noter qu’à l’inverse des matériaux thermoélectriques inorganiques, pour lesquels un compromis doit être établi pour décider lequel des paramètres du facteur de mérite sera optimisé au dépend des autres, l’approche présentée ici dans le cas de matériaux thermoélectriques organiques montre une méthode qui optimise l’ensemble des paramètres à la fois.

Des applications intéressantes à cette nouvelle technologie pourraient voir le jour à moyen terme ; en particulier, la création d’une feuille flexible thermoélectrique qui pourrait se déployer ou s’enrouler autour d’objets chauds afin de générer de l’électricité ou de les refroidir.

L’intérêt d’une interface organique/inorganique

Une autre équipe, du Laboratoire Berkeley, s’est intéressée aux matériaux thermoélectriques fabriqués à partir de polymères et nanocristaux, qui présentent l’intérêt d’être significativement moins chers à fabriquer que les matériaux thermoélectriques traditionnels. Ils ont ainsi réalisé un matériau composite dont la performance thermoélectrique est meilleure que l’addition des performances de chacun de ses composants. Leur étude a été publiée en mars 2013 dans le journal Advanced Materials. Le matériau a été réalisé à partir de nanofils de tellure et du polymère conducteur PEDOT:PSS. Afin d’expliquer ce résultat, les chercheurs ont modélisé leurs films en les assimilant à un composite comportant trois matériaux : les nanofils, le volume du polymère et une nouvelle phase interfaciale polymère/nanocristal présentant une conductivité électrique accrue.

Ainsi la découverte de cette nouvelle phase à l’interface, ayant un caractère hautement conductif, ouvre la voie à de nouvelles méthodes pour l’amélioration des matériaux thermoélectriques hybrides. Il est intéressant de noter que ce résultat peut aussi être utilisé à d’autres matériaux composites polymère/nanocristal, notamment ceux utilisés dans le domaine du photovoltaïque, des batteries et du stockage de l’hydrogène.

Innovation remarquable : une nouvelle méthode d’amélioration des performances

En mars 2013, des chercheurs du MIT et de l’Université Rutgers ont présenté dans le journal Advanced Materials une nouvelle méthode permettant d’augmenter les performances thermoélectriques des matériaux, grâce à l’utilisation de nanocomposites dont ils contrôlent la composition, les dimensions et la densité des nanoparticules incluses. L’étude est pour l’instant uniquement théorique, et présente la simulation numérique d’un tel matériau, montrant comment optimiser son facteur de mérite en jouant sur chacun des paramètres du facteur.

Un nouveau concept y est présenté, dans lequel les chercheurs profitent d’un phénomène d’antirésonance pour laisser passer les électrons de plus haute énergie dans le matériau tandis que les phonons (particules virtuelles transportant la chaleur) sont arrêtés par les nanoparticules car de moindre énergie. De plus, les nanoparticules qui « attrapent » les phonons s’avèrent même aider le passage des électrons.

La prochaine étape du travail sera donc de réaliser de premiers dispositifs tests, pour lesquels de nombreux challenges expérimentaux demeurent.

Source : Bulletins électroniques

Et aussi dans les

ressources documentaires :