Le phénomène de grippage peut intervenir dans de nombreux systèmes mécaniques complexes. Il résulte d´un déséquilibre thermique fort entre l´énergie fournie et l´énergie dissipée et se matérialise sous différentes formes comme par exemple une augmentation brutale du coefficient de frottement, l´échauffement et la destruction des pièces mécaniques en contact et/ou le blocage des mouvements du système mécanique. Eviter ce type de défaillance constitue un enjeu majeur pour les concepteurs de moteurs thermiques, en particulier chez les constructeurs automobiles. En effet, un premier prototype qui présente un comportement de grippage, engendre des retards et des coûts supplémentaires que l’on peut estimer entre 1 à 2 millions d´euros pour un moteur prototype et les tests, sans compter les coûts supplémentaires engendrés par le retard du projet qui augmentent fortement lorsqu´on approche de la série.

Les causes du grippage d´un système peuvent être multiples : jeu trop faible, jeu trop fort, surface agressive, pollution… Une chose est sûre : un modèle permettant de prédire le grippage et d´aider à faire des recommandations sur la conception constitue un atout critique pour le concepteur. L´objectif d’un tel modèle, est de décrire le comportement physique global d´un système mécanique lubrifié, en calculant le comportement du système en un nombre de points limité et pour les quantités physiques nécessaires à la prédiction du grippage. Ce type de modélisation, aussi appelée modélisation 0D-1 D, se concentre sur la description du comportement physique en fonction du temps. Contrairement aux modélisations détaillées, telles que les éléments finis, il permet une bonne interprétation physique des résultats et offre également des possibilités d´optimisation bien plus puissantes et plus rapides.

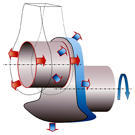

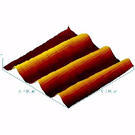

Le modèle développé par Renault est constitué de deux parties. Une première partie sert à constituer des tables de données à partir d´une modélisation déjà existante de la lubrification. La seconde partie traite des aspects relatifs à la thermique en s´appuyant sur ces tables de données. Physiquement, l´ensemble des modélisations, prend en compte deux surfaces mécaniques cylindriques en situation de lubrification mixte. Les phénomènes physiques en jeu sont nombreux et très complexes :

- lubrification (équations de films rugueux minces visqueux à faible nombre de Reynolds) ;

- cavitation (changement de phase dans le film d´huile) ;

- fluides non newtoniens (piezoviscosité et effet du taux de cisaillement) ;

- couplage élasticité-paroi ;

- cisaillement d´huile (échauffement) ;

- microcontacts engendrant du frottement (échauffement par microcontacts) ;

- conduction et convection forcée (thermofluide).

Le modèle a été construit en décrivant l´ensemble de ces phénomènes à partir de leurs équations dans le logiciel Maple de Maplesoft. L´écriture des équations a été largement facilitée avec l´interface document technique de Maple qui permet l´écriture naturelle d´expressions mathématiques.

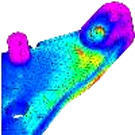

Le modèle paramétrique construit avec Maple permet de prévoir les risques de grippage et de mieux comprendre son mécanisme. La « surchauffe » et le grippage qui s´ensuit interviennent en un temps très court, mais il st aussi important de bien connaître les conditions qui mènent à la « surchauffe » parfois sur de longues durées. Le modèle 0D/1 D construit avec Maple permet également de construire des cartographies du grippage en fonction de multiples paramètres. Plus généralement il permet de prédire le comportement au grippage en fonction d´un jeu donné de paramètres.

« Le modèle paramétré construit avec Maple permet d´appréhender plus de physique dans les modélisations de phénomènes et ainsi apporter des réponses là où les codes classiques n´apportent rien » rapporte M. Ligier, Responsable R&D à Direction de la Mécanique chez Renault. « Cette approche permet de faire des itérations rapides pour construire des cartographies ou des analyses de sensibilité et à répondre, dans des délais très courts, aux nouveaux challenges que tout développement industriel concurrentiel doit relever. »