L’association professionnelle du secteur, l’Afhypac, organisatrice aux côtés de la métropole Aix-Marseille Provence, et des CCI du Var et de Marseille Provence, n’a pu que se féliciter de la montée en puissance du secteur hydrogène, qui se traduit par une forte progression des membres. En 15 mois, signale Philippe Boucly, le président de l’association, le nombre d’adhérents est passé d’une centaine à 160, et ce n’est pas fini. Une montée en puissance aidée par les groupes de travail mis en œuvre par l’Afhypac à l’aune de la reconnaissance de l’hydrogène dans la programmation pluriannuelle de l’énergie, du plan hydrogène maintenu après le départ de Nicolas Hulot l’an dernier, mais aussi du soutien du Président de la République. Comme l’indique Christelle Werquin, déléguée générale de l’Afhypac, l’hydrogène dispose du soutien au plus haut niveau de l’état et la filière avance. Reste à passer à la vitesse supérieure et à la « massification », le mot-clé de ces deux journées marseillaises.

A l’occasion des journées marseillaises, l’Afhypac a également dévoilé sa plateforme en ligne Vig’Hy : l’observatoire de l’hydrogène en France (www.vighy-afhypac.org ). S’appuyant sur les remontées de l’ensemble des acteurs de la filière, Vig’Hy recense sur une seule et unique carte actualisée les projets, initiatives et stations de recharge en France.

Massifier la production et les usages

Stéphane Reiche, délégué général du grand port maritime de Marseille (GPMM), a rappelé que pour que l’hydrogène soit décarboné, il faut d’abord que l’électricité le soit aussi. A Marseille, 114 MW d’énergies renouvelables sont déjà installés, dont 33 MW en solaire et 31 MW en éolien. Déjà quelque 10 000 tonnes fatales d’hydrogène sont produites par Kem One, sur l’établissement de Fos-sur-Mer. Par électrolyse du sel, les ateliers de Fos-sur-Mer produisent en effet du chlore, de la soude et de l’hydrogène. Le chlore obtenu est consommé sur place, pour fabriquer du chlorure de vinyle monomère (CVM), par réaction sur l’éthylène, livré pour moitié à Kem One à Berre (Bouches-du-Rhône) ; le reste est expédié par barges vers le site de Saint-Fons (Rhône) où il est transformé en PVC.

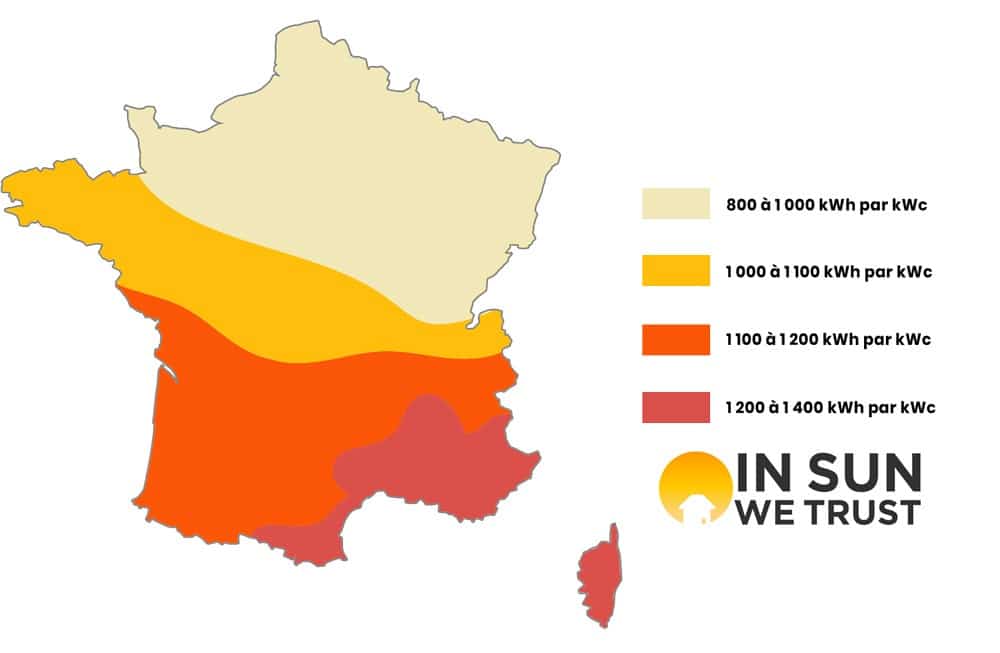

De son côté, la Chambre de commerce et d’industrie (CCI) du Var a soumissionné dès 2016 l’appel à projets « territoire Hydrogène ». Le programme Hynovar, qui repose sur un partenariat CCCI du Var, Engie Cofely, le circuit Paul Ricard, les Bâteliers de la Côte d’Azur et Hyseas Energy, prévoit l’installation de deux stations de production-distribution d’hydrogène et un développement de la mobilité terrestre et maritime hydrogène. Hynovar a été sélectionné le 3 mai dernier dans le cadre de l’appel à projets lancé par l’Ademe (Agence de l’environnement et de la maîtrise de l’énergie), « Ecosystèmes de mobilité hydrogène ». Ce projet porte notamment le déploiement d’une navette maritime dans le port de Toulon, et à terme Marseille s’inscrit aussi dans cet objectif. Elle porte également le projet H2Flex, labellisé Flexgrid par la Région, qui vise à modéliser le réseau électrique pour assurer un meilleur équilibre entre production des ENR et consommation des entreprises du plateau de Signes, via le stockage que permet l’hydrogène. A Signes, un projet fait ainsi appel à l’hydrogène pour stocker le courant produit par les panneaux photovoltaïques. Même combat du côté de sa voisine, la CCI Marseille Provence, qui mise sur une industrie historique existante, avec notamment un hydrogénoduc de 40 km reliant Fos-sur-Mer à Lavéra et des gazoducs pour valoriser l’hydrogène. Sans oublier la zone portuaire, moteur de la demande à venir. D’ores et déjà, un démonstrateur de « Power-to-gas » (électricité en gaz), Jupiter 1000 et porté par GRTgaz (le gestionnaire de réseau de transport de gaz) est opérationnel au nord de la plateforme PIICTO (plateforme industrielle et d’innovation du Caban-Tonkin), à Fos.

La Région Sud (ex-PACA) n’est pas en reste, via son plan climat régional. Elle soutient notamment le projet Jupiter 1000 ou Hynovar, mais aussi Hygreen Provence (un parc solaire de 1 500 hectares porté par l’agglomération Durance Lubéron Verdon permettant de produire de l’hydrogène vert, à hauteur de la consommation de quelque 1 400 bus, et de livrer un soutien au réseau électrique) ou encore Hyammed, qui vise à déployer une station d’approvisionnement sur le site portuaire industriel de Fos-sur-Mer. La Région peut d’ailleurs compter sur le pôle de compétitivité Capenergies, qui aide déjà une vingtaine de projets et anime l’écosystème hydrogène de la région, au sein du club H2 Sud.

Côté demande, le territoire a une ambition, avec quelque 7 000 trains par an, 3 000 barges fluviales, près de 3 000 chariots élévateurs, sans oublier les deux millions de poids lourds, dont 60% dans les Bouches-du-Rhône, l’hydrogène doit jouer un rôle dans la décarbonation des transports.

La façade maritime

Le branchement des navires à quai au réseau électrique (pour remplacer le diesel) n’est pas toujours possible. Là encore, l’hydrogène a une carte à jouer, en installant des piles à combustible. Marseille mais aussi Toulon se saisissent de cette carte, avec des projets de 2 MW. Franck Verbeke, d’Helion Hydrogen Power (ex-Areva Stockage Energy) souligne en effet que l’organisation maritime internationale a fixé des objectifs de réduction des rejets (CO2, SOx, NOx) de 30% en 2030 dans les ports et de 50% en 2050 par rapport à 2018. De nombreux usages peuvent être concernés, insiste-il, des grues mobiles, en passant par les tracteurs de conteneurs au sol, et pour certains types de navires. En Bretagne, un projet est en cours sur un petit ferry avec une pile à combustible de deux fois 1 MW, un projet hybride puisque doté aussi d’une batterie. Helion, associé à Orion Naval Solutions est également en train de travailler sur un projet de barge de transport fluvial, à Toulouse, avec un modèle hybride et une PAC de 80 kW à 150 kW.

Utiliser l’éolien offshore

L’hydrogène est également un moyen de stockage privilégié pour les surplus d’électricité renouvelable, via le Power to Gas. Au-delà du projet Jupiter 1000, en Vendée, le Sydev, le syndicat d’énergie vendéen, mise sur un projet similaire à terme, Vendée hydrogène. Au départ, trois éoliennes « historiques » de 2,5 MW du parc de Bouin (qui sont sorties du tarif d’achat) livreront environ 30% de leur production pour fabriquer 30 tonnes d’hydrogène par jour. Mais, à terme, indique Alain Leboeuf, président du Sydev et de Vendée Energie (la structure qui porte le projet, constituée avec deux autres syndicats d’énergies Soregies et Sergies et le soutien de la Caisse des dépôts), ce projet pourrait accueillir les surplus du futur parc offshore d’Yeu-Noirmoutier. En Méditerranée, à Port-la-Nouvelle, un projet identique se met en place avec pour horizon la future production de l’éolien offshore flottant.