La prise de décision dans une usine revêt des dimensions verticales (hiérarchiques) et horizontales (selon les activités réalisées dans l’usine).

Dans les faits, depuis plusieurs années déjà, on laisse des machines prendre des décisions en lieu et place des humains.

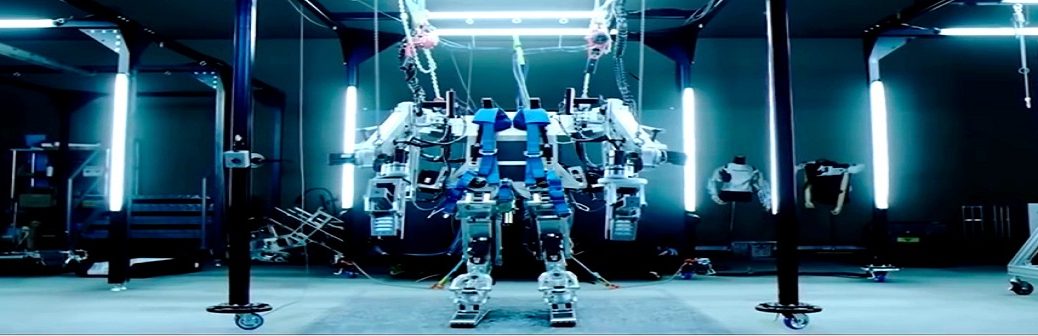

Ainsi, la robotique qui a remplacé la main-d’œuvre “humaine” sur les chaînes de montage se perfectionne inlassablement. Ces machines nécessitent plus de maintenance, mais accomplissent aussi de plus en plus de tâches de manière autonome. Elles ont absorbé la prise de décision sur des tâches pour lesquelles leur compétence est supérieure (rapidité de choix, d’exécution…) à celle des hommes.

Difficile d’imaginer une autre voie qu’une prise en main progressive et irréversible de l’ensemble des tâches dans l’usine pour lesquelles le “jugement” de la machine dépasse celui de l’homme. Cette assertion ne gênait personne tant qu’on parlait des choix standardisés sur une chaîne de montage, ou par exemple de maintenance prédictive, mais aujourd’hui la puissance de calcul permet à des ordinateurs de traiter rationnellement des quantités de données ahurissantes à des vitesses inaccessibles par l’homme.

Et du coup le rôle de la machine change : les capacités des ordinateurs rendent les robots intelligents et capables d’accomplir routinièrement des tâches extrêmement complexes. Voire des tâches que l’homme ne sait pas appréhender.

La machine devient intelligente. L’addition de la robotique, de l’intelligence artificielle et du deep learning, ensemble ou séparément, fournit des outils qui permettent de maximiser dans tous les sens du terme le rendement des usines. L’essor des objets/capteurs connectés donne un coup d’accélérateur supplémentaire à ce processus.

Un plafond de verre fragile

Pour le moment, le plafond de verre de cette évolution se situe au niveau des décisions stratégiques : celles pour lesquelles la substance des informations à mettre en cohérence pour aboutir à une décision n’est pas pondérable objectivement. Et pour cause, si ce n’était pas le cas, les chefs d’entreprises auraient un travail facile !

Mais là aussi, l’augmentation des capacités de calcul informatique risque de briser ce plafond de verre. Et plus vite qu’on ne le croit.

Aujourd’hui, plus rien ne permet de dire que l’agrégation d’informations disparates et complexes – voire subjectives – dans le but d’aboutir à la meilleure décision possible est hors de portée d’une machine.

Si l’homme arrive à prendre ces décisions, c’est qu’elles sont paramétrables. Et donc qu’on peut programmer un ordinateur pour les générer.

En fait, ce que révèle aujourd’hui notre incapacité à transférer cette capacité de décision à des machines réside en deux points :

D’abord, nous ne sommes pas prêts à le faire pour des raisons éthiques. Il est aujourd’hui inconcevable qu’une machine décrète un plan social dans une entreprise. Aussi, la peur – peur à l’origine de beaucoup d’œuvres de science-fiction – d’une intelligence artificielle qui échapperait au contrôle de l’homme aide à maintenir le plafond de verre évoqué plus haut.

Ensuite, le second point est plus lié au fait que certaines décisions stratégiques prises dans une usine font appel à un moment ou l’autre à des choix subjectifs (on pourrait dire “orientés”), c’est-à-dire non motivés par des arguments indiscutables, “numérisables” a priori.

Ce second point est très important parce qu’il révèle l’incapacité de l’homme à justifier certains choix de manière purement objective. D’où la construction verticale de la prise de décision, car il faut bien “trancher”.

Mais ce que cela implique également, c’est que l’incapacité à rationaliser certaines décisions, parce que les données sont trop nombreuses, rend impossible le projet de paramétrer un ordinateur pour le faire, par définition.

Aujourd’hui, l’intelligence artificielle associée au deep learning nous laissent à penser que si l’homme est incapable de rationaliser totalement tous les critères à prendre en compte dans une décision, l’ordinateur, lui, peut.

A ce titre, on voit mal pourquoi ces technologies ne supplanteraient pas également l’homme dans ces tâches décisionnaires, à terme.

D’ailleurs, les études se multiplient, expliquant que les chefs d’entreprise pourraient être parmi les premiers humains totalement remplacés par des machines. Ce n’est plus de la science-fiction.