Impossible de séparer usine du futur et processus de production : en effet, automatisation, robotisation, intelligence artificielle, toutes ces technologies permettront aux usines de demain de profiter d’outils de production plus performants et compétitifs.

Cela dit, quels seront les curseurs qui guideront ces nouveaux modes de production ? La volonté de personnalisation des produits ? Des modes de production moins énergivores ? L’avènement des pièces détachées pour réparer nos produits et augmenter leur durabilité ?

Un peu de tout ça en fait. Mais il ne faut pas s’y tromper, au-delà des toutes les contraintes qui pèsent sur la production et que l’usine du futur permettra de faire mieux cohabiter, le nerf de la guerre restera évidemment la consommation de ces produits au sens économique du terme.

Depuis un siècle, nous sommes passés d’un mode de production où la demande surpassait l’offre, à un système où c’est l’offre qui prédomine. Aujourd’hui, la production de masse constitue le mode de production majoritaire et entraîne les conséquences que nous connaissons :

- nécessité d’écouler les produits sur un territoire de plus en plus vaste ; c’est la mondialisation des échanges ;

- uniformisation des produits, directement liée au point précédent.

Casser les codes

Les smart factories cassent ces codes en brèche. Aujourd’hui, les attentes des consommateurs évoluent rapidement. Non seulement nous ne voulons plus acheter des produits uniformisés voire aseptisés, mais nous attendons également que le marché réponde de manière quasi immédiate à des besoins qui évoluent sans cesse.

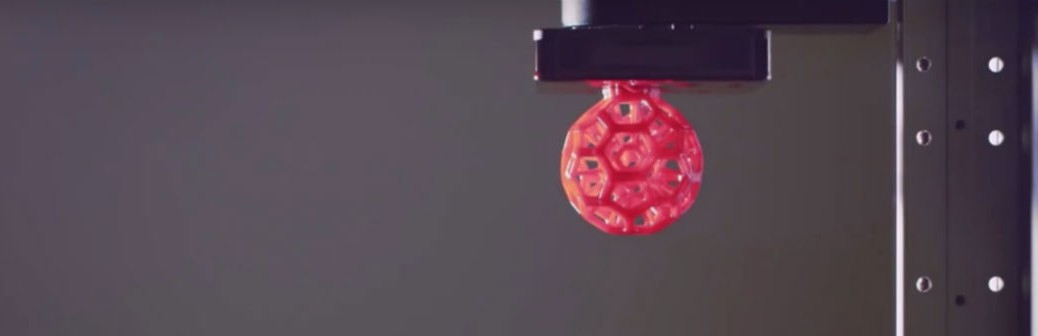

En ce sens, l’usine du futur paraît armée. En automatisant les chaînes de production et en généralisant l’impression 3D, l’industrie se donne les moyens de proposer des produits ultra-personnalisés et disponibles dans des laps de temps très réduits.

C’est là qu’apparaît une nouvelle façon de consommer pour les clients finaux : la possibilité de posséder un produit parfaitement adapté à leurs besoins, au moment où ils en ont besoin.

L’usine du futur s’est parfaitement armée pour répondre à cet enjeu, en séparant conception (ex : CAO) et production (ex : impression 3D). Cette fragmentation permet également de corréler parfaitement la production à la demande. Et de disperser les centres de production de par le monde. Tout le monde est gagnant.

Partant de là, qu’est ce qui change pour le consommateur ? Au-delà de l’ultra-personnalisation, c’est aussi la durée de vie du produit qui va révolutionner les habitudes. On a beaucoup parlé d’obsolescence programmée ces dernières décennies. Cette pratique industrielle qui a permis pendant longtemps de financer l’innovation dans les entreprises n’est aujourd’hui plus acceptable, à l’heure où le pouvoir d’achat stagne et où l’homme prend conscience que la production de masse pose des problèmes écologiques critiques au niveau mondial.

Le consommateur, ayant la possibilité d’investir dans un produit qu’il a personnalisé selon ses attentes, est plus enclin à le faire durer dans le temps. Cette tendance émerge car la production via des imprimantes 3D permet beaucoup plus facilement de de réparer des produits en ne fabriquant, à l’unité, que les pièces détachées nécessaires.

Un rôle nouveau pour le consommateur

Le consommateur va donc avoir un rôle nouveau. Aujourd’hui encore cible d’une industrie qui l’inonde de produits dans le but de déclencher un acte d’achat, le voilà désormais acteur d’une “relation” où il va devoir s’investir pour évaluer ce qu’il attend du produit qu’il veut acheter, à court et moyen termes.

Dans ce nouveau paradigme, le consommateur développe un rapport plus “affectif” envers le produit, car il est impliqué dans sa conception. C’est cette affection qui va l’amener à tout faire pour prolonger sa durée de vie.

Cela dit, ne rêvons pas : l’obsolescence programmée ne va pas disparaître, elle va muter. La consommation à outrance que nous connaissons actuellement ne va pas disparaître non plus, puisqu’elle constitue aujourd’hui le socle de notre économie de marché.

Ce qui va changer par contre, c’est que le consommateur, par ses choix de consommation, avec l’avènement de l’usine du futur, jouera un rôle de régulateur plus en amont dans la chaîne de production, donc plus impactant.