cH2ange est une initiative portée par le groupe Air Liquide, centrée autour de la place de l’hydrogène dans la transition énergétique.

La page est accessible à cette adresse: https://www.facebook.com/cH2ange. Elle est également relayée sur Twitter par le service communication d’Air Liquide avec le hashtag #cH2ange.

Voici quelques éléments de réflexion dans le cadre du débat qu’Air Liquide appelle de ses vœux, ceci sous forme de réponse aux différentes questions posées et avec de nombreux documents de référence intégrés en liens hypertextes.

Air Liquide (cH2ange) interroge: « Ne vous êtes vous jamais demandé ce qui se passerait si toutes les voitures électriques étaient uniquement alimentées par des batteries ? Ne vous êtes vous jamais demandé ce qui se passerait si tout le monde rentrait à la maison en début de soirée et branchait sa voiture électrique ? » (Question accompagnée d’une peluche qui pleure)

Réponse: Les voitures étant stationnées environ 95% du temps et le trajet moyen d’un automobiliste standard étant d’environ 35 kilomètres par jour, la charge lente à faible puissance n’est pas du tout un problème. A fortiori si l’on dispose d’une batterie permettant d’avoir plus de 300 kilomètres d’autonomie. C’est ce que savent déjà tous les utilisateurs de voitures électriques. La charge lente peut d’ailleurs être réalisée sur le parking du lieu de travail.

Grâce aux outils numériques modernes il est possible de piloter la charge de manière éco-intelligente en fonction de la disponibilité des ressources solaire et éolienne. Les batteries des véhicules électriques constituent une formidable opportunité pour faciliter l’intégration de hauts niveaux d’énergies renouvelables variables. C’est l’approche V2G-G2V. Cet outil de flexibilité est d’ailleurs intégré à l’étude France 100% Renouvelable de l’ADEME. Ce qu’Air Liquide présente aux internautes des réseaux sociaux comme un problème constitue en réalité une opportunité.

Air Liquide (cH2ange): « Le future de notre mobilité est zéro émission. Cela signifie-t-il que chacun de nous doit conduire une voiture électrique à batterie ? »

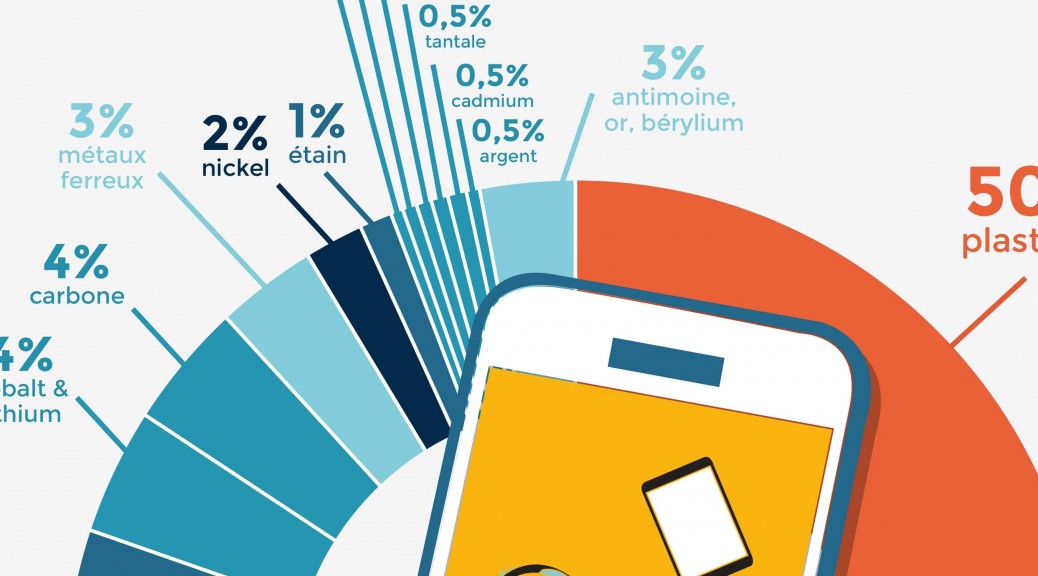

Réponse: L’électro-mobilité avec stockage batterie a une efficacité environ trois fois supérieure à celle de la thermo-mobilité. En revanche le remplacement de la batterie par de l’hydrogène compressé à 700 bars, produit par électrolyse et consommé par une pile à combustible dégrade fortement l’efficience. Il faut consommer environ trois fois plus d’électricité pour parcourir un kilomètre en voiture à hydrogène qu’avec une voiture électrique à batterie. Cela conduit à un gaspillage des surfaces et des métaux (Cuivre, Argent etc.) pour construire trois fois plus de centrales solaires, éoliennes et hydrauliques. Il faut donc davantage de mines dont l’impact environnemental n’est pas neutre.

Si l’intégralité du parc automobile français passait au 100% électrique à batterie alors la demande nationale d’électricité augmenterait d’environ 15% (70 TWh) d’après une estimation réalisée par le président d’honneur de l’association Sauvons Le Climat et corroborée par d’autres études. Si ce parc automobile passait intégralement à l’hydrogène obtenu par électrolyse alors la hausse de la demande électrique serait d’environ 45% (210 TWh).

Air Liquide (cH2ange): « Savez-vous combien de temps il faut pour charger une voiture électrique à batterie ? »

Réponse: Les superchargeurs Tesla d’ancienne génération (120 kW) permettent de charger une batterie de 90 kWh à 80% en 40 minutes et à 100% en 75 minutes. Les superchargeurs nouvelle génération d’Ultra-e (350 kW) permettront de capturer 300 kilomètres en 20 minutes, le temps de prendre un café. C’est parfaitement en phase avec les consignes de sécurité routière. En Suisse le groupe ABB a installé un système de charge ultra rapide (600 kW). Elon Musk a annoncé l’arrivée de superchargeurs Tesla de plus de 350 kW.

Air Liquide (cH2ange): « Challenge: quelle puissance sera selon vous nécessaire pour charger un million de voitures électriques à batterie (0,4% de la totalité des voitures en Europe), pendant 20 minutes seulement, en une journée ? Le fast-charging, est-ce une solution? » (question suivie d’une vidéo qui a été vue plus de 300.000 fois)

Réponse: 1 million de Toyota Mirai à Hydrogène, cela correspond à 114 GW de piles à combustible embarquées. Les 1,6 GW de superchargeurs mentionnés par Air Liquide (13.888 superchargeurs de 120 kW) peuvent être alimentés par 1,6 GW de PAC stationnaires. A noter que les trajets supérieurs à 300 kilomètres sont rares pour un automobiliste standard et que la charge rapide n’est nécessaire que pour ces longs trajets. Il est rare en France qu’un million de véhicules (3,1% du parc automobile national qui compte 32 millions d’unités) aient besoin de parcourir plus de 300 kilomètres d’une seule traite le même jour.

Air Liquide (cH2ange): « Nous devons nous diriger vers une société post-pétrole. Les voitures électriques à batterie sont une option. Les voitures électriques à hydrogène, une autre. »

Réponse: La batterie de la Tesla Model 3 aura une capacité de 55 KWh ce qui offrira une autonomie de plus de 300 kilomètres. Cette batterie ne coûtera que 6875 dollars ($125 le kWh de stockage), soit un cinquième du prix de la voiture complète. Pour qu’une voiture électrique équipée d’une batterie de 20 kWh ($2500) et d’un prolongateur Hydrogène devienne compétitive, il faudra alors que le coût de la PAC + électronique soit inférieur à $4375. La Toyota Miraï à Hydrogène (PAC de 114 kW) est vendue à partir de 66.000 euros hors taxes. Une bonne partie de ce coût correspond à la pile à combustible et à l’électronique qui l’accompagne.

Parcourir 100 kilomètres en voiture à hydrogène coûte environ 10 euros hors taxes. C’est 5 fois plus cher qu’avec une voiture électrique à batterie. « Le coût de compression à 700 bars à partir d’hydrogène à pression ambiante est prohibitif » explique un ingénieur spécialiste de l’hydrogène.

L’infrastructure Hydrogène est-elle meilleure marché que les superchargeurs nouvelle génération ? La Californie vient d’accorder à titre expérimental 92 millions de dollars pour créer en 2017 un réseau de 50 stations de recharge en hydrogène. Soit 1,7 million s’euros par point de charge. La charge s’effectue en 5 minutes. Les 25 stations-superchargeurs du programme Ultra-e (350 kW, charge en 20 minutes) coûtent 13 millions d’euros, c’est à dire environ 0,5 million d’euro par superchargeur. Si la charge est 4 fois plus longue le coût du chargeur est trois fois moins élevé. Les rapports coût / durée sont proches.

Le coût de 13.888 superchargeurs de 350 kW l’unité (4,8 GW) est d’environ 7 millliards d’euros, c’est à dire 218 euros par automobile à l’échelle des 32 millions de véhicules du parc français. Les 4,8 GW de superchargeurs peuvent d’ailleurs être couplés à 4,8 GW de PAC stationnaires, permettant ainsi de réaliser des économies au niveau du réseau électrique. 4,8 GW de PAC stationnaires versus 114 GW de PAC embarquées…Facteur 24. « Historiquement, un nouveau vecteur énergétique a toujours commencé par s’imposer dans les usages stationnaires avant ceux de mobilité pour des questions de poids, d’autonomie, de fiabilité, de sûreté, etc. » expliquait Etienne Beeker, expert de France Stratégie, le 22 septembre 2015 dans le cadre d’une interview pour un média de la Commission de Régulation de l’Energie.

Quel est le coût d’un million de piles à combustibles (114 GW) pour équiper un million de Toyota Miraï ? De 3648 GW de PAC pour en équiper 32 millions ? Et combien coûtent 32 millions de réservoirs à hydrogène associés devant résister à une pression de 700 bars ?

Air Liquide (cH2ange): « Dans quelques années les voitures à hydrogène et les voitures électriques à batterie seront comme les voitures diesel et les voitures à essence aujourd’hui », a déclaré Dr. Katsuhiko Hirose, ingénieur pile à combustible et Hydrogène chez Toyota. Etes-vous d’accord avec lui ? »

Réponse: Le comparatif est-il pertinent ? Essence et diesel doivent tous les deux êtres éliminés dans une perpective zéro émission qu’Air Liquide appelle de ses vœux. Au nom de l’ouverture à l’innovation doit-on accepter les voitures thermiques à éthanol de maïs alors que leur efficience Sun-to-Wheel est 180 fois inférieure à celle des voitures électriques à batterie alimentées par des panneaux photovoltaïques ? Certes les voitures à hydrogène sont « seulement » 3 fois moins efficientes et non pas 180. La question devient: où placer le curseur de la tolérance en matière d’efficience ? Les personnes luttant contre le gaspillage peuvent-elles être traitées de « khmers verts » ?

« Il y a une compétition entre les batteries et les piles à combustible à hydrogène, on verra qui gagnera » a déclaré Bertrand Piccard, fondateur de l’ « alliance mondiale pour les solutions efficientes » (qui s’appelait auparavant « alliance mondiale des technologies propres »), au micro de Patrick Cohen sur France-Inter à l’occasion de la parution du livre « Objectif Soleil » retraçant l’aventure Solar Impulse.

De son côté Elon Musk, grâce à l’hydrogène, vient de réussir le lancement d’une fusée Falcon 9 (SpaceX) depuis le centre spatial Kennedy de Cap Canaveral, avec récupération réussie de l’étage inférieur. Ce qui ne l’empêche pas de déclarer que les voitures à hydrogène, compte-tenu de leur efficience médiocre, sont « absurdes » (« Silly ») et qu’elles relèvent manifestement uniquement « d’une chose marketing », une façon de renforcer la « valeur corporate » des groupes concernés. L’Hydrogène jouit en effet d’une bonne image auprès du grand public malheureusement pas assez informé à propos des problématiques d’efficience.

Le multi-milliardaire américain avait même déclaré à propos des voitures à hydrogène: « so bullshit ! ». Toyota avait alors répondu avec une vidéo montrant que les véhicules à hydrogène peuvent être alimentés par des bouses de taureau ou de bison: « Fueled by bullshit ». Le méthane issu de la fermentation peut en effet servir à produire du dihydrogène par reformage. Aujourd’hui 95% de l’hydrogène consommé dans le monde provient du reformage du méthane d’origine fossile, et non pas de biométhane. L’hydrogène de reformage vapeur sert notamment dans la production d’ammoniaque qui à elle seule est responsable de plus de 1% des émissions mondiales de dioxyde de carbone, un gaz à effet de serre.

La bataille entre les deux PDG, celui de Toyota et de Tesla continue. Big Oil face à la Silicon Valley. Selon la légende l’adolescent David à gagné contre le géant philistin Goliath. Ceci grâce à une technologie très efficiente, une fronde, et à sa capacité à l’utiliser de façon habile.

La chaîne de propulsion électrique de la voiture Tesla couplée aux superchargeurs constitue une fronde des temps modernes. Un véhicule qui prend d’ailleurs l’apparence d’une fusée: la Tesla Model S P100D passe de 0 à 100 kilomètres/heure en 2,3 secondes. Contre 9 secondes pour la Toyota Miraï. Le groupe nippon vient de rappeler l’intégralité des 2800 unités vendues dans le monde en trois ans, ceci suite à un problème de contrôle électronique de la pile à combustible.

« Certaines personnes n’aiment pas le changement, mais nous devons embrasser le changement si l’alternative est le désastre » a déclaré Elon Musk. Plus de 700.000 véhicules électriques à batterie ont été vendus dans le monde durant l’année 2016, dont la moitié en Chine. Selon The Economist cette vague va grandir très rapidement.

Olivier Daniélo

Olivier Daniélo est auteur pour la Revue Politique et Parlementaire des dossiers « La révolution de la voiture électrique 2.0 » (2009, dans le Hors-série « Développement durable: éthique et stratégie du XXIème siècle ») et « La seconde vague de la voiture électrique » (2014). Ainsi que du dossier « Véhicules électriques: un volant de stockage pour demain » (2011), Revue Systèmes solaires n°202.

Laurent LELOUP est le créateur -en 2006- de Finyear Group qui publie les quotidiens Finyear et BlockchainDaily News et produit de nombreux évènements.

Laurent LELOUP est le créateur -en 2006- de Finyear Group qui publie les quotidiens Finyear et BlockchainDaily News et produit de nombreux évènements.