Les deux principaux moteurs de ce changement global seront le solaire PV et l’éolien terrestre. La puissance photovoltaïque cumulée en 2030 sera de 1,9 TW (0,14 TW en 2013), soit davantage que celle de l’éolien qui atteindra 1,3 TW. La puissance installée des autres EnR (dont l’hydroélectricité) sera de 2 TW.

La part combinée du solaire photovoltaïque et de l’éolien terrestre dans le mix électrique mondial passera de 3% en 2013 à 17% en 2030 (entre 16 et 18% selon les hypothèses retenues). Le troisième élément majeur sera l’hydroélectricité. En revanche, les contributions de la bioélectricité et de l’éolien offshore seront relativement modestes, tandis que celles du solaire thermodynamique (CSP) et de la géothermie seront faibles.

Le monde se dirige ainsi progressivement vers un mix électrique « Wind Water Sun », formule de Mark Jacobson, spécialiste des questions énergie-atmosphère de l’université Stanford.

800 GW de nouvelles capacités photovoltaïques en Asie

Entre aujourd’hui et 2030 la région Asie-Pacifique va installer 1.7 TW de renouvelables dont 800 GW de solaire PV, moitié au sol et moitié sur toitures, et 500 GW d’éolien. En 2030, le tiers de l’électricité de cette région très peuplée où vivent dès aujourd’hui 2 êtres humains sur 3, proviendra des EnR.

Milo Sjardin, directeur de la région Asie-Pacifique au sein de BNEF a déclaré que « la croissance du solaire va être spectaculaire dans cette région ». Une puissance de 800 GW de solaire PV, qui sera installée principalement en Chine, en Inde et au Japon, équivaut à 13 parcs électro-nucléaires français et à 500 réacteurs EPR, soit 31 réacteurs par an pendant 16 ans ! La capacité de déploiement du solaire PV, une technologie sans aucun risque pour les populations vivant à proximité des panneaux, facile à installer, ne produisant pas de déchets toxiques à longue durée de vie, qui ne consomme pas d’eau douce et est très bien acceptée par les populations, est effectivement impressionnante.

En Europe, selon BNEF, la part des énergies renouvelables (y compris hydroélectricité) dans le mix électrique passera à 50%. Et non à 60% comme indiqué par l’AFP probablement du fait d’une confusion entre puissance et énergie, erreur répétée par de nombreux médias francophones. C’est la puissance installée renouvelable qui passera de 40% aujourd’hui à 60% en 2030. La part de la production éolienne terrestre grimpera de 6% en 2013 à 20% en 2030.

La demande électrique européenne ne va augmenter que de 9% durant les 16 années à venir selon les experts de BNEF. Ce faible niveau de croissance, du fait d’une démographie périclitante et des progrès en matière d’efficacité énergétique, aura en France des conséquences au niveau de la production électro-nucléaire dont la part dans le mix électrique doit être réduite de 75% à 50% d’ici 2025.

Les émissions de CO2 ne commenceront à baisser qu’à la fin de la prochaine décennie

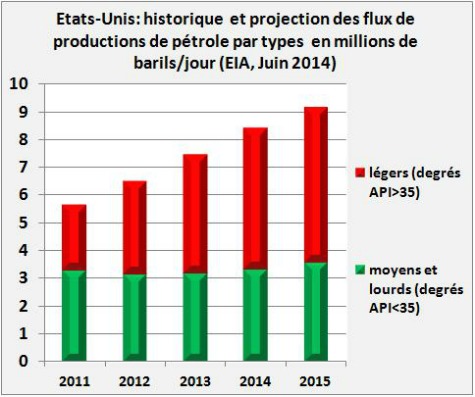

La puissance installée des centrales thermiques non durables sera de 5,3 TW en 2030. Le parc de centrales fossiles va passer de 3,5 TW en 2012 à 4,7 TW en 2030, soit une augmentation d’environ un tiers.

La proportion des centrales à gaz, deux fois moins émettrices en CO2 que les centrales à charbon, va augmenter au détriment de ces dernières, en particulier aux USA où 109 GW seront fermées en conséquence de la révolution des gaz de schistes. King Coal, particulièrement polluant, n’a plus la cote outre-Atlantique. Les centrales à gaz sont davantage flexibles que les centrales à charbon et nucléaires et peuvent ainsi être combinées avec les énergies renouvelables fluctuantes.

En Asie, dépendante de gaz naturel liquéfié importé et coûteux, 434 GW de centrales au charbon vont être en revanche installées, l’équivalent de 2 nouvelles centrales par mois.

En Europe, la part du charbon dans le mix électrique va chuter de 19% en 2013 à 8% en 2030. Celle du gaz de 25% à 17%. Grâce à la croissance du solaire photovoltaïque et de l’éolien les émissions de CO2 du secteur électrique seront divisées par deux. « La baisse annuelle de 5% des émissions de CO2 sera principalement le résultat de la hausse des capacités renouvelables et de la hausse du prix du carbone qui provoquera une substitution du charbon et du lignite par le gaz » estiment les experts de BNEF.

A l’échelle mondiale « les émissions globales en CO2 devraient cesser d’augmenter à la fin de la prochaine décennie, ceci du fait de l’addition, par les pays en développement et à croissance rapide, de nouvelles capacités fossiles en parallèle aux nouvelles capacités renouvelables » soulignent les auteurs du rapport.

Les habitants des pays en développement aspirent en effet à vivre selon les standards d’Europe de l’ouest et auront besoin des énergies fossiles en transition, tout comme les européens et les nord-américains en ont bénéficié depuis le XIXème siècle. La grande majorité du CO2 anthropique présent aujourd’hui dans l’atmosphère a été émis par les occidentaux. Les représentants des pays dits « du sud » ne manquent pas de le rappeler à l’occasion de chaque grand sommet climatique.

Les énergies renouvelables, un marché de 5000 milliards de dollars, contre 2700 milliards pour les énergies non durables

En 2030 la puissance photovoltaïque installée dans le monde sera quatre fois supérieure à celle du nucléaire. Compte-tenu du fait que le facteur de charge moyen du nucléaire est environ 5 fois supérieur à celui du solaire PV, la production solaire correspondra à environ 80% de celle du nucléaire. La production photovoltaïque dépassera probablement celle du nucléaire durant la décennie 2030.

La région Asie-Pacifique va attirer 2,5 trillions de dollars d’investissements dans les énergies renouvelables, dont 1,4 trillion en Chine. En Europe 94% des investissements dans le solaire concerneront le segment du petit PV. Une situation très différente de celle de la région Asie-Pacifique où la moitié des capacités PV installées concerneront de grandes centrales.

Dans les Amériques 231 milliards de dollars vont être investis dans le petit solaire PV en toiture, soit 18% de la totalité des investissements dans le secteur électrique de ce continent. Seul le gaz naturel, avec 24% du volume des investissements en Amérique, dépassera le solaire.

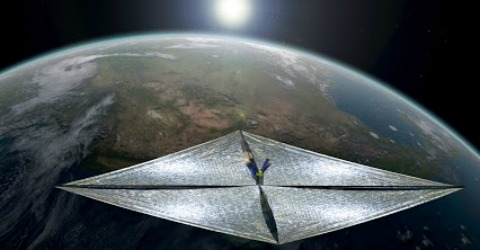

Cap vers une « Solar Electric Economy »

Selon plusieurs rapports, dont un du groupe pétrolier Shell, le solaire va devenir la source principale d’énergie de l’humanité durant la seconde moitié du XXIème siècle. Le groupe Total, géant pétrolier français, a investi 1,4 milliard de dollars pour acquérir 60 % du capital de l’entreprise SunPower, anticipant la révolution solaire qui ne fait que commencer.

Mais la compétition sera rude. Président de SolarCity qui domine le tiers du marché solaire résidentiel aux USA, Elon Musk vient d’annoncer la construction d’une « giga-factory » ayant une capacité de production d’1 GW/an de panneaux solaires. Il ne s’agit, selon Elon Musk, que d’une « unité pilote » qui n’est que le début d’une série d’usines géantes capables chacune de produire 10 GW/an.

Ce visionnaire a dans cet objectif acquis pour 350 millions de dollars l’entreprise Silevo qui produit des panneaux à base de silicium et sans argent, ce qui permettra une croissance sans contrainte sur le plan des matières premières. Le silicium est le second élément le plus abondant sur Terre après l’oxygène. Cette non dépendance envers l’élément argent deviendra dans les années à venir un sérieux atout en terme de compétitivité vis à vis des groupes concurrents. Elon Musk a également décidé de construire une gigantesque usine de production de batteries, qui sera en réalité la plus grande usine jamais construite dans le monde. Ces batteries alimenteront à la fois le marché du stockage stationnaire pour assister le solaire, et le marché de la voiture électrique.

C’est ainsi un écosystème complet qu’est en train de construire ce californien, son approche est holistique. Il a vraiment la tête tournée vers l’avenir avec son entreprise Space X qui fait trembler l’Agence Spaciale Européenne et avec Tesla, la star de l’électro-mobilité haute qualité dont les ventes battent des records.

« Le soleil est un réacteur nucléaire libre et très pratique » a déclaré le 17 juin 2014 Elon Musk, non sans son ironie habituelle, dont la fondation a d’ailleurs donné 500.000 dollars pour la construction d’une centrale solaire au Japon suite à la catastrophe nucléaire de Fukushima et dont la fortune personnelle dépasse le bénéfice net du groupe Total en 2013. Pour Elon Musk, nous sommes en train de vivre « le mouvement d’une économie hydrocarbonée d’extraction et de combustion vers une économie électro-solaire ».

Les Chinois n’ont pas dit leur dernier mot. Ils pourraient construire des usines de panneaux solaires au Mexique, pays membre de l’ALENA, afin de contourner les taxes douanières imposées par le gouvernement fédéral américain. Et, par ricochet, celles des gouvernements européens via le traité de libre-échange transatlantique. Ou alors en Malaisie où les entreprises First Solar et SunPower ont installé une bonne partie de leur capacité de production d’où l’impossibilité pour les autorités américaines de surtaxer les panneaux solaires provenant de ce pays.

Le « 2030 Market Outlook » de BNEF, rapport majeur qui parait une fois par an, est basé sur une modélisation de l’offre et de la demande du marché de l’électricité et sur l’évolution du coût des différentes technologies.

Par Olivier Daniélo

Dans les ressources documentaires :

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)