Les entreprises françaises sont-elles prêtes pour le passage à l’IPV6 ?

En prévision de la Journée mondiale de l’IPv6, Infoblox Inc a annoncé aujourd’hui les résultats d’une enquête effectuée auprès de plus de 2.400 entreprises IT représentatives au sujet de leurs préoccupations sur l’IPv6, les projets d’adoption et de l’état actuel du déploiement. Comme l’offre mondiale d’adresses IPv4 ne cesse de diminuer, les entreprises devront être en mesure de soutenir l’explosion du nombre de périphériques compatibles IPv6 qui se connectent au réseau, que ce soit un ordinateur portable, téléphone portable, imprimante, scanner ou une tablette. Ne pas avoir une adresse IP est l’équivalent d’avoir un téléphone sans un numéro de téléphone, ce qui explique pourquoi il y a un besoin critique pour les entreprises à évaluer, élaborer et commencer le processus de migration des réseaux d’aujourd’hui.

Les résultats de l’enquête en ligne renforcent le fait que les entreprises sont confrontées à des problèmes majeurs d’éducation, de planification et de mise en œuvre de défis qui indiquent que la plupart sont mal préparées pour une migration réussie vers le réseau IPv6.

Les données révèlent des préoccupations et des défis :

- 80% estiment qu’ils ne sont pas suffisamment instruits pour la migration IPv6 ;

- 41% quand même suivent les adresses IP manuellement avec des feuilles de calcul, ce qui peut être source d’erreurs, de perte de temps et d’argent et non viables dans les environnements IPv6 ;

- 70% sont préoccupés par la réussite lors du déploiement IPv6 ;

- Le manque de connaissance et le risque de l’inconnu sont les grandes craintes sur IPv6 • 41% évaluent leur préparation derrière celle des concurrents ;

- La plupart des gens sont dans la phase d ‘«apprentissage» d’IPv6 • Seulement 24% ont consacré des ressources pour gérer la migration d’IPv4 vers IPv6 ;

- 23% s’attendent à faire face à des sites Web externes pour IPv6 au cours des 12 prochains mois.

“Le niveau de préoccupation est élevé, ce qui est bon signe, mais il ya beaucoup d’incertitude sur les mesures nécessaires et les outils pour gérer avec succès la transition d’IPv4 à IPv6», a commenté Cricket Liu, Expert en technologie DNS, et vice président Architecture d’Infoblox.

« Bien que la transition ne se fera pas du jour au lendemain, des mesures évidentes, telles que l’éducation, une évaluation des dispositifs de réseau qui sont prêts pour IPv6, et la mise en œuvre des outils automatisés de gestion des adresses IP, sont nécessaires. Le suivi des adresses IP dans une feuille de calcul est vraiment risqué avec plus de 128 bits des adresses IPv6, ce qui augmente la probabilité d’erreurs liés à la saisie manuelle. Des solutions qui automatisent la gestion des adresses IP sont devenus une nécessité pour éviter les erreurs et rester au fait des réseaux dynamiques d’aujourd’hui et les demandes des utilisateurs. »

Cloud computing : Atos Origin va offrir des solutions de tests informatiques

Disponible à l’échelle mondiale, cette nouvelle solution offrira aux clients de tous les secteurs d’activités un moyen flexible et financièrement avantageux de gérer toutes leurs exigences en matière de tests afin que leurs projets informatiques, quelle qu’en soit l’ampleur, puissent passer en toute sécurité de la phase de développement à la phase de production. La solution complète, qui couvre l’ensemble du cycle de développement logiciel, est basée sur un modèle de « tarification à l’acte » conçu par Atos Origin à l’aide du set d’outils intégré Rational Jazz d’IBM. Cette solution intègre la méthodologie de Tests et Recettes d’Atos Origin et tire parti de la longue expérience développée avec sa clientèle en la matière.

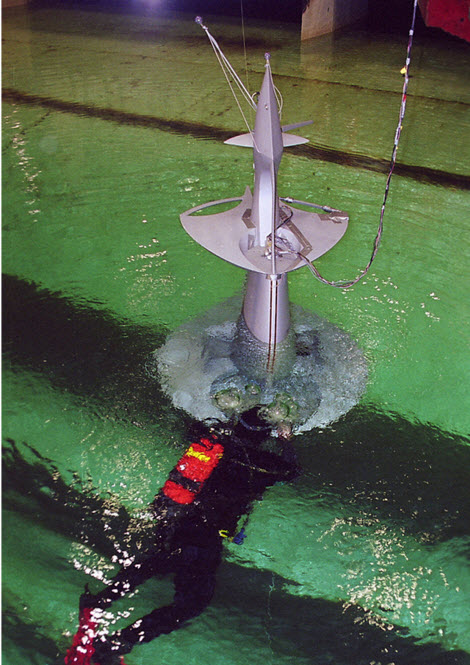

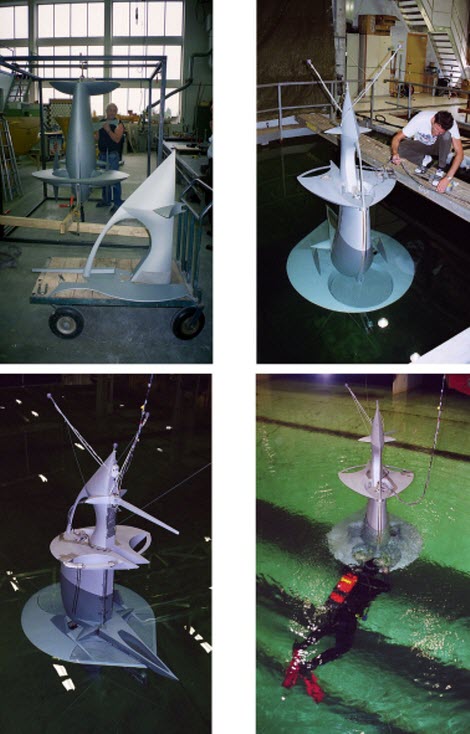

La simulation informatique temps réel au service des SmartGrids

KTH, l’un des instituts technologiques internationaux les plus renommés, conduit des recherches dans de nombreux domaines tels que les technologies de l’information et de la communication, les transports ou l’énergie. En 2010, les chercheurs de KTH souhaitent concevoir SmarTSLab (Smart Transmission Systems-Laboratory), une nouvelle plateforme technologique dédiée à l’utilisation des SmartGrids. L’équipe projette alors de développer des nouvelles technologies informatiques visant à optimiser la production et la distribution, à économiser l’énergie, à sécuriser le réseau électrique et à réduire les coûts.

Pour mener ces recherches, KTH aspire à trouver une alternative technologique à la simulation analogique, qui implique la réalisation de tests sur maquette à échelle réduite. L’institut lance alors un appel d’offre public pour la conception d’une solution de simulation informatique temps réel, dont la rapidité et la puissance de calcul permettraient de reproduire informatiquement et en temps réel :

- un réseau d’électricité et son activité à échelle nationale ou Européenne,

- des sources d’énergies renouvelables,

- ainsi que des systèmes de conversion d’énergie.

En décembre 2010, KTH choisit le simulateur d’OPAL-RT Europe. Fondé sur la dernière génération de processeurs multi-cœurs Intel i7 et les cartes de calcul FPGA, ce simulateur est doté d’une précision de calcul à la microseconde et apte à reproduire virtuellement une grande variété de configurations de réseaux électriques. Cette plateforme de simulation temps réel, capable de reproduire avec précision de grands réseaux électriques, est aujourd’hui la plus rapide et la plus puissante d’Europe.

De plus, il respecte la norme de communication internationale IEC 61850, liée aux équipements de protection des réseaux et indispensable à la conduite de ces recherches. Le simulateur est intégré avec l’environnement de modélisation MATLAB/Simulink, ce qui permet une prise en main rapide. Aujourd’hui, les chercheurs soumettent le simulateur OPAL-RT Europe à une multitude de cas d’exploitation et d’incidents techniques :

- erreurs de fréquence ;

- creux de tension ;

- dégradations de qualité de puissance ;

- court-circuit ;

- pannes dues à une surcharge ;

- variations météorologiques ;

Ces tests informatiques devraient permettre de tirer des enseignements concrets et de valider des nouveaux concepts de technologies informatiques pour un déploiement efficace et pérenne des SmartGrids. « Le simulateur livré par OPAL-RT Europe nous donne accès à une technologie hautement performante et polyvalente. En outre, ce simulateur est étroitement intégré avec MATLAB / Simulink, un environnement de modélisation que nos élèves connaissent bien. Cela réduit les besoins en formation, simplifie nos recherches et augmente nos possibilités de coopération internationale. »

Zoom sur l’Autriche

Un coeur virtuel fait la jonction entre l’informatique et la médecine

Des chercheurs de l’Institut de Biophysique de l’Université de Médecine de Graz ont développé un modèle informatique -« in silico »- du coeur humain. Ce modèle permet de simuler les différents processus qui prennent place dans le coeur, ainsi que de visualiser les effets de différents traitements : interventions physiques ou prise de médicaments.

La compréhension et l’étude du coeur est une question d’importance fondamentale : en effet, les maladies cardio-vasculaires constituent la première cause de décès dans les pays industrialisés (environ 1,9 million de morts chaque année dans l’Union Européenne – ce sont quelques 30% des décès leur sont attribuables). Les causes sont néanmoins très diverses : troubles de la circulation, hypertension artérielle, inflammation du muscle cardiaque… Un modèle informatique du coeur peut permettre de simuler les réactions cardiaques à différents stimuli et ce jusqu’au niveau cellulaire, offrant aux chercheurs et aux médecins des informations précieuses.

Le champ des applications possibles d’un tel outil sont vastes : des modèles électro-physiologiques peuvent être utilisés par exemple pour optimiser le traitement de la fibrillation auriculaire, pour adapter les stimulateurs cardiaques ou encore pour observer les effets de médicaments agissant sur les troubles du rythme cardiaque…

L’un des objectifs des recherches en cours à l’Université de Médecine de Graz – en collaboration avec des experts de laboratoires de pointe dans le monde entier, tels que l’Institute of Computational Medicine à l’Université John Hopkins – est, à terme, de pouvoir proposer une médecine personnalisée aux patients : le modèle informatique pourrait être adapté à la situation de chacun après avoir récupéré des données individuelles par imagerie ainsi que par des examens électro-physiologiques.

Ces techniques de simulation sont rendues possibles notamment grâce au développement et à la généralisation des superordinateurs, la simulation d’un coeur humain peut ainsi se calculer en quelques minutes, mais en utilisant un système informatique basé sur plusieurs milliers d’unités de calcul.

En savoir plus : http://www.bulletins-electroniques.com/actualites/67003.htm

Ordinateur quantique : un correcteur d’erreurs itératif – un registre quantique de 14 bits

En savoir plus : http://www.bulletins-electroniques.com/actualites/66998.htm

Par S.B

LES BILANS