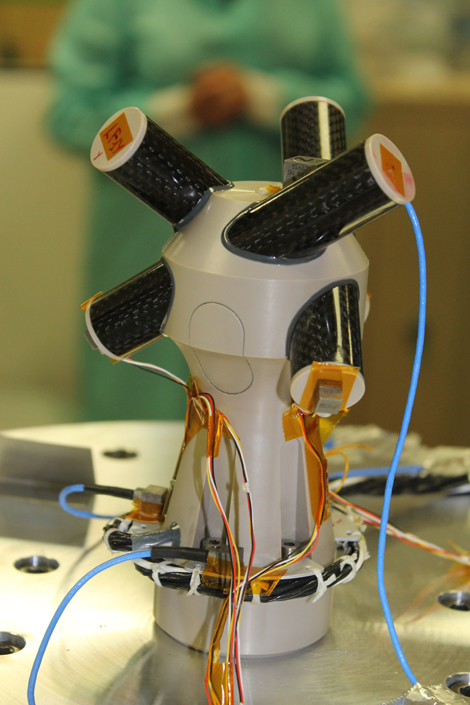

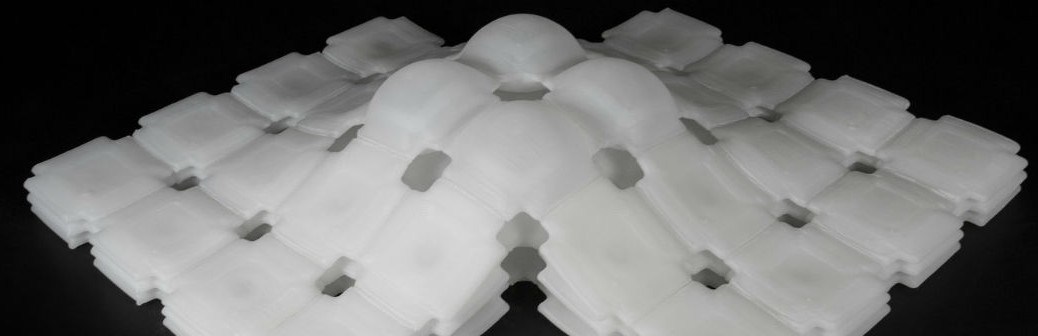

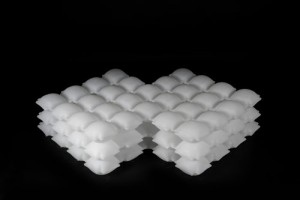

Le bio-printing vise à mettre à disposition des biologistes et des médecins des procédés permettant de déposer des suspensions cellulaires, des solutions aqueuses ou des hydrogels sur des supports biocompatibles, en limitant les différents stress que peuvent subir les cellules par les procédés de fabrication additive pour atteindre une fonctionnalité biologique souhaitée dans les tissus ou organes bio-imprimés.

Relativement aux techniques de fabrication additive classiques, l’impression 3D d’éléments biologiques ajoute un niveau de complexité important aux procédés car il est nécessaire de structurer « intelligemment » des matériaux vivants ou non, mimant la matrice extracellulaire et de contrôler les distributions spatiales de différents types de cellules ou de biomolécules pouvant jouer un rôle sur la différenciation cellulaire, leur croissance ou leur mort.

Dans les faits, la fabrication d’un tissu biologique par bio-printing s’effectue de la manière suivante :

- une première étape consiste à conceptualiser par ordinateur l’architecture du tissu biologique puis à programmer les paramètres d’impression des « encres » contenant des cellules. Il convient généralement de prévoir un support sur lequel les cellules vont adhérer et se développer. De même, les processus de transfert nutritionnel doivent être anticipés pour permettre un développement effectif des cellules ;

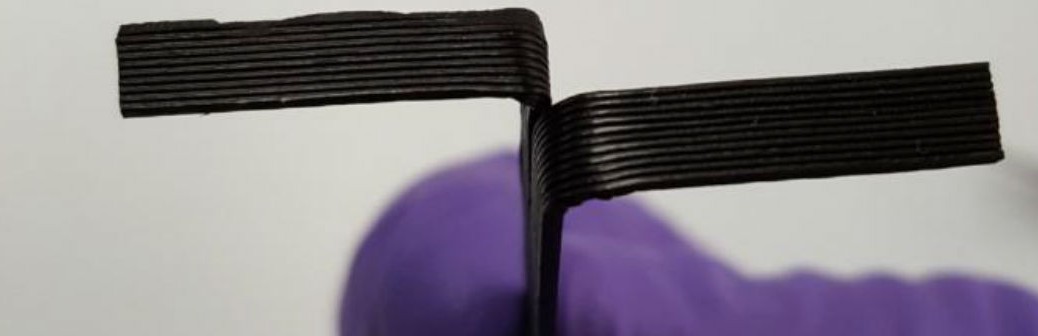

- les « tissus biologiques » sont ensuite imprimés couche-par-couche à l’aide d’automates qui reproduisent les motifs conçus par ordinateur en déposant par exemple des microgouttelettes d’encres biologiques ;

- la dernière étape repose sur la maturation du tissu imprimé en bioréacteur. Cette étape permet aux cellules de s’auto-organiser jusqu’à faire émerger des fonctions biologiques spécifiques.

IDTechEx1 a réalisé une étude sur les futures applications, les marchés et les acteurs du domaine. Dans cette synthèse IDTechEx cible, pour l’essentiel, deux axes d’action principaux en bio-printing :

- la réalisation de supports représentant des tissus humains pour permettre de tester des médicaments (à la place de travailler sur l’animal et sur l’humain) ;

- la production de matériaux biologiques et de tissus humains pour les « réparations ».

Des avancées stimulantes aux promesses sensationnalistes

Parmi les avancées, les chercheurs de l’INSERM2 (équipe de Nadine Benkirane-Jessel à Strasbourg Unité 1109 dans INSERM, 2015) ont créé un implant ostéo-chondral composé de deux compartiments afin de régénérer le cartilage et l’os sous-chondral au sein de l’articulation :

- une membrane nanofibreuse, à base de collagène ou de polymères, dotée de nanoréservoirs de facteurs de croissance osseux, pour favoriser la réparation de l’os ;

- une couche d’hydrogel (alginate) renfermant de l’acide hyaluronique et des cellules-souches issues de la moelle osseuse du patient, favorisant la régénération du cartilage.

L’organisation en trois dimensions du dispositif favoriserait la croissance et la différenciation des cellules-souches en cellules du cartilage. « Imaginez la membrane nanofibreuse comme une feuille de papier déposée par le chirurgien sur l’os abîmé. Immédiatement après, il dépose la seconde couche contenant les cellules-souches et termine son intervention. Ensuite, le travail de consolidation de l’ensemble se fait seul ! L’objectif est d’obtenir une régénération totale de l’articulation – os sous-chondral et cartilage – dans les mois qui suivent », explique la chercheuse.

Les startups du secteur s’inscrivent dans une stratégie à long terme qui vise « tout simplement » la réalisation d’organes. Certes, on n’en est pas là, mais la vision est claire, soutenue par un public très intéressé par l’accès à des soins spécifiques, voire peut-être à des possibilités d’« augmentation » des performances humaines en attendant la mise sur le marché de produits, services ou systèmes nouveaux qui satisfont un renforcement de la demande de « bien-être », pour laquelle on acceptera de payer un certain prix (notion d’attractivité).

Par exemple, BioBots conçoit des imprimantes 3D capables de créer des tissus vivants. Ses produits sont disponibles sur le marché depuis quelques mois. En mai dernier, BioBots, avec une logique de promesse sensationnelle, présentait au public son imprimante capable de créer des tissus humains vivants, reproduisant pour l’occasion l’oreille coupée de Van Gogh…

Pour mener à bien ses ambitions, BioBots utilise une encre photo-transformable, qui mise en présence de lumière se polymérise. Combinée avec des cellules vivantes, elle permet de mettre en forme de la matière biologique synthétique. Lors de « Techcrunch Disrupt » à New-York en 2015, Dan Cabrera, CEO de l’entreprise, aurait affirmé que sa méthode permettait à sa création de se différencier de ses concurrents proposant également des imprimantes 3D capables de créer la vie.

Parmi les entreprises concurrentes, on compte le Canadien Aspect Biosystems, le Suédois Cellink , ou encore le Japonais Cyfuse. Pour BioBots, le projet vise à faciliter la recherche médicale. Ainsi, il serait possible d’utiliser ces tissus vivants pour tester des médicaments en laboratoire, s’affranchissant de la nécessité d’utiliser des animaux. Surtout, on pourrait ainsi réaliser des tests individuels, pour offrir à chaque patient un traitement personnalisé correspondant le plus parfaitement possible à ses besoins.

Du bio-printing à l’homme augmenté

La médecine n’est déjà plus l’art destiné à cerner les causes d’un mal-être et à aider l’organisme à réagir aux agressions qui l’ont rendu malade. Elle considère le corps comme un assemblage d’organes plus ou moins interdépendants qu’il faut entretenir, réparer, changer, transformer ou améliorer. Le soin peut alors céder la priorité à la réparation. Avec l’individualisme, la spécificité des corps risque de devenir l’un des fondements de la médecine de précision de demain, tant qu’elle permet des soins sur mesure ou personnalisés (et moins coûteux en principe). Dans le même temps, les effets de la transformation du concept de santé (OMS) allant de la suppression de la maladie, à la réalisation d’un bien-être individuel (médecine de confort) soutiennent le développement potentiel d’« Homme augmenté », développement autorisé dans son principe par le bio-printing. De plus, l’avènement de l’impression 3D pourrait résoudre certains des problèmes les plus pressants auxquels fait face le don d’organes — comme la disponibilité et le rejet par le corps du patient receveur.

Donnons-nous rendez-vous dans quelques années pour savoir si la science triomphera de l’actuelle bulle spéculative et saura faire du bio-printing une méthode efficace et robuste pour la médecine.

Extrait de l’article de Techniques de l’Ingénieur RE268, Bio-printing – État des lieux et perspectives, d’Emmanuel GUÉDON, Laurent MALAQUIN et Jean-Claude ANDRÉ (février 2017)

1IDTechEx. – 3D bio-printing 204-2024 : applications, markets, players (2014). http://www.idtechex.com/

2INSERM. – Un implant vivant pour régénérer le cartilage (2015). http://www.inserm.fr/