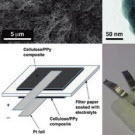

Selon le media Gas2.0 une équipe de chercheurs de l’Université d’Uppsala a découvert qu’une certaine variété d’algues vertes appelée Aegagropila linnaei de la famille des Cladophoraceae produirait une substance non toxique, facile à isoler et peu coûteuse, capable d’alimenter des batteries durables aussi flexibles et minces assure t-on que les batteries au lithium les plus évoluées utilisées aujourd’hui.La clé de la découverte réside dans la particularité de Aegagropilalinnaei à produire un type unique de cellulose à condition de la cultiver sur une très grande surface (1 gramme de matière produite par 80 m2). En recouvrant cette cellulose algale d’un polymère conducteur bien connu appelé polypyrrole (ppy), l’équipe a « réussi à produire une batterie d’une extrême légèreté qui bouleverse toutes les normes connues aussi bien en matière de capacités de stockage que de temps de charge », a précisé Gustav Nyström, étudiant en nano-technologies et l’un des principaux chercheurs de l’équipe découvreuse.

La batterie mise au point au cours de l’expérimentation n’a pas été complètement optimisée, mais les chercheurs ont déjà réussi à obtenir des capacités de stockage d’environ « 25 Wh/kg du matériau de la batterie en poids, soit 40 Wh/l du matériau de la batterie en volume ». Pour se faire une idée de ce que ces chiffres signifient, les chercheurs ont fourni comme échelle de comparaison les données des batteries au lithium-ion (optimisées elles depuis longtemps) existant sur le marché et qui sont de « 100-160 Wh/kg ou 250-360 Wh/litre ».Après optimisation de sa découverte, l’équipe de recherche de l’Université d’Uppsala s’attend à ce que sa batterie aux algues obtienne à peu près les mêmes caractéristiques de stockage d’énergie que le lithium-ion. Jusqu’à aujourd’hui, personne n’a vraiment été capable de mettre au point une batterie à base organique qui puisse rivaliser avec les meilleures batteries au lithium-ion (non-organiques). Pour ceux qui se posent la question de savoir à quoi cela servirait d’obtenir une batterie organique, la réponse tient en quelques données : facilité de fabrication, faible degré de toxicité, et surtout caractéristique naturellement flexible du matériau. Concrètement, selon les chercheurs d’Uppsala, cette batterie serait faite essentiellement de papier et d’eau salée, un procédé très simple à mettre en oeuvre « dans sa propre cuisine même avec un mixeur » a précisé la chercheuse Maria Stromme au média EurekAlert.

Les autres chercheurs confirment effectivement que seuls des moyens simples, des matériaux peu coûteux et abondants dans la nature et des produits chimiques éco-compatibles sont nécessaires à la fabrication de cette batterie. Mais malgré sa facilité de fabrication et son absence présumée de toxicité, cette batterie a des caractéristiques impressionnantes de durabilité.En gardant encore à l’esprit qu’elle n’en est pour l’instant qu’au stade expérimental, elle montre déjà une capacité étonnante à être rechargée rapidement et surtout un nombre impressionnant de fois, sans perdre, charge après charge, de sa capacité de stockage. Ces bons résultats préliminaires pourraient incliner l’équipe de recherche à se focaliser sur les applications dans le domaine des véhicules électriques. Mais elle préfère pour l’instant communiquer sur les propriétés uniques de cette batterie en matière de flexibilité et de faible toxicité.« Ces batteries, en raison de leur légèreté, pourraient être utilisées dans des textiles intelligents (vêtements ou, par exemple, capteurs surveillant les polluants, l’irradiation UV ou moniteurs mesurant portés sur soi à des fins de diagnostics médicaux), mais aussi dans les emballages, ou tout appareillage de diagnostic dans les pays en développement. L’avantage évident de ces batteries étant de pouvoir être fabriquées sans matériel de pointe, sur place, dans les pays en développement » a précisé l’équipe.A terme rien ne s’oppose, eu égard à ses performances, que ce type de batterie remplace purement et simplement les batteries au lithium-ion, plus chères et plus toxiques, dans leurs domaines d’application, y compris l’automobile électrique. Mais nous sommes loin d’en être là ! Lire l’article de Gas2.0 (en anglais)Francis Rousseau est rédacteur en chef de plusieurs blogs portant sur l’environnement et les énergies renouvelables, dont un spécialisé dans les énergies marines : Les Energies de la mer. Ces blogs sont réalisés pour 3B Conseils, cabinet conseil en communication scientifique et technique et bureau d’études, organisateur des Entretiens Science et Ethique.