Techniques de l’Ingénieur : Pour commencer, pourriez-vous nous présenter le SESURE et le réseau Téléray ?

Nathalie Chaptal Gradoz : Le SESURE est le service qui gère les programmes de surveillance radiologique sur le territoire français. Cette surveillance s’effectue notamment au moyen d’appareils installés sur le terrain. Ces moyens dits « fixes » peuvent être des sondes ou des appareils de prélèvement automatique de poussière de l’air ou dans l’eau.

D’autre part, nous réalisons des prélèvements manuels dans l’environnement proche de l’installation nucléaire ainsi qu’à distance de celle-ci, afin de mesurer la radioactivité générale ambiante, ce qu’on appelle « le bruit de fond », et l’impact de la centrale sur son environnement.

Parmi les moyens fixes, il y a le réseau d’alerte Téléray, constitué aujourd’hui de 185 sondes qui mesurent le débit de dose gamma ambiant dans l’air sur le territoire. Nous avons également un autre réseau très similaire installé dans l’eau des grands fleuves, en aval de toute installation nucléaire. Ceci afin de garantir une qualité radiologique des eaux qui quittent le territoire national.

Pour en revenir au réseau Téléray, les 185 sondes ont été installées à partir de 1991, suite au retour d’expérience de l’accident de Tchernobyl. Il y a 4 ou 5 ans, nous avons entamé un programme de rénovation de ce réseau, basé sur le constat que les sondes avaient atteint l’âge de 20 ans. Ces progrès technologiques se sont accompagnés de progrès dans la transmission des données, avec l’avènement de nouveaux réseaux et la constitution de bases de données plus solides.

Concrètement, une sonde Téléray calcule toutes les 10 minutes le débit de dose gamma ambiant dans l’air. Chaque sonde possède une mémoire telle que l’ensemble de ses données peut être archivé. En temps réel, les données sont transmises à notre système de supervision situé au Vésinet (78).

Si un écart à une gamme de variabilité attendue des données est enregistré, le système de supervision va immédiatement informer le personnel d’astreinte (24h/24) par le biais d’une alerte. Cette même personne est ensuite chargée de la gestion de l’alarme, et de la compréhension de la source du problème.

Parfois, ce sont juste des raisons liées à la météo. Certains orages sont capables de générer une élévation du taux de radioactivité ambiante, et donc de déclencher une alarme radiologique sans qu’il y ait pour autant une alerte.

Pourriez-vous nous en dire plus sur la procédure de gestion des alertes ?

Comme je vous l’ai dit, dans l’équipe de télésurveillance, il y a toujours une personne d’astreinte 24h/24, durant une semaine. En cas d’alarme, le système de supervision développé et mis en service depuis 2011, permet à cette personne de voir rapidement s’il s’agit d’une valeur ponctuelle, si les sondes à proximité ont enregistré une valeur anormale ou pas, etc. Cela permet d’évacuer tout de suite un certain nombre d’hypothèses.

Nous avons également un correspondant local, qui va être contacté et qui va procéder à quelques vérifications techniques.

Si en dépit de toutes ces raisons, nous ne parvenons pas à diagnostiquer un évènement ponctuel naturel, alors nous alertons en interne. Nous avons de fait une procédure pouvant conduire jusqu’à alerter un cadre d’astreinte à l’IRSN et jusqu’au début d’un gréement en situation de crise, au niveau national.

Vous parliez du seuil d’alerte. Sur quels critères est-il établi ?

En fonction de son implantation, une sonde va enregistrer, par exemple, une valeur moyenne constante de 100 nanosieverts par heure, correspondant au bruit de fond de la radioactivité naturelle à cet endroit-là. Le seuil d’alerte va alors être établi à 114 nanosieverts par heure de plus. Pourquoi ? Parce que si vous faites le calcul, au bout d’une année, vous aller arriver à 1 millisievert, et 1 millisievert correspond précisément à la valeur limite annuelle d’exposition du public à la radioactivité artificielle.

En raison des conditions météorologiques, on a parfois des pics qui dépassent facilement 200 nanosieverts. Si cela dure 5 minutes et que c’est une cause naturelle, ce n’est pas inquiétant.

Alors certes, le système veille, mais l’équipe de télésurveillance n’attend pas que l’alarme soit déclenchée pour être vigilante. Surtout si elle est avertie d’un danger quelque part.

Le seuil d’1 millisievert n’a donc jamais été atteint ?

Non, et heureusement. L’impact des activités nucléaires est seulement de quelques microsieverts par an. Le site de La Hague, par exemple, produit au maximum une dizaine de microsieverts par an de radioactivité ajoutée. On est donc très loin du 1 millisievert.

Quel a été l’impact du passage du panache radioactif de Fukushima en mars 2011 ?

Compte tenu de la distance par rapport au Japon, et de la dilution dans les masses d’air suite à un demi-tour du globe, le passage du panache de Fukushima n’a pas été visible sur nos sondes. Il aurait fallu être à une distance beaucoup plus proche du Japon pour détecter quelque chose.

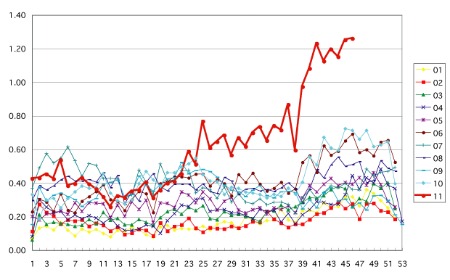

En revanche, aux abords de l’installation de la centrale de Fukushima, il y a eu effectivement des variations très intenses du débit de dose. Nous avions installé une sonde à l’ambassade de France à Tokyo, par chance, juste avant les rejets importants qui ont eu lieu aux alentours du 20 mars. Avant l’accident, elle oscillait entre 50 et 60 nanosieverts par heure, durant le rejet elle est montée jusqu’à 160 nanosieverts par heure, pour revenir ensuite aux alentours de 80.

Ce seuil d’alerte d’ 1 millisievert est-il partagé par d’autres organismes de radiosurveillance en Europe ?

Au lendemain de l’accident de Tchernobyl, de nombreux pays européens se sont dotés de capteurs de télémesure de la radioactivité gamma, mais chaque pays a décidé de sa couverture géographique et de la densité de capteurs qu’il allait installer sur son territoire. Par exemple, l’Allemagne a installé plus de 2000 capteurs alors que la France n’en a installé que 170.

Les technologies utilisées en Europe et les stratégies d’implantation sont très variées. Cela dépend aussi si le pays est nucléarisé ou pas, si la crainte provient d’un réacteur étranger ou national, etc.

La stratégie de surveillance en France ne s’applique donc pas forcément à un autre pays européen. A ce titre, chaque pays peut librement fixer ses seuils d’alerte. La France fait partie des seuils les plus bas d’Europe. La Commission européenne incite néanmoins l’ensemble des états membres à harmoniser les mesures et les pratiques.

Aujourd’hui, nous avons 185 sondes Téléray, et nous allons passer progressivement à 450 sondes. Jusqu’ici, nous avons installé une sonde dans chaque préfecture départementale, afin d’assurer une surveillance homogène du territoire. Par ailleurs, nous avons également une sonde Téléray installée dans l’environnement proche de chaque installation nucléaire, à 1 kilomètre sous les vents dominants.

L’implantation des sondes Téléray autour des installations nucléaires va donc se densifier. Plus précisément dans la zone qui se situe entre 10 et 30 kilomètres autour de l’installation. Pourquoi ne commencer qu’à 10 km ? Parce que dans la zone entre 0 et 10 km, ce sont les exploitants nucléaires qui ont l’obligation d’installer un certain nombre de sondes de mesure du débit de dose.

La salle de pilotage de la télésurveillance est située au Vésinet. Nos sondes y sont supervisées en temps réel. Il en va de même avec les sondes EDF dont les mesures nous sont également accessibles en temps réel.

Si une sonde tombe en panne, quel est le temps moyen mis pour la remplacer ?

C’est variable. Le premier niveau d’intervention est notre correspondant local à qui l’on va demander de faire quelques vérifications techniques. Ensuite, si cela est nécessaire, nos techniciens vont se déplacer pour remplacer ou réparer la sonde défectueuse. Si c’est une simple réparation, cela peut être très rapide. Le remplacement d’une sonde demande par contre plus de temps et peut être programmé à plus ou moins longue échéance, en fonction de son emplacement, de sa criticité, etc.

Durant la semaine qui a suivi la catastrophe de Fukushima, nous avions des sondes qui étaient défaillantes dans les DOM-TOM. Ces sondes ont toutes été réparées dans la semaine qui a suivi.

Quels sont les sites français dont la radioactivité naturelle est la plus importante ?

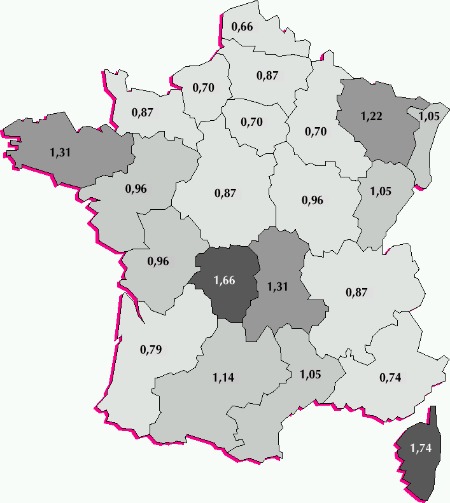

Certaines roches contiennent naturellement plus d’uranium, de thorium ou de potassium que d’autres. C’est le cas des Alpes, du Massif Central, de la Bretagne et de la Corse. Le niveau de radioactivité naturelle y est supérieur à celui qu’on pourrait trouver dans le bassin parisien par exemple. Le« bruit de fond » va se situer entre 150 et 180 nanosieverts par heure, alors qu’il sera de 60 à Paris.

De même, certaines sondes situées sur des sommets connaissent des records. Celle de l’Aiguille du Midi tourne en général entre 300 et 350 nanosieverts par heure.

Comment le public a-t-il accès aux données enregistrées par les sondes ?

Sur le site Internet de l’IRSN, vous cliquez sur l’onglet « Portail de la surveillance de la radioactivité dans l’environnement » ou vous entrez dans le navigateur de recherche l’adresse « sws.irsn.fr » qui vous amène sur une carte de France avec des points. Après avoir sélectionné « sondes du réseau Téléray », vous pouvez cliquer sur l’un des points pour avoir la chronique des mesures enregistrées sur cette sonde. Le site est mis à jour quotidiennement avec les données de la veille.

Lors de Fukushima, nous avions mis en ligne des valeurs rafraîchies plus rapidement que le lendemain pour les données de la veille. Aussi, nous avions dû ouvrir un site spécifique, le site habituel était victime d’une trop forte affluence.

Par ailleurs, il existe un autre site, celui du « Réseau National de Mesure de la Radioactivité dans l’Environnement ». Il rassemble non seulement les mesures de l’IRSN mais aussi les mesures d’autres acteurs du nucléaire, comme les exploitants ou des associations. Sur ce site, vous pouvez comparer les mesures d’EDF avec celles de l’IRSN, etc. C’est un site pluraliste, mais qui n’est mis à jour que mensuellement.

En Europe, je ne connais pas d’autre site équivalent au nôtre. Aux États Unis, non plus.

D’une certaine façon, nous payons encore la catastrophe de Tchernobyl dont ont découlé des incompréhensions entre le public et les autorités françaises. Il s’est créé un manque de confiance qui, nous l’espérons, va s’estomper avec le temps…

Vous parliez d’augmenter la densité du réseau Téléray, avez-vous d’autres projets en cours ?

Oui. Depuis 4, 5 ans, nous nous attelons à revisiter notre stratégie de surveillance de l’environnement. Celle-ci avait été mise en place après les tirs atmosphériques d’armes nucléaires dans les années 60 à 80. Les niveaux de radioactivité dans l’air étaient alors beaucoup plus importants que ceux d’aujourd’hui. Il y avait également le fait que ces équipements commençaient sérieusement à vieillir.

Le niveau de radioactivité étant moindre aujourd’hui, les équipements doivent être de plus en plus perfectionnés. Concernant les analyses en laboratoire, il faut également des appareils de mesure de la radioactivité plus puissants, capables de détecter des traces de radioactivité dans l’environnement.

Les gens ne se satisfont pas d’entendre « il n’y pas de danger sanitaire ». Ils veulent une valeur chiffrée de ce que représente la radioactivité artificielle. Cela pose donc le défi technique de trouver des moyens pour ne pas être en dessous de la limite de détection des appareils.

Par ailleurs, nous avons également le projet de changer un autre dispositif fixe que sont les cabines de prélèvement d’aérosols sur des filtres. Ces cabines vont être rénovées à partir de 2012 avec des appareils de nouvelle génération, dont le débit d’aspiration est plus important.

Propos recueillis par Carole Hamon

Nathalie Chaptal Gradoz est chef adjointe du Service d’Etude et de Surveillance de la Radioactivité dans l’Environnement (SESURE) à l’IRSN (Institut de Radioprotection et de Sûreté Nucléaire).

Pour aller plus loin :

.jpg)