Après la frénésie dont les réseaux « ad-hoc » (ou sans infrastructure) ont fait l’objet ces dernières années, il est désormais temps de passer aux applications concrètes. Profitant de la miniaturisation des équipements, les réseaux de capteurs ont ouvert la voie. Les applications sont nombreuses, dans des domaines allant de l’embarqué au militaire ou à la domotique. D’un point de vue technique, Zigbee semble être le grand gagnant, fort de ses couches basses IEEE 802.15.4.Un nouveau domaine applicatif s’est fait jour récemment introduisant de nouveaux enjeux : le domaine médical. Les « Body Area Networks » (BAN, terme apparu en 2006) ont montré les limites de la généricité de Zigbee et suscité la création du groupe IEEE 802.15.6, berceau d’une réflexion de standardisation.

Ce groupe a défini une classification des besoins selon deux axes : le type d’application et le débit. Le contrôle du diabète ou la délivrance de médicament sont des applications médicales à bas débit. Celles nécessitant l’envoi de signaux de type audio, électro-encéphalogramme, suivi de grossesse sont à débit moyen alors que le haut débit correspond à l’envoi de vidéo (endoscopie). Dans le domaine non médical, citons le fitness, l’utilisation de casques audio ou vidéo.Mais au delà du débit, ce sont également des besoins en fiabilité, sécurité et confidentialité qui distinguent ces applications.Les communications médicalesGrâce à une standardisation des protocoles, les BAN devraient permettre des économies d’échelle sur les capteurs, prothèses et autres équipements miniaturisés ; ils en faciliteront l’intéropérabilité. Le suivi de diverses constantes vitales (températures, fréquence cardiaque, taux d’insuline, …) pourrait être centralisé afin d’assurer un suivi efficace de pathologies diverses (alzheimer, diabète, suivi post-opératoire). Au delà du suivi, la communication avec des équipements actifs (pacemaker, pompe à insuline, …) peut permettre de maintenir l’état du patient.Les communications intra-corporelles ne sont pas les seules à prendre en compte, car un tel suivi médical ne saurait être longtemps autonome. Une passerelle (de type Smartphone) permettra de relayer les informations vers/depuis d’autres réseaux tels des services d’urgence. Ces communications n’entrent pas dans le cadre des BAN mais en conditionnent l’organisation.

Le groupe 802.15.6 s’est également intéressé à des applications moins dramatiques, voire plus farfelues.Un premier exemple est le suivi d’activités sportives, par le biais de capteurs de rythme cardiaque, de température, … dont les informations seraient centralisées sur un lecteur MP3 pour une analyse en temps réel ou en différé.Le marché des jeux vidéo est un autre domaine dans lequel l’utilisation de casques audio ou vidéo, de capteurs de mouvements et autres dispositifs profitera pleinement de la standardisation des BAN. De nombreux jeux pourraient être développés autour du fitness, des arts martiaux, de la chorégraphie, …De façon plus anecdotique, des services de partage d’émotion, fondés sur des capteurs (de conductivité de la peau, d’ECG, …) pourraient permettre aux réseaux sociaux de s’enrichir d’informations personnelles collectées en temps réel (humeur). Ils permettraient également la mise en place de « mood based messaging » pour envoyer automatiquement à des proches des messages liées à l’humeur, la joie, la déprime.

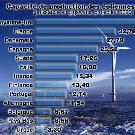

Comme nous venons de le voir, l’éventail applicatif est vaste. Il en est de même du spectre des besoins en qualité de service. Si un débit de 1 Kbit/s peut suffire à un suivi de taux d’oxygène, un électrocardiogramme nécessitera jusqu’à 500 Kbit/s et une endoscopie 1 Mbit/s. L’échelle des délais est large également, de 20 à 200 ms pour des applications de suivi médical jusqu’à quelques minutes pour les réseaux sociaux.La fiabilité doit être élevée pour presque toutes les applications hormis celles de confort. De la même façon, des taux d’erreur binaire très faibles sont nécessaires aux applications médicales. Des études doivent donc être mises en œuvre pour caractériser ce canal de transmission particulier qu’est le corps humain et proposer des techniques de codage adaptées.La sécurité et la confidentialité, enfin, doivent faire l’objet d’une attention particulière étant donnés les enjeux. De récents travaux montrant la fragilité d’équipements de type pacemakers face à des attaques, le sujet n’est pas à prendre à la légère.

Des solutions techniques existent déjà : Bluetooth pour les jeux, les réseaux sociaux, et Zigbee pour le médical.L’intérêt des BAN sera d’améliorer les applications dans le premier cas et dans le second de dépasser les faiblesses de Zigbee. Ce dernier n’a pas convaincu le groupe 802.15.6 du fait de sa faible qualité de service (couche MAC faible, délai fort et variable), et de l’absence de différenciation de services. De plus, le cahier des charges des BAN est plus contraignant ; il introduit la nécessité de coexister avec les réseaux existants, ainsi que des considérations de type reprogrammation, ergonomie et calibrage à distance. En conclusion, le standard Zigbee est incomplet.Des premiers choix technologiques se dessinent d’ores et déjà :

- Bande de fréquences médicales (402-405 MHz) pour les communications intracorporelles et bande ISM pour les communications extracorporelles ;

- Antennes électriques pour les communications extracorporelles et antennes magnétiques pour les communications intracorporelles ;

- Utilisation de la technique Ultra Wide Band (faible puissance sur un large spectre, donc faible portée et peu d’interférences) pour les communications extracorporelles.

Le travail du groupe IEEE 802.15.6 n’en est qu’à ses balbutiements en terme de choix technologiques. Les solutions apportées devront être particulièrement ambitieuses en raison de la diversité des besoins applicatifs.Trouver des protocoles fiables et peu consommateurs d’énergie reste un défi largement ouvert. L’enjeu est important car les besoins sont forts et le domaine vital. De plus, les débouchés commerciaux réels et le spectre des applications ne pourront que s’étoffer au fur et à mesure des développements technologiques.Par Nazim Agoulmine, professeur à l’Université d’Evry Val de Seine, laboratoire Lip6-CNRS