La loi Grenelle I a fixé des objectifs ambitieux pour le développement de l’électricité éolienne en France. Alors que le Programme Pluriannuel d’Investissement de 2006 avait visé 15 000 MW en 2015, la loi Grenelle I et le Programme Pluriannuel d’Investissement 2009 prévoient 25 000 MW en 2020, dont 6 000 MW en mer (« offshore »). Pour encourager le développement de l’éolien, les pouvoirs publics ont garanti son achat par EDF à un tarif imposé. Comme pour l’électricité solaire [1], nous avons cherché à savoir combien cela coûte, qui y gagnera et qui devra payer l’addition : le consommateur d’électricité ou le contribuable [2] ?

Aux tarifs d’achat actuel (86 €/MWh en terrestre, environ 130 €/MWh en offshore), la charge financière, actualisée sur la durée de la garantie d’achat [3], sera :

- pour chaque MW installé en éolien terrestre, environ 2,2 millions d’euros soit, pour les 19000 MW prévus, 42 milliards d’euros ;

- pour chaque Mw éolien « offshore », environ 6,5 millions d’euros soit, pour les 6.000 MW prévus, 39 milliards d’euros. Au total, les flux financiers, actualisés à 4 %, vont donc atteindre 80 milliards d’euros, autant que pour le solaire photovoltaïque.

Difficile de savoir exactement où va l’argent

A qui vont ces sommes colossales ?Il est difficile de répondre à cette question, tant les données sur le sujet sont opaques. On peut penser cependant que le tiers ou un peu plus vont aux fournisseurs/installateurs, et le reste, soit largement plus de la moitié, aux promoteurs.

Qui paie ?

Pour l’essentiel, c’est EDF (ses actionnaires et ses clients) et l’ensemble des redevables de la « compensation du service public de l’électricité » (CSPE). La CSPE est calculée en faisant la différence entre le tarif d’achat et le prix du marché de gros de l’électricité, évalué par la Commission de Régulation de l’Energie à près de 80€/MWh, en moyenne, pour 2009. Faible pour l’éolien terrestre, elle sera en revanche très élevée pour l’offshore ; au total, la CSPE représentera près du quart du total.Les trois quarts restants, environ 60 milliards d’euros, seront à la charge d’EDF qui, en échange, disposera chaque année des 60 et quelques TWh produits par les éoliennes.

Un tarif d’achat beaucoup trop élevé ?

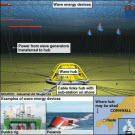

Le tableau ci-dessous présente la répartition des sommes investies dans éolien suite au Grenelle, soit environ 80 G€.

Qui y gagne, qui y perd ?

A première vue, les grands gagnants sont les fournisseurs de machines et les promoteurs : en 2006, le prix d’une éolienne de 2 MW était descendu à 1.000 €/kW, et cette machine produisait un MWh à un coût compris entre 50 à 60 €, très inférieur au tarif d’achat garanti. Depuis, au lieu de continuer à baisser, le prix des éoliennes a connu une augmentation spectaculaire de 50 %, dont on peut légitimement se demander si elle n’est pas une conséquence directe d’un tarif d’achat beaucoup trop élevé [4] ! Et aujourd’hui, face à la hausse des prix des machines, le lobby éolien réclame une augmentation du tarif d’achat.

Un mix énergétique dominé par le nucléaire et l’hydraulique

Les grands perdants sont évidemment EDF et, dans le cas de l’éolien offshore, les redevables de la CSPE. La charge financière annuelle de l’éolien, autour de 2020, sera supérieure à 4 milliards d’euros, soit près de 10 % du chiffre d’affaire d’EDF en France [5]. Certes, EDF disposera des 60 TWh produits par les éoliennes : mais ceux-ci étant produits de façon aléatoire vont se substituer à un mix électrique, dominé par le nucléaire et l’hydraulique, dont le coût marginal moyen est inférieur à 30 €/MWh [6].

En principe, le développement de l’éolien en Europe a pour objectif principal la réduction des émissions de CO2 dues à la production d’électricité. En pratique, cet objectif est probablement atteint dans les pays très dépendants des combustibles fossiles pour leur production d’électricité (Danemark, Espagne, Allemagne).

Ce n’est pas le cas en France. On aurait pu espérer, au moins, que l’industrie nationale bénéficie du soutien massif apporté à cette technique, mais celle-ci est logiquement dominée par les industries danoise et allemande (et, demain, chinoise). Il est grand temps, pour l’éolien comme pour les autres mesures du Grenelle de l’environnement, que ces ordres de grandeur soient mis sur la table, au lieu d’être passés sous silence. Les responsables politiques doivent pouvoir évaluer sérieusement les avantages et les inconvénients des différentes actions engagées au nom de la lutte pour la protection du climat car, qu’on le veuille ou pas, les ressources financières de la France sont limitées.

Sources :

[1] P. Bacher – « Les tarifs d’achat du solaire photovoltaïque doivent baisser vite » Tribune Veille Techniques de l’Ingénieur – 2 juillet 2009

[2] P. Bacher – « Loi Grenelle I et flux financiers » – Revue de l’Energie (à paraître)

[3] durée de garantie du tarif d’achat : 15 ans pour l’éolien terrestre, 20 ans pour l’éolien offshore

[4] F. Poizat – « L’apprentissage de la subvention durable » http://sauvonsleclimat.org 14 juillet 2009)

[5] On notera que l’obligation d’achat des électricités éolienne et photovoltaïque représentera, autour de 2020, près de 20 % du chiffre d’affaire d’EDF en France ; c’est l’ordre de grandeur des hausses de tarif demandée par EDF pour les prochaines années.

[6] Les seules dépenses évitées sont celles des combustibles (nucléaire et fossiles), des provisions pour la gestion des déchets et d’une éventuelle taxe sur le CO2. Le chiffre de 30 €/MWh est obtenu en admettant que le nucléaire est marginal 60 % du temps, le fossile 30 % et la pointe « spot » 10 %, et en négligeant les dépenses de raccordement au réseau.

Pierre Bacher, ancien élève de polytechnique, est l’auteur de « L’énergie en 21 questions » – édition Odile Jacob (2007), membre du conseil scientifique de Sauvons le Climat et éditorialiste à l’Espace Veille de Techniques de l’ingénieur.