Pouvez-vous nous parler de votre parcours professionnel ?

Je suis aujourd’hui CEO de Clever Identity, start-up que j’ai créée en 2021, qui propose aux centres et organismes de recherche en santé des solutions d’évaluation du risque autour de l’anonymisation des données. Concrètement, nous leur facilitons l’utilisation des données de patients, malgré les nombreuses contraintes réglementaires – notamment le RGPD – qui encadrent l’usage des données personnelles, dont celles de santé. Grâce à l’anonymisation que nous proposons, ces organismes ne sont plus soumis à ces contraintes et peuvent se consacrer à la recherche.

Par ailleurs, je suis également enseignant dans plusieurs universités, à l’institut polytechnique de Paris, à l’université de Rennes 2, à l’IMT Atlantique à Rennes et à l’IMT business schools. Dans mes cours, j’interviens spécifiquement sur l’anonymisation et l’analyse du risque relatif à la protection des données, notamment à travers le Privacy Impact Assessment (PIA). L’objectif est de compléter la formation des ingénieurs et des étudiants en reconversion professionnelle au niveau réglementaire, afin qu’ils puissent avoir des bases sur le RGPD et la gestion des données personnelles.

Quelle est votre formation ?

J’ai débuté mes études par les mathématiques fondamentales, jusqu’au niveau bac+4. Ensuite, en bac+5, je me suis orienté vers les mathématiques appliquées. À l’université de Limoges, j’ai étudié la cryptologie dans le cadre du master Cryptis.

À la fin de mon master 2, j’ai été retenu chez Orange Labs à Rennes et j’ai fait une thèse Cifre1 dans le domaine de la cybersécurité. Embauché en tant qu’ingénieur de recherche, j’ai en même temps travaillé sur ma thèse. Je souhaitais en effet appliquer mon apprentissage théorique à des cas concrets. Chez Orange, j’avais cette possibilité et c’était le meilleur compromis.

Qu’est-ce qui vous a amené à vous intéresser au RGPD et à l’anonymisation des données ?

Je m’y intéressais déjà durant ma thèse entre 2014 et 2017. Le RGPD a été adopté en 2016 et mis en place au niveau européen en 2018. J’intervenais alors uniquement sur les aspects techniques, mais je me consacrais davantage à ceux de l’anonymisation des données.

L’anonymisation occupe une place vraiment importante dans le cadre du RGPD, parce que c’est la seule méthode en mesure de faire sortir les données du champ d’application de ce règlement. Techniquement, elle permet de trouver le juste milieu entre protéger les personnes et assurer que les données restent utiles pour le besoin.

Un avis publié en 2014 par le groupe des autorités de protection de données européennes spécifie et définit l’anonymisation, en appuyant sur le respect des critères techniques que sont l’individualisation d’une personne, la corrélation et l’inférence des données. Pour schématiser, il ne faut pas pouvoir isoler une personne dans un jeu de données, par exemple par rapport à son âge, ni corréler entre eux des jeux de données relatives à une personne. Pour autant, l’inférence peut être intéressante, par exemple pour identifier dans un jeu de données les hommes d’un certain âge souffrant d’une maladie spécifique. Les données des patients sont indispensables à la recherche sur les maladies graves, mais elles doivent être anonymisées.

Dans le passé, les données concernant ces critères techniques ont été mal anonymisées et ont été violées. Les données relatives à la santé du gouverneur de l’État du Massachusetts ont ainsi été dévoilées, à l’instar de celles d’autres personnes, lors de la publication d’une étude. L’anonymisation de ces données a été mal réalisée, dévoilant aisément la maladie dont souffraient ces personnes. Dans un autre cas, les clients réguliers d’un club de strip-tease ont été identifiés grâce à la publication de données de géolocalisation de taxis.

L’erreur a été de penser que la suppression du nom et du prénom suffirait à anonymiser les données. L’instauration de critères techniques bien définis permet désormais de prouver que les données sont protégées.

Pouvez-vous revenir sur la mise en place du RGPD et sur son évolution ?

Comme pour toutes les réglementations, il y a toujours un temps d’incubation. La CNIL avait souligné d’ailleurs que les mesures deviendraient de plus en plus contraignantes au fil du temps. Cependant, les entreprises ont eu du temps pour se mettre en conformité.

De 2018 à aujourd’hui, des sanctions ont été appliquées, beaucoup plus fréquentes récemment au regard des débuts du RGPD. Ces sanctions permettent de prendre conscience des enjeux, et les entreprises évoluent d’autant plus que ces sanctions sont financières. La CNIL, notamment, sanctionne régulièrement pour cause de violation des données. Toutefois, les sanctions sont souvent précédées par les mises en demeure. Elles peuvent être rendues publiques, avec un fort impact sur l’image de l’entreprise, amenant la clientèle à s’interroger sur le niveau de sécurité de l’entreprise en question.

D’autres réglementations voient le jour, notamment sur tout ce qui encadre l’intelligence artificielle, l’IA Act, mais aussi sur tout ce qui est protection bancaire, la DORA, ou encore la NIS 2, spécifique à la sécurité informatique. Ainsi plusieurs réglementations s’enchaînent et font qu’en matière de contrôle, les choses sont de plus en plus rigoureuses, strictes.

Les entreprises ont-elles bien pris la mesure de l’enjeu ?

Pour ma part, je note une prise de conscience progressive de l’importance de la réglementation et son acceptation. Son intérêt et l’impact d’un mauvais traitement des données personnelles sont de mieux en mieux compris. Les sanctions et mises en demeure ont joué dans cet écosystème qui incite les entreprises à se mettre en conformité.

Tous les secteurs d’activité ne se valent pas. La réglementation est généralement intégrée dans les politiques du secteur financier. Les données y sont effectivement sensibles. C’est différent dans le domaine de la santé qui relève du domaine public, mais qui, compte tenu de difficultés financières, a du mal à se mettre en conformité. Ces secteurs ont intégré la réglementation et tentent malgré tout de veiller à son respect. La grande distribution ou l’énergie recueillent également des informations sensibles, variables suivant la taille de l’entreprise. Les grandes entreprises sont forcément plus regardées que les PME, ce qui a une conséquence sur le niveau de prise de conscience de chacune.

Pour l’essentiel, les grandes entreprises des secteurs d’activité évoqués se conforment et ont un niveau de maturité un peu plus avancé que les autres. Globalement, tout le monde a entendu parler du RGPD et a plus ou moins sa signification en tête, mais la mise en pratique ne suit pas forcément.

La CNIL fait un travail de sensibilisation remarquable en matière de recommandations. Elle publie ainsi régulièrement des fiches permettant de se mettre en conformité. Concernant les entreprises, cela se fait en fonction de leur taille, du nombre et de la complexité des traitements à réaliser, mais également des sommes en jeu notamment en raison des sanctions. Les grandes entreprises ont plus à perdre, donc privilégient ce qui est le plus rentable. Au regard du budget et du risque de sanction, elles prennent un consultant ou un délégué à la protection des données (DPO) qui les aidera à se mettre en conformité.

En quoi consiste l’anonymisation des données personnelles ? Pouvez-vous nous parler de cette méthode ?

Concrètement, l’anonymisation des données personnelles permet de traiter et transformer les données personnelles pour qu’elles ne le soient plus. L’anonymisation est définie par la réglementation et si d’autres définitions sont parfois utilisées, celle qui fait foi est celle proposée par l’ensemble des autorités de protection de données européennes dans un avis publié en 2014. Pour être considérées comme anonymisées, il faut pouvoir s’assurer qu’elles ne puissent plus être individualisées, corrélées et inférées.

Pour sa part, la CNIL a publié sur son site une autre manière d’évaluer l’anonymisation. Elle enjoint ainsi, à défaut de remplir scrupuleusement ces trois critères, de mener une analyse de risque de réidentification pour démontrer que, sur la base de moyens raisonnables, ce risque est nul. C’est ce qu’il faut réussir à démontrer et qui correspond à l’anonymisation des données.

Certaines entreprises que j’ai accompagnées utilisent une définition qui est ad hoc et qu’elles ont plus ou moins créée, consistant en la possibilité de rendre les données irréversibles une fois qu’elles ont été anonymisées. La difficulté est que l’irréversibilité est mal comprise puisque, selon ces entreprises, elle consisterait simplement à supprimer le nom et le prénom. Or, une étude a prouvé qu’il est possible, à partir du genre ou du code postal et d’une année de naissance, d’identifier quelqu’un. Il ne faut pas considérer que seules certaines données sont identifiantes, d’autres le sont également. La CNIL a donc défini des critères techniques plus précis pour caractériser l’anonymisation, afin de protéger les personnes et prouver qu’elles le sont. Cette preuve doit se faire à partir d’une analyse de risque très technique et qui nécessite une expertise.

Clever identity propose justement une solution simple pour évaluer l’anonymisation et démontrer que les données peuvent être utilisées.

Il n’est pas nécessaire, voire possible, de supprimer tous les risques ; il faut les réduire à un niveau acceptable. En pratique, le besoin de conserver l’utilité des données sous leur forme anonymisée ne permet pas de garantir un risque zéro. Par exemple, l’anonymisation peut passer par la généralisation à partir d’une adresse dont on ne gardera que le code postal ou que la ville. Cependant, si dans une étude, il faut également conserver la rue, il faudra trouver un juste milieu dans le jeu de données. C’est ce qui empêche de prétendre à un risque zéro, parce qu’il restera toujours un minimum d’information.

La CNIL et d’autres réglementations, comme la loi informatique et libertés, existaient bien avant le RGPD. La CNIL décidait de la conformité de l’anonymisation. Aujourd’hui, le RGPD introduit le principe de responsabilité qui stipule que toute une entreprise se met en conformité elle-même, sans nécessairement consulter la CNIL. Il lui faut en revanche démontrer que tout a été mis en œuvre pour garantir la conformité et que le risque est faible.

Notre travail consiste à être en conformité avec ces recommandations. En suivant les mises à jour de la CNIL, nous arrivons à produire une anonymisation conforme à ce que la réglementation demande. Notre activité repose principalement sur l’évaluation des risques de réidentification. Nous arrivons à rassurer les entreprises sur le niveau de conformité de leur anonymisation en leur permettant d’avoir une vision claire sur le risque de réidentification contenu dans les données anonymisées. En revanche, si nous déterminons que le risque est toujours élevé, nous proposons des contre-mesures via l’anonymisation des données, permettant de réduire le risque initial à un risque cible acceptable. C’est ce qui nous distingue dans notre secteur d’activité.

Quelles sont les différences entre anonymisation, chiffrement et pseudonymisation des données personnelles ?

La pseudonymisation et le chiffrement sont des méthodes qui conservent le caractère personnel des données et ne peuvent donc pas faire sortir les données du champ d’application du RGPD, à l’inverse de l’anonymisation.

La pseudonymisation, parce qu’elle empêche l’identification directe, est une méthode qui permet d’apporter un certain niveau de sécurité des données. L’anonymisation, pour sa part, empêche à la fois une identification directe et une identification indirecte.

Un identifiant direct est par exemple un nom, un prénom, une photo. C’est une information qui peut être utilisée pour identifier de façon directe. Un identifiant indirect peut être un numéro de téléphone, un numéro de sécurité sociale ou même le fait de porter une chemise bleue : si une seule personne dans une pièce porte une chemise bleue, cela permet de l’identifier, de façon indirecte.

Il y a aussi d’autres manières d’identifier indirectement, notamment en combinant plusieurs valeurs. Par exemple, si plus d’une personne a une chemise bleue, l’une d’elles peut porter des lunettes marron. En combinant ces informations, il est possible d’identifier de manière indirecte.

La pseudonymisation n’empêche pas ce type d’identification. Elle empêche l’identification directe, mais pas indirecte. Seule l’anonymisation casse ce lien et permet que l’on ne puisse plus identifier de manière directe et indirecte. Il n’y a plus de donnée personnelle.

Le chiffrement, quant à lui, est réversible. C’est systématique, lorsqu’on déchiffre les données, on retrouve les données d’origine. Voilà donc la différence entre anonymisation, chiffrement et pseudonymisation.

Votre casquette de consultant vous amène-t-elle à intervenir auprès d’acteurs industriels ? Si c’est le cas, dans quel secteur ?

La solution que nous proposons est spécifiquement adaptée au secteur de la santé en particulier dans le domaine de la recherche, mais elle peut être utilisée dans d’autres contextes, notamment en contexte bancaire, ainsi que dans toutes les activités autour de l’intelligence artificielle (IA).

Aujourd’hui, travailler sur des données personnelles dans le but de construire des modèles d’intelligence artificielle est soumis à des mesures réglementaires contraignantes. L’anonymisation des données permet de ne pas subir ces contraintes. En conséquence, nous pouvons intervenir auprès de tous ceux qui ont besoin de données pour faire de l’IA sans les contraintes.

En cas de contrôle, il faut en revanche pouvoir prouver que l’anonymisation a été bien faite, ce dont ne se rendent pas forcément compte les industriels. Les fournisseurs de ce service de solutions d’anonymisation n’en parlent pas forcément en effet, n’ont pas toujours la compétence pour l’évoquer, parce que c’est très technique. La CNIL préconise de contacter un expert pour pouvoir évaluer le risque et s’assurer de sa prise en charge. Certaines entreprises mettent en place des choses, mais sont potentiellement en danger en raison d’une non-conformité. Anonymiser ne suffit pas, il faut démontrer que les personnes sont protégées.

Quelles compétences/qualités sont, selon vous, indispensables concernant l’anonymisation de données ?

Pour le domaine de l’anonymisation, il faut connaître la réglementation. Il n’est pas nécessaire d’être un expert, mais il faut bien comprendre le périmètre, les enjeux concrets et pas uniquement les aspects techniques. Les maîtriser est crucial. L’enjeu principal pour les entreprises est qu’elles soient conformes pour éviter la sanction.

Dans les enjeux techniques, la cybersécurité et plus précisément l’analyse de risques cyber et la compréhension de la data science sont des compétences importantes pour connaître le fonctionnement de l’anonymisation des données.

La curiosité et l’ouverture d’esprit permettent de s’adapter. En effet l’anonymisation varie d’un contexte à un autre et demande des softs skills comme l’agilité, la flexibilité.

Quels conseils donneriez-vous à un étudiant ou ingénieur désirant s’orienter dans le secteur de l’anonymisation des données ?

Je lui dirais que c’est un domaine très intéressant et porteur. On a besoin de gens qui peuvent aider à l’usage des données, lesquelles sont partout. On dit que c’est le nouveau pétrole de notre ère. Mais en même temps la réglementation contraint vraiment l’accès à ces données.

L’anonymisation fait tomber ces barrières. Elle est très utile à ceux qui travailleront pour des entreprises qui, toutes, auront besoin des données, que ce soit pour tester leur application, savoir si celle-ci fonctionne bien après un développement ou pour faire de l’intelligence artificielle. Les modèles d’IA sont déjà très nombreux et avec cette prolifération, cette problématique ira en grandissant.

L’anonymisation ayant de l’avenir, il ne faut pas hésiter à s’y pencher, d’autant qu’elle comporte aussi des challenges techniques. C’est vraiment intéressant.

Que vous apporte la collaboration avec Techniques de l’Ingénieur ?

Je suis en contact avec Techniques de l’Ingénieur depuis 2018. L’article que j’ai rédigé figure parmi les plus consultés. J’avais été recommandé par une professeure de Télécom Sud Paris, Maryline Laurent.

Il se dit dans le monde de la recherche que l’on trouve dans Techniques de l’Ingénieur ce qu’on ne trouve pas ailleurs.

Je suis habitué à rédiger des articles de recherche, mais là, le travail a été un peu inhabituel puisqu’il s’agissait de vulgarisation. Cela m’a beaucoup intéressé, parce qu’il m’a fallu une approche pédagogique sur ces questions, notamment sur la différence entre pseudonymisation, anonymisation, chiffrement, ou encore le processus à mettre en place pour anonymiser les données.

1convention industrielle pour la formation par la recherche

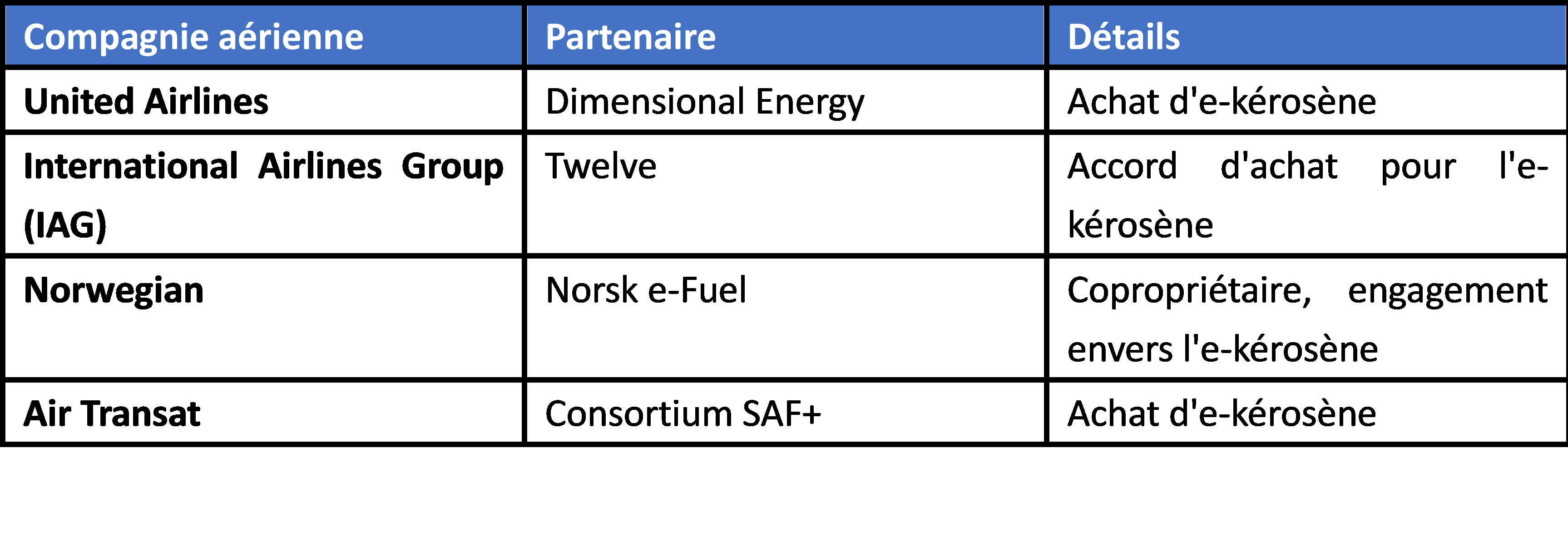

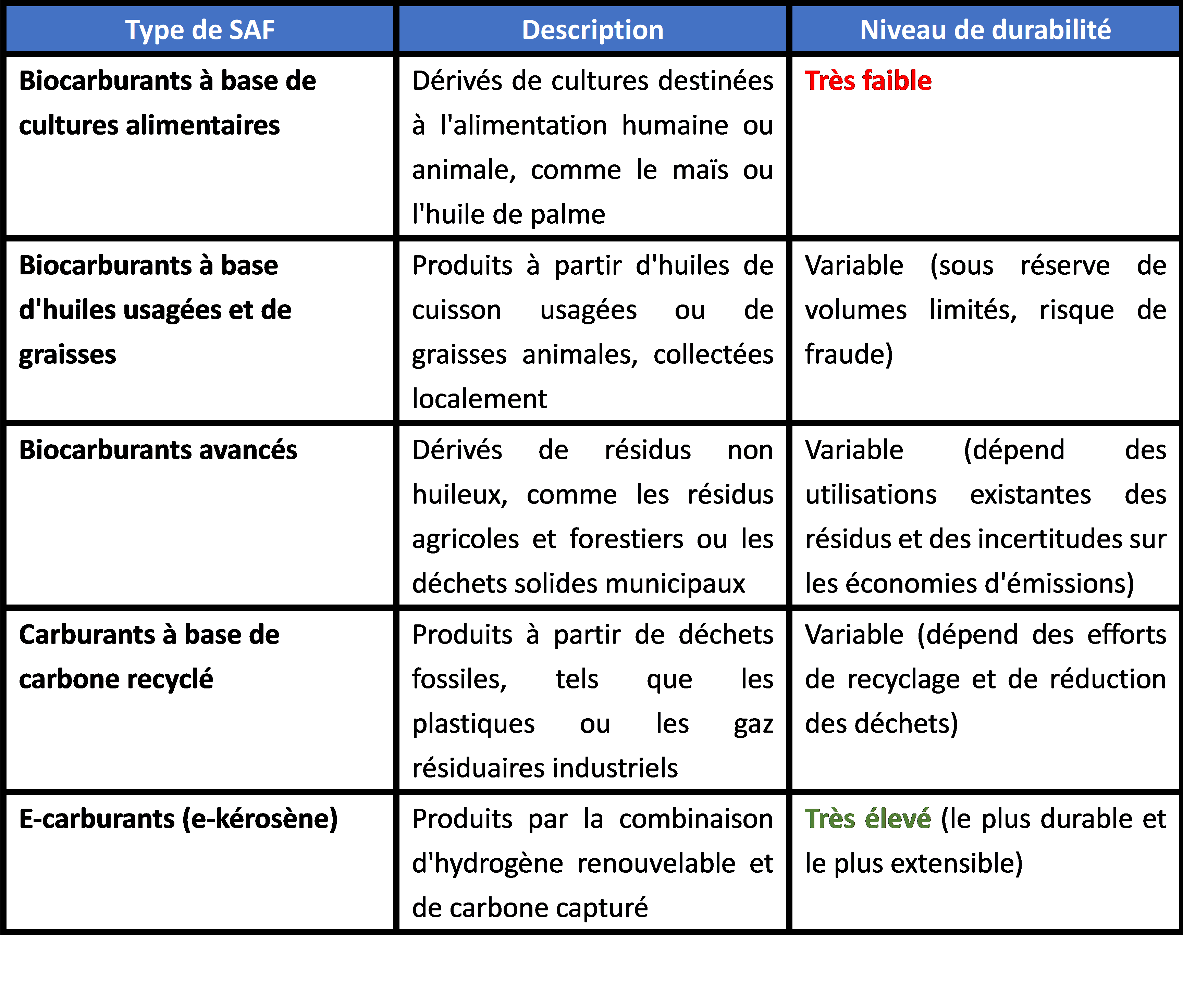

Ces compagnies, bien qu’elles ne soient pas encore en mesure de réduire de manière significative leurs émissions d’ici 2030 et 2035, se démarquent néanmoins par leurs investissements et achats dans des

Ces compagnies, bien qu’elles ne soient pas encore en mesure de réduire de manière significative leurs émissions d’ici 2030 et 2035, se démarquent néanmoins par leurs investissements et achats dans des  Néanmoins, toutes ces compagnies ont le mérite d’avoir déjà mis le pied à l’étrier, car il faut rappeler que la moitié des 77 compagnies du classement n’ont même pas fixé d’objectif en termes d’utilisation de SAF !

Néanmoins, toutes ces compagnies ont le mérite d’avoir déjà mis le pied à l’étrier, car il faut rappeler que la moitié des 77 compagnies du classement n’ont même pas fixé d’objectif en termes d’utilisation de SAF !