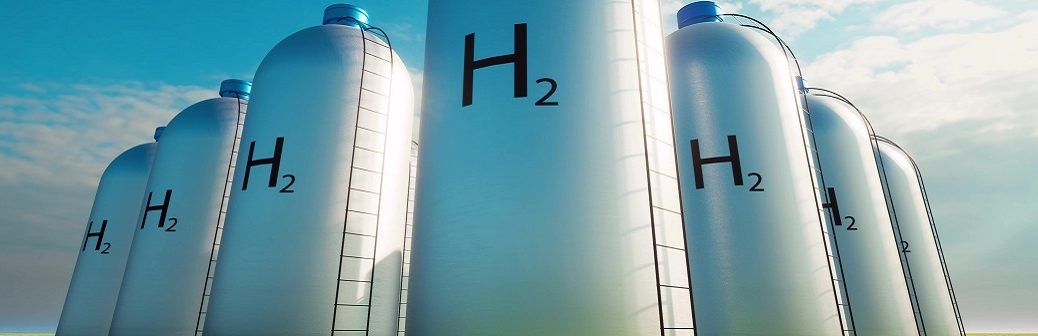

Dans le cadre du PEPR-H2, Myriam Merad, directrice de recherche au CNRS (UMR LAMSADE, Université Dauphine PSL), dirige le projet AIDHY, qui a pour finalité d’analyser le déploiement de la filière hydrogène décarboné sur les territoires et d’accompagner les acteurs de la filière et les parties prenantes dans l’évaluation de la la soutenabilité des projets industriels autour de l’hydrogène.

Myriam Merad a expliqué aux Techniques de l’Ingénieur les enjeux de soutenabilité explorés à travers le projet AIDHY(Aide à la Décision pour l’analyse et l’évaluation de la filière hydrogène décarboné). Ce dernier permet également d’interroger la vision « solutionniste » qui prédomine dans les politiques de transition énergétique, comme cela peut être le cas en ce qui concerne l’hydrogène, notamment, et propose une approche systémique pour rendre compte et évaluer la viabilité et la soutenanbilité des projets hydrogène sur les territoires.

Techniques de l’Ingénieur : Quel est l’objectif principal du projet AIDHY sur lequel vous travaillez ?

Myriam Merad : L’objectif du projet AIDHY est d’interroger ce qui est aujourd’hui largement présenté comme une évidence : le déploiement de l’hydrogène décarboné dans les stratégies de transition énergétique. L’hydrogène est souvent mobilisé comme une réponse à la lutte contre le changement climatique, en particulier à travers la réduction des émissions de CO₂. Cette contribution est réelle et importante, mais elle ne suffit pas à caractériser la soutenabilité d’une filière.

Notre point de départ est donc simple : que signifie concrètement dire qu’une filière est soutenable ? Peut-on réduire cette question aux seules émissions de CO₂, à la rentabilité économique ou à la faisabilité technologique, ou faut-il intégrer d’autres dimensions (sociales, territoriales, environnementales, institutionnelles) qui conditionnent sa robustesse sur le long terme ?

Au-delà de ce questionnement fondamental, AIDHY vise aussi à accompagner les porteurs de projets et les acteurs des territoires. Le déploiement de projets hydrogène implique des procédures complexes (autorisations, concertation, gestion des risques, acceptabilité locale) et des contraintes multiples. Le projet cherche à fournir des outils et des cadres d’analyse permettant d’anticiper ces enjeux, plutôt que de les découvrir une fois les projets engagés…

Comment définissez-vous concrètement la soutenabilité sociétale d’un projet hydrogène ?

La soutenabilité sociétale ne se réduit pas à une seule dimension. Elle repose sur une articulation entre des enjeux économiques, environnementaux et sociaux, en tenant compte des échelles et des acteurs concernés. Sur le plan social, nous portons une attention particulière à l’ancrage territorial des projets. Un projet hydrogène est-il cohérent avec une trajectoire territoriale déjà construite ? A-t-il fait l’objet d’un dialogue réel avec les parties prenantes locales, ou est-il porté de manière descendante, sans appropriation locale ?

Nous interrogeons également la capacité des projets à produire des bénéfices territoriaux, et pas uniquement des bénéfices globaux. La transition énergétique répond à un enjeu mondial, mais elle se déploie localement. La question est donc de savoir si un projet contribue réellement au développement local, à l’emploi, à la réduction des nuisances ou des vulnérabilités, ou s’il externalise une partie de ses coûts sur les territoires.

Pour objectiver ces dimensions, nous avons construit un référentiel de plus de 250 critères couvrant les aspects socio-économiques, environnementaux et territoriaux. Tous ne sont pas activés dans chaque cas, car les priorités varient selon les territoires et les acteurs. L’enjeu n’est pas d’imposer une grille unique, mais de rendre visibles et discutables les critères qui fondent les jugements de soutenabilité.

Comment le projet s’articule-t-il concrètement sur les territoires ?

Nous cherchons à comprendre comment la filière hydrogène se décline concrètement dans les territoires. Lorsqu’une stratégie nationale identifie des territoires de déploiement, la question est de savoir si cette déclinaison est pensée uniquement à partir d’objectifs globaux, ou si elle intègre réellement les configurations locales : tissu industriel existant, contraintes foncières, ressources disponibles, risques déjà présents, priorités des collectivités.

Nous analysons notamment la manière dont les projets s’insèrent dans les dynamiques territoriales : viennent-ils compléter des stratégies locales existantes, ou entrent-ils en concurrence avec d’autres usages, d’autres projets ou d’autres priorités ? Sont-ils portés par une vision de long terme, ou répondent-ils à des opportunités conjoncturelles de financement ou de positionnement industriel ?

Méthodologiquement, nous combinons une analyse macroscopique des trajectoires nationales avec des études de cas territoriales approfondies, notamment en Auvergne–Rhône-Alpes et en Bretagne. Nous avons également lancé une enquête nationale sur la perception des risques et des opportunités liés à la filière hydrogène et à sa soutenabilité. Ces retours d’acteurs sont essentiels pour comprendre comment la filière est perçue, appropriée ou questionnée sur le terrain, et pour enrichir l’analyse des trajectoires possibles…

Quelles méthodologies développez-vous pour évaluer la soutenabilité ?

Nous nous appuyons sur les méthodes existantes d’évaluation multicritère et multi-acteurs, tout en allant au-delà des analyses de cycle de vie classiques. Ces dernières sont nécessaires, mais insuffisantes pour appréhender des filières complexes et évolutives comme l’hydrogène. Nous avons ainsi posé les bases d’une méthode permettant d’évaluer non pas une filière de manière statique, mais des trajectoires de filière à différents horizons temporels 5, 10, 20, 50 ans, voire davantage.

Ces trajectoires sont construites avec les acteurs des territoires, à travers des exercices prospectifs, afin de confronter les besoins actuels aux usages futurs, aux contraintes à venir et aux capacités d’adaptation. Une filière pensée pour répondre à des enjeux immédiats peut se révéler inadaptée demain si elle ne s’insère pas correctement dans un portefeuille plus large de solutions énergétiques.

Enfin, nous intégrons explicitement la question des risques et des nuisances. La filière hydrogène s’implante souvent dans des zones industrielles déjà exposées, ce qui peut conduire à une concentration des risques. Si certaines trajectoires peuvent contribuer à réduire les émissions et certaines nuisances, d’autres peuvent faire émerger de nouveaux enjeux, comme la pression sur la ressource en eau liée aux électrolyseurs. L’évaluation de la soutenabilité consiste précisément à rendre visibles ces arbitrages et ces effets de trajectoire, afin d’éclairer les décisions avant qu’elles ne deviennent irréversibles..

Comment évaluez-vous la soutenabilité énergétique de l’hydrogène par rapport aux autres sources d’énergie ?

Il faut d’abord lever une ambiguïté importante : l’hydrogène décarboné n’est pas une source d’énergie, mais un vecteur énergétique. Sa soutenabilité ne peut donc pas être évaluée comme celle de l’éolien, du photovoltaïque ou du nucléaire, qui sont des sources primaires. Elle dépend entièrement des sources d’énergie mobilisées pour le produire, des usages auxquels il est destiné, et de la manière dont il s’insère dans un système énergétique plus large.

C’est pourquoi il est insuffisant de comparer uniquement des procédés de production d’hydrogène entre eux. Une évaluation pertinente suppose de comparer des scénarios énergétiques complets : que se passe-t-il si, pour répondre à un même besoin, on mobilise directement de l’électricité renouvelable, ou si l’on passe par un vecteur comme l’hydrogène, avec ses pertes, mais aussi ses capacités de stockage, de transport et de flexibilité ? Ce sont ces arbitrages systémiques qui permettent d’éclairer les choix.

Dans nos travaux, nous distinguons clairement le procédé, qui concerne la production, et la filière, qui englobe l’ensemble de la chaîne, de la production à la distribution et aux usages. La soutenabilité de l’hydrogène se joue à l’échelle de cette chaîne complète, et doit être mise en regard d’autres portefeuilles ou scénarios énergétiques, notamment à l’échelle des territoires.

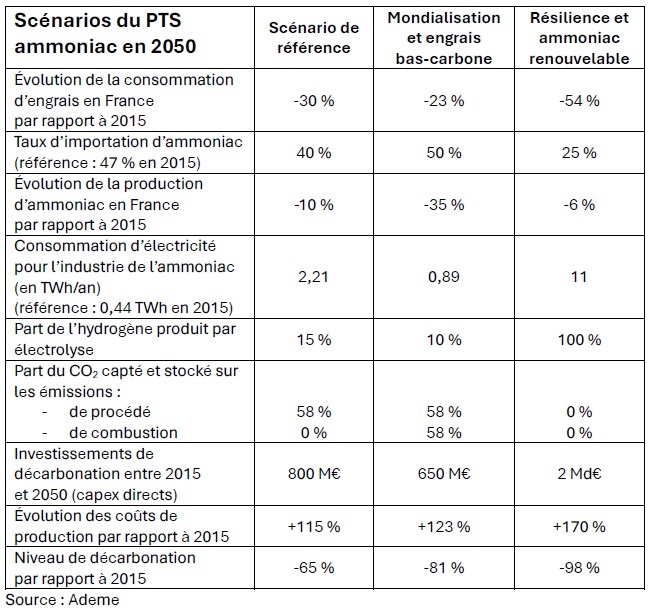

Enfin, la soutenabilité n’est pas une propriété absolue. Elle dépend des critères retenus, des échelles considérées et de ce que l’on choisit de rendre évaluable. Une analyse menée par l’ADEME, par une collectivité territoriale ou par des acteurs industriels ne posera pas exactement les mêmes questions. C’est pourquoi l’enjeu n’est pas de trancher une fois pour toutes, mais de rendre explicites les hypothèses, les arbitrages et les effets de trajectoire associés aux choix énergétiques..

Votre démarche semble arriver après le lancement de nombreux projets. Comment l’expliquez-vous ?

La réflexion qui a émergé au sein de notre consortium part d’un constat simple : la transition énergétique est encore trop souvent pensée de manière essentiellement solutionniste. Bien sûr, la dimension technique est indispensable, mais elle ne peut pas suffire. Ce qui manque fréquemment, c’est une réflexion explicite sur le projet de territoire et de société que ces solutions engagent dans le temps.

L’exemple du nucléaire est souvent mobilisé, non pour juger une technologie en soi, qui a répondu, et continue de répondre, à des besoins énergétiques et stratégiques majeurs, mais pour rappeler que des choix construits principalement de manière technocratique peuvent produire, sur le long terme, des effets sociaux, environnementaux et territoriaux insuffisamment anticipés, et enfermer l’action publique dans des trajectoires difficiles à infléchir. Ce raisonnement vaut d’ailleurs pour toute option énergétique ou technologique dès lors qu’elle engage des horizons de plusieurs décennies.

Les outils existants, comme les études d’impact, les études de dangers, le débat public ou la concertation, obligent déjà à introduire une partie de ces questions, mais de façon fragmentée et souvent trop tardive. Ce qui fait encore défaut, c’est un espace de réflexion plus global et réellement en amont, capable de poser collectivement la question suivante : quelle société voulons-nous construire au regard des contraintes actuelles et des choix énergétiques que nous faisons aujourd’hui ? À cet égard, l’absence d’un véritable lieu de pensée stratégique de long terme – à l’image de ce que fut le Commissariat au Plan, et que France Stratégie tente aujourd’hui de réinvestir – reste un angle mort de la conduite des projets.

Quels sont les facteurs qui expliquent cette absence de vision systémique ?

Il y a plusieurs éléments de réponse, mais ils tiennent moins à des chocs ponctuels qu’à un état structurel de l’action publique. L’État est aujourd’hui à bout de souffle, non seulement en termes de moyens, mais aussi de capacités d’anticipation, de coordination et de réaction. Il devrait être un acteur de la prévoyance et du long terme ; or il fonctionne de plus en plus dans une logique de gestion de l’urgence, ce qui affaiblit sa capacité à penser les trajectoires.

Les crises récentes, qu’il s’agisse du Covid ou de la guerre en Ukraine, ne sont pas la cause de cette situation, mais en ont été des révélateurs. Elles ont mis en lumière un déficit de préparation et d’anticipation, et une difficulté à sortir de réponses construites dans l’urgence, souvent sous fortes contraintes politiques, économiques et administratives.

Un deuxième facteur tient à l’enfermement progressif de l’État dans un modèle technocratique très sectorisé. Cette culture a longtemps été une force, notamment dans des domaines comme l’énergie ou l’industrie, mais elle tend aujourd’hui à produire des raisonnements en silos et une survalorisation de la solution technique. Or, une solution n’est jamais absolue : elle est toujours située, territoriale, sociale, et inscrite dans un contexte donné. Lorsque cette dimension est négligée, les politiques publiques se verrouillent dans des choix difficiles à réinterroger.

À cela s’ajoute le cloisonnement des périmètres de la sphère publique. Les enjeux économiques, environnementaux, sanitaires et sociaux sont traités par des administrations et des agences distinctes, qui n’ont ni toujours le temps ni les incitations pour construire une lecture réellement intégrée en amont. On aboutit alors à des arbitrages optimisés sur un critère, mais sous-optimaux, voire contre-productifs, sur d’autres.

Enfin, la pression de l’innovation rapide et de la compétition internationale accentue ces dynamiques. La question de la compétitivité est stratégique, mais lorsqu’elle devient dominante, elle peut pousser à des choix dictés par le positionnement international plutôt que par une analyse fine des besoins, des vulnérabilités et des capacités d’adaptation des territoires.

Dans ce contexte, la lutte contre le changement climatique, qui est une nécessité absolue, tend parfois à être abordée à travers un cadre trop étroit, centré principalement sur la réduction des émissions de CO₂. Si cet objectif est fondamental, sa transformation en indicateur quasi exclusif peut réduire la pensée et invisibiliser d’autres enjeux essentiels : adaptation, ressources, santé, biodiversité ou acceptabilité sociale. Cela contribue à enfermer les choix énergétiques et technologiques dans des alternatives insuffisamment pensées de manière systémique..

Quel message voudriez-vous faire passer aux décideurs ?

Ce que l’on observe avec l’hydrogène décarboné n’a rien d’exceptionnel. Les mêmes logiques se retrouvent dans d’autres choix structurants, métaux critiques et terres rares, intelligence artificielle, infrastructures énergétiques ou numériques, dès lors que l’on engage des trajectoires de long terme. Ce sont moins les secteurs qui posent problème que la manière dont ces choix sont pensés, cadrés et justifiés.

Le risque est alors de transformer des décisions profondément politiques en décisions présentées comme purement techniques, nécessaires ou évidentes. Or ces choix produisent des effets durables : dépendances industrielles et géopolitiques, rapports de pouvoir asymétriques, réduction des marges d’adaptation et, parfois, enfermement dans des trajectoires difficiles à infléchir.

Il ne s’agit pas de céder au catastrophisme, mais d’assumer un pessimisme de la raison : regarder lucidement vers quoi ces trajectoires nous conduisent, précisément parce qu’elles sont portées par de bonnes intentions, et se donner les moyens d’en interroger les effets non intentionnels. Cette lucidité est une condition de la responsabilité, pas un frein à l’action.

Dans l’architecture institutionnelle française, la séparation, au moins fonctionnelle, entre le politique, l’administratif et le scientifique devait jouer un rôle de garde-fou, en permettant à chaque niveau de poser ses propres questions et d’introduire de la réflexivité dans la décision publique. Or cette capacité s’érode lorsque les cadres de problème, les expertises mobilisées et les horizons temporels sont de plus en plus alignés sur des impératifs politiques de court terme.

L’éthique et la responsabilité sociétale ne relèvent alors plus d’un supplément moral ou d’un discours d’accompagnement. Elles deviennent des conditions centrales de la qualité du choix public, c’est-à-dire de sa capacité à intégrer ses angles morts, ses effets différés et les conséquences pour les acteurs absents ou peu audibles dans la décision.

Propos recueillis par Pierre Thouverez