Pour l’édition 2021 du concours Ingénieuses, le jury est composé de membres de la CDEFI (Conférence des directeurs des écoles françaises d’ingénieurs) et de représentant·e·s de leurs partenaires et soutiens : l’Agence universitaire de la Francophonie, ATC France, le Bureau national des élèves ingénieurs, la Commission des titres d’ingénieur, Femmes ingénieurs, Ingénieurs et scientifiques de France, STMicroelectronics, Talents du numérique et Techniques de l’Ingénieur.

Par ailleurs, cette édition est marquée par la création d’un prix récompensant un des projets ayant obtenu le label Cap Ingénieuses, la nouvelle initiative de la CDEFI qui vise à mettre en lumière des actions de sensibilisation aux métiers des sciences et technologies et à l’égalité femmes-hommes menées par des écoles d’ingénieur auprès de classes d’écoles élémentaires et de collèges.

185 candidatures et projets ont été déposés entre le 26 janvier et la date butoir fixée au 10 mars 2021. À l’issue des délibérations, les nominé·e·s suivant·e·s ont été désigné·e·s (par ordre alphabétique) :

- prix à destination des écoles (quatre écoles seront récompensées) :

- ENSAE Alumni, pour son projet « Parcours de Femmes ingénieuses économistes : l’ENSAE ou l’École de la Data »,

- l’ENSSAT, pour son projet « ADA LOVELACE »,

- l’ESIEA, pour son projet « #SiJeVeuxTuPeux #IfIWantYouCan »,

- l’ESIROI, pour son projet « Mois de la Femme Ingénieure (MFI) »,

- l’INSA Lyon, pour son projet « Semaines thématiques de sensibilisation autour de nombreux thèmes »,

- Grenoble INP, pour son projet « Genre INP’lication »,

- Polytech Sorbonne, pour son projet « HeForShe Polytech Sorbonne »,

- UniLaSalle, pour son projet « Club Universal » ;

- prix Cap Ingénieuses :

- le département d’ingénierie de l’université des Antilles, pour son projet « Devenir ingénieure aux Antilles »,

- l’ENSI Poitiers, pour son projet « Transmettons à la nouvelle génération ! »,

- l’ENSTA Bretagne, pour son projet « L Codent L Créent » ;

- prix de l’élève-ingénieure France :

- Alix DUTHOIT, élève à Polytech Annecy-Chambéry,

- Thiziri NAIT SAADA, élève à Télécom Paris,

- Alexandra ROSU, élève aux Arts et Métiers d’Aix-en-Provence ;

- prix de la femme ingénieure (deux femmes ingénieures seront récompensées) :

- Sarah BOZZA, diplômée de l’université de technologie de Troyes et Senior Product Manager chez Amazon,

- Florence GABORIT, diplômée d’AgroParisTech et des Mines ParisTech et ingénieure de recherche en hydrologie et télédétection au laboratoire mixte international TREMA,

- Christelle OLALDE, diplômée de l’ISAE-Supméca et Head Of Digital Cabine et Architecture Électrique chez Airbus,

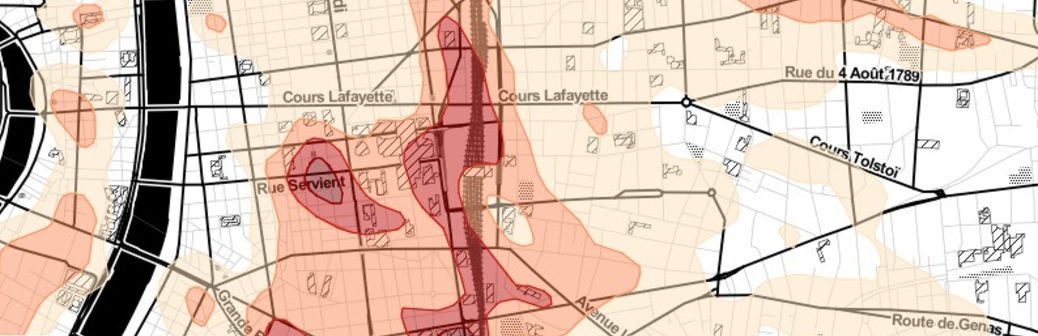

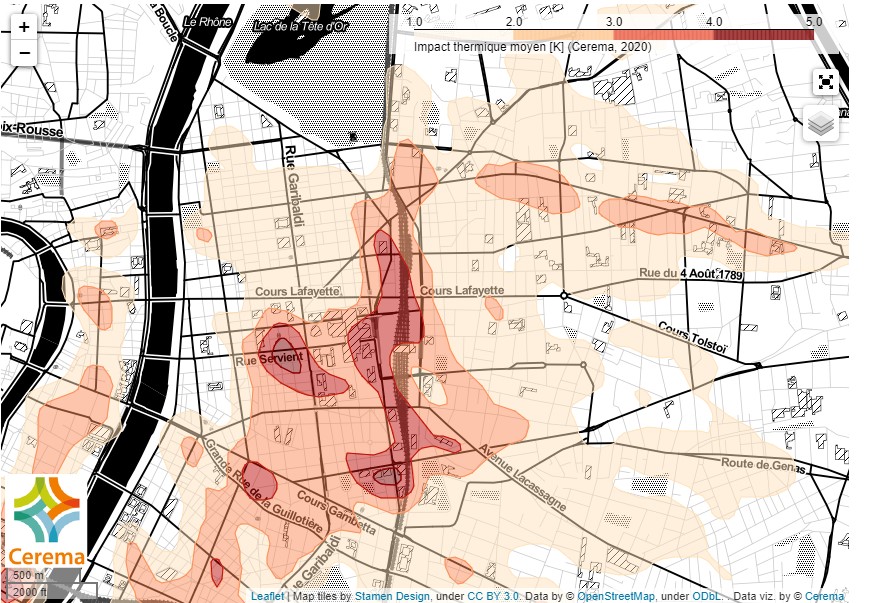

- Maäréva PAYET, diplômée de l’INSA Strasbourg et ingénieure chargée de projet et doctorante en thèse CIFRE en collaboration avec le laboratoire d’écologie urbaine Réunion et le laboratoire de recherche PIMENT (Physique et ingénierie mathématique pour l’énergie, l’environnement et le bâtiment) de l’université de La Réunion,

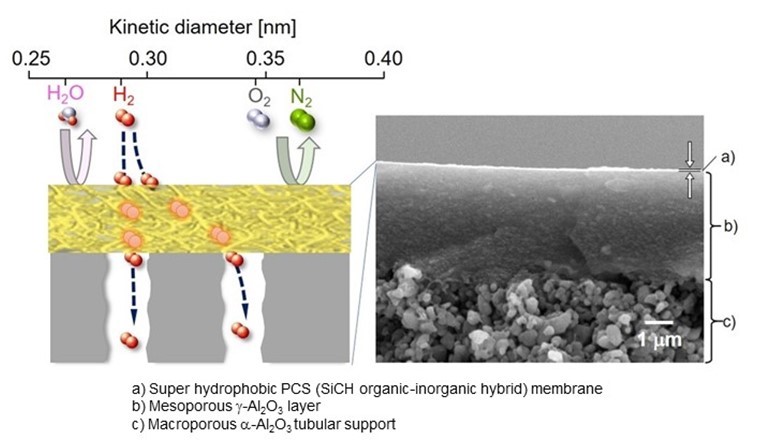

- Amélie RAMET, diplômée de l’ENSIC, intervenante à l’ESTP Paris – campus de Troyes et chargée de mission observatoire au CEIA (Club écologie industrielle de l’Aube).

Parallèlement, l’Agence universitaire de la Francophonie au Maghreb, partenaire de la CDEFI, statuera sur la lauréate du prix de l’élève-ingénieure Maghreb.

Les noms des écoles d’ingénieur·e·s, élèves-ingénieures (France et Maghreb) et femmes ingénieures lauréates dans chaque catégorie seront dévoilés lors de la cérémonie de remise des prix d’Ingénieuses, qui se tiendra le jeudi 20 mai 2021.

Agnès Guillot : Les plantes, contrairement aux animaux, ne se déplacent pas. Elles sont donc obligées d’analyser et de prévoir de multiples facteurs de l’environnement – biotiques (en rapport à la vie ou êtres vivants) et abiotiques (non vivants) – pour maximiser leurs chances de survie. Pour cela, elles doivent donc prendre de multiples décisions. Pour l’ingénierie, il est très intéressant de comprendre comment elles le réalisent sans système nerveux. Par ailleurs, les plantes ne se déplacent pas mais elles bougent constamment, sans équipement musculaire. Il est aussi intéressant de comprendre comment des machines pourraient se mouvoir sans avoir de moteurs complexes et énergivores. Enfin, les plantes sont autonomes énergétiquement, elles fabriquent leur carburant par photosynthèse, contrairement aux animaux qui ont besoin de manger des végétaux ou d’autres animaux. Pour l’instant, une photosynthèse artificielle n’est pas encore compétitive.

Agnès Guillot : Les plantes, contrairement aux animaux, ne se déplacent pas. Elles sont donc obligées d’analyser et de prévoir de multiples facteurs de l’environnement – biotiques (en rapport à la vie ou êtres vivants) et abiotiques (non vivants) – pour maximiser leurs chances de survie. Pour cela, elles doivent donc prendre de multiples décisions. Pour l’ingénierie, il est très intéressant de comprendre comment elles le réalisent sans système nerveux. Par ailleurs, les plantes ne se déplacent pas mais elles bougent constamment, sans équipement musculaire. Il est aussi intéressant de comprendre comment des machines pourraient se mouvoir sans avoir de moteurs complexes et énergivores. Enfin, les plantes sont autonomes énergétiquement, elles fabriquent leur carburant par photosynthèse, contrairement aux animaux qui ont besoin de manger des végétaux ou d’autres animaux. Pour l’instant, une photosynthèse artificielle n’est pas encore compétitive.