RELIEF[1] est un copilote IA de chiffrage, pensé pour les industriels, qui automatise la création de devis complexes.

En générant des recommandations intelligentes, RELIEF améliore la performance des équipes de technico-commerciaux, et optimise le niveau de marge des affaires.

Jonas LEVY et Mickaël MAMOU sont les cofondateurs de cette jeune entreprise créée en 2024.

Techniques de l’ingénieur : Quelles sont les difficultés que rencontrent les entreprises industrielles avec le chiffrage ?

Mickaël MAMOU : Une problématique majeure des PME et ETI industrielles est la perte du savoir-faire acquis pendant des décennies, par des ingénieurs qui ont participé à la construction de ces entreprises. Or, beaucoup de ces ingénieurs partiront bientôt à la retraite d’ici les cinq prochaines années. Le chiffrage étant une compétence rare, ce savoir-faire est donc clairement menacé.

Malheureusement, comme on le sait, les usines ne sont pas les endroits les plus attractifs du monde et souffrent de problèmes de recrutement, il y a donc un fort enjeu de sécurisation de cette compétence de chiffrage dont la perte peut mettre une entreprise en péril.

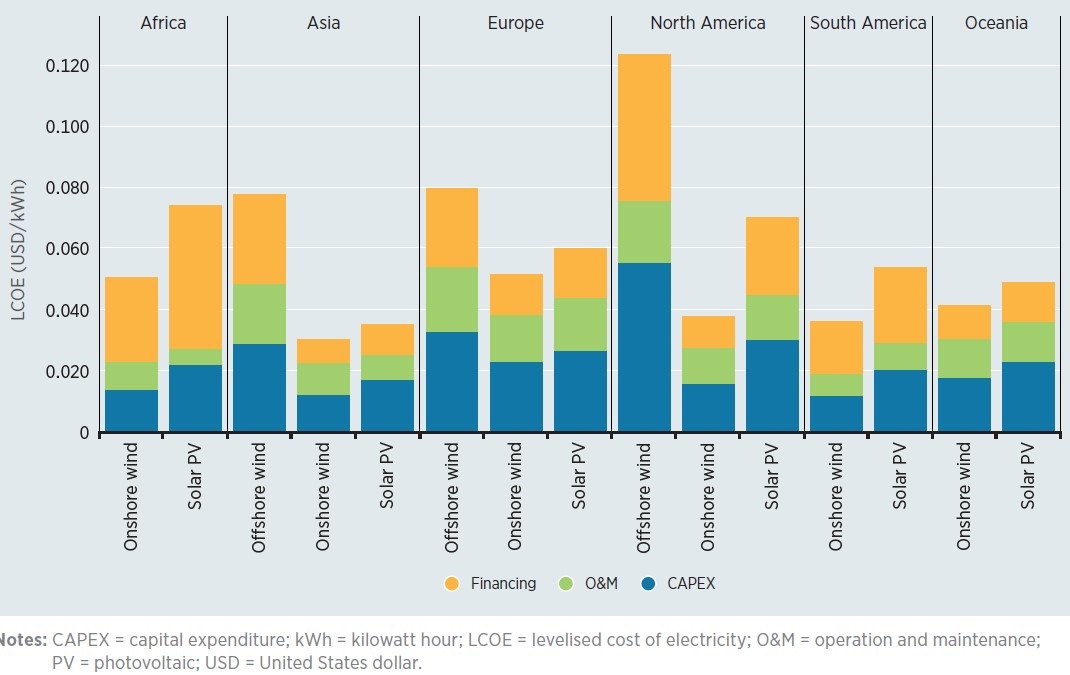

La seconde problématique est l’accès au marché. En effet, une entreprise qui n’arrive pas à produire un devis de qualité sous des délais courts perd des contrats par manque de réactivité. On sait par exemple que les entreprises de domaines comme la métallerie, la chaudronnerie ou la mécanique de précision ont accès à des marchés phénoménaux. Néanmoins, ces entreprises n’arrivent à répondre qu’à 20 % des demandes entrantes !

Enfin, il y a aussi une troisième problématique, qui est le besoin d’augmenter la productivité du chiffrage. En général, les personnes qui exercent ce métier sont très bien payées, car c’est quelque chose de très complexe. Néanmoins, on pense que 80 % du travail qu’ils accomplissent peut être digitalisé, accompagné par une IA, afin que l’ingénieur puisse se concentrer sur les tâches à haute valeur ajoutée.

Des entreprises développent des outils de chiffrage en interne ?

Certains dépensent en effet des centaines de milliers d’euros pour développer des outils de chiffrage en interne. Bien souvent, cela ne les mène nulle part, après trois ans de développement, car c’est plus complexe qu’il n’y paraît.

En effet, pour qu’un outil permette de résoudre un problème en profondeur, il faut qu’il soit capable de reproduire le raisonnement d’un ingénieur et de l’accompagner. Si on ne fait pas ça, on crée un outil qui apporte un peu de productivité au début, mais qu’il faut maintenir et faire évoluer, ce qui nécessite un savoir-faire technologique qui n’est généralement pas présent dans ces entreprises. En fait, la production d’outils aussi avancés n’est simplement pas leur métier.

Ne peuvent-elles pas y arriver avec des outils d’IA générative ?

Des entreprises tentent également de développer des outils de chiffrage en s’aidant de ChatGPT et arrivent parfois à des résultats. Cependant, d’une part, la protection des données fournies à ChatGPT pour entraîner l’outil devient un vrai problème. D’autre part, ces données sont mélangées à un corpus tellement large que la performance globale de l’IA décroît, donc ça n’est pas une solution sur le long terme.

Quelle solution proposez-vous ?

L’outil que nous proposons est un copilote IA qui accompagne l’ingénieur dans les différentes étapes du processus de chiffrage et lui fait gagner du temps.

Nous avons constaté que, dans l’industrie, l’exercice de chiffrage peut toujours être segmenté en quatre phases. La première est une phase de cadrage, suite à la réception du cahier des charges, toujours plus ou moins flou, plus ou moins complet. Il y a un aspect stratégique : est-on en mesure de répondre à cette demande ? Est-ce un client historique ou pas ? Est-ce un client stratégique ? Est-ce un compte que j’ai envie de pénétrer ? De quelle manière ai-je envie de répondre ?

La deuxième phase, c’est la conception de la solution technique. Elle fait appel à différentes briques technologiques, des sous-ensembles qui existent déjà dans les logiciels métiers.

La troisième phase consiste à structurer mentalement le devis, à mettre des hypothèses en face, concernant les coûts, le temps, etc.

Enfin, la quatrième phase est la construction du devis, la vérification par plusieurs personnes, puis la validation.

Or, sur chaque étape, il y a environ 80 % d’automatisation par IA qui est possible ! RELIEF est composé de plusieurs agents IA qui permettent ainsi d’automatiser une grande partie de ces étapes.

Comment fonctionnent ces agents IA, dans le processus de chiffrage ?

Un premier agent IA passe au travers d’un moteur de chiffrage que nous avons préalablement reconstruit en amont. Cela permet à l’outil d’accéder à des données parfaitement classifiées. L’IA est donc très précise dans sa réflexion stratégique, puisqu’elle va chercher des objets de données qui sont hyper structurés.

Une fois que l’ingénieur a répondu aux questions de ce premier agent conversationnel, un second agent prend le relais, en fonction du type de client et propose une architecture de solution. Puis un troisième agent vient proposer des solutions du type : « je propose d’intégrer telle ou telle donnée ; j’estime que telle opération demande 20 h ; le coût de tel matériau est… »

Le quatrième agent concerne la validation du devis. Il laisse le choix entre une validation automatique et une notification au responsable, pour validation, car le workflow de RELIEF est flexible, adapté au processus métier de chaque entreprise.

Dans quelle mesure RELIEF permet-il de répondre aux problématiques liées au chiffrage ?

Nous permettons aux entreprises de faire appliquer par des agents IA des règles métiers qui, soit existaient dans la tête des experts, soit étaient formalisées de façon éparse. Avec RELIEF, un devis qui prenait 20 h nécessite désormais entre 2 h et 4 h ! La productivité du chiffrage technique est donc décuplée.

Si on prend l’exemple de l’accès au marché, RELIEF aide les entreprises à répondre à plus de 40 % des demandes, jusqu’à 100 % dans certains cas, ce qui débloque des opportunités de croissance phénoménales.

Le but est aussi de soulager l’ingénieur. Il est tout de même dommage qu’un profil aussi qualifié passe autant de temps à manipuler des feuilles Excel, à valider des formules et à fouiller dans l’ERP de l’entreprise pour rechercher des projets similaires.

Vous venez de lever 2,6 M€, après seulement 9 mois d’existence. Comment voyez-vous la suite ?

En se basant sur des indicateurs prédictifs, d’après les tendances des trois derniers mois, on devrait pouvoir atteindre 100 clients et 2 millions d’euros d’ARR d’ici fin 2026. Beaucoup de choses peuvent changer d’ici là, mais c’est la trajectoire que nous prenons.

Pour atteindre ces objectifs, RELIEF devra recruter 20 collaborateurs techniques, opérationnels et commerciaux. La récente levée de fonds de 2,6 M€ en amorçage auprès de Daphni, Galion.exe, OSS Ventures, Kima Ventures et plusieurs business angels de renom permettra d’y arriver.

[1] RELIEF