Pouvez-vous revenir sur votre parcours professionnel ?

Diplômé de Centrale Lille au début des années 1980, j’ai commencé à travailler chez Aérospatiale[1] pendant une dizaine d’années. Spécialiste des lanceurs et des fusées, j’ai débuté sur des aspects techniques comme le pilotage et la cinématique d’Ariane avant de contribuer au projet ATV[2].

Ensuite j’ai travaillé sur des lanceurs réutilisables et rejoint l’équipe architecte du programme Ariane 5 en 1988, chargé de certaines études de dimensionnement du lanceur.

En 1992, après avoir rejoint le CNES, j’étais responsable des essais système, incluant des tests aérodynamiques, thermiques, combinés et de séparation, ainsi que les premiers essais en vol. Je supervisais la spécification technique de ces vols. Le premier vol en 1996 s’est soldé par un échec avec une explosion après 36 secondes, mais le deuxième vol en 1997 a été réussi, suivi d’une réussite complète lors du troisième vol en 1998.

Pendant huit ans, j’ai dirigé les avant-projets, couvrant tous les volets de petit à long terme, avant de revenir à un rôle plus technique en tant qu’expert senior, rattaché à la direction technique, puis au directeur des lanceurs. Mon rôle transversal était de garantir la cohérence technique des activités, telles que les trajectoires et la propulsion, tout en supervisant la communication entre les équipes. J’étais également responsable de diverses revues de projets et programmes. En 2022, j’ai rejoint le siège du CNES, sous la direction de la stratégie, pour apporter mon expertise à l’orientation des grands programmes.

Et enfin, en 2024, j’ai rejoint la start-up MaiaSpace[3].

En parallèle de mes activités professionnelles, je m’intéressais à différents sujets tels que le tourisme spatial, la protection de la Terre contre les astéroïdes, l’évacuation des déchets nucléaires dans l’espace, et la génération de puissance électrique depuis l’orbite, que je traite pour Techniques de l’Ingénieur. Je travaille également depuis 1987 à la pollution de l’espace par les débris, sujet sur lequel j’ai abondamment publié. Je préside plusieurs comités internationaux liés à la gestion des débris spatiaux et suis impliqué dans des instances de standardisation : ISO[4], IADC[5], ECSS[6].

Je donne des cours et des conférences dans des universités et ai récemment présenté sur les débris spatiaux à l’Académie des Sciences et à l’Assemblée Nationale. J’édite quatre journaux professionnels, dont Acta Astronautica, et gère environ une centaine d’articles par an, ce qui me permet de rester informé des dernières avancées. J’ai publié environ 250 articles, dont une centaine avec comité de lecture, et détiens six brevets et six enveloppes Soleau. Membre de l’Académie de l’air et de l’espace, j’ai également reçu plusieurs distinctions.

Enfin je m’investis dans l’éducation en intervenant auprès d’élèves de tous âges, soulignant l’importance de présenter les métiers de l’aérospatial, notamment aux jeunes filles.

Comment avez-vous été amené à travailler dans l’aérospatial ?

Passionné d’aviation depuis l’enfance, je voulais initialement devenir pilote de ligne. Au cours de mes études, je me suis aperçu que je recherchais autre chose que les vols à l’horizontal. Mon intérêt s’est donc tourné vers le spatial en quête d’exploration infinie. Après mes études, c’est avec enthousiasme que j’ai pris mon premier poste.

Quel était votre rôle à la Direction de la Stratégie du CNES ?

Mon rôle était, grâce à mes 40 ans d’expérience, de contribuer à la définition d’une stratégie en matière d’exploration spatiale, vers la lune ou les nouvelles stations spatiales. J’étais dans mes domaines de spécialités : les lanceurs, les débris et la pollution de l’espace, la pérennité des activités orbitales.

La situation de l’encombrement orbital est en effet préoccupante. Je travaille sur cette question et sur ce qui pourrait être recommandé. Dans l’espace, la présence toute proche d’un débris est indétectable, les risques d’autant plus grands. Trois prédominent :

Les traînées lumineuses dans l’espace grillent les capteurs des télescopes, de plus en plus fréquemment, jusqu’à un point critique. C’est une gêne importante pour les astronomes.

Les objets spatiaux en orbite basse (jusqu’à environ 2 000 km d’altitude) retombent sur Terre. En descendant dans les hautes couches de l’atmosphère, ils brûlent. L’équivalent d’un satellite entier ou d’étages entiers de fusées tombe tous les jours. La dangerosité de l’événement et la pollution de cette zone constituent dès lors des points essentiels.

Les collisions en orbite entraînent la destruction de satellites actifs. Devenant de nouveaux débris, ils se fragmentent en nouveaux débris plus petits, avec d’autres risques de collision. Ce phénomène exponentiel est appelé le syndrome de Kessler. Dans une zone relativement délimitée de l’espace, même si toute activité spatiale était suspendue, le nombre d’objets continuerait à s’accroître.

Une réglementation très stricte est donc nécessaire, mais ne suffirait pas. Il faut en effet aller nettoyer cette zone.

À travers un ouvrage publié en 2016, vous alertiez sur la pollution spatiale. Comment la situation a évolué ?

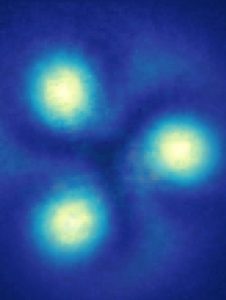

La situation a évolué de façon terrible. À présent, il existe deux grandes zones distinctes dans l’espace : la zone de pollution orbitale, qui se situe entre 700 km et 1100 km d’altitude, touchée par le syndrome de Kessler. Celle-ci contient un nombre croissant de débris, davantage que de satellites actifs. Cette zone est progressivement désaffectée, car trop dangereuse du fait du risque important de collision. Elle s’étendra par le bas et par le haut, en raison des nouveaux débris qui se disperseront.

La zone de congestion est située entre 250 et 650 km d’altitude. Ce sont ces orbites que visent désormais les opérateurs de satellites, notamment ceux des méga constellations comme Starlink. Starlink compte déjà 6 000 satellites actifs, et ce nombre pourrait atteindre 30 000 d’ici 2030, avec une prévision de 100 000 satellites en 2040.

La gestion du trafic spatial est donc au cœur du problème. Le nombre de satellites actifs est passé de 1 000 à 10 000 en seulement 10 ans. Cette croissance rapide pose des défis majeurs. Avec l’augmentation du nombre de constellations, comme celles d’Elon Musk, Jeff Bezos, IRIS² (européenne), ainsi que celles de la Chine et de l’Inde, éviter les collisions devient de plus en plus complexe.

Les deux zones évoquées, de pollution et de congestion, nécessitent chacune des solutions spécifiques. Une réglementation ferme et à jour est essentielle pour les deux zones. Depuis 1998, je participe à l’élaboration de cette réglementation, année de sortie du premier standard du CNES[7]. La loi spatiale française remonte à 2008, la France étant le seul pays à avoir une loi portant sur les débris spatiaux. Les autres pays ont des recommandations. Ce travail est devenu international, en 2002 avec l’Inter-Agency Space Debris Coordination Committee (IADC), l’ONU, ISO, puis l’ECSS. Il manque une réglementation internationale commune et contraignante. De plus, connaître précisément ce qui se trouve en orbite est une priorité.

Un réseau de radars, télescopes et lasers est nécessaire pour affiner la précision des éphémérides spatiales. Actuellement, la position des objets est connue avec une marge d’erreur de 100 mètres, ce qui entraîne de fausses alertes lorsqu’ils passent à moins de 200 mètres l’un de l’autre. Des programmes institutionnels, utilisant des radars très coûteux, visent à améliorer ces techniques d’observation. Des start-ups, comme Aldoria, créent des télescopes ; Look Up Space conçoit des radars. Des solutions prometteuses arriveront dans un avenir proche. De même, les données recueillies par des télescopes de particuliers intéressent et sont achetées.

Dans la zone polluée au-dessus de 700 km, éviter les collisions est crucial. Si les manœuvres d’évitement sont possibles entre objets actifs, elles sont en revanche impossibles avec les débris, d’où la nécessité de les éliminer. Le retrait actif des débris (Active Debris Removal, ou ADR) est une mission complexe, techniquement et financièrement exigeante. MaiaSpace en possède la compétence mais ne s’y est pas encore employée. La priorité est de se concentrer sur les gros débris spatiaux, qui, en cas de collision, peuvent générer une multitude de fragments. Par exemple, les satellites russes Zenit 2, aussi volumineux qu’un autobus, passent régulièrement à moins de 100 mètres les uns des autres. Une collision entre ces masses pourrait multiplier le nombre de débris, et l’effort de récupération se concentre donc sur des objets volumineux plutôt que sur de petits fragments. Cependant, ce processus est compliqué non seulement sur le plan technique et financier, mais aussi politiquement, car l’approche de certains débris est interdite. Si rien n’est fait, la pollution des orbites basses pourrait s’aggraver.

Dans la zone d’encombrement orbital plus basse, l’accumulation d’objets entraîne une hausse exponentielle des manœuvres d’évitement. Par exemple, Starlink, avec ses 6 000 satellites, en effectue déjà 100 000 par an, et ce chiffre pourrait exploser avec l’ajout de milliers de nouveaux satellites. La gestion du trafic spatial devient donc un enjeu critique, exigeant l’élaboration de règles partagées, particulièrement lorsque des constellations de différentes nationalités sont impliquées. La question des débris et de l’encombrement orbital reste prioritaire, et je continue de publier des avis académiques sur le sujet dans la revue de l’académie de l’air et de l’espace pour sensibiliser la communauté scientifique et les décideurs.

Un autre point concerne la durée de séjour en orbite. À 300 km, un satellite reste en orbite 2 à 3 ans avant de retomber dans l’atmosphère. À 800 km, il peut rester en orbite pendant deux siècles, et à 1000 km, pendant 1000 ans. À 650 km, un satellite reste environ 25 ans, marquant une sorte de frontière. C’est d’ailleurs cette durée qui est exigée par les recommandations internationales qui sont publiées depuis 2002.

On s’emploie actuellement à abaisser cette durée à cinq ans, voire un an, mais les opérateurs et les constructeurs s’y opposent, car une limite de temps les impacte fortement, sur le volume de carburant notamment. Cette négociation est difficile.

Pouvez-vous nous parler de la création de MaiaSpace et du lien avec le CNES ?

Initiative du CNES et d’ArianeGroup, cette start-up est attendue pour redonner une compétitivité au niveau international, grâce à une équipe hautement qualifiée. Les réalisations sont impressionnantes, du point de vue des délais et des coûts. J’y occupe le poste d’ingénieur système senior. On peut dire que le nouveau lanceur en développement est dans la continuité du programme de lanceurs d’Ariane 5 et Ariane 6.

Que pouvez-vous nous dire de plus sur ce projet de lanceur européen ?

MaiaSpace est un projet de mini lanceur. Il permet de mettre à peu près 2,5 tonnes en orbite. Sa particularité est que le premier étage est réutilisable. Les deux options sont possibles : la version avec étage consommable est plus performante et pour la version réutilisable, l’intérêt est que le premier étage peut servir à nouveau. Il s’agit d’une innovation, pour une solution flexible, avec un troisième étage optionnel. Cela nous permet d’apporter une réponse à nos futurs clients, pour toute mission potentielle. Le fait de pouvoir récupérer son premier étage a été vu chez SpaceX aussi avec Falcon 9.

La notion de qualité environnementale est essentielle dans nos réflexions, à chaque étape de travail, pour le choix des carburants. Certains collaborateurs travaillent exclusivement sur l’analyse de cycle de vie. C’est une signature majeure de MaiaSpace.

En dehors de MaiaSpace, quels sont vos projets ?

Je suis principalement occupé par les débris orbitaux, c’est prioritaire. Je participe à des réunions de travail sur la zone d’encombrement, ainsi qu’à des congrès dédiés, comme l’IAC[8]. Ces événements sont révélateurs de la prise de conscience sur les débris. Tout cela est très prenant et passionnant.

Quel regard portez-vous sur l’industrie aérospatiale, plus particulièrement en France ?

Dans ce domaine, la France se situe à un très haut niveau, Airbus est français d’origine, Concorde était franco-anglais, les hélicoptères français sont très performants, Ariane était français puis est devenu européen. En France, nous disposons d’un vivier précieux que nous devons préserver. Aujourd’hui, le radar français GRAVES[9] est un modèle réussi et inspirant. La France, grâce au CNES, a réussi à fédérer toute l’Europe autour d’Ariane.

Les échecs du lanceur Europa étaient dus à l’absence de maître d’œuvre, ce qui a conduit le CNES à prendre en charge le développement d’Ariane, financé à 20 % par l’Allemagne, un projet qui a connu un grand succès européen. Le projet Ariane Next, ambitieux et axé sur la réutilisation, a été refusé, laissant place à de nouveaux projets de lanceurs dans d’autres pays européens. Parmi eux, MaiaSpace, financé par ArianeGroup, se distingue comme un complément prometteur d’Ariane, avec une vocation et un sourcing européens.

Quelles compétences ou qualités sont indispensables dans vos domaines d’expertise ?

Il est important d’être enthousiaste, de s’amuser au travail et d’avoir envie. C’est formidable de travailler sur des engins, de la technique et technologie de pointe. Les profils recherchés sont des ingénieurs généralistes, issus de Polytechnique, de Centrale, de l‘IPSA, d’EPF, des INSA, de SupAero. Il est possible d’intégrer MaiaSpace avec un master plus. Un profil d’ingénieur spécialisé dans les textiles a été embauché au CNES pour le tissage de fibres de carbone destinées aux protections thermiques de nos véhicules. Des ingénieurs chimistes travaillent sur les carburants.

Au-delà du diplôme, un bon bagage technique et scientifique est essentiel. Plus que l’élite, l’enthousiasme et les expériences réussies, comme des stages dans le spatial ou la gestion de clubs de petites fusées, sont particulièrement valorisés.

Avez-vous recours à une veille technologique ? Dans ce cadre, à quels domaines vous intéressez-vous et quelles sont vos sources principales d’information ?

Les quatre journaux professionnels dont je suis éditeur couvrent un large éventail de contenus. J’ai accès à Springer, Elsevier et son outil de recherche Scopus. J’ai des notifications sur les innombrables sujets que je suis. À cela, s’ajoutent les abstracts que je relis, de façon à en retenir un certain pourcentage[10]. Ces relectures m’apportent beaucoup, contribuent à me former et à m’informer. Je fais un effort pour comprendre ce que je lis, et j’y puise de nouvelles idées. De plus, je suis conseiller pour l’Union européenne, mais aussi évaluateur pour plusieurs programmes scientifiques de la Commission européenne.

Que vous apporte la collaboration avec Techniques de l’Ingénieur, en tant que conseiller scientifique ?

Techniques de l’Ingénieur figure parmi mes sources, pour la qualité et l’utilité des articles. J’aime beaucoup l’idée de contribuer à élaborer une base d’articles de référence sur le spatial en qualité de conseiller scientifique.

Nous allons nous employer à étoffer les articles dans mes domaines. Notamment, un article est en cours sur la propulsion nucléaire, et plus largement sur l’utilisation du nucléaire dans l’espace.

Avant cette collaboration, j’avais accès aux articles Techniques de l’Ingénieur via le bureau chargé de la veille du centre de ressources documentaires du CNES, qui envoyait des notifications pour toute nouvelle publication.

-

-

-

- ArianeGroup

- Projet ATV

- MaiaSpace

- International Organization for Standardization

- IADC

- European Cooperation for Space Standardization

- Référentiel du CNES, édition septembre 2024.

Mise à jour de la Réglementation Technique associée à la Loi Spatiale Française (LOS)

- International Astronautical Congress : IAC2024, IAC2025 …

- Grand Réseau Adapté à la Veille Spatiale, situé à Dijon

- Par exemple, entre 70 et 80 % des soumissions d’Acta Astronautica sont rejetées.