Transport et Environnement est une ONG européenne basée à Bruxelles, qui existe depuis plus de trente ans, et qui fédère également des associations à travers toute l’Europe. L’organisation possède des antennes à travers toute l’Europe, dont une à Paris.

Agissant en faveur du développement d’une mobilité zéro émission, Transport et Environnement participe à faire évoluer le cadre législatif européen dans ce sens, notamment à travers la publication de rapports d’experts démontrant les impacts de certains usages actuels sur l’environnement et la santé.

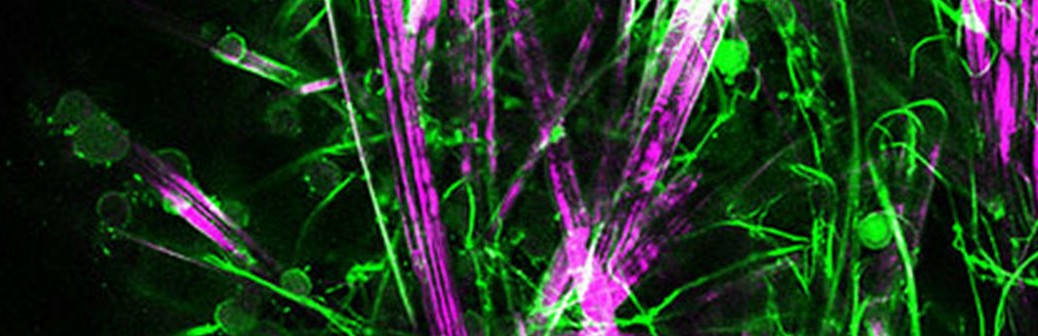

Concernant le transport maritime par exemple, Transport et Environnement a publié, en 2022, une enquête démontrant que CMA CGM, le géant français du transport maritime, avait surestimé le gain environnemental découlant de l’utilisation du GNL pour propulser certains de ses navires. En effet, l’utilisation du GNL comme carburant pour le transport maritime provoque des fuites de méthane dans l’atmosphère lors du fonctionnement des moteurs mais aussi sur toute la chaine de production. Ce méthane, directement relâché dans l’atmosphère, se révèle être un puissant gaz à effet de serre. L’ONG a également publié un rapport en 2023, intitulé « gaz fossile : la pilule empoisonnée du transport maritime », pour dénoncer l’usage du gaz dans le transport maritime, considéré comme non durable.

Fanny Pointet, responsable du transport maritime au sein du bureau français de Transport et Environnement, a expliqué à Techniques de l’Ingénieur en quoi l’utilisation du gaz pour le transport maritime, à fortiori du GNL, même biologique ou de synthèse, était une solution non durable.

Techniques de l’Ingénieur : Quelles sont les missions de Transport et Environnement ?

Fanny Pointet : Notre objectif est l’avènement de modes de transports décarbonés à l’horizon 2050, à la fois neutres pour le climat et la santé, et accessibles à tous.

Nous travaillons évidemment sur la problématique du transport routier, qui concentre une grande partie des émissions de CO2 liées au transport, mais aussi sur les aspects aérien et maritime.

Notre objectif est de parvenir à opérer ces changements à travers la législation. Nous croyons que cela est réalisable grâce à un cadre politique et juridique ambitieux. Du coup, nous travaillons à la fois sur tout ce qui concerne la législation européenne, puisque c’est à ce niveau que les réglementations sur le transport sont actées, mais aussi au niveau français, surtout sur le volet fiscalité.

En ce qui concerne le transport maritime, quel est la position de Transport et Environnement vis-à-vis de l’usage du GNL comme carburant ?

Le transport maritime, par rapport aux autres modes de transport, a pendant longtemps été assez peu régulé en ce qui concerne ses émissions de gaz à effet de serre. Cela se faisait au niveau international.

Depuis 2023, cette régulation s’est renforcée au niveau européen, avec le Pacte Vert de la Commission Européenne, qui a inclus le transport maritime dans son paquet législatif sur le climat. Cela veut dire que le marché du carbone s’applique désormais au secteur maritime, ainsi que les normes sur les carburants durables par exemple.

Le transport maritime a longtemps utilisé des carburants fossiles extrêmement polluants, ayant un impact non seulement sur le climat mais aussi sur la qualité de l’air. En 2020, une norme internationale sur le taux de soufre a été mise en place pour diminuer ce dernier dans les carburants utilisés par les navires.

Cela a eu pour conséquence d’obliger la flotte mondiale à utiliser des carburants davantage raffinés, ce qui fait baisser leur taux de soufre. Une autre solution pour les armateurs consiste à installer à bord des navires des systèmes de filtres (scrubbers). Une troisième possibilité est d’opter pour des carburants moins soufrés, comme le GNL.

Cette norme sur la qualité de l’air a donc participé, entre autres, à démocratiser l’usage du GNL dans le transport maritime, ou en tout cas à en faire une solution alternative pour propulser les navires.

Quelles sont les conséquences de l’usage du GNL pour le transport maritime ?

L’usage du GNL dans les navires limite les émissions de CO2 en comparaison des carburants conventionnels, comme le fioul ou le gasoil et, comme je l’ai dit, il est moins soufré. Ce double avantage sur les autres carburants conventionnels, à la fois en termes de santé publique et au niveau climatique, fait du GNL un candidat à priori idéal pour améliorer les impacts écologiques et sur la santé du transport maritime.

Cependant, en y regardant de plus près, les bienfaits liés à l’usage du GNL ne sont pas si évidents. En effet, le GNL est majoritairement constitué de méthane, qui a un pouvoir réchauffant beaucoup plus important que celui du CO2. Ainsi, bien qu’il émette moins de CO2 à la combustion, son impact sur le climat quand il est émis tel quel dans l’atmosphère provoque un impact très important. Hors, il y a des fuites de méthane tout au long de la chaîne de production du GNL, lors de son extraction, de sa distribution, et aussi de sa combustion dans les moteurs. Ces fuites, même minimes, aboutissent à un impact climatique équivalent, voire pire que celui des carburants classiques.

Quelle est la position des acteurs industriels du secteur maritime par rapport à l’utilisation du GNL ?

Le bilan du GNL en tant que GES et sur la qualité de l’air, les industriels le connaissent. C’est pour cette raison qu’ils évoquent souvent le GNL comme étant une solution de transition. Cela pose selon nous deux problèmes majeurs : d’abord, le GNL reste aujourd’hui compatible avec les trajectoires de décarbonation mondiales et européennes, qui ne sont pas assez ambitieuses. Dès lors, l’usage du GNL n’est plus une solution de transition, à partir du moment où son usage permet d’atteindre les objectifs de décarbonation à moyen terme.

Aujourd’hui, il est plus profitable, pour les armateurs, d’investir sur le GNL plutôt que sur d’autres sources d’énergies plus vertueuses, tout en restant dans les clous des réglementations européennes. C’est en ce sens que les réglementations actuelles ne nous paraissent pas assez ambitieuses.

Le second point sur lequel nous alertons est le risque d’actifs échoués. En effet, si le GNL constitue une solution transitoire, le risque est grand de voir des acteurs du maritime investir largement dans les technologies GNL, pour in fine se retrouver dans l’impossibilité de s’en passer par la suite quitte à payer de lourdes pénalités, où tout simplement ne plus pouvoir utiliser certains navires.

L’avènement du bio-GNL et du e-GNL pourrait-il changer la donne ?

Il y a beaucoup de tensions prévisibles à l’avenir sur la biomasse, pour décarboner de nombreux secteurs économiques. Nous pensons que les futurs bio-GNL et e-GNL (GNL de synthèse) ne doivent pas servir au transport maritime, car d’autres carburants sont plus adaptés pour cela. Le bio-gaz ou le gaz de synthèse sont plus adaptés pour d’autres usages, comme le chauffage ou l’industrie par exemple.

Ainsi, quand nous voyons des bateaux de croisière communiquer sur le fait qu’ils ont fait une croisière entièrement propulsée au bio-GNL, cela s’apparente pour nous à du greenwashing, dans le sens où rien ne dit que ces secteurs d’activités pourront utiliser massivement le GNL issu de la biomasse ou de synthèse à l’avenir. Enfin, même si cela était le cas, cela ne résout en rien les problèmes de fuites de méthane : même si les industriels travaillent sur des moteurs innovants pour limiter les fuites, il apparaît très compliqué de les éliminer totalement. Notamment en ce qui concerne les bateaux de croisière.

Quelles sont les propositions de Transport et Environnement pour remplacer ou limiter l’usage du GNL pour le transport maritime ?

Il faut d’abord une législation sur les carburants qui soit la plus ambitieuse possible et qui permette de prioriser les usages, c’est la première chose. Ensuite, il existe également des solutions en ce qui concerne directement la propulsion des navires de petite taille, grâce à la propulsion électrique ou à hydrogène. Les plus gros navires pourront quant à eux utiliser des carburants de synthèse neutres en carbone tels que l’e-méthanol, l’e-ammoniac, l’e-diesel ou encore l’hydrogène liquéfié.

L’électrification des quais des ports représente aussi une solution d’avenir, qui permettra aux navires à quai d’éviter de faire tourner les moteurs pour fournir les services, notamment en ce qui concerne les bateaux de croisière. Cela fait d’ailleurs l’objet d’obligations au niveau européen, qui s’imposeront à partir de 2030.

La réduction de la vitesse de navigation est également une solution : réduire la vitesse de 10% permet de réduire la consommation de carburants de 30%.

La propulsion à la voile est aussi une solution qui permet de consommer moins de carburants.

C’est donc un ensemble de solutions qui doivent être déployées, pour aboutir à une amélioration globale de l’empreinte carbone et sur la santé du transport maritime.

Ce qui est certain selon nous, c’est que tous les carburants produits à partir de biodéchets nous paraissent être une fausse solution, étant donné les tensions à venir sur ce type de ressource.

Propos recueillis par Pierre Thouverez