Cet appel à projets vise à promouvoir l’émergence de nouveaux acteurs tricolores capables de concevoir des réacteurs nucléaires de quatrième génération, permettant, entre autres, d’améliorer la gestion du cycle de vie des substances radioactives.

La spécificité d’HEXANA, qui veut industrialiser des réacteurs modulaires avancés (AMR) à cogénération, s’illustre par le parcours des trois ingénieurs à la base du projet.

Sylvain Nizou, CEO d’HEXANA, est un ingénieur qui a longtemps évolué dans le domaine de l’énergie. Il est spécialiste des questions énergétiques et en particulier des questions de captage et de valorisation du CO2, mais aussi de la décarbonation de l’industrie en général. Partant du constat que l’innovation allait permettre, à terme, de développer des technologies de valorisation du CO2 efficaces, de production d’hydrogène ou de nouveaux carburants pour le secteur aérien par exemple, la problématique pour ces dernières consiste à bénéficier d’un accès à des quantités considérables d’énergie décarbonée, sous la bonne forme et en continu.

Paul Gauthé, CTO d’HEXANA, est aussi ingénieur, expert de la filière nucléaire à neutrons rapides, et a travaillé sur l’exploitation de Phénix et sur le projet ASTRID (prototype de réacteur de quatrième génération rapide refroidi au sodium). Enfin, Jean-Baptiste Droin, CIO d’HEXANA, est également un ingénieur expert en sûreté, conception et fonctionnement des réacteurs nucléaires avancés et de leurs couplages à de nouveaux usages au service des besoins industriels.

C’est de la rencontre entre la compréhension des besoins énergétiques nécessaires à la décarbonation de l’industrie et les technologies du nucléaire de quatrième génération en capacité de répondre à ces besoins qu’a émergé HEXANA.

Sylvain Nizou nous explique en quoi consiste le projet de réacteur nucléaire avancé porté par HEXANA, et comment ce dernier peut répondre spécifiquement aux enjeux de décarbonation de l’industrie tout en offrant un modèle de développement durable de l’énergie nucléaire.

Techniques de l’Ingénieur : Quels sont les concepts à la base de la solution technologique développée par HEXANA ?

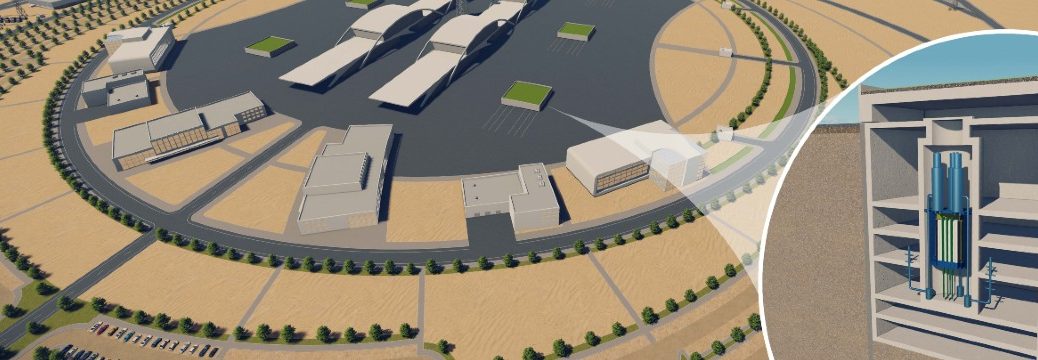

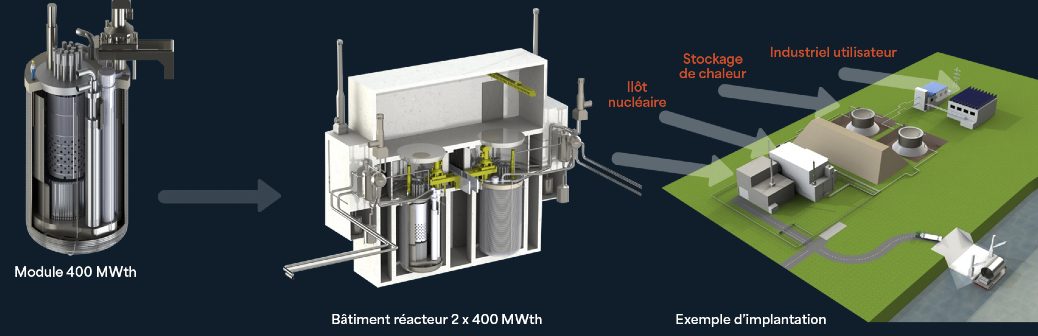

Sylvain Nizou : HEXANA travaille sur la conception d’un système de réacteur à neutrons rapides à caloporteur sodium, dit RNR-Na, associé à un dispositif de stockage d’énergie, qui permet de fournir à la demande de la chaleur jusqu’à 500 degrés et de l’électricité pour l’industrie.

La technologie des RNR-Na (réacteurs à neutrons rapides refroidis au sodium) est connue depuis plus de soixante-dix ans dans les grands pays leaders de l’énergie nucléaire. La France a exploité pendant 35 ans le réacteur expérimental Phénix, puis développé, construit et exploité le plus gros RNR-Na au monde – (Superphénix), démontrant ainsi qu’il était possible de développer la technologie RNR à l’échelle industrielle et en grande puissance.

Ensuite, le projet ASTRID visant à développer un démonstrateur de réacteur de quatrième génération a permis de relancer cette filière RNR-Na, de renouveler les compétences, les moyens de calculs, et de se remettre à niveau en vue d’un déploiement industriel.

Si le projet ASTRID ne s’est pas poursuivi en 2019, tout ne s’est pas arrêté là : des analyses, des stratégies internationales, et des designs de nouveaux réacteurs ont été développés à partir des connaissances accumulées sur le projet ASTRID, et poursuivis depuis 2019.

Nous avons donc travaillé, pendant trois années au sein du CEA, sur un nouveau concept, pour aboutir à la création d’HEXANA. Il y a donc une forme de continuité sans la volonté de refaire ASTRID, puisque HEXANA bénéficie de tout le travail réalisé en amont par la filière nucléaire sur les RNR-Na depuis des décennies.

Notre volonté est de développer un objet innovant, un SMR avancé (AMR), avec toutes les promesses que cela véhicule en termes de temps de construction, de maîtrise des coûts, de compétitivité, d’utilisation beaucoup plus large par rapport aux réacteurs traditionnels destinés à produire de l’électricité pour un réseau national. Et en particulier cette capacité à produire directement et en même temps de la chaleur à haute température et de l’électricité de manière flexible, selon les besoins : le monde industriel a besoin d’électricité mais aussi de chaleur. Et à l’heure actuelle cette chaleur est massivement générée à base de combustibles fossiles. Il est donc très pertinent d’extraire cette chaleur des RNR-Na, avec une valorisation qui est comprise entre 95 et 98%.

Comment la chaleur produite est-elle stockée ?

La chaleur est stockée au sein de sels fondus, c’est une technologie très spécifique empruntée au monde de l’énergie solaire à concentration, que nous sommes les seuls à développer en France et à intégrer à un AMR. Ce stockage de chaleur qui offre une flexibilité sur la puissance délivrée va alimenter soit une turbine pour produire de l’électricité, soit directement l’industriel qui a besoin de cette chaleur.

Quel combustible est utilisé ?

Le réacteur utilise du combustible nucléaire MOX pour son fonctionnement. Il s’agit d’un mélange entre du plutonium et de l’uranium appauvri. Il est fabriqué à partir de matières issues du retraitement des combustibles usés d’EDF et de coproduits de la filière d’enrichissement. Cette démarche permet d’engager la fermeture du cycle du combustible nucléaire et de réduire la dépendance de la filière nucléaire aux ressources minérales importées.

Quels sont les défis en termes d’innovation ?

Nous faisons le choix de valoriser les acquis du passé et d’innover là où cela est nécessaire. Il y a un immense défi sur le passage à l’industrialisation d’un réacteur RNR-Na modulaire standardisé : il y a des composants nouveaux, un design également totalement nouveau et une organisation industrielle dont la filière nucléaire n’a pas encore l’expérience.

Mais nous faisons le pari de ne pas innover sur les aspects du projet qui fonctionnent et qui ont déjà été validés par les autorités de sûreté : un réacteur de conception intégrée comme Phénix et Superphénix, un combustible MOX qualifié, des aciers aussi qualifiés pour tous les composants. Nous reprenons ainsi certaines briques technologiques mâtures, que l’on intègre dans notre réacteur, qui produit une puissance de 400 MW thermiques. Il est possible de convertir cette puissance thermique en électricité, avec un rendement de 42%, soit environ 300 MW électriques pour une paire de réacteurs fournissant un total de 800 MW thermiques.

Nous avons décidé d’associer ces réacteurs par deux (ou par quatre selon les besoins du client) pour être en mesure d’assurer une continuité de service. Quand l’un des réacteurs doit être rechargé en combustible ou mis en maintenance, l’autre assure au moins la moitié du besoin énergétique. Cela permet au client de bénéficier d’un approvisionnement continu en énergie, et nous offre la possibilité de mutualiser certains systèmes pour faire des économies sur les coûts de construction. Nous n’innovons que là où cela est nécessaire pour aller vite. D’abord parce que cela nous permet de concentrer nos efforts d’ingénierie sur le défi de l’industrialisation d’un objet modulaire que l’on peut produire en série, mais aussi car nous ne disposons pas d’outils de R&D pour faire des irradiations de nouveaux matériaux, de nouveaux systèmes. Nous ne pouvons donc pas nous engager sur la qualification de nouveaux objets, ce qui nécessite beaucoup de temps. Pour autant, une fois les premiers réacteurs démarrés, nous serons les premiers à disposer de capacité de R&D pour améliorer notre technologie et accroitre notre compétitivité avec notre tête de série.

Vous vous appuyez également sur des acteurs historiques de la filière nucléaire.

En effet. Nous nous inscrivons dans un écosystème existant, avec une supply chain qui, même si elle a besoin d’être renforcée et renouvelée, existe déjà : nous travaillons avec EDF, avec le CEA, avec Framatome, ORANO, BOUYGUES CONSTRUCTION et EGIS, entre autres, pour valoriser ce savoir-faire prisé et la propriété intellectuelle historique.

En capitalisant sur les acquis du passé, quand bien même nous avons d’énormes défis sur des nouveaux composants comme des échangeurs, des pompes, des designs, des procédés de fabrication et d’industrialisation, nous sommes en mesure d’avancer vite. Notre première tête de série industrielle est prévue pour 2035, et nous n’avons pas besoin de passer par un prototype et un démonstrateur nucléaire. Nous passons directement à une tête de série industrielle, ce qui va nous faire gagner du temps par rapport à d’autres acteurs de la filière qui doivent faire approuver tous les nouveaux éléments nucléaires de leur système et passer avant tout par des prototypes nucléaires voire non-nucléaires.

De nombreux acteurs internationaux du nucléaire s’intéressent aujourd’hui aux RNR-Na…

En effet. Aujourd’hui, tous les grands pays qui font du nucléaire sont dans la course au RNR-Na. Les Etats-Unis ont lancé il y a dix ans TerraPower, qui développe le projet Natrium, dont le système de stockage de la chaleur sous forme de sels fondus est assez similaire. Il ne s’agit pas là d’un SMR, mais d’un réacteur de 350 à 500 MW électriques pas particulièrement destiné à fonctionner en cogénération, nous ne sommes donc pas en concurrence avec eux.

La Chine dispose d’un réacteur expérimental et construit actuellement 2 réacteurs de 600 MW thermiques. L’Inde est également en train de développer des RNR-Na tout comme le Japon.

Enfin, la Russie reste leader sur ce créneau : elle exploite aujourd’hui un réacteur expérimental, et deux réacteurs industriels de 600 et 800 MW électriques, appuyés par une filière MOX et continue de développer d’autres RNR de puissance.

Nous ne sommes donc pas les seuls sur ce créneau, mais nous disposons aujourd’hui en France de compétences et de connaissances sur ces RNR-Na que le monde entier nous envie.

Comment travaillez-vous avec les industriels qui pourraient être amenés à utiliser la solution que vous développez ?

Notre système particulier du stockage de chaleur, et de conversion d’énergie en aval, est conçu pour être spécifiquement adapté et flexible par rapport aux différents usages identifiés. C’est un travail que nous menons en très grande proximité avec le monde industriel. Nous engageons des études de cas d’usages avec les acteurs des secteurs de la chimie, de l’aérien, du maritime, de l’acier, du ciment, de l’hydrogène et des carburants de synthèse. Nous travaillons avec eux pour identifier comment HEXANA peut répondre à leurs besoins. Quel est leur rythme de consommation, la part de chaleur et d’électricité dont ils ont besoin ? A quelle température utilisent-ils la chaleur ? Est-ce que leur consommation électrique est continue ? Y a-t-il des variations fortes de consommation ? Un tel système peut-il offrir d’autres solutions comme la capture de CO2 ou le dessalement d’eau de mer ?

Nous nous adressons aussi, en termes de clients, au réseau électrique de manière globale : dans les projets que nous imaginons, le fait de pouvoir revendre de l’électricité au réseau au moment où il en a le plus besoin représente une vraie valeur, a fortiori dans un contexte où les énergies renouvelables intermittentes vont prendre une place de plus en plus importante dans les mix énergétiques appelant des capacités de flexibilité comme celles offertes par le système HEXANA.

A ce niveau, notre système de stockage d’énergie est un service rendu au réseau, très complémentaire, en faveur de l’intégration forte des énergies renouvelables et à la réduction de l’utilisation des combustibles fossiles.

Propos recueillis par Pierre Thouverez

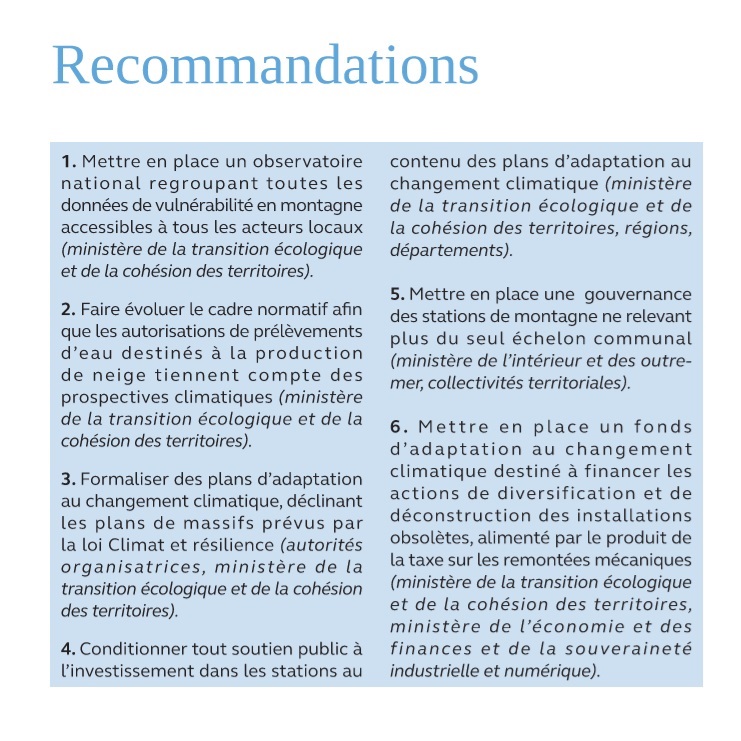

« Si l’enquête dresse le constat d’un déclin du modèle économique du ski français, elle souligne également que les politiques publiques d’adaptation ne sont pas à la hauteur des enjeux », partage la Cour des comptes. Pour inverser la donne, le rapport préconise notamment l’élaboration de « plans d’adaptation » pour chaque station de montagne et le conditionnement des financements publics à l’existence et au respect de ces plans.

« Si l’enquête dresse le constat d’un déclin du modèle économique du ski français, elle souligne également que les politiques publiques d’adaptation ne sont pas à la hauteur des enjeux », partage la Cour des comptes. Pour inverser la donne, le rapport préconise notamment l’élaboration de « plans d’adaptation » pour chaque station de montagne et le conditionnement des financements publics à l’existence et au respect de ces plans.