L’obtention du Nobel d’économie 2025 clôt symboliquement la série des grands prix de l’année, et souligne l’attente mise sur l’économie de l’innovation dans un contexte mondial de bouleversements technologiques. Ce prix valorise la théorie développée notamment par Philippe Aghion et le Canadien Peter Howitt selon laquelle la croissance durable dépend d’un processus de remplacement constant des technologies dépassées par de nouvelles, et de la recherche d’équilibre entre création et destruction économique.

Dans cette perspective, Philippe Aghion affirme que ce n’est plus simplement le contrôle de matières premières, le poids militaire ou financier qui définit la puissance, mais la capacité à produire des ruptures technologiques, à diriger les chaînes de valeur de pointe et à rendre les innovations durables. Selon lui, les États-Unis dominent aujourd’hui parce qu’ils concentrent les meilleures capacités d’innovation dans des secteurs de rupture tels que l’intelligence artificielle, le numérique ou la biotechnologie. Ce leadership attire les capitaux étrangers et garantit la suprématie des grandes devises comme le dollar.

Cette position s’articule avec l’analyse du palmarès 2025 : le Nobel est partagé entre trois chercheurs. Le Néerlandais Joel Mokyr reçoit la moitié du prix pour avoir exploré les conditions historiques et institutionnelles qui permettent aux innovations de s’ancrer dans la société, et pour mettre en lumière comment les découvertes techniques, économiques et sociales se renforcent mutuellement. La seconde moitié est attribuée conjointement à Philippe Aghion et Peter Howitt, pour leur modèle mathématique de croissance par destruction créatrice, montrant que l’investissement et la concurrence technologique propulsent l’évolution économique à long terme.

Dans l’interview, Philippe Aghion souligne que des « nuages sombres » s’amoncellent à l’horizon. La montée du protectionnisme, les barrières au libre-échange, des réglementations excessives ou la dispersion des initiatives nationales menacent la dynamique d’innovation. Il appelle l’Europe à ne plus se laisser dominer par les États-Unis ou la Chine sur la scène technologique, en redéfinissant sa stratégie industrielle et son écosystème financier. Il estime par ailleurs que le fonctionnement actuel du modèle européen est trop prudent et qu’il privilégie l’innovation incrémentale plutôt que les ruptures technologiques. Philippe Aghion pointe enfin le rôle de la réglementation concurrentielle trop stricte qui a longtemps empêché une politique industrielle ambitieuse en Europe.

Einstein perdus

Pour redresser la trajectoire, Philippe Aghion propose certaines pistes, à commencer par la création d’une institution à l’échelle européenne inspirée de l’ARPA américaine (Advanced Research Projects Agency), dédiée à des projets stratégiques à haut risque dans les domaines de l’énergie, du climat, de la santé ou de l’intelligence artificielle, le tout avec une coalition volontaire d’États membres (France, Allemagne, Royaume-Uni, etc.) Il plaide ensuite pour un système éducatif rénové, capable d’identifier et d’accompagner les talents – les « Einstein perdus » – avec des enseignants mieux formés, des soutiens personnalisés et une orientation vers l’innovation. Il recommande par ailleurs de réorienter l’épargne privée européenne vers des projets à haut risque et à forte valeur ajoutée, en repensant les mécanismes de financement et le crédit impôt recherche, qu’il juge efficaces pour retenir des activités, mais insuffisants pour lancer des ruptures technologiques.

Cet appel prend un relief particulier pour la France et l’Europe alors que la compétition mondiale pour les technologies de rupture (IA, robotique, quantique, biotechnologie) s’intensifie. Dans un contexte où les États-Unis et la Chine multiplient les investissements stratégiques, l’Europe pourrait perdre du terrain si elle n’adapte pas ses institutions, sa gouvernance et son modèle de soutien à l’innovation. L’enjeu n’est plus seulement de suivre, mais de devenir un acteur de premier plan dans les filières profondes du futur.

En conclusion, le prix coattribué à Philippe Aghion n’est pas seulement une reconnaissance académique, mais un signal politique fort pour les décideurs, les industriels et les acteurs de la recherche. Il fait valoir que le monde économique de demain se jouera à l’interface de la science, de l’industrie et de la capacité à structurer les grandes ruptures. Le message de ce prix, qui souligne que le leadership technologique est le pivot du pouvoir économique, devrait inspirer des réformes profondes dans les politiques d’innovation.

Croissance endogène et destruction créatrice : deux moteurs de l’économie de l’innovation

Les travaux de Philippe Aghion et Peter Howitt reposent sur deux concepts centraux, respectivement la croissance endogène et la destruction créatrice.

La croissance endogène s’oppose à l’idée que le progrès technique tomberait du ciel. Elle montre que l’innovation naît de l’intérieur même du système économique, à travers les investissements des entreprises en recherche, la concurrence, et les incitations publiques à innover. Autrement dit, la croissance ne dépend pas seulement du capital ou du travail, mais surtout de la capacité à produire des idées nouvelles et à les diffuser.

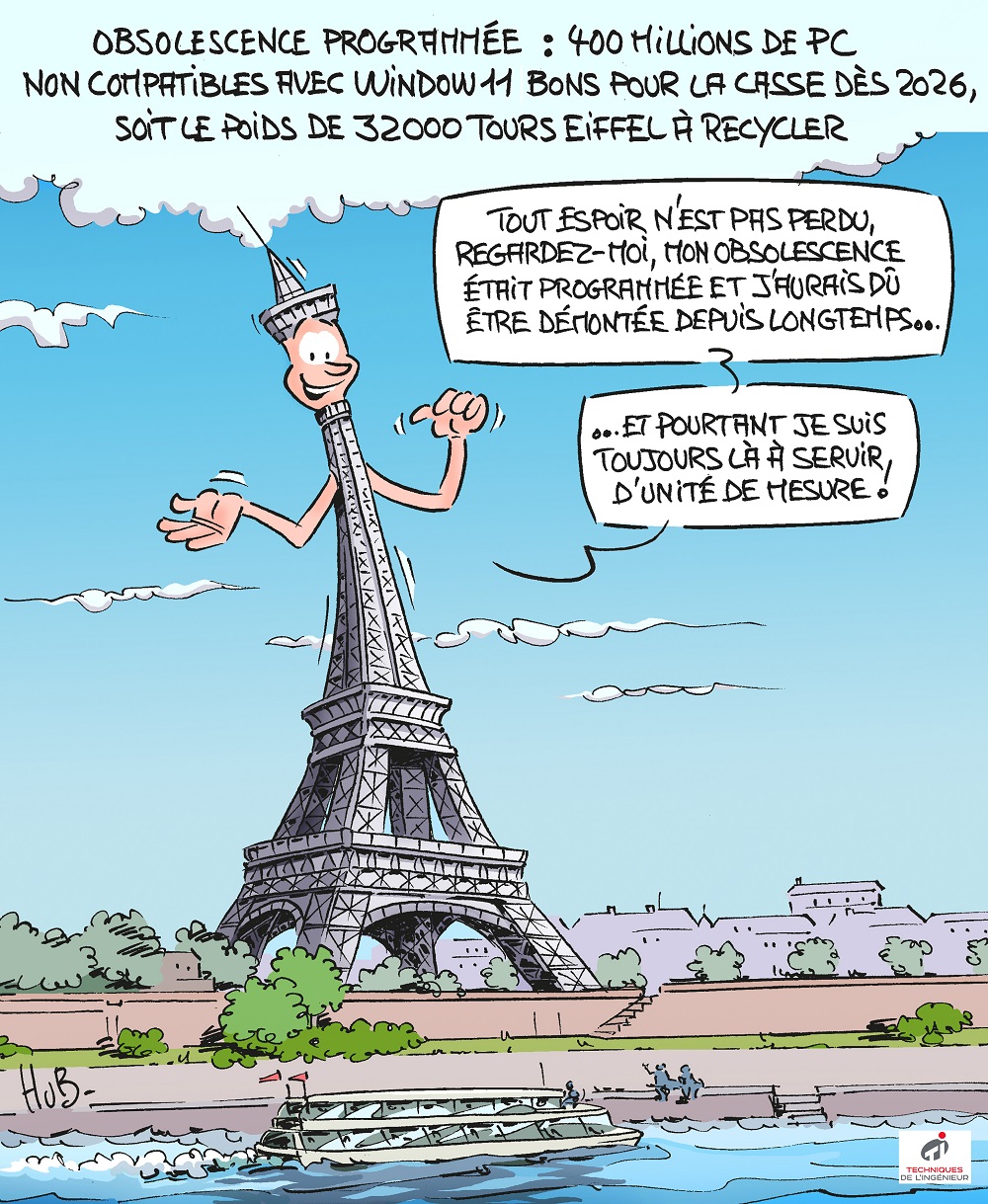

La destruction créatrice, concept popularisé par l’économiste Joseph Schumpeter, décrit quant à lui le processus par lequel de nouvelles technologies remplacent les anciennes. Ce renouvellement permanent détruit des emplois et des entreprises obsolètes, mais en crée d’autres, plus qualifiés, dans des secteurs émergents. C’est ce mécanisme que les modèles de Philippe Aghion et Peter Howitt formalisent, démontrant que l’économie progresse quand la concurrence pousse les firmes à innover pour échapper à la stagnation.

Appliqués à l’industrie moderne, ces modèles éclairent la dynamique observée dans des secteurs comme l’intelligence artificielle, les matériaux avancés ou la transition énergétique. Les nations qui savent organiser et soutenir cette destruction créatrice – sans la freiner par excès de prudence – sont celles qui gardent une longueur d’avance technologique et donc économique.