Selon le baromètre BlueDocker 2026, le technicien de maintenance industrielle figure parmi les profils les plus recherchés en 2025 (12,1 %), suivi des dessinateurs-projeteurs mécaniques et électriques (9,4 %).

Pour Pierre Vandenhove, PDG de DV GROUP, cette situation constitue un enjeu stratégique majeur.

Pierre Vandenhove est PDG de DV GROUP, leader européen couvrant l’ensemble de la chaîne de valeur de l’usine grâce à ses quatre Business Units : DV DIGITAL, DV ENGINEERING, DV MAINTENANCE et DV CONTROL.

Du bureau d’études aux ateliers, DV GROUP accompagne les industriels vers une performance durable.

Chiffres clés :

- 350 collaborateurs

- 50 M€ de CA en 2024

- 25 implantations européennes

Techniques de l’ingénieur : Quel est le métier de DV GROUP ?

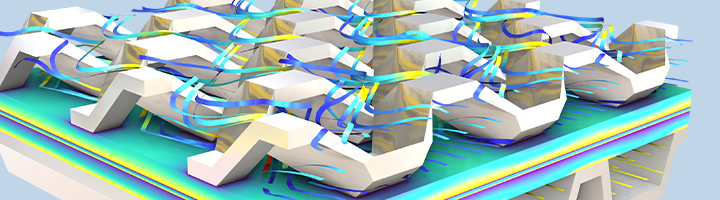

Pierre Vandenhove : Le cœur de métier de DV GROUP est technique, mais il est avant tout porté par les femmes et les hommes qui le font vivre. Nous intervenons sur l’ensemble du cycle de vie des installations industrielles : ingénierie, maintenance, contrôle et intégration de solutions digitales.

Notre mission est d’aider les industriels à sécuriser, fiabiliser et transformer leur outil de production pour le rendre plus performant, plus agile et plus efficient. Cela mobilise des expertises polyvalentes et pointues.

Dans notre secteur, la valeur ne réside pas uniquement dans la technologie, mais dans la maîtrise technique, l’expérience et le sens des responsabilités de nos équipes. Nos compétences constituent le socle de notre performance et de notre développement.

Pourquoi dit-on que la France est en pénurie de ces profils techniques alors qu’elle perd des usines ?

Il existe effectivement une tension structurelle. La France dispose d’infrastructures énergétiques et industrielles majeures, notamment d’un parc nucléaire puissant. Cependant, les compétences techniques nécessaires à la maintenance, à l’ingénierie et à la transformation de ces installations se sont progressivement raréfiées.

Nous évoquons souvent le manque de soudeurs. Mais la pénurie concerne également les électrotechniciens, les automaticiens, les techniciens de maintenance ou encore les projeteurs industriels.

Nous faisons face à une fragilisation des savoir-faire techniques stratégiques. Cette situation complexifie la réindustrialisation et fragilise notre compétitivité.

Comment s’explique cet abandon de formations techniques fondamentales ?

Un tournant culturel s’est opéré à partir des années 1980. Les filières techniques ont progressivement perdu en attractivité et en reconnaissance. L’orientation massive vers les filières générales a contribué à marginaliser les parcours industriels.

Or, une économie industrielle solide repose sur un continuum de compétences techniques, du technicien à l’ingénieur. La réussite professionnelle ne peut pas être exclusivement associée aux filières académiques généralistes. Elle doit également valoriser l’excellence technique.

Comment attirer les jeunes générations vers les métiers de la maintenance ?

Il est essentiel de rétablir une vérité simple : les métiers de la maintenance et de l’ingénierie sont des métiers à haute valeur ajoutée, porteurs de sens et d’impact concret.

La maintenance industrielle garantit la continuité de production, la sécurité des installations et la performance énergétique. Elle constitue un pilier de la compétitivité industrielle.

Ces métiers sont exigeants : ils impliquent parfois des horaires décalés et une forte responsabilité opérationnelle. Néanmoins, ils offrent en contrepartie une employabilité exceptionnelle, des perspectives d’évolution rapides, des niveaux de rémunération attractifs et une sécurité professionnelle durable.

Aujourd’hui, la tension sur le marché est telle que les jeunes talents disposent d’un pouvoir de choix inédit.

Quelles actions mettez-vous en place pour attirer et conserver des talents ?

L’alternance constitue l’un des piliers de notre stratégie. Nous intégrons chaque année une trentaine d’alternants.

Nous avons structuré un dispositif de tutorat croisé, la DV ACADEMY : les jeunes alternants apportent leur maîtrise des nouveaux outils et leur approche technologique, les collaborateurs expérimentés transmettent leur expertise opérationnelle et leur culture industrielle.

Nous avons dédié une ressource interne à l’accompagnement des alternants, car il s’agit d’un investissement stratégique de long terme.

Cette politique porte ses fruits : entre 70 % et 80 % des collaborateurs intégrés il y a quinze ans sont toujours présents dans l’entreprise et ont évolué vers des fonctions à responsabilité.

Au-delà de l’alternance, et toujours dans le cadre de la DV ACADEMY, nous avons développé une plateforme interne structurée en modules de formation.

Elle permet : d’organiser le transfert des savoirs critiques, de sécuriser les compétences techniques stratégiques, d’accompagner l’évolution professionnelle de nos équipes.

Dans un contexte de tension sur les talents, la fidélisation passe par la montée en compétence continue et la valorisation des parcours.

En dehors de l’alternance, collaborez-vous avec les écoles pour promouvoir les métiers industriels ?

Oui, de manière proactive. Nous intervenons auprès d’établissements scolaires et universitaires pour présenter la réalité des métiers industriels.

Il est fondamental d’expliquer aux jeunes que les filières techniques ne sont pas des voies par défaut, mais des trajectoires d’excellence et d’ambition.

Nous organisons des journées d’immersion, participons à la co-construction de contenus pédagogiques et collaborons étroitement avec plusieurs écoles et universités.

La reconquête industrielle passera nécessairement par la reconquête des vocations.