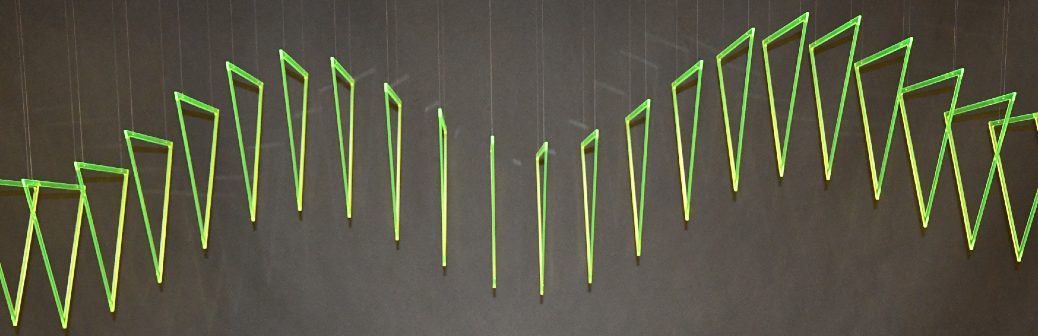

Fils de mathématiciens ayant lui-même étudié l’ingénierie informatique, Elias Crespin se reconnaît à ses œuvres géométriques suspendues au plafond par des fils en nylon, reliées à des moteurs et dirigées par programmation informatique. Lorsqu’il nous accueille dans son atelier à Ivry-sur-Seine, des dizaines d’œuvres semblent flotter dans la large salle blanche. Ronds, triangles et figures géométriques de tout ordre sont suspendus et se transforment, dans une lenteur méditative et un silence complet. Un regard ailleurs et les œuvres ont complètement changé d’apparence. Pour désigner ces mutations d’une forme à une autre, Elias Crespin parle de chorégraphies, qu’il a lui-même dessinées et programmées.

Ses connaissances et son appétence pour les sciences ont influencé son art, même s’il n’a pas choisi volontairement de lier les deux. « Tout a commencé devant une œuvre de l’artiste vénézuélien Jesús-Rafael Soto. Je me suis dit qu’avec des fonctions mathématiques paramétrées, il serait possible de faire bouger cet objet. C’est resté à l’état d’idée pendant 2 ans, puis j’ai réfléchi au moyen de déplacer un objet à partir d’un logiciel que j’aurais programmé. J’ai essayé avec de plus en plus de moteurs, pour voir comment les connecter et les adresser individuellement pour qu’ils fonctionnent de façon autonome », se remémore l’artiste. Une fois la technique opérationnelle, il y a suspendu un filet mécanique pivotant et flexible, comme un écho au travail de sa grand-mère, l’artiste Gego. C’est ainsi qu’est née sa première œuvre, Malla Electrocinética I, et que se sont initiées ses chorégraphies. Avec plus d’une centaine d’œuvres à son actif, il est désormais exposé dans le monde entier, et une de ses œuvres, L’Onde du Midi, a notamment élu domicile au musée du Louvre depuis 2020.

Mécanique, électronique et programmation

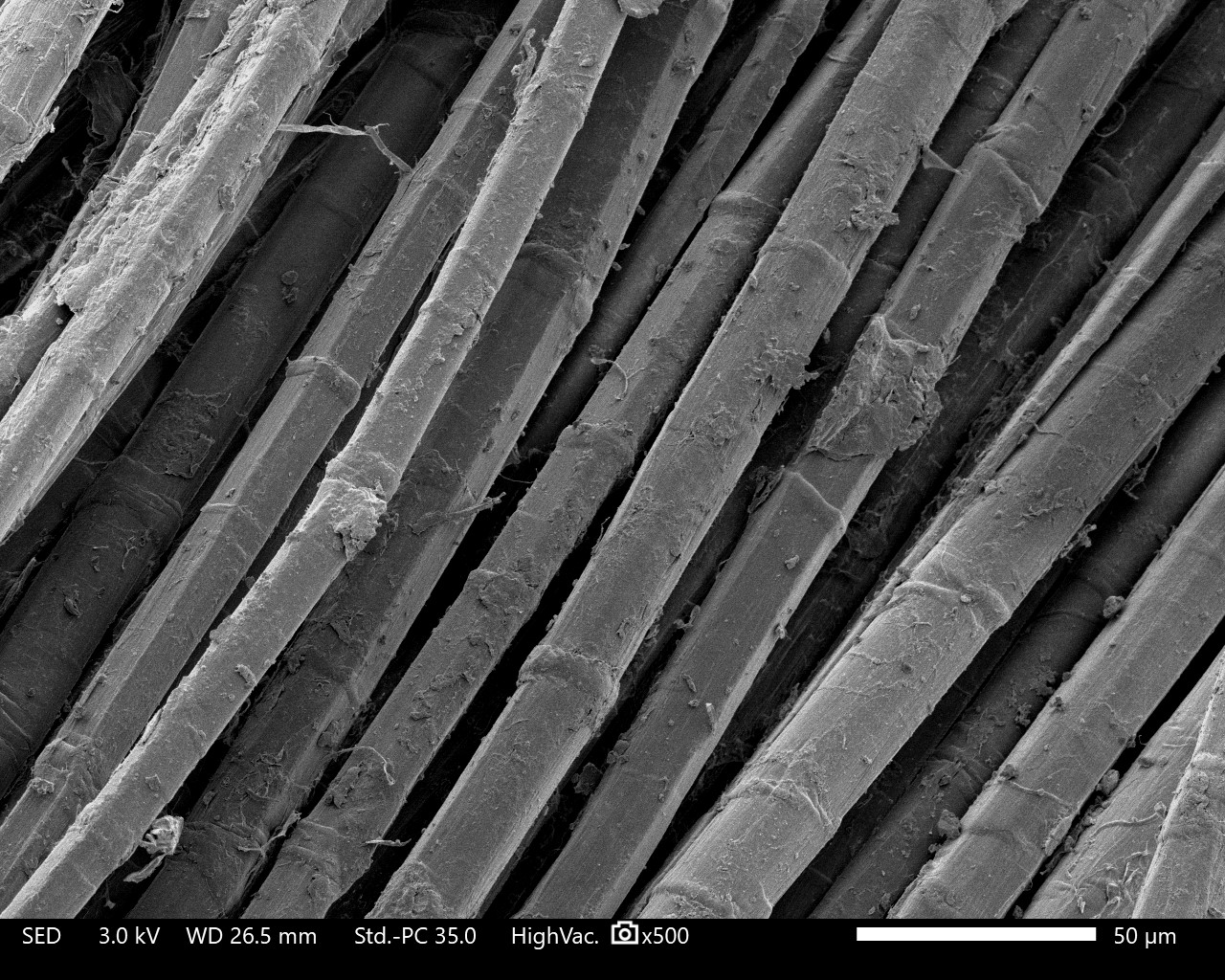

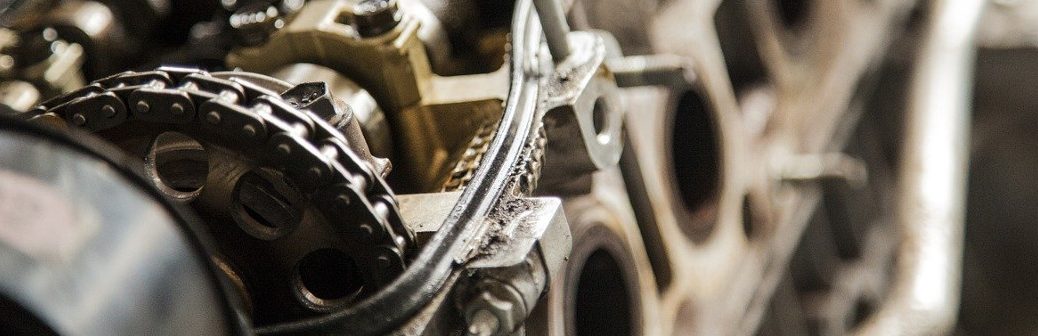

Muni d’un large sourire, Elias Crespin ouvre un des caissons normalement accroché au plafond et s’enthousiasme de nous expliquer les mécanismes derrière ses œuvres. « Il existe trois aspects principaux pour faire fonctionner les sculptures : la mécanique, l’électronique et la programmation. À l’intérieur des caissons se trouvent des moteurs pas-à-pas d’une résolution standard de 6 400 pas par tour qui permettent d’avoir 16 positions intermédiaires par tour. Ensuite, des poulies changent le mouvement rotationnel du moteur en mouvement linéaire, et permettent aux fils de nylon accrochés d’effectuer des mouvements verticaux », indique Elias Crespin. Les moteurs sont contrôlés par l’électronique et conçus de telle sorte que 12 bits puissent commander 64 moteurs. Son œuvre exposée au Louvre compte 256 moteurs et nécessite des signaux de 36 bits.

Pour la programmation, Elias Crespin compte sur des raspberry. « J’utilise une interface que j’ai développée moi-même, que nous pourrions appeler une interface de séquencement ou de composition, avec laquelle je peux interactivement faire bouger et donner une forme particulière à l’œuvre. Toutes les œuvres ont le même programme mais ce programme est paramétré différemment en fonction de la chorégraphie. Un des paramètres est la géométrie de l’œuvre, donc dépend des cordonnées de chaque point en mouvement, et de l’emplacement des moteurs », précise-t-il. La danse est une suite de formes. L’artiste définit les coordonnées des formes, puis le logiciel calcule les positions intermédiaires pour muter d’une position à une autre, toujours dans un rythme très calme. « Je préfère les mouvements lents car c’est une esthétique qui me plaît, et qui me permet de transmettre une forme de paix », explique l’artiste. Enfin, la Wifi permet d’établir le lien entre le logiciel de composition et l’œuvre.

Au bout des fils en nylon, Elias Crespin suspend des formes géométriques conçues avec des matériaux légers, comme des tiges ou des fines découpes en inox, aluminium ou plexiglas. Il travaille en ce moment à faire évoluer son logiciel pour pouvoir entre autres gérer des moteurs plus puissants et en conséquence, des éléments plus lourds.

De la création au vieillissement des œuvres

Afin de concevoir ses sculptures, Elias Crespin suit plus ou moins les mêmes étapes. S’il s’agit d’une commande pour un espace spécifique, la dimension, l’identité visuelle et les contraintes architecturales éventuelles sont induites d’emblée. Pour les œuvres sans espace particulier, c’est différent. « Après une centaine d’œuvres réalisées, mon expérience me permet d’avoir un bagage, ce qui peut aussi être un frein à mon imaginaire car je reste dans mon univers, détaille l’artiste. Je commence toujours par définir l’identité géométrique de l’œuvre. Est-ce que ça sera des éléments concentriques, des ronds, des triangles, des carrés, des baguettes ? Puis je prépare le caisson, la plateforme de contrôle comme je l’appelle. Je réalise un dessin technique avec un modèle 3D de l’intérieur du caisson où je place les moteurs, les cartes, l’alimentation, donc tous les composants qui prennent du volume. À ce moment-là, j’ai une bonne idée du mouvement général de l’œuvre. Après avoir accroché les éléments, j’utilise mon interface et je teste les positions pour programmer la chorégraphie ».

Pour la pérennité des œuvres, Elias Crespin doit prendre en compte le vieillissement des composants. « C’est un véritable défi pour nous. Dans presque chaque ville où nous exposons les sculptures, nous avons formé un technicien capable d’intervenir en cas de problèmes, comme une surcharge électrique ou des fils cassés. Nous préparons aussi de la documentation pour l’entretien technique en espérant que ça maintienne les œuvres en état de marche dans le temps. Les composants vieillissants devront être remplacés. Pour L’Onde du Midi au Louvre, nous avons donné chacune des pièces en doublon. Ils devraient pouvoir la garder en fonctionnement pour les 50 voire 100 prochaines années ! Et après, nous verrons… », conclut Elias Crespin.

Photo de Une : TriAlineados Fluo Vert d’Elias Crespin