Les failles sous-marines peuvent être à l’origine de violents tremblements de terre ou de tsunamis ; des pays comme le Japon, le Chili mais aussi l’Italie en ont fait la triste expérience. Face à ce danger, des chercheurs du laboratoire Géosciences Océan (LBO) de l’Institut Universitaire Européen de la Mer (IUEM) et l’unité de recherche Géosciences Marines de l’Ifremer développent une nouvelle technique de mesure de l’activité sismique sous-marine. Le projet, baptisé Focus et financé par une bourse de l’ERC (European Research Council), vient de se concrétiser par la pose d’un câble en fibre optique de six kilomètres et à 2 000 mètres sous la mer, en travers d’une faille au large de la Sicile. Cette région du Sud de l’Italie a souvent été frappée par des séismes meurtriers.

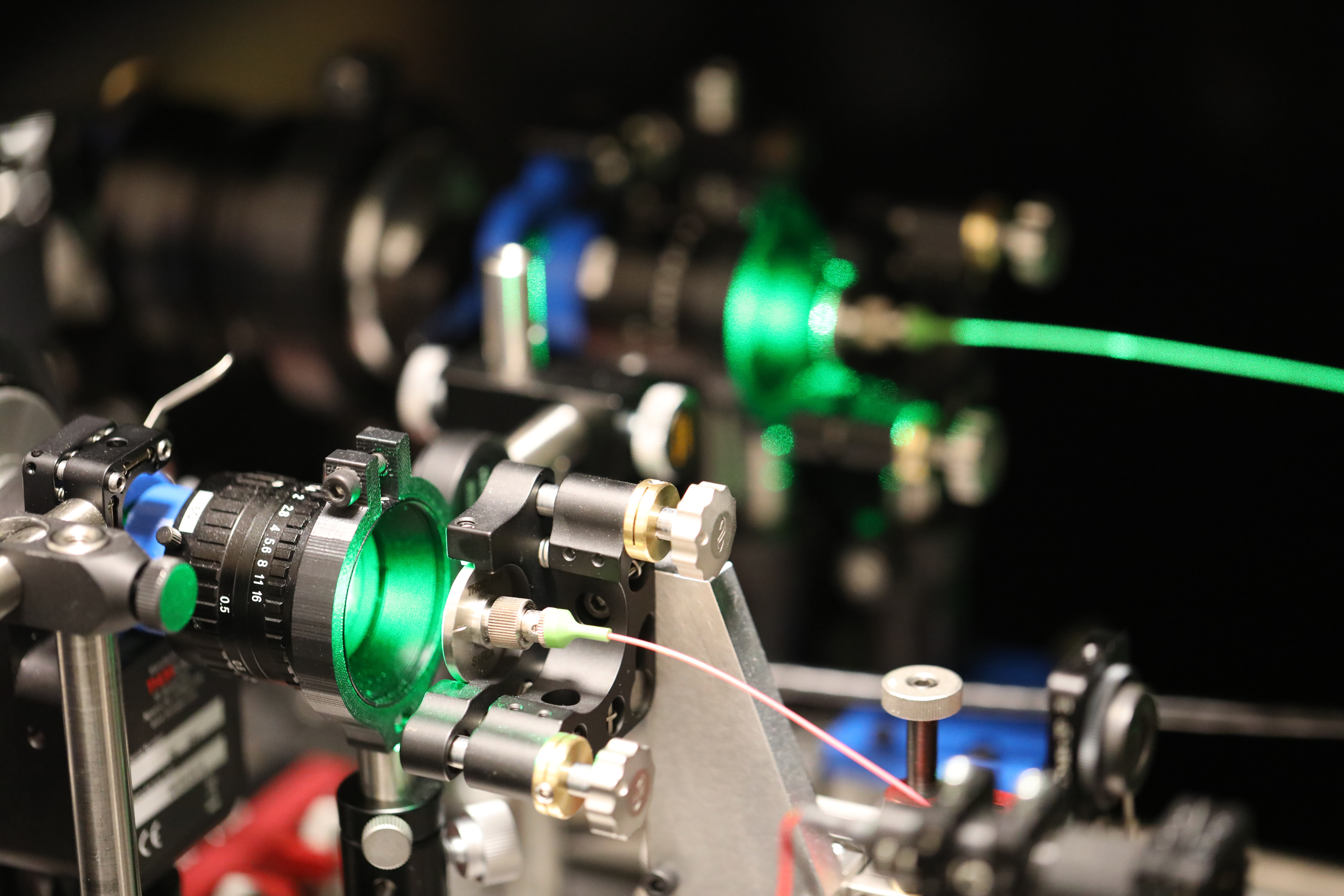

L’idée d’utiliser des câbles en fibre optique pour mesurer l’activité sismique sous-marine n’est pas nouvelle. Une technologie a déjà fait ses preuves et a pour nom DAS (pour Distributed Acoustic Sensing). Elle repose sur le principe de diffusion de Rayleigh et consiste à utiliser les techniques d’interférométrie laser en introduisant une lumière dans la fibre optique, puis à mesurer les sollicitations auxquelles elle est soumise, notamment les vibrations liées à une activité sismique. Bien qu’opérante, cette technologie présente une limite : elle fonctionne avec une portée relativement faible puisqu’au-delà d’une distance de 20, 30 voire 40 km, elle n’est plus efficiente.

Une portée pouvant aller jusqu’à une centaine de kilomètres

« Nous avons décidé d’utiliser une autre technique de réflectométrie laser appelée BOTDR, pour Brillouin Optical Time Domain Reflectometry, explique Marc-André Gutscher, directeur du Laboratoire Géosciences Océan à Brest et lauréat de la prestigieuse bourse ERC. Cette technologie est couramment utilisée pour suivre les mouvements de grandes infrastructures comme des ponts, des barrages hydroélectriques ou des tours aéroréfrigérantes dans des centrales nucléaires. Son intérêt est d’avoir une portée plus grande, jusqu’à une centaine de kilomètres. Il est possible, sur des pipelines transportant du pétrole, de détecter des petites fissures dont l’épaisseur est inférieure à celle d’un cheveu humain, par exemple au km 87,3. Autre avantage : plutôt que d’enregistrer l’activité sismique en temps réel, cette technologie permet de mesurer des déplacements de failles et donc de réaliser un suivi de l’activité sismique bien avant qu’une catastrophe arrive. »

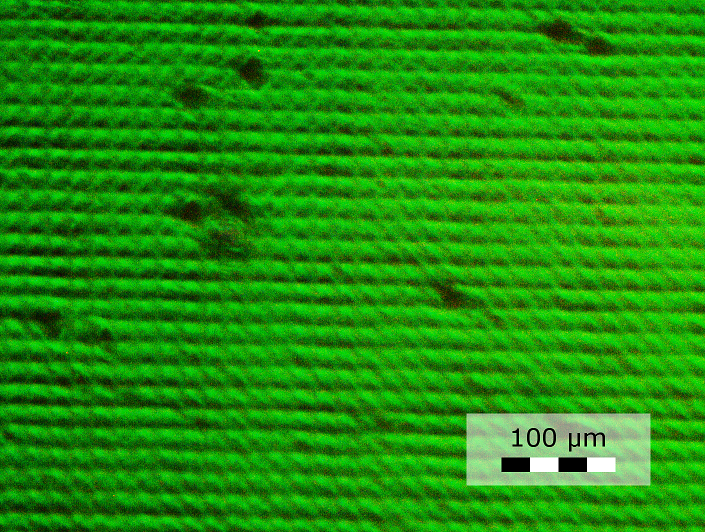

La réflectométrie BOTDR repose, elle aussi, sur l’introduction d’une lumière laser dans un câble en fibre optique. Bien que les fabricants tentent de fabriquer ces câbles avec de la silice la plus pure et parfaite possible, des petites imperfections sont toujours présentes le long de la fibre. La lumière laser va alors toucher ces imperfections et une infime partie va être réfléchie vers son origine. Ces points de réflexion sont ensuite captés par l’interrogateur, l’appareil qui à la fois projette la lumière mais aussi mesure cette lumière rétrodiffusée. Cette dernière permet de déterminer les propriétés optiques de la fibre et de mesurer les contraintes auxquelles elle est soumise comme des étirements ou des raccourcissements. Ces contraintes provoquent en effet un déplacement des pics du spectre de diffusion Brillouin. « C’est en mesurant le déplacement de ce spectre qu’il est possible de mesurer à combien de centimètres le câble a été étiré ou raccourci », précise le chercheur.

Un robot spécialement conçu pour l’exploitation des grands fonds

Les câbles posés au fond de la mer par les opérateurs télécoms sont généralement constitués de fibres en configurations libres, c’est-à-dire qu’elles sont enfermées dans un tube métallique mais flottent légèrement à l’intérieur. Du gel ou simplement un espace vide entre la fibre et le tube métallique permet de protéger la fibre contre les chocs extérieurs et éviter qu’elle ne casse. Pour ce projet, les chercheurs ont dû utiliser un câble spécialement adapté à la technologie BOTR, qui possède une configuration serrée. « Notre câble est constitué d’une fibre entourée d’une résine rigide afin que toutes les contraintes extérieures sur le tube métallique se répercutent à l’intérieur sur les fibres, ajoute Marc-André Gutscher. Les fibres sont volontairement moins protégées car nous avons besoin de mesurer l’activité à l’extérieur. »

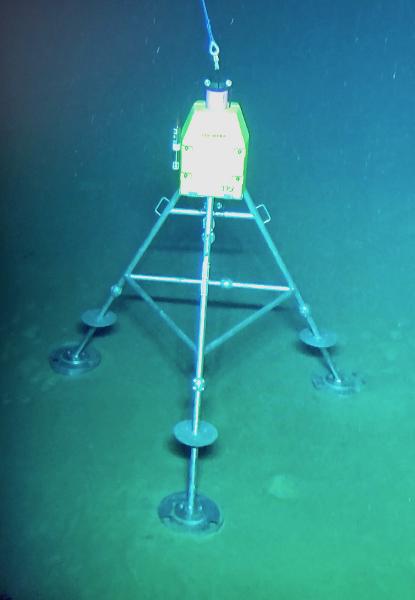

Autre élément important : cette technologie fonctionne de manière optimale à condition que le câble adhère à la structure qu’il est censé mesurer. Ici, le câble a dû être ensouillé dans les sédiments du fond de la mer à l’aide d’une charrue tirée par un robot téléopéré conçu pour l’exploitation des grands fonds, le ROV (Remote Operated Vehicle). Les chercheurs ont connecté ce câble à un câble en fibre optique classique de 28 km de long, déjà présent dans le fond marin depuis plusieurs années, et dont se servent des physiciens italiens pour leurs propres recherches scientifiques. « Lorsque la fibre est bien intégrée à la structure, la technologie BOTDR peut potentiellement mesurer des déplacements submillimétriques, déclare le chercheur. Ici, avec un câble enfoncé dans la vase au fond de la mer, nous espérons détecter des mouvements de la faille d’un à deux centimètres. »

Des balises acoustiques installées à 2 000 mètres sous la mer

Afin de calibrer les mesures enregistrées par la réflectométrie laser BOTDR, huit stations géodésiques ont aussi été installées au fond de la mer, de part et d’autre de la faille. Séparées de quelques centaines de mètres et jusqu’à 1,5 km, elles sont équipées de balises acoustiques qui émettent un signal et communiquent entre elles. En mesurant le temps de trajet de ces signaux entre chaque balise, il est ainsi possible de calculer précisément la distance qui les sépare et donc de mesurer l’écart de la faille.

Depuis le 16 octobre, les chercheurs envoient de la lumière laser à intervalles réguliers dans ce câble de 6 km de long. Trois à quatre années seront nécessaires avant de connaître les conclusions de ce travail de recherche. « Si notre technologie fonctionne, nous pourrions envisager la pose d’une nouvelle génération de câbles télécommunications au fond de la mer capables de détecter le déplacement des plaques tectoniques, analyse Marc-André Gutscher. Pour les opérateurs télécoms, cette nouvelle génération leur permettrait également de mesurer l’état de santé de leurs câbles et de détecter d’éventuelles intrusions volontaires sur ces derniers. Il peut arriver que des agences d’espionnages tentent de capter les informations transmises par ces fibres optiques en envoyant des engins au fond de mer pour accéder à ces câbles. »