Pareille dépendance se décline essentiellement en trois types de risques :

- pénurie de métaux rares, en raison de la très forte augmentation de leur utilisation, mais également, en Europe, de matériaux qui jusqu’à présent ne posaient pas de problème de disponibilité, mais qui deviendront critiques du fait de l’électrification accélérée du système énergétique dans le cadre de la politique bas carbone et donc de l’épuisement beaucoup plus rapide de leurs gisements ;

- tensions géopolitiques et économiques, un nombre restreint de pays disposant de gisements importants de minerais contenant ces métaux ;

- dommages environnementaux.

La pénurie est un risque d’autant plus élevé que la part des productions renouvelables intermittentes ainsi que, par voie de conséquence, du stockage d’énergie par batteries est importante dans le mix électrique et que l’électrification du système énergétique est plus soutenue.

Les métaux rares sont présents, entre autre, dans :

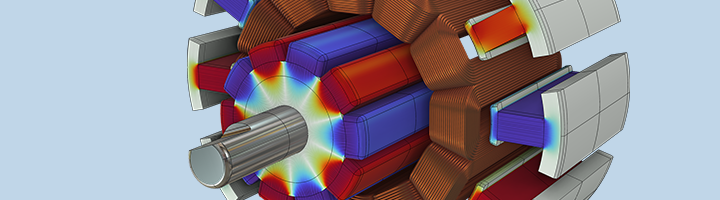

- les éoliennes. Le moteur de la plupart d’entre elles est constitué d’un aimant à base de néodyme (terre rare), de fer et de bore (métal rare) ;

- les cellules des panneaux solaires contenant gallium, silicium et terres rares ;

- les cathodes des batteries des voitures électriques et de stockage d’énergie ; le cobalt en est un composant important, permettant une plus grande capacité de stockage. Il présente toutefois des risques majeurs dont il sera question ci-dessous.

D’autre part, certains matériaux très largement utilisés dans l’industrie de l’électronique et de l’informatique sont susceptibles d’être remplacés par d’autres nettement plus performants. C’est le cas du silicium dans les semi-conducteurs, composants de base de la technologie des puces. En effet, l’oxyde de gallium est cinq fois plus conducteur que ce dernier. Toutefois, une telle substitution est soumise à des contraintes géopolitiques similaires à celles du silicium (dont la production du brut est dominée par la Chine).

Quant au germanium, il requiert un raffinage complexe et coûteux, dont la production de plaquettes dominée par la Corée du Sud et le Japon. Il permet la transmission de données à haut débit dans les fibres optiques (essentielle à l’IA) et est devenu de plus en plus nécessaire vu la demande croissante de réseaux de données à haute performance. Selon certaines estimations, la demande globale de germanium devrait augmenter de 60 % d’ici à 2034.

Parmi les métaux qui deviennent critiques dans le contexte de la politique de décarbonation, le cuivre en offre une belle illustration.

Ainsi, selon l’IFPEN (projet ANR GENERATE, Emmanuel Hache), 20 kg de cuivre sont nécessaires pour fabriquer un véhicule thermique, 40 kg pour un hybride et environ 80 kg pour un véhicule électrique. En outre, 90 % des ressources en cuivre connues aujourd’hui seront extraites d’ici à 2050, dont environ un tiers de la consommation globale dans les réseaux électriques et le transport. L’AIE (Agence Internationale de l’Énergie) a signalé une pénurie potentielle, prévoyant que les projets miniers actuels et prévus ne répondront qu’à 80 % des besoins en cuivre en 2030. Les mines américaines prévoient que l’augmentation de la production en 2024 n’est pas suffisante pour soutenir la forte demande, notamment de l’IA.

L’aluminium et plus particulièrement l’alumine de haute qualité (HPA) en est un autre exemple. Cette dernière est utilisée notamment dans la production d’énergie renouvelable, les applications militaires, les batteries Li-ion. Sa pureté chimique remarquable (après traitement), sa résistance mécanique et sa stabilité thermique sont des caractéristiques essentielles aux techniques basées sur l’IA.

Les contraintes géopolitiques

Les pays qui détiennent dans leur sous-sol des gisements de matériaux rares font l’objet de convoitise. Celles-ci se traduisent par des alliances pour en partager l’exploitation, d’accords d’achat, voire par des agressions pour en acquérir la propriété.

L’Ukraine est, entre autres, l’objet de telles convoitises tant de la part des Américains que des Russes. Les premiers ont signé un accord portant sur l’accès à ses richesses minérales en échange d’une aide militaire (mais pas la propriété), tandis que les seconds ont annexé ses territoires orientaux, notamment, pour s’approprier ses gisements locaux de lithium (deux des quatre principaux du pays, les plus riches de l’Europe) ainsi que des minerais rares tels que le niobium et le tantale.

La Chine, à elle seule, contrôle plus 60 % des terres rares extraites (sa production s’élève à environ 170 000 tonnes, loin devant celle des États-Unis), 93 % de la production de l’oxyde de gallium et plus de 90 % de la production d’aimants permanents, selon une publication en mai 2025 de Gilles Lepesant, directeur de recherche au CNRS.

La Chine en possède aussi les plus grandes réserves. En Mongolie intérieure, le district de Bayun Obo abrite le gisement de terres rares le plus important au monde, associé à un énorme complexe industriel de traitement.

La Chine contrôle également la principale réserve mondiale de gallium et produit plus de la moitié du germanium mondial.

La position dominante de la Chine dans ce domaine est extrêmement inquiétante, car elle lui confère une capacité de nuisance démesurée.

Il est urgent que les démocraties mettent tout en œuvre pour développer leur propre production de métaux et terres rares, moyennant des importations provenant de pays de confiance, leur permettant d’assurer leur autonomie en la matière.

On est encore très loin de cet objectif même si des pays comme l’Australie, la Suède et les États-Unis disposent de gisements de ces matériaux, dont certains sont déjà exploités.

Les dommages environnementaux

L’exploitation de métaux rares et de minerais contenant des terres rares n’est pas à l’abri de problèmes de rentabilité, ni de danger pour l’environnement et la santé.

L’extraction et le traitement de ces derniers sont très coûteux en énergie, en eau et en produits chimiques. Généralement, les gisements ne contiennent que 1 % de terres rares. Il faut par conséquent extraire d’énormes quantités de minerais pour finalement ne récupérer que peu de terres rares en fin de processus. En outre, celles-ci sont souvent associées à des déchets radioactifs puisqu’ils ont quasi le même rayon ionique.

L’extraction est réalisée en déversant des alcalis toxiques dans le sol afin de dégager les terres rares de l’argile.

La solution chimique est libérée dans le sol et collectée dans des bassins avec les terres rares extraites.

Après des années de pollution causée par l’exploitation illégale de nombreuses petites mines dans la région minière du Jiangxi (l’une des plus importantes du monde), les autorités chinoises ont enfin décidé de réparer les dommages environnementaux. Malheureusement, après des années de nettoyage, l’eau de source de toute la région reste contaminée.

La plupart de ces mines ont été fermées. Les milliers de personnes qui ont perdu de ce fait leur emploi ont émigré au Myanmar et au Laos pour extraire le minerai dans les mines locales. La Chine importe de plus en plus de minerais ainsi extraits dans ces pays pour en séparer ensuite les terres rares, une fois importées. La pollution environnementale n’a pas été éliminée, mais déplacée.

Aux États-Unis, les minerais extraits de la (principale) mine de Mountain Pass étaient expédiés vers la Chine pour traitement. Actuellement, ils sont traités aux EU avec l’aide d’un programme spécifique du ministère de la Défense. Ce dernier, selon Gilles Lepesant cité plus haut, a alloué depuis 2020 près de 500 millions USD pour constituer une filière américaine. De nouveaux projets ont émergé en Caroline du Sud, dans l’Oklahoma , au Texas où s’est implanté le principal acteur industriel australien déjà détenteur d’une usine de raffinage en Malaisie.

En Europe des capacités de raffinage voient le jour au Royaume-Uni, en Norvège, en Suède. En France, le site de La Rochelle a repris ses centrales de raffinage en 2025. Et un projet franco-japonais est initié à Lacq avec un approvisionnement issu du rebut de production.

Conclusion

L’électrification accélérée de l’économie européenne, dans le cadre de la politique bas carbone imposée par la Commission européenne, entraîne un gonflement de la demande de métaux rares de manière générale et de terres rares en particulier. Selon le bureau de recherche géologique et minière (BRGM), la consommation de terres rares va croître d’environ 8 % par an dans les années à venir en raison de la forte augmentation de la part des productions éoliennes et photovoltaïques dans le mix électrique et de celle des voitures électriques et hybrides dans le parc automobile (pour autant que la croissance de leur parc se confirme durant la prochaine décennie, à voir !).

Ces besoins croissants en métaux et terres rares incitent à diversifier l’approvisionnement en minerais contenant ces matériaux (afin de se soustraire le plus possible de la dépendance à l’égard de la Chine), notamment en les important du Vietnam, du Myanmar, de l’Australie ou de l’Indonésie.

Toutefois, les lois et réglementations environnementales (parfois, excessives) sur la qualité de l’air, de l’eau, des sols, etc., bref sur la protection de la nature et le bien-être des populations de manière générale, sont de nature à freiner l’accès à ces ressources, voire à remettre en question des projets d’extraction et, partant, à ne pas satisfaire la demande croissante de matériaux critiques essentiels, entre autres, aux secteurs de l’informatique, des communications, des technologies de pointe et de l’énergie.

Tôt ou tard, les États européens ne se verront-ils pas contraints d’offrir aux entreprises des voies de contournement pour leur permettre de rester compétitives au niveau international ?

Des propositions de suppression de certaines exigences ont également émergé aux États-Unis, entre autres, pour les projets essentiels à la sécurité nationale ou à la résilience économique (Robert A. James et Asleigh Myers – 6 janvier 2025).

Quoiqu’il en soit, les projets de développement de terres rares nécessitent un soutien public. Leur rentabilité est loin d’être immédiate en raison non seulement du coût des projets, mais également, entre autres, du coût de la mise en conformité avec les exigences aléatoires de contraintes environnementales et de la volatilité des prix des importations en provenance de pays de confiance.

Jean-Pierre Schaeken Willemaers