Techniques de l’Ingénieur : Pouvez-vous revenir sur votre parcours professionnel ?

Jean-Luc Viruéga :La crise de l’ESB[1], survenue alors que j’étais en dernière année d’études d’ingénieur en génie industriel[2], a été pour moi l’occasion d’une première approche du domaine de la traçabilité.

À cette époque, je souhaitais suivre un DEA[3], parallèlement à ma dernière année d’école, toujours en génie industriel et j’ai enchaîné ensuite avec un doctorat en génie industriel. J’ai donc travaillé sur la traçabilité appliquée à trois grandes crises : les produits du sang contaminé par le virus du sida, l’ESB, les OGM et les polémiques liées. Cette formation par la recherche – et non pour la recherche – m’a permis de me spécialiser dans ce domaine.

J’interviens soit dans l’objectif d’améliorer une situation, de développer et intégrer de nouvelles technologies, soit en cas de litiges, de rappels de produits, de non-conformité et lorsque mon expertise judiciaire est requise.

Par ailleurs, je continue le monitorat. J’enseigne à des professionnels, des étudiants et j’organise des formations ou participe à des conférences.

Qu’est-ce qui vous a amené à vous intéresser à la traçabilité ?

Compte tenu des normes de qualité[4] imposées à l’industrie, la traçabilité figurait au programme de mes études. J’avais un peu étudié le sujet à l’école et plus concrètement lors de stages sur les produits industriels.

Des sujets transversaux – tels que la gestion de production, l’assurance qualité ou le management de la qualité et des ERP[5] – me passionnaient également. À cette époque[6], la traçabilité était peu connue et concernait essentiellement l’industrie du secondaire. Mise au grand jour via la crise de la viande bovine, elle s’est révélée un sujet digne d’intérêt, constituant même une demande sociétale, publique, réglementaire et pas seulement technique, puis est devenue une obligation pour l’industrie.

À cette époque, la combinaison de flux d’information, à travers le digital naissant, et d’un produit par exemple me captivait déjà, d’autant plus que cette notion pouvait être transposée à tous les secteurs.

Comment la définissez-vous ?

En conférence, au travail, ou en cours, je ne peux montrer ni d’exemple, ni d’échantillon, ni de maquette de traçabilité. Elle n’est pas uniquement physique, mais doit s’adjoindre des termes complémentaires pour être mieux qualifiée.

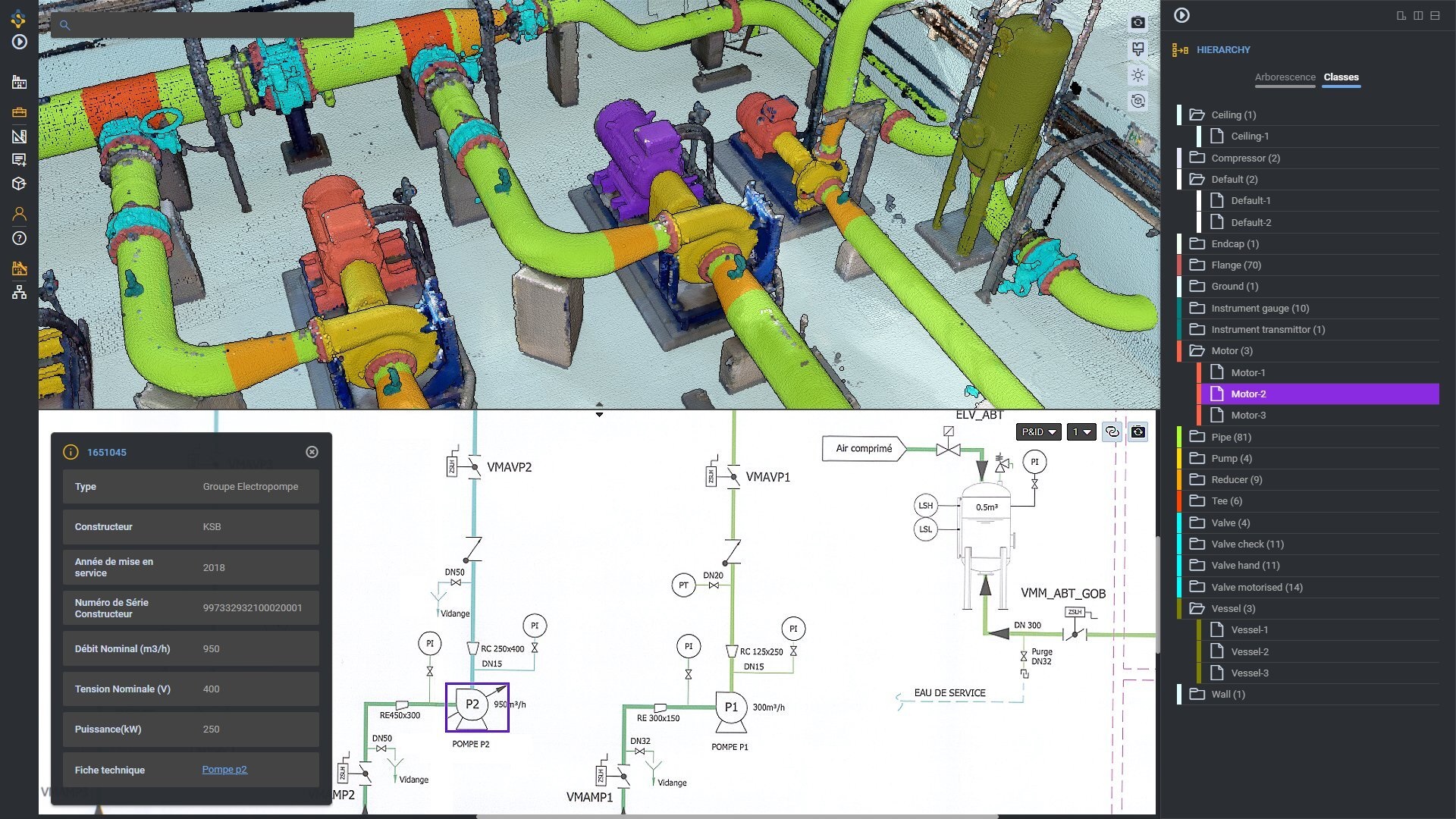

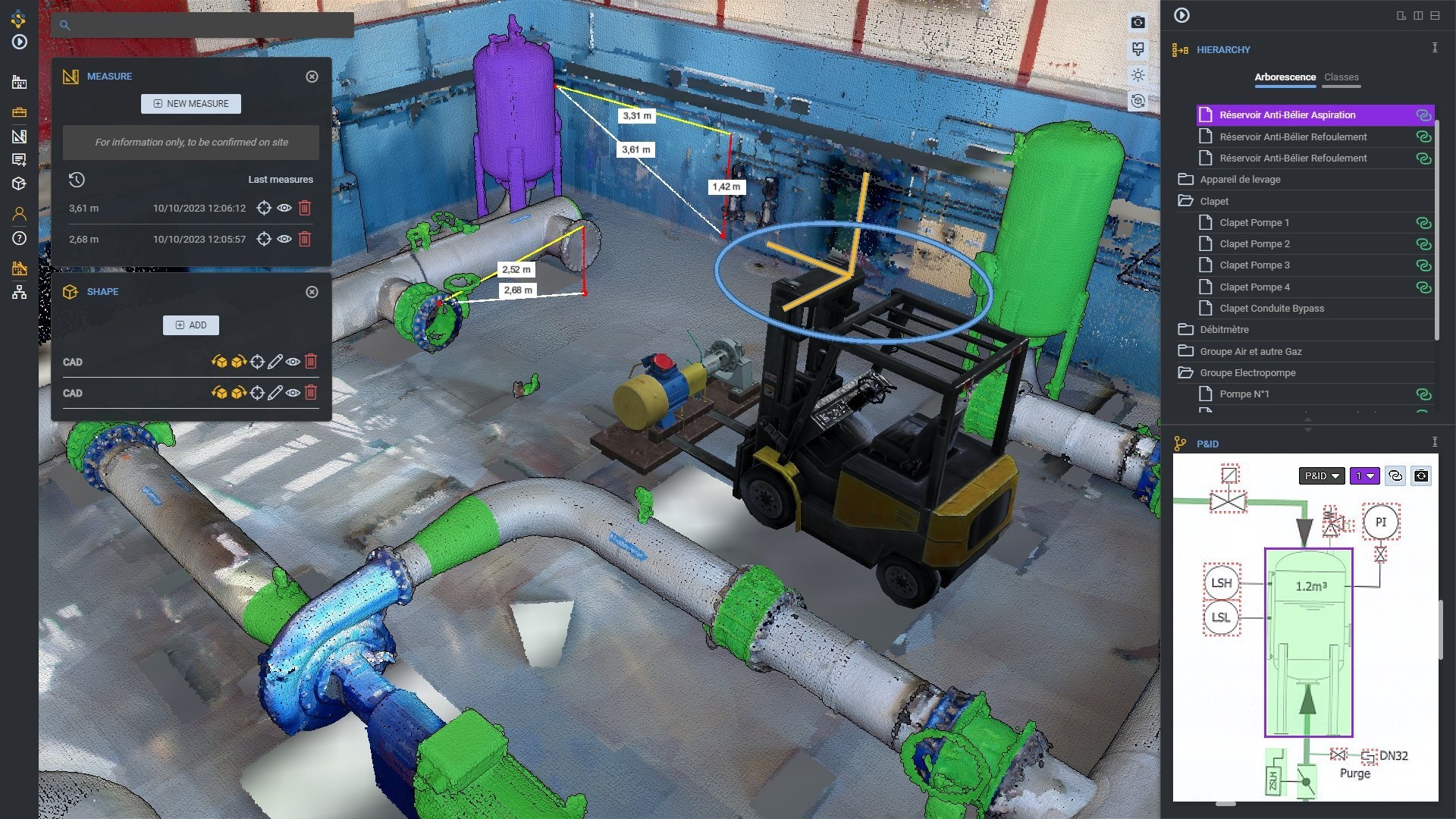

L’expression « système de traçabilité », déclinée en une approche systémique, me semble ainsi la plus pertinente. Elle ne doit pas, par ailleurs, être réduite à une seule technologie de marquage et de gestion de l’information impliquant des logiciels, mais tenir compte d’une organisation et d’un contexte physique, avec des matières entrantes et sortantes comportant des informations, comme la marque d’un fabricant.

Un système de traçabilité sert essentiellement lorsque des crises éclatent. Il est souvent mis en place suite à des problèmes liés à des produits défectueux et susceptibles de créer des dommages. Il se traduit par la gestion et la diffusion d’informations sur des lots, permettant d’enclencher le rappel ou le retrait de produits de la vente.

Hors crise, des systèmes de traçabilité sont mis en place depuis longtemps. C’est par exemple une étiquette certifiant le bon étalonnage des postes de station essence, ou encore des mentions environnementales ou d’origine pour un produit. Sans la traçabilité, il n’y aurait pas d’information fiable.

Toutes les chaînes de fabrication, les filières et les secteurs sont concernés. Depuis le 31 mai 2023 par exemple, un fabricant de produits en bois doit indiquer les coordonnées de la parcelle de provenance pour justifier que ce produit n’est pas issu de la déforestation.

La traçabilité a aussi une dimension internationale, à travers des sujets tels que le commerce équitable ou le travail des enfants notamment.

Je travaille à la mise à jour d’un article de ressources documentaires des Techniques de l’ingénieur sur la traçabilité dans la RSE et le développement durable. Cet article porte sur le système de traçabilité positive permise grâce aux efforts apportés tout le long de la chaîne d’approvisionnement. Ce processus aboutit à des informations valorisantes sur les produits mis en vente, quel que soit le niveau où on se place, professionnel ou consommateur final. L’information y est prouvée par le système de traçabilité et peut être contrôlée par un organisme public ou privé.

Au-delà de cette garantie du produit de consommation, le QR code posé sur de nombreux produits de consommation raconte le cycle de vie d’un produit, de son élaboration à sa consommation. Il permet au consommateur d’affirmer ses convictions à travers ses choix d’achats et non plus de subir l’asymétrie d’information démontrée par Georges Akerlof[7]. Le besoin de processus certifiant la qualité a donné naissance à différents labels.

Comment la traçabilité a-t-elle pris une place centrale dans votre travail ?

Les trois crises déjà évoquées ont révélé la nécessité, pour toute entreprise et pas uniquement du secteur alimentaire, d’une traçabilité, notamment en raison des enjeux de santé humaine.

La déclinaison sur le terrain industriel des textes de loi relatifs à la traçabilité est une part importante de mon travail, certains problèmes revêtant même un traitement judiciaire. La modification d’une loi, d’une organisation, voire d’une composition, ou le rappel d’un produit peuvent nécessiter l’appui d’un conseil extérieur spécialisé en traçabilité.

Estimer le coût de la traçabilité est facile, évaluer son apport l’est moins, puisqu’il n’apparaît qu’en cas de problème. Pour résumer, la traçabilité coûte, mais son absence encore plus.

Depuis les crises sanitaires du sang contaminé et de l’ESB qui ont contribué à souligner l’importance de la traçabilité, de quelle façon le concept a évolué ?

La traçabilité, jusque-là soumise à la volonté des entreprises, est devenue une obligation pour tout produit alimentaire en Europe, par un règlement européen voté en 2002, et obligatoire au 1er janvier 2005 pour toute entreprise. L’obligation porte sur le résultat, pas les moyens mis en œuvre pour garantir la traçabilité. Des exigences normatives existent cependant, ainsi que des guides de bonnes pratiques.

Au-delà de la question de la sécurité sanitaire justifiant un rappel de produit, la traçabilité est à présent utilisée dès qu’une preuve doit être apportée sur la qualité de conception ou de fabrication d’un produit, son origine, son authenticité, son fonctionnement, ou pour prouver qu’il ne contient pas d’éléments nocifs.

Enfin, les systèmes de traçabilité s’accompagnent d’équipements ou de technologies, dont la nature n’est pas précisée par l’obligation législative. La difficulté est donc de déterminer la solution technique adaptée pour répondre à l’obligation réglementaire. Certains équipements n’évoluent donc pas parce qu’ils doivent se conformer à cette obligation.

Est-il pertinent de parler de frictions entre pression réglementaire et manque de traçabilité ?

Oui. L’obligation réglementaire pousse les entreprises à s’engager afin de garantir une meilleure sécurité. Traçabilité et responsabilité sont intimement liées. S’ajoutent à présent des problématiques environnementales qui impliquent de protéger la santé des consommateurs et de l’environnement. Le paradoxe et l’aspect contre-productif de la pression réglementaire peuvent être prégnants.

La pression réglementaire est légitime et son origine est liée à des abus, intervenus avant l’obligation de traçabilité. Est-elle peut-être trop présente ? L’équilibrage est difficile à trouver. Quoiqu’il en soit, en dépit d’une volonté bien présente des entreprises, cette obligation peut leur paraître imposante et contraignante en termes de financements.

Mon travail consiste à positiver une contrainte. Prise entre l’ingénieur et le juriste, la réponse à l’obligation réglementaire ne doit pas être apportée au détriment de la rentabilité ou de la souplesse de production. Les réflexions, analyses et études qui précèdent un changement d’organisation doivent minimiser l’impact sur la production. J’espère apporter cette valeur ajoutée. Mon travail me paraît essentiel lorsqu’il s’agit d’intégrer une nouvelle obligation de traçabilité. Il est l’occasion d’une remise à plat de la gestion des stocks ou d’une révision de la nomenclature, voire de l’ajout d’une mention valorisante.

Guidé par l’intérêt économique, le secteur de la logistique, par exemple, a gagné en fiabilité grâce au tracking, et ce sans pression réglementaire.

En conclusion, le niveau en traçabilité exigé est acceptable lorsqu’elle a un intérêt, mais parfois l’évolution n’aboutit qu’à force d’abondants textes réglementaires, de litiges, de procès ou encore de scandales dans les médias. Avant la crise de l’ESB, la traçabilité en alimentaire semblait impossible. Mais les événements dramatiques participent à modifier un ordre qui semble immuable, comme le démontre la théorie du cygne noir[8].

La traçabilité est-elle aussi importante pour les producteurs, les consommateurs, et les gouvernements ?

Elle est aussi importante, mais de nature différente. La mise en vente d’un produit engage la responsabilité de son producteur, voire d’un fournisseur.

Le consommateur attend un service. Le produit acheté lui appartient. Il conserve la preuve d’achat, l’emballage ou la garantie pour le produire en cas de problème, car il n’en est pas responsable.

Les pouvoirs publics se situent entre les producteurs qu’ils doivent défendre et les consommateurs pour lesquels ils doivent garantir la sécurité sanitaire. Les contrôles des douanes empêchent ainsi l’importation de produits dangereux. L’autorité publique a une responsabilité et une mission de régulation et de protection.

De la production à la distribution, la traçabilité est-elle bien intégrée, acceptée ?

Le point de vue du consommateur est un maillon important, mais mal tracé, de cette chaîne. Les factures devraient être conservées durant 5 ans. Elles sont à présent souvent numériques. En cas de problème, il faut aller chercher la preuve d’achat sur le bon relevé bancaire. Cette traçabilité n’est ni vraiment acceptée ni vraiment intégrée.

Concernant le distributeur, les systèmes de traçabilité sont bien intégrés. Cependant, si les produits de consommation courants, par exemple alimentaires, mentionnent la date limite de consommation, leur numéro de lot pourrait être ajouté, intégré au code-barre[9] ou dans le ticket de caisse. Un lot se révélant défectueux ou dangereux pourrait ainsi être bloqué en caisse. Faut-il attendre une obligation sur ce point aussi ?

Pour sa part, le producteur répond essentiellement à la contrainte réglementaire de traçabilité. Très ponctuellement, une mention d’origine sanitaire est ajoutée, comme le pays d’origine, par exemple. Entre l’obligation réglementaire formelle de résultat et la réponse technologique, les producteurs ne sont pas dans une position simple. Un problème d’interprétation ou de compréhension peut également s’ajouter. Les documents techniques de traçabilité restent rares, alors qu’ils pourraient contribuer à l’émergence des moyens à mettre en œuvre pour répondre aux obligations réglementaires de traçabilité.

Les producteurs qui ont le mieux intégré et accepté la notion de traçabilité sont ceux qui ont eu des problèmes. L’obligation de traçabilité est attendue par le consommateur, mais son incitation est perçue comme une contrainte supplémentaire au lieu d’être considérée comme un outil de facilitation. Mon travail consiste justement à transformer cette recommandation extérieure en un outil interne de pilotage de la production, avec comme objectif que la traçabilité soit mieux accueillie.

Comment faire de cet outil de contrôle de la qualité d’un produit une stratégie pour les entrepreneurs ?

D’une stratégie prospective peuvent se dégager des idées pour mettre en place et intégrer un système de traçabilité, qui pourra être valorisé en interne comme en externe. Certaines entreprises intègrent à leurs produits l’obligation de traçabilité, moyennant une augmentation de tarif infinitésimale. L’intégration obligatoire de traçabilité peut être l’occasion de valoriser un produit, avec par exemple une mention environnementale. Le produit est alors doté d’une dimension supplémentaire, comme une garantie ou une information jusque-là inexistante.

En production, l’intégration d’un système de traçabilité permet de mieux gérer les stocks par exemple. L’usage interne de la traçabilité pourrait être d’une grande aide stratégiquement parlant, via notamment la mise en place d’un système d’alerte en cas de défaut, avant la sortie d’usine.

Dans le cadre de mon travail, lorsque je suis sollicité pour des questions techniques, j’observe l’absence de stratégie en traçabilité, seul le niveau fonctionnel étant considéré. L’application d’une contrainte n’est pas une stratégie. Quand on me demande un conseil en stratégie, ma réponse porte sur l’objectif, puis j’amène l’échange sur le terrain de l’ingénierie et de l’analyse fonctionnelle. L’obligation en traçabilité ne décrit pas les moyens. Reste le résultat et le bon fonctionnement des moyens retenus.

Quels conseils adressez-vous à un ingénieur, un technicien ou un scientifique qui arrive sur le marché du travail ?

Quel que soit le parcours professionnel, la traçabilité en fait partie, par exemple à travers la rédaction d’un texte scientifique ou l’application d’un protocole expérimental. Pour un technicien, elle est présente dans le matériel technique, l’entretien, la maintenance, les EPI. Pour un ingénieur, elle est dans la gestion d’un projet. Je conseille de ne pas ignorer la traçabilité et d’en faire une compétence.

Il est aussi possible de faire son métier de la traçabilité, comme c’est mon cas, ou du lien à tisser avec la technologie ou le service visé. En maîtriser tous les aspects est presque impossible, même si elle est largement représentée dans la loi. Pour ma part, j’ai appris sur le tas, suivi des formations sur l’expertise judiciaire, et beaucoup travaillé avec des juristes.

Quels sont vos projets, actuels et futurs ?

J’ai souvent constaté un manque de documents sectoriels définissant les moyens d’application de la traçabilité. Je m’emploie donc à combler ces lacunes. De plus, particulièrement dans les secteurs de niche, j’aborde les questions de la contrefaçon afin de valoriser la production. À mes missions s’ajoutent des questions environnementales et le devoir de vigilance. J’apprécie d’agir pour que la traçabilité ait une utilité au quotidien, pas uniquement en réponse à une obligation. Je formalise à l’écrit vingt ans de pratique et développe ma propre méthode pour instaurer un système de traçabilité en entreprise, afin de combler l’absence de processus défini. Il s’agirait d’une innovation sur le plan méthodologique, pour auditer en interne. En effet, l’entreprise attend qu’un système de traçabilité soit efficace. Or, apporter une garantie de bon fonctionnement n’est pas toujours aisé.

Mon deuxième axe de développement est digital, j’aimerais concevoir une application de traçabilité pour les consommateurs, qui constituent le maillon de la chaîne le moins valorisé.

Que vous apporte la collaboration avec Techniques de l’Ingénieur, en tant qu’auteur et conseiller scientifique ?

Je me servais déjà de la base documentaire en école d’ingénieur. J’apprécie l’accès à ces connaissances. J’apprends autant que je donne. Dans la base « traçabilité » notamment, je ne suis pas l’auteur le plus abondant et je parcours avec intérêt ce qu’écrivent les autres auteurs, issus de différents réseaux. Je prends connaissance de ce qui est écrit dans d’autres thématiques connexes comme la logistique, la production, la qualité.

Être référent chez Techniques de l’ingénieur et auteur me donne une visibilité et une forme de caution.

Je développe également mon réseau en traçabilité, car je peux être amené à contacter les autres auteurs qui publient sur ce sujet, ce qui mène à des rencontres, à des échanges, pas seulement au téléphone, mais aussi à l’écrit, expression plus précise et plus puissante.

* Jean-Luc Viruéga, expert en traçabilité

[1] ESB : encéphalopathie spongiforme bovine. Le Premier ministre anglais annonce le 3 mars 1996 que la possible contamination à l’homme de la maladie de l’encéphalopathie spongiforme bovine peut déclencher chez l’homme une nouvelle forme de la maladie de Kreuztfeld-Jacob. Ce qui a été appelé la maladie de la vache folle développe chez la personne touchée une dégénérescence au niveau cérébral. C’est le 1er janvier 2005 que s’est appliquée dans toute l’Europe la traçabilité sur les viandes.

[2] Traduction d’”industrial engineering”

[3] DEA, diplôme d’études approfondies, correspond à un master 2 recherche aujourd’hui.

[4] ISO 9001 et ISO 9002 (qui n’existe plus)

[5] Les ERP, Enterprise Resource Planning, étaient désignées à cette époque-là par le terme GPAO : Gestion de la Production Assistée par Ordinateur

[6] Dans les années 1990

[7] Asymétrie d’information, développée par Georges Akerlof, économiste américain d’inspiration keynésienne. Ses travaux sur l’analyse des imperfections de marché ont été récompensés par le prix Nobel d’Économie 2001

[8] Le « Cygne noir » théorisé par Nassim Nicholas Taleb

[9] Code-barre ou EAN13 (European Article Numbering)