Après des travaux franco-français fin 2021 (RTE, négaWatt) et début 2022 (Ademe), le temps des scénarios est revenu, mais cette fois-ci à l’échelle européenne. Avant qu’Engie présente bientôt sa vision de la transition énergétique en Europe, 26 organisations de 20 pays viennent de publier une étude inédite sur le chemin que peut prendre le Vieux Continent pour atteindre la neutralité carbone. Mené par l’association française négaWatt, le projet nommé CLEVER (pour Collaborative Low Energy Vision for the European Region) regroupe notamment AirClim (Suède), Inforse-Europe (Danemark), Politecnico di Milano (Italie), Energie-Suffizienz (Allemagne), EcoServeis (Espagne) et l’Observatoire national d’Athènes (Grèce).

Le travail réalisé par ce consortium pendant quatre ans a permis de modéliser l’évolution des consommations et productions d’énergie jusqu’en 2050 pour 30 pays : l’Union européenne des 27, la Suisse, la Norvège et le Royaume-Uni. En partant des besoins en énergie finale des différents secteurs d’activité, ils ont appliqué des hypothèses de sobriété et d’efficacité, pour ensuite évaluer les moyens de production d’énergie primaire nécessaires. Conformément aux principes du scénario négaWatt, seules les énergies renouvelables sont prises en considération.

L’Europe partant d’une situation actuelle où les énergies fossiles représentent encore une forte part de la production, ce choix s’avère audacieux. Mais le projet CLEVER montre que cela est possible, avec en conséquence une forte réduction des émissions de gaz à effet de serre (-65 % dès 2030 par rapport à 1990) pour arriver à la neutralité carbone en 2045, sans recours à la capture et au stockage de carbone. Ce scénario européen est ainsi compatible avec une trajectoire mondiale limitant le réchauffement climatique à +1,5°C.

Définition de corridors de sobriété

Tout d’abord, l’action doit être engagée le plus vite possible et sans aucun frein les 25 prochaines années. En ce sens, les membres du projet ont listé une série de recommandations pour que les politiques énergétiques européennes soient adaptées. Il s’agit par exemple que la directive sur la performance des bâtiments en cours de révision mette très fortement l’accent sur la rénovation performante du parc résidentiel et tertiaire.

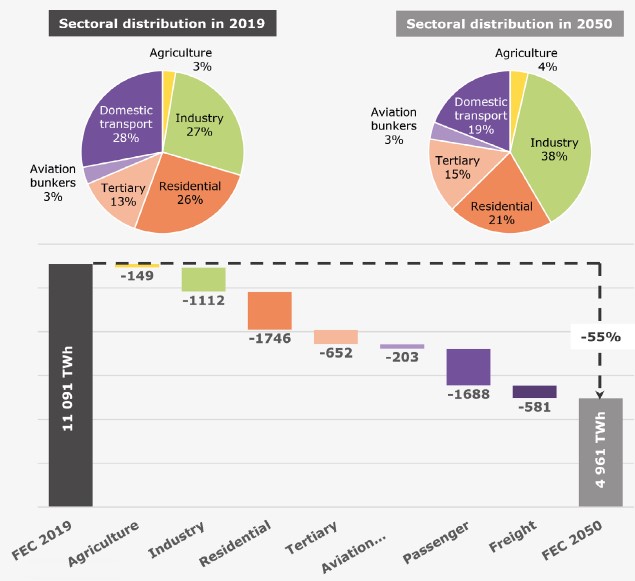

La baisse des consommations d’énergie finale est estimée à 55 % en 2050 par apport à 2019 : elle conditionne tous les résultats du scénario. Les secteurs du bâtiment et du transport représentent les deux tiers de cette baisse. Pour y arriver, le taux annuel de rénovation performante doit dépasser les 2 % vers 2030 dans tous les pays, alors qu’actuellement la moyenne est à 0,2 %. Les modes de chauffage passent majoritairement à l’électricité (principalement des pompes à chaleur), à la biomasse solide et aux réseaux de chaleur, tandis qu’énergies fossiles et vecteur gazeux ne sont plus utilisés. Dans le transport, le développement des véhicules électriques et au bioGNV, ainsi que le développement des transports en commun et des mobilités douces, sont un des moyens de réduire la consommation d’énergie de ce secteur de 39 % dès 2030.

Surtout, les porteurs du projet CLEVER insistent sur le fait que la sobriété est un axe crucial de la baisse des consommations. En France, en Allemagne et au Royaume-Uni, elle compte pour 20 à 30 % des économies d’énergie. La sobriété, dans la lignée de ce qu’a proposé le GIEC, est définie comme la redéfinition collective et individuelle des infrastructures et des pratiques pour minimiser la consommation d’énergie, de matériaux, de terres, d’eau et autres ressources naturelles tout en assurant le bien-être humain sans dépasser les limites planétaires. Elle se traduit donc certes dans des comportements individuels, mais ne trouvera sa pleine expression que si des politiques publiques lui sont dédiées. Elles doivent ainsi permettre la réduction des vitesses sur autoroute (110 km/h), l’augmentation du taux de remplissage des véhicules (covoiturage/autopartage), la réduction de la taille des véhicules et de la taille des logements, de moindres achats de biens de consommation, etc.

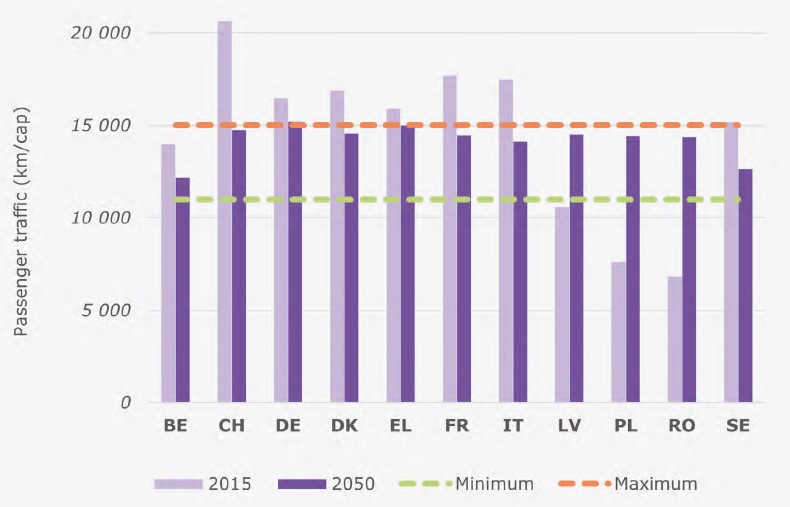

L’originalité de l’approche de CLEVER est de considérer que la sobriété va être source d’équité entre pays. En effet, l’étude prévoit des corridors de sobriété pour différents critères : selon la situation actuelle des pays, l’évolution sera à la hausse ou à la baisse pour que tous convergent. Par exemple, le nombre de kilomètres parcourus chaque année est compris entre 11 000 et 15 000 km par personne en 2050 (voir graphe), ce qui oblige certains pays à baisser leur moyenne tandis que d’autres pourront l’augmenter. Une analyse similaire est faite dans le bâtiment, pour que la moyenne par personne converge vers 32-40 m2 de logement, 18-25 litres d’eau chaude par jour et 500-700 kWh par an pour les usages électriques.

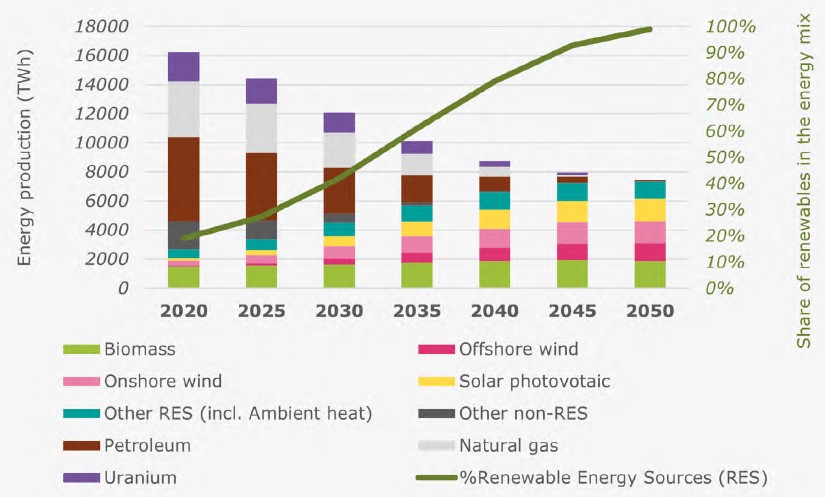

Beaucoup plus de renouvelables

Le scénario CLEVER établit ensuite une trajectoire pour les productions d’énergie : fossiles et nucléaire sont progressivement réduits à zéro, tandis que la part des renouvelables augmente pour atteindre 100 % en Europe en 2050. La croissance des usages de la biomasse jusqu’à 2250 TWh en 2050 (surtout du biogaz et du bois-énergie non issu de la forêt) reste dans les limites des estimations les plus basses faites au niveau européen. Pour l’électricité, un fort développement du solaire photovoltaïque, de l’éolien terrestre et de l’éolien en mer permet de satisfaire tous les besoins. En 2050, ces trois technologies disposent respectivement de capacités installées égales à 1 366 GW, 546 GW et 328 GW. Les objectifs intermédiaires à 2030 sont en phase avec les ambitions européennes de REPowerEU.

L’électrification des usages, tant promue dans d’autres scénarios, est contenue dans CLEVER par l’efficacité et la sobriété énergétiques. Un certain équilibre entre vecteurs énergétiques (gaz, carburants liquides, hydrogène, biomasse solide, réseau de chaleur, électricité) est recherché pour tenir compte des contraintes sectorielles, de l’approvisionnement en matières premières, des niveaux de maturité technologique et des coûts. Ainsi, les vecteurs gazeux jouent un rôle particulier, portés par deux types de conversion :

- l’électrolyse de l’eau qui permet de produire de l’hydrogène à hauteur de 1 030 TWh en 2050 pour l’UE27 ;

- la pyrogazéification de biomasse, permettant à terme de produire 214 TWh de méthane de synthèse.

On notera que les objectifs de CLEVER pour l’hydrogène en 2030 (140 TWh) sont bien inférieurs à ceux de REPowerEU (plus de 600 TWh), ce qui permet au scénario alternatif de ne pas recourir du tout à des importations, sauf 25 TWh entre l’UE27 et la Norvège à l’horizon 2050. La montée en puissance de l’hydrogène après 2035 permet de satisfaire les nouveaux besoins dans l’industrie, dans le transport maritime international de marchandises (power-to-gas et power-to-liquid), dans la production d’électricité et de chaleur, et dans le transport domestique.

Avec tous ces éléments d’analyse, les auteurs du scénario CLEVER espèrent apporter de nouveaux arguments aux instances européennes afin que des objectifs ambitieux et cohérents avec cette approche sobriété-efficacité-renouvelables soient définis pour 2040.