Trois jours. C’est le temps qu’il aura fallu à Quandela pour livrer, installer, et mettre en service in situ « Lucy », le cinquième ordinateur quantique produit par l’entreprise depuis sa création en 2017. Après douze mois de gestation au sein de l’usine de Massy, inaugurée par la scale-up française en 2023 – et dont nous vous avions proposé une petite visite l’an dernier, alors même que Lucy y était en cours d’assemblage –, la machine a franchi le seuil du Très grand centre de calcul (TGCC) du CEA le 15 octobre dernier.

Seulement trois jours plus tard, donc, elle s’éveillait pour la première fois aux côtés du supercalculateur Joliot-Curie du TGCC, avec lequel elle va d’ailleurs être couplée, renforçant ainsi l’environnement partagé de calcul haute performance et quantique du TGCC. « Il s’agit de la deuxième unité de traitement quantique (QPU) de notre centre de calcul, note, en effet, le directeur du CEA DAM Île-de-France Jean-Philippe Verger, qui décrit l’arrivée de Lucy comme une nouvelle avancée sur la voie du calcul quantique hybride ».

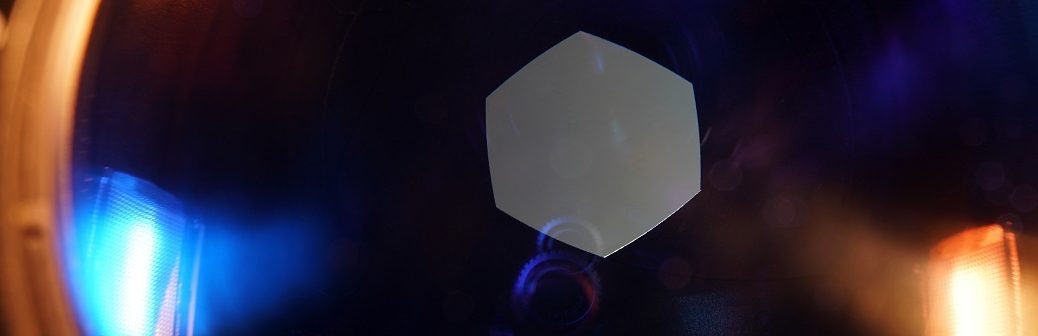

Comme ses prédécesseurs Ascella, Altair, puis Belenos – itération dont il partage les caractéristiques techniques – ce modèle d’une capacité de douze qubits physiques bénéficie naturellement de la technologie quantique exclusive développée par Quandela, qualifiée de « photonique », car reposant sur l’émission de « photons uniques ». Des particules sur lesquelles sont opérées des portes quantiques – ces briques de bases des circuits quantiques. « Quand on parle d’une machine à douze qubits photoniques, cela signifie qu’elle est capable de manipuler simultanément douze de ces photons uniques », éclaire – sans mauvais jeu de mots – Valérian Giesz, cofondateur et directeur des opérations de Quandela. Capable, ainsi, de réaliser 576 opérations quantiques par seconde, ce modèle est présenté par ses créateurs comme « le plus puissant jamais déployé dans un centre de calcul européen ».

Une technologie aux multiples atouts

En dépit de ses performances hors du commun, la machine tient dans deux baies de serveur tout ce qu’il y a de plus conventionnelles. Sa puissance électrique de seulement 5 kW – contre a minima 25 kW, d’après Quandela, pour un système équivalent basé sur les technologies supraconductrices promues par des acteurs tels que Google ou IBM – lui permet d’ailleurs de ne requérir qu’une simple alimentation en 230 volts… « Nous avons réussi un tour de force… », se félicite Valérian Giesz, qui souligne ainsi l’un des intérêts majeurs de la technologie quantique photonique de Quandela : sa sobriété énergétique. « Cela découle notamment du fait qu’un grand nombre de composants fonctionnent à température ambiante. Et même pour ceux qui nécessitent un maintien à basse température [source de photons uniques et détecteurs, n.d.l.r.], en comparaison avec d’autres technologies quantiques, notre approche est à peu près cent fois plus “chaude” [avec un maintien des composants, en l’occurrence, à environ trois degrés Celsius au-dessus du zéro absolu, n.d.l.r.]. Ce qui nous permet d’avoir des cryostats très compacts », explique le cofondateur de Quandela. (Des cryostats d’ailleurs fournis par l’Allemand attocube systems AG, dans le cadre d’un consortium formé avec Quandela pour l’occasion.)

Les avantages de la technologie promue par Quandela ne s’arrêtent d’ailleurs pas là. Stable et robuste, l’approche photonique permet aussi à l’ordinateur quantique de Quandela de se passer de systèmes de protection thermique, anti-vibrations ou encore de blindage électromagnétique. « Nous avons mesuré une fidélité moyenne des portes quantiques à deux qubits de 99 %, et nous avons montré qu’il était possible de préparer des états intriqués à plus de trois photons – ce que l’on appelle un état GHZ – avec une fidélité supérieure à 85 % », ajoute Valérian Giesz.

Une large palette de cas d’usage

Après son installation au sein du TGCC à la mi-octobre, le système est aujourd’hui en phase de test d’acceptation, pour une mise à disposition prévue début 2026. Des scientifiques de toute l’Europe pourront alors tirer parti de cette puissance de calcul quantique considérable, pour des travaux de recherche et d’exploration industrielle dans des domaines aussi variés que la cybersécurité, la finance et la blockchain, mais aussi le développement de moteurs à combustion, la mise au point de systèmes de navigation pour drones, ou encore l’étude de phénomènes d’écoulement, sans parler d’autres cas d’usage dans la chimie, les mathématiques, et même l’IA… « Des utilisateurs potentiels nous ont en effet déjà soumis un certain nombre de cas d’usage qu’ils souhaiteraient pouvoir explorer d’ici peu, en utilisant Lucy : des Français comme Thales, EDF, l’Onera, TotalEnergies ; mais aussi des acteurs européens tels que l’Université polytechnique de Bucarest, le Centre européen pour les prévisions météorologiques à moyen terme (ECMWF), ou l’Irish Centre for High-End Computing (ICHEC) », énumère Sabine Maire, responsable des projets quantiques de GENCI[1], opérateur public à la tête, aux côtés du CEA, d’EuroQCS-France ; consortium dans le cadre duquel l’acquisition de Lucy a été réalisée par l’entreprise commune européenne pour le calcul haute performance, EuroHPC.

Une imbrication – pour ne pas dire une intrication – d’entités franco-européennes qui illustre d’ailleurs, au-delà des seuls enjeux technologiques et scientifiques, la dimension stratégique et géopolitique de l’arrivée au sein du TGCC de cette machine, dont 80 % des composants – et même 100 % pour les plus critiques – sont d’ailleurs eux-mêmes d’origine européenne… Comme le note, finalement, Niccolo Somaschi, cofondateur et P.-D.G. de Quandela : « La livraison de Lucy n’est pas seulement une nouvelle étape, c’est un élément clé pour l’avenir du calcul hybride européen. […] Cette réalisation renforce la souveraineté technologique de l’Europe et démontre la puissance de la collaboration transfrontalière pour façonner la prochaine génération du calcul ».

Quandela : une feuille de route toujours sur de bons rails

Il y a un an presque jour pour jour, Quandela dévoilait sa feuille de route 2024-2030. Parmi les objectifs clés de cette roadmap figurait alors le franchissement, à l’horizon 2027, du seuil des 10 qubits dits « logiques », combinaison de centaines de qubits physiques permettant la correction d’erreurs. Une perspective toujours d’actualité, comme nous le confirme Valérian Giesz, cofondateur et directeur des opérations de Quandela : « Nous entendons toujours tenir cet objectif ! Nous comptons notamment, pour cela, déployer d’ici peu à l’échelle du prototype une nouvelle génération de sources de photons, avec un spin comme moyen d’intrication, qui nous permettra de faire la démonstration de l’obtention de ces qubits logiques ». Une première démonstration qui sera alors le point de départ de la montée en échelle de l’approche hybride photonique – semi-conducteur sur laquelle mise Quandela pour l’avenir.

« Ce futur prototype à 10 qubits logiques n’a pas vocation à être commercialisé, mais pourra être mis à disposition de nos partenaires du monde de la recherche. Nous poursuivrons en parallèle notre feuille de route qui nous permettra de franchir le seuil de 50, puis de 100 qubits logiques d’ici à la fin de la décennie », se projette finalement le directeur des opérations de Quandela. Rendez-vous est donc pris pour 2030 ; un horizon auquel Quandela vise l’obtention de 400 millions d’euros de financements supplémentaires, au travers d’une ou plusieurs levées de fonds.

[1] Grand Équipement National de Calcul Intensif, société civile détenue à 49 % par l’État représenté par le ministère en charge de l’Enseignement supérieur et de la Recherche, 20 % par le CEA, 20 % par le CNRS, 10 % par les Universités représentées par France Universités et 1 % par Inria.