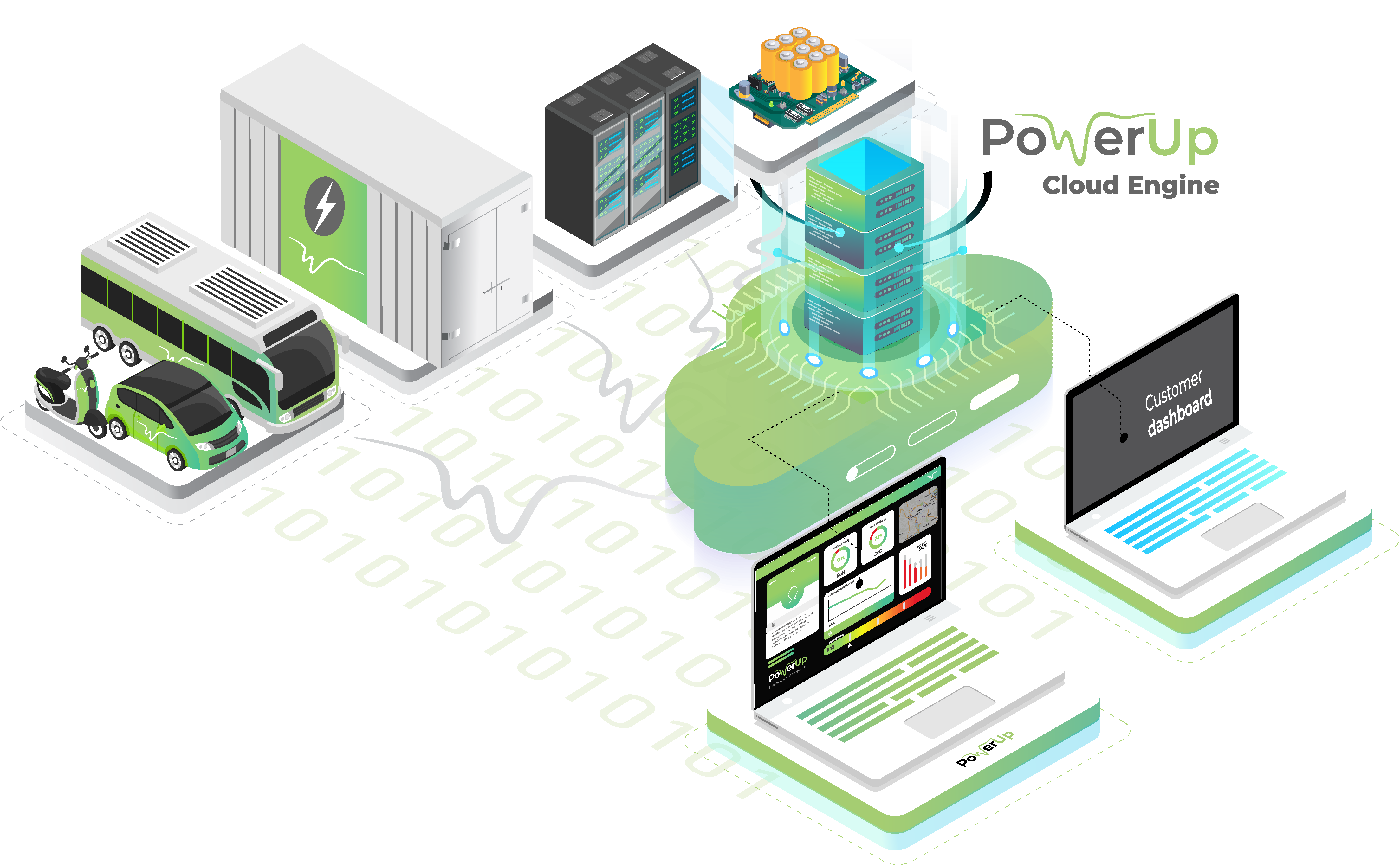

Une « indicathèque ». C’est ce qu’a mis au point – et ne cesse d’enrichir – la Société générale d’évaluation des territoires (SGEvT), entreprise toulousaine née en 2015 sous l’impulsion, notamment, de Nancy Oliveto, avocate, urbaniste et ex-consultante en développement durable. Baptisée TEREvAL, cette bibliothèque d’indicateurs et d’outils d’aide à la décision en regroupe aujourd’hui près de soixante, destinés à guider les collectivités dans leurs projets de développement de territoire. La naissance de ce véritable « tableau de bord » , comme celle de l’entreprise, est étroitement liée au Grenelle de l’environnement. Arnaud André, co-fondateur et Président de la SGEvT revient dessus : « Le Grenelle de l’environnement a fait naître l’obligation, pour les collectivités, de développer des plans de développement durable du territoire[1]. Le nombre de sujets à intégrer dans ces plans a fortement augmenté, pour prendre en compte des aspects tels que l’efficacité énergétique, l’artificialisation des sols… L’autre obligation était aussi, pour ces collectivités territoriales, d’évaluer l’efficacité de leurs plans. La société s’est donc créée sur cette idée de fournir aux collectivités des outils constituant un tableau de bord leur permettant de suivre dans le temps l’impact des projets menés ».

Évolutive, cette plateforme ne cesse de s’enrichir au fil des besoins exprimés par les collectivités clientes de la SGEvT. « Au fur et à mesure des projets sont apparus différents sujets, comme celui de l’enveloppe urbaine, c’est-à-dire les limites de la ville. Nous avons donc créé des algorithmes pour aider à établir cette enveloppe, mais aussi pour vérifier le respect des prescriptions qui sont faites », explique Arnaud André. Il y a peu, c’est aussi à un sujet à l’importance croissante que s’est attaquée la SGEvT : celui des dépôts sauvages.

Repérer, qualifier, mais aussi prévenir les dépôts sauvages

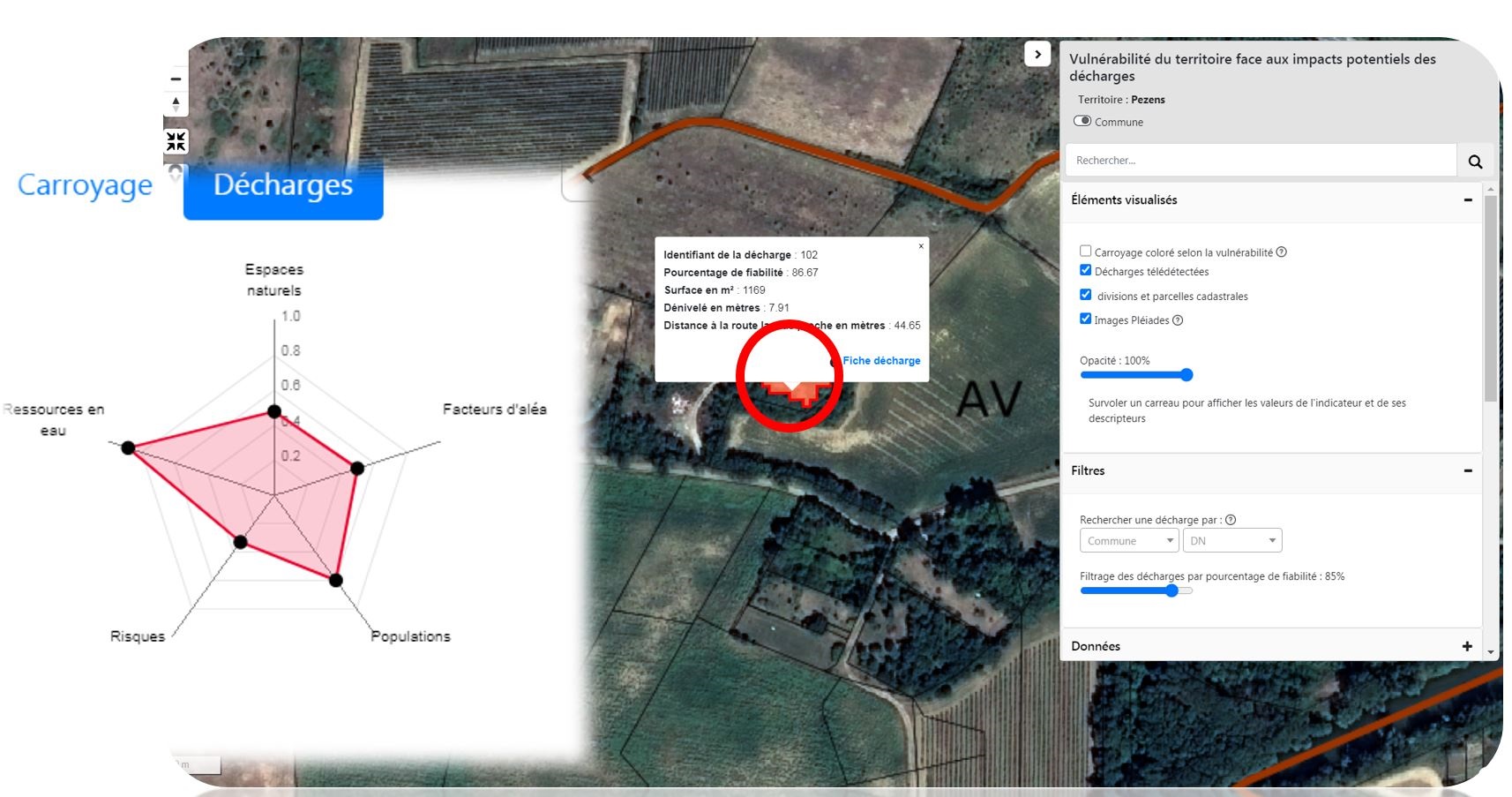

Pilotée par l’Ademe, une enquête menée en 2018 auprès de 2 652 collectivités territoriales a révélé que près de 90 % d’entre elles se trouvaient alors confrontées au problème des dépôts sauvages. Comme le notait toutefois l’Agence dans le rapport publié suite à la réalisation de cette enquête[2], « aucun état des lieux exhaustif de la situation des dépôts sauvages (quantités et nature des dépôts) n’existe à l’échelle nationale ». Un outil développé par la SGEvT pourrait toutefois changer la donne. L’entreprise a en effet mis au point une solution de télédétection visant à repérer, mais aussi à qualifier ces dépôts (étendue, date d’apparition, risques pour l’environnement…) et même à identifier, avant l’apparition de déchets, des zones particulièrement propices aux dépôts sauvages.

« Grâce aux liens que nous avons depuis des années avec le CNES, nous leur avons proposé de monter une offre basée sur les photos satellites Pléiades, croisées avec nos connaissances contextuelles du territoire : relief, occupation des parcelles, réseaux de transport… », dévoile Arnaud André. Initiée fin 2019, la démarche a abouti en 2021 par la mise en service de cet outil de télédétection inédit. « La mise au point a pris du temps. Il faut en effet détecter sur des images satellites des formes qui pourraient être des dépôts sauvages, mais qui peuvent aussi être de simples rochers, ou des cours d’eau par exemple. Les algorithmes ont donc besoin de temps pour apprendre, pour corriger progressivement leurs erreurs », note le président de la SGEvT.

Une solution qui a déjà fait ses preuves sur le terrain

Une fois détecté, chaque dépôt fait l’objet d’une notation réalisée en fonction de critères tels que sa proximité avec un cours d’eau, d’une nappe d’eau souterraine, d’écoles ou d’autres lieux sensibles. « Cet outil que nous avons développé fournit des éléments de priorisation, permettant de répondre à la question “quel dépôt faut-il traiter en premier ?” », souligne Arnaud André. Un intérêt auquel s’ajoute celui de l’identification de zones sensibles, propices à l’apparition de dépôts sauvages. Des zones qui, une fois délimitées, peuvent ainsi faire l’objet d’une surveillance renforcée. « Nous fournissons aussi des outils d’intervention, ajoute le co-fondateur de l’entreprise. Fin 2021, nous avons aidé les forces de l’ordre à mener une campagne d’interventions dans l’Aude, sur plusieurs centaines de km². Nous leur avons produit des fiches mentionnant la taille des dépôts, les conditions d’accès pour les atteindre, etc. Grâce à cela, les gendarmes sont allés sur le terrain, et en une après-midi, ils ont pu réaliser un travail qui leur aurait demandé plusieurs jours, peut-être même plus d’une semaine, sans notre outil. »

Côté fiabilité, l’outil proposé par la SGEvT se révèle capable d’atteindre un taux de détection d’au moins 90 % selon le président de l’entreprise, qui le concède toutefois : « Si le dépôt est invisible du satellite, évidemment on ne le détectera pas. C’est le cas par exemple de ce qui est sous couvert végétal. Ceci dit, cela dépend de la saison ». Outre cette limitation, la taille des dépôts a aussi son importance : d’une résolution de 50×50 cm, les images fournies par les satellites Pléiades permettent une détection de dépôts à partir de quelques dizaines de mètres carrés. « Un simple sac plastique rempli de déchets ne sera pas repéré », cite ainsi comme contre-exemple Arnaud André. La future constellation Pléiades Neo, avec sa résolution spatiale de 30 centimètres, promet toutefois de rendre le seuil de détection un peu plus bas encore.

Étoffer son panel d’outils : la raison d’être de la SGEvT

Après la réussite du projet mené dans l’Aude, la SGEvT espère désormais proposer sa solution à de nombreuses autres collectivités. « Il y a beaucoup d’intérêts, et de sujets à l’étude. Pas seulement de la part des collectivités territoriales, mais aussi des industriels de la collecte, qui y voient des opportunités nouvelles », se réjouit Arnaud André.

Moyennant un abonnement de quelques dizaines de milliers d’euros par an – en fonction notamment de la taille du territoire à couvrir –, les fonctionnalités de détection, de notation ou encore de définition des moyens d’accès sont ainsi d’ores et déjà disponibles via la plateforme TEREvAL. « Et il y aura bien sûr matière à compléter ces fonctions avec d’autres idées », prévoit le président de l’entreprise.

Une corde supplémentaire s’ajoute ainsi à l’arc de « l’indicathèque » développée par la SGEvT. Une plateforme qui devrait d’ailleurs s’étoffer encore un peu plus prochainement, avec l’ajout d’autres outils, comme le dévoile finalement Arnaud André : « Nous avons toute une offre en matière de proximité et nous travaillons ainsi, par exemple, sur les contrats locaux de santé[3], qui sont devenus une urgence pour beaucoup de territoires ». Et le dirigeant de conclure : « Fournir aux collectivités une collection d’outils la plus vaste possible est notre raison d’être ».

[1] Plans climat-air-énergie territorial (PCAET), rendus obligatoires par la loi Grenelle 2 pour les collectivités de plus de 50 000 habitants, et désormais obligatoires pour toutes les intercommunalités de plus de 20 000 habitants (seuil abaissé en 2018).

[2] ADEME, ECOGEOS. 2019. Caractérisation de la problématique des déchets sauvages. Rapport. 84 pages.

[3] Outils portés conjointement par les Agences régionales de santé (ARS) et les collectivités territoriales pour réduire les inégalités territoriales et sociales de santé.

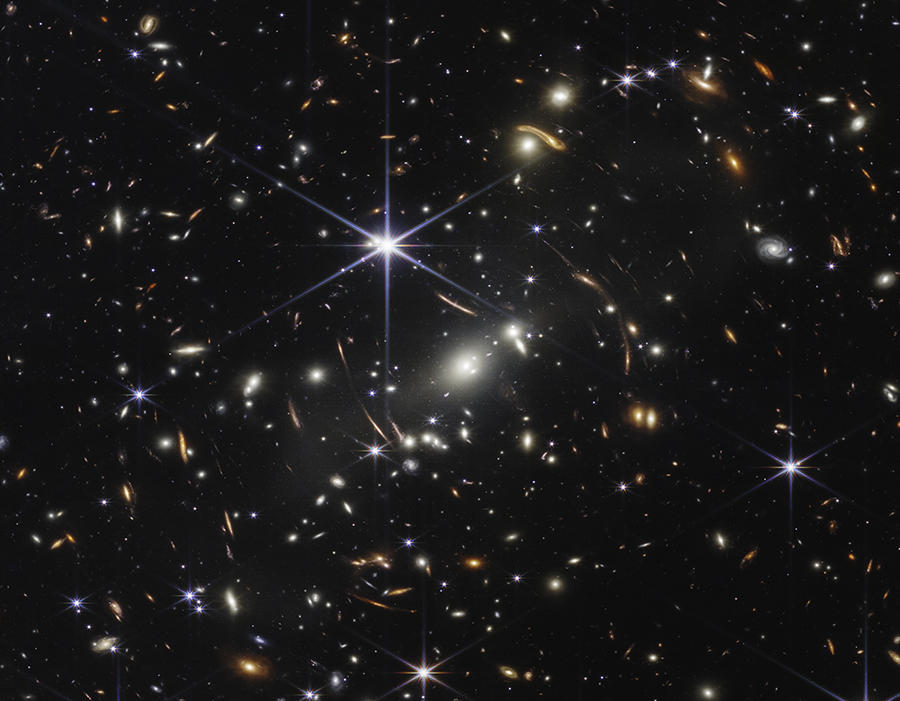

Copyright NASA, ESA, CSA, and STScI

Copyright NASA, ESA, CSA, and STScI