Par Hubert Blatz

Gauthier Ryckeboer et Romain André sont respectivement ingénieur électronique et chef de projet produits électroniques (ingénieur électrique de formation), au département conception d’accessoires jeux vidéo chez Nacon. Mais avant de rejoindre cette filiale du groupe BigBen, ils avaient commencé leurs carrières d’ingénieurs dans le secteur automobile. Ce changement s’est accompagné d’une toute nouvelle manière de travailler ! Une composante inhérente à leur quotidien : une précieuse flexibilité professionnelle et une passion commune pour le jeu vidéo.

Expériences et passe-temps ludiques, les jeux vidéo, omniprésents dans notre culture populaire, sont avant tout des produits : ils sont conçus, testés, éprouvés et approuvés, avant leur mise sur le marché. Parmi les nombreux professionnels qui œuvrent dans le domaine du gaming figurent, on s’en doute bien, des ingénieurs ! Gauthier Ryckeboer et Romain André en font partie.

“Au quotidien, mon métier se résume à plusieurs casquettes, détaille Gauthier Ryckeboer. Une première casquette laboratoire qui représente les validations, les tests et les caractérisations des différents accessoires des jeux vidéo. Une deuxième casquette, cette fois ingénierie, qui est plus liée à la spécification en vue du développement de l’accessoire, et c’est là où j’assiste mon collègue Romain, ces missions étant liées au user interface, à l’électronique et à l’électrique. Une troisième casquette autour de l’amélioration continue du produit, en fonction des retours clients, et nous sommes toujours à l’affût de nouvelles technologies et de nouveaux composants”.

De son côté, Romain André participe à la supervision du développement du produit “en allant de l’idée de départ et jusqu’à la sortie de l’usine et l’arrivée en magasin” : “cela consiste à définir complètement le produit, d’un point de vue technique, avec les membres du laboratoire, dont Gauthier, superviser le développement tout au long de la chaîne de production, participer à l’élaboration du packaging et travailler avec les équipes marketing pour présenter le produit aux clients”.

Depuis leurs débuts dans le milieu du jeu vidéo, les deux ingénieurs profitent d’une plus grande flexibilité au travail. Ainsi, pour Gauthier Ryckeboer : “chez Nacon, lorsque nous avons une idée ou un projet, que ce soit sur le développement d’accessoires ou sur autre chose, il nous est possible de le remonter très facilement car la hiérarchie est très accessible, et cela jusqu’au PDG (Alain Falk, NDLR), et il nous est aussi possible d’échanger avec beaucoup de corps de métiers, qu’il s’agisse de nos collègues de la comptabilité ou de l’informatique, de nos partenaires industriels qui se trouvent en Chine par exemple, de nos partenaires technologiques éparpillés à travers le monde, ou encore les collègues chefs de projet comme Romain ou encore les collègues designers industriels… Aujourd’hui, j’ai pu développer un côté pluridisciplinaire, très agréable car challengeant intellectuellement”.

Romain André renchérit et affirme que cette flexibilité constitue l’un des avantages qui l’ont poussé à poursuivre sa carrière dans le secteur du jeu vidéo : “la flexibilité, c’est la possibilité d’entreprendre et de voir le concept, imaginé avec les collègues, prendre forme et prendre vie. C’est une des choses qui rend le secteur au global ainsi que l’innovation très intéressants, car ce n’est pas un secteur qui reste fixe. Si par exemple on voit aujourd’hui comment a évolué une manette, à quoi elle ressemblait et ce qu’il y avait dedans il y a 10 ans, ce n’est plus la même chose aujourd’hui, ça a complètement changé ! Et on peut en dire tout autant pour l’évolution des jeux vidéo, des supports de jeux, mais aussi des casques audio. Et au niveau industriel, cette flexibilité m’a permis de rencontrer des personnes qui maîtrisent des technologies qu’autrement, si j’étais resté dans le secteur automobile, je n’aurais pas forcément pu découvrir à moins de changer de périmètre ou de site… Alors qu’aujourd’hui, je travaille sur des catégories de produits qui sont totalement différentes les unes des autres, tout en restant au même endroit”.

L’entreprise bretonne Thrustmaster, qui fabrique des joysticks et des volants

L’équipementier automobile français Valeo

“Power on: The Story of Xbox”, série de vidéos documentaires sur la chaîne YouTube de Microsoft

“High Score : L’Âge d’or du gaming”, docu-série sur Netflix

“Les consoles de jeux vidéo”, un livre d’Evan Amos (éditions Omaké)

Les livres sur l’histoire du jeu vidéo proposés par les éditions Omaké

“Joypads ! Le design des manettes”, un livre de Laurent Bolli et Nicolas Nova (éditions Les moutons électriques)

“Le rendez-vous tech” et “Le rendez-vous jeux”, podcasts animés par Patrick Beja

“Tech café”, podcast animé par Guillaume Vendé et Guillaume Poggiaspalla

Cogitons Sciences est un podcast produit par Techniques de l’Ingénieur. Cet épisode a été réalisé par Intissar El Hajj Mohamed, en collaboration avec Marie-Caroline Loriquet. Le générique a été réalisé par Pierre Ginon et le visuel du podcast a été créé par Camille Van Belle.

En 2021, les centres de données auraient été responsables de 2 % des émissions de CO2 dans le monde, soit l’équivalent de l’ensemble du secteur aérien mondial. L’industrie européenne des centres de données a indiqué qu’elle fonctionnerait de manière entièrement neutre en carbone d’ici 2030.

Différentes pistes sont étudiées pour limiter leur consommation en énergie : refroidissement avec de l’eau de mer comme à Marseille, data center sous-marin comme celui en construction en Chine, optimisation de la climatisation, recours à des systèmes de sauvegarde moins énergivore, optimisation avec l’intelligence artificielle des calculs intensifs…

Autre piste envisagée : recourir à l’hydrogène verte. En cas de panne de courant, les datacenters disposent de groupes de générateurs électriques (généralement au diesel) ainsi que d’onduleurs avec des batteries massives.

Même s’ils sont peu utilisés, ces moteurs diesel doivent être régulièrement démarrés pour s’assurer qu’ils pourraient fonctionner dès qu’une panne électronique est constatée. Étant donné le nombre important de datacenters dans le monde (près de 700, rien que pour les 8 principaux opérateurs), ces essais réguliers génèrent de la pollution et une consommation non négligeable de carburant.

Pour réduire cet impact, NorthC teste un module de pile à hydrogène de 500 kilowatts dans l’un de ses datacenters. Selon cet opérateur régional, cette alternative permettra d’économiser des dizaines de milliers de litres d’essence. Seule de l’eau est libérée lors de la combustion de l’hydrogène vert.

Si cette quantité de carburant était brûlée, plus de 78 tonnes de CO2 seraient créés. Selon NorthC, c’est l’équivalent de 24 voitures parcourant en moyenne 32 kilomètres chaque jour ou de 20 000 téléphones chargés chaque jour pendant un an.

Les piles à hydrogène qui seront installées dans le centre néerlandais de Groningue seront plus chères que les générateurs diesel traditionnels. Toutefois, en raison de la hausse des prix des carburants et du développement continu de la filière hydrogène, l’opérateur estime que les coûts devraient baisser rapidement.

Les Français travaillent également sur l’intégration de l’hydrogène vert dans des datacenters. Deux entreprises, Atos et HDF Energy, développent une solution complète pour alimenter des datacenters avec de l’hydrogène généré par des énergies renouvelables.

De son côté, le groupe énergétique allemand RWE vient de signer un accord avec Neptune Energy pour développer un projet de démonstration d’hydrogène vert dans la mer du Nord néerlandaise. Baptisée H2opZee, cette expérimentation vise une capacité d’électrolyse de 300 à 500 mégawatts. Ce projet serait développé en deux phases. La première sera axée sur une étude de faisabilité, tandis que la seconde se concentrera sur la mise en œuvre. L’objectif est que le projet soit développé avant 2030.

Composées de deux couches de verre et d’une couche interne métallique invisible faisant office d’isolant thermique, les vitres de train constituent aussi des barrières infranchissables pour les ondes de téléphonie et d’Internet mobile. Un problème qui contraint les compagnies ferroviaires à installer des répéteurs. Une opération coûteuse et contraignante, qu’il faut renouveler au fil de l’évolution des technologies et qui implique en outre une maintenance régulière, en plus d’une consommation énergétique notable. Complètement passive, la solution développée par nu glass consiste quant à elle à venir graver sur la couche métallique située au cœur du vitrage une trame invisible qui le rend perméable aux ondes. Réalisée à même le train, l’opération se révèle rapide et peu coûteuse. De multiples avantages qui pourraient également permettre à la technologie de faire son entrée, dans quelques années, dans le secteur du bâtiment, comme nous l’explique Luc Burnier, fondateur et CEO de cette spin-off de l’École polytechnique fédérale de Lausanne (EPFL).

Luc Burnier : Je travaille depuis neuf ans à l’EPFL¹ au Laboratoire d’Énergie Solaire et de Physique du Bâtiment (LESO-PB). Une partie de ce laboratoire se consacre à l’enveloppe des bâtiments, avec une orientation matériaux, par exemple sur les couches destinées aux fenêtres. Cette enveloppe des bâtiments se rapprochant de celle des trains – elle implique des consommations énergétiques liées au chauffage et à la climatisation – nous avons lancé en 2015 un projet avec l’Office fédéral des transports (OFT) dans l’objectif d’améliorer l’isolation des trains. Un tiers de leur consommation énergétique est en effet lié au chauffage et à la climatisation.

Nous avons alors identifié les fenêtres comme un point crucial. Il y a eu beaucoup d’évolutions technologiques à ce sujet. On avait, auparavant, du simple vitrage, puis du double. Plus tard, pour réduire les radiations, des coatings ont été développés : des couches minces métalliques transparentes qui servent à refléter toutes les ondes de chaleur et multiplient ainsi presque par deux l’isolation thermique de la fenêtre. La problématique, dans les trains, était que l’installation de ces fenêtres avec couches métalliques entraîne une absence de réseau téléphonique à l’intérieur des rames. La seule solution disponible à l’époque était l’installation de répéteurs, des systèmes très chers que les compagnies ferroviaires rechignaient à installer pour des raisons de budget. Elles préféraient alors parfois opter pour des vitrages peu isolants, plutôt que d’avoir à régler la problématique de la connectivité.

Nous avons donc cherché une solution « de physiciens » à cette problématique. Avec Andreas Schüler, mon supérieur, l’équipe du LESO et des partenaires industriels, nous avons ainsi développé un système permettant de venir « couper » très finement cette couche métallique pour interrompre sa conductivité électrique. Cela permet de laisser passer les ondes de téléphonie mobile, sans pour autant affecter la capacité des vitres à refléter les radiations thermiques.

Pour cela, nous avons opté pour une technique de pointe d’ablation par laser. Elle permet de faire des lignes très fines et donc d’enlever le moins de matière possible. Nous parvenons maintenant à faire des lignes d’une largeur inférieure à 25 microns, quand ce qui se fait aujourd’hui sur le marché du vitrage neuf est plutôt de l’ordre de 50 microns.

Ces lignes sont répétées tous les deux millimètres dans les deux sens. Cela produit une grille, dont on peut d’ailleurs choisir la périodicité. En tout cas, plus les lignes sont fines, mieux c’est, car on enlève moins de coating et l’on préserve ainsi l’isolation thermique. Cela est aussi important en matière de visibilité : il ne faut pas que les lignes soient trop larges, sinon on pourrait voir le quadrillage à l’œil nu.

Nous avons implémenté cette solution dans un premier train – un modèle NINA – en collaboration avec la BLS, entreprise ferroviaire de la région bernoise, dans le cadre d’un projet de l’OFT. La première entreprise ayant produit ces verres lasérisés a malheureusement fermé et d’autres fabricants ont repris la technologie (qui n’est pas brevetée) notamment Flachglas et Saint-Gobain, mais avec des lignes plus larges. Ces entreprises vendent, en plus, uniquement du verre neuf, ce qui est certes très bien pour la construction de nouveaux trains, mais ne permet pas de répondre à la problématique des trains déjà sur les rails. Une grosse partie de la flotte existante disposant de ces très bons verres isolants se retrouve verrouillée au niveau de la connectivité réseau.

Nous avons donc développé une solution de post-traitement, qui s’effectue directement sur le train. Cela évite de gâcher des vitres qui n’ont que quelques années et qui peuvent encore avoir une durée de vie de quinze ans, simplement pour une histoire de connectivité. Notre solution ne nécessite même pas de démonter les fenêtres, ce qui représenterait une problématique logistique et impliquerait des coûts énormes. C’est pour cela que nous avons développé une machine permettant de traiter les vitres directement en place.

Cela fait environ deux ans que je travaille sur cette solution de post-traitement. Les contraintes sont en effet différentes de celles liées à la fabrication de verre neuf, en usine. Malgré tout, nous arrivons à une meilleure qualité que ce que font les industriels en usine avec de grosses machines laser. Cela est dû à notre tête laser qui n’utilise pas les standards habituels de la technologie. Nous avons développé un système qui est en cours de brevetage à l’échelle européenne.

Il y a plusieurs problèmes avec les répéteurs… Si les compagnies ferroviaires rechignaient à en installer, c’est notamment parce que ce sont des systèmes compliqués, chers, et qui ne sont, parfois, pas très efficaces. Il y a régulièrement des pannes. Quand la technologie évolue, que l’on passe par exemple de la 4G à la 5G, il faut réadapter les modules, voire les remplacer. Cela consomme également de l’énergie, environ 700 watts. Hormis les coûts matériels, les contraintes sont donc aussi logistiques : il faut équiper des trains en prévoyant des emplacements pour les antennes, pour les répéteurs, il faut des techniciens, des opérations d’entretien…

À l’inverse, notre solution est complètement passive, et n’est pas limitée à un type d’onde, elle laisse tout passer, jusqu’à 6 GHz, voire plus si cela est souhaité. Elle ne nécessite pas d’entretien : une fois que l’on a traité la vitre, c’est fini. En plus de cela, notre solution a des avantages en matière de performances de communication : le fait de ne pas avoir à passer par le répéteur permet de connecter directement le téléphone aux antennes-relais, en line-of-sight². Cela permet des meilleures performances tout en demandant des niveaux de signaux un peu plus faibles.

La couche métallique est située à l’intérieur du vitrage : il y a deux lames de verre et la couche est sur l’une des faces intérieures du verre. Notre laser passe à travers le premier verre et vient se focaliser précisément sur la couche métallique interne. Nous utilisons des lasers proche-infrarouges, « transparents » pour le verre, ce qui permet de ne pas provoquer son échauffement. On ne vient « brûler » que la couche métallique, souvent une couche d’argent et d’oxydes d’une centaine de nanomètres, cela n’a donc pas d’impact sur la tenue mécanique du verre. Les temps de pulse sont aussi très courts, ce qui évite que la chaleur ne se transmette au verre.

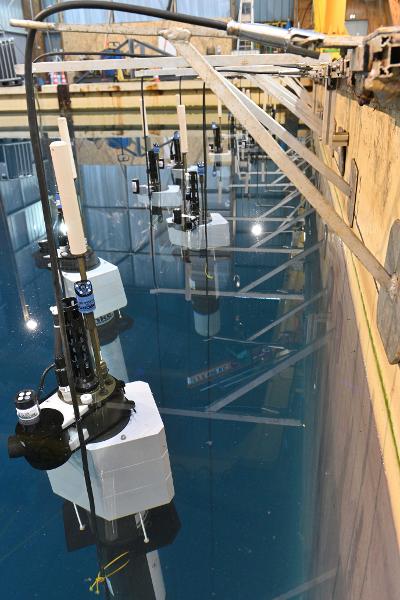

Il s’agit d’une tête laser d’une quinzaine de centimètres de côté. Dedans se trouve toute notre technologie brevetée, qui permet notamment de réaliser l’autofocus : le laser vient toujours se focaliser parfaitement sur la couche métallique afin que la résolution très fine des lignes soit atteinte. Cette tête laser est positionnée sur un robot qui vient scanner la vitre et réalise le traitement sur tout le vitrage. Ce robot lui-même est placé directement sur le train.

Cela prend une quinzaine de minutes. Nous pourrions réduire un peu ce temps en augmentant les vitesses du robot ou en améliorant d’autres paramètres, mais nous considérons qu’avec quinze minutes par fenêtre, cela est cohérent avec le temps nécessaire à l’installation de la machine.

Il est vrai qu’il y a de plus en plus de trains double-étage et le deuxième étage est souvent équipé de verre courbe. Notre tête laser possède un degré de liberté supplémentaire, qui est nécessaire pour pouvoir suivre une courbe. C’est aussi là que notre système d’autofocus montre toute son importance : il agit toutes les millisecondes et permet ainsi de maintenir une parfaite focalisation du rayon sur la couche métallique interne du verre, même s’il est courbé. La courbure n’est jamais parfaite, et l’on risquerait d’avoir des écarts sans ce système. Quand nous avons discuté avec la BLS de la première série de trains à traiter, l’idée était justement de le faire sur des vitres courbes, c’est la raison pour laquelle nous avons développé la machine pour qu’elle en soit capable.

Nous sommes pour le moment en collaboration avec les CFF [Chemins de fer fédéraux suisses, NDLR]. Nous avons traité un premier wagon qui était un wagon test. L’essai s’est bien passé, mais il ne s’agissait pas encore d’un train de passagers. En avril prochain, nous prévoyons de travailler sur une voiture de passagers, afin d’avoir un retour utilisateurs. Cela va permettre aux CFF de valider le procédé sur un matériel roulant avant de déployer la technologie. Nous sommes aussi en contact avec la Deutsche Bahn, qui rencontre exactement le même problème : de nombreux trains sont équipés de vitrages qui bloquent les ondes et leurs répéteurs ne fonctionnent pas bien… Il serait trop cher de changer les fenêtres de tous les trains. Avoir une solution de post-traitement les intéresse donc beaucoup.

L’idée pour nous est également d’élargir notre offre à l’échelle européenne, car il y a une demande. Il faut selon moi offrir cette solution le plus vite possible. La problématique est très actuelle, notamment avec le passage de la 4G à la 5G, et plus globalement avec la digitalisation. D’ici la fin de cette année, nous devrions commencer à déployer la technologie à l’échelle suisse puis européenne.

Nous sommes effectivement à la recherche de marchés en France, mais aussi en Angleterre, Espagne, Autriche, dans les pays nordiques… Ce sont des pays où le ferroviaire est bien développé et où la même problématique se manifeste.

Même si nous n’écartons rien, nous pensons a priori plutôt vendre un service complet. C’est plus simple d’avoir une formule complète pour les entreprises ferroviaires : leurs employés ne sont pas formés à l’utilisation des machines lasers. Notre machine est assez mobile, elle peut être transportée dans un van pour être déplacée là où se trouve le train à traiter. Il n’est en effet pas évident de faire venir un train qui se trouve par exemple au fin fond de l’Allemagne jusqu’à Berlin simplement parce que la machine s’y trouve. Avoir une machine mobile est important.

Par rapport aux répéteurs, ou encore au changement de fenêtres, nous sommes deux à trois fois moins chers. Il y a donc vraiment un intérêt, d’autant plus que, pour les répéteurs, il sera nécessaire de les changer à nouveau dans quelques années… Or, avec notre solution, une fois les vitres traitées, il n’y a plus à intervenir, il n’y a pas besoin d’entretien. En plus des coûts de base, les coûts liés aux entretiens, aux pannes sont donc éliminés.

Nous prévoyons aussi de proposer une offre aux verriers : si l’on sait faire mieux directement sur train, nous pourrons faire encore mieux en usine. Nous étudions cette piste… D’autant plus que nous avons un intérêt de la part de verriers qui souhaiteraient travailler avec nous. Nous visons également le secteur du bâtiment, qui fait face à la même problématique : de plus en plus de constructions sont hermétiques aux ondes. Notre solution de post-traitement serait donc parfaite, puisque l’on ne peut pas déterminer à l’avance si un bâtiment aura des problèmes de connectivité. Je pense qu’il s’agit d’une question d’années. Nous n’attendrons sans doute pas longtemps avant de nous lancer car il y a aussi une demande et cette problématique de connectivité qui risque de devenir de plus en plus importante avec le développement de l’IoT³. À terme, il sera crucial d’avoir des vitres qui laissent passer les ondes. C’est un marché important, et les coûts associés à l’installation de répéteurs sont encore plus élevés. Cela risque en plus de s’accentuer avec le temps : les fenêtres sont l’un des éléments que l’on remplace en priorité lors de la rénovation des bâtiments. Or, dans toutes les fenêtres actuelles, il y a des couches métalliques basse-émissivité, qui bloquent la chaleur mais aussi les ondes, c’est devenu un standard.

Nous n’avons pour le moment qu’une machine, car nous sommes encore en phase précoce. Mais nous prévoyons effectivement de multiplier les machines. Je pense que d’ici la fin de l’année nous serons à quatre exemplaires. Ces machines sont facilement multipliables : la nouvelle technologie laser que nous avons développée nous permet aussi d’avoir des machines plus simples que les gros modèles déployés habituellement.

(1) École polytechnique fédérale de Lausanne

(2) Transmission directe de l’onde électromagnétique entre l’émetteur et le récepteur, sans interruption du signal par un obstacle.

(3) Internet of Things, Internet des objets

Après une greffe, le risque de rejet demeure malgré le suivi systématique par le patient transplanté d’un traitement immunosuppresseur. Des consultations régulières restent ainsi indispensables pour s’assurer du bon fonctionnement de l’organe greffé. Le suivi de certains paramètres fonctionnels et histologiques permet en effet de détecter un éventuel risque de rejet. Des paramètres dont la modification n’intervient toutefois que tardivement, lorsque le greffon est déjà en souffrance. Pour détecter de manière plus précoce le risque de rejet, la start-up BioMAdvanced a ainsi entrepris le développement d’une solution de diagnostic basée sur la recherche de biomarqueurs dans le sang. Ces indicateurs trahissent plus précocement le risque de rejet, et permettent ainsi de moduler le traitement à temps. Cofondatrice et directrice du Conseil scientifique de la start-up, Sophie Brouard nous en retrace les origines et revient en détail sur la solution de diagnostic développée par BioMAdvanced, dont la commercialisation devrait débuter fin 2025.

Sophie Brouard : Je suis en premier lieu chercheuse au niveau académique, et Directrice de recherche à l’Inserm(1). Depuis les années 2000, mes collègues et moi-même travaillons sur les sujets de transplantations rénales et pulmonaires ainsi que sur des maladies auto-immunes. Notre objectif est de trouver des biomarqueurs qui permettraient de détecter plus précocement un rejet après une transplantation et d’assurer un meilleur suivi des traitements dans le cadre de maladies auto-immunes. Il existe en effet aujourd’hui des moyens, dans le cas d’une transplantation rénale, de suivre le rejet par des paramètres fonctionnels. Mais quand ces paramètres fonctionnels changent, cela signifie, en fait, qu’une souffrance du greffon existe déjà. Il est donc trop tard pour intervenir. Il en va de même au niveau histologique : quand on s’aperçoit de signes histologiques, c’est trop tard… Nous avons donc cherché à détecter des marqueurs que l’on puisse trouver avant ces marqueurs fonctionnels. Nous nous sommes ainsi orientés vers des pistes moléculaires, vers les gènes.

Nous voulions également rester dans un compartiment peu invasif, ce qui excluait la biopsie. Le sang, en revanche, nous semblait intéressant : à chaque consultation, le patient fait déjà une prise de sang, cela représentait donc pour nous une occasion de faire une mesure de gènes.

À partir de là, nous avons poursuivi nos travaux, et nous avons eu l’occasion de nous intéresser à une cohorte de patients transplantés très rares : des patients qui ne prenaient plus de traitements immunosuppresseurs et qui continuaient malgré tout à avoir une fonction rénale normale. Cela correspondait à une définition de la tolérance. Il s’agit d’un phénomène extrêmement rare : normalement quand on est transplanté, on doit suivre un traitement à vie. Nous avons donc essayé de voir si ces patients avaient quelque chose de particulier et nous les avons finalement associés à une situation de faible risque de rejet immunologique. Nous avons trouvé chez eux des biomarqueurs, et à partir de là, une signature du faible risque de rejet en transplantation rénale.

En validant cette signature, nous nous sommes aperçus qu’elle pouvait également être importante pour déceler le rejet subclinique, c’est-à-dire le rejet qui n’est pas détectable cliniquement. La signature que nous avons détectée est présente chez les patients qui ont un faible risque de rejet et inversement chez ceux qui ont un haut risque de rejet, de rejet subclinique.

Après cette première signature, nous avons adopté la même approche au niveau du poumon, sachant qu’en transplantation pulmonaire, il n’y a pas de tolérance. Nous nous sommes donc intéressés à des patients qui présentaient un rejet chronique de leur greffon. Nous avons, de la même manière que pour le rein, établi une signature du risque de rejet.

Dans les maladies auto-immunes, enfin, nous nous sommes intéressés à la rectocolite hémorragique. L’idée, dans ce cas, a été de pouvoir détecter les patients qui pourraient être éligibles aux traitements. Quand on traite les patients en première intention avec un anti-TNF(2), on a énormément de personnes résistantes à ce traitement, qui perdent donc du temps. L’idée était donc de déterminer quels patients pourraient bénéficier de ce traitement et quels malades devraient bénéficier directement d’une deuxième ligne de traitement. Il s’agit dans ce cas de marqueurs que l’on appelle des biomarqueurs compagnons.

À partir de tout cela, nous nous sommes dit qu’il serait intéressant de lancer une start-up sur ce sujet. J’avais déjà un peu d’expérience car nous avions développé auparavant une entreprise, Effimune, qui est devenue OSE Immunotherapeutics, orientée sur les anticorps monoclonaux. Le lancement de BioMAdvanced a un peu été un concours de circonstances… Nous avons suivi le programme DeepTech Founders(3), nous avons également été accompagnés par Atlanpole(4), qui nous a vraiment poussés à y aller. Un de mes collègues m’a conseillé de rencontrer Frédéric Pette, qui est devenu notre CEO. Nous étions cinq au total pour monter l’entreprise : Frédéric et moi-même, ainsi que Richard Danger, ingénieur qui travaillait depuis longtemps à mes côtés, Jean-Michel Bouler, qui m’avait conseillé de rencontrer Frédéric, ainsi que son frère, Nicolas Bouler, qui est plus spécialisé sur les aspects qualité et développement.

Il s’agit de biomarqueurs très liés aux lymphocytes B. Nous avons publié plusieurs papiers montrant que ces marqueurs sont vraiment spécifiques à un organe. Nous avons notamment réalisé, avec un collègue anglais, une étude comparative de patients tolérant un rein, et de patients tolérant un foie. Nous avons montré que les biomarqueurs étaient très différents.

Pour le poumon et le rein, les différences sont un peu moins marquées, il y a quelques gènes communs, mais les gènes que nous avons retenus, ceux qui sont les plus discriminants, ne sont pas les mêmes.

Comme je l’évoquais, il s’agit donc de gènes liés aux lymphocytes B, mais pas uniquement. Pour la signature « rein », on se retrouve par exemple avec trois paramètres cliniques et deux gènes : un gène impliqué dans la multiplication des lymphocytes B, qui s’appelle TCL1A, mais l’autre, AKR1C3, est plutôt un gène des cellules NK (Natural Killer) [capables de tuer des cellules tumorales et des cellules infectées, NDLR].

Pour le poumon, il s’agit également de gènes plutôt liés aux lymphocytes B, mais pas que, on les retrouve aussi dans les lymphocytes T. Il s’agit de gènes liés aux phénomènes de prolifération, transcription, activation.

Pour la signature que l’on retrouve dans la rectocolite hémorragique, il s’agit cette fois de gènes situés sur la voie du récepteur de l’IL-7, IL-7 étant une cytokine qui permet la croissance des lymphocytes.

C’est une question qui nous est souvent posée, mais non, ces marqueurs ne sont pas détectables avant transplantation. Cela s’explique notamment par le fait que ces gènes sont des gènes de l’inflammation, des gènes de la régulation. Or, pour avoir de la régulation, il faut avoir du « danger », comme l’a montré une chercheuse dans les années 1970. Dans notre cas, ce « danger » est justement représenté par l’évènement de la greffe.

Il faudrait en revanche que nous poussions nos travaux plus loin pour être sûrs de cela. Il reste une part d’incertitude à ce sujet.

Elle est faite par une PCR tout à fait standard, une RT-PCR(5), et nous l’avons également validée par NanoString(6), une technique qui permet de passer beaucoup plus d’échantillons.

Nous avons ensuite développé un algorithme, une équation basée sur cinq paramètres : trois paramètres cliniques : nombre de rejets antérieurs, genre et prise d’inhibiteurs de calcineurine, et les deux gènes biomarqueurs, auxquels on donne un poids, en fonction de leur expression et de leur importance dans la détection. Cela nous permet d’obtenir un chiffre, qui, s’il dépasse le seuil de 3,14, indique que le patient est à risque de rejet.

Le médecin disposera d’un chiffre qui lui indique si le patient est à risque de rejet. Après, évidemment, c’est toujours à lui d’avoir le dernier mot et d’interpréter. Il faut aussi prendre en compte les aspects cliniques.

Déjà, après avoir déterminé par notre technique le risque de rejet, il faut s’en assurer en réalisant une biopsie. Après, on peut envisager une modification du traitement si cette biopsie confirme le résultat. Soit on augmente les doses, soit on change le traitement parce qu’il n’est pas adapté. Une surveillance peut également être mise en place : le clinicien peut aussi estimer que, malgré de mauvais paramètres, on ne change rien. Dans ces cas-là, l’idée sera alors de suivre beaucoup plus le patient. C’est un aspect vraiment important, la surveillance fait beaucoup.

J’ai notamment déposé, dans le cadre de l’appel à projets européen ERA PerMed, un projet dont l’acronyme est AGORA(7). L’objectif est d’évaluer les patients à faible risque de rejet et, derrière, dans le cadre d’une étude clinique, de diminuer les doses d’un des immunosuppresseurs. Ce projet a été accepté. Notre test va donc être mis en œuvre directement chez ces patients dans le cadre d’une étude prospective, qui inclura également une validation rétrospective sur 300 patients, pour laquelle notre test sera également utilisé.

(1) Institut national de la santé et de la recherche médicale

(2) TNF : Tumor Necrosis Factor – facteur de nécrose tumorale. Les anti-TNF sont des médicaments qui bloquent l’action de ces protéines sécrétées par les lymphocytes T et qui interviennent dans le processus inflammatoire et les réactions immunitaires.

(3) Programme de formation à l’entrepreneuriat destiné aux chercheurs, lancé par Hello Tomorrow, en partenariat avec Bpifrance et sous le patronage conjoint du ministère de l’Enseignement supérieur, de la Recherche et de l’Innovation, et du Ministère de l’Économie et des Finances.

(4) Atlanpole Biotherapies est le pôle de compétitivité en santé du Grand Ouest.

(5) Reverse transcription‐polymerase chain reaction, technique associant transcription inverse et réaction de polymérisation en chaîne.

(6) Technologie utilisée pour capturer et dénombrer des molécules d’ADN, d’ARN ou des protéines à l’aide d’un système de sondes chromocodées.

(7) Algorithm of Graft Outcome in Renal Allotransplantation

Des chercheurs d’EA – Environmental Action, centre de recherche suisse spécialisé dans l’empreinte plastique, soulignent que les peintures pourraient être la principale source de pollution par les microplastiques des océans. En effet, dans son nouveau rapport L’environnement est peint de plastique, l’organisme estime que les peintures sont un contributeur majeur à la pollution plastique océanique.

Le rapport se base sur l’année de référence 2019 avec une demande mondiale en peintures de 52 millions de tonnes, comprenant 19,5 millions de tonnes de plastiques. La perte totale de peinture dans l’environnement est estimée entre 5,2 et 9,8 millions de tonnes par an (Mt/an), avec une moyenne de 7,4 Mt/an. Sur ce total, près de 2 millions de tonnes finissent dans les océans chaque année. Soit 58 % de l’apport total en microplastiques dans les océans, évalue le rapport. Le reste finit dans les sols.

« Les peintures modernes sont majoritairement constituées d’un liant à base de polymère plastique : 37 % en moyenne», explique EA – Environmental Action. Les microplastiques visés ici résultent de l’application, la rénovation et l’abrasion des peintures utilisées dans nos infrastructures, véhicules, bateaux, bâtiments, marquages routiers… Leur contribution dépasse celle des fibres textiles (522 000 tonnes) et de la poussière de pneus (424 000 tonnes).

Les sources de microplastiques liées à la peinture restent largement réparties géographiquement. En raison de sa plus grande population, la contribution la plus élevée aux pertes totales vient, comme pour la pollution macroscopique, de la région Asie-Pacifique (54 % des pertes totales).

Cité dans un communiqué, Declan McAdams, président de l’entreprise norvégienne Pinovo à l’origine de cette recherche, conclut : « Ce rapport doit être pris comme un signal d’alarme pour l’industrie de la peinture et ses clients chargés de l’entretien des revêtements de peinture. Les régulateurs nationaux et transnationaux, tels que la Commission européenne et l’Organisation maritime internationale (OMI), doivent prendre des mesures immédiates pour que les personnes travaillant avec de la peinture repensent leurs méthodes d’application, d’entretien et de traitement de cette substance en fin de vie. Il est important que l’industrie trouve des méthodes alternatives plus durables. Avec ces conclusions mettant en lumière l’ampleur de la pollution causée par la peinture, nous avons besoin d’un changement systémique dans la façon d’utiliser et gérer cette dernière. »

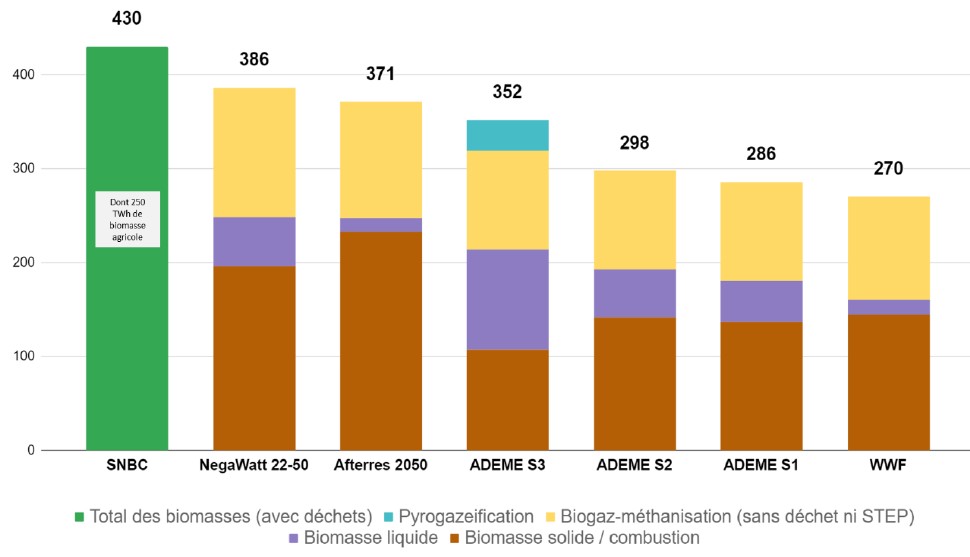

Les besoins importants de ressources renouvelables pour la transition énergétique impliquent de donner une large place à la biomasse, en particulier celle issue des filières agricoles et forestières. WWF France et le bureau d’étude Solagro se sont intéressés à la biomasse mobilisable par ces deux filières en 2050. Dans leur rapport, le mode alimentaire à cet horizon répond en qualité et en quantité aux besoins nutritionnels sur la base du scénario Pulse Fiction qui implique également une agriculture plus durable. Une fois l’alimentation assurée, la biomasse restante mobilisable est estimée entre 45 et 50 Mt de matières sèches par an.

Dans la vision du WWF, un quart de la forêt française est laissée en « libre évolution pérenne » en 2050. L’exploitation des 75 % restants conduit en 2050 à des taux de prélèvements identiques à aujourd’hui mais en récoltant plus de feuillus (dont la part triple pour fournir 50 % du bois d’œuvre). En relocalisant le tissu industriel français, notamment les scieries, le bois est mieux mobilisé pour différents usages : construction, énergie, chimie, etc. La priorité est donnée aux bois d’œuvre (7,2 Mm³) et au bois d’industrie (13,9 Mm³).

Pour la partie énergétique, le rapport de WWF évoque un volume utilisé de 52 Mm³ équivalent bois rond par an en 2050, dont 13,2 Mm³ issus directement de l’exploitation en forêt (bois ronds, plaquettes résultant du broyage), 31,8 Mm³ des produits connexes des industries du bois et du papier-carton, et 7 Mm³ du bois récolté hors forêt (haies, agroforesterie, arbres en zones artificialisées).

La biomasse forestière ainsi mobilisable pour l’énergie correspondrait à 140 TWh/an en 2050. Plus aucune importation ou exportation de bois-énergie ne serait faite. La biomasse agricole serait autour de 120 TWh, sans aucune culture principale dédiée à une valorisation énergétique. Elle servirait principalement à des unités de méthanisation de taille modérée (100 à 110 TWh/an) et pour les biocarburants de seconde génération à destination de l’aéronautique (15 TWh/an).

Globalement, l’usage énergétique de la biomasse vu par le prisme de WWF est le plus faible de tous les scénarios actuels sur le sujet, en particulier ceux de l’Ademe et de l’Association négaWatt (cf. graphe Quantité d’énergie).

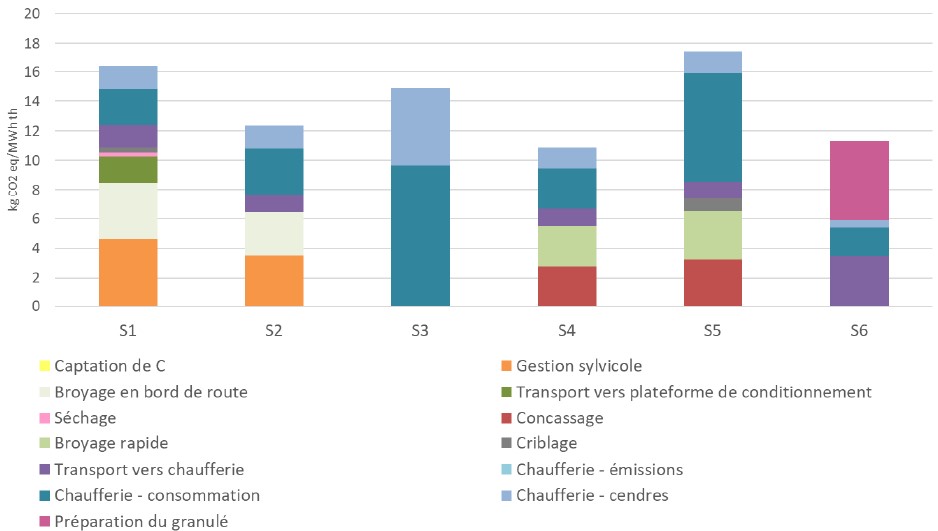

La gestion durable de la forêt prônée par le WWF pose néanmoins la question de l’impact environnemental de la collecte et de la combustion du bois-énergie. Une étude de l’Ademe publiée en janvier dernier a justement permis d’analyser cet aspect en se concentrant sur les chaufferies biomasse utilisées en collectif et dans l’industrie. En effet, même si le bois est une ressource renouvelable qui prend toute sa place dans des politiques d’économie circulaire, les émissions de polluants atmosphériques et de gaz à effet de serre (GES) dues à ces chaufferies doivent être maintenues le plus bas possible.

Trois enseignements peuvent être tirés de cette étude. Premièrement, les enjeux de qualité de l’air sont bien traités si les valeurs limites d’émissions de particules et de NOx imposées par la directive européenne sont respectées. Cette réglementation, qui s’applique aux installations de 1 à 50 MW, conduit les professionnels à équiper leurs chaudières des meilleures technologies (réduction à la source dans les foyers de combustion, systèmes d’électrofiltre de filtre à manche pour les poussières, unité de condensation). Pour les installations de puissance inférieure à 1 MW, des efforts d’écoconception doivent être faits.

Ensuite, les émissions de GES de la filière bois-énergie collectif et industriel sont inférieures à celles des filières utilisant du gaz d’origine fossile. Selon différents scénarios de types de développement du bois-énergie en collectif et industriel, ces émissions varient entre 10,9 et 17,4 kgCO2éq par MWh thermique produit (cf. graphe Emissions de gaz à effet de serre), quand celles du gaz fossile sont entre 290 et 400 kg. Ce bon résultat est dû au fait que le CO2 d’origine biogénique est considéré comme neutre en carbone : le carbone relâché dans l’atmosphère lors de la combustion du bois est équivalent à celui stocké pendant la croissance des plantes. L’analyse du cycle de vie montre ainsi que les émissions de GES sont surtout dues aux autres aspects de l’activité de production de chaleur : sylviculture, transport, préparation du combustible, consommation d’énergie des chaudières, gestion des cendres.

Enfin, l’étude de l’Ademe ouvre la voie à une meilleure compréhension des impacts d’une plus grande production de plaquettes forestières. Pour que le bilan GES de cette ressource en biomasse soit bon, la gestion sylvicole doit maintenir des pratiques favorisant le stockage de carbone : à court terme (30 ans), les plantations sur les terrains agricoles qui ne sont plus exploités (feuillus, résineux, taillis à courte rotation) sont les plus intéressantes ; à long terme (100 ans), la récolte de plaquettes sur des forêts existantes présente un bilan GES amélioré. Dans tous les cas il est bénéfique de favoriser des systèmes bois énergie croisés avec une production de bois matériau.

Chaque parcelle de forêt a des spécificités (stock de carbone initial, fertilité, productivité) dont il faut tenir compte. D’autres chercheurs pointent ainsi le besoin d’adapter les pratiques sylvicoles dans une optique plus large : il ne s’agit pas seulement de replanter des arbres, mais de le faire en rendant les forêts plus diversifiées, en adaptant leur densité aux ressources hydriques et en créant des zones protégées pour avoir la possibilité de déterminer quelles essences autochtones vont le mieux s’adapter au changement climatique sur le long terme.

Le scénario ressemble aux films hollywoodiens : des réseaux informatiques et télécoms, militaires et civils, mis hors service, des virus saboteraient des centrales électriques et bloqueraient l’accès aux distributeurs de billets de banque… Une série d’attaques propices au chaos.

Mais pour l’instant, point de chaos dû à des cyberattaques de grande ampleur ! Pourtant les médias français multiplient les titres accrocheurs comme le Figaro qui indique que « La cyberguerre fait rage entre la Russie et l’Ukraine ». L’Obs affirme qu’il s’agit d’une « cyberguerre tous azimuts, l’autre dangereuse offensive russe contre l’Ukraine ».

La réalité est plus banale. « Nous imaginions ce déchaînement orchestré de violence dans le cyberespace, ce ballet d’attaques frappant l’Ukraine par vagues, et au lieu de cela, nous avons une bagarre. Et même pas une bagarre très importante, pour l’instant », a déclaré Jason Healey, ancien membre du personnel de la Maison-Blanche chargé de la protection des infrastructures et du renseignement, qui est aujourd’hui chercheur sur les cyberconflits à l’université Columbia.

Un constat partagé par les quelques experts français que nous avons rencontrés. Sous couvert d’anonymat, un spécialiste militaire note que « beaucoup de personnes parlent et s’agitent, comme les Anonymous, mais rien de particulièrement visible sur cette fameuse cyberguerre. Côté russe, leur internet est plus cloisonné que l’on pense. Pour le moment, c’est juste la guerre ».

Hervé Debar, directeur de la recherche à Télécom SudParis, souligne aussi le calme plat côté cyberattaque : « En 2015 et 2016, des compagnies d’électricité régionales ukrainiennes avaient été victimes de cyberattaques. Ces opérations avaient notamment entraîné une panne de courant affectant certains quartiers de Kiev et de sa région. Mais aujourd’hui, c’est pour l’instant une guerre de l’information sur les réseaux sociaux ».

De nombreux experts en cybersécurité pensent que le Kremlin, du moins pour l’instant, préfère garder les communications de l’Ukraine ouvertes pour les services de renseignement. « Soit les Russes sont en train d’écouter ce qui se passe, ce qui explique que les réseaux télécoms ne sont pas touchés car ils sont une source d’information, soit ils ont comme objectif d’occuper le pays et ils auront donc besoin d’infrastructures opérationnelles », explique Hervé Debar.

Avant l’invasion, des pirates informatiques ont mis hors ligne ou défiguré les sites Web du gouvernement ukrainien et effacé certains serveurs à l’aide de logiciels malveillants. Un expert du ministère de la Défense nous a précisé que « certains codes malveillants avaient été activés fin 2021, ce qui montre que la Russie avait programmé cette opération depuis un certain temps ». Des virus « dormants » pourraient donc être activés à des moments opportuns.

En face, une armée de pirates informatiques, dont certains ont été rassemblés en ligne par le service de sécurité ukrainien SBU, annonce avoir « défiguré » des sites gouvernementaux et médiatiques russes.

Un groupe de volontaires, qui se fait appeler l’Armée informatique d’Ukraine, compte plus de 230 000 adeptes sur un canal Telegram et ne cesse de dresser la liste des cibles à atteindre par les pirates, comme les banques russes et les bourses de cryptomonnaies. Mais on ne s’improvise pas hacker du jour au lendemain, c’est un métier qui exige plusieurs années de pratique.

Et si finalement la cyberguerre était une arme de dissuasion qui ne serait pas utilisée car trop destructrice ? « Il y aurait à la fois des problèmes techniques, juridiques et éthiques qui pourraient se poser. Quid en effet des conséquences d’une cyberattaque touchant les populations civiles ? », souligne Hervé Debar.

Nous vous en remercions pour votre participation à ce jeu-concours. Le tirage au sort a été effectué le 9 février au sein de la rédaction et voici :

Patrick Potard est le grand gagnant du concours Techniques de l’Ingénieur 2021 ! Il a répondu correctement aux 11 questions (les réponses plus bas !) et il remporte donc un pack télétravail composé d’un ordinateur portable et d’un casque.

Quelle bonne nouvelle pour cet ingénieur spécialisé dans les mesures de radioactivité naturelle. Il a utilisé les ressources documentaires de Techniques de l’Ingénieur pour certains de ses projets. Il va pouvoir profiter de son nouvel équipement pour travailler confortablement.

Bravo à lui et à tous les autres gagnants ! Nous pouvons compter parmi eux :

Nathaly Chapon Normand,

Aimé Delbart,

Cécile Pagani,

Gilles Fernandez,

David Demeulemester,

Marie Niel

….

Ils ont eu l’occasion de remporter chacun un cadeau parmi les lots offerts cette année : un téléphone durable, des fauteuils massants, des modules CerT.I. et des abonnements à l’une des ressources documentaires ainsi que d’autres très beaux lots.

Félicitations à eux et à l’année prochaine pour un nouveau grand jeu-concours !

Le grand jeu-concours « Quoi de neuf chez Techniques de l’Ingénieur ? » a été l’occasion de tester vos connaissances sur les nouveautés du site Techniques de l’Ingénieur. Voici les réponses aux 11 questions posées.

1. Quel est le nom du podcast de Techniques de l’Ingénieur qui décrypte les enjeux des sciences ?

Meet TI / Cogitons Sciences / ScienTIc

En savoir plus

2. Quel est le thème du 1er épisode de ce podcast ?

L’éthique de l’innovation / L’énergie et mobilité / Les métiers de l’ingénieur

En savoir plus

3. Quel était le thème principal de la journée “Génie écologique”, liée à la sortie de l’offre éponyme ?

Le sol / Uranus / Aladin

En savoir plus

4. Quel triste anniversaire à fait l’objet d’un dossier spécial en mars ?

La mort de Fernandel / Les 10 ans de Fukushima / La mort de Napoléon

En savoir plus

5. Combien de livres blancs ont été publiés en 2021 ?

Moins de 20 / 20 à 40 / Plus de 40

En savoir plus

6. Combien d’articles interactifs ont été publiés dans les ressources documentaires en 2021 ?

Entre 200 et 500 / Entre 500 et 700 / Plus de 700

En savoir plus

7. Dans la série d’Interviews vidéos “Innovantes”, de quoi nous parlait Julie Dautel en mars 2021 ?

Des méthodes de tests in vitro pour ne plus passer par l’animal / Des ballons d’hélium dans les réseaux de télécommunications / D’une solution digitale pour optimiser la déconstruction des bâtiments

En savoir plus

8. Qu’est-ce qu’une offre Doc&Quiz ?

Une offre intégrant des articles interactifs / Une entretien en ligne avec un médecin / Un jeu télévisé

En savoir plus

9. En quoi consiste la Veille personnalisée ?

Un flux d’actualité hebdomadaire sur les sujets de votre choix / Un maître-chien en bas de chez vous / Un économiseur d’écran

En savoir plus

10. Quel dessinateur nous réjouit chaque mois dans le dossier mensuel d’actu ?

Hub / AleyxRomarin / Inthym

En savoir plus

11. Quel est le sujet de la dernière conférence en ligne de l’année 2021, réalisée le 9 décembre en partenariat avec le Cetim ?

Découverte de la fatigue des matériaux / Les clés d’une intégration robotique réussie / Usinage Intelligent/connecté

En savoir plus

Le 18 février 2021, le célèbre rover se posait sur Mars, dans le cratère Jezero. Perseverance a également fêté par la même occasion le millionième tir laser réalisé sur Mars, il y a quelques jours. En effet, les deux rovers présents sur Mars, Curiosity et Perseverance, sont tous les deux équipés d’instruments lasers innovants – ChemCam pour Curiosity et SuperCam pour Perseverance – qui permettent aux deux engins de collecter un maximum de données sur la planète rouge. Perseverance a eu l’honneur du millionième tir, qui a été commandé à distance, au CNES. Cet évènement a également donné lieu à une table ronde, organisée par le CNES, que vous pouvez revoir ci-dessous :

A l’occasion du premier anniversaire de Perseverance, le site internet du CNES vous propose également un quizz, pour évaluer – ou améliorer – vos connaissances sur cette mission martienne d’ores et déjà couronnée de succès.

C’est un flash, repéré par une équipe d’astronomes australiens, qui intrigue le petit monde de l’astronomie depuis près de deux semaines. Ce signal radio, émis précisément toutes les 18 minutes et 11 secondes, provient du centre de la voie lactée, à plus de 4 000 années lumières de la Terre : il a été capté par l’un des télescopes les plus sensibles du monde, l’ASKAP.

Si les propriétés de ce signal – la lumière qu’il émet apparaît et disparaît de manière aléatoire – évoquent les caractéristiques de certains objets stellaires, comme des supernovae, des pulsars ou des étoiles à neutrons, les astronomes sont pour le moment incapables de conclure avec certitude sur la nature de ce signal. L’hypothèse qui tient la corde serait celle d’un magnétar à rotation lente – une étoile à neutrons dotée d’un champ magnétique très puissant – qui n’a à l’heure actuelle jamais été observé.

Pour en savoir plus, vous pouvez lire cet article, publié sur le site France 24. Deux experts du CEA expliquent que l’objet céleste observé est peut-être le plus vieux magnétar de notre galaxie.

Quoi qu’il en soit, les astronomes du monde entier s’accordent sur le fait que ce signal n’est en rien le prélude à une rencontre du troisième type.

La sonde chinoise Tiawen-1 a réalisé une photo inédite de Mars grâce à une perche à selfie, installée sur l’orbiteur, qui tourne autour de la planète rouge depuis plus d’un an. Ces images incroyables ne sont pas les premières envoyées par la sonde depuis qu’elle orbite autour de Mars. Ces clichés, pris le 31 janvier dernier, ont été publiés peu de temps après par l’agence spatiale chinoise.

Voici ces images en vidéos :

Le Huffingtonpost propose sur son site un quizz réalisé avec des photos prises par Thomas Pesquet lors de son récent séjour à bord de l’ISS. Saurez-vous reconnaître quel pays ou quelle ville se cachent derrière ces photos ?

Pour tenter votre chance, c’est par ici.

Par Pierre Thouverez

Le réchauffement climatique atteint déjà +1,1°C par rapport à l’ère préindustrielle. Les catastrophes naturelles se multiplient. Vagues de chaleur, méga-feux, inondations, sécheresses, cyclones s’intensifient partout dans le monde. Le GIEC estime que ces événements météorologiques et climatiques extrêmes entraînent déjà le dépassement des seuils de tolérance de certaines plantes et animaux. Cela provoque des mortalités massives chez des espèces telles que les arbres et les coraux. Selon les experts, entre 18 % et 30 % des espèces sont menacées d’extinction.

Le deuxième volet du sixième rapport d’évaluation du GIEC a été publié le lundi 28 février et il confirme qu’avec un réchauffement climatique de +1,5°C – objectif minimal de l’Accord de Paris – le monde affrontera déjà de multiples aléas climatiques inévitables au cours des deux prochaines décennies. Dès lors que le réchauffement dépassera ce seuil, même de façon « temporaire », le monde connaîtra « des impacts supplémentaires graves, dont certains seront irréversibles ». L’adaptation deviendra plus difficile à mesure que le monde se réchauffera. « Dans certaines régions, ce sera impossible si le réchauffement climatique dépasse 2°C », prévient le GIEC. À +3°C, ces aléas atteindraient une intensité « intolérable », selon Gonéri Le Cozannet, co-auteur du rapport.

« L’adaptation progresse en Europe, mais demeure insuffisante face à la rapidité des changements », prévient Gonéri Le Cozannet. Le GIEC identifie ainsi quatre risques majeurs pour l’Europe. Tout d’abord, même en limitant le réchauffement climatique à +1,5°C, les vagues de chaleur causeront la mort de 30 000 personnes par an en Europe. À 3°C, le nombre de décès pourrait tripler.

Côté agriculture, les rendements agricoles baisseront à cause des vagues de chaleur et des sécheresses. Dès +2°C, des pénuries d’eau toucheront plus d’un tiers de la population dans le sud de l’Europe. À +3°C, le manque d’eau limitera l’irrigation.

Un dernier risque majeur identifié concerne les inondations côtières. Elles seront dix fois supérieures d’ici la fin du siècle, juge le GIEC. La hausse du niveau des mers représente ainsi une menace pour les communautés côtières et leur héritage culturel au-delà de 2100.

Face à ces risques, le groupe d’experts souligne l’urgence à mettre en place une action climatique axée sur l’équité et la justice, dotée d’un financement suffisant, un transfert de technologies et un engagement politique fort.

Le GIEC identifie ainsi trois leviers d’adaptation majeurs. D’abord, la protection de 30 à 50 % des habitats terrestres, d’eau douce et océaniques de la Terre. « En restaurant les écosystèmes dégradés et en conservant efficacement et équitablement 30 à 50 % des habitats terrestres, d’eau douce et océaniques de la Terre, la société peut bénéficier de la capacité de la nature à absorber et à stocker le carbone, et nous pouvons accélérer les progrès vers le développement durable, mais un financement et des politiques adéquats de soutien sont essentiels », affirme le coprésident du Groupe de travail II du GIEC, Hans-Otto Pörtner.

Ensuite, le GIEC insiste sur la nécessité de planifier au plus vite les travaux d’adaptation nécessaires pour faire face à des catastrophes climatiques plus fréquentes et plus violentes, notamment dans les villes côtières. Enfin, il souligne l’importance d’augmenter les moyens de la finance climatique et que les pays développés aident financièrement les pays les moins avancés.

Les véhicules micro-air à ailes battantes sont des robots capables de pénétrer dans des espaces confinés difficiles d’accès, comme l’intérieur d’une usine ou d’un bâtiment effondré. Ils ont l’avantage d’être très manœuvrables et de résister aux diverses perturbations qu’ils peuvent rencontrer. Seul point noir au tableau : la nécessité d’un système de transmission entre les actionneurs et les ailes. De l’énergie est alors perdue, en plus d’un apport de masse supplémentaire qui gêne les performances du robot. Une équipe de la Faculté d’Ingénierie de l’Université de Bristol pourrait avoir trouvé la solution au problème… chez les abeilles ! Leur nouveau système de battement, présenté le 2 février 2022 dans Science Robotics, déclenche le mouvement des ailes à la racine par l’application directe de forces électrostatiques à amplification liquide. Donc plus besoin de transmission. Après plus d’un million de cycles de tests réalisés avec un système de la taille d’une libellule, le dispositif ne montre pas de défaillance et délivre une puissance moyenne de 124 W/kg – avec des pics à 200 W/kg. Soit une puissance équivalente à celle retrouvée chez les oiseaux, et supérieure aux mammifères ou aux insectes ! À l’avenir, le travail des chercheurs de Bristol pourrait aider à l’exploration sur de longues durées, à la vérification de stations éoliennes off-shore, ou encore à des missions de reconnaissance et sauvetage.

La détection douce pourrait prochainement révolutionner le monde des appareils portables à interfaces tactiles, ainsi que les systèmes robotiques. Mais avant cela, cette technologie devra relever de nombreux défis. Son déploiement est par exemple entravé par sa faible résilience et sa forte demande énergétique. C’est dans ce contexte qu’un nouvel hydrogel gélatine-glycérol ionique a été mis en avant le 18 février 2022 dans NPG Asia Materials. Fabriqué à l’aide d’une imprimante 3D, l’appareil conçu par des chercheurs de l’Université de Cambridge a la particularité de contenir du chlorure de sodium (du sel) plutôt que l’encre de carbone habituelle. Le sel a l’avantage d’être soluble dans l’hydrogel, permettant un canal uniforme pour la conduction ionique. Accessible, simple à usiner, biocompatible et également biodégradable, l’hydrogel gélatine-glycérol est désormais capable de s’autoréparer à température ambiante – alors qu’il fallait le chauffer au préalable. Il est prévu pour réaliser des relevés de tension, d’humidité et de température. Son emploi futur pourrait se trouver du côté des peaux, mains et autres bras artificiels.

Les substances psychotropes peuvent poser des problèmes de santé publique, de par leur effet analgésique voire euphorisant, et les opioïdes n’y font pas exception. Alors que tester les individus personnellement porterait atteinte à la vie privée de chacun, un groupement de chercheurs issus du Boston College, de la Boston University et des Giner Labs a préféré se focaliser sur les eaux usées pour évaluer la quantité et le type de drogues consommées par une communauté. Pour cela, ils ont travaillé sur une analyse quantitative à partir d’un capteur basé sur le graphène, cette feuille de carbone d’un atome d’épaisseur. De la taille d’un penny, le capteur portable se compose d’une plate-forme en graphène ponctuée d’aptamères – des brins d’ADN façonnés de manière à s’attacher à des molécules bien spécifiques (ici les opioïdes). Lorsqu’une substance psychotrope s’accole à l’un de ces brins, ce dernier se plie, ce qui a pour conséquence d’augmenter la charge électrique parcourant la plate-forme. Cette modification du courant est lue facilement via des signaux électroniques issus de chaque aptamère. Décrit en détail dans ACS Nano le 24 février 2022, le capteur biologique promet de détecter simultanément jusqu’à trois opioïdes différents. Lors d’un test réalisé sur des eaux usées diluées 20 fois, les scientifiques sont ainsi parvenus à relever des traces de noroxycodone, d’EDDP et de norfentanyl. Par la suite, le capteur pourrait permettre d’effectuer des tests rapides d’infections virales à domicile ou de vérifier la présence de pathogènes dans les eaux usées.

En 2019, 19 personnes ont trouvé la mort et 15 ont été gravement blessées à un passage à niveau en France. 98 % de ces accidents sont dus au non-respect du code de la route, à une vitesse d’approche excessive ou à des comportements à risque, indique la SNCF.

L’Hexagone compte 15 405 passages à niveau. Certains sont considérés comme étant prioritaires à sécuriser et ont été inscrits au programme de sécurisation national (PSN), programme défini par l’État et l’instance nationale des passages à niveau (INPN) en 1997.

Différentes pistes avaient été annoncées en 2019 par le gouvernement :

Et si la France s’inspirait des tests menés en Suisse ? La société de transports publics à Bâle, Baselland Transport AG, expérimente une solution de Nokia reposant sur l’analyse vidéo alimentée par l’IA.

Baptisé Scene Analytics, elle combine des capacités d’apprentissage automatique (machine learning) et de vision par ordinateur pour permettre une analyse en temps réel des flux vidéo. La solution peut être entraînée sur des données de vidéosurveillance pour apprendre ce qui est « normal » ou anormal.

Installées près d’un passage à niveau, des caméras envoient des alertes instantanées avec des aperçus, des clips et d’autres données pertinentes qui aident les équipes de Baselland Transport AG à établir des priorités et à résoudre le problème.

Afin de préciser le contexte, cette solution détecte le type d’objet. Des enregistrements vidéo basés sur les événements et les données associées sont stockés, ce qui permet une analyse médico-légale post-incident.

Mais ce dispositif de Nokia ne sert pas uniquement à réduire les risques d’accident à ces carrefours très dangereux. Cette solution de Nokia pourrait être également déployée dans des ports maritimes afin d’améliorer l’intégrité opérationnelle et la sécurité grâce à l’analyse vidéo qui permet de localiser et d’identifier les conteneurs et d’optimiser le mouvement des marchandises dans le chantier.

Autre application : la détection des véhicules trop bruyants. Depuis début 2022, la France a installé son premier radar sonore dans le parc de la Haute Vallée de Chevreuse. La Belgique expérimente une autre voie, celle de Scene Analytics. La ville de Genk teste ce dispositif pour mesurer les niveaux de bruit excessifs dans l’une de ses rues commerçantes.

Nokia exploite les données récupérées auprès de microphones et de caméras installés le long de cette rue. Un système de reconnaissance automatique des plaques minéralogiques permet d’identifier un véhicule qui dépasserait un seuil prédéterminé.

Reste à espérer qu’il n’y ait pas de dérives comme à Orléans et ses détecteurs de sons « anormaux »…

Créée en 2017, la start-up grenobloise ROSI Solar va construire sa première usine de recyclage de panneaux photovoltaïques en Isère. L’investissement fait suite à un premier contrat décroché dans le cadre d’un appel d’offres lancé par Soren, l’éco-organisme qui gère en France la filière de collecte et de traitement des modules arrivés en fin de vie. Cette unité industrielle devrait être mise en service à la fin de l’année et traiter environ 2 000 tonnes par an, soit l’équivalent d’environ 100 000 panneaux. Son principal enjeu est l’extraction de métaux à forte valeur, tels que le silicium avec un volume attendu d’environ 60 tonnes, mais aussi du cuivre (20 tonnes) et de l’argent (2 tonnes).

Recycler des panneaux solaires est une opération complexe à mettre en œuvre ; ceux-ci sont protégés par une feuille en verre sur la face avant, et par un polymère très résistant aux intempéries à l’arrière. L’ensemble est collé par d’autres polymères, formant un encapsulant. En partenariat avec le laboratoire de recherche SIMAP (Science et Ingénierie des Matériaux et Procédés), ROSI Solar a développé deux procédés de recyclage. Le premier repose sur un traitement thermique par pyrolyse afin de dégrader les polymères en les évaporant et ainsi extraire le verre et les différents métaux.

Cette première étape a pour but d’accéder aux cellules photovoltaïques, qui représentent moins de 5 % de la masse des panneaux solaires, mais contiennent les métaux à forte valeur.

Le second procédé consiste à réaliser un traitement chimique, et permet notamment de séparer les fils d’argent présents à la surface des cellules et le silicium. Contrairement à l’hydrométallurgie, une technique qui consiste à dissoudre les fils d’argent puis à les déposer par électrolyse sur des anodes, le procédé développé est capable de recycler directement ce métal précieux et non des atomes d’argent dissous.

« De nombreuses personnes tentent de développer l’hydrométallurgie, mais ce procédé coûte cher et est difficile à gérer sur le plan environnemental, car il utilise des acides forts, analyse Antoine Chalaux, directeur commercial de ROSI Solar. L’avantage de notre technologie est qu’elle repose sur de la chimie douce et non agressive. Elle est plus simple à mettre en œuvre, car on s’attaque au point de liaison entre l’argent et le silicium et l’opération est réalisée dans une solution dédiée. Afin de rentabiliser notre unité industrielle, il y a un très fort intérêt à récupérer ces fils d’argent, car même s’ils ne représentent que 0,1 % de la masse totale des modules, ils constituent 50 % de leur valeur. »

Alors que les usines de recyclage actuellement en fonctionnement reposent essentiellement sur des procédés de broyages ou de concassage, avec pour objectif principal de récupérer le verre qui représente 70 % de la masse des modules, l’ambition de ROSI Solar est de recycler au minimum 80 % des différents constituants des panneaux. L’entreprise a déjà testé ses deux procédés à l’échelle un dans un bâtiment accolé au laboratoire SIMAP.

Dans le cadre de l’appel d’offres de Soren, la première étape du recyclage va être confiée à Envie 2E Aquitaine, entreprise filiale d’Envie, une fédération d’insertion par le travail. Ce prétraitement sera automatisé et réalisé grâce à une technologie développée au Japon et consistant à racler, à l’aide d’un couteau, le verre pour enlever la partie polymère. Il permettra de recycler le verre, le cadre en aluminium et les câbles. « Notre unité industrielle sera flexible et, dans un premier temps, ce flux prétraité constituera le principal entrant de notre ligne de production en Isère, précise Antoine Chalaux. Mais nous souhaitons très rapidement recycler plus de volume, avec l’objectif d’atteindre 10 000 tonnes, et de traiter des panneaux entiers venant de pays limitrophes. »

Une fois extraits, le cuivre et l’argent subiront des étapes de raffinage avant d’être vendus sur le marché comme un produit standard. Enfin, ROSI Solar compte travailler en partenariat avec un chimiste allemand afin de valoriser le silicium – qui demande un retraitement plus complexe – auprès de l’industrie. « Le recyclage des modules est important pour que l’image du photovoltaïque soit au niveau des enjeux de la production d’électricité renouvelable en France et en Europe, déclare Antoine Chalaux. Et il est important que les usines de recyclage soient rentables pour que la filière n’ait pas à payer au prix fort la gestion des panneaux usagés. »

Co-organisé avec l’AFTPVA (Association Française des Techniciens des Peintures, Vernis, encres d’imprimerie, colles et Adhésifs) et en partenariat avec la FIPEC (Fédération des Industries des Peintures, Encres, Couleurs, Colles et adhésifs, Préservation du Bois), l’événement assure la rencontre des industriels de l’amont et l’aval pour construire ensemble un avenir eco-responsable.

Cette année, le salon dédié à la production et à la formulation de peintures, vernis, encres d’imprimerie et autres, vous accueille pour vous permettre d’aller à la rencontre de plus de 200 fournisseurs producteurs et distributeurs de revêtements, d’équipements et de services avec les fabricants de coatings et applicateurs, durant 3 jours entiers.

Si vous recherchez des technologies innovantes pour la production de vos produits et la formulation, alors cet événement est fait pour vous !

Vous y retrouverez des matières premières, ingrédients biosourcés, pigments, solvants, polymères, résines… portés par les sociétés leaders du marché, les start-up les plus novatrices qui représentent les fournisseurs français et internationaux du secteur.

Et si vous êtes plutôt en quête d’optimisation de vos équipements de production, mixeurs, broyeurs, machines à teinter, emballages… Eurocoat vous offre un large panel d’équipements pour améliorer vos process, gagner en efficacité de production et être à la pointe de l’innovation dans vos laboratoires.

Retrouvez des activités pour élargir vos connaissances :

Si vous souhaitez en savoir plus sur cet événement, rendez-vous directement sur le site https://www.eurocoat-expo.com/

Après avoir développé un capteur permettant de suivre à distance le niveau de remplissage de présentoirs destinés à la presse papier, Heyliot s’est finalement tournée vers un marché particulièrement porteur : celui des déchets. Grâce à son capteur connecté baptisé Heywaste, l’entreprise propose à ses clients de mesurer en continu le niveau de remplissage de leurs conteneurs de déchets. Transmises sur une plate-forme via les réseaux sans fil LoRaWAN (protocole de communication radio utilisé en IoT¹) ou SigFox (un opérateur télécom français de l’IoT), ces données sont ensuite analysées pour permettre l’envoi d’alerte et la génération de rapports. Compact et doté d’une autonomie de plusieurs années, le capteur développé par Heyliot est entièrement conçu et fabriqué localement. Son co-fondateur et actuel PDG, Cyri Pradel, nous en détaille la genèse, le fonctionnement et les différents intérêts.

Cyril Pradel : L’idée est née courant 2016. Avec mon ami Loïc Coeurjoly, nous avions tous les deux fait ce constat que beaucoup d’objets connectés faisaient leur apparition, mais qu’ils étaient en général très orientés « grand public ». Nous étions surpris de constater qu’il y avait finalement assez peu de produits pour les entreprises. L’un comme l’autre, nous travaillions dans les télécoms en B2B et nous avons eu cette intuition que la donnée devait aussi profiter aux entreprises. C’est avec cette idée en tête que nous avons cherché un problème à résoudre.

Le premier problème que nous avons trouvé nous est apparu pendant une soirée au cours de laquelle nous avons rencontré un éditeur de presse. Il mettait, à l’époque, à disposition dans des présentoirs des journaux et magazines immobiliers. Il nous a fait part, au détour d’une conversation, de sa difficulté à gérer ces présentoirs : les livreurs passaient toujours les remplir soit trop tôt, soit trop tard. Et surtout, il n’arrivait pas à avoir d’indicateurs sur la qualité de sa diffusion. Nous sommes donc partis de ce problème-là en cherchant une solution permettant de voir à distance le niveau de remplissage des présentoirs de journaux.

Nous avons commencé avec des petits prototypes basés sur des Arduino [plateforme de prototypage open-source, NDLR] et Raspberry [Raspberry Pi est un nano-ordinateur monocarte, NDLR]. Nous avons ensuite pu tester notre produit sur le marché avec un de nos premiers clients. Il s’agissait à l’époque d’un prototype encore très volumineux, communiquant avec une carte SIM sur le réseau GSM [pour « Global System for Mobile Communications », le standard numérique de seconde génération pour la téléphonie mobile, NDLR]. Ça n’était clairement pas exploitable à long terme. Mais cela nous a prouvé que l’on pouvait répondre au besoin.

Cette première version nous permettait simplement de savoir si le présentoir était plein ou vide… C’était très binaire. Nous avons alors commencé à discuter avec 20 Minutes, Ouest-France, Logic-Immo… Ces interlocuteurs souhaitaient quasiment connaître le nombre exact de journaux en temps réel, ainsi que le nombre d’exemplaires pris en main sur différentes périodes d’une journée. Nous sentions que nous tenions une idée. Nous avons donc décidé de rejoindre le Pôle Startups, un incubateur ouvert par Canon à côté de Rennes, qui proposait de mettre à disposition ses compétences d’ingénierie mécanique et électronique pour accompagner des porteurs de projets. Nous avons ainsi pu sortir un premier capteur, qui se plaçait au-dessus du présentoir de journaux et qui permettait de savoir très précisément combien d’exemplaires étaient disponibles.

Nous avons ensuite pivoté, changé de marché : nous nous sommes rendu compte que, malheureusement, le marché de la presse papier était compliqué. Nous avons donc préféré nous orienter vers le marché des déchets.

Le constat de base a tout simplement été celui du déclin du marché de la presse papier. Nous avons donc réfléchi à ce que nous avions construit : une solution permettant de suivre à distance le niveau de remplissage d’une boîte. Nous avons donc prospecté autour de nous, en cherchant à savoir quelles seraient les boîtes que l’on pourrait surveiller à distance. Nous avons vu des possibilités dans la logistique, dans le retail, dans l’agriculture… Mais nous avons finalement trouvé un intérêt plus particulier au marché des déchets : nous avions cette volonté de faire quelque chose de positif, d’apporter notre technologie pour améliorer un peu le monde autour de nous. Or, appliquée aux déchets, notre solution avait l’avantage de permettre d’économiser des tournées de ramassage, donc du carburant mais aussi du temps humain.

Aujourd’hui, le capteur fait 170 grammes, mesure un peu moins de 20 centimètres de longueur. Il est basé sur une architecture STM32. Le capteur de mesure en tant que tel est basé sur la technologie Time of flight (ToF ou « caméra temps de vol ») qui envoie des photons et mesure le temps qu’ils mettent à revenir. Quant à la transmission des données, nous utilisons un module bi-mode proposé par Nemeus qui nous permet de transmettre tantôt sur le réseau LoRaWAN, tantôt sur SigFox selon les conditions radio sur place.

Nous ne voulions pas faire de compromis sur les réseaux que nous allions utiliser. Par chance, nous avions à côté de chez nous cette entreprise, Nemeus, qui avait développé le premier module bi-mode IoT au monde, qui permettait donc de communiquer à la fois sur le réseau LoRaWAN et sur le réseau SigFox. Cela nous a fortement intéressés, nous sommes donc allés les voir et nous avons travaillé conjointement à la conception de ce capteur. L’intérêt des réseaux que nous avons choisis est qu’ils utilisent des basses fréquences, avec de longues portées. Aujourd’hui, nous nous apercevons que nous n’avons ainsi quasiment pas de problèmes de couverture. Fin décembre 2021, nous avons par exemple installé des capteurs dans des conteneurs situés au pied du Mont-Blanc, dans une zone assez encaissée, et pourtant notre parc d’une centaine de capteurs fonctionne très bien.

Nous sommes très, très fiers de la fabrication entièrement bretonne de notre capteur. Nous avions toutes les entreprises nécessaires à proximité ! Un bureau d’étude mécanique à dix minutes de chez nous, notre fabricant-intégrateur, Ouestronic, se trouve également dans notre région. Les boîtiers plastiques sont quant à eux produits en Auvergne.

Nous avons opté pour une pile, remplaçable facilement. Sur un cycle classique, qui consiste en une mesure par heure, et un envoi des données toutes les quatre heures, elle tient entre quatre et cinq ans. Nous avons beaucoup travaillé sur l’aspect low power du capteur. De plus, nous utilisons les voies descendantes des réseaux IoT pour envoyer une information à notre capteur, typiquement la reconfiguration des timings de mesure. Nous cherchons à optimiser la durée de vie de cette pile, en étant capables d’adapter le cycle de mesures en fonction de la sollicitation des points d’apport de déchets. Un point au bout d’une route ne sera pas forcément aussi sollicité qu’un point situé en plein centre-ville…

Nous avons pu le tester sur différents flux de déchets : ordures ménagères, emballages, verre, textile, pneus… Nous avons même fait des essais sur des cuves de méthaniseur. Nous avons été surpris de voir que le capteur était même capable de mesurer des niveaux d’eau, chose qui est normalement assez compliquée. La seule limite reste les environnements ouverts, en plein soleil, ce qui n’est généralement pas le cas pour les conteneurs de déchets.

Le gros du travail consiste à traiter ce signal brut, qui arrive sur une plate-forme que nous avons développée. Nous avons en effet fait en sorte d’embarquer le minimum d’intelligence nécessaire dans le capteur pour éviter la surconsommation d’énergie. Tout le traitement des mesures brutes est donc déporté sur la plate-forme. Son rôle est de calculer, grâce à un algorithme, le niveau de remplissage d’un conteneur à partir de ses dimensions. Nous avons également des algorithmes qui travaillent à lisser les courbes, pour faire en sorte que les mesures présentées à nos clients soient des mesures qualifiées. Cela permet de leur présenter l’état de leur parc, avec un système de cartographie présentant l’ensemble des points selon un code couleur qui est fonction du remplissage. Le client a aussi la possibilité d’être alerté si un contenant dépasse un certain niveau de remplissage.

Certains clients souhaitent également planifier leurs tournées. Par exemple : effectuer le ramassage de tous les conteneurs d’emballage situés dans un périmètre donné et remplis à plus de 60 %. La plate-forme va alors leur fournir une liste de tous les points concernés, une sorte de feuille de route pour le chauffeur du camion de ramassage.

La plate-forme a la capacité de générer des rapports avec des indicateurs clés, comme le niveau moyen de remplissage avant collecte. C’est un aspect que nos clients regardent de près, en cherchant à se rapprocher des 80, 90 %. J’ai constaté cela en rencontrant un collecteur, qui passait auparavant les deux tiers de son temps à stationner, sortir du camion, simplement pour vérifier le niveau du conteneur. C’est du temps perdu, et des émissions polluantes évitables…

C’est fortement souhaitable ! Nous travaillons avec quelques collectivités qui sont des figures de proue de l’open data, Rennes notamment. Nous avons déjà aujourd’hui des modules qui permettent à nos clients d’accéder à leurs propres mesures (nous ne sommes pas propriétaires de la donnée), mais également, grâce à notre API², de communiquer avec des logiciels tiers, notamment des plates-formes d’open data, qui permettent d’indiquer aux usagers le niveau de remplissage des conteneurs.

Nous en sommes aujourd’hui à environ 1 800 capteurs. Nous avons globalement deux segments de clientèle, le premier étant les collectivités, le second les entreprises privées. Les collectivités ont souvent des besoins autour de la résolution des problèmes de propreté dus à des débordements. Cela peut notamment être lié à des phénomènes de saisonnalité, comme c’est le cas, par exemple, à La Rochelle, qui connaît une forte affluence l’été.

Nous travaillons aussi sur des points d’apport éloignés, difficiles d’accès, comme au pied du Mont-Blanc. Un autre exemple est celui de la communauté de communes du Pays-de-Mortagne, un territoire très vaste, sur lequel il faut optimiser le ramassage des conteneurs en évitant les déplacements inutiles.

En ce qui concerne les entreprises privées, nous avons soit des clients directs, qui font eux-mêmes leurs collectes de déchets et qui veulent les optimiser à la manière des collectivités, mais aussi des entreprises qui travaillent pour des collecteurs, des personnes qui font de la propreté en entreprise…

Les réseaux de transmission que nous utilisons nous permettent de passer facilement les frontières. Nous avons ainsi déjà quelques capteurs en Suisse, en Belgique, en Espagne, ainsi qu’aux Pays-Bas. Nous avons pour objectif, en 2022, de déployer un peu plus de 7 000 capteurs.

Nous vendons le capteur 129 €, prix d’entrée sans achat en volume. Un abonnement à 5 € par mois et par capteur intègre ensuite toute la connectivité et l’accès à la plate-forme, avec l’ensemble des fonctionnalités : alertes, rapports…

Nous avons plutôt vocation à rester sur le secteur des déchets. En revanche, nous allons continuer à améliorer le capteur, à le rendre plus résistant, plus communicant aussi. On voit bien aujourd’hui que la capacité du capteur à prendre beaucoup plus de mesures par jour que nos concurrents est un avantage. Quand eux se limitent à deux ou trois mesures quotidiennes, nous en prenons 20 à 30 fois plus, ce qui permet d’apprendre beaucoup plus de choses. Le tout avec la même consommation d’énergie. Nous allons maintenant développer la partie analyse des données, proposer un conseil plus poussé à nos clients.

Le capteur va aussi évoluer pour être compatible avec les nouveaux réseaux, notamment NB-IoT et LTE-M, qui font partie des nouveaux réseaux IoT arrivant dans plusieurs pays. Cela nous permettra, demain, de traverser encore plus de frontières et d’aller encore un peu plus loin avec le capteur.

(1) Internet of things, internet des objets

(2) Application Programming Interface