Avec le réchauffement climatique, les phénomènes physiques et chimiques de l’océan évoluent. Le rôle de « forêt océanique » du phytoplancton est bien connu, mais pourrait évoluer avec les changements à venir. Pour mieux comprendre le rôle du phytoplancton dans les océans, nous avons échangé avec Loic Le Ster, chercheur au centre d’études biologiques de Chizé à la Rochelle et au laboratoire d’océanographie de Villefranche (LOV). Il s’est spécialisé dans l’océanographie (l’interaction entre les phénomènes physiques dans l’océan et la biologie, la biogéochimie) et l’écologie marine (l’interaction entre les différents niveaux du réseau trophique, de la chaîne alimentaire, à travers l’étude des grands prédateurs comme les éléphants de mer). Ses recherches se focalisent sur l’océan polaire, plus spécifiquement en région Antarctique et océan Austral.

Techniques de l’Ingénieur : Pouvez-vous nous rappeler ce qu’est le plancton en général ?

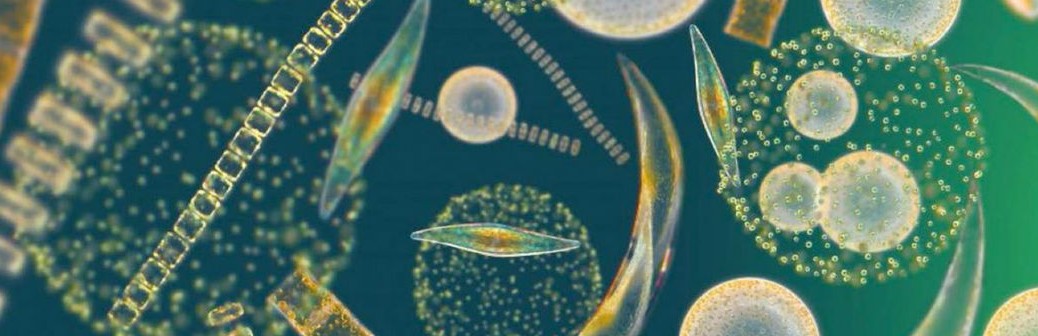

Loic Le Ster : Plancton vient du grec planctus, qui signifie errant. Ce sont des particules qui ne décident pas où elles vont, qui dérivent même si certaines sont dotées d’une motilité verticale (pour éviter les prédateurs ou capter la lumière, elles se meuvent plus ou moins profondément). Elles suivent les mouvements de l’eau. C’est ce qu’on peut voir lors de l’efflorescence (le bloom) de phytoplancton, qui est le plancton végétal. Il va apparaître dans une région, puis être transporté selon les courants et former des filaments, des tourbillons, etc.

Le plancton n’est pas un groupe taxonomique à proprement parler. Il a une diversité génétique immense et de nombreux embranchements sont représentés, depuis le phytoplancton (végétal) au zooplancton (animal). Il y a également d’autres groupements : le necton par exemple représente les larves de poissons qui sont des planctons pendant la phase larvaire, et ne le sont plus une fois adultes. Il existe également une série d’organismes comme les crabes qui ont cette phase larvaire. Et au niveau de la taille, on va du nanomètre pour le plus petit phytoplancton jusqu’à plusieurs mètres pour des salpes, des organismes gélatineux comme les méduses.

Le phytoplancton a un rôle important pour le climat…

Le phytoplancton est l’équivalent des forêts (amazonienne et continentales) dans l’océan. C’est-à-dire que celui-ci va faire de la photosynthèse, un processus qui consiste à créer du carbone organique en captant du carbone non organique venant de l’atmosphère. Les forêts océaniques comme terrestres sont cruciales dans le maintien de l’équilibre sur Terre. Sans elles, les taux de CO2 grimperaient beaucoup plus vite.

Le phytoplancton intervient dans la pompe à carbone, appelée également séquestration du carbone du haut vers le bas, c’est-à-dire exporte du carbone atmosphérique de la surface vers le fond. Le plancton de surface va grandir, capter du carbone, mourir ou être brouté par du zooplancton, et les pelotes fécales vont sédimenter, couler, et être piégées dans les profondeurs pendant des échelles de temps longues. Pas toutes, car une partie est remise dans la colonne d’eau, dans une boucle microbienne. C’est ce processus qui donne aux océans tout le poids dans la balance du changement climatique. Il y a aussi une pompe physique à carbone. Sans même l’intervention de la biologie, le carbone de l’atmosphère est dissous dans l’eau, va couler au fond et être piégé. On estime que les productions de CO2, à 87 % sont issues de la combustion pétrole et 13 % de la déforestation. 50 % vont rester dans l’atmosphère et 50 % seront absorbés (25 % par l’océan). Nous voulons savoir comment évolue le plancton avec le temps et les facteurs environnementaux (température et CO2).

Comment ?

Nous utilisons plusieurs technologies. Le robot profileur – un tube de deux mètres de haut – permet de récolter un certain nombre de paramètres grâce à des capteurs de lumière, d’oxygène, de température, de salinité et de fluorescence. Ces données donnent des indications sur l’état de l’eau au niveau physique et biogéochimique. La concentration de phytoplancton dans le milieu est mesurée à l’aide de petits fluorimètres composés d’un laser et d’un récepteur : en fonction de l’onde reçue, on sait à quel point l’eau est verte, concentrée en chlorophylle (le phytoplancton). Ce robot profileur a un comportement planctonique : il ne choisit pas où il va. Son cycle de vie est de 9 jours à 2 000 mètres, et il prend les mesures le 10e jour, lors de sa remontée. Arrivé en surface, il transmet les données, reçoit de nouveaux ordres et repart en dérive sous l’eau.

Son équivalent un peu plus piloté à distance est le glider. Il ressemble à un petit avion avec des petites ailes. Il va réaliser des montées et descentes plus fréquentes. Il sera déployé pendant un mois entier, pour être récupéré ensuite, car il demande plus de batterie. Si on veut par exemple le déployer dans l’océan Austral, il faut l’emmener en bateau. Et l’hiver… il n’y a pas de bateau, donc on n’a quasiment pas de prélèvement. En réalité, l’océan Austral est sous-échantillonné. La glace de mer, depuis les satellites, rend les masses d’eau invisibles. Sans parler des nuages. Les observations par satellites sont problématiques, c’est pour cela qu’on a besoin de robots.

Vous étudiez aussi les éléphants de mer…

Effectivement, nous réalisons des campagnes de terrain où on va placer une balise sur la nuque d’éléphants de mer. La balise pèse 500 g, pour une taille de 10 x 8 cm, et intègre les mêmes capteurs que les flotteurs, avec les contraintes qu’imposent la miniaturisation. Ce mammifère marin est intéressant car il a un comportement particulier : il a deux périodes dans l’année, une de mue et une de reproduction. Le reste du temps, il a une vie solitaire : il vit en mer, chasse. Il effectue environ 60 plongées par jour, et parfois jusqu’à 2 000 m de profondeur. Et dans des zones difficiles d’accès pour l’homme : près de la glace, sur la bordure du continent antarctique et les zones pélagiques au milieu de l’océan. Ainsi, il nous permet d’avoir une idée de ce qu’il se passe au niveau du phytoplancton et de la température. Il est également équipé d’un GPS, car à la base, on voulait en savoir plus sur lui : où va-t-il, quelles sont ses zones préférées, où chasse-t-il, etc., pour détecter des niches écologiques. Comme c’est un grand prédateur, il reflète l’état de santé de l’écosystème. S’il trouve à manger, cela signifie que tous les autres organismes de l’écosystème, vers la base du réseau trophique et du phytoplancton, vont être en bonne santé. Ces endroits, on les identifie bien, car il s’attarde dans ces zones.

Que vous permettent ces données ?

Les conditions climatiques ouvrent de plus en plus la porte vers l’Antarctique, pour l’exploitation des pêcheries et de la recherche. Ces animaux-là, comme les grands oiseaux et les manchots également, permettent d’avoir des données pour identifier des zones que l’on souhaiterait protéger, en tant qu’aire marine protégée, car on y estime une valeur écologique forte. Et on souhaite éviter au maximum qu’il y ait des développements technologiques dans ces zones-là. Une des missions du laboratoire est d’ailleurs de faire des suggestions lors de comités, et des propositions d’aire marine protégée. Comme lors du comité Antarctique qui s’est réuni en France en juin, pour présenter les résultats de recherche.

Quels sont justement les résultats de vos études ?

Dans le cadre du travail que j’effectue, il s’agit plutôt d’un résultat vers lequel on souhaite aller. À l’heure actuelle, les satellites montrent que l’océan Austral est plus vert qu’avant, c’est-à-dire qu’il y a plus de phytoplancton dans une majorité de zones, sans être homogène. Globalement, on pourrait l’interpréter par des zones plus chaudes dans lesquelles le phytoplancton serait favorisé. Il y aurait peut-être des stocks de phytoplancton dans cette région alors que d’autres s’appauvrissent, comme dans le nord-atlantique (mais c’est un constat beaucoup moins clair). En étudiant localement, on pourrait trouver des contradictions. Deuxième constat : la couche de mélange superficielle des océans semble s’approfondir au niveau global.

Nous souhaitons vérifier ces constats grâce aux données acquises par les éléphants de mer, en recroisant la correspondance entre notre profil vertical et les données satellites. C’est un résultat en suspend sur lequel on n’a pas de conclusion formelle. C’est là où on peut avoir des conclusions intéressantes sur in fine comment la pompe à carbone évolue – est-elle plus ou moins forte ? – et comment elle va nous aider en termes de considération climatique pour la suite. En plus, on ne sait pas s’il s’agit du même type de phytoplancton. On a de nombreuses espèces différentes, comme pour les arbres. Certains types de phytoplancton, bien qu’abondants, s’ils sont très légers participent de façon infime dans la pompe à carbone. D’autres organismes, comme les diatomées, avec une paroi cellulaire en silice, vont couler plus rapidement, donc ont une efficacité plus importante.

Sur 100 kg de carbone en surface (lors d’un bloom), entre 2 et 7 % vont être exportés au fond. 7 % pour le plus fort, et 2 % pour des espèces qui vont couler tellement doucement que la plupart va être reconsommée en surface. Nous devons vérifier et ne pas nous arrêter aux concentrations apparentes plus fortes. Il faut une grande prudence face à ces conclusions.

Vous vous focalisez plus sur l’océan Austral…

On se focalise sur les régions très productives : plutôt les zones froides. La zone nord-atlantique va être une zone très productive mais je la connais moins. Il y a des intensités régionales différentes. Les phénomènes qui lient la physique à la biologie sont dans chaque région un peu différents. L’océan austral a un rôle central dans les études climatiques car on estime qu’il représente 40 % du carbone absorbé au niveau mondial. Si on a une évolution à noter dans l’océan global, l’océan austral va peser dans l’évolution de l’export du carbone. Et c’est le seul qui connecte les océans : il effectue une boucle autour de l’antarctique et va être au contact des océans antarctique, indien et pacifique à la fois. Il a une place centrale.