Par Hubert Blatz

Stoneridge est un leader mondial dans le domaine des systèmes de caméra et de détection pour véhicules commerciaux et industriels. Les systèmes fabriqués par Stoneridge étant assemblés par collage, Stoneridge a décidé d’automatiser ses procédés, à la fois pour maintenir les standards de qualité du groupe et gagner en productivité.

Avant l’automatisation, les opérations de collage étaient manuelles, ce qui engendrait des variations dans les quantités de colle utilisées. Selon Tom Hafkamp, ingénieur logiciel chez Stoneridge, ces variations de poids pouvaient aller jusqu’à 10 % d’un collage à l’autre !

Or, depuis que Stoneridge a automatisé ses process, cette variation est retombée à seulement 1 %, ce qui est une très nette amélioration et un gage de stabilité pour la production : « Cette évolution a significativement augmenté la productivité et la durabilité de notre processus d’assemblage, avec moins de vérifications et ajustements. »

Par ailleurs, cette optimisation du collage a également permis de réduire les déchets d’adhésifs de 20 %.

Auparavant, les équipements devaient être calibrés tous les 100 produits, ce qui prenait chaque fois entre 5 et 8 minutes. De plus, pour chaque calibration, l’état était vérifié avant et après assemblage, tous les 5 produits. Pour la productivité, le bilan était donc sans appel : pour 400 produits assemblés, 80 mesures étaient nécessaires, ce qui représentait 45 minutes par jour !

Sur ce point, l’automatisation mais aussi le passage à des conditionnements plus grands ont eu un effet radical. Désormais une seule vérification est effectuée, à chaque pause, ce qui prend à peine 2 minutes quotidiennes.

Concrètement, le collage automatisé consiste à utiliser un équipement de dosage volumétrique alimenté par deux lignes d’alimentation, une pour chaque composant A et B. L’équipement choisi par Stoneridge est un système de dépose intégré LOCTITE® EQ RC 50 capable de déposer en points ou en cordons.

Deux pompes à rotor, reliées à un contrôleur, permettent ainsi un dosage précis du volume de chaque ligne. Après mélange à la bonne proportion, la colle est alors appliquée par un robot.

Selon Remco Broekhuizen, ingénieur commercial technique chez Henkel, Stoneridge a été informé des possibilités offertes suite à un séminaire en ligne sur cet équipement. « Nous avons organisé une démonstration et effectué un premier test de validation, après lequel Stoneridge a donné son accord. »

Mais en dehors des considérations techniques, pour Stoneridge, les solutions Loctite de Henkel sont une garantie de maintenir des normes de qualité les plus élevées. Leur collaboration va ainsi au-delà de la simple relation client-fournisseur, puisque Stoneridge et Henkel ont un partenariat d’excellence. Ce partenariat permet ainsi aux deux groupes d’innover ensemble, un exemple récent étant l’ajout d’une connexion Wi-Fi au système afin de faciliter l’envoi de notifications au technicien pour faciliter le suivi de production.

Copyright visuel de Une : Stoneridge/Henkel

À quand des comprimés pharmaceutiques personnalisés ? Peut-être pour bientôt grâce à la fabrication additive. Cette technique a le double avantage de proposer de multiples libertés de design associées à un contrôle du dépôt de matériau au niveau du voxel individuel. Le terme voxel est issu de la contraction de « volume » et de « pixel », ce dernier étant lui-même tiré de la contraction de « picture » et de « element ». En bref, le voxel est à la 3D ce que le pixel est à la 2D. L’impression 3D par dépôt offre une précision jusque dix fois supérieure à celle par extrusion – de 10 à 80 μm contre 100 à 800 μm – pour des matériaux multiples. Autrement dit, ce type d’impression ouvre la porte à l’intégration au sein de comprimés de doses médicamenteuses optimales avec des taux de libération sur mesure. Le tout usinable en grands volumes de production. Reste « simplement » à trouver la bonne recette… que des chercheurs anglais pourraient bien avoir trouvée !

Geoffrey Rivers, professeur assistant à l’université de Nottingham (Angleterre), est le premier auteur d’un article paru courant mai 2024 dans le journal Materials Today Advances. Aidé de ses collègues du Centre de fabrication additive et de l’École de pharmacie de l’université, le professeur a démontré la faisabilité de la co-impression au sein d’une même enveloppe de deux matériaux différents – l’un hydrosoluble, et l’autre non. Pour en arriver là, les scientifiques ont d’abord recherché des polymères hydrosolubles biocompatibles pouvant servir d’excipients, c’est-à-dire de substances capables d’incorporer les principes actifs du médicament. Ils se sont alors tournés vers le poly-ACMO (poly-4-acryloylmorpholine), à la fois hydrosoluble et photodurcissable, qu’ils ont couplé à de l’aspirine pour jouer le rôle de monomère insoluble. Une fois l’impression réalisée, la pilule-test a été durcie sous une lumière ultraviolette pour donner un comprimé de 5 millimètres de diamètre pour 1 millimètre de hauteur.

En poursuivant sur leur lancée, Geoffrey Rivers et ses collègues de Nottingham ont décidé de varier les morphologies de leurs comprimés dans le but de contrôler la libération du médicament chez le patient. En effet, le taux de libération des agents thérapeutiques est déterminé par la surface de l’objet. Le disque, la couronne, ou encore la couronne insoluble pourvue d’un cœur hydrosoluble comptent parmi les formes testées par l’équipe scientifique. Les chercheurs sont ainsi parvenus à étendre leur gamme de taux de libération avec des courbes de dissolution lentes (0,98 +/- 0,04 mg/min), rapides (4,07 +/- 0,25 mg/min) et même multi-étapes (2,17 +/- 0,04 mg/min, puis 0,70 +/- 0,13 mg/min). Ces résultats laissent présager de la viabilité de futurs dosages solides personnalisés à l’aide de tels « polycomprimés », que ce soit dans le cadre de la santé humaine comme de la médecine vétérinaire.

Pour notre dossier de mai, « Les batteries en quête de disruption technologique », voici les thèses sélectionnées par le REDOC SPI. Retrouvez le résumé de ces thèses ainsi que les thèses des mois précédents sur le site de notre partenaire.

Amélioration de la méthodologie de prédiction de durée de vie des batteries de véhicules électriques

Marc Haber

Thèse de doctorat en physique des matériaux, soutenue le 09/01/2023

Laboratoire d’innovation pour les technologies des énergies nouvelles et les nanomatériaux (CEA Liten)

Ρrοnοstic des batteries lithium en utilisant l’intelligence artificielle

Abdelilah Hammou

Thèse de doctorat en Génie électrique, soutenue le 14/09/2023

Laboratoire universitaire des sciences appliquées de Cherbourg

Maintenance prévisionnelle des batteries lithium-ion dans les véhicules électriques à base d’apprentissage automatique

Inès Jorge

Thèse de doctorat en Informatique, soutenue le 24/11/2023

Laboratoire des sciences de l’ingénieur, de l’informatique et de l’imagerie

Étude de la formation de SEI dans les batteries Li-ion à l’aide de nouvelles approches basées sur la XPS in situ

Federico Giovanni Capone

Thèse de doctorat en Physique et chimie des matériaux soutenue le 05/04/2024

Synchrotron SOLEIL

Fabrication par impression jet d’encre d’électrodes 3D pour les nouvelles batteries Li-ion : opportunités et défis

Kinga Sztymela

Thèses de doctorat en Matériaux céramiques et traitements de surface, soutenue le 25/09/2023

Institut de Recherche sur les CERamiques

Contrôle et gestion optimale des centrales hybrides hydroélectriques couplées aux batteries pour une meilleure flexibilité dans les systèmes électriques du futur

Stefano Cassano

Thèses de doctorat en Énergétique et génie des procédés, soutenue le 27/09/2023

Centre Procédés, Énergies Renouvelables et Systèmes Énergétiques

Utilisation des MOFs (metal organic frameworks) comme nouveaux précurseurs pour les matériaux de batterie Li-ion

Anna-Caroline Lavergne Bril

Thèse de doctorat en Matériaux, mécanique, électrochimie, génie civil, soutenue le 19/07/2023

Laboratoire des composants pour l’énergie

Des nouveaux matériaux pour des batteries sans métaux

Valentin Gouget

Thèse de doctorat en Matériaux, mécanique, électrochimie, génie civil, soutenue le 21/09/2023

Laboratoire d’innovation pour les technologies des énergies nouvelles et les nanomatériaux (CEA Liten)

Vers un nouveau concept de batterie protonique

Ekaterina Kurchavova

Thèse de doctorat en Chimie Physique, soutenue le 13/10/2023

Laboratoire de réactivité de surface

Vers la réversibilité des carbones fluorés en batterie

Marie Colin

Thèse de doctorat en Chimie des matériaux, nanomatériaux et procédés, soutenue 18/10/2023

Institut de Chimie de Clermont-Ferrand

Un extrait de «Batteries électriques pour applications portables et embarquées – Technologies » par Serge PÉLISSIER, Ali SARI et Pascal VENET

Compte tenu de la diversification des équipements, choisir une technologie d’accumulateur pour une application donnée mobilise des connaissances et des informations multiples. Chaque famille d’accumulateurs présente en effet des spécificités au niveau des caractéristiques en puissance ou en énergie. De plus, les conditions d’usage diffèrent d’une technologie à l’autre.

Les accumulateurs NiCd affichent de meilleures performances que celles des batteries au plomb, permettant leur essor depuis les années 1960, toutefois freiné par leur prix plus élevé.

Ils peuvent accepter des courants de décharge importants et fonctionnent dans une large plage de température. Par ailleurs, plus la tension de fin de décharge est faible, et plus la capacité déchargée peut être élevée. Toutefois, on constate l’apparition d’un effet mémoire ; ainsi, une cellule soumise à plusieurs cycles de décharge/recharge partiels sans être déchargée complètement perd de sa capacité.

Remarquables en termes de durée de vie et de fiabilité, ces batteries sont toujours employées de nos jours, mais leur utilisation est interdite en Europe en raison de la toxicité du cadmium qu’elles contiennent.

Ces batteries, dont la commercialisation a débuté, dans les années 90, présentent une densité d’énergie supérieure aux accumulateurs NiCd.

Cependant, du fait de ces dégagements gazeux qui peuvent survenir en fin de charge ou de décharge, la conception des batteries NiMH doit intégrer des dispositifs limitant les surpressions. Par ailleurs, le couple NiMH est plus énergétique et présente un auto-échauffement plus important. Le protocole de charge intègre donc une surveillance de la variation de la température associée à un dispositif de coupure pour limiter l’aspect exothermique. L’accumulateur NiMH supporte les décharges profondes grâce à la recombinaison, au niveau de l’électrode positive, de l’hydrogène qui se dégage. Mais, il n’est pas conseillé de pratiquer cette situation, car toute l’énergie électrique est transformée en chaleur.

Comparé aux batteries NiCd, la tension en fin de charge est moins élevée pour les NiMH, mais leur échauffement plus important impose des modes de charge différents, qui impose la surveillance du gradient de température de l’accumulateur. Les courants de décharge peuvent aller jusqu’à 12C et fonctionnent dans une large plage de température. Néanmoins, un stockage long est à proscrire au-dessus de 45 C°.

Les accumulateurs lithium-métal polymère peuvent posséder de très bonnes performances, mais l’utilisation d’électrode négative en lithium métal pose aujourd’hui de gros problèmes de sécurité et de durée de vie, compte tenu de la formation de dendrites de lithium pouvant perforer le séparateur et donc engendrer un court-circuit. Pour éviter ces risques, on peut utiliser un électrolyte polymère qui constitue un obstacle aux courts-circuits.

Les accumulateurs lithium-ion (Li-ion), quant à eux, sont constitués d’une électrode négative utilisant un composé d’insertion à la place du lithium métallique. Chaque type de chimie de batterie lithium-ion possède des caractéristiques propres, leurs caractéristiques (tensions nominale, minimale et maximale, régime de courant, durée de vie, densité d’énergie, etc.) peuvent donc être différentes. De plus, l’utilisateur des accumulateurs doit respecter une plage de températures. Mais, les valeurs basses de température engendrant plusieurs phénomènes, une valeur de température limite est fixée par les constructeurs.

Des dispositifs de surveillance s’imposent par ailleurs afin de garantir le respect des limites de tension et de température. Enfin, la sécurité de leur fonctionnement dépend du choix des matériaux constitutifs, ainsi que des sécurités passive et active.

Les technologies au lithium se sont développées dans les applications où la densité d’énergie volumique et/ou massique est un argument important. Elles occupent actuellement pleinement le marché du stockage de l’énergie électrique.

La technologie NiMH occupe encore un créneau dans les applications où une notion d’interchangeabilité avec des piles existe.

La technologie NiCd, pour sa part, est interdite à la vente au grand public en Europe, sauf pour les systèmes d’urgence, d’alarme, d’éclairage de sécurité et les équipements médicaux. Son impact environnemental est en outre un inconvénient majeur en raison de la présence du cadmium qu’elle contient.

Les batteries NiMH ne contiennent pas de matériaux toxiques, mais en raison de la présence de terres rares, telle que le lanthane, leur recyclage est recommandé. Le risque toxicologie n’existe par ailleurs qu’en cas de manipulation de grande quantité de certains matériaux, lesquels devront en outre être recyclés.

Les technologies utilisant le lithium-ion vont encore progresser en densité d’énergie, en durée de vie et en maturité industrielle. Des améliorations sont attendues par exemple en introduisant du silicium au niveau de l’électrode négative ou par l’utilisation de matériaux nanostructurés. Les technologies sodium-ion commencent à apparaître avec des performances prometteuses.

Beaucoup de travaux de recherche portent actuellement sur des technologies lithium « tout solide » utilisant des électrolytes solides et du lithium sous forme métallique. On peut donc s’attendre à ce que le domaine des accumulateurs portables connaisse dans les années à venir des changements importants.

Exclusif ! L’article complet dans les ressources documentaires en accès libre jusqu’au 13 juin 2024 !

Batteries électriques pour applications portables et embarquées – Technologies, par Serge PÉLISSIER, Ali SARI et Pascal VENET

A l’heure actuelle, les batteries lithium-ion représentent la technologie la plus performante, aussi bien en termes de performance que de filière industrielle. Ces batteries sont composées de nombreuses cellules individuelles, assemblées entre elles. Ces cellules, identiques entre elles, présentent une électrode positive, une électrode négative, un électrolyte et un séparateur. L’électrode positive, ou cathode, est composée d’oxyde métallique de lithium, et contient, en proportions variables selon les modèles, du nickel, du manganèse et du cobalt. L’électrode négative, quant à elle, est très souvent composée de graphite. Les matériaux qui composent l’électrolyte sont des sels dissous dans un solvant. Enfin, le séparateur, qui sert à éviter les courts circuits, est souvent constitué d’un film polymère. La plupart des batteries innovantes en développement, si elles font appel à des matériaux nouveaux, sont également constituées en partie de ceux cités précédemment. A l’exception des batteries organiques, dont l’atout principal est justement leur recyclabilité, mais qui ne sont pour le moment qu’au stade expérimental, et qui présentent à l’heure actuelle des faiblesses en termes de puissance.

Aujourd’hui, face à la multiplication des usages des batteries, notamment pour le développement et l’avènement programmé des véhicules électriques et plus généralement de la mobilité électrique, certains de ces matériaux risquent de voir leur disponibilité poser problème. En effet, certains ingrédients des batteries lithium-ion voient leurs gisements être répartis de manière très inégale à la surface du globe. Prenons l’exemple du lithium. Les principales réserves, par ordre de grandeur, se trouvent dans l’ordre au Chili, en Argentine, en Australie, en Chine, aux Etats-Unis, au Canada, au Zimbabwe et au Brésil. On constate qu’aucun pays européen n’apparaît dans ce classement, même si le Portugal possède des gisements de lithium. Cela pose un problème géopolitique évident, en vue d’une mobilité tout électrique : l’ambition européenne de produire sur le vieux continent les batteries qui équiperont les véhicules électriques appelés à se généraliser sur son sol pourrait bien se heurter à cette réalité. Au mieux, il s’agit là d’une dépendance qui affaiblira l’autonomie de la filière, au pire d’une épée de Damoclès sur l’ensemble de la chaîne de valeur du tout électrique. Autre exemple, le nickel : aujourd’hui, la Russie possède 10% des réserves mondiales dans son sous-sol. La situation en Ukraine laisse imaginer quelles pourraient être les tensions futures liées à l’approvisionnement des constructeurs de batteries européens en nickel, s’ils sont contraints de faire appel aux ressources russes.

Aussi, l’enjeu actuel autour de ces matériaux réside dans l’impact écologique de leur extraction, qui entre dans le bilan carbone du cycle de vie des batteries. Au final, des pénuries, à court et à long terme, sont prévisibles au vu des productions planifiées de batteries pour les années futures sur des matériaux comme le nickel, le cobalt et surtout le lithium.

Les industriels misent sur l’innovation pour pallier à ces pénuries prévisibles. Si la recherche travaille au développement de batteries utilisant des matériaux nouveaux, c’est bien des disruptions en termes de recyclage qui pourraient faire émerger une solution de long terme. Les industriels cherchent ainsi à fermer le cycle des métaux utilisés dans les batteries. Cela permet d’une part d’économiser de façon drastique les besoins d’importations de matériaux, mais aussi de produire des batteries ayant un impact écologique moindre, de l’ordre de 25%.

Renault pourrait être le premier constructeur, au niveau européen, à recycler ses batteries à l’échelle industrielle, à travers le projet TFIN (The Future Is Neural). Ce qui permettrait à la marque au losange d’économiser sur les besoins en matériaux, qui entrent à 70% dans le coût d’une batterie, cette dernière représentant 40% du coût d’un véhicule électrique.

Alexandre Chagnes : J’ai effectué une thèse sur les électrolytes et la chimie dans les batteries lithium-ion, puis au Canada sur l’hydrogénation électrocatalytique de molécules organiques. Ensuite, j’ai travaillé pendant un an au CEA à Saclay sur la spéciation dans les réacteurs nucléaires. De 2005 à 2016, maître de conférences à l’École Nationale Supérieure de Chimie de Paris, j’ai travaillé sur l’hydrométallurgie, un domaine que j’ai développé à partir de 2017 à l’université de Lorraine.

J’occupe actuellement différents postes de direction, notamment celui de directeur scientifique du projet LabEx, qui regroupe plusieurs laboratoires. Son objectif est de développer la chaîne de valeur, en partant de la matière première issue des ressources, qu’elles soient primaires ou secondaires, jusqu’aux matériaux semi-finis, en intégrant les aspects économiques et environnementaux dans une perspective d’économie circulaire. De plus, j’enseigne à l’École nationale supérieure de géologie de Nancy et aux Mines de Nancy, ainsi qu’à l’université de Troyes, en Italie également et ponctuellement en Argentine.

Je poursuis ma recherche sur l’hydrométallurgie dans le laboratoire GeoRessources, dédié aux géosciences. L’équipe dont je fais partie travaille sur la métallurgie extractive. Elle est divisée en deux groupes : l’un se consacre à la concentration du minerai, et l’autre que je dirige s’intéresse à l’hydrométallurgie appliquée aux ressources primaires ou au recyclage. 80 % de mes activités de recherche portent sur le recyclage des batteries lithium-ion. En mars 2024, j’ai créé avec un collaborateur la start-up WEEEMET dédiée au recyclage des cartes électroniques.

Je me suis toujours référé, notamment à Chimie Paris, à la documentation de Techniques de l’Ingénieur, l’université y étant abonnée. J’y trouvais notamment des réponses aux questions, en fonction du sujet étudié. Je disposais d’une vision synthétique et détaillée grâce aux articles des experts. À la faveur des références croisées, l’ouverture sur d’autres sujets est intéressante.

En 2023, j’ai accepté avec plaisir la proposition d’intégrer les équipes d’auteurs et conseillers scientifiques de Techniques de l’Ingénieur, compte-tenu de la référence que cette édition constitue aux yeux des chercheurs. Outre la reconnaissance qu’elle permet, diffuser notre expertise contribue à consolider et développer les connaissances scientifiques.

A l’université de Lorraine, il y avait un travail important sur les ressources primaires sans intégrer le recyclage ni les procédés hydrométallurgiques qui nécessitent une connaissance approfondie de la chimie des solution, de la thermodynamique et des procédés. La chimie des solutions et la thermodynamique m’ont toujours intéressé. Mon premier sujet de master et de stage a donc porté sur la chimie des solvants pour les électrolytes. J’ai ensuite postulé pour une thèse avec l’aérospatiale, au CNES, sur le sujet des batteries dans l’aérospatial. J’ai ainsi pu approcher et apprécier, le domaine de la chimie des solutions et l’électrochimie. L’hydrométallurgie appliquée au recyclage, notamment des batteries lithium-ion était encore peu connue à cette époque. Je l’ai découverte à l’occasion d’un concours, qui m’a permis d’être nommé maître de conférences.

Mes connaissances en chimie des solutions et thermodynamique, éléments que l’on retrouve dans le domaine de l’hydrométallurgie, se sont ajoutées à celles du nucléaire, acquises lors de mon travail au CEA. Le centre traitait de l’hydrométallurgie par le biais du traitement des combustibles usés des réacteurs nucléaires. Nous étions plusieurs à nous intéresser à ce sujet et le nombre de places disponibles y était limité. J’ai donc décidé de contracter avec Orano, anciennement Areva, afin de travailler à la production d’uranium par voie hydrométallurgique. C’est réellement cette expérience qui a marqué mes débuts professionnels dans ce domaine. Ensuite, j’ai développé l’hydrométallurgie pour les batteries, afin de combiner le recyclage des batteries et la production des métaux utilisés dans leur fabrication.

Les véhicules électriques contiennent de nombreux métaux importants, notamment dans les aimants du moteur qui intègrent des terres rares, ou encore les batteries. Celles-ci s’appuient actuellement sur deux grands types de technologies : NMC (nickel, manganèse, cobalt) auquel s’ajoute le lithium d’une part, et LFP (lithium, fer, phosphore) d’autre part.

Les métaux importants pour les batteries sont le nickel, le manganèse, le cobalt et le lithium. La technologie LFP est plus contraignante parce qu’hormis le lithium, elle contient du fer, sans grande valeur. Ses matériaux étant peu coûteux, son recyclage s’effectuerait donc à perte.

Du point de vue du recyclage, la technologie de batterie importante est donc celle du NMC, pour la récupération du lithium, cobalt, nickel, manganèse, principalement, mais aussi pour le cuivre et l’aluminium qui composent les collecteurs de courant. Malgré son importance, le cuivre est peu évoqué dans le cadre de la transition digitale et énergétique. Cependant, très utilisé, son prix devrait augmenter. Il faut donc le récupérer, notamment dans les cartes électroniques. C’est le point de départ de la start-up que je monte sur cette activité.

Une première réglementation européenne de 2006 traitait de la façon d’inclure l’économie circulaire et le recyclage des batteries. Elle était adaptée à des batteries type nickel-cadmium, plomb-acide, nickel-métal hydrure, et fixait à 50 % le taux de récupération. Elle n’est en revanche pas adaptée aux technologies de batterie actuelles, car sans recycler les matériaux des batteries, 50 % du poids d’une batterie est déjà à recycler.

En 2016, une réglementation intermédiaire plus adaptée a été décidée, puis une directive européenne votée en juillet 2023. Elle est adaptée aux batteries lithium-ion, puisqu’elle permet d’augmenter le ratio de la masse de la matière à recycler dans une batterie, de 50 à 70 %, voire au-delà. Elle intègre aussi la notion de devoir obligatoirement recycler les batteries, de mettre en place une filière de recyclage, et aussi d’intégrer dans la fabrication des batteries des matériaux issus du recyclage, ce qui constitue une nouveauté. La fabrication d’une batterie intègre un certain pourcentage de différents sels métalliques, qui stimule, dynamise et cadre le recyclage. Enfin, les évolutions de la réglementation insistent sur la nécessité d’utiliser des matériaux acceptables éthiquement, notamment des métaux qui ne sont pas extraits par des enfants.

La première batterie lithium-ion a été développée par Sony en 1991[1]. Elle était constituée d’un oxyde de cobalt lithié dans les électrodes positives (140 milliampères-heures par gramme de capacité stockée à l’intérieur) et de graphite dans l’électrode négative (autour de 280 milliampères-heures par gramme). Depuis, on est passé de l’électrode dite LCO (Lithium, Cobalt, Oxyde) à une électrode manganèse, LiMn2O4, puis à l’électrode NMC dans les années 2000.

Si la capacité de stockage de ces électrodes n’a pas significativement augmenté au cours du temps, leur sécurité d’utilisation s’est en revanche améliorée. La quantité de cobalt, très coûteux, a été réduite, au bénéfice du nickel, plus accessible. Ces changements ont amené des électrodes qui cyclent plus (jusqu’à 2500 cycles charge-décharge), mieux sécurisées et plus abordables, avec une capacité de stockage stable. L’électrode NCA, pour sa part, intègre de l’aluminium et a des capacités beaucoup plus importantes, mais est peu utilisée sur le marché.

L’évolution notable s’observe dans les autres caractéristiques des électrodes, actuellement de type NMC dont la teneur en métaux peut varier, en termes de stœchiométrie, selon les besoins (par exemple NMC 811 et NMC 622 ou bien LFP pour les véhicules électriques).

À côté de cette technologie lithium-ion, les technologies sodium-ion commencent à arriver sur le marché, notamment via les véhicules électriques produits en Chine. Leur utilisation se prête à des distances plus courtes, avec un temps de charge de quelques minutes, ouvrant d’autres perspectives.

Le recyclage des batteries est assez récent. Les premières batteries ont fait leur apparition en 1991. L’idée de les recycler a émergé autour de la fin des années 1990, début des années 2000. Les premiers procédés à l’échelle industrielle s’appuyaient sur des procédés pyrométallurgiques, nécessitant une haute température, très énergivores et émetteurs de gaz à effet de serre. Par ailleurs, ces techniques ne permettent pas de séparer finement les différents matériaux qui constituent les batteries, ni même de produire les sels utiles à la transition énergétique. Le recyclage privilégie depuis des procédés hydrométallurgiques. Plus doux et plus fins, ils permettent de produire des sels de haute pureté pouvant être réutilisés dans la conception de nouvelles batteries lithium-ion.

Actuellement, le recyclage tente de combiner hydrométallurgie et traitements thermiques, pour créer de nouveaux procédés. Pour la plupart, ces procédés s’élaborent sur une chimie assez classique, bien que certaines entreprises (par exemple, Mecaware) travaillent à développer des procédés de rupture. Pour sa part, l’entreprise de recyclage suédoise Revolt – filiale de Northvolt et adossée à une gigafactory – s’appuie sur la dissolution de la matière active pour fabriquer une nouvelle électrode.

Les futures usines de recyclage traiteront d’abord, non pas des batteries usagées, mais des résidus industriels de production de batteries.

En France, les gigafactories sont situées essentiellement dans le nord du territoire. Pour éviter les impératifs liés au transport et à la logistique, les usines de recyclage devraient donc les rejoindre de façon à traiter en premier lieu les résidus de fabrication des batteries. Il est possible que le maillage s’homogénéise avec l’installation d’entreprises dédiées au recyclage des batteries dans d’autres régions.

Des alliances se créent, ce qui est novateur. Un fabricant de voitures s’allie à un recycleur, une entreprise issue de la filière de recyclage s’associe avec un chimiste qui fabrique des électrodes. Ainsi, des consortiums se créent entre différentes entreprises afin de prendre en charge toute la chaîne de valeur du produit, du déchet jusqu’au produit final, dans un contexte d’économie circulaire.

L’Europe – et avec elle la France – a réalisé sa dépendance à des pays géopolitiquement instables. D’autres sont stables, par exemple, l’Argentine a du lithium, mais c’est compliqué politiquement. La Chine, dont nous sommes dépendants également, produit aujourd’hui entre 80 et 90 % des batteries. Face à ce constat, l’Europe agit pour la construction des batteries sur ses territoires. Outre des gigafactories, la matière première lui est donc indispensable.

Nous devons dès lors soit nous allier avec des pays à même de nous assurer un approvisionnement via leurs gigafactories, soit développer l’économie circulaire afin d’obtenir la matière première issue du recyclage sur nos territoires. Nous pourrions également développer des mines en Europe. Tout cela se fera par un jeu d’alliances, bien connu des gouvernements européens.

Si le recyclage a démarré, il ne suffit cependant pas à satisfaire entièrement la demande dans un monde en pleine croissance. Des mines sont nécessaires pour gagner en autonomie énergétique. Pour les développer, nous devons connaître avec exactitude les ressources exploitables et disponibles de notre sol ; ce n’est le cas ni en France ni en Europe.

Des géologues du laboratoire GeoRessources travaillent sur la caractérisation des gisements et la compréhension des mécanismes qui conduisent à leur formation. Cette exploration est très importante, puisqu’elle nous aide également à détecter les gisements et à caractériser les ressources.

Il est aussi important de communiquer largement sur la réalité actuelle de l’exploitation d’une mine, très différente de celle d’antan, et sur ce que signifie l’intégration d’une mine à notre territoire. Le projet de mine de lithium en Allier est l’objet d’un grand débat public jusqu’en juillet 2024. Répondre aux questions, rassurer sont des façons de montrer que le gouvernement est garant de la sécurité de la population et de l’environnement. La mine est une industrie comme une autre, avec un accès clair et transparent aux informations concernant sa consommation d’eau.

Outre ce projet de mine de lithium en Allier, des mines se développent au Portugal ou en Finlande, une pour les terres rares dans le nord de la Suède, également dans le nord de l’Europe, le cobalt. En Alsace, la géothermie permettra la production de 20 000 tonnes de carbonate de lithium par an.

Des projets de mines en Europe sont donc annoncés, mais pour être autonomes, nous devons nous appuyer sur l’économie circulaire en permettant le recyclage. L’exploitation de mines devra intégrer les contraintes de sobriété et simultanément s’assurer du développement des industries nécessaires.

Je me focalise à 80 % sur le recyclage de la batterie, un travail que je mène avec des industriels. Une société, notamment, spécialisée dans le recyclage de lampes basse consommation, souhaite élargir son activité aux batteries lithium-ion. Elle s’intéresse entre autres aux batteries de la petite mobilité électrique (vélos, trottinettes…).

Deux technologies existent pour les batteries de vélo. La première, la technologie NMC est d’usage pour les vélos onéreux, tandis que la technologie LFP se retrouve dans les vélos au prix modique. Or, lors de leur collecte, les batteries sont mélangées. Cette mise en vrac pose problème parce que le fer des batteries LFP ne convient pas en hydrométallurgie. En conséquence, nous développons un procédé qui permettra de traiter ce flux complexe à composition variable, à forte teneur en fer, de façon à pouvoir récupérer le nickel, le manganèse et le cobalt. J’espère que le projet pourra permettre la création d’une usine de recyclage d’ici 2028.

Par ailleurs, je m’intéresse également à l’implantation de nouvelles briques technologiques, comme l’électrodialyse. je m’interroge sur l’implantation de cette brique dans les procédés de recyclage des batteries lithium-ion. L’objectif est de récupérer le lithium, non pas en fin, mais en début de procédé, tout en évitant d’en perdre tout au long du processus. Le projet de la start-up WEEEMET vise à développer un procédé de récupération du cuivre à partir de déchets électroniques, de type carte électronique, grâce à un procédé qui produit des concentrés en amont brevetés par MOB-E-SCRAP. Le fondateur de MOB-E-SCRAP et moi, nous avons fondé WEEEMET qui traitera et extraira le cuivre contenu dans le concentré produit par MOB-E-SCRAP, et et réalise de la R&D pour les partenaires industriels. À l’avenir, l’or, l’argent, l’antimoine et l’étain, c’est-à-dire tous ces métaux qui sont mis de côté actuellement, seront également récupérés.

Pour devenir enseignant-chercheur, les principales qualités sont la curiosité, la ténacité et l’ouverture d’esprit. La curiosité conduit à s’intéresser à de nombreux sujets, en discutant avec différentes personnes, issues d’horizons divers. De ces échanges naissent de nouvelles idées. La ténacité est importante, parce que l’enseignant-chercheur aujourd’hui endosse de nombreux rôles et casquettes, allant de la gestion à la comptabilité, la logistique, le dépôt de projet, la rédaction d’articles… Il ne faut pas avoir peur de toucher à tout ni, bien entendu, de travailler.

Mon premier message aux candidats pour une thèse est de passer leur chemin s’ils ne sont pas certains de vouloir faire de la recherche. On peut essayer d’attirer les meilleurs, mais s’ils ne sont pas heureux, cela ne donne rien de bon, et trois ans est une longue période. Je leur conseille de bien réfléchir à leur sujet de thèse et de ne revenir qu’après la réflexion leur permettant de confirmer leur choix. Je leur conseille aussi de discuter avec d’autres doctorants et post-doctorants. Se renseigner sur le budget alloué à la thèse est par ailleurs un précieux indicateur.

Ensuite, ce long chemin requiert du courage. L’obtention de la thèse ne suffit pas à devenir enseignant-chercheur. Trois ou quatre ans de post-doctorat à l’étranger sont vraisemblablement nécessaires avant qu’un poste ne s’ouvre effectivement.

Hormis ma participation à des congrès en France et à l’étranger, notamment en Argentine, j’ai toujours écrit. La rédaction de mon huitième livre est en cours. Les activités liées à la communication, à l’édition font partie de moi.

J’interviens également dans différents comités éditoriaux, dont celui de Techniques de l’Ingénieur. Cela m’intéresse parce que je dispose ainsi d’une autre vision, de l’intérieur, facilitant la compréhension du fonctionnement. Dès lors, participer à l’actualisation de contenus pour Techniques de l’ingénieur m’intéresse. Enfin, cette collaboration est une façon pour moi d’être reconnu dans mon domaine ; c’est valorisant de pouvoir avoir un impact, une certaine importance.

Les contributions d’Alexandre Chagnes aux Techniques de l’Ingénieur

Alexandre Chagnes contribue en tant que conseiller scientifique et auteur auprès de Techniques de l’Ingénieur.

[1] Batterie de type Li-ion (LIB)

À lire

Réponse à la consultation européenne – Projet de règlement sur les matériaux critiques

Les modules sans fil forment des composants vitaux des appareils interfacés à la peau. En effet, leurs systèmes électroniques radiofréquences peuvent récupérer de la puissance tout en offrant des capacités de télécommunication. Malheureusement, ces composants radiofréquences ont montré une certaine sensibilité à la déformation élastique. Des tractions, même faibles, ont tendance à modifier leurs propriétés électriques (comme la fréquence de résonance dans le cas d’une antenne). Or, ce genre d’imprévu mène souvent à une perte notable de la puissance du signal sans fil. Un cas de figure à prévoir, d’autant plus dans des environnements fortement dynamiques tels que la surface de la peau ! Le salut pourrait venir des matériaux diélectro-élastiques, qui associent des propriétés diélectriques (notamment l’isolation électrique) à une grande capacité à se déformer. Ces nouveaux matériaux promettent ainsi de prévenir efficacement les changements de fréquence impromptus au niveau de l’interface peau-systèmes électroniques radiofréquences.

L’intérêt de ces nouveaux matériaux a été mis en avant en mai 2024 dans un article publié dans Nature. Une équipe internationale de chercheurs issus de l’université Rice (Houston, États-Unis) et de l’université de Hanyang (Séoul, Corée du Sud) y a présenté le développement de son propre matériau diélectro-élastique. Leur objectif : que ce dernier permette de maintenir les propriétés radiofréquences originelles des appareils, peu importe les contraintes élastiques leur étant appliquées. Pour ce faire, le premier auteur de cette recherche, Sun Hong Kim, alors assistant de recherche à Hanyang et désormais postdoctorant à l’université Northwestern (Evanston, États-Unis), et ses collègues ont procédé par rétro-ingénierie. L’idée étant d’imiter l’élasticité des mouvements de la peau, tout en contrant les effets disruptifs dus à la déformation et en minimisant la perte énergétique et la chaleur engendrée. La confection de leur matériau est passée par l’intégration d’amas de nanoparticules de céramique hautement diélectriques à un polymère élastique. En calculant les bonnes distances entre les particules ainsi que la forme optimale des amas, les scientifiques ont pu stabiliser les propriétés électriques et la fréquence de résonance des composants radiofréquences.

Pour s’en persuader, l’équipe de recherche s’est attelée à construire divers appareils sans fil déformables. Parmi eux, une antenne, une bobine ou encore une ligne de transmission. Les performances de ces systèmes électroniques ont ensuite été évaluées selon deux cas de figure : avec comme substrat le matériau développé par les chercheurs, ou un élastomère standard. Le résultat était sans appel. Alors que toute déformation coupait irrémédiablement la connexion pour l’élastomère standard, les systèmes couplés au matériau diélectro-élastique gardaient une communication stable jusqu’à 30 mètres de distance ! En poursuivant sur leur lancée, Sun Hong Kim et ses collègues ont développé des bandes bioniques adaptables à différentes parties du corps : la tête, les genoux, les bras et les poignets. À l’avenir, de tels appareils pourraient envahir les établissements de santé, où ils viendraient fournir surveillance, diagnostic et soin personnalisés pour chaque individu.

En 2022, le marché mondial des batteries s’élevait à 116 milliards d’euros. Dont près de la moitié concernant le secteur de la mobilité, pour lequel les batteries lithium-ion sont ultra majoritaires. Les géants industriels producteurs de ce types de batteries se trouvent en Asie, continent qui regroupe, avec la Chine en tête de gondole, près de deux tiers de la production. Le groupe CATL[1], basé en Chine, produisait en 2022 35% des batteries lithium-ion au niveau mondial.

La domination actuelle de la Chine sur la production de batteries dédiées à la mobilité, et plus largement sur la filière industrielle de production de véhicules électriques, s’explique d’abord par la capacité de l’Etat chinois à orienter l’activité des acteurs industriels nationaux à travers un capitalisme d’Etat qui a démontré son efficacité depuis plusieurs décennies. Aussi, la Chine a toujours été en retard, en termes d’innovation et de compétitivité, sur les Européens et les Américains en ce qui concerne les moteurs à combustion. De ce fait, dès la fin des années 1990, l’Etat chinois a commencé des expérimentations sur les véhicules électriques, pour être en mesure de devenir leader sur un marché à peine émergent à l’époque. Au courant des années 2010, le plan “Made in China 2025” a mis en place un système de subventions pour faciliter l’accès des Chinois aux véhicules électriques. Ces subventions n’étaient accessibles que pour des véhicules dont les batteries étaient 100% chinoises, une manière très efficace de booster la demande en batteries “made in China”. Une stratégie payante, qui fait aujourd’hui de ce pays le leader incontesté de cette filière industrielle, appelée à dominer le secteur de la mobilité dans les décennies à venir, a priori.

Aujourd’hui, les Etats-Unis et l’Europe produisent chacun 7% des batteries électriques au niveau mondial, à des années lumières de la Chine. Le vieux continent a mis en place, à travers le paquet de propositions législatives Fit for 55, des objectifs climatiques ambitieux, qui impliquent notamment la fin de la vente de véhicules thermiques et l’avénement des véhicules électriques, à partir de 2035. Pour cela, la mise en place d’une filière de production de véhicules électriques, et donc de batteries, est actuellement à l’œuvre, à travers le développement dans de nombreux pays européens de gigafactories pour produire ces fameuses batteries (Par exemple Verkor en France). Ainsi, l’Europe, qui dispose actuellement d’une capacité de production d’environ 70 GWh pour les batteries, doit atteindre, c’est l’objectif fixé par la commission, une capacité de production de 550 GWh à l’horizon 2030. Un changement d’échelle donc, dans un temps record, soutenu financièrement au niveau continental.

Dans cette course contre la montre pour rattraper le retard européen, deux écueils majeurs se font jour. D’abord, la pénurie potentielle en matières premières, ou en tout cas la forte dépendance vis-à-vis de pays étrangers qui va se créer pour être en mesure de mettre en place cette augmentation de cadence de production dans les années à venir. C’est particulièrement vrai pour les besoins à venir en termes de cobalt, de lithium, de manganèse ou de graphite, qui pourraient freiner les ambitions européennes. Second point, la consommation d’énergie tout au long de la chaîne de production des batterie est très importante, les incertitudes actuelles sur les prix de l’énergie constituent donc une inquiétude pour le futur.

Au-delà de ces limitations potentielles, l’Europe a mis en place, pour favoriser autant que possible la montée en puissance d’une filière européenne des batteries compatible avec la compétition au niveau internationale et les objectifs continentaux au niveau environnemental, un “règlement batteries”. Ce dernier, adopté en juillet 2023, met en place un cadre réglementaire autour de la production des batteries, sur tout le cycle de vie de ces dernières : matières premières, production, fin de vie, recyclage… Pour obliger les producteurs – du monde entier – voulant équiper de futurs véhicules européens à se plier aux mêmes règles que celles édictées en Europe. Un moyen de limiter la concurrence déloyale au niveau écologique des producteurs chinois par exemple.

[1] Groupe CATL (Contemporary Amperex Technology Company Limited)

15 milliards d’euros. Un record d’investissements a été annoncé à l’occasion de la 7ème édition du sommet Choose France, cet événement initié par Emmanuel Macron, dont le but est de mettre en valeur l’attractivité de la France afin de promouvoir les investissements industriels étrangers. En 2023, ce sont 13 milliards d’euros qui avaient été annoncés. Au Château de Versailles, près de 200 chefs d’entreprise étrangers de 40 nationalités différentes ont été réunis et il a été présenté 56 projets d’investissements représentant la création de 10 000 emplois. Dans un contexte où la France tente d’amorcer une phase de réindustrialisation du pays, voici les principales annonces à retenir.

La promesse d’investissement la plus importante revient à Microsoft qui compte investir 4 milliards d’euros pour développer son infrastructure dans le domaine du cloud et de l’intelligence artificielle. Une expansion de ses sites à Paris et Marseille est prévue ainsi que l’ouverture d’un nouveau site dans l’agglomération de Mulhouse pour héberger des centres de données de nouvelle génération. Amazon, autre acteur des GAFAM, compte également investir plus de 1,2 milliard d’euros pour renforcer son réseau logistique ainsi que soutenir le développement de son infrastructure cloud. Le géant du e-commerce souhaite aussi développer ses capacités françaises en matière d’intelligence artificielle et d’informatique en nuage.

Autres annonces dans le domaine du numérique : le cabinet de conseil Accenture dont le siège se situe en Irlande, va ouvrir deux centres d’IA Générative à Paris et à Sophia-Antipolis. La société américaine Equinix, l’un des principaux opérateurs de centres de données dans le monde, prévoit d’investir plus de 630 millions d’euros dans ses installations en France. Quant à Telehouse, le leader mondial des data centers à forte connectivité, filiale du groupe japonais KDDI, cette société compte allouer un milliard d’euros à la construction de trois nouveaux data centers éco-responsables en régions Sud et Île-de-France. Enfin, l’entreprise finlandaise IQM Quantum Computers, spécialisée dans l’informatique quantique, va construire une unité de production industrielle d’ordinateurs et de puces quantiques, avec l’installation d’une ligne pilote au CEA-Leti à Grenoble.

Des entreprises étrangères vont aussi investir en faveur de la décarbonation. McCain, le géant canadien de la frite surgelée, va investir un milliard d’euros en Europe dont 350 millions d’euros seront destinés à moderniser et décarboner des usines situées dans le Pas-de-Calais et la Marne. La société espagnole FertigHy, qui regroupe un consortium d’investisseurs parmi lesquels Heineken, InVivo et Siemens, va installer en France sa première usine de production d’engrais à faible émission de carbone. Montant de l’opération : 1,3 milliard d’euros. Le site, implanté dans la région des Hauts-de-France, permettra la production de 500 000 tonnes d’engrais bas carbone par an à l’horizon 2030. La start-up néerlandaise Thorizon va investir une vingtaine de millions d’euros dans le développement d’un petit réacteur nucléaire (SMR pour small modular reactor) à sels fondus dans la région lyonnaise.

Du côté de la mobilité, la compagnie maritime danoise DFDS envisage de rendre 100 % électrique une nouvelle génération de ferries traversant la Manche d’ici à 2035. L’investissement s’élève à un milliard d’euros et sera notamment utilisé pour développer les installations électriques dans les ports de Calais et de Dunkerque afin de recharger rapidement les bateaux. L’entreprise allemande Lilium annonce un investissement de 400 millions d’euros pour assembler en France son avion régional électrique à décollage et atterrissage verticaux (eVTOL). Skeleton Technologies, leader européen du stockage d’énergie à haute puissance et à charge rapide, a choisi la région Occitanie pour développer ses activités. L’entreprise estonienne y construira une usine pour fabriquer sa batterie à haute puissance. Dans un premier temps, un centre de R&D sera construit à Toulouse cet automne et le budget global de ces projets s’élève à 600 millions d’euros.

Dans la santé, le groupe pharmaceutique britannique AstraZeneca s’est engagé à investir 365 millions d’euros pour l’extension de son site de Dunkerque afin de construire deux lignes de production supplémentaires permettant la transition vers une production de médicaments contre l’asthme plus verts. L’américain Pfizer prévoit d’investir plus de 500 millions au cours des cinq prochaines années pour renforcer sa R&D en France, notamment au travers de collaborations de recherche clinique et l’augmentation d’essais cliniques, dans des domaines comme l’oncologie et l’hématologie, ainsi que pour la production pharmaceutique sur le territoire français.

Les points forts des batteries lithium-ion sont connus : elles peuvent être utilisées sur une gamme très large d’usages. A côté de cela, leur longue durée de vie, la puissance qu’elles sont capables de délivrer, ainsi que la limitation de l’autodécharge, les rendent performantes pour de nombreuses applications, dans de nombreux secteurs industriels.

Pour autant, les batteries lithium-ion ont des défauts, ou plutôt des limites. Tout d’abord, et même si ce n’est pas le facteur le plus gênant technologiquement parlant, ces batteries sont difficiles à recycler, en grande partie à cause de l’aspect hautement réactif des composants qui la constituent. Cette limite, dans le cadre de la transition énergétique, offre deux trajectoires : soit la disruption, qui permettra de développer des procédés innovants pour – beaucoup – mieux recycler les batteries lithium-ion, soit le développement de nouvelles batteries, constituées de matériaux différents, plus simples à recycler.

Enfin, citons deux inconvénients importants liés à l’usage des batteries lithium-ion, à savoir leur sensibilités aux températures, et les risques d’incendies, qui limitent les usages et sont source d’insécurité, encore aujourd’hui.

Face à ces limites, et à la nécessité de franchir des paliers en termes de densité énergétique, d’autonomie, et de recyclabilité, à la fois pour élargir la palette des usages des batteries, et pour entrer dans les clous des objectifs écologiques nationaux et internationaux, plusieurs pistes sont développées à l’heure actuelle.

S’il reste compliqué – impossible ? – de déceler aujourd’hui quelles seront les batteries qui supplanteront les technologies lithium-ion, force est de constater qu’il existe une grande variété de solutions mises en œuvres dans les laboratoires de recherches, et testées au niveau industriel.

Citons tout d’abord les technologies de batteries dites solides. Ces dernières sont appelées ainsi car l’électrolyte qui les compose se trouve sous forme solide. Grâce à cela, les batteries développées ont une densité énergétique qui peut être multipliée jusqu’à dix fois par rapport à une batterie lithium-ion de même volume. Cela permettrait donc, pour une puissance donnée, de disposer de batteries plus petites et plus légères, avec des applications évidentes, pour les véhicules électriques, voir les avions électriques, pour qui le poids des batteries est aujourd’hui extrêmement limitant. Aussi, les batteries solides devraient avoir une durée de vie plus importante, et ne peuvent pas s’enflammer, deux critères de performance importants pour des usages à grande échelle. Les pistes les plus sérieuses aujourd’hui étudiées pour constituer les électrolytes font appel à des matériaux tels que les polymères solides, le verre, la céramique ou les sulfites. Enfin, et ce n’est pas anodin, les batteries solides fonctionnent, technologiquement parlant, de manière assez similaire aux batteries lithium-ion, ce qui présente un avantage pour développer ces batteries dans un laps de temps assez restreint.

Les batteries à flux redox, qui sont un type de batteries d’accumulateurs, dont l’usage est plutôt réservé aux usages stationnaires. L’innovation majeure de ce type de batteries réside dans le découplage entre la capacité énergétique de la batterie et sa puissance. La grande taille de ces systèmes limite leurs usages, mais leur capacité à fournir une énergie stable dans le temps pourrait les rendre indispensables pour le stockage des excédents d’électricité produits par les éoliennes ou les panneaux solaires, par exemple.

Les technologies de batteries organiques, qui présentent aujourd’hui des limites importantes en termes de densité énergétique, ont l’immense avantage d’être composées de matériaux biodégradables, qui rendent leur impact environnemental intéressant, écologiquement parlant.

Dernier exemple, les batteries au graphène, matériau qui assure une conductivité énergétique et thermique élevée, ce qui permet de diminuer drastiquement les temps de charge. Malheureusement, la production du graphène reste toujours, à l’heure actuelle, chère et technologiquement très compliquée.

Le monde serait-il finalement sur la bonne voie pour sortir du charbon et reposer sur les énergies renouvelables ? En 2023, les énergies renouvelables ont généré 30 % de l’électricité mondiale, selon la Revue mondiale de l’électricité 2024 du groupe de réflexion Ember. Un record, tiré par la croissance du solaire et de l’éolien qui représentent désormais 5,5 et 7,8 % de l’électricité mondiale, derrière l’hydroélectricité (14,3 %). Dave Jones, expert chez Ember estime que « l’année 2023 constitue probablement un tournant décisif dans l’histoire de l’énergie », marquant le pic d’émissions du secteur électrique. « Mais le rythme de la baisse des émissions dépendra de la rapidité avec laquelle la révolution des énergies renouvelables va se poursuivre », prévient-il. L’UE est en tête avec 44 % d’électricité renouvelable, dont 27 % d’énergie solaire et éolienne. Les émissions du secteur électrique de l’UE ont culminé en 2007. Depuis, elles ont diminué de 46 %.

Depuis 2000, la proportion des renouvelables dans la production d’électricité est passée de 19 % à plus de 30 % dans le monde. Cette croissance a permis de réduire l’intensité carbone de la production d’électricité mondiale à 480 grammes de CO2 par kilowattheure (CO2/kWh). Cette intensité a atteint un nouveau record de baisse en 2023, 12 % en-dessous du pic de 2007.

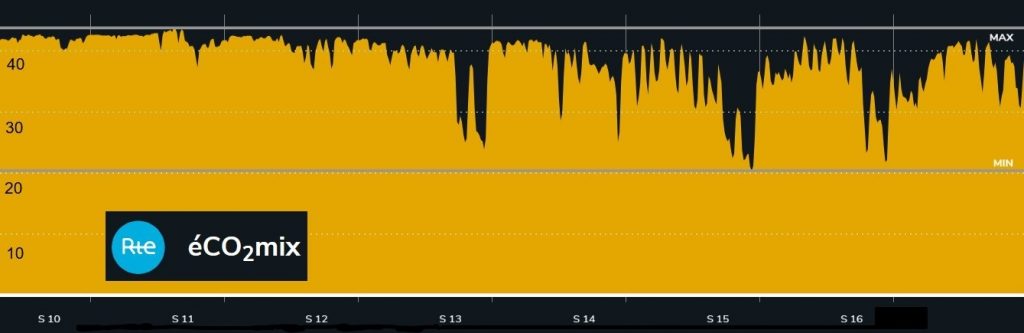

Entre 2022 et 2023, la demande mondiale en électricité a augmenté de 627 térawattheures (TWh). La production solaire et éolienne a alors augmenté de 513 TWh, couvrant près de 82 % de cette demande. Dans des conditions normales, les nouvelles capacités en énergie renouvelable ajoutées en 2023 auraient suffi à faire baisser de 1,1 % la production fossile. Mais le déficit en hydroélectricité (- 88 TWh) a, au contraire, dû être comblé par une augmentation de la production en énergie fossile. Cela a entraîné une augmentation de 1 % des émissions mondiales du secteur électrique. En hausse de 135 millions de tonnes d’équivalent CO2 en 2023, elles atteignent 14,15 milliards de tonnes d’équivalent CO2, un nouveau record.

Lors de la COP28 climat à Dubaï en décembre 2023, les dirigeants mondiaux ont convenu de tripler la capacité mondiale des énergies renouvelables d’ici 2030. Cet objectif vise à atteindre 60 % d’électricité renouvelable à cette date. Cela permettrait de réduire presque de moitié les émissions du secteur de l’énergie.

Pour atteindre ces objectifs, il faudra encore accélérer la croissance des énergies renouvelables. Par exemple, selon le scénario Net Zero Emissions de l’Agence internationale de l’énergie (AIE), la production mondiale d’électricité éolienne doit augmenter pour représenter 18,5 % du mix électrique en 2030 et 31 % en 2050. De même, l’énergie solaire devra continuer à croître à un rythme soutenu.

Malgré les défis, les progrès vers l’abandon du charbon paraissent tangibles, en dépit d’une hausse d’électricité produite à base de charbon de 1,4 %. En 2023, la production d’électricité à partir de charbon a connu des baisses significatives dans plusieurs économies de l’OCDE, y compris l’UE, les États-Unis et le Japon. 95 % de l’augmentation de la production de charbon en 2023 s’est produite dans quatre pays gravement touchés par la sécheresse : la Chine, l’Inde, le Vietnam et le Mexique.

Le rapport montre que la croissance attendue de l’électricité renouvelable donne l’assurance qu’une nouvelle ère de baisse des émissions du secteur de l’électricité est sur le point de commencer. En 2024, le rapport prévoit une diminution de 2 % de la production mondiale d’énergie fossile.

Le 26 mars dernier, un tournant majeur pris dans l’industrie automobile mérite d’être souligné : la marque suédoise Volvo a produit son ultime voiture possédant un moteur diesel. Il s’agit d’un XC90 bleu, un grand SUV[1] équipé d’un quatre-cylindres diesel 2.0 turbo. Cette dernière production aura le privilège d’être exposée au nouveau musée World of Volvo, à Göteborg, en Suède.

Annoncé lors de la semaine du climat à New York, ce cap novateur illustre la volonté d’engager une transition vers le tout électrique au moment même où de nombreux constructeurs retardent leur conversion en proposant encore des modèles à moteur à combustion interne. Cette mutation sera progressive puisque la gamme de la firme produira encore des modèles hybrides rechargeables avant d’atteindre l’objectif du 100 % électrique à l’horizon 2030.

Après Smart ou Porsche, Volvo intègre donc à son tour la liste des rares constructeurs automobiles à avoir totalement abandonné les moteurs diesel. Pour la firme suédoise, c’est la fin d’une aventure qui avait débuté en 1979 avec le tout premier modèle diesel, la 244 GL D6, alors équipé d’un moteur Volkswagen avant que Volvo ne commence à produire ses propres moteurs diesel en 2001.

Les motivations de ce virage ne sont pas seulement de nature écologique ; la marque s’adapte également à la demande du marché en misant sur de nouveaux investissements plus rentables. En effet, alors que la tendance est à la baisse pour le diesel, l’électrique est un marché en plein essor. En 2019, le diesel représentait encore la moitié des ventes du constructeur en Europe. Aujourd’hui, la tendance générale s’est inversée, notamment en France, où les voitures électriques représentent 15,5 % du marché contre 10,6 % pour les diesels. Pour rappel, le mix du diesel sur le marché français était de 31,1 % il y a encore trois ans. Au niveau mondial, les ventes de véhicules électriques Volvo ont augmenté de 70 % en 2023 par rapport à 2022.

Ce tournant s’accompagne d’une transformation industrielle qui impliquera une reconversion des usines Volvo, dédiées à la production de véhicules électriques et de leurs batteries. Filiale du chinois Geely, elle [Volvo, NDLR] ne mise plus sur les investissements dans le développement de moteurs à essence ou diesel. En effet, en 2022, la marque a cédé la part qu’elle détenait dans Aurobay, une coentreprise dédiée aux moteurs à combustion.

Après avoir lancé l’EX90, un SUV 100 % électrique, le constructeur suédois a mis sur le marché, en 2023, l’EX30, un véhicule électrique au prix très abordable de 37 000 € grâce à une fabrication délocalisée en Chine.

Au niveau industriel, l’enjeu est de développer de nouvelles techniques pour réduire les coûts et le poids des futurs modèles électriques. Un crossover électrique, l’EX60 qui devrait arriver en 2026, sera produit grâce au procédé de mégacasting pour l’assemblage de la partie arrière. L’avantage est d’obtenir une seule pièce d’aluminium au lieu de la centaine de pièces précédemment utilisée. Ce procédé permet une réduction du poids de 50 %. Cette innovation s’inspire de la méthode de fabrication de gigacasting mise au point par Tesla. Notons que le Tesla Model Y domine le marché en étant le véhicule le plus vendu dans le monde en 2023 avec 1,2 million d’unités écoulées.

[1] Sport Utility Vehicle

Sortie de piste lors du décollage d’un 737 à Dakar le 9 mai, problèmes de train d’atterrissage sur un 767 la veille, détachement d’une porte-bouchon en plein vol le 5 janvier… Entre les problèmes de production, les non-conformités et les soupçons de falsification de documents par des employés, Boeing traverse une crise inédite.

Le 17 avril, quatre lanceurs d’alerte témoignaient devant le Sénat américain au sujet des graves problèmes de production qui concernent les Boeing 737 Max, 787 Dreamliner et 777.

Avant l’ouverture de la série d’auditions au Sénat, le président de la commission d’enquête et sénateur démocrate Richard Blumenthal résumait ainsi la situation de Boeing par cette phrase :

« Ce que nous allons entendre aujourd’hui du lanceur d’alerte, c’est un exemple de comportement des grands groupes donnant priorité aux bénéfices au détriment de la sécurité, à la cadence de production avant presque tout le reste ».

En effet, alors que les carnets de commandes des donneurs d’ordre sont pleins pour dix ans, aussi bien côté Boeing que côté Airbus, augmenter les cadences de production sans faire aucune concession sur la qualité et donc sur la sécurité est un véritable défi. Or, c’est justement ce qui est reproché à Boeing.

Richard Blumenthal révélait ainsi qu’il y a « de plus en plus de graves accusations selon lesquelles la culture de la sécurité chez Boeing est brisée »

Et il semblerait qu’elle le soit depuis plusieurs années, si l’on en croit les témoignages et les faits.

Pour mieux comprendre, il faut revenir en arrière. En 2018 et 2019, les crashs de deux 737 Max 8 ont causé la mort de 346 personnes en raison de défauts de conception, clouant au sol pour deux ans les Boeing 737.

Lors d’audiences organisées en 2020 par le Congrès américain, Ed Pierson, ancien combattant de l’US Navy, était entendu en qualité de directeur sur la ligne de production du 737, entre 2015 et 2018.

Pierson affirmait qu’à l’époque, il était tellement préoccupé par les mauvaises conditions de production à l’usine, qu’« il hésitait à emmener sa propre famille dans un avion Boeing ». Selon lui, la cause principale de ces dysfonctionnements était « la pression des gestionnaires pour construire de nouveaux avions le plus rapidement possible. »

Le 6 mai, L’Agence américaine de l’aviation civile (la FAA) a également ouvert une nouvelle enquête afin de savoir si Boeing a correctement mené les inspections requises quant à la jonction des ailes au fuselage de certains 787 Dreamliner.

Il faut par ailleurs préciser que cette enquête a été ouverte après que Boeing eut informé la FAA « qu’il n’avait peut-être pas effectué les inspections requises ».

Malgré la multiplication des incidents techniques concernant ses avions et les accusations dont il fait l’objet, Boeing se dit « confiant dans la sécurité et la durabilité des 787 et 777 ». L’avionneur a également promis la mise en œuvre de plusieurs plans d’actions immédiates permettant de renforcer la qualité et la sécurité. Un premier plan a été remis à la FAA et le second est attendu prochainement.

De son côté, l’agence européenne de la sécurité aérienne estime, sur la base des informations fournies par la FAA, que « la situation est sous contrôle, même si elle relève de la responsabilité de la FAA. »

En attendant de voir les résultats de ces actions, cette crise majeure de sécurité risque de provoquer une crise de confiance qui pourrait sembler favorable à Airbus. À condition néanmoins que l’avionneur européen soit en mesure de récupérer les commandes de son concurrent. Dans le cas contraire, cela pourrait alors favoriser l’entrée de nouveaux constructeurs, notamment le chinois COMAC et son C919.

Début mai, l’État a réuni le Comité stratégique de filière (CSF) automobile. Objectif : signer un nouveau contrat de filière qui doit orienter tout le tissu industriel vers une nouvelle chaîne de valeur permettant de réduire de 100 % les émissions des véhicules à l’échappement à partir de 2035, comme prévu par le cadre législatif européen. L’enjeu est d’autant plus complexe que la filière vise aussi une plus forte digitalisation de ses produits, de ses process industriels et des services de mobilité, et que l’impératif de création d’emplois et de richesses sur les territoires se fait plus pressant.

La filière automobile dit se positionner comme « services et industries des solutions face au défi climatique » selon les mots de Luc Chatel, président du CSF : formule assez audacieuse quand on sait que le secteur du transport routier est le premier émetteur de CO2 en France… Le défi de la conversion des moyens de déplacement vers des solutions décarbonées a en tout cas été bien identifié comme un défi industriel, complémentaire des autres actions comme le développement des transports en commun, des mobilités douces, etc.

Le précédent contrat stratégique 2018-2022 a déjà mis la filière sur la voie de l’électrification des véhicules. Ainsi, 200 000 véhicules électriques ont été vendus en 2022 et 300 000 en 2023, représentant une part de marché autour de 18 %. Le nombre de points de recharge a atteint 100 000 en mai 2023. Le soutien de l’État à l’innovation a aussi été relevé, notamment à travers le Comité d’orientation pour la recherche automobile & mobilités (Coram). Ce dernier a épaulé 60 projets depuis 2020, avec 393 M€ d’aides pour 1,2 Md€ d’investissements.

À date, quatre projets de gigafactories dans le domaine des batteries électriques ont aussi été annoncés en France, pour faire émerger une offre nationale innovante et compétitive. Bruno Lemaire a appuyé cet aspect de la réindustrialisation française en allant visiter récemment le site de Blue Solutions (groupe Bolloré) dans le Finistère. Le spécialiste des batteries solides Lithium-métal y a officialisé son activité de R&D et le lancement d’une ligne de production pilote dans l’agglomération de Quimper. Elle sera suivie par la construction d’une grande usine de fabrication de batteries dans le Grand-Est, près de Mulhouse. À terme, avec un investissement global de 2,2 milliards d’euros – grandement aidé par des crédits d’impôt – cette gigafactory vise une production annuelle de 25 GWh de batteries, soit l’équivalent des besoins de 250 000 véhicules électriques par an, selon Blue Solutions.

Mais tout cela n’est qu’un début. Le nouveau contrat stratégique 2024-2027 engage toute la filière à accélérer, des constructeurs de véhicules jusqu’à tous les équipementiers et entreprises de services.

Ce nouveau contrat s’articule autour de six axes. Les trois premiers ambitionnent de stimuler l’innovation, de gagner en compétitivité, de renforcer l’attractivité de la filière, de former aux nouvelles compétences, de sécuriser les approvisionnements stratégiques (spécialement sur l’électronique de puissance), et de renforcer une dynamique collective. Il s’agit de mettre tout en œuvre pour que le contexte soit favorable à la mutation du secteur automobile, avec un fort rôle de l’État, par exemple grâce aux aides de France 2030.

L’axe 4 vise particulièrement l’accélération de la transition écologique. Il s’appuie sur les objectifs fixés par la planification nationale : multiplier par quatre les ventes de véhicules particuliers 100 % électriques par rapport à 2022, soit 800 000 en 2027 ; multiplier par six celles de véhicules utilitaires légers pour dépasser 100 000 ventes en 2027. Pour y arriver, le contrat prévoit le maintien de dispositifs de soutien à l’achat de ce type de véhicules (sans les détailler), le déploiement d’infrastructures de recharge et d’avitaillement, y compris en hydrogène, et la promotion de l’offre de véhicules électriques « en prenant en compte l’exigence de sobriété ». Sur cet aspect, il est évoqué l’optimisation de la consommation de matières et l’allègement des structures, sans qu’on sache vraiment si c’est un appel à construire des voitures plus petites. Par ailleurs, aucun mot sur les véhicules roulant au bioGNV, qui auraient pourtant un rôle à jouer dans la décarbonation.

Enfin, les deux derniers axes complètent la panoplie des objectifs de durabilité de la filière automobile. L’un en insistant sur l’intérêt de l’économie circulaire (écoconception, réemploi et remanufacturing de pièces, recyclage des métaux, des plastiques, des batteries, des composants électroniques et des véhicules industriels). L’autre en englobant toutes les autres actions sur le parc de véhicules existants (carburants décarbonés, rétrofit, écoconduite, etc.) et sur les usages (covoiturage, intermodalité, nouveaux services des collectivités locales).

Il restera à voir si toutes ces bonnes intentions seront effectivement et rapidement appliquées par le secteur automobile. Une proposition de loi en cours d’examen sur l’accélération et le contrôle du verdissement des flottes sera un bon test : les entreprises concernées (notamment les loueurs) ne doivent pas freiner son ambition afin que ce soit un levier de déploiement massif des véhicules électriques, comme l’ont fait remarquer plusieurs associations et la CFDT dans une lettre ouverte au Premier ministre fin avril.

On le répète à l’envi, le développement de filières industrielles innovantes, que ce soit concernant l’hydrogène, les véhicules électriques, la production d’électricité bas carbone, le recyclage (…), sont une nécessité pour espérer donner corps aux ambitions écologiques françaises, européennes et mondiales, illustrées par l’objectif d’être neutre en carbone à l’horizon 2050. Si la neutralité carbone constitue le graal à atteindre, le chemin pour y parvenir est constellé d’innovations technologiques qui doivent, alliées à une notion nouvelle, la sobriété, permettre d’atteindre cette ambition.

Dans ce contexte, le développement de batteries plus performantes est indispensable. Il convient ici d’étayer la notion de performance en ce qui concerne les batteries. Elle recouvre deux aspects. D’abord, l’amélioration des paramètres qui définissent ce qu’est aujourd’hui une batterie performante, selon l’usage : la puissance délivrée, l’autonomie offerte, la rapidité de charge, le nombre de cycles, la recyclabilité… d’un autre côté, la disruption des usages existants via l’amélioration des technologies. L’exemple le plus parlant est celui du transport routier : les batteries actuelles améliorent les performances des véhicules électriques, avec des autonomies autour de 400 à 500 km aujourd’hui. Les batteries, dans le futur, pourraient permettre une autonomie supérieure à 1000 km, ce qui change drastiquement le spectre d’utilisation des véhicules.

Quels seront les usages des batteries dans le futur, dans le contexte de la transition énergétique ? Et quelles disruptions seront nécessaires pour garantir ces usages ? On pense tout d’abord à la mobilité, qu’elle soit routière, aérienne ou ferroviaire, dans le sens où les transports constituent une part importantes des émissions de GES à l’heure actuelle. Les véhicules électriques ont besoin de batteries à haute capacité et à recharge rapide, pour être compétitives par rapport aux performances des véhicules thermiques actuels.

Pour l’aviation et le maritime, ce sont la légèreté et la puissance qui doivent être améliorées, dans des proportions importantes, pour imaginer, par exemple, des avions électriques ayant des performances comparables aux avions de ligne thermiques actuels.

Ensuite, le stockage de l’énergie constitue, après les transports, un pilier de la réussite de la transition énergétique, pour palier l’intermittence de certaines sources d’énergie, éoliennes et solaire en tête. Les améliorations attendues concernent la limitation de l’autodécharge, qui permettra de stocker les excédents de production sur du long terme, et la durée de vie, qui doit être grandement améliorée pour pouvoir généraliser les couplage entre production intermittente et stockage.

Viennent ensuite des usages qui peuvent paraître plus minoritaires, mais qui prennent une place de plus en plus considérable aujourd’hui, que ce soit en termes d’usages, mais aussi des émissions de GES qu’ils génèrent.

Citons l’utilisation des appareils électroniques portables, pour lesquels la charge rapide et la durabilité des batteries est une évolution attendue. Dans la même veine, la domotique mise, pour se généraliser plus rapidement, sur l’augmentation de l’autonomie des batteries, de leur durée de vie, et de l’absence de maintenance. Ces améliorations permettront également d’élargir le spectre d’utilisation des objets connectés.

Ensuite, les réseaux intelligents, autre pilier essentiel de la transition énergétique pour rationaliser la production et la consommation d’énergie, nécessitent des batteries plus performantes pour permettre une gestion plus efficace de l’énergie, et un équilibre entre l’offre et la demande

Dernier exemple, la mobilité urbaine, sous tous ses aspects, qui constitue, à l’instar des exemples précédents, une des pierres angulaires de la transition énergétique. L’amélioration drastique des performances des batteries, sur le plan de la fiabilité, de la légèreté, de la sécurité et de l’autonomie permettront de développer dans des proportions compatibles avec les ambitions écologiques qui sont les nôtres la micro-mobilité et les transports publics pour tous.

En bref, dans le domaine des batteries, les disruptions technologiques à venir vont permettre non seulement de révolutionner les usages actuels, mais constituent une condition indispensable à l’avènement de la transition écologique en cours.

L’affaire aura fait grand bruit. Le 30 janvier dernier, nos confrères du Monde et de la cellule investigation de Radio France révélaient l’existence, au sein de la filière des eaux de source et minérales française, de « pratiques trompeuses » mises en place de longue date et à grande échelle. « Pendant des années, des eaux vendues comme “de source” ou “minérales naturelles” ont subi des techniques de purification interdites », résumait en effet Stéphane Foucart dans les colonnes du Monde. Des traitements mis en œuvre pour une trentaine de pour cent – au moins – des quelque 146 « dénominations commerciales » distribuées sur le marché français, comme l’estime l’Inspection générale des affaires sociales (IGAS) dans un rapport remis au gouvernement en juillet 2022, et aujourd’hui rendu public. Un document dont les auteurs concèdent même ne pas avoir de doute sur le fait que cette part d’environ 30 % soit sous-estimée, et que la mise en œuvre de tels traitements soit en réalité de mise chez « l’ensemble des minéraliers », puisque « délibérément dissimulée »…

Le point de départ de l’affaire est ainsi constitué par une dénonciation, un signalement effectué en 2020 par le salarié d’une usine du groupe Alma, n° 1 français en volume grâce, notamment, à sa célèbre marque Cristaline. « Sur la base [de ce] signalement […], le Service national des enquêtes (SNE) de la direction générale de la Concurrence, de la Consommation et de la Répression des fraudes (DGCCRF) a mené des investigations qui ont permis de révéler un certain nombre d’écarts à la réglementation, tout particulièrement en matière de traitement », indique ainsi le rapport de l’IGAS.

Des investigations dans la foulée desquelles un autre grand nom du secteur – Nestlé Waters, qui détient notamment les marques Hépar, Contrex, Perrier, ou encore Vittel – s’est lui-même manifesté auprès du cabinet de la ministre déléguée en charge de l’industrie d’alors, Agnès Pannier-Runacher, pour – discrètement[1] – confesser à son tour la mise en œuvre « de pratiques de traitement non conformes », comme le note l’IGAS. Un « rendez-vous secret », tel que le décrit Radio France, qui s’est tenu à Bercy fin août 2021. Ceci, « dans une sorte d’étrange et totalement informelle procédure de plaider-coupable », comme le notent, à nouveau, nos confrères de Radio France… « Après ces révélations, […] les ministères compétents (Économie et Santé) […] ont décidé de saisir l’Inspection générale des affaires sociales » retracent les auteurs du rapport publié par le service administratif français.

Outre un travail documentaire et l’envoi de questionnaires à l’ensemble des exploitants de sites de conditionnement d’eau en bouteilles, l’IGAS a ainsi coordonné une campagne d’inspection « de grande envergure », menée par les Agences régionales de santé (ARS) au printemps 2022 auprès d’une quarantaine de marques d’eau en bouteille. « Les travaux réalisés par la mission ne constituent pas un contrôle, mais relèvent davantage d’une étude détaillée des processus d’autorisation, de traitement et de contrôle des EC [eaux conditionnées] », souligne le rapport de l’IGAS.

Ces investigations ont ainsi permis au service administratif d’aboutir à cette part d’au moins 30 % d’eaux minérales et d’eaux de source faisant l’objet de traitements « non conformes à la réglementation ». Et l’IGAS de révéler que « les écarts principalement signalés concernent la pratique de la microfiltration ».

Visant à retenir les particules en suspension dans l’eau, la technique n’est pourtant pas tout à fait proscrite en soi, comme le note l’IGAS elle-même dans son rapport : « Depuis 2001 […], le recours à des filtres dont le seuil de coupure est supérieur à 0,8 µm est toléré par la Direction générale de la santé (DGS) ». Problème, tolérée dans des cas exceptionnels, la mise en œuvre de ce procédé de filtration membranaire s’est toutefois révélée généralisée, et même « dévoyée » selon l’IGAS. En cause, un manque de clarté de la réglementation, mais aussi – et surtout – une recrudescence des situations de non-conformité des eaux conditionnées vis-à-vis des différents critères de qualité auxquels elles se doivent de répondre, définis notamment dans l’arrêté du 14 mars 2007 modifié. « Les ressources aquifères exploitées par Nestlé [Waters] sont régulièrement contaminées microbiologiquement, notamment par des bactéries de type Escherichia coli. Des traces de polluants chimiques, comme des métabolites de pesticides, ont également été découvertes dans l’eau de Perrier. Les traitements non conformes mis en place n’ont donc pas eu seulement pour but de prévenir d’éventuelles contaminations de l’eau, mais bien de la “nettoyer” des contaminants », expliquent ainsi la cellule investigation de Radio France, sous la plume de la journaliste Marie Dupin.

Une situation qui a ainsi poussé le groupe minéralier à commettre – comme il l’a lui-même révélé aux membres de la mission de l’IGAS et à l’ARS Grand Est à l’occasion d’un contrôle mené sur l’un de ses sites d’embouteillage – des écarts « plus graves » encore, comme les qualifie l’IGAS.