L’humain en est couvert de la tête aux pieds. La peau, notre plus grand organe sensoriel, permet grâce à ses différents récepteurs d’aborder le monde qui nous entoure. Des chercheurs se sont inspirés de la peau humaine pour la reproduire artificiellement avec des composants électroniques. Les objectifs sont divers : réparer les récepteurs humains endommagés, doter les robots ou les neuroprothèses de systèmes plus performants pour la manipulation d’objet, alimenter des systèmes sans batterie…

Des récepteurs somatiques critiques

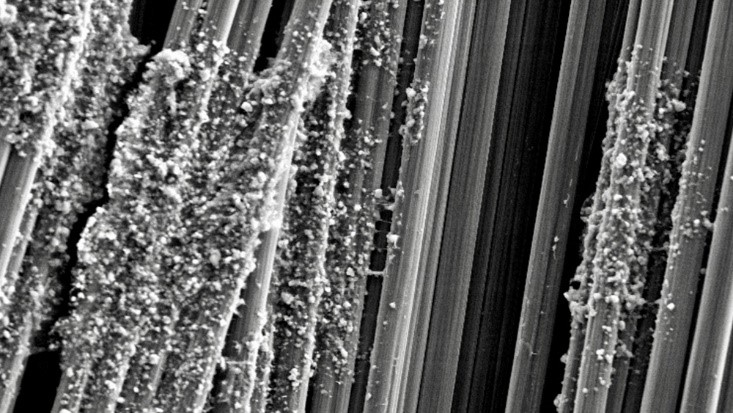

Des chercheurs du Royal Melbourne Institute of Technology (RMIT) en Australie, ont conçu trois récepteurs cutanés du système sensoriel somatique : le corpuscule de Pacini pour le sens du toucher, le thermorécepteur pour la perception de la température et le nocicepteur pour la douleur. Grâce à une combinaison de capteurs de pression, de couches minces d’oxyde à changement de phase et de memristor, les récepteurs « détectent les stimuli, mesurent leurs niveaux et transmettent des signaux au cerveau, déclenchant ainsi des réactions », expliquent les chercheurs dans leur article publié le 1er septembre dans Advanced Intelligent Systems.

Les chercheurs ont ainsi démontré expérimentalement la capacité de concevoir des récepteurs cutanés artificiels permettant de remplacer des régions cutanées humaines endommagées, d’augmenter la sensibilité des individus dans certaines activités (comme la défense et le sport), ou encore de doter la robotique de sensibilité.

Une peau alimentée par la sueur

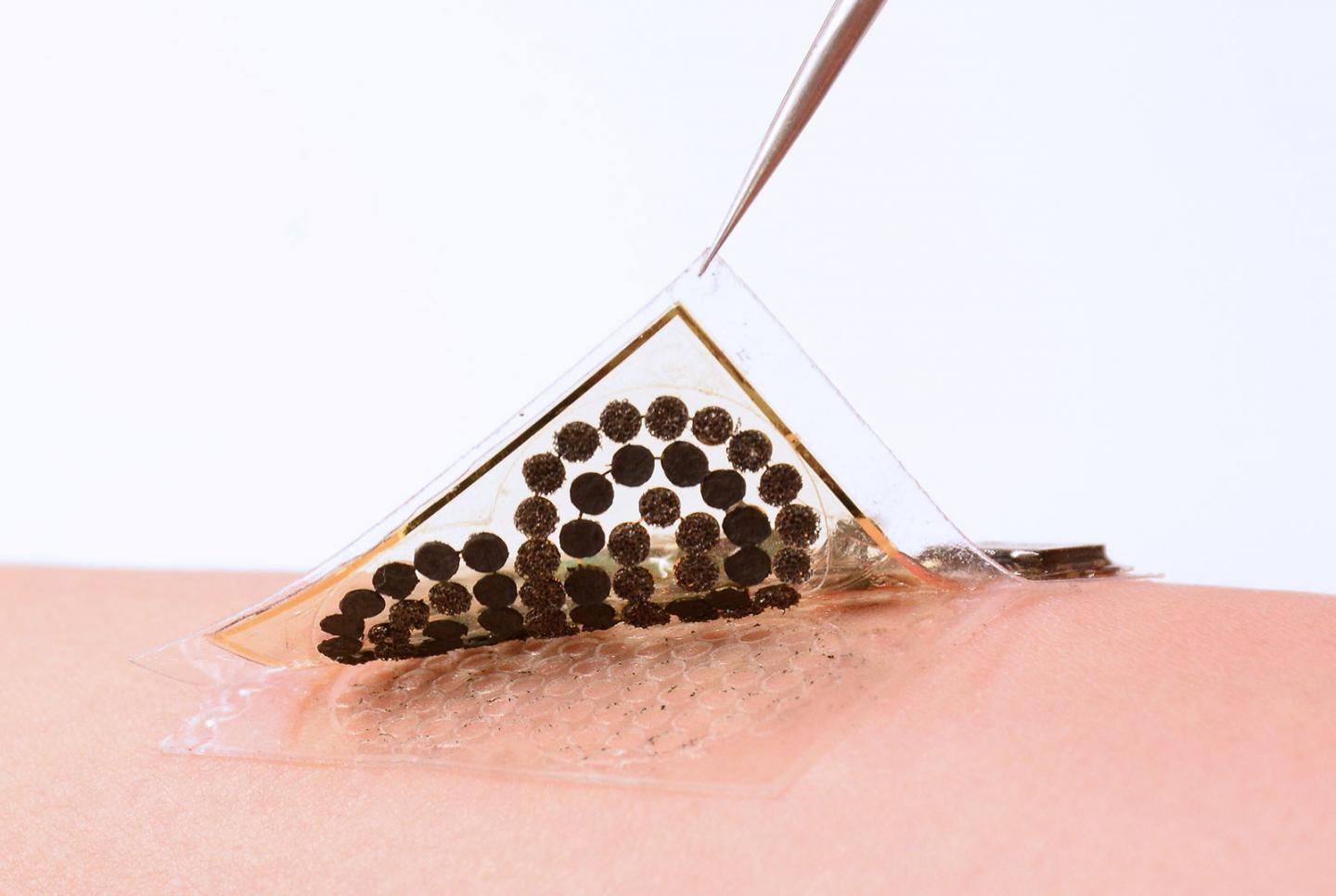

La sueur est une bonne source d’énergie pour les peaux artificielles. C’est ce que montrent les travaux d’une équipe de recherche du California Institute of Technology (Caltech), aux Etats-Unis, publiés en avril 2020 dans Science Robotics. Cette peau électronique sans batteries externes fonctionne grâce aux biocarburants contenus dans la transpiration humaine. Elle est dotée de capteurs multimodaux et de biopiles au lactate (comme celle du CNRS, dont l’étude a été publiée en septembre 2019) qui lui fournissent une densité de puissance de 3,5 milliwatts par centimètre carré (mW/cm²) pour une autonomie de 60 heures d’activité en continu.

Cette peau permet de surveiller les biomarqueurs métaboliques clés, tels que l’urée (déchet azoté des protéines), l’ammonium (NH4+), le glucose, son pH, ainsi que la température durant une activité prolongée. L’ensemble de ces données sont transmises sans fil, par Bluetooth, à l’interface utilisateur. Le dispositif électronique permet également d’enregistrer les contractions musculaires pour contrôler, telle une interface homme-machines, une prothèse ou un bras robotisé. Une vidéo, publiée sur Twitter, en fait la démonstration.

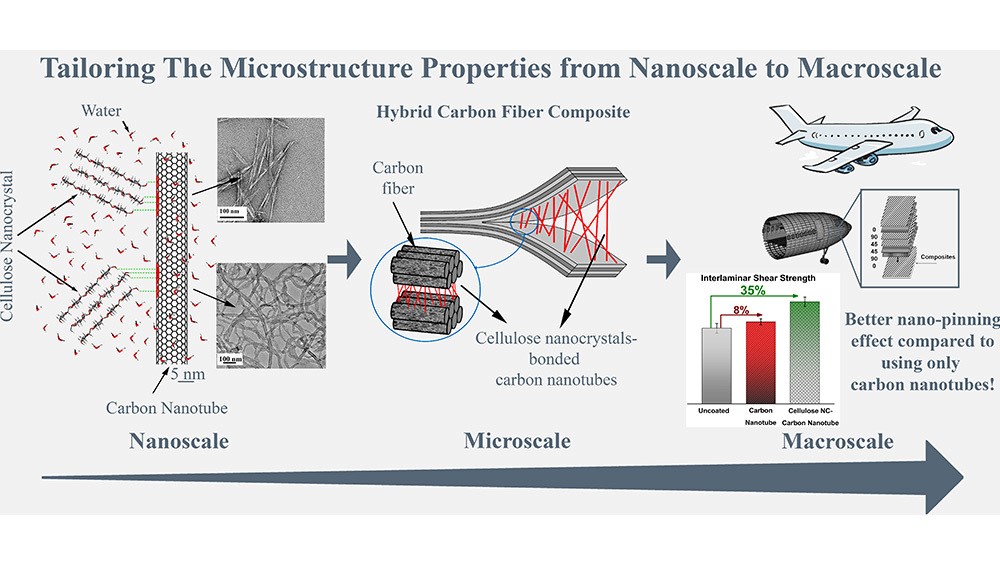

Un système nerveux artificiel

Des chercheurs de l’université de Singapour ont mis au point un système nerveux artificiel pour peau électronique. Leurs travaux ont été publiés en juillet 2019 dans la revue Science Robotics. Cette peau est dotée de plus de 10 000 capteurs ultrasensibles permettant la transmission simultanée d’informations thermotactiles tout en maintenant des latences de lecture exceptionnellement faibles. « Pour démontrer le concept, nous avons développé un système prototype utilisant des composants standard pour caractériser les performances de notre architecture de communication ACES [pour Asynchronously Coded Electronic Skin, ndlr] », expliquent les chercheurs. Ils ont ainsi utilisé un réseau physique de 240 mécanorécepteurs artificiels qui transmettaient des événements de manière asynchrone à une latence constante de 1 ms, tout en maintenant une précision temporelle de < 60 ns. Une précision temporelle « exceptionnellement élevée » potentiellement réalisable avec plus de 10 000 capteurs, selon l’équipe.

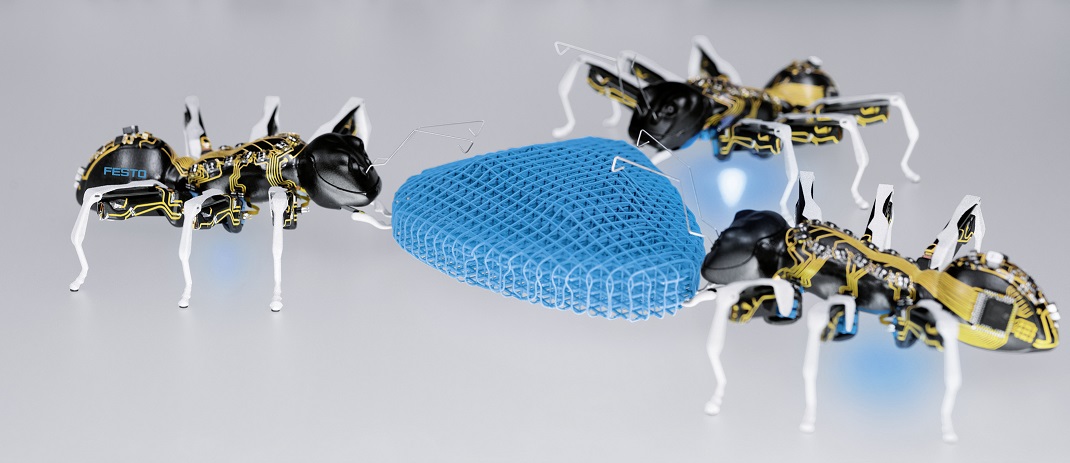

Leur architecture ne nécessite qu’un conducteur électrique pour propager le signal. Les réseaux de capteurs sont reconfigurables et résistants aux dommages. Les chercheurs imaginent des applications robotiques, médicales (neuroprothèses) et informatiques (matériel neuromorphique) pour la manipulation d’objets et la perception somatosensorielle.

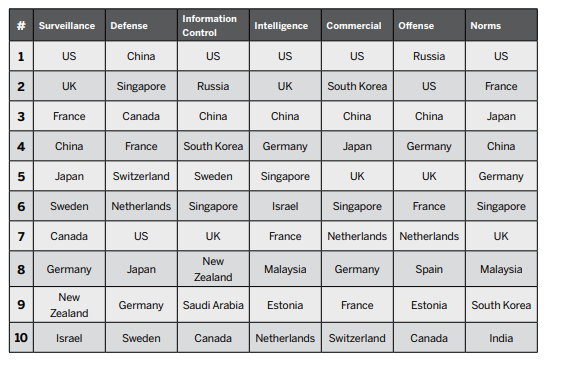

« Depuis le début des années 90, la Chine développe ses capacités en cyberguerre. La doctrine militaire chinoise intègre la cyberattaque comme une composante de sa stratégie visant à défaire un ennemi mieux équipé ou supérieur en nombre. L’Armée de Libération Populaire a bien compris la dépendance sans cesse croissante des armées modernes vis-à-vis de l’informatique et de leurs besoins permanents de communiquer », nous explique sous couvert d’anonymat un expert militaire français.

« Depuis le début des années 90, la Chine développe ses capacités en cyberguerre. La doctrine militaire chinoise intègre la cyberattaque comme une composante de sa stratégie visant à défaire un ennemi mieux équipé ou supérieur en nombre. L’Armée de Libération Populaire a bien compris la dépendance sans cesse croissante des armées modernes vis-à-vis de l’informatique et de leurs besoins permanents de communiquer », nous explique sous couvert d’anonymat un expert militaire français.

Flore Berlingen : Le principe de responsabilité élargie des producteurs est entré dans la loi en 1975 mais les premières filières REP (à responsabilité élargie des producteurs) se mettent en place dans les années 1990. Les

Flore Berlingen : Le principe de responsabilité élargie des producteurs est entré dans la loi en 1975 mais les premières filières REP (à responsabilité élargie des producteurs) se mettent en place dans les années 1990. Les