Régulièrement, la presse se fait l’écho d’applications mobiles qui récupèrent vos données personnelles à votre insu. Mais il existe une menace encore plus forte, mais qui reste très discrète : le piratage de composants électroniques intégrés dans les téléphones.

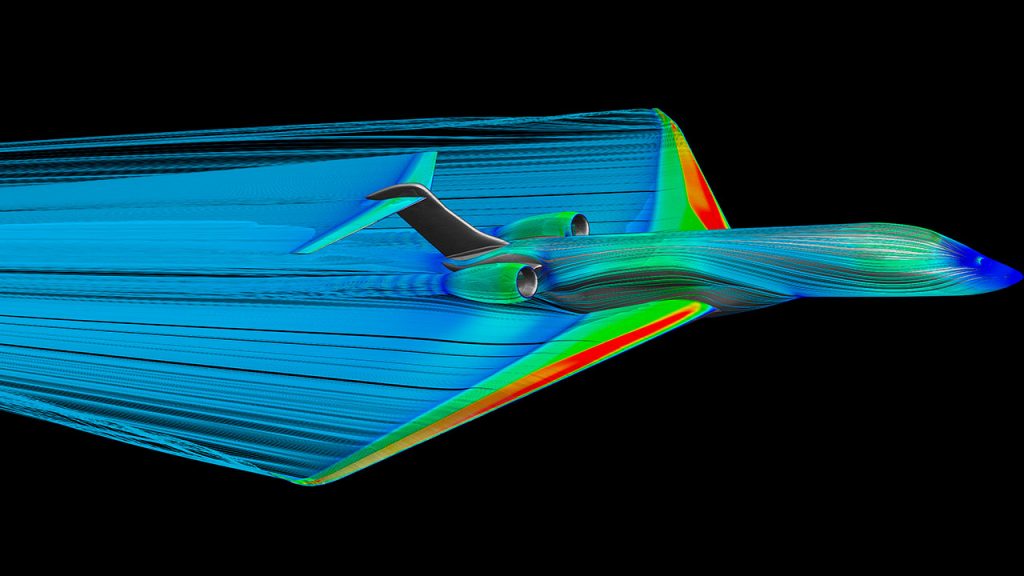

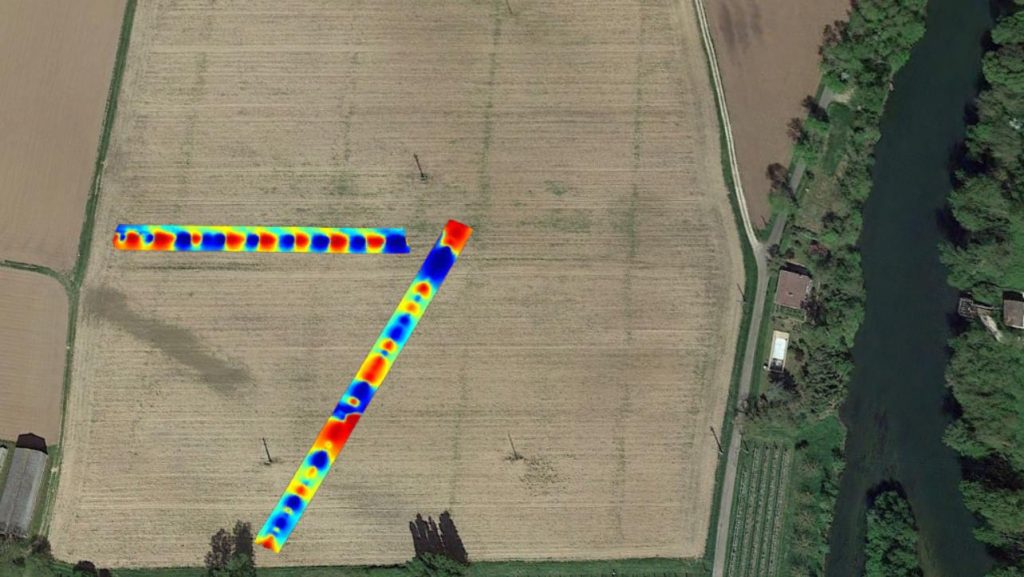

Une récente étude menée par des chercheurs de l’Université de Pittsburgh Swanson School of Engineering a révélé que le circuit spécialisé dans la génération d’images (GPU-Graphics Processing Unit) de certains smartphones Android, intégrant une puce Qualcomm Adreno, pouvait être utilisé pour espionner et récupérer des données personnelles.

Présentée en mars 2022 lors de la conférence ASPLOS en Suisse, une attaque reposant sur cette faille de sécurité matérielle permet de déduire différentes données d’identification (dont les logins et mots de passe) sans nécessiter de privilège système ni provoquer de changement notable dans le fonctionnement ou les performances de l’appareil. Le pire est que ce piratage passe inaperçu ! Google a confirmé qu’il publierait une mise à jour de sécurité Android dans le courant de l’année pour résoudre ce problème.

Effet domino

Les attaques visant le hardware ont d’abord été imaginées pour « le vol de données bancaires sur les puces de nos cartes bleues, détaille dans le journal du CNRS Lilian Bossuet, professeur à l’université Jean Monnet de Saint-Étienne et membre du laboratoire Hubert Curien. Ces approches sont à présent appliquées aux téléphones portables, dont les circuits sont mal protégés. La situation est cependant encore pire dans l’Internet des objets, où les appareils sont à la fois omniprésents et très peu, voire pas du tout, sécurisés. »

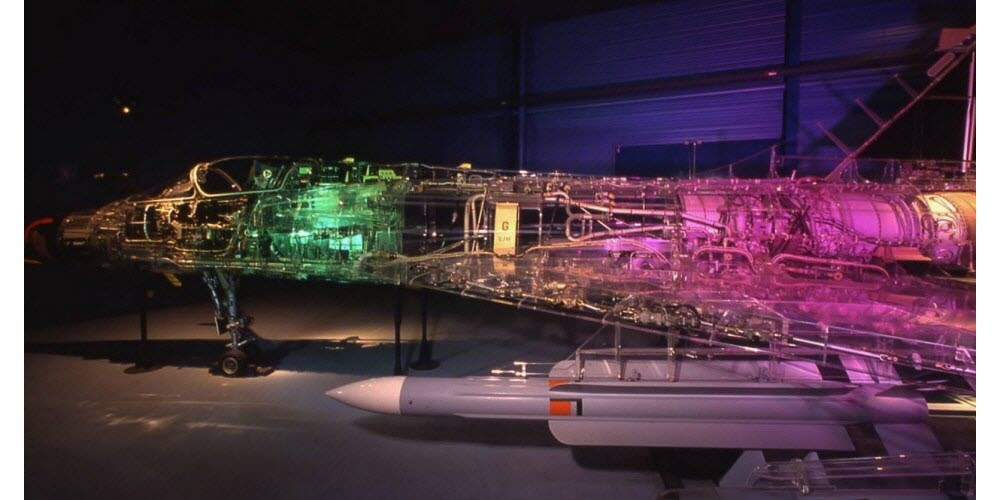

Ordinateurs, réseaux de communication, capteurs… Tous les appareils électroniques intégrant des processeurs. Il suffit qu’un composant physique soit compromis pour impacter les différentes couches de cybersécurité d’un système. L’effet serait dévastateur. Or, les puces modernes sont des dispositifs très complexes constitués de milliards de transistors. Leur compromission peut se faire à différentes étapes (conception, fabrication, assemblage, test), mais par contre la détection est très difficile.

Les modifications physiques apportées à un seul circuit intégré peuvent être bien cachées parmi le nombre de composants valides et peuvent fonctionner longtemps sans être détectées. Une vulnérabilité matérielle bien conçue peut donc passer inaperçue !

À l’occasion de la conférence Black Hat sur la sécurité à Las Vegas, en 2012, le chercheur Jonathan Brossard avait créé une backdoor baptisée Rakshasa qui remplace le Bios d’un ordinateur. Son programme malveillant pouvait compromettre le système d’exploitation au moment du démarrage sans laisser de traces sur le disque dur. Jonathan Brossard avait ainsi démontré que le backdooring permanent du matériel était possible.

Espionnage économique

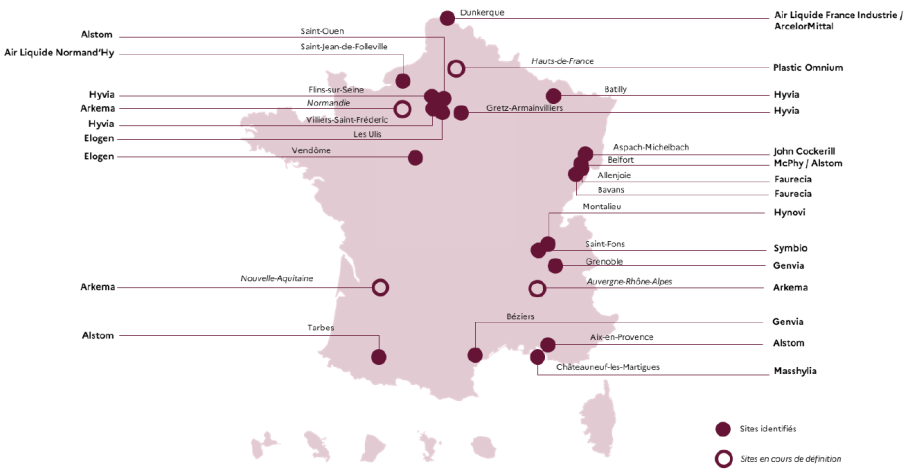

La situation est d’autant plus inquiétante que les attaques matérielles concernent de multiples dispositifs : systèmes de contrôle d’accès, appareils de réseau, systèmes de contrôle industriel, systèmes de surveillance…

Outre l’intégration de portes dérobées (ou backdoor), ces attaques peuvent être utilisées pour de l’écoute clandestine, la génération d’erreurs entraînant l’arrêt d’une machine, le contournement des systèmes d’authentification informatique…

Autant de techniques mises à profit pour de l’espionnage économique ou perturber le bon fonctionnement d’industriels sensibles. Fin 2018, des usines chinoises avaient implanté des puces de surveillance et de contrôle du réseau sur des cartes mères fabriquées pour Supermicro. Quelques années plus tôt, des défaillances surprenantes de composants avaient été détectées chez des entreprises de défense telles que Raytheon, BAE, Northrop Grumman et Lockheed.

Le risque d’acquérir des composants matériels avec une porte dérobée est donc une réalité. Mais les Chinois ne sont pas les seuls à exploiter cette technique. La NSA a aussi demandé aux fabricants américains d’implanter une porte dérobée dans les produits exportés.

Mais comment se protéger face à toutes ces menaces ? « Pour des questions de performances, de nombreux processeurs partagent des zones de mémoire cache, où ils peuvent laisser des informations qui deviennent alors vulnérables. Il faut réfléchir à de nouvelles architectures qui permettent d’isoler physiquement les informations critiques. Mais renforcer la sécurité a forcément un coût. S’il est accepté pour des applications bancaires ou militaires, il sera plus difficile à tolérer pour des usages conventionnels ou domestiques », a prévenu Lilian Bossuet, dans le journal du CNRS.