Par Hubert Blatz

Quelle est la différence entre biocarburants avancés et biocarburants conventionnels ? Quelles technologies permettent de produire des biocarburants avancés ? Quels sont les freins et les leviers pour leur déploiement en France ?

Pour répondre à ces questions, Techniques de l’Ingénieur reçoit Jean-Christophe Viguié, responsable des programmes “biocarburants” à l’IFP Énergies Nouvelles (IFPEN). L’IFPEN a mené plusieurs projets en partenariat avec des industriels et des laboratoires de recherche pour développer des technologies de production de biocarburants avancés.

Vous pouvez écouter l’épisode ici.

Les biocarburants avancés sont « définis par une liste de ressources dans la directive européenne RED II [Directive des Energies Renouvelables, NDLR] », explique Jean-Christophe Viguié. « Ce sont des ressources qui n’entrent pas en compétition directe avec un usage alimentaire. Pour faire simple, ce sont des résidus, des déchets, type résidus forestiers ou les déchets de culture agricole comme par exemple les pailles. » Ils sont ainsi différents des biocarburants « produits à partir de ressources qui entrent en concurrence avec un usage alimentaire ».

« On peut distinguer deux grands types de technologies », signale Jean-Christophe Viguié. Une première catégorie est celle des technologies thermochimiques, où « la biomasse est d’abord déconstruite en la gazéifiant à très haute température », avant de réaliser une synthèse Fischer-Tropsch. « On synthétise donc des carburants “idéaux”, puisque ce sont des carburants de synthèse », remarque le responsable. « La deuxième grande voie est une voie biochimique » qui commence également par une déconstruction de la biomasse mais se termine par une fermentation grâce à des biocatalyseurs afin d’obtenir de l’éthanol.

L’IFPEN a notamment co-développé deux technologies de production de biocarburants avancés : Futurol et BioTfuel. « La technologie Futurol permet de produire de l’éthanol qui est d’abord un carburant pour les véhicules à moteurs à allumage commandé, c’est-à-dire les véhicules à moteur essence. Tandis que les carburants issus de la technologie BioTfuel sont destinés aux moteurs diesel comme ceux équipant les poids lourds par exemple et à l’aviation. »

Pour développer ces technologies, « il faut mettre en place de nombreuses compétences, en chimie, en génie chimique, en hydraulique, en hydrodynamique, en biotechnologie, en économie ou en analyse environnementale ». Ensuite, il faut s’assurer de maîtriser le risque technologique : « Pour cela, après des études en laboratoire, il est souvent nécessaire de passer par une phase de démonstration : construire un ensemble qui va reproduire au plus près l’unité industrielle mais dans une taille plus petite. C’est ce que nous avons fait pour Futurol et BioTfuel. » Le procédé est assez long : il a ainsi fallu 10 ans pour compléter le projet Futurol (de 2018 à 2019) et 11 ans pour BioTfuel (de 2010 à 2021 ; en cours de validation).

Qu’en est-il de la mise sur le marché ? « Le mode de commercialisation retenu est la concession de licence. Et c’est Axens, filiale de l’IFPEN, qui est le vecteur de commercialisation de ces technologies. […] La signature d’une première licence pour cette technologie s’est faite en février 2020, une licence signée avec le raffineur croate Ina. Concernant la technologie BiotFuel, […] le développement de cette technologie se termine en 2021 et donc Axens lancera la commercialisation immédiatement une fois la technologie validée. »

Pour Jean-Christophe Viguié, la France a l’avantage de disposer de très larges ressources agricoles et forestières, sans oublier que le pays a fourni « d’importants efforts de recherche et d’innovation avec le soutien de l’Etat ». Un point bloquant toutefois réside dans la réglementation en vigueur sur les émissions des véhicules : celle-ci « se focalise sur les émissions de CO2 au pot d’échappement, ce qui est un biais dans la réglementation car ce CO2, quand il provient des biocarburants, est compté comme un CO2 qui proviendrait des carburants fossiles ».

Selon l’IFPEN, les filières avancées permettraient de réduire les émissions de gaz à effet de serre par un facteur de 10, par rapport à la référence fossile. « Un véhicule qui roule aujourd’hui avec du biocarburant synthétique présente un bilan plus favorable qu’un véhicule électrique », insiste Jean-Christophe Viguié. Et de conclure : « Les biocarburants et les biocarburants avancés en particulier sont une très bonne solution pour décarboner nos transports. Ils doivent donc être mis en œuvre aux côtés de l’électrification, de l’hybridation, et c’est probablement en combinant toutes ces solutions que nous pourrons atteindre un objectif ambitieux de décarbonation des transports. »

Cogitons Sciences est un podcast produit par Techniques de l’Ingénieur. Cet épisode a été réalisé par Intissar El Hajj Mohamed, en collaboration avec Alexandra Vépierre. Le générique a été réalisé par Pierre Ginon et le visuel du podcast a été créé par Camille Van Belle.

Toutes les entreprises font face à un dilemme. D’un côté, elles constatent que l’exploitation des données crée de la valeur. D’un autre côté, elles sont de plus en plus convaincues que la protection des données à caractère personnel, « c’est bon pour le business ».

Mais comment concilier les deux lorsqu’on utilise de plus en plus de solutions numériques et le cloud qui sont majoritairement détenus par des entreprises de droit américain ? Celles-ci sont en effet tenues de respecter différentes lois des États-Unis et en particulier le Cloud Act. Promulgué en 2018, il permet de « fouiller » dans les données hébergées dans les serveurs d’autres pays, au nom de la protection de la sécurité publique.

De plus en plus d’entreprises et d’instances officielles s’en inquiètent. D’où les deux enquêtes lancées par le Contrôleur. « Suite aux résultats de l’exercice de notification par les institutions et organes de l’UE, nous avons identifié certains types de contrats qui nécessitent une attention particulière, et c’est pourquoi nous avons décidé de lancer ces deux enquêtes », a déclaré Wojciech Wiewiórowski, le Contrôleur.

L’objectif de la première enquête est d’évaluer la conformité des institutions, organes et agences de l’Union européenne avec l’arrêt « Schrems II » (rendu le 16 juillet 2020) lors de l’utilisation du cloud d’Amazon et de Microsoft, lorsque les données sont transférées vers des pays non-membres de l’UE, en particulier vers les États-Unis. La seconde enquête porte sur l’utilisation de Microsoft Office 365 et là aussi sur les transferts de données outre-Atlantique.

« Avec l’arrêt « Schrems I » de 2015, la Cour de justice de l’Union européenne (CJUE) constatait que les États-Unis n’apportaient pas de protection suffisante et équivalente au droit européen concernant les transferts de données personnelles des citoyens européens. La CJUE avait donc invité la Commission européenne à revoir sa copie. Avec « Schrems II », elle constate notamment que les Clauses contractuelles types (CCT) – lorsqu’elles sont intégrées dans les contrats des GAFAM – n’apportent pas toujours de protection suffisante. Ce qui pose problème aujourd’hui, c’est le lien entre les garanties contractuelles et le droit du pays destinataire des données. L’enjeu est de savoir si le droit du pays de l’importateur (les USA en l’occurrence, NDLR) permet aux entreprises de respecter leurs obligations contractuelles de protection des données, compte tenu de la possibilité pour les services de renseignement américains d’avoir accès aux données qu’elles détiennent. Aujourd’hui, les avocats et DPO constatent qu’il y a un transfert de risque vers les responsables de traitement, c’est-à-dire les acteurs qui mettent en place les traitements (entreprises européennes). « Les autorités passent la patate chaude aux acteurs », explique maître France Charruyer, avocate expert en Data protection et cofondatrice du cabinet d’avocats ALTIJ à Toulouse.

Cette problématique de transferts internationaux des données ne concerne pas que les instances européennes. Une majeure partie des entreprises utilisent aujourd’hui des logiciels et infrastructures d’acteurs américains comme Amazon et Microsoft.

« C’est un casse-tête pour de nombreuses entreprises et en particulier pour des PME qui n’ont pas nécessairement les compétences ni les moyens pour faire des analyses des lois de surveillance des pays tiers et des analyses de risques avant toute signature de contrat. Une analyse des lois de surveillance peut s’élever à 250 000 dollars rien que pour le droit américain, selon l’association Renaissance numérique. Il conviendrait de mutualiser ces analyses de la règlementation étrangère et nous militons pour ça au sein de plusieurs associations, afin de permettre aux PME de bénéficier elles aussi de la chaîne de valeur de la data », détaille maître France Charruyer.

Or, les pouvoirs de négociation des entreprises face aux GAFAM sont extrêmement faibles. Dans une résolution du 20 mai 2021, à propos de l’arrêt « Schrems II », le Parlement soulignait que « les PME européennes, ainsi que les organisations et associations à but non lucratif, disposent d’un pouvoir de négociation et de capacités juridiques et financières limités, alors qu’on attend d’elles qu’elles évaluent en autonomie l’adéquation de la protection des données dans des pays tiers, ce qui implique d’appréhender les cadres juridiques complexes de divers pays tiers ».

Ces deux enquêtes du Contrôleur interviennent au moment où de nouvelles Clauses contractuelles types (CCT), relatives au transfert de données vers un pays tiers, sont adoptées par la Commission européenne. Elles détaillent les grands principes à respecter en matière de protection des données personnelles telles que le prévoit le RGPD.

Dans un communiqué, les membres de l’Association française des correspondants à la protection des données à caractère personnel (AFCDP) « restent frustrés par ces clauses contractuelles de la Commission européenne, et inquiets des conséquences de l’adoption de ces CCT pour assurer la protection des données transmises à des partenaires étrangers, en particulier américains ».

Selon ces spécialistes, ces nouvelles CCT « passent entièrement sous silence le fond du problème : alors que c’est bien la surveillance étatique des États-Unis qui a conduit à l’invalidation du « Privacy Shield », ce point n’est pas traité dans les CCT ».

« Nous assistons à un bras de fer entre un marché de 400 millions de personnes, que représente l’Europe, et les États-Unis, constate France Charruyer. Ce sont des enjeux de souveraineté et d’extraterritorialité. Les GAFAM sont là pour faire du business et ils sont dans une logique qui est complètement différente à la nôtre au niveau de l’appréhension du droit. Ils sont sur des logiques « d’auto-conformité » (« auto-compliance » en anglais). Les Européens sont sur des logiques de régulation. C’est devenu une affaire politique ».

2021 marque la dissémination des IoT !

Malgré un début 2021 marqué par la pandémie, on peut espérer une année rythmée par le renouveau des IoT. La course aux innovations ne manque pas de perspectives, et c’est ce besoin insatiable de mouvement qui enclenche de telles évolutions.

C’est pourquoi Techniques de l’Ingénieur est partenaire de cet événement leader permis par la fusion de IoT World et MtoM Embedded Systems. Ce sont les 150 exposants, les 7000 visiteurs et les auditeurs du programme de conférences qui vont bénéficier de cette énergie hors du commun !

Le salon tournera autour d’expositions, de tables rondes, d’ateliers et de conférences, sans oublier les Rendez-vous Business. Vous pourrez également retrouver les animations listées ci-dessous :

IoT Awards

Fiers de votre projet IoT ? Présentez-le gratuitement aux IoT Awards 2021 !

Pour la 5ème année consécutive, un jury de professionnels attribuera le 6 octobre prochain les IoT Awards. Ces prestigieux trophées récompenseront les meilleurs projets IoT (high‐tech, innovant, ambitieux, compliant, Prix du jury). Concourir est gratuit, simple et rapide, directement sur le site : www.iot‐awards.fr.

IoT Financing Desk

Vous cherchez des conseils avisés pour bien financer votre projet IoT ?

Prenez rendez-vous avec nos consultants spécialisés à l’occasion du salon. L’opération IoT Financial Desk consiste à mettre gratuitement à disposition des entreprises une expertise en ingénierie du financement de l’IoT, pour leur permettre d’identifier les dispositifs de financement et en bénéficier pleinement en toute sécurité.

IoT Legal Desk

Vous avez un projet IoT ? Pensez « légal » le plus tôt possible et profitez d’un rendez-vous privé, gratuit et confidentiel avec un cabinet d’avocats présent sur le salon.

Highlight your Deeptech

Vous menez un projet, aidez, hébergez ou avez découvert une start-up dont vous êtes fier, qui a développé un produit ou une solution en rapport avec l’IoT, le MtoM, les objets connectés ?

Vous estimez qu’elle mérite d’être (re)connue ? Inscrivez-la à l’Opération Highlight your Deep-Tech 2021.

Rendez-vous Business gratuit

Seulement 5 minutes pour vous inscrire ! Vous sélectionnez les exposants que vous souhaitez rencontrer sur le site. Les rendez-vous sont organisés avec les exposants que vous aurez sélectionnés. Les rendez-vous de 30 minutes se déroulent directement sur les stands des exposants.

Inscrivez-vous ou demandez votre badge visiteur gratuit et découvrez l’intégralité des programmes de conférences via le site : www.salon-IoT-MtoM.com.

« Les prévisions actuelles de l’utilisation de biomasse dépassent de 50 à 100 % les capacités qui seront disponibles, prévient Per Klevnäs, associé chez Material Economics. Nous devons définir correctement nos priorités pour l’utilisation des matières premières dont nous disposons ». Dans un nouveau rapport, le cabinet de conseil propose en effet de définir de nouveaux usages prioritaires pour la biomasse, très différents des plans actuels. « Les chefs d’entreprise et les décideurs politiques devront s’adapter », ajoute Per Klevnäs.

Les plans actuels de l’Union européenne supposent un doublement de la demande de biomasse au sein des États membres. Entre 2000 et 2019, l’utilisation de la biomasse pour la production énergétique a déjà augmenté de 150 %. Mais ces prévisions sont mises à mal par ce nouveau rapport. Les politiques concernant l’utilisation de la biomasse reposent sur des « connaissances obsolètes datant d’il y a 10 à 15 ans », prévient Material Economics. Face aux nouvelles technologies et aux effets du changement climatique, le cabinet invite à faire évoluer rapidement les priorités.

Material Economics met en garde contre la surestimation de l’offre de biomasse potentiellement disponible. En effet, les forêts, principales fournisseuses de biomasse, sont d’ores et déjà sous une pression importante à cause de la crise climatique. Signe de cet impact concret du changement climatique, mardi, le Haut Conseil pour le climat s’inquiétait du fait que les forêts françaises « n’ont capté que les trois quarts du carbone anticipé » entre 2015 et 2019 à cause de « la diminution de la capacité de stockage de la forêt ».

Pour éviter d’accentuer la pression sur les forêts et les conflits concernant l’utilisation des terres, Material Economics propose de réserver la biomasse à la construction et à certaines utilisations énergétiques à forte valeur ajoutée. Le rapport cite l’exemple du chauffage industriel, de l’aviation et du transport maritime. « D’un point de vue purement économique, la biomasse ne devrait être utilisée pour la production d’énergie que là où une forte valeur ajoutée peut être créée, analyse Sten Nilsson, PDG de Forest Sector Insights. La plus grande valeur ajoutée pour les biocarburants liquides provient des sous-produits de l’industrie de la pâte à papier ». Les experts proposent en échange de répondre aux besoins énergétiques en développant l’énergie éolienne et solaire.

Un tel scénario à valeur élevée réduirait les coûts de 36 milliards d’euros par an, calcule Material Economics. Il éviterait l’émission de 144 millions de tonnes de CO2 par an. Et il éviterait de convertir en cultures énergétiques entre 30 et 40 millions d’hectares de terres. Ce scénario, bénéfique tant d’un point de vue économique qu’environnemental, contribuerait en plus à l’agenda de restauration de la biodiversité des systèmes naturels européens, conclut le cabinet.

A ce jour, près de 26 000 véhicules roulent au BioGNV/GNV en France (+20 % en un an) et l’on dénombrait 4 513 immatriculations de véhicules neufs en 2020, précise le panorama. En outre, sur ce nombre, un véhicule sur cinq est alimenté en BioGNV, la version renouvelable du GNV. En 2020, la filière BioGNV/GNV reste portée par le transport de marchandises avec une amorce très forte par le transport par autocars.

Les bus et autocars (+75 %), et les poids lourds (+24 %), ont enregistré une forte croissance du nombre d’immatriculations. En 2020, pour la première année, plus de bus ont été immatriculés au BioGNV/GNV qu’au diesel en France. Les collectivités, les transporteurs mais aussi la grande distribution plébiscitent ce carburant qui s’impose comme l’alternative économique et écologique au diesel. D’autant que tous les véhicules roulant au gaz, quelle que soit leur année d’immatriculation, bénéficient de la vignette Crit’Air 1, ce qui les autorise à circuler lors des pics de pollution et dans les Zones à faibles émissions (ZFE). Le parc de véhicules lourds au GNV se répartit comme suit : 44 % poids lourds, 34% bus, 17% bennes à ordures et 5% autocars. Pour les poids lourds, près d’un camion sur 20 est alimenté au GNV (GNC – gaz naturel comprimé – ou GNL – gaz naturel liquéfié). Le dispositif de suramortissement pour les véhicules de plus de 2,6 tonnes est une mesure fiscale qui soutient le développement du transport au GNV. Il s’applique jusqu’à fin 2024 et peut aller jusqu’à 60 %, rappelle l’AFGNV. Le panorama souligne aussi le décollage des autocars fonctionnant au GNV. Entre 2019 et 2020, la flotte des cars alimentés en GNV a plus que doublé, passant de 122 à 355 unités.

Côté collectivités, Ile-de-France Mobilités a par exemple engagé un plan de conversion de l’ensemble de sa flotte en véhicules propres d’ici 2025, dont 70 % de bus roulant au BioGNV. Les villes de Dax, Saumur, Toulon ou Chamonix ont rejoint cette année la liste des collectivités adeptes du BioGNV/GNV.

Fin 2020, on comptait 175 points d’avitaillement ouverts au public. D’ores et déjà, la France détient le premier réseau européen de stations pour avitailler les poids lourds roulant au gaz. Une partie de ces stations est implantée sur autoroutes, contribuant au maillage du continent et facilitant la traversée de l’Europe par les transporteurs routiers. D’autant que l’avitaillement est extrêmement rapide : 10 minutes environ pour un plein de gaz, comme pour un poids lourds traditionnel, insiste le rapport de l’AFGNV. En outre, « malgré la crise sanitaire, 2020 est une année record en termes de mises en service, avec 44 nouveaux points d’avitaillement, dont 25 distribuent du BioGNc et 13 du GNL, et trois fois plus d’avitaillement en trois ans ».

Un palier devrait encore être franchi en 2021, puisqu’une centaine de nouvelles stations publiques devraient ouvrir, auxquelles il faut ajouter environ 200 stations privatives (pour les flottes d’entreprises et les collectivités, les transports publics, etc.), signe que le BioGNV/GNV connait un véritable essor.

« Mon ambition, comme président de l’AFGNV, est de confirmer aux pouvoirs publics que le GNV et le BioGNV ont leur place dans le mix énergétique pour décarboner le transport », a indiqué Guillaume Larroque, à l’occasion de la présentation du panorama.

« En novembre 2014, l’Europe a produit la Directive ‘Infrastructures pour les carburants alternatifs’ qui imposait à chaque Etat membre de définir la feuille de route pour déployer, d’ici 2025, des réseaux publics d’avitaillement pour le gaz naturel, l’électricité et l’hydrogène. Je note que notre filière a largement dépassé, en 2018, l’objectif que s’est fixé la France pour 2025 », a rappelé Gilles Durand, secrétaire général de l’AFGNV.

Version 100 % renouvelable du GNV produite localement à partir de déchets organiques, le BioGNV permet quant à lui de réduire de 80 % les émissions de CO2 par rapport au diesel. Les véhicules roulant au gaz sont également deux fois moins bruyants que des véhicules diesel équivalents.

Terminologie des gaz pour véhicules (source panorama BioGNV, AFGNV)

Gaz naturel véhicule. GNV est le nom donné au gaz naturel lorsqu’il est utilisé comme carburant pour la mobilité.

Version renouvelable du GNV. Le BioGNV a les mêmes caractéristiques que le GNV et tous les véhicules gaz sont compatibles avec ce biocarburant. La seule différence réside en son mode de production. Le BioGNV est produit localement à partir de la méthanisation de déchets organiques (déchets agricoles, alimentaire, etc.).

Gaz naturel comprimé. Le gaz est comprimé à 200 bar dans les réservoirs. Il existe des GNC et des bioGNC.

Gaz naturel liquéfié. Pour obtenir du GNL, le gaz est liquéfié à -162 °C, ce qui permet d’avitailler de plus grandes quantités de carburant et d’obtenir des autonomies comparables à celles du diesel. Ce carburant est réservé aux poids lourds.

En 2015, deux chercheurs de l’Université d’Avignon – Laurent Urban, professeur en agronomie et écophysiologie végétale et Jawad Aarrouf, maître de conférences en biologie et pathologies végétales – découvrent que les flashs d’UV-C viennent activer la résistance des plantes face à divers pathogènes. L’année d’après, ils présentent leur nouvelle technologie à Yves Matton, le cofondateur de Technofounders, un start-up studio spécialisé dans la création de jeunes sociétés technologiques. Des études de marché sont réalisées et révèlent qu’il est possible de valoriser cette technologie dans le secteur agricole, notamment celui de la viticulture, pour traiter les maladies fongiques. En 2016, tous les trois décident de créer la start-up UV Boosting. Depuis le printemps, l’entreprise a lancé officiellement la commercialisation d’un équipement pour traiter les vignes. Rencontre avec Yves Matton, le directeur technique d’UV Boosting.

Yves Matton : Elle consiste à appliquer des flashs d’UV-C pendant moins d’une seconde sur les plantes. Ces flashs vont venir activer leur système immunitaire, car ils transmettent un message à la plante lui indiquant qu’elle doit se préparer à une potentielle agression. Nous avons démontré, grâce à une cartographie des gènes, que le procédé active plus de 200 gènes de défense, connus pour être mis en œuvre par la vigne en réponse à l’agression d’un pathogène comme l’oïdium et le mildiou. Ces deux champignons représentent environ 80 % des traitements pesticides utilisés sur les vignes. Notre procédé va venir préparer la plante à cette agression. Et dans le cas où un champignon se présente, la plante va réagir de manière plus rapide et plus forte. Elle est donc capable de limiter par elle-même le développement de la maladie.

Depuis 2016, nous avons réalisé de nombreux essais en laboratoire et à partir de 2017 sur des vignes. Nous avons ainsi quatre saisons de recul sur de nombreux vignobles du sud-est, du Bordelais, de la Bourgogne, de la Champagne, et même à l’international en Afrique du Sud. Nous comparons toujours les modalités d’un traitement antifongique à pleine dose, allégé, ou très allégé avec ce même traitement, mais complété par des flashs d’UV-C. A chaque fois, nous observons une diminution des symptômes sur la vigne de l’ordre de 50 % grâce à notre technologie. Cela signifie qu’en situation standard, la perte de rendement suite à l’arrivée d’une maladie est divisée par deux.

Sur le marché, il existe des simulateurs de défense des plantes (SDP) vendus par des firmes phytosanitaires qui viennent aussi activer leur système immunitaire mais leur formulation manque de stabilité et leur efficacité n’est pas constante. Notre procédé a démontré un niveau de répétabilité très élevé c’est-à-dire que quel que soit le vignoble, l’année, et même le type de plante – car ces flashs lumineux ne sont pas seulement efficaces sur la vigne – les résultats sont extrêmement répétables. De plus, nous n’utilisons aucun produit chimique alors que les SDP en contiennent.

L’équipement s’installe à l’avant ou à l’arrière des tracteurs. Il se présente sous la forme de panneaux verticaux qui émettent des flashs lumineux et qui circulent le long de chaque plant de vigne. Il coûte 36 000 euros pour le modèle un rang et 54 000 euros pour deux. Ce procédé est principalement préventif, il faut donc commencer à l’utiliser dès le début de la saison, avant l’apparition des symptômes et ensuite en entretien pendant toute la saison. Pour la viticulture, on commence au stade des premières feuilles et ensuite, il faut poursuivre tous les 10 à 15 jours jusqu’à la véraison qui se situe dans le courant du mois de juillet. Entre 8 à 10 passages sont donc à effectuer suivant la région et la pression des maladies. Nous travaillons à l’optimisation de notre système afin de réduire le nombre total de ces passages. Il faut savoir que l’indice de fréquence des traitements (IFT) est d’environ 15 passages en viticulture avec des différences selon les régions, et cela peut même monter jusqu’à 19 ou 20.

Depuis le printemps, nous commercialisons un équipement adapté à la vigne. Il s’adresse aux viticulteurs qui souhaitent alléger leurs traitements chimiques. Notre solution permet en effet de réduire l’usage des pesticides de 30 à 60 %. Actuellement, il y a une très forte accélération des conversions en agriculture biologique dans la viticulture. Les viticulteurs ont alors à leur disposition beaucoup moins de produits pour protéger leurs cultures, principalement du cuivre et du souffre, mais leur durée d’efficacité n’est pas très longue. Ils voient notre solution technologique comme une façon de limiter la perte de rendement en cas de saison propice au développement de maladies.

Nous développons aussi notre procédé pour la fraise ; l’équipement devrait être commercialisé durant la deuxième partie de l’année. L’intérêt est le même que pour la vigne, c’est-à-dire de sécuriser les rendements face à l’arrivée de maladies, notamment l’oïdium et le botrytis. Après le passage de notre équipement, il n’y a pas de délai avant de pouvoir ré-entrer dans les serres ou pour récolter les fruits. C’est un atout important, car après l’utilisation de produits chimiques, il faut attendre avant de pouvoir pénétrer à nouveau dans les serres et cueillir les fraises. En pleine saison, cette contrainte peut pénaliser les rendements, car la cueillette doit être journalière afin de récolter le fruit au bon stade de maturité.

Le mécanisme de notre technologie est assez universel, nous lançons des partenariats de recherche pour qualifier son efficacité et optimiser son utilisation sur d’autres plantes : asperges, tomates, pommiers…

Thomas Pesquet a cumulé pas moins de trois sorties extravéhiculaires au mois de juin. En effet, les 16, 20 et 25 juin derniers, l’astronaute français, accompagné de son collègue américain Shane Kimbrough, ont installé des panneaux solaires nouvelle génération, appelés iRosa. L’opération, plus longue que prévue, a nécessité une troisième sortie, afin d’installer les deux panneaux.

Vous pouvez revivre ces missions en time laps grâce aux vidéos ci-dessous.

Première sortie

Deuxième sortie

La troisième et dernière sortie, en vitesse réelle

Thomas Pesquet totalise désormais plus de trente heures de sorties extravéhiculaires, ce qui en fait le recordman français en la matière. Il dépasse Philippe Perrin, qui avait totalisé plus de 19 heures de sorties, lors de son unique passage à bord de l’ISS, en 2002.

Lors de sa première sortie dans l’espace, Thomas Pesquet a également failli battre le record de la sortie extravéhiculaire la plus longue pour un Français, également détenu par Philippe Perrin avec 7 h 17 min. Il a manqué deux minutes à Thomas Pesquet, dont la mission, rallongée à cause d’un imprévu, a duré plus longtemps que planifié.

Trois taïkonautes, qui avaient décollé le 17 juin depuis le sol chinois à bord du Shenzhou 12, sont à bord de la station spatiale chinoise CSS.

Après s’être amarrés avec succès au module central, les trois astronautes sont entrés, après des heures de préparatifs, dans le module orbital de «leur» station spatiale.

Des images de cette première ont été fournies par l’agence spatiale chinoise, et sont disponibles ici. Comme nous l’expliquions dans l’article du mois dernier, la station spatiale chinoise pourrait dans les années qui viennent devenir la seule exploitable. Alors que la station spatiale internationale devrait prendre sa retraite en 2024, CSS, le module chinois, doit être prêt pour 2022. A l’origine, les chinois avaient été interdits par la Nasa de participer au développement et à l’exploitation de l’ISS. C’est pour cette raison que la Chine a développé sa propre station : les autorités chinoises ont d’ors et déjà assuré que leur station accueillerait des astronautes du monde entier : «A ce stade, nous n’avons pas envisagé la participation d’astronautes internationaux, mais elle sera garantie», a en effet déclaré Zhou Jianping, le concepteur principal des programmes spatiaux habités chinois.

La méga fusée SLS de la Nasa est actuellement en cours d’assemblage. La plus grande fusée jamais construite emmènera en 2023 des astronautes sur le sol lunaire, pour y préparer une future base lunaire.

Les dimensions de cette fusée sont effarantes, l’étage central mesurant près de 65 mètres. Il abrite les réserves de propergol, alors que deux propulseurs latéraux, mesurant 54 mètres, assureront la poussé de la fusée lors de ses deux premières minutes de vol.

Ci-dessous, vous pouvez suivre en time laps l’assemblage de la fusée, réalisé le 14 juin dernier :

Par Pierre Thouverez

Image d’illustration : les taïkonautes à bord de la station chinoise ©CMSA

Depuis quelques années, l’introduction de l’IA dans le secteur des transports a apporté de nombreuses améliorations. L’entreprise londonienne Predina, qui a bénéficié du soutien du programme britannique Intelligent Mobility (IM) Accelerator, a créé un système permettant de prédire et de réduire de manière dynamique le risque d’accident grâce à l’IA. Cette technologie permet aussi d’optimiser les batteries des bus électriques comme le fait BluWave-ai au Canada.

L’IA peut être également utilisée pour réduire les embouteillages sur les routes, ce qui permet de fluidifier le trafic. Grâce à sa solution basée sur l’IA, la société Notraffic permet d’améliorer la gestion des carrefours. Selon ses tests, elle permet de réduire de 40 % le retard des véhicules.

Basée en Californie, mais fondée par des Israéliens, cette entreprise a installé sa solution dans des carrefours de Los Angeles, ainsi qu’à Phoenix, en Arizona. Cinquième ville des États-Unis, elle est la 25e agglomération la plus encombrée des États-Unis, selon une étude menée par Inrix en 2017.

Grâce à l’IA, le délai moyen de l’intersection est passé de 29,50 secondes à 13,65 secondes et les délais de la circulation transversale sont passés de 26,83 secondes à 12,38 secondes. Les piétons devaient attendre 42,21 secondes auparavant. Après l’installation du système de Notraffic, ils attendent 10 secondes de moins.

NoTraffic utilise des capteurs IA aux intersections pour analyser le trafic et optimiser les feux de circulation. Cette approche proactive contraste avec la solution habituelle qui s’appuie sur des détecteurs de trafic à boucle inductive (ou « boucle électromagnétique ») placés dans la chaussée. Ces capteurs sont associés à des détecteurs qui sont reliés à des systèmes logiques ou informatiques chargés de traiter les informations.

Comme ces boucles électromagnétiques sont installées sous terre, leur mise à niveau ou leur remplacement n’est pas facile. Mais surtout, s’ils peuvent minimiser ou maximiser la durée d’un feu, les détecteurs ne peuvent pas l’annuler, même si aucune voiture n’arrive dans sa direction.

Grâce à l’intelligence artificielle, le système de NoTraffic réduit les coûts d’installation et de maintenance et permet aux carrefours d’être plus réactifs en fonction du trafic. Pour cela, NoTraffic installe des capteurs d’intelligence artificielle dans toutes les directions d’une intersection. Les données sont analysées près de 15 fois par seconde.

Ce système intègre également des capacités de véhicule connecté basées sur les communications dédiées à courte portée (DSRC- Dedicated short-range communications) et le système cellulaire de véhicule à véhicule (CV2X- Cellular-V2X). Les unités de NoTraffic détectent et classent tous les usagers de la route y compris les vélos et les piétons. Enfin, une connexion 4G assure la synchronisation des signaux avec les carrefours voisins.

L’analyse en temps réel permet même de prédire des collisions en tenant compte de la vitesse, de l’accélération et de la direction des véhicules. Enfin, cette solution a la capacité de classer les véhicules afin de donner la priorité à certains comme les transports publics, les ambulances ou les piétons aux carrefours situés près d’écoles. L’entreprise prévoit d’être présente sur 41 marchés d’ici à la fin 2021.

Le 15e rapport annuel du Boston Consulting Group (BCG), intitulé « Overcoming the Innovation Readiness Gap », définit les 50 entreprises les plus innovantes du monde. Abbott Labs, AstraZeneca, Comcast, Mitsubishi et Moderna rejoignent le top 50 des entreprises les plus innovantes pour la première fois cette année.

Les entreprises qui progressent le plus rapidement sont Toyota, qui passe de la 41e à la 21e place, Salesforce, qui passe de la 35e à la 22e place, et Coca-Cola, qui passe de la 48e à la 28e place.

Principal enseignement de cette enquête reposant sur des entretiens avec 1 500 responsables de l’innovation dans le monde : l’innovation est aujourd’hui l’une des trois principales priorités de leur entreprise.

Créer un nouveau vaccin COVID-19 en moins d’un an (Pfizer, Moderna et Merck & Company), inventer des kits de test en quelques semaines (Abbott Labs) ou redéfinir l’achat en ligne et la livraison à domicile sécurisée reflètent la polyvalence des entreprises les plus innovantes du monde en 2021. L’expertise d’Amazon et de Walmart en matière de logistique et de commerce électronique a permis de garantir la sécurité des achats en ligne et la rapidité de la livraison à domicile à des millions de personnes sous le coup d’un ordre de rester à la maison.

Il n’y a pas un secteur plus favorable qu’un autre à l’innovation. Mais le BCG pointe cinq facteurs qui différencient le plus les entreprises innovantes et celles qui sont à la traîne. Les cinq facteurs qui indiquent le mieux le potentiel d’innovation d’une entreprise sont les suivants :

Principal constat, le manque de collaboration entre les ventes, le marketing et la R&D est le principal obstacle à l’innovation. Un tiers de toutes les entreprises interrogées considèrent en effet qu’une mauvaise collaboration entre le marketing et la R&D est l’obstacle le plus important à l’amélioration du rendement de leurs investissements en matière d’innovation.

Dans un monde hyperconnecté, la transformation numérique de l’activité principale est désormais une priorité absolue pour 75 % des PDG et 65 % des entreprises qui accélèrent ce type de projet.

Là aussi, le BCG a identifié six facteurs de réussite qui, ensemble et seulement ensemble, font passer les chances de réussite de la transformation numérique de 30 % à 80 %. Ces six facteurs de réussite sont l’intégration étroite de la stratégie numérique à la stratégie commerciale, l’engagement du PDG jusqu’à l’encadrement intermédiaire, un noyau de talents composé d’experts du numérique, des plateformes technologiques et de données flexibles et axées sur les besoins de l’entreprise, une gouvernance agile et un suivi efficace de la progression vers les résultats définis.

Ce rapport en conclut que les entreprises qui sont à l’écoute des besoins de leurs clients afin d’orienter leur R&D ont « un avantage décisif pour devenir des leaders de l’innovation ». Savoir prendre des risques est également payant selon le BCG. La course aux vaccins contre la COVID-19 l’a cruellement rappelé…

Restaurer un écosystème pris d’assaut par une espèce invasive a d’autant plus de chances de succès que sa détection est rapide. L’hydrobie des antipodes (Potamopyrgus antipodarum, une espèce de mollusque originaire de Nouvelle-Zélande), après être arrivée par le Nord-Ouest de l’Amérique du Nord et avoir traversé les Grands Lacs, s’attaque désormais à la conquête de sa partie Est. Pour vérifier sa progression, des biologistes menés par l’université de l’Iowa ont personnalisé la technique de l’ADN environnemental (eDNA), permettant l’identification d’espèces invasives. Dans leur papier sorti le 1er juin 2021 dans Biological Invasions, les chercheurs décrivent la collecte d’échantillons sur huit sites, répartis sur six rivières de la Pennsylvanie centrale. Résultats : cinq des huit sites ont révélé la présence de l’hydrobie des antipodes. L’un des sites a même eu droit à une vérification physique de la présence de l’espèce, qui peut couvrir le fond de l’eau à hauteur de plus de 500 000 individus pour moins d’un mètre carré, expulsant par la même occasion les précédents habitants. Cette étude montre que des efforts peu coûteux et adaptables à la science citoyenne suffisent pour surveiller de potentiels invasions dans le futur.

Les baleines franches de l’Atlantique Nord comptent parmi les espèces marines les plus en danger. Pour communiquer, les 350 derniers individus échangent des appels et des sons proches de coups de feu. Des signaux audios qu’il est important de capter, afin que les navires changent de course. En effet, les baleines franches peuvent se retrouver emmêlées dans les filets de pêche ou même blessées par les bâtiments. Malheureusement, capter leurs vocalisations n’est pas simple car elles sont souvent contaminées par les activités humaines, comme le forage offshore. Une solution consisterait en des systèmes automatisés, placés sur des bouées comme sur des planeurs, et capables de trier les signaux reçus. C’est ainsi que les chercheurs de la University of East Anglia, associés notamment à l’Association Écossaise pour la Science Marine, se sont retrouvés à travailler sur une méthode de deep learning afin de retirer les bruits parasites. Leur technique, décrite le 3 juin 2021 dans The Journal of the Acoustical Society of America, repose sur deux approches séparées employées en imagerie. Ils disposent ainsi d’un réseau neural convolutionnel et d’un autoencodeur, débruitant tous deux les spectrogrammes du signal audio contaminé. Des tests ont été effectués avec l’ajout artificiel de bruit blanc, de pétrolier et de chalutier, et semblent concluants pour l’avenir.

Un des matériaux naturels les plus résistants est la soie d’araignée. Sa fabrication passe par la dissolution de la protéine de soie dans une solution aqueuse, puis par un filage résultant en une fibre ultrasolide. Les chercheurs de l’université de Cambridge s’en sont inspirée en employant une protéine de soja – les protéines de plantes étant abondantes et biodégradables. Leur idée ? Remplacer à terme les systèmes à base de pétrole. Leur méthode d’assemblage autonome contrôlé est rapportée dans le papier du 10 juin 2021 de Nature Communications. Ils ont notamment pallié le problème de la faible solubilité par un mélange eau-acide acétique, associé à de l’ultrasonication à hautes températures. Le résultat leur a permis de travailler aux échelles micro et nano pour former des surfaces hydrophobes, et des couleurs. Le film final possède une haute transparence avec des propriétés mécaniques robustes, dignes des plastiques actuels, et sans emploi de solvants toxiques. De plus, il est compostable directement à la maison, contrairement à d’autres bioplastiques qui réclament un compostage industriel. Une première étape devrait consister à remplacer les plastiques des tablettes de lave-vaisselle et les capsules de machines à laver.

Cette idée repose sur deux principales confusions. Premièrement, beaucoup de personnes font l’amalgame entre blockchain, cryptomonnaies et bitcoin alors que ces notions sont assez différentes. La blockchain est une technologie de registres distribués qui forme une « chaîne de blocs » . Une cryptomonnaie est une forme numérique de monnaie et les transactions sont suivies et archivées dans une blockchain chiffrée et publique. Et deuxièmement, trop de personnes confondent consommation et pollution. « On considère que toute consommation est synonyme de pollution : ça consomme beaucoup, donc ça pollue. De nombreuses études ne font pas de distinction entre énergie propre, renouvelable ou non carbonée. Or, 70 % de l’énergie utilisée par les blockchains est non carbonée et en bonne partie renouvelable donc quasiment non polluante », précise Renaud Lifchitz, expert en cybersécurité chez Holiseum et spécialiste en cryptomonnaie. Dans un article qu’il a rédigé, il précise également que « l’essentiel de la production électrique est de toute façon perdu (près de 70 % aux USA en 2019), la consommation énergétique du bitcoin est à côté très négligeable ».

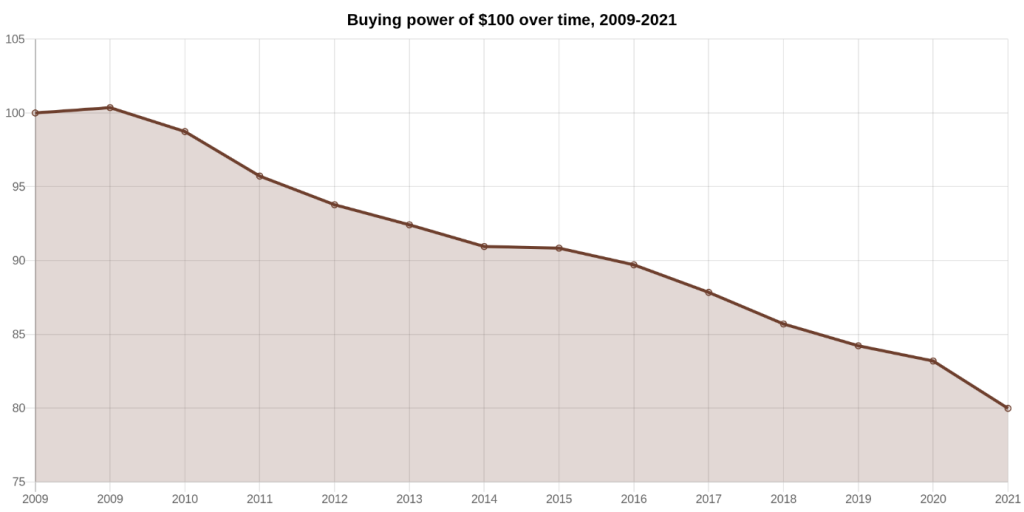

Le principal usage est de stocker de la valeur. C’est la même chose qu’avec l’or sauf que c’est dématérialisé. Le stockage et le « transport » du bitcoin, sur une clé, sont donc moins coûteux et compliqués que celui des lingots. « Contrairement aux monnaies fiduciaires, le bitcoin est une monnaie déflationniste, car il y a un nombre limité d’unités (il n’y aura pas plus de 21 millions d’unités de bitcoin) ; ça ne peut que s’apprécier à long terme. Avec les monnaies fiduciaires, la baisse du pouvoir d’achat a été très élevée », précise Renaud Lifchitz. En 2020 le pouvoir d’achat a baissé de 19 % par rapport à 2009. Dans l’exemple ci-dessous (cf. graphique), 100 dollars en 2009 ne valent plus que 84 dollars 11 ans plus tard à cause de l’inflation. Les cryptomonnaies ne suivent donc pas la logique keynésienne qui préfère que l’argent soit dépensé au plus vite, quitte à s’endetter pour consommer, plutôt que d’épargner en permanence.

Il est souvent associé à la drogue, au blanchiment d’argent et au terrorisme. Mais différentes études, menées notamment par Europol et Chainalysis, montrent au contraire que les usages illicites sont en dessous des 1 %, ce qui est largement inférieur aux pratiques illégales faites avec de la monnaie fiduciaire. Les activités illicites en cryptomonnaies représentent 0,3 % à 3 % des volumes d’échanges selon les études, soit 10 fois moins que les monnaies fiduciaires en pourcentage et 100 à 1 000 fois moins en volume financier !

Cette idée que le « bitcoin est sale » avait été diffusée par les banques qui voyaient d’un mauvais œil l’intérêt grandissant pour le bitcoin. Pourquoi les usages illicites du bitcoin ne sont-ils pas plus répandus ? Pour Renauld Lifchitz, il s’agit d’une « technologie encore jeune qui n’est pas encore bien maîtrisée par des groupes terroristes ou mafieux et qui est facilement traçable ».

« Le bitcoin est une jungle qui tend à devenir une forêt plutôt qu’un coupe-gorge où il n’y aurait que des margoulins et des fraudeurs. Il y a une régulation qui est de plus en plus présente qui n’est pas là pour interdire, mais pour accompagner », insiste maître Hubert de Vauplane, avocat au barreau de Paris, qui co-dirige l’activité FinTech au sein du cabinet Kramer Levin Naftalis & Frankel LLP.

C’est faux. Aujourd’hui, la surveillance s’intensifie avec les normes de connaissance du client (KYC) et d’anti-blanchiment (AML) imposées aux plateformes d’échange et autres services, ce qui est en train de créer un vrai fichage de la chaîne.

« Cette régulation s’explique par deux points. Les régulateurs nationaux veulent s’assurer qu’il n’y a pas d’opportunités de blanchiment. Deuxièmement, certaines banques peuvent penser que cela pourrait ébranler le système bancaire », explique maître Hubert de Vauplane.

À terme, la surveillance du bitcoin pourrait mener à une perte de confidentialité pour l’ensemble des utilisateurs. Selon Renaud Lifchitz, « il y a plein d’exemples qui montrent justement que le bitcoin ne garantit pas l’anonymat ». Ce fut le cas récemment avec l‘attaque de ransomware (ou rançongiciel) qui a touché Colonial Pipeline, début mai, et qui a fortement perturbé la distribution de carburants sur la côte est des États-Unis durant une semaine. « Les trois quarts de la rançon ont été retrouvés par le FBI, car les fonds n’étaient pas assez bien protégés par les pirates et parce qu’il y a justement une traçabilité qui est bien meilleure que celle de l’argent fiduciaire. Là aussi, les personnes confondent anonymat et pseudonymat ».

Avec le bitcoin, on a des comptes numérotés comme ceux que nous avons avec notre compte courant et dès qu’on entre ou sort de la blockchain, on passe par un échange qui est connecté au système bancaire et donc il n’y a pas d’anonymat. Une personne qui achète ou vend des cryptomonnaies est donc parfaitement identifiée. C’est ainsi que la police a pu tracer et saisir les fonds de plusieurs centaines de trafiquants.

« Aujourd’hui certaines bandes de cybercriminels utilisent des cryptomonnaies qui assurent une meilleure anonymisation comme Monero et Zcash. Ils évitent un traçage des flux, car on ne voit pas nécessairement l’émetteur, le récepteur et le montant », indique Renaud Lifchitz.

Pour maître Hubert de Vauplane, « le bitcoin doit être considéré comme une nouvelle classe d’actifs, au même titre que le bois ou l’or pour lesquels on escompte un rendement, d’où des spéculations. C’est un marché qui a les défauts de sa jeunesse, notamment sa volatilité. Mais elle n’est pas plus impressionnante que celle de certaines matières premières rares ».

Début avril, un épisode de gel tardif entraînait des pertes économiques évaluées à près de deux milliards d’euros pour l’agriculture française. Face à de telles répercussions, le réseau international World Weather Attribution qui analyse fréquemment le lien possible entre un événement météorologique extrême et le réchauffement climatique s’est emparé du sujet. Les scientifiques concluent que le changement climatique a augmenté de près de 60 % la probabilité qu’un tel épisode de gel tardif se produise en France en présence de feuilles, bourgeons et de fleurs. Le réchauffement des températures hivernales a en effet avancé la saison de croissance des plantes, rendant alors les cultures plus vulnérables aux épisodes de gel tardif.

Samuel Morin, directeur du Centre national de recherches météorologiques, unité mixte CNRS/Météo France rappelle à l’AFP qu’on « ne peut pas dire d’un événement météo ponctuel : ‘c’est à cause du changement climatique’, mais on peut mesurer à quel point le changement climatique a modifié la probabilité que cet événement puisse se produire ». S’il n’a pas personnellement participé à l’étude, trois autres chercheurs de Météo-France co-signent le rapport, aux côtés de scientifiques de l’Institut Pierre-Simon Laplace, de l’Institut météorologique royal des Pays-Bas, de l’Université d’Oxford et de l’Institut Max Planck de biogéochimie d’Iéna.

L’analyse a porté sur la Champagne, la Vallée de la Loire et la Bourgogne et montre deux effets opposés. Sous l’effet du réchauffement climatique, les températures les plus basses entre avril et juillet ont augmenté de 1,2°C dans les régions étudiées. Le réchauffement du climat a donc rendu cette vague de froid en avril moins probable. Mais les hivers étant désormais plus chauds, la saison de croissance se déroule plus tôt dans l’année. Ainsi, le changement climatique rend possible l’apparition de feuilles et de fleurs beaucoup plus tôt dans l’année. « Les cultures démarrent leur croissance plus tôt dans l’année, ce qui les rend plus exposées et vulnérables aux basses températures », prévient l’étude.

« Il y a un paradoxe apparent : le réchauffement climatique peut conduire à une augmentation des dommages causés par le gel, explique Robert Vautard, chercheur au Centre national de la recherche scientifique (CNRS) et à l’Institut Pierre-Simon Laplace. Nos résultats montrent que la saison de croissance commence plus tôt à cause du changement climatique et que les périodes de gel deviennent moins sévères, mais le premier effet est plus important que le second. Par conséquent, la vigne pousse et mûrit plus vite maintenant, mais cela la laisse plus exposée à d’éventuelles vagues de froid. »

Environ 95 % de la production mondiale d’hydrogène est fabriquée grâce à la technologie SMR (Steam methane reforming) à partir du gaz naturel ou grâce au procédé de gazéification du charbon. Cet hydrogène est qualifié de « gris » car sa production émet des quantités importantes de CO2. On parle de plus en plus de l’hydrogène « vert » produit grâce à l’électrolyse de l’eau à partir d’énergies renouvelables de type solaire ou éolien. Il existe également une troisième voie, peu développée sur le plan industriel, car difficile à mettre en œuvre économiquement, et qui consiste à procéder à la pyrolyse du méthane. Cet hydrogène que l’on nomme « turquoise », Materia Nova y croit beaucoup. Cet institut de recherche, situé à Mons en Belgique, développe actuellement une nouvelle technologie par pyrolyse plasma dite hybride en vue de l’industrialiser.

Plusieurs solutions technologiques peuvent être mises en œuvre pour réaliser la pyrolyse du méthane. Celle développée par Materia Nova est une adaptation d’un procédé appelé Kvaerner, mis au point en 1990, et aujourd’hui en phase de commercialisation par la société américaine Monolith. Mais selon Fabrizio Maseri, responsable du programme manager chez Materia Nova, cette technologie souffre de rendements limités et son plasma est mal utilisé : « ce plasma sert en effet à chauffer le gaz à près de 2 000 degrés kelvin afin de mettre en œuvre la pyrolyse thermique classique, déclare-t-il. De notre côté, nous utilisons d’autres types de plasmas dits hybrides, dont je ne peux pas dévoiler le nom pour des raisons de confidentialité, afin d’utiliser non seulement l’énergie thermique qu’ils contiennent, mais aussi l’énergie électronique et vibratoire. Cette différence permet de dissocier le méthane sans monter aussi haut en température. On évite ainsi les problèmes d’usures des matériaux qui ont des difficultés à résister à des températures si élevées et il n’est pas nécessaire d’arrêter le procédé tous les jours pour le nettoyer. On peut ainsi mettre au point un processus industriel qui tourne 24h sur 24 et à bas coût. »

Selon l’institut belge, leur technologie consomme intrinsèquement près de huit fois moins d’énergie que l’électrolyse de l’eau : 18,5 MJ (Mégajoules) par kg d’hydrogène produit contre 143. Cette différence s’explique par le fait qu’il est beaucoup plus facile de dissocier des molécules de méthane que d’eau. La pyrolyse plasma présente aussi l’avantage de ne pas consommer d’eau, un atout face à cette ressource limitée. Il faut savoir qu’environ 10 tonnes d’eau sont nécessaires pour produire une tonne d’hydrogène vert et entre 20 et 2 tonnes pour l’hydrogène gris.

Sur le plan des émissions de CO2, cette nouvelle technologie n’en produit aucun car la pyrolyse plasma est réalisée en absence d’oxygène. La technologie SMR en émet, quant à elle, entre 10 à 12 tonnes par tonne d’hydrogène. « Concernant l’électrolyse de l’eau, il est faux de dire qu’elle est neutre sur le plan du carbone, explique Fabrizio Maseri. Il faut en effet intégrer le CO2 produit pour construire les équipements qui produiront de l’électricité. Sur la base d’une analyse de cycle de vie, l’émission d’un parc éolien est de 11 g de CO2 équivalent par kWhe (kilowattheure électrique) et celle d’un parc solaire de 50. De plus, il n’est pas possible d’utiliser de l’eau usée, ni de l’eau de mer pour réaliser l’électrolyse, car l’eau doit être extra-pure. Il est donc nécessaire de procéder à des traitements de l’eau, comme l’osmose inverse pour la purifier, mais qui produisent du CO2. »

Dès 2022, Materia Nova souhaite démarrer la mise en place d’un projet visant la production d’hydrogène par pyrolyse plasma grâce à un partenariat d’industriels, avec l’objectif de mettre en place un pilote préindustriel produisant 1 000 tonnes d’hydrogène chaque année. Une grande partie du méthane utilisé pour ce pilote proviendra du gaz naturel et sera donc d’origine fossile. « Nous sommes obligés de privilégier le gaz naturel car il est disponible en grande quantité et nous avons besoin de volumes importants », complète Fabrizio Maseri.

Une petite fraction du méthane aura aussi pour originalité de provenir du gaz de mines, car même fermées, les mines de charbon situées en Wallonie mais aussi ailleurs en Europe continuent à produire du grisou qui s’échappe à l’air libre. « Il est très utile d’éviter ces émissions en les valorisant, car le méthane est un puissant gaz à effet de serre, 23 fois plus puissant que le CO2 selon le GIEC, précise Fabrizio Maseri. De notre côté, on considère qu’il est même jusqu’à 40 fois plus puissant ». Du biométhane sera aussi utilisé pour alimenter la pyrolyse plasma. Étant donné qu’il contient une part élevée de CO2, des prétraitements seront donc réalisés pour le concentrer en méthane à des concentrations équivalentes à celle du gaz naturel.

L’objectif de Materia Nova est de réussir à produire cet hydrogène turquoise à un prix aussi compétitif que l’hydrogène gris, et participer à la décarbonation de l’industrie belge. Pour cela, l’Institut souhaite aussi valoriser le carbone solide, issu comme l’hydrogène, de la pyrolyse du méthane. Ce composé, également appelé « noir de carbone », est en effet utilisé pour fabriquer des pneus ou des colorants qui sont ensuite incorporés dans des peintures et des plastiques noirs. Il peut également servir à la fertilisation des sols en agriculture. « Il est actuellement produit à partir de résidus du pétrole et d’huiles usagées mais sa fabrication émet entre 3 à 4 tonnes de CO2 par tonne de carbone solide produit. Le consortium d’industriels accompagnant Materia Nova commercialisera donc ce noir de carbone décarboné, mais aussi d’autres formes plus avancées de carbone, accessibles par pyrolyse plasma hybride et sans émission de CO2, comme le graphène », complète Fabrizio Maseri.

En 2020, 162 gigawatts (GW) de nouvelles capacités de production d’énergie renouvelable ont été installés dans le monde. À la fin de l’année, le monde comptait ainsi 2 799 GW d’installations d’énergie renouvelable. Selon le rapport Coût de la production d’énergie renouvelable en 2020 de l’Agence internationale pour les énergies renouvelables (Irena), le coût des énergies renouvelables continue de baisser fortement. Sur l’année, le coût du solaire thermique à concentration (CSP) a ainsi baissé de 16 %, l’éolien terrestre de 13 %, l’éolien offshore de 9 % et le solaire photovoltaïque de 7 %. En fin de compte, en 2020, 62 % des nouvelles capacités de production d’énergie renouvelable coûtaient moins cher que l’option à combustible fossile la moins chère : le charbon.

Face aux engagements de neutralité carbone à l’horizon 2050, ces nouvelles filières présentent un avantage certain, estime l’Irena. « Les nouveaux projets d’énergies renouvelables ajoutés en 2020 permettront aux pays émergents d’économiser jusqu’à 156 milliards de dollars [131 milliards d’euros, ndlr] sur l’ensemble de leur durée de vie », calcule l’agence internationale. En effet, à niveau de production équivalent, les projets d’énergies renouvelables ajoutés en 2020 réduiront les coûts du secteur de l’électricité d’au moins 6 milliards de dollars par an dans les pays émergents, par rapport aux combustibles fossiles. Et ce, tout en réduisant les émissions de gaz à effet de serre. « Les deux tiers de ces économies proviendront de l’éolien terrestre, et dans une moindre mesure de l’hydroélectricité et du solaire photovoltaïque », prévient l’Irena. Depuis 2010, les 534 GW de capacité renouvelable ajoutés dans les pays émergents à des coûts inférieurs à l’option charbon la moins chère réduisent chaque année les coûts de l’électricité d’environ 32 milliards de dollars, calcule l’organisme.

L’étude suggère que 800 GW de capacité existante au charbon ont des coûts d’exploitation plus élevés que les nouveaux panneaux solaires photovoltaïques et éoliens terrestres à grande échelle. Le remplacement de ces centrales au charbon réduirait les coûts annuels du système de 32,3 milliards de dollars par an. Il permettrait d’éviter l’émission d’environ 3 gigatonnes de CO2 par an. Cela représente 9 % des émissions mondiales de CO2 liées à l’énergie en 2020 ou l’équivalent de 20 % de la réduction nécessaire d’ici 2030 pour limiter l’augmentation de température à 1,5 °C selon la voie décrite dans l’ouvrage Perspectives pour les transitions énergétiques mondiales de l’IRENA.

Aux États-Unis, l’exploitation de 61 % de la capacité totale de production à base de charbon coûterait plus chère que les nouvelles capacités renouvelables. « Le retrait et le remplacement de ces centrales par des énergies renouvelables réduiraient les dépenses de 5,6 milliards de dollars par an et économiseraient 332 millions de tonnes de CO2, atténuant ainsi d’un tiers les émissions de carbone aux États-Unis », calcule l’Irena. En Allemagne, aucune centrale au charbon existante n’a des coûts d’exploitation inférieurs à ceux d’une nouvelle installation de production à base de solaire photovoltaïque ou d’éolien terrestre.

Entre 2010 et 2020, le coût de l’électricité a baissé de 85 % pour le solaire photovoltaïque à échelle industrielle. Il a reculé de 68 % pour le solaire thermique à concentration (CSP), de 56 % pour l’éolien terrestre et de 48 % pour l’éolien offshore. « Avec des prix d’enchères record de 1,1 à 0,03 USD/kWh aujourd’hui, le prix du solaire photovoltaïque et de l’éolien terrestre est continuellement plus bas que celui des nouvelles options au charbon les moins chères sans aucun soutien financier », précise l’Irena.

« Après le récent engagement du G7 à atteindre zéro émission nette et à mettre fin au financement mondial du charbon à l’étranger, il appartient désormais au G20 et aux économies émergentes d’appliquer ces mesures, prévient Francesco La Camera, directeur général de l’Irena. Nous ne pouvons pas nous permettre une transition énergétique à deux vitesses, dans laquelle certains pays deviendraient rapidement verts tandis que d’autres resteraient prisonniers de l’ancien système à base de combustibles fossiles. »

Depuis plus de 11 ans, Gazelec est devenu l’un des lieux d’échanges principaux en termes d’achat d’énergie. C’est chaque année que se rencontrent les professionnels du secteur pour s’informer et échanger sur les dernières évolutions et innovations.

Fortement ralenti par la pandémie du Covid-19, le secteur de l’énergie a subi de plein fouet de lourdes conséquences économiques : à cause d’une baisse de consommation énergétique, l’écosystème s’est retrouvé perturbé face à un marché qui augmente ses prix.

La 12ème édition du congrès se tiendra les 12, 13 et 14 octobre 2021 au Pullman Paris Bercy. Un programme chargé s’annonce avec une journée dédiée au gaz, une journée dédiée à l’électricité et enfin, une journée de formation avec des ateliers au choix. Parmi les thèmes abordés :

Et bien d’autres encore.

L’évènement est un rendez vous plus que jamais nécessaire cette année avec pas moins de :

50 sponsors et partenaires

600 participants

80 speakers

150 rendez-vous

250 acheteurs attendus

Vous pouvez consulter le programme des conférences et des ateliers, la liste des marques présentes ou vous inscrire sur le site de l’événement.

Pour plus d’informations, rendez vous sur https://congresgazelec.com/

Marie-Dominique Bogo est intrapreneure au sein de l’entreprise Suez. Après avoir créé la société Re-Source Industries qui accompagne la déconstruction des automobiles, puis avoir déployé une filière de déchets d’équipements électriques pour SITA Recyclage, elle a fondé BatiRIM, une coentreprise entre Suez et Resolving.

Créée en 2019, la société BatiRIM part du constat que le diagnostic des déchets et le recyclage dans le BTP ne sont pas à la hauteur : « Lorsqu’on doit déconstruire un bâtiment, on le voit comme un volume de béton à abattre, ce qui détourne la valeur réelle du bâtiment, des matériaux et équipements qui le composent. Pourtant, il y a souvent des produits neufs qui finissent avec le reste à la benne », explique l’intrapreneure.

Avec BatiRIM – RIM pour Resource Information Modeling -, Marie-Dominique Bogo entend redonner de la valeur aux matériaux grâce au numérique : « Nous proposons une solution digitale qui est mobile et collaborative pour optimiser la rénovation et la déconstruction des bâtiments au service de l’économie circulaire ». Elle parle de « BIM inversé ».

Pour cela, les plans des bâtiments sont récupérés et mis sur une tablette. Lors d’une première visite, le diagnostiqueur identifie tous les éléments, qui peuvent être retrouvés grâce à une bibliographie d’équipements, et définit ce qui peut être réutilisé. Ensuite, un calcul se fait automatiquement afin de séparer les différents équipements et matériaux et permet d’établir un diagnostic. « A l’heure actuelle, le diagnostic se fait à la main, ce qui ne donne pas forcément d’indication sur les localisations exactes, les mesures etc. Avec notre outil, le déconstructeur peut anticiper la déconstruction et structurer la gestion des flux », détaille Marie-Dominique Bogo.

Une fois le diagnostic réalisé et la déconstruction organisée, les éléments pourront être séparés et mis de côté pour être réutilisés, réemployés ou recyclés. « Nous avons un réseau d’acteurs du réemploi avec lesquels nous travaillons et nous pouvons faire les meilleures propositions en fonction des équipements et des objets qui vont être dans le bâtiment. Sur le volet recyclage, nous avons notre passé économie circulaire grâce à Suez, donc nous connaissons très bien les filières », développe la fondatrice de BatiRIM.

Lors de leur premier chantier de déconstruction de la ZAC de la Plaine Saulnier à Saint-Denis, l’utilisation de l’outil BatiRIM a permis de réaliser 400 tonnes de réemplois, une première en France. Les matériaux et équipements ont été récupérés par des collectionneurs, des associations, des acteurs publics (jardins partagés, pompiers…) etc. Le digital permet une traçabilité des équipements tout le long du chantier jusqu’à leur arrivée chez les acteurs de réemploi.

Maintenant, Marie-Dominique Bogo souhaite vendre l’outil aux diagnostiqueurs et apporter le réseau de BatiRIM aux acteurs de la déconstruction. « C’est une autre manière de penser, le travail est plus propre car on démonte, on ne détruit plus. Il ne faut pas oublier que nous vivons dans un monde fini dont les ressources ne sont pas inépuisables », conclut l’intrapreneure.

Pour notre dossier de juin, « Les nouvelles technologies révolutionnent l’approche du sport », voici les thèses sélectionnées par le REDOC SPI. Retrouvez le résumé de ces thèses ainsi que les thèses des mois précédents sur le site de notre partenaire.

Analyse de la performance en trail courte distance : Déterminants physiologiques, spécificité de la sollicitation musculaire et stratégies d’optimisation

Sabine Ehrström

Doctorat : Sciences du Mouvement Humain, 26/11/2020

Laboratoire Motricité Humaine, Expertise, Sport, Santé (LAMHESS)

Influence des caractéristiques techniques de la chaussure à crampons sur l’interface terrain-joueur

Sylvain Blanchard

Doctorat : Biomécanique, 21/10/2020

Laboratoire de Biomécanique Appliquée

Optimisation de la position en cyclisme et en triathlon par une approche systémique de la performance pour des individus de diverses morphologies

Geoffrey Millour

Doctorat : Biomécanique et physiologie du mouvement, 06/10/2020

Laboratoire PSMS – Performance, Santé, Métrologie, Société

Développement d’une nouvelle méthodologie d’analyse in situ du mouvement en cyclisme : apport des centrales inertielles pour l’estimation de la cinématique articulaire

Sébastien Cordillet

Doctorat : Sport, 17/12/2019

Laboratoire Mouvement Sport Santé

Contribution à l’analyse de l’activité neuromusculaire des skieurs alpins d’élite lors de tests isocinétiques et en conditions réelles d’entraînement

Marine Racinais Alhammoud

Doctorat : Sciences et techniques des activités physiques et sportives, 06/12/2019

Laboratoire interuniversitaire de biologie de la motricité

Analyses biomécanique et physiologique des modes de propulsion synchrone et asynchrone chez les basketteurs en fauteuil roulant manuel

Marjolaine Astier

Doctorat : Sciences du Mouvement Humain, 24/09/2019

Laboratoire Motricité Humaine, Expertise, Sport, Santé

Analyse et optimisation pluridisciplinaire de la performance en vélo tout terrain crosscountry olympique (VTT XCO)

Simon Devys

Doctorat : Sciences du Mouvement Humain, 05/06/2019

Institut des Sciences du Mouvement Etienne Jules Marey

Création et validation d’un outil low-cost d’analyse de la posture du cavalier ‘ADPC’

Dominique Prin

Doctorat : Sciences de l’Ingénieur, 10/10/2018

Laboratoire PSMS – Performance, Santé, Métrologie, Société

Quels effets d’empowerment et de valorisation de la consommation induits par l’utilisation régulière de dispositif numérique ? : Le cas des objets de quantifield-self et des communautés virtuelles dans la consommation sportive active

Coline Rual

Doctorat : Sciences de gestion, 03/12/2019

Laboratoire d’Économie et de Gestion de l’Ouest

Le Soi quantifié et l’engagement dans l’utilisation des objets connectés pour le sport

Khalid Samhale

Doctorat : Sciences de gestion, 08/11/2019

Lille économie et management

Depuis que le sport s’est professionnalisé, les athlètes sont soumis à une pression importante, due à l’importance décuplée de chaque match, sportivement et in fine financièrement parlant. La préparation des joueurs a suivi cette tendance, devenant de plus en plus spécifique et personnalisée selon les joueurs.

Dans le football actuel, un joueur titulaire dans un grand club joue une cinquantaine de matchs par an, ce qui est beaucoup. Le championnat d’Europe, qui se déroule après la fin de saison en club, oblige donc les joueurs à faire une courte préparation, d’environ trois semaines, pour une nouvelle compétition, qui obligera les deux équipes finalistes à jouer sept matchs. Il s’agit donc, pour les équipes nationales qualifiées, de permettre aux joueurs de se préparer avec les autres joueurs de leur équipe, tout en récupérant physiquement et mentalement, après une longue saison en club.

La particularité de l’Euro 2021, c’est que ce tournoi arrive après une année marquée par la crise du coronavirus, qui a d’ailleurs obligé les organisateurs à repousser le tournoi, qui devait initialement se tenir en juin 2020.

Aujourd’hui, les joueurs portent des capteurs lors de leurs séances d’entraînements. Cyril Moine, le préparateur de l’équipe de France, collecte des données ciblées pour évaluer l’état de forme physique des joueurs au début de la préparation physique. «Il y a deux types de données, explique Cyril Moine sur le site de la Fédération Française de Football (FFF). D’abord celles transmises par les GPS qui concernent les distances de course à haute intensité, le nombre de sprints, d’accélération ou de décélération. Grâce à elles, je peux faire une juxtaposition avec ce que les joueurs sont capables d’effectuer pendant un match. C’est ce qu’on appelle la charge externe. Je m’appuie aussi sur les données de fréquence cardiaque puisque j’enregistre tous les entraînements. À partir de là, je mesure la charge interne du joueur pour savoir comment il réagit physiologiquement par rapport à l’effort proposé. Il y a quelques années, on recevait ces données après l’entraînement, à présent, elles arrivent en simultané sur le terrain. L’état des lieux se fait en direct.»

A partir de là, les joueurs sont répartis en groupes de niveau en fonction de leur forme physique, pour personnaliser leur travail. Ce suivi est quotidien, et permet également de repérer un pic de forme, ou au contraire une baisse de régime physique au jour le jour. Des indicateurs très utiles pour le sélectionneur de l’équipe de France, Didier Deschamps. Cela dit, Cyril Moigne estime que ces outils technologiques, utilisés par toutes les sélections nationales, ne sont qu’une information parmi d’autres pour le sélectionneur, comme il l’explique sur le site de la FFF : «Des petits curseurs me permettent de dire : attention, tel joueur est un peu dans le rouge ou, au contraire, tel autre est en facilité, on peut y aller et continuer. Ces moyens techniques nous offrent une grande réactivité. L’œil avisé du sélectionneur est beaucoup plus important que la technologie mais c’est une aide à la décision. En général, lorsque je vais voir le coach, il le sait déjà car il l’a vu.»

Cette aide à la décision apportée par les outils technologiques va aider l’encadrement à suivre de manière précise et personnalisée la condition physique des joueurs.

Les nouvelles technologies permettent aussi aux sélections nationales d’analyser leur propre jeu, et celui de leurs adversaires, grâce aux outils de tracking GPS. Ce volet de l’amélioration de la performance a été grandement affecté par la crise sanitaire : l’usage veut que l’encadrement assiste aux matchs des futurs adversaires de l’équipe de France pour étudier leur jeu. Avec le Covid, ces déplacements pour observer les adversaires ont été impossibles. Mais les données désormais disponibles après chaque match permettent de tout savoir sur les déplacements des joueurs pendant les matchs, à distance.

Surtout, l’analyse vidéo permet aujourd’hui de proposer des paramètres d’analyse de la performance, de manière individuelle et collective, ce qui est fondamental pour tous les sports d’équipes. Thierry Marszalek, l’analyste vidéo de l’équipe de France depuis de nombreuses années, dispose ainsi à Clairefontaine, le camp de base de l’équipe de France, de plus de 14 000 matchs en vidéo, prêt à être décortiquées. Ce dernier a vu les effectifs assignés à l’analyse vidéo augmenter ces dernières années. Il reste pourtant, à l’instar de Cyril Moigne, mesuré sur l’impact de son activité sur la performance globale de l’équipe de France : «l’analyse vidéo est utile, mais pas forcément capitale. On lui donne d’ailleurs aujourd’hui trop d’importance à mon goût. La seule chose dont on ne peut se passer, ce sont les joueurs. Par contre, je suis content de ne plus être seul pour faire mon travail».

On le voit, aujourd’hui les innovations technologiques, que ce soit pour les préparations physique ou tactique des équipes, sont indispensables. Pour autant, de l’avis même des intéressés, elles ne sont pas décisives pour la victoire finale. Il est peu probable que les nouvelles technologies s’emparent du football comme cela a pu être observé dans un sport comme le football américain : en effet, le football reste un sport où chaque joueur, s’il fait partie d’un collectif, peut être en capacité de prendre à son compte le sort d’un match. Ce qui n’est pas vrai pour le football américain.

Cette dualité entre l’apport individuel et collectif de tel ou tel joueur à son équipe alimente les débats médiatiques lors du championnat d’Europe qui se dispute actuellement. Les journalistes sportifs disposent eux aussi d’outils technologiques leur permettant de développer des analyses de plus en plus factuelles. Mais pas définitives.

Il est aujourd’hui tellement complexe d’analyser l’apport à la fois collectif et individuel d’un joueur lors d’un match que seul l’ajout de la subjectivité (celle du sélectionneur, celle du journaliste), permet de donner un sens aux données.

Ici vous trouverez notre récap’ de l’actualité scientifique et technologique qui a bercé ou chamboulé le mois de juin. Et à la fin de cet article : deux infos cadeaux bienheureusement repérées par nos soins.

Attachez vos ceintures, la NASA a annoncé deux nouvelles missions, Davinci + et Veritas, qui exploreront Vénus ! Le lancement est prévu pour la période 2028-2030, rapporte Le Monde (via l’AFP). Ce n’est pas tout. Les étoiles ont récemment accueilli de nouveaux convives : des calamars et des tardigrades (ces animaux minuscules à la résistance surhumaine) ont voyagé à bord d’une fusée SpaceX, jusqu’à la station spatiale internationale (ISS). Plus précisément, concernant les céphalopodes, il s’agit de 128 bébés calamars issus du laboratoire de biologie marine de l’Université d’Hawaï, nous informe le Honolulu Star-Advertiser. Les deux espèces font l’objet de sérieuses études pour mieux comprendre les effets de l’apesanteur et des vols spatiaux notamment sur les relations hôtes-bactéries, peut-on lire dans l’Obs.

Avec 0,05 kWh/km (soit moins d’un demi-centime par km parcouru), l’Urbanloop (à ne pas confondre avec l’Hyperloop) a battu le record de la plus faible consommation énergétique pour un véhicule autonome sur rail. Un score établi à Tomblaine, en Meurthe-et-Moselle, écrit Le Parisien. Urbanloop est un projet de capsules monoplaces, sur rail, dont la vitesse avoisine les 60 km/h. Démarré il y a 4 ans, il est porté par l’ENSEM, l’ENSG, Mines Nancy et Télécom Nancy, toutes des écoles d’ingénieurs de l’Université de Lorraine. En octobre 2020, nous avions consacré un dossier au véhicule autonome : vous y trouverez justement un article dédié à la navette autonome !

En analysant les prélèvements effectués dans les transports en commun d’une soixantaine de villes, dans 32 pays, des chercheurs ont montré que chaque ville a son propre lot très distinctif de microorganismes ! Explications ici, dans Franceinfo. Mais la cartographie d’autres microbiomes va bon train aussi ! C’est le cas des microorganismes marins, avec les expéditions scientifiques de Tara, dont on vous parlait ici.

Dans une réserve écologique, sur une plage californienne, un drone s’est écrasé, causant la fuite de milliers de sternes élégantes prises de panique. Les oiseaux ont ainsi abandonné 1500 œufs, nous apprend Futura-Sciences… Un désastre pour cette espèce ouest-américaine. Tempérons cependant, les drones ne sont pas forcément incompatibles avec la nature : ils peuvent même être de précieux alliés ! C’est le cas de ce drone pollinisateur dont nous vous parlions déjà en juillet 2020.

Ne vous détendez pas pour autant, car les orchidées, elles, n’en mènent pas large ! Les espèces les plus recherchées, voire encore inconnues de la science, attisent la convoitise de trafiquants de plus en plus téméraires. Alors, dans les jardins botaniques anglais, c’est le branle-bas de combat. Victimes de vols d’orchidées, ces paradis pour végétaux lèvent le bouclier, raconte The Guardian.

Néanmoins, à d’autres organismes vivants, on ne la fait pas ! Nous vous parlions plus haut du tardigrade parti dans l’espace. Découvrez maintenant l’irréductible rotifère bdelloïde ! Cet animal microscopique est revenu à la vie après avoir passé 24 000 années gelé dans le permafrost sibérien, apprend-on par l’agrégateur de news scientifiques Phys.org.

Alors que de nombreux sites web ont été paralysés le 8 juin, en raison d’une panne informatique vite résolue chez le fournisseur Fastly (Franceinfo fait le point ici), un média a trouvé un moyen ingénieux pour contourner le problème. Affecté par cette panne, le site d’information The Verge a eu recours à Google Docs pour poursuivre sa publication… Sauf qu’en oubliant de désactiver la fonctionnalité « édition », il s’est retrouvé dans une situation bien cocasse ! Une anecdote documentée dans ce tweet.

Léger mais costaud. À base de graphène, cet aérogel, décrit en détail dans The Engineer, serait désormais le plus léger matériau d’isolation acoustique. Développé par des chercheurs de l’Université de Bath (Royaume-Uni), il permet de réduire jusqu’à 80 % du bruit émis par un moteur d’avion. C’est d’ailleurs là qu’il pourrait trouver son application ! Ce matériau a fait l’objet d’une étude publiée dans Scientific Reports (Nature).

Datagen, dont le MIT Technology Review brosse le portrait, propose un pari audacieux : aider les entreprises à se passer des données du monde réel pour entraîner leurs IA. Comment ? En créant de faux humains numériques, bien sûr ! L’apparence de ces humains de synthèse est d’un réalisme troublant. Nous ne sommes pas sûrs de ce qu’en « pense » l’IA, mais nous autres Homo sapiens, un humain virtuel a intérêt à être parfait ! En effet, en décembre 2020, on vous expliquait dans cet article qu’un avatar réaliste n’est pas toujours une bonne idée : selon la théorie de la « vallée de l’étrange », si l’on décèle un problème dans l’apparence d’un humain numérique censé être réaliste, on va tout de suite cesser d’y croire !

Phénomène rare : au large de Cape Cod, aux Etats-Unis, une baleine à bosse gobe accidentellement un pêcheur de homard. Après moins d’une minute passée dans le ventre sombre du géant des mers, le plongeur est recraché, indemne. Son histoire est à lire dans Anchorage Daily News.

Et enfin, une biographie inattendue : celle de Magawa, le rat qui reniflait (pour les détecter) les mines au Cambodge et qui va bientôt profiter d’une retraite bien méritée. C’est à lire (ou écouter) dans NPR.

Crédit image de une : Intissar El Hajj Mohamed//Techniques de l’Ingénieur

Un extrait de « Biomécanique du sport » par Patrick LACOUTURE

Les outils de simulation peuvent être répartis en deux catégories. La première concerne les ergomètres, appareils sur lesquels le sportif réalise son geste comme s’il se trouvait sur le lieu de sa pratique sportive. La seconde est une simulation plus théorique. Ce domaine de recherche concerne l’optimisation et la simulation des mouvements dynamiques des systèmes anthropomorphes, développées sur des plateformes dédiées comme les humains, les robots humanoïdes, et sur des personnages humains virtuels aussi appelés avatars. Il s’agit alors de programmer le mouvement d’un avatar capable de reproduire, de simuler le geste du sportif. Ces deux approches sont très utiles pour étudier l’influence d’un matériel, d’une posture, d’une technique gestuelle, d’une consigne d’entraîneur sur le geste produit.

L’ergomètre a l’avantage de pouvoir pratiquer lorsque les conditions météorologiques sont très mauvaises. De plus, l’entraîneur peut proposer des exercices spécifiques à son athlète. Parmi l’ensemble des ergomètres disponibles sur le marché, on peut citer le rameur, le tapis roulant, le cycloergomètre, etc. La notion de reproductibilité du geste sur ergomètre s’appuie sur au moins trois impératifs :