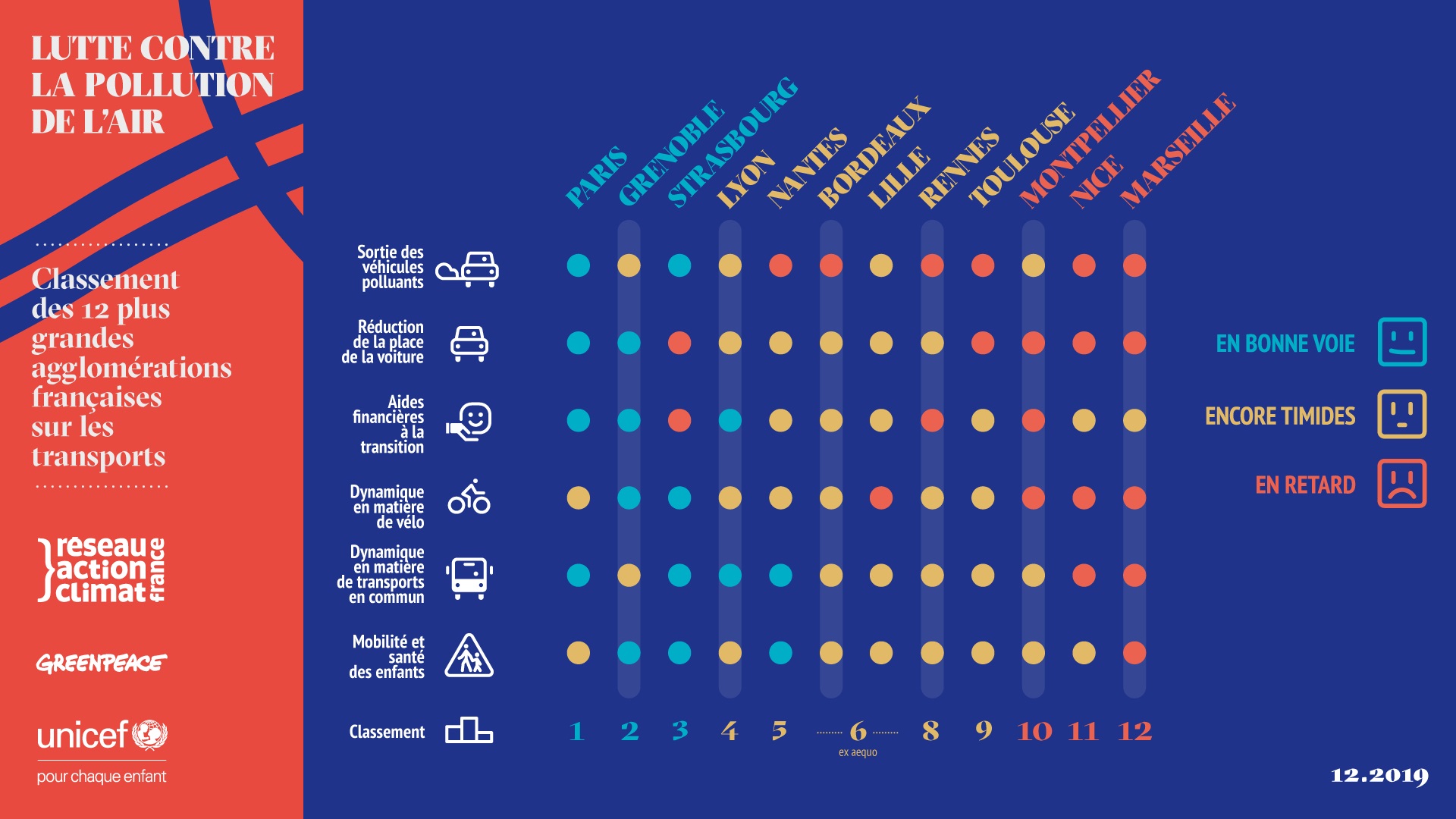

Si les grandes agglomérations commencent à s’intéresser à certains aspects de la pollution de l’air, les défis restent importants. « Aucune des grandes agglomérations françaises ne va aujourd’hui assez loin pour protéger efficacement ses habitants de la pollution de l’air », estime le rapport commun de Réseau action climat, Greenpeace et UNICEF France publié le 11 décembre. Celui-ci dresse un bilan de l’action engagée par les 12 plus grandes agglomérations françaises ces cinq dernières années en la matière.

De Paris à Marseille, des engagements à consolider

La zone à faibles émissions de Paris est déjà opérationnelle et regroupe 49 communes du Grand Paris. Grâce à elle, la capitale se hisse en tête du classement. En plus, la ville a pour objectif une sortie complète du diesel en 2024 et une sortie de l’essence en 2030. Strasbourg se positionne en ce sens, Grenoble doit confirmer son engagement. « La très grande majorité des villes et métropoles françaises tardent à s’engager vers la fin de la voiture individuelle essence ou diesel et la sortie du tout-voiture », regrette Lorelei Limousin, responsable des politiques Climat – Transports pour le Réseau Action Climat France.

Marseille se trouve en fin de classement, quel que soit l’indicateur retenu. Montpellier et Nice sont aussi dans le rouge, en fin de classement. D’autres agglomérations, comme Lyon et Nantes, se démarquent positivement sur certains enjeux, mais restent trop timides sur la réduction de la place de la voiture et la sortie des véhicules polluants. Les politiques des autres agglomérations – Bordeaux, Lille, Rennes et Toulouse – restent trop faibles sur l’ensemble des sujets.

Les élections municipales en perspective

Les ONG veulent profiter des élections municipales pour que les candidats prennent des engagements sur la mobilité et la pollution de l’air. « La lutte contre la pollution de l’air, dont le trafic routier est largement responsable en ville, et le développement des mobilités durables seront des sujets incontournables de la prochaine échéance électorale : les nouveaux élus devront prendre des mesures à la hauteur de l’urgence sanitaire et climatique », prévient Sarah Fayolle, chargée de campagne Transports à Greenpeace France.

Les ONG appellent couramment à agir en urgence contre la pollution de l’air. Elles demandent de réduire la place de la voiture, développer les mobilités douces et les transports en commun. Cela passe par la mise en place de zones à faibles émissions, et l’adoption de politiques de sortie du diesel et de l’essence. Afin d’accélérer la transition vers des modes de déplacement et de transports moins polluants, les agglomérations peuvent mettre en place des aides financières spécifiques. Enfin, les ONG appellent à des mesures spécifiques pour un public plus vulnérable, les enfants.