Techniques de l’Ingénieur : Pouvez-vous revenir sur votre parcours professionnel ?

Gaëlle Lissorgues : Après le bac, j’ai suivi une prépa scientifique parce que, si je n’étais pas sûre de ce que je voulais faire, mon souhait était néanmoins de m’orienter vers les sciences, et particulièrement la physique.

À la suite, en 1990, j’ai entamé un cursus de quatre ans à l’ENS Cachan[1], en spécialité physique appliquée[2]. La troisième année de ce cursus, en 1993, j’ai passé l’agrégation de physique, option physique appliquée. L’année suivante, je me suis engagée dans un DEA[3] que j’ai poursuivi à Jussieu[4]. J’ai continué avec trois ans de thèse, de 1994 à 1997, à l’ENS Cachan, sur la télémétrie laser appliquée en robotique, avec de l’optique et de l’électronique embarquée. Dotée de plusieurs compétences, j’ai eu la chance, à la fin de ma thèse, d’obtenir directement en septembre 1997 un poste à l’ESIEE Paris[5], l’école d’ingénieur où je suis encore aujourd’hui, et où j’ai occupé différentes fonctions.

Ma thèse étant fortement orientée électronique pour des applications robotiques, et la formation en physique appliquée comportant un tiers d’électronique. J’ai poursuivi ma carrière en physique appliquée et électronique, dans les domaines des capteurs et de l’instrumentation ainsi que de leurs variantes. Mon parcours peut paraître assez linéaire entre prépa, école, thèse puis un poste équivalent à maître de conférences. Enfin, en 2006, j’ai passé mon HDR[6], ce qui m’a menée à un poste de professeur, toujours dans la même école.

Comment vous êtes-vous spécialisée dans l’électronique ?

En intégrant Cachan, j’ignorais que la physique appliquée englobait la partie électronique, l’électrotechnique, l’induction, la motorisation, et la partie automatique avec le traitement du signal. Très vite pendant mes études, j’ai vraiment aimé la partie électronique. C’était un aspect de la physique qui m’était inconnu, que je n’avais pas encore abordé.

L’électronique m’intéressait parce qu’elle réunissait de la physique fondamentale, comme la physique des matériaux et celle des semi-conducteurs qui sont assez pointues, avec de grands domaines techniques. Cela correspondait à mon projet de faire de la recherche, avec un fort ancrage applicatif pouvant mener à des débouchés industriels. Il s’agissait par exemple de savoir si un certain prototype aurait une utilité dans un futur assez proche.

J’ai moins de disposition pour des problématiques très fondamentales, très utiles par ailleurs. J’étais plus attirée par le développement d’activités autour de solutions permettant de répondre concrètement à moyen terme à des défis scientifiques. L’électronique s’y prêtait bien. Bien sûr, l’électronique existait déjà dans les années 1990[7] et cette discipline offrait de nombreuses possibilités d’évolution. Il m’a donc semblé intéressant de l’étudier. La révolution internet ne s’était pas encore produite, la miniaturisation des composants était encore en devenir. En 1997, très vite après mon arrivée à l’ESIEE, j’ai été invitée à orienter mes activités de recherches sur les MEMS (micro-electro-mechanical systems), c’est-à-dire les microsystèmes électromécaniques, que l’on trouve dans de nombreux objets du quotidien (comme les accéléromètres des airbags de voiture). Ces recherches, somme toute assez récentes, s’appuient sur ce qu’on appelle des microtechnologies. La fabrication doit s’effectuer dans un environnement spécifique : une «salle blanche ». Cette infrastructure est lourde et peu de laboratoires en France en disposent[8]. L’ESIEE disposait de salles blanches lorsque j’y suis arrivée. J’ai pu ainsi mettre en place mon activité de recherche autour des MEMS et des technologies innovantes de microfabrication.

L’électronique se trouve partout. Cet univers conceptuel, pour les aspects concernant la physique, peut être compliqué à expliquer et à comprendre. En revanche, il est simple d’utiliser l’électronique, laquelle est largement présente dans notre quotidien à travers notre téléphone, la voiture et bien d’autres de nos appareils. Aussi d’un point de vue pédagogique, le domaine est concret et facile à illustrer, ce qui m’a probablement conduite à le choisir aux dépens du traitement du signal, plus abstrait, plus théorique.

Pouvez-vous nous parler de votre rôle dans le département Santé, énergie et environnement de l’ESIEE Paris ?

Historiquement, l’école, qui s’appelait à sa création l’école Bréguet, existe depuis 1904. Située rue Falguière, à Paris, c’était l’école de la Chambre de commerce et d’industrie de Paris, Île-de-France. Elle s’est déplacée sur le campus de Champs-sur-Marne en 1987. Autour de 2010, une formation Ingénierie et management[9] alliant des aspects gestion de projets et technique a rejoint le campus ; ce n’était néanmoins pas encore une formation d’ingénieur. Puis en 2012, le directeur, Dominique Perrin, a souhaité une seule école intégrant cette partie Management et sciences humaines dans le cursus des ingénieurs. Ainsi, ESIEE management et ESIEE engineering ont été réunis sous le seul nom de ESIEE Paris.

Dans le cadre d’une refonte globale de l’organisation de l’école, le directeur a souhaité créer un nouveau département, en Santé, énergie et environnement. Des échanges nous ont permis d’imaginer un avenir solide pour ces thématiques, en s’appuyant sur deux filières d’enseignement, présentes du côté management, et qui abordaient le développement durable, l’environnement et la biotechnologie. Cette expérience antérieure allait nous permettre de créer des filières d’ingénieurs. Ce nouveau département et le regroupement d’autres ont incité quelques collègues de l’enseignement en management impliqués dans la protection de l’environnement et la santé à nous rejoindre, ainsi que des collègues de physique puisque les questions liées à l’énergie incluent cette science. Nous avons également été rejoints par des collègues qui faisaient de la recherche sur les micro- et nanotechnologies, notamment les microcapteurs. Ceux-ci sont développés par exemple pour la détection de polluants, pour la qualité de l’eau ou de l’air, pour des dispositifs implantés ou implantables. Ces domaines se retrouvaient donc tout naturellement dans les thèmes santé, environnement, énergie.

Pendant neuf ans, jusqu’en 2021, j’ai suivi et accompagné l’activité de ce département qui, de deux filières d’ingénieurs en 2012 – en énergie, énergies renouvelables, efficacité énergétique d’une part, biotechnologie et santé d’autre part –, a bien grandi ensuite.

Actuellement, une troisième filière, en alternance, est proposée sur tout ce qui est autour de la transition énergétique[10]. Le département continue à se développer. Les activités de recherche sont principalement orientées MEMS, avec les microsystèmes pour la santé, l’environnement ou l’énergie.

Lors de la construction du département, nous avons demandé à nos collègues susceptibles d’être intéressés par les thématiques Santé, Énergie, Environnement s’ils voulaient l’intégrer. Quelques-uns ont préféré rejoindre celui de l’électronique ou de l’informatique, mais d’autres que l’on n’attendait pas a priori ont souhaité cette intégration, à l’instar d’un collègue travaillant sur les mathématiques, lesquelles englobant les biostatistiques.

Le département s’est construit ainsi de façon à la fois collégiale, itérative et rapide. L’objectif étant d’accueillir des élèves et de leur proposer un programme de formation dès la rentrée 2012. Pour la première filière, le programme a évolué depuis sa création, passant des biotechnologies et l’e-santé à la santé numérique. La biotechnologie est moins présente dans la mesure où dans l’industrie, les besoins portent particulièrement sur la télémédecine, la téléconsultation, mais également l’aide à la décision en médecine, l’apport de l’intelligence artificielle dans le diagnostic ou le traitement d’images.

Les deux autres filières colorées « énergies », quant à elles, se focalisent vraiment sur les énergies renouvelables et la transition énergétique. Un réel focus s’effectue sur tout ce qui a trait aux villes durables, aux bâtiments intelligents, au concept de smart city, c’est-à-dire à l’efficacité énergétique multi-échelles[11]. Les étudiants abordent ainsi toute la chaîne d’un point de vue gestion de l’énergie, mais également tous les types d’énergies dites renouvelables[12]. Ils bénéficient ainsi d’une double compétence, celle des calculs d’efficacité énergétique et celle du secteur renouvelable, pour le domaine du bâtiment et d’autres.

Quels ont été vos principaux sujets de recherche ?

En arrivant à ESIEE, je me suis formée aux microtechnologies, en vue de la microfabrication pour les capteurs. La fin des années 1990 et le début des années 2000 ont été marqués par le grand boom des télécoms (GSM, téléphonies mobiles). J’ai alors orienté mes recherches vers les MEMS dits RF, c’est-à-dire les microcapteurs pour les applications radiofréquence. Ce secteur commençait seulement à émerger. Il visait à remplacer tout ou partie de certaines fonctions électroniques standard – avec des composants, des diodes, des transistors – par d’autres types de composants, les composants micromécaniques.

Ces composants intègrent une partie vibrante, comparable à une poutre mise en résonance. Une contre-électrode placée dessous fait varier une grandeur physique – la capacité, par exemple. Ainsi, une capacité variable intégrée dans un circuit électronique plus complexe aboutit à une fonctionnalité d’accordabilité en fréquence. Il est alors possible de faire varier la fréquence du système électronique grâce à l’ajout de ce petit élément micromécanique. Différentes fonctions permettent ainsi de créer des relais ou switches. Le signal peut être coupé, ou bien il y a continuité même si tel élément est déplacé. Il y a comme cela un certain nombre de fonctions qui peuvent s’appuyer sur des objets mécaniques, mais qu’on miniaturise, pour pouvoir aller vers des très hautes fréquences. Je travaillais plutôt entre 1 et 20 gigahertz en fréquence. Au tout début de ma recherche, j’ai travaillé sur de nombreuses applications télécoms, RF, et ce en coopération avec des partenaires industriels comme Thalès. Ils nous ont sollicités au milieu des années 2000 pour nous demander des fonctionnalités de radars particuliers de défense, des déphaseurs, des antennes intelligentes, accordables, par exemple. Ces activités-là ont été financées par des réponses à des appels à projets européens ou nationaux.

J’ai aussi travaillé avec la DGA[13], sur des composants spéciaux. Le besoin consistait à voir si ces technologies dites MEMS RF pouvaient améliorer certaines fonctionnalités. Je m’y suis consacrée durant la première partie de ma carrière. J’ai ensuite passé mon habilitation à diriger des recherches en 2006.

J’ai souhaité alors réfléchir à mon avenir. Je n’étais pas certaine de vouloir continuer dans les MEMS RF. L’époque nous incitait à miniaturiser encore plus, à nous diriger vers des nanodispositifs, aux dépens des microdispositifs. Nos salles blanches ne nous le permettaient pas puisque nous ne disposions pas des équipements adéquats. Les térahertz constituaient également un domaine novateur. Je me suis finalement rapprochée d’autres collègues qui se consacraient aux microcapteurs, et ai commencé à m’intéresser spécifiquement à leurs applications en biologie et santé.

Petit à petit, mes activités ont glissé des MEMS RF vers les bioMEMS, c’est-à-dire les MEMS pour la biologie et la santé. Durant les deux décennies écoulées, mon engouement pour les MEMS pour la bio et la santé s’est confirmé, au détriment des MEMS pour les télécoms et le militaire. Une petite équipe a alors commencé à se former sur ces domaines d’application en particulier autour des neurosciences. Je l’ai rejointe progressivement jusqu’à travailler complètement sur les biocapteurs.

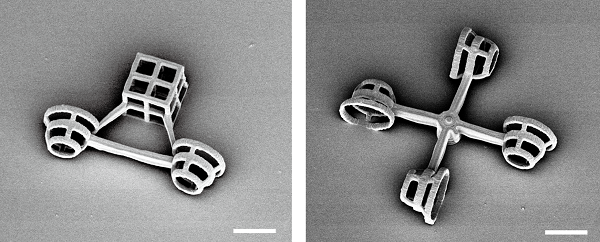

Je travaille depuis longtemps sur l’application en neurosciences. Ce thème est complexe et beaucoup de découvertes restent à faire. Nous fabriquons ainsi des matrices de microélectrodes, de tout petits plots métalliques, de toutes petites électrodes de quelques dizaines de microns de diamètre, c’est-à-dire à l’échelle des noyaux cellulaires des neurones. Nous pouvons dès lors enregistrer in vitro l’activité neuronale, par exemple en plaçant des cultures de neurones sur nos petites électrodes. Nous connaissons ainsi les pics d’activité électrique de ces neurones. Il est également possible d’injecter des courants sur ces électrodes pour stimuler l’activité des neurones à tel ou tel endroit.

Par ces applications, avec les biologistes et les cliniciens, nous tentons de mieux comprendre le fonctionnement des réseaux de neurones vivants et de déterminer la manière dont ils se mettent en place au stade embryonnaire, par exemple si c’est la locomotion en premier. Les matrices de microélectrodes fabriquées de façon spécifique (adaptées aux tissus, etc.) par nos soins sont des outils qui permettent aux biologistes d’expliquer ces processus.

Progressivement, celles-ci ont évolué vers des projets relatifs aux implants, en particulier les implants rétiniens. En 2010, j’ai travaillé durant un an avec l’institut de la vision à Paris, afin d’appréhender davantage ce domaine de la bio et des implants, et d’en comprendre tous les enjeux à la fois éthiques, réglementaires, techniques, scientifiques et biologiques.

Depuis, une grande partie de notre travail est consacrée à différentes générations d’implants. Les implants rétiniens sont destinés à être placés sous la rétine. Nous intervenons sur la partie technique. Nous nous limitons à des applications et des validations in vivo[14].

Les matériaux aussi ont évolué, passant des matrices de microélectrodes aux implants in vivo destinés à la réhabilitation fonctionnelle neurologique, donc passant aussi de substrats rigides à des substrats souples. Beaucoup de nos projets sont financés par l’ANR[15], afin de déterminer si une reconnexion par un système externe est possible après une lésion de la moelle épinière. Pour les implants rétiniens, dans certaines pathologies de la rétine, l’objectif est de remplacer des photorécepteurs abîmés et qui ne sont plus capables de réagir aux stimuli lumineux. L’implant remplacerait ces photorécepteurs dégénérés pour redonner une stimulation artificielle à des neurones et, simultanément, un certain type de vision. Artificielle, elle serait différente de la nôtre et nécessiterait pour le patient de suivre une rééducation.

Nous ne sommes qu’une partie de ces gros projets pluridisciplinaires. La technologie des implants corticaux a évolué avec l’apport de nouveaux matériaux. Depuis plusieurs années, nous travaillons ainsi sur le diamant de synthèse. Nous générons ce diamant polycristallin de synthèse en le faisant croître dans nos salles blanches, à partir d’un mélange de méthane et d’hydrogène. On fabrique aussi de petites électrodes, non plus en or ou en platine, mais en diamant dopé.

Depuis près d’une quinzaine d’années, je consacre une grande partie de mon travail de recherche aux applications médicales. La première contrainte des implants sur ou sous la peau est liée au matériel et aux matériaux utilisés, qui doivent impérativement être biocompatibles.

Le silicium n’est pas biocompatible, or il est le matériau phare de l’électronique. C’est une difficulté. Nous fabriquons donc des capteurs en essayant de n’avoir à utiliser le silicium que comme support mécanique pour s’en s’affranchir par la suite. Une autre solution est de l’encapsuler dans un étui biocompatible.

Ces sujets de recherche portant sur les applications en santé et sur la réhabilitation fonctionnelle, les neurosciences, sont passionnants. Ce ne sont que de petites briques d’un projet vaste et ambitieux. C’est fantastique de se dire que, peut-être un jour, on pourrait aider des patients. Certains sont d’ailleurs déjà implantés avec d’autres capteurs que les nôtres. Toutefois, des problèmes sont observés, notamment la dégradation des matériaux, leur tenue à long terme. L’apprentissage neuronal peut également être compliqué, car tous les patients ne sont pas à même de bien apprendre la nouvelle façon de « voir » pour l’exemple des implants rétiniens[16].

Notre savoir-faire évolue donc et les neuroprothèses font partie des bio-interfaces au sens large. Cette technique consiste à interfacer un système électronique via une électrode à systèmes vivants, comme un semi-conducteur ou un métal et un tissu vivant, par exemple des cultures cellulaires, ou le liquide interstitiel sous la peau, de la salive, de l’urine, du sang… À partir de ce milieu biologique, nous essayons d’optimiser les biointerfaces. Cette part importante de notre travail porte à la fois sur des aspects de modélisation et de fabrication conceptuelle. Nous sommes ainsi parvenus aux dispositifs physiologiques connectés sur la personne. En 2016, notre conception et notre fabrication d’un capteur souple de mesure d’onde de pouls ont été un très beau succès. Ce capteur posé sur un doigtier permet de remonter à l’onde de pouls et à d’autres paramètres cardiaques (grâce à un matériau piézoélectrique encapsulé dans un polymère). Un prototype de ce dispositif a été retenu et envoyé dans la station spatiale internationale, l’année où Thomas Pesquet est parti, afin d’être utilisé pour faire une mesure de rigidité artérielle dans la station. Pour des raisons de confidentialité, les résultats sont restés dans l’équipe des médecins référents. Cependant, c’est une grande fierté pour l’équipe « capteurs pour la santé » d’avoir participé à ce projet. Et ce, d’autant plus que cette réussite nous a permis d’en élaborer d’autres.

Le bâtiment appelé « salles blanches » est la structure dédiée à la microfabrication. Pour y travailler, il faut revêtir une combinaison afin de limiter la pollution extérieure, de nos plaquettes par exemple. J’aime particulièrement mener le travail de recherche depuis le début, quelle que soit l’application. On part du besoin exprimé par un industriel ou un chercheur, clinicien, biologiste. En même temps qu’on imagine le capteur, on le dessine, puis on le fabrique en salle blanche. Les différents matériaux sont empilés couche par couche puis gravés sélectivement, et les dispositifs testés. Nous suivons ainsi toute la chaîne, de l’idée jusqu’à l’applicatif, grâce à l’outil de fabrication in situ.

Qu’est-ce qui vous a amenée à travailler sur les capteurs physiologiques connectés ?

J’ai rejoint des collègues qui commençaient à travailler dessus et nous avons formé une équipe. Nos premiers résultats étaient très encourageants. Pour la partie biomédicale, nous nous sommes associés ensuite avec des hôpitaux, des médecins, des biologistes, des neuroscientifiques, notre objectif étant d’apporter des solutions à leurs questions techniques, ainsi qu’une bibliographie poussée si nécessaire afin d’estimer le potentiel des recherches.

L’avis de personnes référentes est très important. Cette proximité et cette collaboration avec des médecins et des biologistes permettent d’interagir régulièrement entre plusieurs disciplines. Enfin, en matière de financement, nous répondons régulièrement à des appels à projets, lesquels ont souvent gravité autour de la santé ces dernières années.

Nous sommes une petite équipe. Toute cette activité de recherche, qui fait d’ailleurs partie du département Santé, énergie et environnement de l’ESIEE Paris, s’effectue dans le laboratoire ESYCOM (électronique, systèmes de communication et microsystèmes). Ce laboratoire, passé UMR du CNRS récemment, intervient sur trois grands thèmes. Le premier est plutôt orienté électromagnétisme, antenne, et RFID, mon sujet d’intervention en début de carrière. Le second est celui des microcapteurs pour l’humain, la santé et l’environnement. Des collègues sont vivement intéressés par tout ce qui concerne la qualité de l’eau et de l’air, impacts médicaux compris. Cela rejoint notre spécialité en microcapteurs pour l’humain, soit au niveau moléculaire, soit au niveau macro avec des capteurs physiologiques.

Enfin, le troisième thème est celui de la microénergie, la gestion de l’énergie à des échelles micro et la récupération d’énergie sous toutes ses formes, qu’il s’agisse d’énergie vibratoire, lumineuse, ambiante ou thermique.

Sur la partie biocapteur nous sommes un groupe très actif de quatre ou cinq personnes, professeurs ou chercheurs actifs permanents, auxquels s’ajoutent des étudiants et étudiantes en thèse, post-doctorants et de nombreux stagiaires.

Mon collègue Lionel Rousseau a commencé à travailler sur les biocapteurs dès 2003 et je l’ai rejoint vers 2006. En parallèle, je menais des projets sur les puces RF. Ceux-ci achevés, je me suis investie à plein temps dans celui des biocapteurs. Mon expérience en radiofréquence et communication y est pertinente, notamment l’aspect connectivité, puisque nous intervenons sur les capteurs physiologiques connectés à distance. J’ai aussi des compétences sur la conception d’une antenne biocompatible. L’interaction avec l’équipe chargée de la partie propagation et électromagnétisme du laboratoire nous permet de répondre aux problématiques d’antennes placées sur ou dans le corps humain, par exemple.

Quelles sont les principales applications de ces capteurs ?

À l’application visuelle déjà évoquée, s’ajoute le grand champ des implants neuronaux. Les capteurs physiologiques, étudiés notamment avec Thomas Pesquet, ont des applications possibles en cardiologie, cardiopathie, mesures ECG, onde de pouls, oxymétrie, des domaines que je connais bien. Il est possible de fabriquer des dispositifs assez facilement en assemblant astucieusement des composants accessibles dans le commerce. Ce n’est pas de la recherche pure, mais c’est intéressant d’un point de vue projet, en particulier pour nos étudiants et étudiantes, car très appliqué.

J’ai suivi aussi des projets différents de ceux sur les capteurs physiologiques, ou neurologiques, avec des applications pour l’environnement. Nous nous sommes par exemple intéressés au nez électronique et à la façon de capter des composés organiques volatils de toutes sortes sur nos capteurs micromécaniques. Ainsi, si on parvient à fonctionnaliser correctement la surface d’une micropoutre, il est possible d’absorber certaines molécules cibles sur la surface de la poutre, de déterminer la quantité de molécules absorbée et éventuellement aussi d’identifier lesquelles. Il devient possible de faire de la détection d’odeur ou d’autres paramètres. Nous avons géré des projets européens sur ces sujets, ou encore plus récemment un projet sur la détection de phéromones d’insectes pour des applications en agriculture raisonnée. Nos applications peuvent donc être assez larges. Le capteur que l’on fabrique permet différents usages. À nous d’être inventifs pour voir à quoi il peut servir.

Concernant l’environnement, certains collègues travaillent sur des bio-interfaces, des électrodes entre un milieu vivant et une partie électronique. Un projet porte par exemple sur les plantes et l’évaluation de leur stress hydrique. Ces différents projets fonctionnent selon la même brique technologique utilisant des micro-électrodes, mais la géométrie, l’électronique de conditionnement, etc. sont différentes. Les bandes de fréquences ne sont pas forcément les mêmes non plus.

Il est intéressant quand on fait du monitoring avec un capteur physiologique sur le vivant, sur les personnes, d’avoir accès à une information continue pour obtenir une image en temps quasi réel de l’état de santé d’un patient. À l’hôpital, les mesures ne sont pas continues, sauf en réanimation. L’objectif peut donc être d’ajouter un suivi et des résultats en continu, comme avec une montre connectée qui mesure un certain nombre d’éléments. Cette indication est cependant plus ou moins juste et plus ou moins médicale selon la montre qu’on met au poignet. C’est tout l’intérêt de l’article comparatif sur les wearables, paru en décembre 2023. Nous l’avons coécrit pour Techniques de l’Ingénieur avec ma collègue, post-doctorante, Alice Lemarquand. Pour sa rédaction, nous avons sélectionné et comparé différents objets connectés. Nous avons trié ce qui relève du domaine de la recherche – objet parfois commercial, mais non agréé en tant que dispositif médical, plutôt orienté bien-être pour le grand public – et du dispositif médical, qui devra avoir passé toutes les étapes de certifications et de normalisation réglementaire.

Pouvez-vous nous parler des nouveaux matériaux développés en lien avec ces capteurs ?

Pour toutes ces applications de capteurs ou d’interface pour le vivant, la première condition est que les matériaux soient biocompatibles, pour ne pas générer ou en tout cas pour limiter une réaction cutanée (dans le cas d’un patch sur la peau), ni de réactions inflammatoires si le dispositif est implanté. Ensuite, nous privilégions des matériaux durables, particulièrement pour ce qui est implanté, en profondeur ou en sous-cutané.

L’implant doit durer une dizaine d’années. C’est une contrainte liée à son application qui impose des choix sur les matériaux. Parmi les métaux, on utilise des métaux nobles, comme l’or, le platine, le titane. Concernant les matériaux polymères, il faut s’assurer qu’ils soient effectivement biocompatibles. Depuis quelques années, avec mes coéquipiers, nous avons développé une activité autour des neurosciences, des implants neuronaux pour lesquels nous utilisons le diamant de synthèse. Son intérêt est d’être un matériau carboné, une forme noble du carbone. Le carbone constitue aussi la matière vivante et des études en amont ont permis de démontrer qu’il était biocompatible. Nous avons donc développé ces interfaces bioélectroniques en diamant de synthèse. Les nanoparticules de carbone (le diamant) sont ainsi déposées dans un réacteur plasma puis mises en croissance progressivement pour obtenir de fines couches de diamant synthétique. Ce procédé est aussi utilisé en joaillerie. Dans ce cas, le processus de croissance des diamants artificiels est plus long, de l’ordre d’une vingtaine de jours. Il faut ensuite tailler ces diamants artificiels bruts pour obtenir des bijoux.

Pour nous c’est différent. Nous avons besoin de quelques centaines de nanomètres, de très faibles couches qui entrent directement en contact avec des cellules vivantes. Ces couches doivent être fonctionnalisables. Le diamant étant une terminaison carbone, on peut accrocher d’autres molécules à celles de carbone. Ce matériau est donc adéquat pour réaliser les biocapteurs, comme l’ont montré quelques-unes de nos études. Il y a eu des travaux sur le graphène, qui est aussi du carbone sous une forme monocouche, mais plus fragile à manipuler, moins stable dans le temps et donc plus difficile à utiliser dans l’implantable. Nous avons toujours des activités en partenariat pour des projets avec le graphène. Nous préférons néanmoins le diamant de synthèse en raison des longues durées d’implantation requises.

Nous sélectionnons aussi d’autres matériaux, comme des polymères biodégradables qui, lorsqu’ils sont dans le corps humain, finissent par se dissoudre et disparaître. On ne travaille pas spécifiquement là-dessus, mais on peut s’associer à des laboratoires plus spécialisés en sciences des matériaux, qui nous offrent de bons conseils pour choisir les matériaux adaptés. En salle blanche, nous pouvons étudier comment fabriquer ces couches de matériaux pour créer nos capteurs. Du point de vue des matériaux, il faut retenir que les applications in vivo comportent des contraintes spécifiques, pour l’adéquation avec la partie biologie.

Que pouvez-vous nous dire sur le développement et le fonctionnement des MEMS ?

MEMS est l’acronyme de « Micro Electro-Mechanical Systems », ou microsystème électromécanique en français, souvent désigné par le terme microsystème. Il s’agit d’un élément de capteur dans lequel la partie actionneur génère une action ou un mouvement. Ou, au contraire, c’est un capteur qui traduit une variation d’un paramètre physique ou chimique, physico-chimique ou biochimique, en une grandeur mécanique, puis électrique. L’intérêt est que la conversion est double, c’est-à-dire mécanique et électrique. La grandeur de sortie du MEMS est un signal électrique, un courant, une tension, idéalement un signal proportionnel et relié à une grandeur physique d’intérêt, qui peut être elle-même dépendante d’une grandeur mécanique. Comme déjà vu, les MEMS peuvent avoir différentes structures. Prenons l’exemple d’une poutre, envisagée à une échelle micrométrique. Elle mesure quelques microns de large sur 100 ou 200 microns de long et moins d’un micron d’épaisseur. On la met en vibration. Et si on accroche des molécules par-dessus, elle vibre moins vite, parce qu’elle se charge. On détecte ce qui s’est mis sur ou autour de la poutre, en mesurant par exemple sa fréquence de résonance mécanique avec des appareils de laboratoire optiques.

On peut aussi ajouter une jauge de contrainte à la position appelée l’ancrage, l’endroit où ça bouge. C’est une partie sensible qui permet de mesurer électriquement la déformation. On peut ensuite être de plus en plus sophistiqué. Un exemple de MEMS très connu se trouve dans les airbags des voitures, les accéléromètres. Ce système est basé sur des formes de peignes, c’est-à-dire plusieurs séries de micro-poutres alternées. Quand il est à l’équilibre, il ne se passe rien et avec l’accélération, ces peignes bougent et se rapprochent ou s’éloignent les uns des autres. On a donc une variation de la capacité entre les doigts du peigne, qui correspond à l’accélération. Il y a des MEMS dans les téléphones portables, comme des accéléromètres, des gyromètres. On en trouve aussi dans les vidéoprojecteurs, sous forme de micro-miroirs mesurant quelques centaines de microns, pouvant donc être intégrés dans les têtes optiques de ces vidéoprojecteurs. À l’intérieur, il y a un système de plaques qui s’orientent mécaniquement pour dévier le faisceau lumineux d’une façon ou d’une autre. Les applications industrielles des MEMS sont très nombreuses : l’automobile, les systèmes automatisés de production robotisée, utilisation en communication radiofréquence, en micro-mécanique de précision comme dans les microactionneurs, les microrobots, les microengrenages.

Dans la partie biologie, santé, c’est un peu plus compliqué, parce qu’en général le MEMS est une grandeur physique à laquelle il faut adjoindre soit de la chimie, soit de la biochimie, soit de la biologie. Cela ajoute des contraintes spécifiques, liées particulièrement au matériau « roi » du MEMS : le silicium. Très utilisé pour les circuits microélectroniques, il n’est cependant pas biocompatible. Les cellules meurent rapidement à son contact. Il faut donc trouver des astuces pour l’encapsuler dans des couches d’autres matériaux, ou trouver des alternatives avec d’autres matériaux. En santé, la technologie MEMS n’est pas directement transposée de ce qui se pratique pour l’automobile. Par exemple, le diamant de synthèse peut entrer dans la conception de MEMS. Il a été utilisé pour développer des équivalents de ce qui se fait en silicium, ce qui permet d’avoir la partie biocompatible et aussi une très grande rigidité mécanique. N’étant pas produit à l’échelle industrielle, son utilisation en MEMS est plus de l’ordre de la recherche et à l’usage des laboratoires.

Quelles compétences, qualités sont selon vous indispensables, plus particulièrement sur vos domaines d’expertise ?

En général, la curiosité et l’ouverture d’esprit me paraissent indispensables pour faire de la recherche scientifique. Il faut sans cesse toujours avoir envie d’apprendre. Pour ce qui est de la science, la rigueur compte, car on est amené à développer de nouvelles théories, démontrer de nouvelles solutions. Il ne suffit pas qu’un dispositif fonctionne une fois et vérifier qu’il est étayé par des modèles. Pour la partie expérimentale, il faut suivre des protocoles qui soient reproductibles.

Ensuite, je pense que le chercheur doit avoir envie de travailler en équipe. Je vois la recherche comme un travail d’équipe, collaboratif, surtout pas isolé. Les bonnes idées jaillissent à plusieurs. En général, c’est en en discutant, en échangeant, en confrontant nos points de vue qu’on trouve la meilleure solution. Ensuite les compétences techniques et scientifiques permettent de gagner en autonomie dans ses recherches. La rigueur scientifique et l’honnêteté intellectuelle comptent aussi. Il est important de savoir mettre en valeur le travail des autres et pas uniquement le sien, d’avoir une pensée pour celui de l’équipe de maintenance des équipements, sans laquelle nous ne pourrions rien faire en salle blanche. Nous sommes dans la recherche très appliquée, nécessitant un environnement spécifique.

Quels sont vos projets, actuels et futurs ?

En recherche, je reste sur la thématique des capteurs pour la santé, l’interface avec le vivant. Je pense poursuivre là-dessus. Le vivant, c’est d’abord l’humain, avec les aspects santé, médicaux. Il englobe davantage que la personne, il concerne aussi l’environnement, et sa gestion, les plantes, l’alimentation, l’agriculture. L’environnement du campus nous laisse entrevoir de nouveaux domaines, de nouvelles opportunités. On parle beaucoup d’écologie.

C’est bien de développer des technologies de pointe, mais il faut aussi se poser aussi les questions de l’investissement financier, des objectifs, des enjeux sociétaux et du développement. Si je devais faire des choix, j’opterais pour des projets avec un vrai impact sociétal, soit avec des applications médicales avérées, soit un impact au regard de l’environnement, pour aller vers une amélioration par rapport à la gestion du risque climatique. On parle beaucoup de cette tendance et nous avons la chance de disposer de technologies qui permettent de fabriquer toutes sortes de capteurs. Il est nécessaire d’essayer de les mettre au service de ces applications.

Quels conseils adressez-vous à un chercheur ou un ingénieur qui arrive sur le marché du travail ?

Je suis à la fois en contact avec des étudiantes et étudiants qui sortent de cursus ingénieur et des jeunes docteurs qui viennent de passer leur thèse. Il est important – ce dont ils et elles n’ont pas toujours conscience – de choisir quelque chose qui leur plaît, qu’il s’agisse de l’entreprise dans laquelle ils ou elles travailleront, du sujet ou du projet sur lequel avancer. Ils ou elles doivent être motivés. Le temps passé au travail est important, il faut y trouver un intérêt propre, surtout quand on a un niveau d’étude suffisant pour pouvoir se permettre de choisir.

Côté savoir-être, être ingénieur.e ou docteur.e signifie savoir faire preuve d’autonomie, savoir prendre des initiatives sous peine de se voir confier des choses moins intéressantes, un peu répétitives. Le monde actuel bouge beaucoup, les technologies évoluent vite et cela demande une capacité à s’adapter à des changements de configuration. La génération actuelle a ces qualités, bien plus que les générations précédentes, mais il est important d’en être conscient. Il serait dommage d’hésiter devant une opportunité à l’international, lorsqu’on n’a pas encore de charge personnelle. Certains ne souhaitent pas aller à l’étranger, mais veulent essayer différents types de postes et multiplier les expériences. D’autres veulent partir sur quelque chose d’immédiatement technique et spécialisé. Il faut donc réfléchir à ce que l’on a envie de faire, au domaine qui semble attirant, à ce qui compte.

La partie recherche et développement dans l’industrie ou dans un grand groupe n’est pas très différente de celle menée par un ingénieur classique, avec une spécialisation plus poussée. Si c’est une carrière plus orientée vers la recherche dans des milieux académiques, à l’université ou dans des grands laboratoires de recherche, le milieu sera très compétitif et la concurrence importante, même au niveau international, rendant donc les carrières difficiles. Ce milieu est élitiste et pas le plus rémunérateur, mais ouvre une grande liberté. C’est donc un choix.

Que vous apporte la collaboration avec Techniques de l’Ingénieur en tant qu’autrice et conseillère scientifique ?

J’avais déjà écrit ou coécrit des articles en 2002 (autour des filtres) avant d’être sollicitée pour collaborer en tant que conseillère scientifique TI.

Techniques de l’Ingénieur dispose d’un bon rayonnement. C’est une revue que je conseille toujours à mes étudiants parce qu’elle a l’avantage d’être en français et de bonne qualité scientifique. Elle brasse de nombreux domaines en sciences et techniques, c’est très large. On accède facilement à des articles en lien avec le sujet d’intérêt, très bien pour réaliser une première bibliographie, un état de l’art.

J’ai accepté d’écrire des articles pour ces raisons. Je ne l’aurais pas fait pour n’importe quelle publication. En tant que conseillère auprès de Techniques de I’Ingénieur, je sollicite des collègues pour qu’ils rédigent ou actualisent des articles dans la ressource documentaire Électronique, en particulier la rubrique Électronique analogique. Le travail sur certaines actualisations est aussi une façon de se remettre à jour soi-même. Il est intéressant de faire des recherches sur ce qui a évolué. Mettre à jour un article permet d’actualiser ses propres connaissances, d’établir un état de l’art sur un sujet donné à un moment précis. L’organisation, consistant à mobiliser des collègues pour essayer de réviser d’autres articles, est intéressante puisqu’elle met en relation différentes personnes, est l’occasion d’interagir avec celles avec lesquelles on n’a peut-être pas beaucoup de contact habituellement.

Les contributions de Gaëlle Lissorgues aux Techniques de l’Ingénieur

Spécialiste des MEMS, des implants connectés « wearables » et de l’électronique, Gaëlle Lissorgues contribue avec les Techniques de l’Ingénieur en tant que conseillère scientifique et autrice.

Offre

– Électronique

Rubrique en tant que conseillère :

– Électronique analogique

Articles en tant qu’ autrice ou coautrice :

L’actualisation, en préparation, de l’article sur les microsystèmes paraîtra au premier semestre 2025 :

– Microsystèmes – Applications et mise en œuvre [E3090v2]

[1] À présent l’école normale supérieure de Paris-Saclay

[2] Cette spécialité n’existe plus aujourd’hui

[3] L’équivalent d’un Master 2 de recherches

[4] À l’époque l’UPMC ou Université Pierre et Marie Curie, à présent Sorbonne Université

[5] ESIEE : École supérieure d’ingénieurs en électrotechnique et électronique

[6] HDR : habilitation à diriger des recherches

[7] avec comme point de départ le transistor dans les années 1960

[8] Les grandes universités qui ont des salles blanches, Saclay avec le C2N, Toulouse avec le LAAS, le Leti/LMT de Grenoble, l’IEMN à Lille, FEMTO-ST à Besançon, et Renatech, le réseau académique Français de nanofabrication

[9] À l’époque ISTM, Institut Supérieur de Technologie du Management

[10] en collaboration avec Paris Cité

[11] Efficacité énergétique multi-échelles, d’une pompe à chaleur, d’un bâtiment, d’un quartier, voire d’une ville

[12], comme l’éolien, le solaire thermique, le solaire photovoltaïque, l’hydraulique, la biomasse, la géothermie

[13] DGA, la direction générale de l’armement

[14] sur des petits animaux, rats ou souris, dans le respect des réglementations

[15] ANR, l’agence nationale de la recherche

[16] La start-up Pixium Vision met à disposition des vidéos proposant des solutions pour pallier quelques-unes des difficultés évoquées.