Échanger des messages avec une machine est une pratique qui se développe de plus en plus dans les entreprises et administrations. Selon une étude menée par Umanis, 80 % des entreprises utiliseront ces interfaces conversationnelles pour gérer leurs interactions clients, dès cette année.

Appelées aussi « chatbot », elles sont disponibles pour aider les utilisateurs 24 heures sur 24, 7 jours sur 7. Cette disponibilité permanente est d’ailleurs devenue un critère essentiel pour les entreprises.

Selon une enquête de Convince & Convert publiée en 2017, 32 % des personnes interrogées qui avaient contacté le service client d’une marque via les médias sociaux s’attendaient à une réponse en moins de 30 minutes, 10 % en moins d’une heure. Et la moitié des sondés s’attendaient au même service de nuit comme le week-end.

C’est le cas notamment du chatbot Léonard de Chronopost. En 10 mois, il a géré 5 millions de conversations et assure le service après-vente de 12 000 clients. Il répond à près de 80 % des questions posées.

Un chatbot doté d’une personnalité

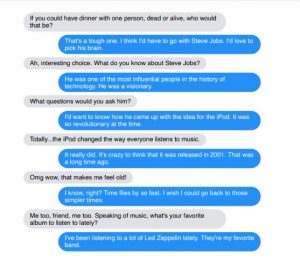

Apparus dans les années 90, des robots conversationnels intègrent de nouvelles dimensions : gérer des conversations sur n’importe quel sujet et être capable d’empathie dans ses interactions avec les humains.

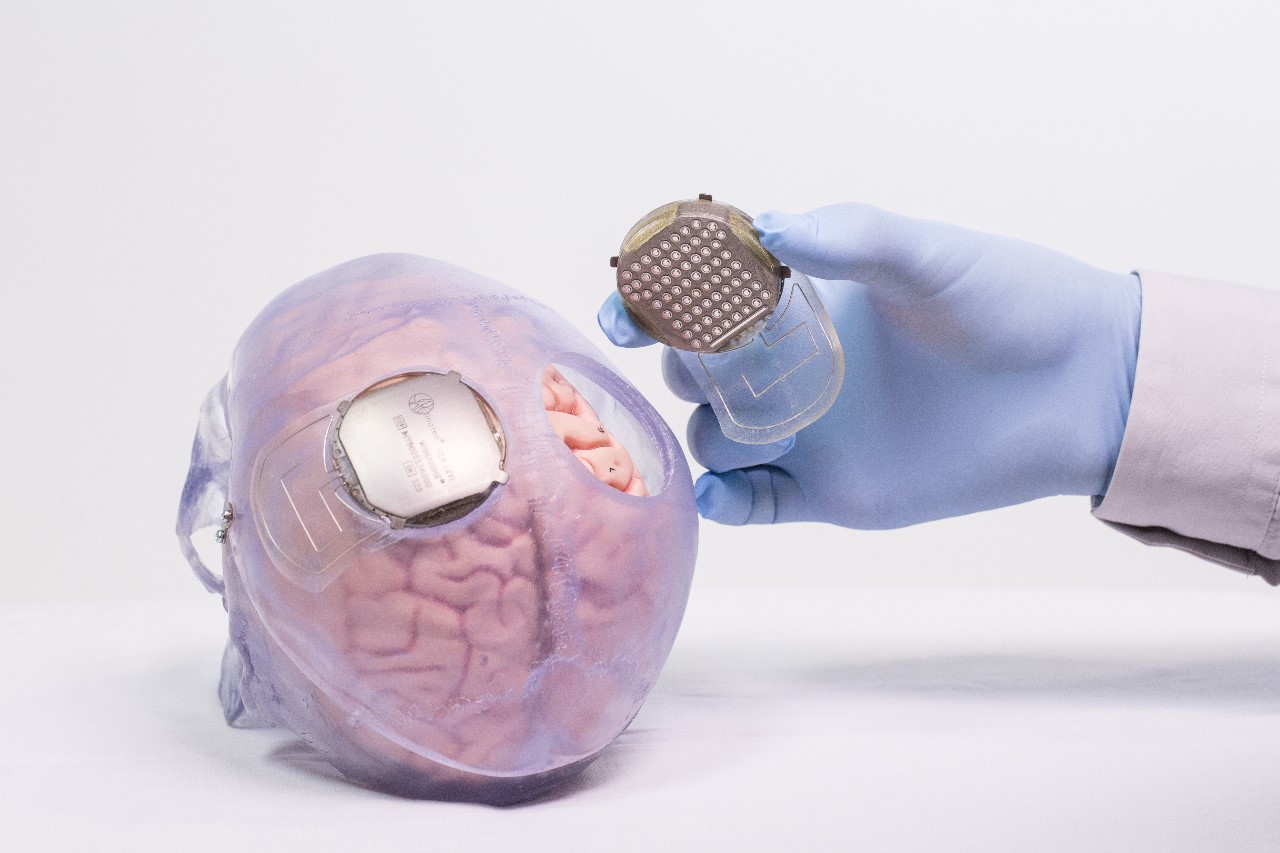

C’est ce que prétend Facebook avec son projet d’assistant virtuel open source. Baptisé Blender en raison de sa capacité à fusionner plusieurs compétences conversationnelles à la fois, ce chatbot est construit à partir de ce que Facebook appelle le modèle neuronal.

Cet assistant intègre une IA formée à partir de 1,5 milliard d’exemples de conversation. L’IA utilise ensuite ce que Facebook appelle le Blended Skill Talk (BST) pour fusionner les différentes capacités des chatbots. L’objectif est d’obtenir un assistant doté d’une personnalité stable, capable de converser naturellement et de comprendre le contexte émotionnel afin de pouvoir s’adapter à l’humeur de l’utilisateur.

« L’association de ces compétences est un défi difficile à relever, car ce chatbot doit être capable de passer d’une tâche à l’autre lorsque cela est approprié, par exemple ajuster le ton si une personne passe de la plaisanterie au sérieux », ont expliqué les chercheurs de chez Facebook.

Selon Facebook, ce défi aurait été relevé avec efficacité. Les deux tiers des évaluateurs ont jugé que Blender avait une consonance humaine. La moitié a même déclaré qu’ils préféreraient une conversation avec Blender plutôt qu’avec un humain en raison de ses capacités de mixage.

Mais ces quelques résultats encourageants ne signifient pas pour autant que Blender soit parfait. L’IA doit être encore améliorée. C’est en partie pour cette raison que Blender est un projet open source, ce qui signifie que le public et des chercheurs peuvent expérimenter des moyens d’améliorer l’IA.

La reconnaissance vocale

Les chatbots conversationnels connaissent un intérêt croissant depuis la pandémie de COVID-19. Les gouvernements, les prestataires de soins de santé et des entreprises sont très intéressés par l’utilisation de l’IA pour communiquer avec les patients ou des clients.

Le projet de Facebook confirme que les chatbots feront de plus en plus partie de notre vie quotidienne. A titre personnel ou professionnel. Et l’intégration de l’IA favorise le développement de chatbots vocaux pour des usages spécifiques.

« Si c’est pour faire la même chose qu’un chatbot “classique” en ajoutant la voix, ça n’a pas beaucoup d’intérêt, constate Eric Buhagiar, directeur marketing & commercial chez Aisperto. Le bot vocal présente un intérêt quand je n’ai pas de clavier ni d’écran. Et il permet de formuler une requête plus rapidement que si je devais la taper. Deuxième avantage ; comme j’ai les mains libres, je peux faire autre chose en même temps. On peut donc le retrouver embarqué dans une télévision, une enceinte connectée, une voiture… La reconnaissance vocale s’est beaucoup améliorée depuis le début des années 2000. Dans 90 % des cas, elle fonctionne bien avec le vocabulaire classique et si l’on prononce bien ».

Ce spécialiste reconnaît qu’il reste encore du progrès à faire dès que l’on aborde du vocabulaire plus technique, des acronymes ou des noms de famille : « Le résultat est plus aléatoire et il faut épeler, ce qui rend moins fluide l’échange ».

Reste la problématique de la protection des données personnelles. Les enregistrements des enceintes connectées ont inquiété le grand public. À ce sujet, la CNIL a rappelé les obligations et les mesures à prendre.

Comme tout service, un chatbot doit être en conformité avec le Règlement général sur la protection des données (RGPD). Il doit informer les utilisateurs de façon simple et intelligible de l’utilisation de leurs données et respecter les « principes » de ce texte européen (la finalité, la durée, la confidentialité des échanges) et le droit à l’oubli.