Par Hubert Blatz

La crise énergétique touche aussi l’informatique. Confrontés à des hausses de leurs factures d’électricité, des opérateurs de datacenters sont contraints de revoir à la hausse leurs tarifs. Il y a quelques mois, Interxion a annoncé à ses clients français une hausse de 14 %.

Les opérateurs de datacenters n’ont pas attendu la crise énergétique que nous connaissons actuellement pour étudier différentes pistes permettant de limiter leur consommation en énergie.

Traditionnellement, les serveurs des gros centres de données sont refroidis en aspirant de l’air froid à une extrémité et en l’expulsant à l’autre extrémité. Ces bâtiments ont été conçus pour optimiser cette méthode de refroidissement en créant des îlots froids et des îlots chauds.

Mais ce n’est pas l’idéal, car cette solution est particulièrement énergivore et émettrice de gaz à effet de serre. De plus, la conductivité thermique de l’air n’est pas très élevée. Nous l’avons tous constaté cet été. Lorsqu’il fait chaud, nous utilisons des ventilateurs pour nous rafraîchir, mais à un moment donné, ces appareils ne suffisent plus et nous nous tournons généralement vers une solution plus efficace : l’eau. Par exemple, une grosse serviette humide placée devant un ventilateur.

Plus récemment, des datacenters ont intégré le refroidissement adiabatique. Cette technique consiste à faire passer un flux d’air chaud dans une salle et à y vaporiser de l’eau. Mais cette solution implique des réglages très précis afin de ne pas être pénalisé par de la condensation sur les équipements à refroidir.

Étape ultime, le refroidissement liquide par immersion (Immersion Cooling). Les serveurs sont plongés dans un liquide diélectrique à base d’huiles de cuisson usagées ou de vidange des véhicules. Un bain d’huile qui oblige néanmoins l’opérateur de datacenters à développer ses propres serveurs, car aucun constructeur traditionnel ne produit à notre connaissance d’équipements adaptés à l’immersion. Cette solution oblige aussi à revoir les process de maintenance des matériels.

C’est néanmoins la solution retenue par TotaLinuX, une entreprise française basée dans la French Tech de Paris Saclay à Jouy-en-Josas et spécialisée notamment dans le HPC (high performance computing – calculs scientifiques et techniques complexes).

« Cette nouvelle technologie de refroidissement des serveurs informatiques, présente les avantages suivants : aucune émission de CO2, aucune consommation d’eau, aucun risque d’incendie contrairement aux datacenters en air, aucune humidité, aucune poussière et aucun bruit. Et surtout, elle permet de diminuer de près de 60 % la consommation d’électricité », souligne Frédéric Delpeyroux, fondateur et CEO de TotaLinuX.

Autre atout mis en avant par ce spécialiste, la possibilité de réchauffer le bâtiment intégrant le datacenter, mais aussi des logements environnants comme des installations municipales (piscines, centres sportifs…). La chaleur dégagée par le datacenter en fonctionnement est transformée en énergie thermique récupérable. Plus la peine d’avoir une chaufferie.

Cette idée est en passe de se concrétiser avec iTrium 1, première réalisation du programme Itrium de TotaLinuX. Les premières pierres d’un bâtiment ont été posées en juillet dernier en banlieue parisienne.

Les 2 500 m² de bureaux et d’exposition seront chauffés grâce à un centre de données immergé. Le bâtiment sera d’ailleurs labellisé selon la certification BREEAM (Building Research Establishment Environmental Assessment Method), un standard de l’évaluation environnementale des bâtiments. D’autres projets sont prévus à l’horizon 2024-2025 avec ITrium 2, à Lannion, ITrium 3 à Montsoult et ITrium 4, dans le Val-de-Marne.

Les aires marines protégées (AMP) contribuent bien à l’adaptation et à l’atténuation des effets du changement climatique. C’est ce que viennent de démontrer des scientifiques du Criobe (CNRS/École pratique des hautes études/UPVD) au sein d’une équipe internationale. Leur étude publiée dans One Earth a analysé 22 403 articles de recherche consacrés aux AMP.

Les résultats démontrent que les AMP peuvent améliorer de manière significative la séquestration du carbone, la protection des côtes, la biodiversité et la capacité de reproduction des organismes marins. Elles améliorent aussi les captures et les revenus des pêcheurs lorsqu’elles sont intégralement ou hautement protégées. Joachim Claudet, co-auteur de cette étude, directeur de recherche CNRS au Criobe et président du conseil scientifique de la plate-forme Océan et Climat, nous explique ces résultats.

Joachim Claudet : La littérature scientifique documente déjà le fait que les aires marines protégées sont un outil efficace pour la conservation de la biodiversité. On sait aussi qu’elles peuvent fournir un certain nombre de bénéfices socio-économiques. Elles bénéficient par exemple à la petite pêche artisanale côtière. Cela est documenté à partir de méta-analyses qui prennent en compte une multitude d’études.

Il y avait beaucoup de suppositions sur le fait que les AMP pouvaient être utilisées soit pour l’atténuation soit pour l’adaptation au changement climatique. On a dont fait cette étude pour évaluer ces effets.

L’étude évalue les mécanismes pour lesquels les AMP peuvent potentiellement jouer un rôle pour l’atténuation ou l’adaptation au climat. Nous avons identifié ces mécanismes et les avons classés en trois catégories : l’atténuation, l’adaptation écologique et l’adaptation sociale au changement climatique. Puis, nous avons cherché à évaluer l’effet positif, négatif ou ambigu des AMP sur chacun de ces mécanismes identifiés.

Nous utilisons deux approches différentes pour avoir à la fois des informations qualitatives et quantitatives lorsque cela est possible. Ainsi, nous avons eu recours d’une part à la technique du « vote counting », largement utilisée dans les sciences sociales pour l’évaluation qualitative, et de l’autre une méta-analyse pour quantifier l’effet d’un mécanisme. Par exemple pour l’adaptation écologique, on ne peut pas évaluer d’effet qualitatif ou quantitatif pour la plasticité phénotypique – capacité à s’acclimater – et sur la connectivité spatiale. Sur l’atténuation, on peut quantifier un effet sur la séquestration du carbone, mais pas sur la régulation de l’équilibre acido-basique.

La méta-analyse montre que les AMP permettent d’avoir une séquestration du carbone supérieure par rapport à une situation sans aire marine protégée. Il y a ainsi un effet très clair sur l’atténuation. C’est notamment le cas pour les mangroves, les herbiers de Posidonie et les macroalgues.

La protection des habitats permet en plus d’atténuer la puissance des vagues et donc l’érosion. Cela permet d’avoir une meilleure protection des côtes, donc une meilleure adaptation au changement climatique. Cela permet par ailleurs d’avoir plus de biodiversité, plus de biomasse et d’augmenter la capacité de reproduction des organismes marins. Tout cela, c’est plus d’adaptation écologique.

En plus, et c’est la première synthèse qui le montre, les AMP permettent d’augmenter les captures et surtout les revenus des pêcheurs. Cela contribue à la capacité d’adaptation sociale au changement climatique.

Par contre, et c’est très important de le souligner, la plupart de ces bénéfices, en particulier les bénéfices socio-économiques, ne sont obtenus qu’avec une protection intégrale ou haute des AMP. Donc les AMP sont un outil pertinent d’atténuation et d’adaptation au changement climatique, à condition qu’elles soient de protection intégrale ou haute.

Dans la littérature scientifique, on s’intéresse de plus en plus à développer des AMP qui soient « climate smart », c’est-à-dire qu’elles puissent s’adapter au changement climatique. On entend par là qu’elles soient aux bons endroits, même quand les populations animales vont se déplacer à cause du changement climatique.

C’est très bien de réfléchir à cela, mais plutôt que de faire des choses qui s’adaptent au changement climatique, il faut déjà s’assurer que les AMP qu’on a permettent de s’adapter au changement climatique. Il faut donc plutôt augmenter le niveau de protection des AMP existantes plutôt que de chercher à les mettre dans des endroits qui vont être résilients au changement climatique.

Le nouveau système énergétique nécessaire à la transition se met progressivement en place, en particulier pour la production d’électricité où les sources renouvelables (éolien et solaire photovoltaïque principalement) seront incontournables, comme plusieurs scénarios le montrent (RTE, Ademe, négaWatt). Si la France n’avait pas pris de retard dans ce domaine, elle aurait d’ailleurs moins de difficulté à passer l’hiver. Il est donc probable, comme le projet de loi sur les énergies renouvelables en cours d’examen doit le permettre, que leur développement va être accéléré.

La variabilité de ces énergies renouvelables électriques pose à terme la question du stockage d’électricité. En plus des traditionnelles stations de transfert d’énergie par pompage (Step), voilà quelques années qu’une filière pour les batteries stationnaires commence à émerger. Dans le monde, 16 GW de ces batteries étaient installés fin 2021 dont 6 GW cette année-là. Selon l’Agence internationale de l’énergie, la transition vers un système énergétique atteignant la neutralité carbone (Net Zero Scenario) nécessiterait d’atteindre 680 GW de batteries en 2030, soit l’installation de 80 GW par an en moyenne dès 2022 !

Au niveau européen, la volonté affichée est de garder la main sur cette brique technologique des batteries, afin d’être indépendant d’autres pays-continents comme la Chine (qui dispose des plus grands fabricants de batteries Lithium-ion) et les États-Unis (qui concentrent le plus grand nombre de projets dans le monde). Mais aucun cadre spécifique n’est donné au stockage d’électricité au niveau communautaire. Il est évoqué dans le Clean Energy Package, mais sans objectif particulier. Les promoteurs de cette solution, regroupés au sein de l’Association européenne pour le stockage d’énergie, ont pourtant bien chiffré le besoin : selon eux, au regard du triplement des capacités éoliennes et solaires nécessaires aux objectifs EnR 2030 de l’UE, il faudrait déployer 200 GW de stockage en 2030 et pousser jusqu’à 600 GW en 2050. Pour tenir ce rythme de 14 GW nouveaux chaque année, la valorisation économique de l’électricité stockée doit être facilitée par rapport aux règles actuelles du « market design ».

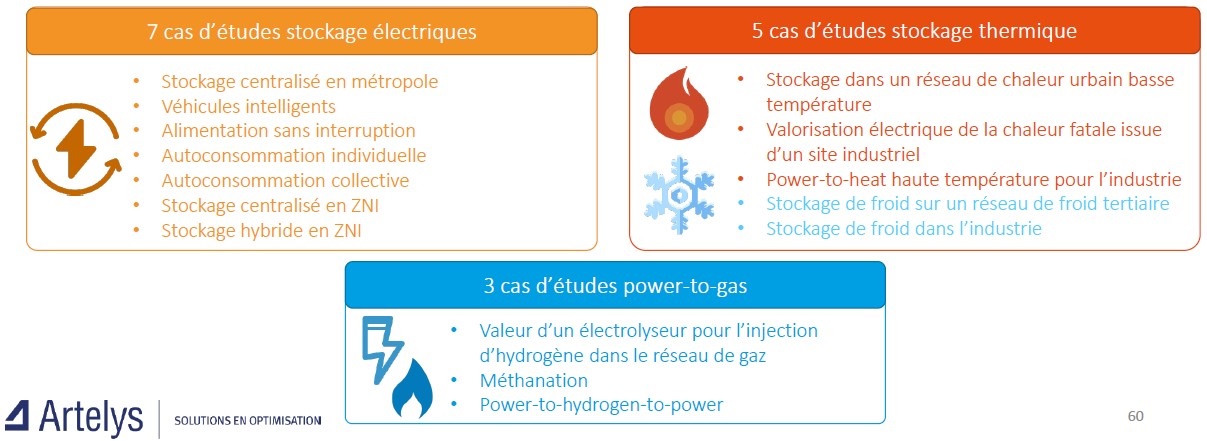

Définir les besoins en stockage d’électricité nécessite en fait d’avoir une vision globale du système énergétique, des différents vecteurs et des différentes transformations possibles. Une étude récente de la société Artelys pour le Club Stockage de l’Association Technique Energie Environnement (ATEE) tente d’éclaircir ce que serait l’avenir en englobant justement les stockages électriques, soit directs (batteries, Step), soit par une solution thermique, soit par la transformation de l’électricité en hydrogène puis éventuellement en d’autres molécules (power to gas) en France aux horizons 2030 et 2050. Tous les coûts de ces solutions de stockage sont à la baisse et il importe de savoir dans quelles situations elles vont avoir le plus d’intérêt pour la collectivité. L’analyse d’Artelys détermine donc quelle est la valeur de l’ajout d’une installation supplémentaire de stockage par rapport à des scénarios présentant déjà un certain mix, en l’occurrence ceux des trois scénarios M1, M23 et N2 de RTE, le premier étant celui qui a le plus recours au stockage (20 GW de batteries et plus de 15 GW en power-to-gas en 2050).

L’étude, appelée PEPS5 (pas encore publiée, mais qui a été présentée lors d’un colloque de l’ATEE début octobre), soulève 15 cas d’études, dont la moitié sur le stockage direct d’électricité. Si on ne considère que ce dernier, on peut retenir trois messages clés.

Globalement, cette étude montre qu’au-delà des scénarios de RTE où il y a déjà un certain équilibre trouvé avec une part de stockage, l’ajout de capacité supplémentaire devra être minutieusement étudié. Mais d’ici là, le cadre juridique, réglementaire et tarifaire du stockage doit encore être amélioré pour qu’il commence à se développer sérieusement.

Un extrait de « Captage et stockage du CO2 dans le contexte de la transition énergétique » par Ludovic RAYNAL, Sina TEBIANIAN

Un aspect remarquable de l’effet de serre est qu’il n’est pas dû aux principaux composants de l’atmosphère, à savoir l’azote et l’oxygène, représentant en volume respectivement 78 % et 21 % de sa composition, mais à des gaz présents en relativement faible quantité. Le premier de ces éléments est la vapeur d’eau. Cette molécule fait l’objet de relativement peu de débat car la vapeur d’eau se condense sous forme de pluie et ne se concentre pas dans l’atmosphère. Au contraire, le dioxyde de carbone, CO2, s’accumule dans l’atmosphère et l’évolution de sa concentration est, pour partie, directement imputable aux activités humaines. L’impact de ce gaz est d’autant plus sérieux que la durée de vie du CO2 est longue, estimée à près de 100 ans. C’est cette valeur qui est retenue pour estimer le potentiel de réchauffement global (PRG) relatif des autres gaz, le CO2 servant de référence. Ainsi, le méthane a un PRG de 21 et l’oxyde nitreux, ou protoxyde d’azote, un PRG de 290. Via l’utilisation de ce PRG normalisé, on peut ramener l’ensemble des émissions de gaz à effet de serre à une émission en équivalent de CO2, CO2 eq.

Le CO2 serait responsable de plus de la moitié de l’augmentation de la concentration des gaz à effet de serre sur la période de 1980 à 1990. Cette « primauté » a notamment été confirmée dans le 5e rapport du GIEC, sorti en 2014. La part des émissions industrielles de CO2 est passée de 55 % à 65 % en l’espace de 40 ans. Ces émissions se traduisent par une augmentation de la concentration en CO2 dans l’atmosphère, comme le montrent les mesures de la National Oceanic and Atmospheric Administration, NOAA, réalisées à l’observatoire de Mauna Loa (Hawaï, USA). La teneur de 400 ppm a été dépassée depuis 2015 (400 ppm correspondant à 400.10–6 mol CO2/mol air sec). Or, les mesures réalisées dans les carottes de glace ont permis de démontrer un lien étroit entre teneur en CO2 dans l’atmosphère et température, leurs évolutions respectives étant synchrones à ± 200 ans sur une période qui couvre plus de 800 000 ans.

L’impact des émissions de gaz à effet de serre sur le réchauffement climatique est d’ores et déjà perceptible dans de nombreux pays, même si celui-ci est très disparate selon les régions du monde. Du fait notamment des courants marins et de la température locale, impactant la teneur locale en vapeur d’eau dans l’atmosphère, on observe des différences notables d’une zone à l’autre. Une augmentation de +1 °C à l’échelle de la planète se traduit par une augmentation de près de 2,5 °C dans certaines régions, notamment l’Asie Centrale ou l’Afrique subsaharienne. S’ensuit un grand nombre de conséquences, parmi lesquelles une disparition progressive des glaces aux pôles et des glaciers, et une montée du niveau des océans ainsi que des variations importantes de précipitations. Cette dernière évolution peut avoir des conséquences dramatiques sur l’agriculture et la santé, et donc sur l’avenir de l’humanité en général.

Exclusif ! L’article complet dans les ressources documentaires en accès libre jusqu’au 10 novembre 2022 !

« Captage et stockage du CO2 dans le contexte de la transition énergétique » par Ludovic RAYNAL, Sina TEBIANIAN

Pour notre dossier d’octobre, « Vers une industrialisation du recyclage des émissions de CO2 », voici les thèses sélectionnées par le REDOC SPI. Retrouvez le résumé de ces thèses ainsi que les thèses des mois précédents sur le site de notre partenaire.

Stockage simultané de carbone dans des terres marginales et des produits anthropiques grâce à la bio-pompe : potentiel d’induction d’émissions négatives et d’atténuation du changement climatique

Zhou Shen

Thèse de doctorat en Génie des Procédés et de l’Environnement, soutenue le 18-05-2022

Toulouse Biotechnology Institute

Thermophysical processes and reactive transport mechanisms induced by CO2 injection in deep salaine aquifers.

Ange Ndjaka

Thèse de doctorat en Mécanique des Fluides, soutenue le 16-02-2022

Laboratoire des Fluides Complexes et leurs Réservoirs

Amélioration des propriétés des granulats recyclés par stockage de CO2 : étude de la faisabilité pré-industrielle

Marie Sereng

Thèse de doctorat en Sciences des Matériaux, soutenue le 15-12-2020

Laboratoire Formulation, microstructure, modélisation et durabilité des matériaux de construction

Evaluation du stock de carbone dans les forêts Libanaises. Exemple des forêts du Nahr Beyrouth

Ralph Zoghaib

Thèse de doctorat en Géographie, soutenue le 12-11-2021

Identité et différenciation de l’espace, de l’environnement et des sociétés

Procédé de captage et libération du CO2 assisté par l’électrolyse utilisant des matériaux de type brucitique

Cherif Morcos

Thèse de doctorat en Génie des procédés et de l’Environnement, soutenue le 13-12-2021

Laboratoire de génie chimique

Development, modeling and optimization of CO2 separation process using membrane contactor : applied to hydrogen purification

Sayali Ramdas Chavan

Thèse de doctorat en Génie des procédés, soutenue le 12-04-2022

Laboratoire de génie des procédés et matériaux

Modelling of MOF/Graphene oxide composites and their performances for CO2 capture

Anusha Lalitha

Thèse de doctorat en Chimie et physico-chimie des matériaux, soutenue le 13-03-2020

Institut Charles Gerhardt

Raman spectroscopic study of CO2 capture and separation by semi-clathrate hydrates crystallization and investigation of exchange processes in hydrates

Carla Thais Rodriguez Machine

Thèse de doctorat en Milieux dilués et optique fondamentale, soutenue le 22-01-2021

Laboratoire de physique des Lasers, atomes et molécules

Processus physico-chimiques et impacts des fuites de CO₂ sur les hydrosystèmes proches surface lors d’un stockage géologique : approches expérimentales in-situ et en laboratoire

Anélia Petit

Thèse de doctorat en Science et Technologie (Terre, Eau, Image), soutenue le 02-12-2020

Géoressources et Environnement

Reaching carbon neutrality in France by 2050 : optimal choice of energy sources, carriers and storage options

Behrang Shirizadeh Ghezeljeh

Thèse de doctorat en Economie de l’environnement, soutenue le10-02-2021

EHESS & Centre de développement de la recherche internationale en environnement

Introduite par la Loi de Transition Energétique pour la Croissance Verte (LTECV), la Stratégie Nationale Bas-Carbone (SNBC) est la feuille de route de la France pour lutter contre le changement climatique. Elle donne des orientations pour mettre en œuvre, dans tous les secteurs d’activité, la transition vers une économie bas-carbone, circulaire et durable.

Parmi ces orientations permettant de poursuivre cette stratégie, le captage, le stockage et la valorisation du CO2 atmosphérique font l’objet d’une attention particulière. En effet, que ce soit en France et dans le monde, la captation du carbone constitue un rouage essentiel, afin de parvenir, à l’horizon 2050, à la neutralité carbone. Les ambitions françaises et mondiales en termes de séquestration carbone sont d’ailleurs extrêmement ambitieuses.

NetZero une entreprise française qui produit, à partir de biomasse résiduelle, du biochar, un amendement de sol stable, qui permet de séquestrer le carbone dans les sols sur du long terme.

Une solution unique en son genre, développée par les fondateurs de cette start-up en milieu tropical, là où la biomasse se trouve en grandes quantités.

NetZero a d’ailleurs passé la première étape du concours XPRIZE Carbon Removal, et à cette occasion reçu un million d’euros, afin de continuer le développement du produit et montrer que la technologie développée par NetZero peut passer à l’échelle industrielle, tout en étant rentable.

Olivier Reinaud, l’un des co-fondateurs de NetZero, a expliqué aux Techniques de l’Ingénieur en quoi le biochar est une solution d’avenir.

Olivier Reinaud : NetZero est une entreprise qui a moins de deux ans et qui évolue sur une dynamique très rapide. L’objectif de notre entreprise est de faire passer à l’échelle le biochar en tant que solution de piégeage long terme de carbone, en se concentrant sur les zones tropicales. En effet, les zones tropicales sont riches en biomasse non valorisée, avec des problématiques de qualité des sols, d’acidité, d’accès aux engrais… l’utilisation du biochar dans ces régions permet de répondre en grande partie à ces problématiques, car il présente possède également des propriétés agronomiques très intéressantes.

Nous utilisons un processus relativement classique de pyrolyse, qui nécessite cependant certaines adaptations spécifiques pour être utilisé avec des résidus agricoles, qui sont notre matière première. Dans notre usine pilote au Cameroun, nous avons accès à une grande quantité de résidus générés par la culture du café. L’innovation que nous portons va plus concerner le modèle que nous développons en amont et en aval, plutôt que la pyrolyse en tant que tel, bien qu’il y ait des leviers significatifs d’optimisation technique. En effet, nous proposons un accompagnement et un package global : nous prenons en charge tous les aspects, depuis le sourcing de la biomasse jusqu’à la distribution finale du produit, l’accompagnement des agriculteurs pour l’utilisation du produit, et la certification des crédits-carbone associés au stockage durable du carbone dans le sol. C’est ce modèle intégré, développé en zone tropicale, qui fait notre spécificité, puisque nous sommes les premiers à avoir développé une usine de fabrication de biochar en Afrique. Et notre seconde usine, au Brésil, sera également la première du genre en Amérique du Sud.

En amont, nous leur expliquons l’intérêt de transformer leurs résidus agricoles en biochar, qu’ils pourront utiliser par la suite pour amender leurs sols, et nous organisons la logistique de collecte de la biomasse. En aval, nous formons les agriculteurs à l’usage du produit et menons des essais agronomiques pour déterminer les paramètres les plus optimaux d’usage.

Il faut savoir que le biochar est un produit qui est connu depuis très longtemps : il était cependant très peu utilisé jusqu’à récemment, car sa production était chère, et les prix de vente prohibitifs. Notre modèle, qui repose sur une technologie plus performante, une production à échelle industrielle, dans des zones où la biomasse est abondante et peu coûteuse, et avec des crédits-carbone comme source complémentaire de revenus, permet un prix de vente du biochar forcément plus attractif pour les utilisateurs.

Nous sommes dans une logique d’économie locale et circulaire. Nous vendons du biochar pour un usage agricole, aux producteurs qui nous fournissent la matière première, à savoir leurs résidus de production. Nous voulons développer un modèle circulaire, avec des garanties de long terme quant à la fourniture des résidus de culture, c’est pour cette raison que nous vendons le biochar à un prix très attractif aux agriculteurs qui nous fournissent la matière première.

Pour le moment, nous ne voulons pas vendre notre biochar autre part que là où nous le produisons, car cela briserait l’aspect circulaire du modèle que nous développons. L’optimisation de notre modèle à court terme n’est pas notre priorité. Ainsi, plutôt que de vendre notre biochar sur des marchés où les prix seront plus élevés, nous préférons le vendre aux agriculteurs qui nous fournissent la matière première. Cette circularité est pour nous un facteur fondamental pour réussir le passage à l’échelle du biochar.

Le biochar permet de séquestrer le carbone dans les sols pendant des centaines d’années. De plus, ce matériau possède des propriétés remarquables en termes de rétention d’eau et de nutriments, ce qui prend tout son sens en zone tropicale, où les apports d’engrais se fait généralement plusieurs fois par an. Le biochar permet également de réhausser le pH des sols. Aujourd’hui, les agriculteurs des zones tropicales utilisent de la chaux pour augmenter le pH des sols, mais il faut la plupart du temps l’importer, à des prix substantiels. Notre solution permet aux agriculteurs de se reposer sur une production locale du biochar, qui va leur coûter moins cher, et leur permettre d’afficher un bilan carbone moins lourd.

La pyrolyse nous permet d’obtenir du biochar, solide, et des gaz en quantités importantes. Ces gaz sont brûlés pour maintenir le processus de pyrolyse, qui se trouve ainsi auto alimenté. Comme il reste malgré tout un excédent de gaz, il est possible, à partir de ces surplus, de faire de la cogénération d’électricité renouvelable.

Même s’il ne s’agit pas d’un prototype mais bel et bien d’une usine en vraie grandeur, notre site au Cameroun a été construit comme un démonstrateur. Il remplit parfaitement sa fonction de prouver que notre modèle fonctionne mais il est, par définition, sous-optimisé et vecteur de nombreux apprentissages. Notre programme de R&D doit permettre, à chaque nouvelle itération, d’améliorer la technologie, les process, et plus largement le modèle. Ainsi, notre seconde usine au Brésil sera nettement plus performante et le modèle plus optimisé. Nous voulons appliquer ce processus itératif jusqu’à atteindre un modèle extrêmement optimisé et packagé, qui puisse être franchisé et ainsi se déployer à très grande échelle.

Propos recueillis par Pierre Thouverez

« Câbles sous-marins : l’Europe sous la menace d’un black-out d’Internet par la Russie », s’interroge BFMTV. « Guerre en Ukraine : la Russie peut-elle couper Internet en France en s’attaquant aux câbles sous-marins ? », s’inquiète France Info. « Une coupure d’Internet par la Russie : le cauchemar de l’Europe », renchérit La Tribune.

En plus d’avoir froid cet hiver, nous risquerions de ne plus pouvoir nous connecter à nos sites préférés à cause des Russes ? La présence récente d’un navire de « recherche » russe Akademik Boris Petrov, qui pourrait être un espion, repéré au large des côtes du Royaume-Uni, conforte ces craintes. La Royal Navy le suit à la trace après qu’il a changé de cap de façon inattendue.

On craint une attaque contre les câbles sous-marins essentiels à l’Internet. Les câbles à fibres optiques qui relient les États-Unis et l’Europe constituent la « colonne vertébrale » de l’Internet. Les responsables de la marine américaine mettent en garde depuis de nombreuses années contre les ravages que la Russie pourrait causer en cas d’attaque.

Pourtant, cette affaire de sabotage de câbles sous-marins relève du fantasme. « Il y a une grosse confusion qui est faite dans de nombreux médias avec la situation de Monsieur tout le monde et celle d’un pays comme le nôtre. Quand un sous-traitant d’un FAI coupe maladroitement la fibre d’un particulier, ce dernier ne peut plus accéder à ses sites préférés. La situation n’est pas du tout comparable pour l’hexagone pour deux raisons principales. Premièrement, notre pays a beaucoup de connexions à l’extérieur dont une bonne partie est terrestre. Deuxièmement, une bonne partie de l’activité Internet est locale, car l’Europe occidentale est un cas particulier avec une interconnexion locale forte. Concernant l’Internet, l’Europe est autosuffisante. Ce n’est pas le cas de l’Afrique et l’Amérique du Sud qui sont très dépendants de connexions extérieures », précise Stéphane Bortzmeyer, spécialiste en réseau.

Pour cet expert qui connaît bien les rouages d’Internet, « des coupures de tous les câbles sous-marins de la planète auraient des conséquences ennuyeuses en France, car on ne pourrait pas joindre les États-Unis ou l’Australie. Mais ça ne serait pas une coupure d’Internet, car celui-ci est une interconnexion de réseaux. Seules les entreprises françaises qui hébergeraient toutes leurs données dans des datacenters d’Amazon ou de Microsoft aux États-Unis ne pourraient plus y accéder en cas de coupures des câbles transatlantiques ».

D’ailleurs, il n’est pas nécessaire que les Russes sabotent un câble sous-marin pour que des entreprises soient impactées. Une panne au niveau d’un Content delivery network¹ ou des actes de vandalisme comme ceux qui ont eu lieu récemment dans la région de Marseille ont des impacts pour certains services et entreprises.

« En fait, les médias et les hommes politiques fantasment beaucoup sur ces histoires de coupures de câbles sous-marins alors qu’on devrait plutôt se focaliser sur le système de santé français qui va très mal comme l’a démontré la pandémie », se lamente Stéphane Bortzmeyer.

¹ Un réseau de diffusion de contenu (CDN) est un groupe de serveurs géographiquement distribués qui accélèrent la diffusion de contenu Web en le rapprochant de l’endroit où se trouvent les utilisateurs

Entre 1948 et aujourd’hui, la France a perdu environ la moitié de ses lignes ferroviaires de desserte fine du territoire. La faute au modèle économique de ces « petites lignes », comme on les appelle plus couramment. Le scénario est quasiment toujours le même : étant donné qu’elles coûtent cher à exploiter, la fréquence de passage des trains et leur amplitude horaire sont peu à peu réduites, et provoquent une baisse du nombre de voyageurs transportés. Ce cercle vicieux se termine par la fermeture progressive de ces lignes, jugées pas assez rentables. En 2018, plusieurs acteurs¹ de la région Occitanie ont décidé de redynamiser ces lignes abandonnées. Leur idée principale : utiliser des innovations technologiques pour refaire fonctionner ces voies ferrées à moindre coût. En 2022, ce projet, baptisé Ecotrain, a trouvé un nouvel élan en recevant le soutien du plan France 2030. Il regroupe à présent un large consortium² constitué d’instituts de recherche et d’entreprises.

La première solution retenue est d’alléger les trains. Alors que ceux de conception classique pèsent environ 50 tonnes, le poids des futures navettes sera limité à une quinzaine de tonnes. Le bas de la caisse restera métallique, tandis que le haut sera conçu à l’aide d’un matériau composite en fibres de lin pour alléger la structure, mais aussi préparer sa déconstruction lors de sa fin de vie. « Cet atout permettra de limiter le coût d’investissement de remise en état des lignes, explique Norbert Féraud, directeur adjoint de la recherche et de l’innovation à l’IMT Mines Albi. Les ouvrages d’art comme les ponts et les trémies ne sont plus capables de supporter les poids des trains de conception classique, mais cette difficulté sera levée avec ces nouvelles navettes plus légères. Une solution de rails en composite va aussi être étudiée afin de rénover les voies déjà existantes, notamment celles qui ne possèdent plus de rails ni de traverses. Il sera ainsi inutile de refaire tout le génie civil, car on pourra profiter des tabliers existants. »

Une autre innovation va consister à rendre autonomes ces navettes. Elles fonctionneront sans conducteur dans le but de réduire leurs coûts d’exploitation. Pour cela, des technologies conçues au départ pour les voitures autonomes vont être transférées vers le ferroviaire. Il est notamment prévu d’utiliser des capteurs pour identifier les éventuels obstacles sur les voies (personnes humaines, animaux, arbres…), ainsi que sécuriser les passages à niveau. D’autres technologies utilisées sur des tramways et des métros seront aussi transférées, notamment celles permettant le positionnement très précis des trains, à l’aide de solutions de type GMSS (Global Mobile Satellite System).

À l’image des trains actuellement en service, ces navettes fonctionneront à l’électricité. Par contre, elles ne seront pas alimentées grâce à des caténaires. Cette solution technique nécessite en effet de trop lourds investissements et se révèle également fragile, notamment face aux intempéries, ce qui induit des coûts d’entretien élevés. Ces navettes, dotées d’une motorisation d’environ 90 kW, seront équipées de batteries qui seront rechargées en électricité à l’aide de microcentrales photovoltaïques installées dans certaines stations. « L’idée serait que la capacité des batteries soit suffisante pour une journée, confie Norbert Féraud. Sinon, elles retourneront se charger à une microcentrale photovoltaïque. Les lignes que nous envisageons d’exploiter font en moyenne 50 km, avec des écarts allant de 10 à 100 km. Étant donné que les microcentrales produiront du courant en continu, alors que les navettes ont un besoin discontinu, le surplus d’énergie sera dirigé vers une autoconsommation locale, notamment pour alimenter des infrastructures collectives, voire des particuliers. »

Un autre aspect innovant du projet se situe au niveau de la solution digitale retenue pour faire face au flux des voyageurs. Dans ce projet, chaque navette pourra accueillir une trentaine de passagers. Jusqu’à présent, lorsqu’il est nécessaire d’augmenter la capacité de transport des voyageurs, les trains sont reliés entre eux à l’aide d’un attelage mécanique. Compte tenu des solutions de positionnement très précis et des logiciels de pilotage employés, la technique ici consistera à réaliser un attelage virtuel. « On appelle cela du platooning, les deux navettes seront synchronisées et communiqueront entre elles pendant la durée du trajet, mais sans connexion physique, complète Norbert Féraud. Cette technologie vient de l’automobile ; ces systèmes de communication sécurisée sont appelés V to X. Le V pour Véhicule et le X pour véhicule ou infrastructure. » Autre particularité : chaque navette étant compacte et légère, il sera possible de les transporter par la route, à l’aide d’un poids lourd, et ainsi les acheminer vers certaines lignes ferrées, en cas de besoin.

La digitalisation va aussi permettre de réaliser une nouvelle approche de la maintenance. Elle ne sera plus préventive, ni curative, mais prédictive afin de réduire le coût d’entretien des machines. Le modèle actuel nécessite de mobiliser des équipes pour diagnostiquer et détecter d’éventuelles anomalies et certaines interventions sont réalisées de manière systématique à intervalles réguliers. Dans le futur, la navette communiquera des informations et, grâce à l’utilisation d’un programme numérique basé sur l’apprentissage automatique, l’intervention des agents chargés d’assurer la maintenance sera effectuée en fonction de l’état d’usure du système ou des pièces.

Cet important programme de recherche a été découpé en « sous-projets » afin de sécuriser les financements et les livrables : navettes, microcentrales photovoltaïques, conduite autonome… En plus du transport des voyageurs, il inclut aussi le micro-fret pour les marchandises. « La solution que nous développons ne vient pas en compétition avec le TGV ou le TER, mais au contraire, permettra de drainer du flux de voyageurs vers ceux-ci, précise Norbert Féraud. Pour limiter les risques, nous essayons au maximum d’utiliser des technologies déjà ou presque matures. Nous avons aussi fait le choix de travailler avec des entreprises françaises. Un pré-démonstrateur de navette est prévu en 2025. Ensuite, une phase d’expérimentation devrait avoir lieu sur une ligne fermée en Occitanie. La première exploitation est prévue à l’horizon 2030, là encore en Occitanie, car cette région est impliquée dans ce projet depuis quasiment le début. »

¹ À l’origine, ce projet a été initié par Philippe Bourguignon (consultant et ancien directeur de programme chez Engie), Michel Colombié (Vice-président industrie de la CCI du Tarn) et Norbert Féraud (directeur adjoint de la recherche et de l’innovation à l’IMT Mines Albi), ainsi que les entreprises Socofer, Syntony et le Groupe Stratiforme-Compreforme.

² En plus des acteurs historiques, le consortium regroupe à présent, entre autres, les Instituts de recherche IMT Mines Albi, IMT Mines Alès, IMT Nord-Europe, UTC Compiègne, IRT M2P, INSA Toulouse, ISAE SupAero et les entreprises Clearsy, Amarenco, Arcadis, Groupe La Poste, Leadtech, NGE Eugénie, NGE TSO, CQFD Composite.

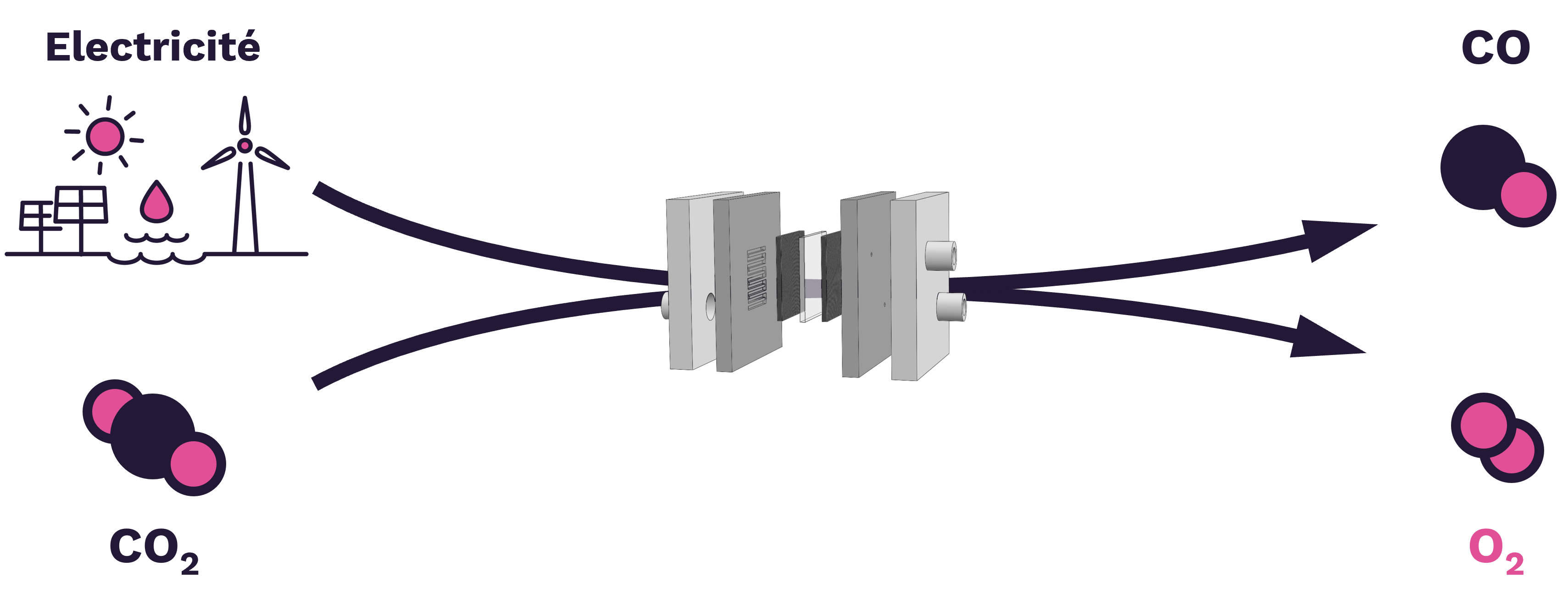

Le CO2 prend du galon. Hier considéré comme un déchet ultime, ce dernier fait aujourd’hui l’objet d’une attention particulière de la part des industriels, en France et dans le monde entier. Ces derniers développent des technologies pour le capter, le valoriser, et le faire entrer dans le cycle de vie de nouveaux produits, qui seront en quelque sorte des puits de carbone.

A l’heure actuelle, au niveau industriel, le CO2 est exploité pour deux usages principaux. D’abord pour la production d’urée (57%), puis pour la récupération assistée de pétrole. Les industries agroalimentaires et métallurgiques utilisent également du CO2, en plus faibles quantités.

Toute la difficulté de la valorisation du CO2 réside en deux mots : débouchés et énergie. En effet, développer des produits à base de CO2 est une chose, les vendre en est une autre. Il faudra que ces produits trouvent leur marché et soient compétitifs, pour être en mesure de créer une économie du CO2 la plus circulaire possible.

Aussi, l’industrialisation des technologies de valorisation du CO2 doit se faire sur un modèle énergétique pérenne : en effet, il est indispensable que la valorisation du CO2 ne soit pas plus énergivore que le gain réalisé grâce à son recyclage.

Ces deux défis constituent une barrière pour de nombreuses technologies de valorisation, pour le moment.

A l’heure actuelle, trois grandes voies de valorisation sont utilisées et développées.

C’est l’une des voies les plus explorées, notamment par l’industrie pétrolière, pour la récupération assistée de pétrole. Cette technologie est industrialisée depuis les années 1970, et peut être considérée à la fois comme une voie de stockage et de valorisation, dans la mesure où une partie du CO2 injecté dans les puits d’hydrocarbures y est séquestrée.

Une autre voie de valorisation, sans transformation, est la géothermie profonde. Grâce à la chaleur contenue dans le sous-sol de la Terre, il est possible de générer de la chaleur sans émettre de grandes quantités de CO2. Concrètement, les industriels se servent du CO2 industriel pour l’injecter dans des failles géologiques profondes. Ces dernières sont ainsi stimulées et favorisent un brassage, qui peut faire remonter des eaux profondes chaudes. Comme pour la récupération assistée de pétrole, cette technologie fait appel à du CO2 supercritique, qui fait office de solvant non polluant.

Non transformé, le CO2 peut également être utilisé pour de multiples applications de niche, qui concernent des quantités de gaz limitées : réfrigérants, conditionnement alimentaire, traitement des eaux, viticulture, soudage…

La transformation chimique du CO2, en vue de l’obtention de produits chimiques à base de CO2, est une technique de plus en plus maîtrisée. Ces transformations chimiques vont consister soit à réduire le CO2 (en y ajoutant de l’hydrogène par exemple), soit à l’insérer dans une molécule carbonée ou une chaîne minérale. La molécule de CO2, stable chimiquement, se prête bien à ce type de réactions chimiques.

A l’heure actuelle, la synthèse à partir de CO2 de produits tels que l’urée, l’acide salicylique et les carbonates cycliques est industrialisée. D’autres produits font l’objet de recherches, pour trouver les catalyseurs adaptés à l’industrialisation des processus.

C’est le cas des polycarbonates, des carbonates linéaires ou encore des acides carboxyliques. Une des contraintes au développement de ces transformations chimiques est la nécessité d’utiliser un CO2 le plus pur possible, sans quoi la réaction de catalyse peut être fortement affectée dans son rendement.

A l’heure actuelle, la valorisation du CO2 par voie biologique se fait principalement via la culture d’algues. En effet, ces dernières consomment du CO2 pour effectuer la photosynthèse et produire de la matière organique. La biomasse générée par ces processus intéresse beaucoup les filières industrielles alimentaires, pharmaceutiques ou même le secteur émergent des algocarburants.

La culture d’algues présente de nombreux avantages. D’abord, leur culture n’empiète pas sur les terres agricoles, et leur rendement photosynthétique est supérieur à celui des végétaux. De plus, elles peuvent être cultivées en eau douce ou salée, ce qui permet de développer des techniques culturales adaptées aux ressources.

Concrètement, les applications de la culture d’algues concernent l’alimentation humaine via la production d’huiles et de protéines.

Le traitement des eaux usées peut aussi être en partie réalisé par les algues, qui réduisent fortement la pollution à l’azote et au phosphore des eaux sales, domestiques ou agricoles.

Enfin, la production de médicaments ou de compléments alimentaires, ainsi que celle de biocarburants, sont pour l’instant des voies d’exploitation du CO2 en développement, qui doivent encore se perfectionner pour proposer un modèle technologique et économique rentable.

L’objectif principal du captage du CO2 est de séquestrer le gaz avant qu’il ne soit émis dans l’atmosphère. Pour ainsi dire, les dispositifs de captage sont installés directement là où les gaz sont émis.

Leur réalisation peut s’effectuer de trois manières :

Ces trois technologies représentent l’avenir du captage du CO2, qui rappelons-le, constitue la troisième priorité de l’Agence internationale de l’énergie pour réduire la concentration en gaz à effet de serre dans l’atmosphère, après l’efficacité énergétique et le développement des énergies renouvelables.

Aujourd’hui, une vingtaine de projets sont menés à l’échelle industrielle pour évaluer et améliorer le coût de la captation du CO2 émis. Si ce coût varie selon la technique utilisée, il est également tributaire du secteur d’activité concerné. Ainsi, le captage du CO2 se révèle plus cher (environ 120 euros par tonne) dans des secteurs comme la sidérurgie, la chimie ou la cimenterie par exemple, alors qu’il ne coûte « que » 15 euros, par tonne, dans une centrale à gaz. On le voit bien, le prix du captage du CO2 est le nerf de la guerre. Le scénario de l’AIE concernant le captage table d’ailleurs sur une baisse des prix des technologies de captage, seul vecteur pour généraliser ces solutions dans l’ensemble des secteurs industriels.

Si les technologies de captage se développent rapidement aujourd’hui, leur utilisation n’est pas nouvelle. Dès 1996, le site gazier de Sleipner, en mer du Nord, a mis en place une méthode pour séparer le gaz naturel extrait du CO2 qui l’accompagne. Ce dernier est ensuite réinjecté dans une nappe souterraine : ce procédé a permis, depuis plus de 25 ans, de capter (et de stocker) plus de 17 millions de tonnes de CO2.

Plus près de nous, la société Total a signé, cet été, avec Equinor et Shell, le premier contrat commercial pour le captage (et le stockage) du CO2 émis par une usine d’ammoniac et d’engrais agricoles installée aux Pays-Bas. Cette industrie très polluante, est très créatrice de gaz à effet de serre, dont du CO2 que l’on va retrouver à de fortes concentrations, ce qui facilite sa récupération. Le CO2 capté est ensuite comprimé et séquestré dans un aquifère, en mer du Nord. Le contrat prévoit la récupération de 800 000 tonnes de CO2 par an, à partir de 2025.

La quantité de CO2 récupérée par ces dispositifs est de plus en plus importante. L’entreprise américaine CarboneCapture vient par exemple d’annoncer, à travers son projet Bison Project, la volonté de capter 5 millions de tonnes de CO2 par an, d’ici à 2030.

Que ce soit en Europe, dans les pays du Nord, aux Etats-Unis, en Chine ou au Japon, les projets de captage fleurissent. De nombreuses usines pilotes sont actuellement mises en place, de même que de nombreux démonstrateurs, qui devront faire leurs preuves, avant de passer à une échelle industrielle, le plus rapidement possible. Si l’on s’en réfère aux ambitions de l’AIE, il faut faire très vite.

Par Pierre Thouverez

Guilhem Belda est ingénieur en informatique, diplômé de l’Université d’Avignon et passionné par l’aéronautique depuis son enfance. Il s’est demandé de quelle manière il était possible de concevoir des systèmes pour améliorer l’assistance à des personnes travaillant dans des milieux fortement contraints, comme c’est le cas des pilotes d’avion. En 2018, il a créé sa start-up pour développer une technologie capable de suivre l’état physiologique et cognitif de personnes évoluant dans ce type d’environnement. Après plusieurs années de recherche et développement, il est sur le point de commercialiser son système. Entretien avec le président et fondateur de Semaxone.

Guilhem Belda : En cas d’incident, les pilotes d’avion par exemple doivent être capables de mobiliser leurs compétences et leurs ressources cognitives pour faire face à cette situation, et ce malgré un fort niveau de stress. En plus de cet aspect cognitif, des contraintes venant de l’environnement peuvent intervenir, comme un changement de température, du taux d’oxygène, de fortes accélérations… Elles vont venir perturber le corps du pilote et impacter son confort et sa santé. Malgré tout, il doit être capable de s’adapter et de mobiliser rapidement et correctement toutes ses ressources, car cela va conditionner la sécurité de l’avion. Face à ces contraintes, nous développons des technologies de monitoring pour récupérer des données sur la physiologie d’une personne afin d’interpréter son état opérationnel et cognitif.

Nous recueillons des données cérébrales, au niveau du cortex préfrontal, une zone qui joue en quelque sorte le rôle de chef d’orchestre du cerveau. Pour cela, un bandeau est placé au niveau du front de la personne et équipé d’un capteur. Nous utilisons la spectroscopie, une technologie qui exploite les sources lumineuses, pour évaluer le niveau d’oxygénation du cortex et de manière continue afin de suivre son évolution. Cette technologie est déjà utilisée pour observer les zones cérébrales, mais pas dans un environnement contraint, comme nous le faisons. Cette méthode est développée en partenariat avec EuroMov DHM, un laboratoire de recherche spécialisé dans l’analyse de mesure physiologique en mouvement.

Ensuite, nous recueillons des données vocales. La voix est porteuse de sens autant sur le plan linguistique que para-linguistique. Nous recherchons toutes les informations autres que la langue, pour nous permettre de caractériser l’état d’une personne. Par exemple, quand un avion monte en altitude, la respiration du pilote devient différente, ses syllabes sont plus longues. À partir de ces petits indices, nous effectuons des corrélations avec son état physiologique. C’est un champ de recherche qui existe depuis de nombreuses années, mais là encore pas dans un univers contraint. Dans ce domaine, nous travaillons en partenariat avec le Laboratoire Informatique d’Avignon (LIA), spécialisé dans l’analyse de la voix.

Nous avons d’abord réalisé de nombreuses expérimentations pour acquérir de la donnée, que ce soit en laboratoire et en caisson pour simuler par exemple de hautes altitudes, mais aussi en conditions réelles. Au total, nous avons plus de 200 heures de vols analysés, entre autres avec des pilotes qui font de la voltige aérienne.

Ensuite, nous traitons ces données à l’aide d’un algorithme d’IA de type « machine learning » afin d’entraîner notre modèle numérique. Il va analyser les boucles d’interaction entre le domaine de la vascularisation du cerveau et celui de la production de parole et de la respiration. Nous avons à présent une bibliothèque nous permettant de savoir comment se comportent les différents signaux cognitifs d’un pilote en fonction de différentes situations, notamment sa charge mentale et cognitive, ou sa mémoire de travail… Au niveau des phénomènes physiologiques, on s’intéresse beaucoup à la manière dont se comporte le corps d’un pilote lorsqu’il est soumis à de fortes altitudes ou des accélérations, comme c’est le cas dans un avion de chasse. Lors de ces importantes accélérations, pouvant aller jusqu’à 5g (gravité – unité d’accélération, NDLR) voire 10g, la force gravitationnelle qui s’applique à un pilote va influencer le niveau sanguin dans le cerveau. Nous sommes capables d’observer ce phénomène et de déterminer si le pilote parvient à maintenir un niveau de réflexion et de performance malgré cette contrainte.

Elles sont principalement de deux ordres. Tout d’abord, dans le domaine de la formation des pilotes. L’idée est de recueillir des données lors de leur entraînement, puis d’analyser la manière dont ils réagissent à différentes situations extrêmes. Lorsque nous observons qu’il a encore de la marge, l’intensité de l’entraînement peut être augmentée, en fonction de ses capacités. Nos mesures sont personnalisées et l’objectif est d’être plus efficace et plus confortable pour le pilote en formation. Grâce à notre système, nous pouvons observer, sur la zone préfrontale du cerveau, la différence de charge entre des pilotes expérimentés ayant atteint un bon niveau de maîtrise de la situation, par rapport à de jeunes pilotes qui la découvrent.

La deuxième application se situe au niveau de l’intégration de notre système à bord des avions, sur les pilotes, dans le but de transmettre des informations aux constructeurs pour qu’ils prennent des contre-mesures. Par exemple, si un pilote se trouve surchargé mentalement, il est possible de lui mettre en avant les informations vraiment prioritaires. Autre cas : lorsqu’un pilote se trouve en haute altitude ou à la suite d’accélérations, son cerveau peut être dans un état d’hypoxie, c’est-à-dire manquer d’oxygène. La contre-mesure peut consister à l’en informer, pour qu’il redescende en altitude, car il ne s’en aperçoit pas toujours. Le constructeur peut aussi décider de mettre en place un système de secours automatique en oxygène.

Nous sommes dans une phase de développement et nous cherchons des partenaires et des clients. Des discussions sont en cours avec de grands industriels afin d’envisager d’équiper des avions de ligne. Nous avons aussi des échanges avec des opérateurs du nucléaire qui sont intéressés pour équiper leur personnel avec notre technologie. Le secteur médical est aussi une cible potentielle, notamment le domaine de la chirurgie. Il peut être intéressant d’équiper la personne qui fait l’acte chirurgical, mais aussi le patient. Il existe déjà des instruments pour mesurer l’oxygénation cérébrale, mais ils sont utilisés de manière ponctuelle au cours d’un examen. Grâce à notre système, nous pouvons observer ce phénomène en continu.

En 2021, Cyclamed a récupéré 9 833 tonnes de médicaments non utilisés (MNU) dans les 21 141 pharmacies d’officine situées en métropole et Outre-mer. Alors que la consommation de médicaments baisse en France depuis 2005, la collecte des MNU reste stable. En 2021, Cyclamed a collecté l’équivalent de 146 grammes de médicaments par habitant, soit 2,5 boîtes par habitant. Thierry Moreau Defarges, président de Cyclamed, nous explique ces résultats.

Thierry Moreau Defarges : Globalement, la consommation de médicaments en France baisse de 1 % par an depuis 2005 malgré l’augmentation et le vieillissement de la population. On est passé de 3,25 milliards de boîtes à 2,65 milliards en 2020, avec une légère remontée à 2,70 milliards en 2021. La chute de 2020 s’expliquait très clairement par la crise de la Covid qui avait eu un impact sur la consommation médicamenteuse.

Cela peut surprendre, car l’on entend parler de la croissance du marché pharmaceutique. Mais il faut bien distinguer la croissance en valeur du nombre de médicaments consommés. Si le marché croît en valeur grâce à d’importantes innovations thérapeutiques, il baisse depuis 20 ans en termes de nombre de boîtes.

La baisse s’explique par les campagnes de bon usage, d’abord développées par les administrations et par les industriels du médicament. L’idée est de souligner que le médicament n’est pas un produit comme les autres et qu’il doit être utilisé à bon escient. La plus célèbre campagne publique « les antibiotiques, c’est pas automatique » a entraîné une baisse de la consommation d’antibiotiques. Récemment, on assiste également à l’apparition des médecines douces, avec des campagnes dédiées à une médecine différente de la médecine traditionnelle.

Il y a aussi une évolution structurelle du marché. Un certain nombre de produits avec un service médical rendu insuffisant ont été déremboursés par la sécurité sociale ou retirés du marché. Je pense notamment aux vasoprotecteurs et aux vasodilatateurs, des produits qui se vendaient en millions de boîtes par mois et dont les ventes se sont effondrées. Par ailleurs, certaines formes médicamenteuses ont pratiquement disparu. Les ventes de suppositoires par exemple sont en chute libre. L’affaire du Médiator a aussi eu un effet sur la consommation de médicaments.

Enfin, un certain nombre de médicaments sont devenus des dispositifs médicaux. Les laboratoires ont transformé leur composition, mais n’ont pas apporté les mêmes preuves thérapeutiques. L’exemple type, c’est le Toplexil. Sanofi a développé un autre produit à base de plantes, le Phytoxyl, qui n’est pas un médicament mais un dispositif médical.

Dans une officine, vous trouvez d’abord les médicaments qui ont une autorisation de mise sur le marché donnée par l’ANSM, l’Agence nationale de sécurité du médicament et des produits de santé. Ce sont des produits qui ont fait l’objet d’essais de tolérance, d’essais cliniques. Il y a aussi des dispositifs médicaux, une catégorie très hétérogène de produits, en plein développement. Cela va des sirops antitussifs à la canne, en passant par les déambulateurs, les appareils à tension ou pour mesurer le diabète. Il y a aussi les cosmétiques, les compléments alimentaires qui se développent beaucoup.

La mission de Cyclamed est de récupérer les seuls médicaments à usage humain. Que faire des autres produits ? Sur les dispositifs médicaux, il n’existe pas vraiment de filière. Il y a des expérimentations ou des filières très spécifiques menées par certaines organisations humanitaires, par exemple pour récupérer les lunettes. Il y a une réflexion à avoir, par exemple sur la réutilisation des dispositifs comme les béquilles.

En 2010, nous avons mis en place une étude de gisement. La question était de savoir la quantité de médicaments chez les Français et la quantité de médicaments non utilisés. Cette étude a été faite jusqu’en 2018. Elle a montré que l’armoire à pharmacie des Français baissait de manière significative. Ce gisement qui était de 23 000 tonnes en 2010 était descendu à 17 000 tonnes en 2018.

On estime aujourd’hui que l’on récupère entre 65 et 70 % du gisement de médicaments non utilisés. En 2022, nous avons lancé une nouvelle étude avec une nouvelle méthodologie. En effet, la méthodologie précédente posait problème. Pour faire l’étude de gisement, nous pesions l’armoire à pharmacie du citoyen telle quelle : il y avait des boîtes pleines, des boîtes sans notice… Or, nous récupérons aujourd’hui les médicaments sans emballages… Et on a beaucoup de mal à interpréter exactement la part que peut représenter cette différence. Aujourd’hui, nous sommes convaincus que la quantité de médicaments qui reste au domicile des Français est très faible et que notre taux de récupération est en réalité plus proche de 80 %. Mais ce n’est pas encore démontré.

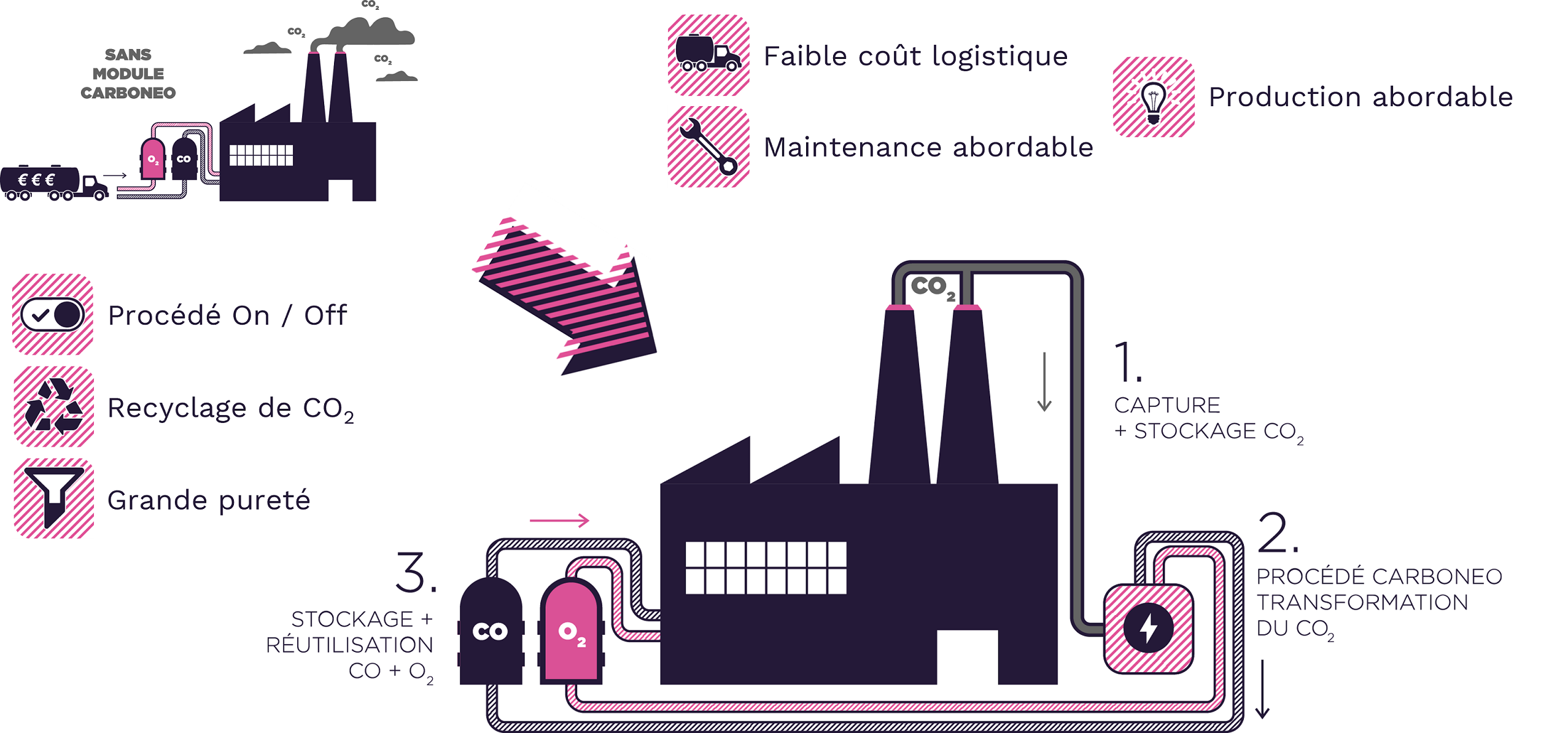

La problématique consiste à développer des solutions industrialisables, compétitives, qui permettent aux entreprises de réduire massivement leurs émissions de CO2.

Si le captage du CO2 directement à la sortie des usines ne constitue pas une obligation, il n’est que la première étape d’un processus de stockage, puis de valorisation. Là aussi, les solutions sont multiples. Les biais de valorisation du CO2 sont d’ailleurs une source d’innovation importante. De multiples technologies sont développées :

La liste est longue, mais le nerf de la guerre consiste à développer autour de ces technologies émergentes des processus circulaires, qui vont permettre de capturer, stocker et valoriser le CO2 de manière compétitive et écologique. En gardant à l’esprit que le carbone séquestré doit le rester : en effet, la fabrication de produits d’usage quotidien à base de CO2 (textiles, savons, nourriture) aboutit parfois, en fin de vie du produit, à un relargage de carbone atmosphérique. Cela dit, les solutions de stockage long terme du carbone atmosphérique sont de plus en plus nombreuses et maîtrisées.

Tant mieux, car les objectifs fixés par l’agence internationale de l’énergie sont ambitieux : dans le scénario de neutralité carbone, ce sont près de 8 Gt de CO2 qui devront être captés dans l’atmosphère annuellement et à partir de 2050. La feuille de route prévoit d’en capter 1,6 Gt en 2030, puis 4 Gt en 2035. En bref, au niveau global, il faudra augmenter le captage du CO2 d’un facteur 100, le tout en une quinzaine d’années. Le défi est de taille.

Mais les entreprises, et notamment les très grandes entreprises, celles qui possèdent des usines à travers le monde, s’intéressent de très près au captage du CO2 qu’elles produisent. Pour nombre d’entre elles, ces solutions technologiques constituent la seule possibilité de réduire efficacement leurs émissions. C’est par exemple le cas des industries de la sidérurgie, du raffinage, de la chimie et de la pétrochimie.

Les processus de captage du CO2 voient leur coût diminuer rapidement. Ils peuvent intervenir à différentes étapes des processus industriels. Ainsi, les combustibles utilisés par certaines industries peuvent être décarbonés avant d’être brûlés : ils permettent ainsi de capter du CO2 et de l’hydrogène additionnel, qui peut quant à lui être valorisé séparément.

Une autre méthode consiste à réaliser la combustion des composés combustibles carbonés en présence d’oxygène pur, ce qui permet d’obtenir des fumées extrêmement concentrées en CO2 et d’en faciliter le captage.

Ces méthodes sont encore en phase de développement, et certains verrous subsistent, comme le prix de production de l’oxygène pur par exemple.

Pour conclure, il convient de mentionner une problématique soulevée par de nombreuses associations vis-à vis des solutions de captage, stockage et valorisation du CO2 : ces technologies permettent aux industriels de ne pas réduire leurs émissions de CO2, mais plutôt d’en recycler une partie. Certains y voient un contournement du défi écologique posé à l’industrie, puisque les processus de recyclage du CO2 consomment également de l’énergie… d’où la nécessité absolue de développer des processus de recyclage du CO2 circulaires.

Par Pierre Thouverez

EVOLIS est une organisation professionnelle affiliée à la Fédération des Industries Mécaniques (FIM) issue de la fusion entre le CISMA, PROFLUID et le SYMOP. Elle représente les industriels constructeurs de matériels pour la manutention, le BTP, le traitement des fluides, ainsi que les fabricants de machines de production et de robots industriels.

Comme espéré, la sortie de la crise sanitaire a laissé place à une forte reprise de l’activité. Malheureusement, l’offre mondiale n’a pas pu suivre la cadence, face à l’explosion de la demande, notamment celle provenant des États-Unis et de la Chine.

Pour ne rien arranger, d’autres facteurs sont venus aggraver la situation : les difficultés d’approvisionnement perdurent et les marchés des matières premières et de l’énergie sont en forte tension.

Dans son communiqué de presse du 6 octobre, EVOLIS constate par ailleurs qu’en France « la croissance se heurte à l’impact cumulé des chocs de prix, de la remontée de l’inflation, de l’incertitude occasionnée par le conflit en Ukraine et de contraintes aiguës d’approvisionnement ».

Le baromètre EVOLIS annonce une conjoncture assez favorable, pour l’ensemble des secteurs fournissant des biens d’équipements, avec un marché qui devrait demeurer dynamique, malgré les contraintes sur la production, notamment dans le secteur du BTP.

La production des industries mécaniques française semble tenir bon, car elle est soutenue par des carnets de commandes garnis. Elle devrait ainsi poursuivre son redressement avec des prévisions de croissance autour de +1,9 % pour 2022 (+7,3 % en 2021 et -11,7 % en 2020, en pleine période Covid-19).

Selon les prévisions d’EVOLIS, le chiffre d’affaires global des entreprises[1] de matériels pour la construction devrait ainsi augmenter de 8,7 % en 2022. Pour les matériels de manutention, le chiffre est sensiblement identique, avec +8,5 % d’augmentation prévue.

Concernant le secteur du traitement des fluides, l’activité est dynamique et les effectifs sont en augmentation pour 2022, de même que les prévisions de chiffre d’affaires : +5,9 %.

Enfin, EVOLIS fait un constat similaire pour le secteur des machines de production industrielle (machines pour le métal, solutions d’automatisation et process industriels) puisque les prévisions d’évolution atteignent également +5,9 %.

[1] Les prévisions de croissance du chiffre d’affaires (en valeur) 2022 concernent les industriels membres d’EVOLIS

Le plan de sobriété du gouvernement mise sur des mesures d’urgence pour « passer l’hiver ». Mais la valorisation énergétique des déchets est l’un des grands oubliés de ce plan. La Fédération Nationale des Activités de la Dépollution et de l’Environnement (FNADE) compte donc profiter de la crise énergétique pour développer la valorisation de nos déchets. Elle rappelle que ces « ressources locales » contribuent à l’ « autonomie » et l’ « indépendance stratégique » de la France. La fédération regrette en ce sens que le projet de loi Accélération de la production d’énergies renouvelables « n’intègre pas la chaleur produite par la valorisation énergétique des déchets non recyclables ». Alors que le Sénat doit commencer à étudier ce texte fin octobre, la fédération espère bien faire passer des amendements.

Aujourd’hui, la valorisation énergétique des déchets génère environ 4% de la chaleur produite en France. Le gaz issu des incinérateurs de déchets fournit 45 % de l’énergie alimentant les réseaux de chaleur urbains, soit 15 térawattheures (TWh). « À horizon 2028, ce sont plus de 30 TWh d’énergie thermique et de gaz qui pourront être produits à partir de déchets non recyclables, soit plus du double de ce qui est produit aujourd’hui », calcule la Fnade.

Dans le détail, alors que la France fait le pari des réseaux de chaleur pour diminuer sa dépendance au gaz russe, la Fnade estime que la valorisation énergétique des déchets pourrait passer à 25 TWh grâce à des soutiens publics adaptés. Les professionnels misent notamment sur le développement des Combustibles Solides de Récupération (CSR), une filière que les industriels espèrent développer en France depuis plusieurs années. Il s’agit de valoriser sous forme d’énergie les refus de tri et les fractions non recyclables des déchets. Grâce à un pouvoir calorifique important, les CSR se substituent aux énergies fossiles et peuvent être utilisés dans les fours des industriels ou dans les réseaux de chaleur.

Il serait aussi question de développer le biogaz provenant des unités de méthanisation des biodéchets, avec l’obligation de tri à la source des biodéchets. La Fnade estime le potentiel à 3 TWh d’ici 2030. En plus, elle propose de développer la valorisation du biogaz issu des centres de stockage des déchets sous forme de chaleur. La Fnade identifie là encore un potentiel de 3 TWh d’ici 2030.

La Fnade compte aussi développer les engrais issus de la valorisation organique des déchets. Elle avance des arguments de retour au sol des nutriments et de séquestration du carbone dans les sols. « Entre 70 000 à 95 000 tonnes d’azote supplémentaires pourraient être produites localement en France par an dès 2022/2023, calcule la Fnade. Environ 5 000 exploitations agricoles, soit 350 000 hectares de sols agricoles français, pourraient bénéficier rapidement de ces amendements dont la valeur agronomique est reconnue. »

Plus globalement, la Fnade insiste sur l’intérêt du recyclage dans son ensemble pour « l’acier, l’aluminium, les plastiques, les papiers et cartons de qualité ». Alors que l’incorporation de matières recyclées dans les produits finis reste assez faible, la fédération estime que la production locale d’acier recyclé pourrait couvrir 85 % des volumes nécessaires à la fabrication d’acier d’ici 2050.

L’exploration sous-marine à grande échelle est une mission complexe. Mais une contrainte importante vient d’être surmontée par des chercheurs du MIT. Actuellement, les caméras sous-marines sont alimentées via un câble sur un bateau. Une équipe du département d’ingénierie électrique et d’informatique du MIT Media Lab annonce avoir développé une caméra alimentée par le son.

Elle convertit l’énergie mécanique des ondes sonores se déplaçant dans l’eau en énergie électrique. Après avoir capturé et encodé les données d’image, la caméra utilise également les ondes sonores pour transmettre les données à un récepteur qui peut reconstruire l’image.

Comme elle n’a pas besoin de source d’énergie, cette caméra peut fonctionner pendant des semaines avant d’être récupérée. Cela permettrait aux scientifiques de rechercher de nouvelles espèces dans des régions reculées de l’océan.

Elle pourrait également être utilisée pour capturer des images de la pollution des océans (l’équipe a fait des tests dans un étang du New Hampshire et a repéré des bouteilles en plastique) ou pour surveiller la santé et la croissance des poissons élevés dans des fermes aquacoles.

L’élément clé de cette caméra est un dispositif capable de récolter l’énergie sous l’eau de manière autonome tout en consommant très peu d’énergie. Des transducteurs fabriqués à partir de matériaux piézoélectriques sont placés sur la partie externe de la caméra et sont utilisés pour acquérir de l’énergie.

Ces matériaux produisent un signal électrique lorsqu’une force mécanique leur est appliquée. Lorsqu’une onde sonore se déplaçant dans l’eau (passage d’un navire ou d’un poisson) frappe les transducteurs, ceux-ci vibrent et cette énergie mécanique est convertie en énergie électrique.

La caméra stocke l’énergie récoltée jusqu’à ce qu’elle soit suffisante pour alimenter l’électronique qui prend les photos et communique les données. Pour réduire au maximum la consommation d’énergie, les ingénieurs ont utilisé des capteurs d’imagerie à très faible puissance. Mais comme les captures d’images ne sont qu’en niveaux de gris, ils ont également développé un flash à faible consommation.

Lorsque l’appareil photo capture une image, il fait briller une LED rouge, puis utilise des capteurs d’image pour prendre la photo. Il répète le même processus avec des LED vertes et bleues.

Même si l’image semble en noir et blanc, la lumière rouge, verte et bleue des LED utilisées se reflète dans la partie blanche de chaque photo. Lorsque les données des images sont combinées en post-traitement, l’image en couleur peut être reconstruite à partir des trois images sources.

Après avoir relevé le défi d’un prototype fonctionnel, les ingénieurs prévoient d’améliorer le dispositif afin qu’il puisse être déployé dans des environnements réels. Car l’un des principaux défis est la largeur de bande limitée des communications acoustiques sous-marines, qui est généralement de l’ordre de quelques kilobits/s. Résultat, le temps de transfert des images sous-marines est généralement de plusieurs dizaines de minutes, voire d’heures.

« Pour permettre un fonctionnement à faible puissance tout en tenant compte des contraintes de bande passante des canaux acoustiques sous-marins, notre méthode utilise un FPGA (Field-programmable gate array) qui fonctionne en deux phases : la phase de capture d’image (qui est limitée en puissance) et la phase de communication par rétrodiffusion (qui est limitée en bande passante). Le fonctionnement de chacune de ces phases est optimisé pour minimiser la consommation d’énergie globale », explique l’équipe dans un article paru dans Nature.

Ils souhaitent également augmenter la mémoire de la caméra afin qu’il puisse prendre des photos en temps réel, diffuser des images en continu ou même réaliser des vidéos sous-marines. Autre objectif : étendre la portée de la caméra qui est pour l’instant de 40 mètres.

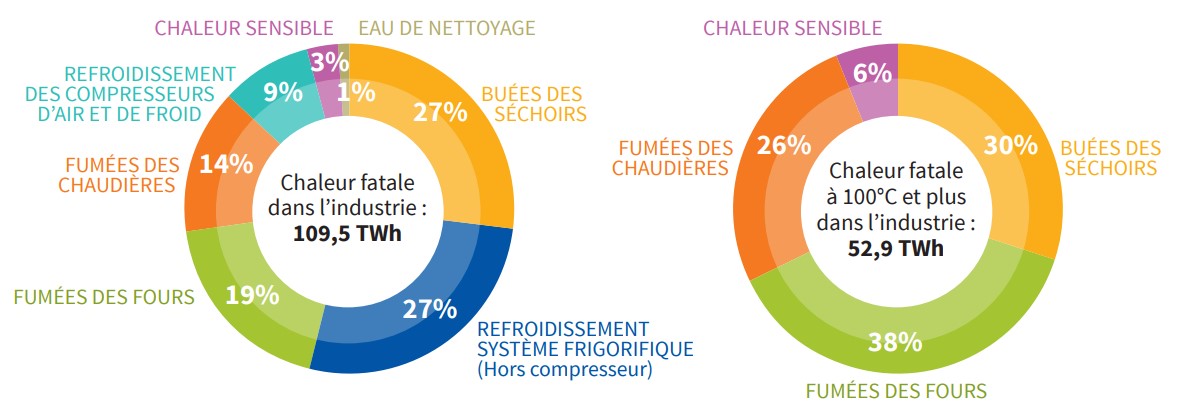

Alors que les entreprises sont confrontées à une crise historique du coût de l’électricité et du gaz, et doivent décarboner leur approvisionnement en énergie, il est une filière d’excellence qui peut apporter une solution dans l’industrie, celle de la récupération de chaleur fatale. Toutes les conditions semblent réunies pour la développer : le gisement est immense, des technologies sont déjà commercialisées et de nouvelles émergent, le soutien financier de l’État existe.

En France, le gisement de ces rejets thermiques perdus a été estimé par une étude de l’Ademe en 2017. Tous process confondus, la chaleur fatale dans l’industrie représente près de 110 TWh dont un tiers dans l’agroalimentaire, un cinquième dans les industries de la chimie et du plastique, et une part de 11-13 % pour chacune des trois filières suivantes : matériaux non métalliques (ciment, verre), métaux (dont sidérurgie) et papier carton. Un plus petit gisement de 8 TWh est contenu dans les data centers et dans les usines d’incinération des ordures ménagères.

Il est notable que plus de la moitié du gisement dans l’industrie est à des températures inférieures à 100°C. Cette source pourrait en partie être captée et réutilisée pour des usages simples (préchauffage d’un process, chauffage des locaux, eau chaude sanitaire, etc.) ou pour alimenter un réseau de chaleur urbain à proximité, en particulier si la température est supérieure à 60°C. Mais même en dessous de 60°C, l’utilisation de boucles tempérées avec rehausse de la température par des pompes à chaleur est tout à fait envisageable.

L’intérêt est néanmoins encore plus grand pour les 53 TWh du gisement présentant des températures supérieures à 100°C. À eux seuls, les intervalles de 100 à 200°C et de 200 à 300°C représentent respectivement 26,4 et 17,4 TWh. Et chez certains industriels, il n’est pas rare que les fumées des fours dépassent les 300-400°C. C’est le cas par exemple à Ugine en Savoie, où l’usine d’Ugitech (fabricant d’acier inoxydable) a mis en place une récupération de la chaleur par prélèvement dans les fumées. En étant prudent sur le niveau de pression et en vérifiant que cela n’avait pas d’impacts sur ses fours, l’industriel fournit ainsi gratuitement 4 500 à 5 000 MWh par an au réseau de chauffage urbain depuis novembre 2021. Par ce biais, la ville n’a quasiment plus besoin d’apport gaz et évite l’émission de 1 100 tonnes de CO2 par an. En retour, l’usine se connecte au réseau de chaleur pour le chauffage de ses bâtiments administratifs et économise 200 tCO2/an en n’utilisant plus ses chaudières gaz. L’investissement de 1,7 million d’euros a été porté par la ville avec le soutien d’aides publiques.

Bien d’autres pistes sont à l’œuvre ou déjà à l’essai. Dans une des usines de Cristal Union (fabrication de sucre) sur le site de Sainte-Emilie dans la Somme, le séchage des pulpes de betteraves était fait par une centrale à charbon. Un projet est en cours pour récupérer de la vapeur d’eau surchauffée sur un autre process de l’usine afin de réaliser le séchage directement. Environ 40 000 tCO2/an seront économisés, au prix néanmoins d’un investissement de 25 millions d’euros, largement subventionné dans le cadre du Plan de relance et des soutiens apportés par le Fonds Chaleur et par les Certificats d’économies d’énergie.

Selon l’Ademe, entre 2015 et 2020, les soutiens publics ont permis de construire des projets valorisant 18 TWh/an de chaleur fatale. Ce sont notamment le Fonds Chaleur (178 projets, dont 95 dans l’industrie) et le Fonds décarbonation des procédés et des utilités pour l’industrie (45 projets lauréats) qui ont fourni le plus gros de la valorisation. Le potentiel est encore immense. Il doit être notamment mobilisé pour atteindre les objectifs de la programmation pluriannuelle de l’énergie qui prévoit entre 2,5 et 3 TWh de chaleur fatale valorisée dans les réseaux de chaleur urbains. Aujourd’hui, avec 0,5 TWh, on en est encore loin…

Vu les prix élevés du gaz et de l’électricité en ce moment, les industriels ont intérêt à passer à l’acte. Afin de les inciter à accélérer, un renforcement des soutiens existants a déjà été effectué en 2022 (Fonds Chaleur, Décarbonation de l’industrie). Un nouvel appel d’offres nommé Decarb Flash vise particulièrement les entreprises de moins de 500 salariés ayant un projet entre 100 000 et 3 millions d’euros. Il y a urgence, mais les options techniques sont nombreuses, et les professionnels de l’offre et de la demande disposent désormais d’une plate-forme, « Je décarbone », où se retrouver. Il n’y a plus d’excuse pour ne pas valoriser la chaleur fatale.

Après plusieurs sportifs et personnalités comme l’ancien footballeur Éric Cantona, l’ancien champion du monde Philipp Lahm (vainqueur en 2014 avec l’équipe d’Allemagne) et l’acteur Vincent Lindon, les villes s’invitent dans le débat autour du boycott du Mondial 2022. Ce dernier se déroulera au Qatar du 20 novembre au 18 décembre.

Mardi soir, Lyon a rallongé la liste des villes qui s’engagent à bannir les fans zones et les écrans géants. Elle rejoint Paris, Marseille, Bordeaux, Nancy, Reims, Strasbourg, Lille, Toulouse, Angers, Villeurbanne, Rennes, Brest ou encore Rodez.

Ces villes font entendre le même son de cloche. Elles refusent de promouvoir cet événement pour des raisons humanitaires et environnementales et ce quel que soit le résultat de l’équipe de France. Le maire de Lyon Grégory Doucet (EELV) dénonce une « abomination sur le plan des droits humains » et une « aberration sur le plan écologique ». En particulier, il dénonce le décès de milliers de travailleurs immigrés dans la construction des huit stades du Mondial, dont sept sont climatisés.

Dans un communiqué, la ville de Nancy a pointé le « décalage » de « l’usage de stades climatisés durant cette Coupe du monde (…) avec les enjeux de transition écologique ». Elle appelle les organisateurs à « sérieusement revoir les règles d’attribution des prochaines Coupes du monde » afin « d’intégrer ces enjeux » de « sobriété » et de « respect du droit humain ».

Alors qu’Élisabeth Borne dévoilait ce jeudi 6 octobre le plan de sobriété énergétique pour l’hiver prochain, secteur par secteur, le maire de Reims Arnaud Robinet (Horizons) estimait que les écrans géants n’avaient pas leur place dans l’espace public : « De telles installations susciteraient une incompréhension légitime (…) pour l’un des événements les plus controversés de l’histoire du sport ».

Chaque semaine, les médias se font l’écho de nouvelles aberrations écologiques entourant le Mondial. Dernièrement, on apprenait que le Qatar, incapable d’accueillir le million de supporters attendus pour la Coupe du monde, prévoyait 160 vols par jour pour les rediriger vers les pays voisins.

Sur Twitter, le #BoycottQatar2022 dénonce la tenue de l’événement. La coalition Carton rouge pour le Qatar s’indigne également. « Footballeurs, membres du staff ou de la fédération : refusez d’être complices de crimes sanglants et d’un écocide total. Refusez d’être les instruments de promotion d’un système psychopathe qui place la compétition au-dessus de toute considération morale et humaniste : boycottez la Coupe du Monde au Qatar ! », peut-on lire dans leur communiqué.

Par ailleurs, une pétition lancée début septembre par des élus et d’anciens élus du Gard, de personnalités du département récolte déjà près de 29 000 signatures. Elle dénonce, entre autres, « près de 6 800 morts sur les chantiers et des ouvriers survivants réduits à l’esclavage », « la corruption à tous les étages », « les stades climatisés dans le désert ».

Alors que le mouvement de boycott s’intensifie contre le Mondial 2022, le Conseil olympique d’Asie (OCA) a attribué les Jeux asiatiques d’hiver 2029 à l’Arabie saoudite le mardi 4 octobre. Pour l’occasion, une toute nouvelle mégalopole verra le jour à Neom, en plein désert. L’organisation annonce pourtant 28 épreuves sur neige et 19 sur glace…

Le plan de sobriété énergétique du gouvernement demande aux entreprises de se mobiliser. En cas de tension sur le réseau électrique, les industriels seront les premiers à prendre part à l’effort collectif. Mais pour l’instant, aucune aide financière n’est prévue en retour et le bouclier tarifaire ne les protège pas de la hausse des prix de l’énergie.

L’association Origine France Garantie, qui certifie l’origine française des produits et services, a publié fin septembre une tribune soulignant le fait que « la crise énergétique plonge l’industrie française dans l’instabilité ». Gilles Attaf, président d’Origine France Garantie et des Forces Françaises de l’Innovation (FFI), nous explique la situation de ses adhérents.

Gilles Attaf : La situation est assez catastrophique. Sur un an, nos adhérents nous font remonter une hausse en moyenne de 65,5 % de leur facture énergétique sur les contrats en cours. Beaucoup d’entre eux ont signé des contrats sur le long terme. Pour ceux qui arrivent bientôt à terme, certaines hausses vont jusqu’à 200 %. Avec de telles hausses, les industriels ne pourront pas continuer leur activité. Certains opérateurs incitent même leurs clients à changer de fournisseur.

Certains de nos adhérents sont aujourd’hui obligés de produire moins. C’est par exemple le cas de la marque de jeans 1083 qui a une usine de tissage dans les Vosges. Elle est obligée d’arrêter sa production deux fois par semaine pour ne pas voir sa facture énergétique exploser. L’entreprise nous a indiqué que sa facture énergétique pourrait passer de 400 000 à 2 millions d’euros sans mesure d’urgence.

Il y avait une vraie dynamique de réindustrialisation dans le cadre du plan France Relance et du plan France 2030. En 2021, on a recensé une ouverture nette de 120 usines et 30 000 emplois créés sur le territoire. Sans soutien, la situation actuelle risque de mettre une fin abrupte à cette dynamique.

Ce jeudi 6 octobre, devant des centaines d’entrepreneurs et dirigeants d’entreprises réunis par BPI France, Emmanuel Macron a demandé d’attendre le mois de novembre pour signer les nouveaux contrats avec les opérateurs, car des négociations sont en cours. On attend donc d’avoir cette vision. L’intervention d’Emmanuel Macron a rassuré les industriels. Le but est de passer ce cap, de soutenir nos industries à court terme pour éviter de réduire leur activité.

Les soucis de compétitivité sur nos entreprises étaient déjà réels. On avait toutefois un atout concurrentiel : si les coûts de production sont plus élevés que dans les autres pays, le prix de l’énergie était relativement bas en France. On a perdu cet atout.