Par Hubert Blatz

Le 11 mars 2011, le Japon connaissait un enchaînement de catastrophes : un séisme, un tsunami puis l’accident nucléaire de la centrale de Fukushima Daiichi. Il s’agit de la deuxième catastrophe de centrale nucléaire de l’histoire, classée au niveau 7, le plus élevé sur l’échelle internationale des événements nucléaires (INES), au même degré de gravité que la catastrophe de Tchernobyl (1986).

Patrice François est en charge du suivi et de la réalisation de projets internationaux de démantèlement d’installations nucléaires et de gestion des déchets à l’Institut de radioprotection et de sûreté nucléaire (IRSN). Il est également chargé de la veille technique à Fukushima. Il revient sur l’accident, les mesures mises en place en urgence juste après la catastrophe et l’avancée du démantèlement aujourd’hui.

Patrice François : Le 11 mars 2011, un séisme de magnitude 9 est survenu à environ 80 km à l’est de l’île de Honshū au Japon, et a été suivi d’un tsunami. Ces catastrophes naturelles ont touché le site de la centrale de Fukushima Daiichi et ont provoqué la perte totale des alimentations électriques et donc du refroidissement des réacteurs. Cela a entraîné la fusion des cœurs des réacteurs nucléaires 1, 2 et 3 avec perte d’intégrité des cuves, sachant qu’on dénombre au total 6 réacteurs sur le site. Il y a également eu des explosions d’hydrogène dans les bâtiments réacteurs 1, 3 et 4.

Les équipes de TEPCO [Tokyo Electric Power Company, producteur d’électricité en charge du démantèlement de la centrale de Fukushima, NDLR] ont d’abord tenté de remettre en marche les fonctions électriques, ce qui s’est avéré impossible car les diesels étaient immergés dans les réacteurs 1 à 4. L’urgence était de préserver le refroidissement des piscines et des cœurs grâce à différents systèmes. En effet, la fusion des cœurs n’a pas eu lieu immédiatement, elle s’est faite progressivement. Les équipes ont fini par injecter de l’eau de mer acheminée par des camions de pompiers en utilisant les systèmes d’arrivée d’eau de conception des réacteurs. Cette méthode – provisoire – a permis de stabiliser les réacteurs dans les semaines qui ont suivi la catastrophe.

Lors de la catastrophe nucléaire de Tchernobyl, il y avait eu une explosion dans le cœur avec projection de débris de combustible à l’extérieur du réacteur. A Fukushima, la situation était différente car les cœurs ont fondu, traversé les cuves et se sont répandus dans les enceintes de confinement. Pour assainir la zone, les travailleurs ont dû rendre accessibles les piscines, donc déblayer les débris sur place, remettre en place les structures d’accès et même construire des structures externes aux bâtiments et renforcer la structure génie civil de la piscine pour le réacteur 4.

Ces travaux-là se sont faits dans des conditions radiologiques significatives car il y avait un rayonnement important au niveau des cœurs fondus. Cela a nécessité de travailler avec des équipes dont le temps de présence sur le site était calibré en fonction des contraintes d’exposition acceptées. Pour les travailleurs, l’exposition légale est de 20 millisievert par an, contrairement au public pour qui elle est de 1 millisievert par an. Mais pendant les premières semaines, le gouvernement japonais a dû autoriser l’intervention des travailleurs à des hauteurs de dose jusqu’à 250 millisievert de manière transitoire, pour des interventions bien particulières afin de stabiliser la situation.

La première étape fixée par TEPCO était de remettre en état les installations pour récupérer les éléments combustibles entreposés en piscine qui n’avaient pas fait l’objet d’une fusion. Il fallait donc construire des systèmes de confinement au-dessus des piscines existantes, et remettre en place les moyens de chargement et déchargement des combustibles qui avaient été endommagés lors de l’explosion. Cette première étape s’est terminée en 2013 pour le réacteur 4 et en 2018 pour le réacteur 3. En revanche, elle est toujours en cours pour les réacteurs 1 et 2 dont la fin est prévue respectivement pour 2025 et 2024. Ce sont des travaux importants et les conditions d’intervention sont complexes à cause de la contamination.

Une fois les installations remises en place, les équipes ont récupéré les éléments combustibles. Cette étape est terminée pour le réacteur 4 depuis 2014 et doit s’achever en mars ou avril 2021 pour le réacteur 3. Une fois les éléments combustibles récupérés, il n’y a plus besoin de maintenir des fonctions de refroidissement des piscines. Concernant les réacteurs 1 et 2, les opérations de reprise n’ont pas encore débuté mais l’objectif de TEPCO est d’avoir repris l’ensemble des éléments combustibles des piscines des réacteurs 1, 2, 5 et 6 pour 2031.

Aujourd’hui, TEPCO injecte dans chaque réacteur 3 mètres cubes d’eau douce par heure, grâce à un circuit en boucle fermée. L’eau utilisée se mélange avec les infiltrations de la nappe phréatique et avec l’eau de mer encore présente dans les bâtiments et est récupérée, puis décontaminée, désalinisée, et réinjectée dans les cœurs des réacteurs. Mais le bilan de cette boucle est excédentaire. TEPCO doit traiter 150 mètres cubes d’eau par jour qui ne sont pas réinjectés. Une fois décontaminée, l’eau est ensuite entreposée dans des cuves car l’exploitant n’a pas le droit de la rejeter.

Il y a plusieurs installations. La première permet de décontaminer l’eau de deux radioéléments : le strontium et le césium. Puis l’eau passe dans une installation de désalinisation. A partir de ce moment-là, il y a deux voies possibles : soit la réinjection dans les cœurs, soit le transfert vers une autre installation qui s’appelle l’ALPS et qui permet de traiter les radioéléments résiduels, au nombre de 62. Une fois que l’eau est décontaminée, elle est entreposée dans des cuves situées sur le site de la centrale.

Le problème ne vient pas d’un impact radiologique car l’eau ne sera rejetée qu’après avoir été complètement décontaminée. Il restera seulement du tritium. Le rejet de l’eau est techniquement réalisable en respectant les autorisations de rejets en mer de la centrale de Fukushima établies avant l’accident. Il s’agit plutôt d’un problème politique. Les locaux, les marins-pêcheurs et les pays limitrophes s’opposent au rejet en mer. La région a beaucoup souffert de l’impact de la catastrophe et conserve désormais une forme de méfiance. Mais il s’agit d’un problème de perception et de méconnaissance des risques réels. Cela étant, il y a aujourd’hui sur le site environ 1 200 000 mètres cubes d’eau entreposée, et les capacités d’entreposage sont limitées à 1 370 000 mètres cubes. Au rythme actuel, les installations devraient être saturées autour de l’été 2022, d’où l’urgence de trouver une solution.

Plusieurs scénarios sont étudiés et deux solutions font l’objet d’un consensus international : soit l’évaporation de ces eaux grâce une installation, soit le rejet en mer qui reste une solution de référence pour l’exploitant. C’est maintenant au gouvernement japonais de se positionner.

TEPCO a élaboré une feuille de route en 3 jalons :

Pour l’instant, TEPCO semble respecter le planning global prévisionnel car en 2021, des essais de reprise du corium dans le réacteur 2 sont prévus. En 2018, un robot avait déjà pu être introduit et a permis de vérifier que des fragments de corium pouvaient être déplacés. Néanmoins de nombreuses incertitudes demeurent sur l’état physique et mécanique du corium. Un nouveau robot, un bras téléopéré, est en cours de conception en Angleterre et devrait être livré prochainement même si du retard a été pris, notamment à cause de la pandémie de Covid-19.

Une des principales problématiques est l’accessibilité. Il doit réussir à se frayer un chemin jusqu’aux structures endommagées pour récupérer le corium avec des moyens de visions permettant d’identifier les objets présents. L’enjeu réside dans la conception des robots et des moyens de vision qui doivent résister aux conditions ambiantes. Les conditions sont différentes d’un réacteur à un autre. Dans le réacteur 3, il y a environ 6 mètres d’eau dans l’enceinte de confinement, et dans le réacteur 2, il y a très peu d’eau. Le niveau d’irradiation y est donc très important, or l’électronique résiste mal à ces rayonnements. Enfin, on doit pouvoir récupérer le robot pour réaliser des opérations de maintenance ou de réparation, et donc pouvoir le décontaminer sans difficulté.

Il sera conditionné en colis spéciaux type canister, qui devront être conçus pour le stockage de déchets radioactifs de haute activité et qui seront préalablement entreposés. Ces colis spéciaux devront assurer des fonctions de confinement (hydrogène, corrosion) et permettre d’assurer la maîtrise de la sûreté criticité qui devrait être acquise par la géométrie des colis. Cela nécessite de réaliser des études de faisabilité pour vérifier si les colis sont compatibles avec la matière que l’on conditionne dedans. L’IRID mène actuellement des études afin de déterminer les spécifications techniques que les colis devront respecter.

Les différents scénarios de démantèlement et les différentes solutions de conditionnement et d’entreposage des déchets sont étudiés par l’IRID [International Reasearch Institute for nuclear decommisioning, NDLR], qui a été créé au Japon. Cet organisme travaille sur un certain nombre de scénarios, qui prévoient un accès soit par le haut comme cela a été fait pour reprendre les éléments combustibles en piscine, soit par le côté des réacteurs ; les deux solutions seront probablement nécessaires. Mais d’importantes incertitudes demeurent sur l’état réel du corium et TEPCO s’attend à être confronté à différents cas de figures tels que des éléments massifs de structures du cœur fondu, des débris de différentes tailles, des poussières et des boues situées en divers endroits de l’enceinte de confinement et de la cuve. La diversité de ces situations influencera directement le planning des opérations de reprise. Certaines opérations pourront être réalisées en l’air et d’autres le seront probablement sous eau.

L’enjeu du démantèlement est de conserver en place des barrières de confinement afin d’éviter la dispersion de matières radioactives dans l’environnement. Aujourd’hui, le corium est à l’intérieur du bâtiment réacteur, dans l’enceinte de confinement. Pour y accéder, la fonction de confinement peut être reportée sur les nouvelles structures qui seront mises en place et non plus uniquement sur l’enceinte de confinement et sur la cuve. Ces nouvelles structures doivent être dimensionnées en fonction des risques liés à la reprise du corium, à savoir la dispersion de matières radioactives, les risques d’incendie, les risques de criticité, ou encore les risques de chute de charge. Il faut aussi déterminer les sollicitations pour lesquelles ces structures doivent être dimensionnées : séisme, incendie, etc. Cela nécessite des études de conception afin de maîtriser le risque potentiel de contamination de l’environnement.

Le Japon a été contraint de remettre à niveau ses installations, notamment à cause du risque de tsunami qui avait été clairement sous-estimé pour Fukushima. Les exploitants travaillent également sur des scénarios de perte totale de fonctions d’alimentation électrique des sites qui avait été jugée peu probable dans le passé. Toute une réflexion de fond a été menée à l’échelle internationale, au niveau des pays qui ont des réacteurs de puissance afin de mettre en œuvre des parades plus poussées en cas d’accidents graves. Au Japon, ça se traduit par la mise en place de systèmes de protection redondants et le cas échéant, par la construction de murs anti-tsunami plus compatibles avec ce qui a été observé à Fukushima. Dans le monde entier, des remises à niveau sont réalisées à la lueur des enseignements tirés de cette catastrophe.

Photo de Une : Fumée sortant du bâtiment réacteur 3, le 21/03/2011 / TEPCO

Lors d’une audition devant la commission économique du Sénat le 10 février dernier, Jean-Bernard Lévy, le PDG d’EDF, a dévoilé une nouvelle donne pour ce projet qui visait au départ à séparer EDF en plusieurs entités sous la coupe d’une holding. Rappelant au préalable qu’EDF n’était pas en direct sur les négociations avec Bruxelles, puisque c’est l’Etat qui discute, Jean-Bernard Lévy a néanmoins dévoilé que le projet repose sur une réorganisation du groupe en deux entités « complémentaires et jamais concurrentes », avec des actifs homogènes et des objectifs stratégiques clairs.

Une première entité, dénommée « EDF Bleu », regrouperait la production nucléaire et thermique. La production hydraulique, qui au départ aurait pu se retrouver dans cette première partie (d’où le « bleu »), serait désormais quant à elle transférée à une « quasi-régie », filiale à 100 % d’EDF Bleu. La seconde entité, dite « EDF Vert », regrouperait la distribution (Enedis), les services, les activités commerciales, la construction et l’exploitation des ENR (d’où son nom de « Vert ») et les activités à l’international. Elle inclura donc Enedis, qui sera une filiale à 100 % d’EDF Vert.

EDF vert serait « détenu très majoritairement par EDF Bleu et par l’Etat et quelques actionnaires minoritaires », le PDG laissant entendre une potentielle ouverture de capital à hauteur d’un quart…

C’est un modèle qui, a insisté le PDG, est retenu par les pays du Sud, comme Iberdrola, en Espagne, et Enel, en Italie.

Car, a insisté Jean-Bernard Lévy, le point de départ de l’action réside dans la nécessité de mettre fin à l’Arenh (Accès régulé à l’énergie nucléaire historique). L’Arenh contraint le groupe à vendre à ses concurrents un quart de sa production nucléaire « à un prix fixé, il y a dix ans, et jamais révisé depuis, sans même tenir compte de l’inflation », soit 42 euros/MWh, a insisté le PDG d’EDF. « C’est un poison qui a largement contribué à faire d’EDF un acteur endetté », poursuit-il, qui rappelle que l’Arenh est fondé « sur une injustice évidente, qui revient à subventionner nos concurrents ». Mais c’est cet Arenh qui est au cœur du débat avec Bruxelles, puisque c’est la Commission européenne qui avait imposé à EDF d’ouvrir le marché de la production que l’entreprise publique dominait largement alors.

Cette réforme permettra ainsi à EDF d’avoir les moyens de se développer plus rapidement, a martelé Jean-Bernard Lévy, la nouvelle régulation nucléaire devant, soit via un corridor de prix, soit via un prix fixe (option qui tient la corde aujourd’hui) – le même pour tous les fournisseurs (EDF y compris) –, « couvrir les coûts et les investissements (passés et futurs) sur le parc existant ».

Et de brandir la menace d’un « déclassement par rapport aux autres grands groupes européens », faisant d’EDF un colosse aux pieds d’argile. « Ils peuvent annoncer des objectifs très supérieurs à ce que peut faire EDF dans sa configuration actuelle », a appuyé le PDG d’EDF. Enfin, Hercule doit permettre de « sécuriser nos concessions hydroélectriques » ajoute Jean-Bernard Lévy, qui souligne un « risque de désoptimisation du productible », voire aller jusqu’à « un appauvrissement des vallées concernées » si les concessions hydrauliques sont mises sur le marché.

Dans ce cadre, et même si EDF ne participe pas directement aux discussions bruxelloises, les négociations avec Bruxelles se font avec plusieurs « lignes rouges » définies par EDF et l’Etat. D’abord, EDF reste un « groupe public intégré (…) qui englobe tous les maillons de la chaîne de l’électricité, toutes les filières de production et tous les services » et répondant à « une seule stratégie ». Bruno Lemaire, le ministre de l’Economie, a d’ailleurs déclaré devant le Parlement que « ce n’était pas négociable ». Et Barbara Pompili l’avait également affirmé à l’Assemblée nationale.

Les entités « coopèrent entre elles » et « les salariés peuvent circuler de l’un à l’autre ». Le statut des IEG (industries électriques et gazières) ne sera pas remis en cause, insisté le PDG d’EDF. Une adresse quasiment directe pour répondre aux syndicats de la maison, qui sont vent debout contre cette réforme.

Pour le PDG d’EDF, « cette réforme est une vraie opportunité de développement au service de la neutralité carbone et de la transition énergétique ». Et d’ajouter que, alors qu’aujourd’hui, EDF vise 50 GW de renouvelables en 2030 – un chiffre porté à 60 GW, lors de l’annonce des résultats du groupe –, dans 10 ans, « avec la réforme, nous pouvons viser 100 GW, et avoir un rôle deux fois plus important ».

Pas certain cependant, malgré toutes ces précisions, que les oppositions faiblissent. Les syndicats, en interfédérale (FNME-CGT, FO, CFE-CGC, CFDT) sont toujours en mouvement, et ont organisé plusieurs journée de grève, depuis janvier, pour réclamer l’abandon du projet… Avec une mobilisation plutôt forte.

Plus inhabituel, la FNCCR, la Fédération des collectivités locales et concédantes (qui, rappelons-le, détiennent les lignes de distribution) s’est fendue d’un communiqué indiquant que « les services publics de distribution d’électricité et leurs usagers ne doivent pas être les otages de la stratégie financière d’EDF ». Et la FNCCR de poursuivre : « l’ouverture d’EDF vert à un actionnariat privé massif pourrait casser la dynamique d’investissement d’Enedis, affecter la qualité des services publics de distribution qui lui sont confiés par les collectivités locales concédantes, et conduire à un renchérissement du prix de l’électricité pour financer les versements de dividendes aux nouveaux actionnaires privés, pénalisant les consommateurs, déjà massivement confrontés à de graves difficultés ». En tout état de cause, la FNCCR déplore « l’absence totale d’information des territoires, et a fortiori de concertation avec eux, en premier lieu avec les autorités organisatrices de la distribution d’électricité, pourtant propriétaires des réseaux ». Enfin, la fédération représentant les collectivités réclame que les territoires soient associés à ce projet… Reste que, pour l’heure, les couloirs de Bruxelles sont très silencieux sur le sujet… Et ce n’est pas qu’à cause de la crise sanitaire !

La pandémie impacte de nombreux secteurs. Celui de la formation n’y échappe pas. Depuis quelques années, ce secteur a dû s’adapter pour répondre aux besoins des entreprises et des salariés (mais aussi de façon générale à tous ceux qui veulent améliorer leurs connaissances).

Principal constat, les formations en présentiel de 7 heures (durée imposée par les OPCO − Opérateurs de compétences – pour leur financement) ne répondent plus aux besoins des entreprises.

Pour deux raisons principales : organisées généralement dans les locaux des entreprises par des prestataires, ces formations apparaissent de plus en plus comme contraignantes à cause de l’obligation de bloquer une journée pour chaque salarié suivant une session. Et avec la pandémie, ces formations en « intra » permettent difficilement de répondre aux contraintes sanitaires.

C’est la raison pour laquelle le e-learning devrait fortement progresser dans l’économie post-pandémique selon un rapport de Grant Thornton. Selon ce cabinet mondial, la crise sanitaire « mettra inévitablement en cause la prestation de formations en présentiel, entraînant la migration vers des formats numériques ou mixtes. »

Fin 2019, une étude réalisée par l’Afpa et France Université Numérique auprès de 400 financeurs, prescripteurs, organismes de formation, universités, OPCO, indiquait que le digital learning favorise l’engagement (71 %) et dans une moindre mesure la performance des apprenants (61 %).

Avec l’intelligence artificielle (IA), les entreprises ont l’opportunité d’améliorer l’engagement et la performance en proposant des solutions d’apprentissage en ligne plus efficaces, car adaptées aux spécificités de chacun. Le type d’apprentissage d’une personne peut être influencé par l’âge, l’origine ethnique, le contexte culturel et d’autres facteurs qui doivent être pris en compte dans le processus de développement.

Or, l’IA peut en effet considérablement raccourcir le processus d’apprentissage en ne suggérant que des modules spécifiques dont l’employé a besoin pour améliorer les compétences nécessaires à son travail. En ayant repéré les forces, les faiblesses et les préférences d’apprentissage de l’utilisateur, un algorithme d’apprentissage automatique (ou machine learning) peut suggérer des cours et des modules de formation adaptés : tutoriels vidéo, contenu écrit, jeux, présentations audio…

Une formation proposée à différents salariés ne sera donc plus globale. Plusieurs modules d’apprentissage en ligne seront supprimés pour les personnes les plus avancées tandis que d’autres bénéficieront d’une approche plus complète et linéaire.

Les tests, les quiz et les évaluations deviennent une partie importante de l’apprentissage en ligne et de toute formation en général. Ils permettent de consolider l’apprentissage et de mesurer l’efficacité du cours. Mais ils présentent une limite en adoptant une approche unique. Résultat, certains apprenants peuvent trouver ces tests trop faciles et d’autres trop difficiles. Avec l’IA, il est possible de concevoir des évaluations adaptées qui vont au-delà du format statique de questions-réponses.

Mais comme toujours avec l’IA, il est essentiel de disposer de données pertinentes et donc personnelles. « Or, affiner la donnée pose un problème éthique. Des informations ne risquent-elles pas d’être divulguées dans l’entreprise où travaille la personne ? Le RGPD exige d’ailleurs le consentement des personnes quant au partage de certaines données », rappelle François Debois, responsable innovation au sein du groupe Cegos.

Dix ans après la catastrophe de Fukushima, la France poursuit son plan d’action afin de renforcer la sûreté de ses sites nucléaires en cas d’agression extérieure : séisme, tempête, canicule… Dès l’accident, des mesures à court terme ont été mises en place par EDF pour améliorer la capacité des réacteurs à faire face à une perte d’alimentation électrique ou de la source d’eau froide. Parmi celles-ci : l’augmentation de l’autonomie des batteries ou la mise en place d’un groupe électrogène supplémentaire permettant d’assurer des fonctions essentielles comme la mesure du niveau d’eau des piscines. En parallèle, une Force d’action rapide du nucléaire (FARN) est créée par EDF regroupant une équipe de 300 personnes capables d’intervenir en moins de 24 heures sur un site avec des moyens électriques et des pompes d’alimentation en eaux supplémentaires. « Cette première phase dite réactive s’est achevée à la fin de l’année 2015, date à partir de laquelle la FARN peut faire face à une situation extrême, où tous les réacteurs d’un site sont endommagés, explique Olivier Dubois, directeur adjoint de l’expertise de sûreté à l’IRSN. Le site de Gravelines est celui qui en comporte le plus, avec six réacteurs. »

Le plan d’action se poursuit actuellement avec la phase de mesures pérennes. Objectif : éviter la fusion du cœur du réacteur ou en limiter ses conséquences sur l’environnement si elle se produit. Pour cela, des dispositifs de sûreté ultime constituant le « noyau dur » sont installés afin d’assurer les fonctions de sûreté vitales lors d’une agression hors norme. Trois dispositifs sont principalement déployés. Le premier consiste à installer des diesels de secours, placés dans de grands bâtiments, dont la fonction est de réalimenter en électricité l’ensemble des systèmes du noyau dur avec une autonomie de 72 heures. « Les 56 réacteurs du parc français sont, à ce jour, équipés ; la dernière installation s’étant déroulée à Paluel en janvier 2021 », ajoute Olivier Dubois.

Deuxième dispositif : l’installation de sources d’eau ultimes pour refroidir les réacteurs grâce au pompage dans des nappes phréatiques ou des bassins. Là encore, la mesure s’applique à chaque réacteur. L’ASN a demandé à EDF de les installer toutes d’ici à la fin de cette année. 58 réacteurs sont concernés, car il faut ajouter les deux de Fessenheim. En effet, bien qu’arrêtées, les piscines d’entreposage de combustible de ce site ne sont pas vides et les sources d’eau ultimes ont également pour fonction de les approvisionner en cas de problème. « À ce jour, seulement sept ont été mises en place, précise Olivier Dubois. EDF s’est engagée à le faire pour l’ensemble du parc nucléaire dans les délais, mais sera probablement obligée d’utiliser des sources provisoires sur certains réacteurs comme l’utilisation de réservoirs déjà existants ou l’installation de bâches souples. Cette source doit être capable de fournir un débit d’au moins 30 m³/h environ pendant 72 heures, le temps que la FARN prenne le relais. »

Enfin, la dernière mesure pérenne concerne la construction de centres locaux de crises résistant à des agressions extrêmes, en remplacement des locaux actuels. Leur rôle est d’accueillir le matériel et une centaine de personnes mobilisées en cas d’accident et où les équipes disposent notamment des informations sur l’état du réacteur. Chaque site doit disposer d’un centre local de crise, soit un total de 18. Actuellement, seul Flamanville est équipé. Pour les autres sites, la mise en service est prévue entre 2022 et 2026.

Le plan d’action post-Fukushima ne s’arrête pas là puisqu’une troisième phase s’intéresse spécifiquement aux réacteurs dont la durée de fonctionnement est prolongée au-delà de 40 ans. L’ASN a en effet demandé d’améliorer leur sûreté afin qu’elle se rapproche des objectifs de sûreté des réacteurs de nouvelle génération, comme l’EPR de Flamanville 3. Là encore, il s’agit d’éviter un accident grave en cas d’agression extérieure ou de limiter les conséquences de la fusion du cœur sur l’environnement, comme l’EPR le prévoit. Une des modifications emblématiques consiste à installer un nouveau circuit de refroidissement et d’évacuation ultime de la puissance de l’enceinte. Il comporte, entre autres, une pompe d’injection d’eau dans le circuit primaire du réacteur ainsi qu’un échangeur pour extraire la chaleur. C’est un moyen supplémentaire d’éviter la fusion du cœur. Et si elle se produit néanmoins, ce circuit a aussi pour rôle de refroidir le corium produit dans le puits sous la cuve du réacteur et de permettre d’éviter que l’enceinte ne monte en pression. « Dans une telle situation, on est normalement obligé d’ouvrir la ligne d’éventage de l’enceinte, ce qui conduirait à des rejets radioactifs, même s’ils sont filtrés, analyse Olivier Dubois. Ce nouveau circuit d’évacuation ultime permet de gérer cette situation sans avoir à ouvrir l’enceinte. »

Ces modifications sont progressivement mises en place à l’occasion des quatrièmes visites décennales. Les réacteurs n°1 de Tricastin et n°2 du Bugey ont déjà été modifiés tandis que le n°4 du Bugey est actuellement en cours de révision. « À moins que pour des raisons de politique énergétique, il soit décidé que certains réacteurs ne dépassent pas l’âge de 40 ans, la modification des 29 autres réacteurs de 900 MW va se poursuivre jusqu’en 2025, déclare Olivier Dubois. Ensuite, viendra le tour des réacteurs de 1 300 MW à partir de 2026 puis celui de 1 450 MW. Les dernières modifications devraient intervenir en 2035. »

Au-delà de toutes ces mesures techniques qui s’étalent sur une très longue période, l’organisation des moyens humains déployés en cas d’accident a aussi fait l’objet de renforcements depuis la catastrophe de Fukushima. « Il faut rester modeste vis-à-vis des agressions qui peuvent se produire et les effets des cumuls d’agressions sont souvent difficiles à anticiper, confie Olivier Dubois. La gestion des conséquences d’un accident va beaucoup dépendre de la capacité d’adaptation et de résilience des équipes de crise. Suite au retour d’expérience de Fukushima, l’IRSN a donc fait plusieurs recommandations sur l’organisation de la FARN et des plans d’urgence interne. »

Fabrice Gaillard est passionné par la Terre et, encore plus, par ce que s’y passe à l’intérieur puisqu’il est chef du groupe « MAGMA » à l’ISTO. Après un doctorat à l’université d’Orléans de 1997 à 2001, il a été chercheur postdoctoral au Bayerisches GeoInstitut. En 2015, il obtient le plus haut diplôme français, l’habilitation à diriger des recherches (HDR), et devient directeur de recherche au CNRS en 2018. De solides arguments pour obtenir des financements dans un contexte peu favorable à la recherche fondamentale.

Fabrice Gaillard : dédié à la géologie expérimentale, ce prix récompense des scientifiques qui, comme moi, développent des ma chines simulant ce qui se passe à l’intérieur de la terre. D’autres que moi auraient donc pu être récompensés. Je pense qu’il y a une note d’originalité dans mes travaux qui a séduit le jury. Mes travaux ont permis de faire des mesures assez originales par rapport à la communauté des sciences de la terre et qui permettent de connecter différentes disciplines, en l’occurrence la géochimie et la géophysique. Un des points forts en ma faveur a certainement été la diversité des sujets scientifiques que j’ai pu adresser tout en utilisant la simulation comme méthodologie principale.

chines simulant ce qui se passe à l’intérieur de la terre. D’autres que moi auraient donc pu être récompensés. Je pense qu’il y a une note d’originalité dans mes travaux qui a séduit le jury. Mes travaux ont permis de faire des mesures assez originales par rapport à la communauté des sciences de la terre et qui permettent de connecter différentes disciplines, en l’occurrence la géochimie et la géophysique. Un des points forts en ma faveur a certainement été la diversité des sujets scientifiques que j’ai pu adresser tout en utilisant la simulation comme méthodologie principale.

La pétrologie est la science des roches. Depuis une trentaine d’années, la pétrologie expérimentale consiste, en laboratoire, à identifier les schémas réactionnels qui permettent de synthétiser des roches. J’ai greffé dessus la pétrologie électrique, une méthode géophysique qui permet de déterminer les variations des résistivités électriques des roches en profondeur. Cela permet aux géophysiciens d’interpréter des régions à l’intérieur de la croûte terrestre qui sont d’énigmatiques conducteurs électriques. Nous pouvons interpréter de manière quantitative l’imagerie électrique dans les terrains volcaniques.

Nous avons développé différentes applications qui intéressent des industriels et des scientifiques souhaitant traquer la présence de roches fondues en profondeur pour une meilleure compréhension du magmatisme et de la gestion des risques. Nous développons également des solutions pour repérer la présence de fluides aqueux et chauds reflétant la formation des gisements miniers et donc la géothermie. Après avoir constaté des anomalies de résistivités électriques, des industriels nous contactent pour tenter d’en savoir plus sur la taille de ce réservoir (sa température, la quantité de fluides, quelle est la vitesse de circulation…). Ce sont des questions qui ont des répercussions immédiates sur la pérennité d’un système géothermique.

En laboratoire, nous avons travaillé sur l’identification par expérimentation des processus magmatiques qui peuvent fabriquer des roches très riches en terres rares et les métaux rares en général (comme le lithium). Mais en France, on tourne le dos à tout ce qui est économie minière et il n’y a pas de stratégie pour devenir autonome dans ce domaine. Or, les besoins en ces métaux rares vont fortement augmenter dans les prochaines années. C’est une question de souveraineté. Nous avons lancé ce sujet avec le Service géologique national, le BRGM, mais pour l’instant nous n’avons pas d’échos de la part d’industriels français. Au niveau européen, ce sont les Suisses et les Britanniques qui sont très actifs dans ce domaine.

Ce prix est une réelle bouffée d’oxygène, car le financement de la recherche en France s’assèche de manière dangereuse. Cela devient très compliqué d’être financé aujourd’hui. Le taux de succès de l’ANR (Agence nationale de la recherche) est de 17 % en 2020 (conformément aux engagements de la loi de programmation de la recherche, les taux de succès devraient atteindre 23 % dès 2021, NDLR). Cela signifie que 83 % des projets scientifiques ne sont pas financés.

Une médaille de l’innovation scientifique me permettra d’être légitime quand je demande à être financé en France, mais surtout au niveau européen. J’ai deux projets que j’aimerais faire financer, mais je devrais prochainement n’en retenir qu’un seul. Le premier projet de recherche fondamentale concerne toujours l’électrique, mais en allant plus franchement dans les systèmes hydrothermaux et potentiellement derrière, la géothermie. J’aimerais compléter l’approche expérimentale électrique par une approche expérimentale sismique. Cette méthodologie expérimentale permettrait de simuler la propagation des ondes sismiques à l’intérieur des roches soumises à des conditions de pression et de température à l’intérieur de la terre.

Le second projet est encore plus fondamental : comprendre quels ont été les processus magmatiques lors des premiers instants de la Terre qui ont conduit, ou pas, à la mise en place rapide d’un environnement habitable avec une atmosphère, des océans et une croûte continentale. Pourquoi, sur Vénus, cela n’a-t-il pas évolué de la même façon ? Là aussi, la méthode reposerait sur le développement de machines en laboratoire qui simuleraient les conditions extrêmes de la « jeune » terre.

Pour de multiples raisons, la filière européenne du recyclage mécanique est en difficulté depuis plusieurs années et de nouvelles perturbations sont à craindre, selon la Cour des comptes Européenne :

Le recyclage chimique consiste à modifier la structure chimique des déchets plastiques pour les convertir en molécules plus courtes. Ceci permet en théorie de disposer de molécules utilisables en tant que matière première pour de nouvelles réactions chimiques.

L’intérêt est grand, par exemple pour traiter des déchets multicouches particulièrement difficiles à séparer par simple recyclage mécanique. Par ailleurs, le retour au contact alimentaire devient envisageable, les nouveaux matériaux obtenus par cette voie ayant des propriétés identiques à celles des matières vierges.

Si les technologies de recyclage chimique sont prometteuses, elles sont encore rarement disponibles à échelle industrielle. Néanmoins, les choses évoluent très vite : selon l’union des transformateurs de polymères (POLYVIA), on peut s’attendre à une production à échelle commerciale d’ici 1 à 2 ans.

Bibiane Barbaza, chargée de mission économique à Polyvia, a fait l’inventaire des innovations et projets apparus en 2020, dans un rapport publié en janvier 2021 et intitulé Recyclage Chimique : Où En Sommes-nous ?

Parmi les 84 initiatives diverses (brevets, projets collaboratifs, installations industrielles, etc.) qu’elle a répertoriées dans le monde, près de 50 sont du fait d’entreprises implantées en Europe. Voici quelques exemples européens.

Le recyclage chimique du polystyrène suscite un fort intérêt. En France, le consortium PS25 réunissant CITEO, VALORPLAST, SYNDIFRAIS et plusieurs entreprises utilisant les emballages en polystyrène a pour but de faire émerger une filière française du recyclage du polystyrène pour le contact alimentaire.

Par ailleurs, le recyclage chimique du polystyrène intéresse également de nombreuses entreprises :

Le spécialiste britannique du recyclage chimique est en mesure de commercialiser des produits chimiques liquides par anaérobie thermale, grâce à ses deux sites de production en Espagne. En 2020, cette startup très impliquée dans le recyclage chimique a aussi multiplié les partenariats : construction de sites de recyclage chimique par pyrolyse avec INEOS et TOTAL, site de recyclage chimique d’emballages de barres chocolatées avec NESTLÉ, partenariat avec l’américain Sealed Air, etc.

Ces quelques exemples démontrent une volonté européenne de faire émerger rapidement ces technologies à échelle industrielle. Ils ne sont cependant qu’un échantillon : pour une vision globale des avancées en matière de recyclage chimique, nous vous invitons à lire le rapport complet, disponible sur le site de POLYVIA.

L’Ademe publie le Baromètre Ecoconception 2020, le dernier en date remontant à 2014. Pour ce nouveau numéro, Harris Interactive a interrogé pour l’Ademe divers types d’entreprises entre le 21 septembre et le 16 octobre 2020 via un questionnaire en ligne et une enquête téléphonique. Parmi les 394 répondants, près de 300 ont intégré l’écoconception au moins de façon sommaire dans leurs plans stratégiques. Dans ce baromètre, l’Ademe recense 33 % d’entreprises qui intègrent l’écoconception « de manière systématique » pour améliorer leur performance environnementale sur le long-terme. En parallèle 18 % l’intègrent dans leur stratégie pour améliorer la performance environnementale sur le court-terme. Mais encore 25 % des entreprises se disent seulement informées sur le sujet, avec une intégration limitée des principes de l’écoconception.

Plus généralement, 21 % des entreprises déclarent déployer la démarche d’écoconception à un niveau généralisé du portefeuille de leurs produits mis sur le marché. Parmi les entreprises impliquées dans l’écoconception, le baromètre indique que deux entreprises sur cinq ont mis en place un système de management environnemental et 18 % ont une certification environnementale ISO 14001 de leurs produits.

L’Ademe note « une forte dynamique de progression » entre 2014 et 2020. En particulier, les entreprises multiplient leur nombre de projets d’écoconception. En 2020, elles avaient réalisé en moyenne 32 projets d’écoconception depuis 3 ans. Elles citaient uniquement 6 projets en 2014. Parallèlement, l’écoconception s’ancre dans les entreprises : le panel interrogé avait en moyenne 4,5 ans d’ancienneté en écoconception en 2014, et 9 ans en 2020.

Pour initier la démarche, la motivation personnelle du dirigeant reste indispensable. Elle est mise en avant par 64 % des répondants. S’ensuivent le besoin d’anticiper les futures réglementations (40 %), et la recherche de nouveaux marchés (32 %). Les entreprises mettent aussi en avant le rôle des parties prenantes pour justifier l’intégration de la performance environnementale à leur stratégie. Elles citent ainsi les clients (78 %), les employés (33 %) et les fournisseurs (31 %).

Quelle que soit la taille des entreprises, la formation à l’écoconception prend une part de plus en plus importante. Parmi les répondants, 91 % des entreprises de plus de 250 salariés et 73 % des moins de 10 salariés sensibilisent et forment leur personnel à l’écoconception. Toutefois, seulement 19 % des entreprises de plus de 250 salariés intègrent systématiquement l’écoconception, contre 45 % pour les entreprises de moins de 10 salariés. « Les petites entreprises sont plus rapidement au stade d’une écoconception généralisée sur leur portefeuille de produits, marquée par une augmentation significative de leur volume de ventes », explique l’ADEME.

Les entreprises impliquées depuis 6 ans font part de leur retour d’expérience pour mettre en avant les bénéfices de l’écoconception sur leurs résultats. 21 % d’entre elles pilotent le retour sur investissement de la démarche mise en place. Résultat : 34 % des entreprises perçoivent une augmentation du volume des ventes, dont 6 % une augmentation significative. Elles étaient respectivement 29 % et 0 % en 2014. Elles mettent aussi en avant une hausse de notoriété (62 %), une meilleure relation avec les clients (48%) et une motivation des employés plus importante (38 %). En contrepartie, les entreprises expriment des attentes et besoins pour renforcer leur démarche : formations, conseils, méthode de comptabilité des impacts économique de l’écoconception.

Dans le cadre du déploiement du Plan de Relance dans les territoires, l’ADEME propose plusieurs aides financières exceptionnelles pour financer leurs démarches d’écoconception. En particulier, l’appel à projets Perfecto est ouvert jusqu’au 8 avril pour déployer une démarche d’écoconception dans un projet de R&D. Des aides appuient les pré-diagnostics écoconception, d’autres les phases d’études ou encore les investissements permettant d’aboutir à la commercialisation de produits et services écoconçus.

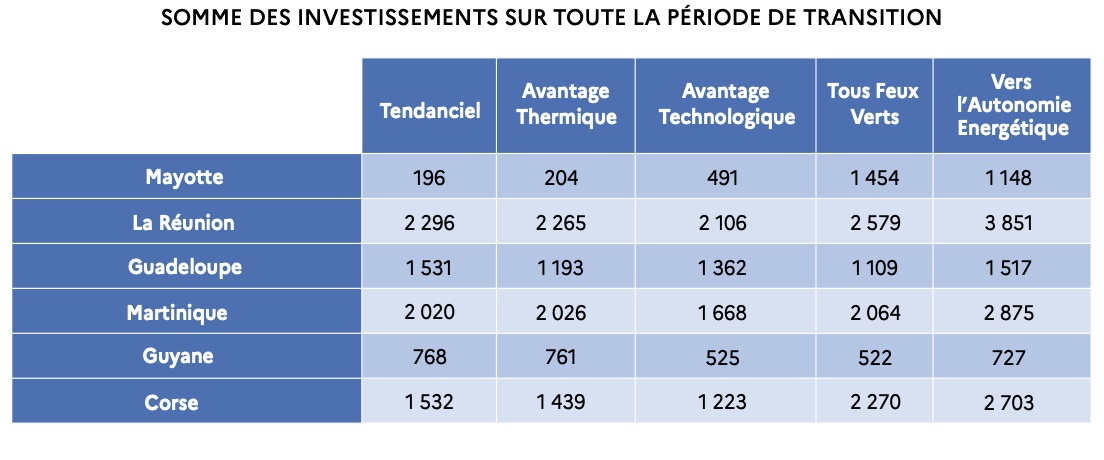

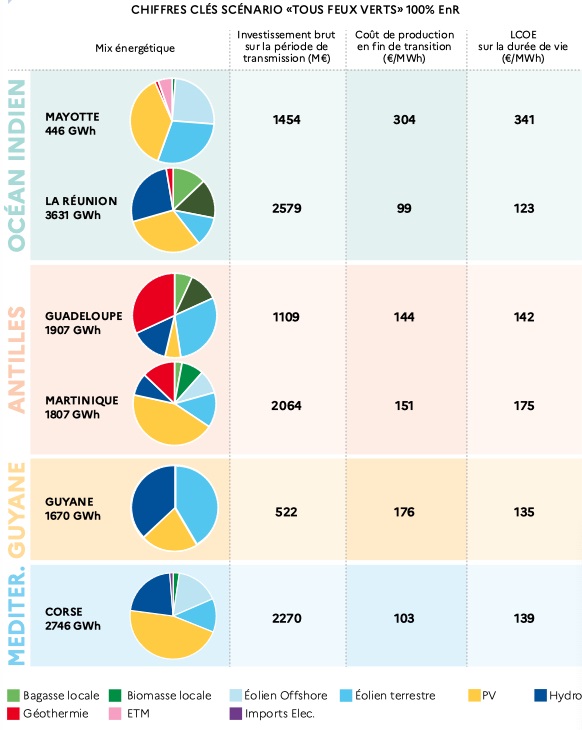

Moyennant une politique volontariste de maîtrise de la demande d’énergie (MDE) et un sérieux développement des capacités de stockage, un mix électrique 100 % énergies renouvelables adapté aux particularités locales est techniquement possible dans les six zones non interconnectées (ZNI) françaises étudiées, indique dans son étude l’Ademe, l’Agence de la transition énergétique.

Cette étude est le fruit d’un travail sur l’autonomie énergétique comme inscrite dans la loi de transition énergétique pour une croissance verte (LTECV) de 2015, rappelle l’Agence de la transition énergétique, prenant en compte à la fois l’évolution de la maîtrise de l’énergie et les changements dans les transports ainsi que les impacts socio-économiques de la transition énergétique en ZNI. Elle passe en revue les six ZNI à la loupe autour de cinq scénarios distincts (voir encadré).

L’Ademe concentre logiquement son attention sur les deux derniers scénarios qui permettent d’atteindre l’objectif fixé par la loi : mix électrique 100 % renouvelable et autonomie énergétique.

Même si les territoires diffèrent géographiquement, avec des ressources locales et/ou des choix politiques divers, l’étude estime que les potentiels renouvelables locaux sont suffisants pour assurer un mix électrique 100 % renouvelable. Et ce sans perte de la sécurité d’approvisionnement sur le système électrique.

Par hypothèse, il n’y a pas d’investissement dans les énergies fossiles dans ce scénario. Sous l’effet d’un bilan économique favorable, la part d’énergie renouvelable dans le mix augmente au fil des années pour couvrir la demande supplémentaire au fur et à mesure.

Les chiffres clés du scénario « Tous Feux Verts », dont le mix électrique est 100 % renouvelable, montrent d’importantes disparités dans la répartition du mix électrique. Ainsi, c’est en Corse et en Martinique que la part du solaire représente quasiment la moitié du mix, tandis qu’en Guyane, c’est l’hydraulique qui est plus important et en Guadeloupe, la géothermie fait jeu égal avec l’éolien terrestre.

Néanmoins, atteindre l’autonomie énergétique ne semble toutefois pas réalisable d’ici 2030 en raison du rythme élevé qu’elle implique pour le déploiement des filières renouvelables, signale l’Ademe. Par exemple, pour atteindre l’objectif d’autonomie fixé par la LTECV, La Réunion devrait déployer environ 1 000 MW de PV en 15 ans, alors que la PPE en cours porte un objectif de 120 MW supplémentaires pour 2023, affiche l’étude.

Réunion, Guadeloupe et Martinique présentent des mix assez bien diversifiés, sources de développement économique local dans plusieurs filières de production, ajoute l’Ademe. En prenant en compte les importations de biomasse, le taux d’énergie renouvelable atteint 100 % dans tous les scénarios guadeloupéens et réunionnais. Mais pour la Martinique, les caractéristiques du parc existant et la difficulté de diversification des potentiels conduisent à conserver une part de production fossile jusqu’en 2030 (en dehors des deux scénarios dont le taux d’EnR est fixé à 100 %). Le taux d’énergie renouvelable atteint tout de même 93 % dans le scénario « Tendanciel » martiniquais, précise l’Ademe.

Cas particulier pour la Corse, qui est reliée au continent par deux lignes sous-marines (avec la France et avec l’Italie), puisque même si l’île de Beauté ne dispose pas d’un fort potentiel d’ENR, hors solaire, l’intermittence de cette énergie est compensée par les possibilités d’importation de courant qui évitent le recours à un stockage puissant.

L’Ademe précise cependant que, compte tenu des coûts complets observés, ce résultat serait également conservé (l’intermittence resterait compensée) si l’on prenait en compte des investissements dans les énergies fossiles.

« D’une façon générale et plutôt contre-intuitive, il est important de noter que sauf cas particulier, les scénarios contraints à 100 % d’ENR n’engendrent pas d’explosion des besoins d’investissement », signale l’Ademe.

La forte augmentation des investissements pour les territoires de Mayotte, la Réunion et la Martinique « résulte de la saturation des potentiels ENR disponibles qui impose à l’algorithme d’investir dans des moyens de productions coûteux comme l’ETM (l’énergie thermique des mers), l’éolien offshore cyclonique ou le photovoltaïque résidentiel ».

L’Ademe explique ainsi en outre que « pour la Guyane, l’ensemble des scénarios conduit à des investissements inférieurs à ceux du scénario « Tendanciel ». A Mayotte, la faiblesse du potentiel renouvelable conduit à d’importants investissements pour remplacer la production conventionnelle. En effet, les scénarios non contraints conservent une part conséquente de production diesel. »

Par ailleurs, l’étude constate qu’afin d’accéder à une autonomie électrique renouvelable, la Réunion, la Guadeloupe et la Martinique devraient investir respectivement, 2,6, 1 et 2 milliards d’euros. Ces sommes sont à mettre en perspective avec l’investissement nécessaire des scénarios tendanciels. Le besoin en investissement du scénario « Vers l’Autonomie Energétique » est identique à celui du « Tendanciel » pour la Guadeloupe. En revanche, il est nettement supérieur par rapport aux scénarios tendanciels respectifs de la Martinique (+42 %) et la Réunion (+68 %). Cette augmentation s’explique par une demande supérieure qui mobilise une grande partie du potentiel et contraint le système à investir dans des technologies plus coûteuses comme des installations PV moins productives ou encore de l’éolien offshore. Par ailleurs, en Guadeloupe, l’investissement du scénario « Tous Feux Verts » est inférieur à l’investissement du « Tendanciel » (-28 %) alors qu’il est légèrement supérieur pour la Martinique (2 %) et la Réunion. L’interconnexion au continent de la Corse réduit enfin les besoins d’investissements, indique l’Ademe.

Les deux derniers scénarios « contraints » portent deux contraintes fortes : les importations d’énergie sont interdites et l’objectif ENR est ciblé à 100 % en fin de trajectoire. En particulier, on considère dans ces scénarios que la biomasse utilisée doit être produite localement. Le modèle d’optimisation prend alors en compte ces deux contraintes pour déterminer le mix électrique correspondant à l’optimum technico-économique. Le contexte favorable aux EnR ainsi que l’objectif 100 % renouvelable sont similaires aux deux scénarios qui se distinguent principalement par une demande énergétique différente.

L’Ademe concède plusieurs limites à l’étude. D’abord, l’objectif 2030, imposé par la LTECV, peut être décalé dans le temps sans être préjudiciable à l’objectif de l’autonomie énergétique. Ensuite, côté réseau, en l’état de l’art, « les outils de modélisation utilisés pour l’analyse de stabilité des systèmes électriques obtenus sont basés sur un ensemble d’équations destinées à des systèmes actuels composés principalement de machines tournantes synchronisées au réseau », ce qui signifie que 100 % d’ENR non pilotables suppose du stockage et de la gestion par électronique de puissance, avec les études ad hoc nécessaires. En outre, les coûts sont calculés hors impôts taxes et marges, mais ils intègrent une taxe carbone structurante. Enfin, l’étude mérite d’être approfondie du côté de l’impact sur l’emploi et l’économie, sans oublier l’environnement… À suivre donc.

D’après un rapport de l’IBM Institute for Business Value, les dépenses liées à la blockchain dépasseraient 16 milliards de dollars d’ici 2023. Les entreprises, en particulier celles des secteurs réglementés, cherchent de plus en plus à mettre en place des solutions de blockchain complètes dotées de fonctions avancées de sécurité et de confidentialité des données tout en améliorant les performances.

Ces secteurs réglementés réalisent environ 50 millions de contrôles en ligne par an afin de s’assurer de l’authenticité des documents fournis par des particuliers pour ouvrir un compte en banque, confirmer l’adresse de son domicile ou justifier ses revenus.

Mais ces secteurs sont de plus en plus confrontés à des tentatives de fraude. Selon le baromètre annuel établi par Onfido, entreprise spécialisée dans la vérification d’identité et l’authentification en ligne, le taux moyen de ce type de fraude a connu une forte hausse dès le printemps 2020 au niveau mondial (+41 % de tentatives en un an) et en France (+29 %, avec un pic à 13,4 % en juin), en passant de 6,6 % à 8,5 % en une année à l’échelle nationale.

C’est dans ce contexte qu’Archipels a entamé la commercialisation de son service de certification par la blockchain avec VIALINK, leader français de l’automatisation du traitement des dossiers clients (KYC) pour la banque, l’assurance et l’immobilier.

À la différence de la signature numérique, la blockchain apporte plus de confiance grâce à un réseau de confiance distribué. Cette solution rend le document indélébile et immuable dans le temps.

Pour vérifier les documents qui leur sont remis, les clients d’Archipels disposent désormais d’un moyen fiable pour mener à bien ces contrôles : qu’il s’agisse de documents liés à l’entreprise (Kbis, Statuts, listes de bénéficiaires), ou encore de factures, l’émetteur en établit une empreinte numérique cryptographique intégrée dans la blockchain ; Archipels joue un rôle de référentiel, véritable registre de documents certifiés.

Preuve d’auditabilité et de traçabilité, la blockchain d’Archipels permet de contrôler un document par rapport à un référentiel d’empreintes numériques. Il suffit de charger les documents à vérifier dans une API sur une plateforme en ligne développée pour le client, qui indique instantanément si le document est authentique ou non.

« Notre solution vise à créer une infrastructure de confiance globale mise à disposition de tout tiers désirant vérifier l’authenticité d’un document. Notre blockchain est privée et permissionnée, ce qui signifie que les acteurs validant les transactions sont des tiers de confiance identifiés et autorisés à le faire. Nous avons une maîtrise totale de l’origine des documents certifiés », nous explique Hervé Bonazzi, CEO d’Archipels.

Prochaine étape pour Archipels, la certification d’autres documents dits « à valeur probante », c’est-à-dire liés à des attributs de votre identité. Il s’agit d’une information qui vient compléter votre identité comme une attestation d’assurance, votre revenu fiscal de référence, vos bulletins de salaire…

« L’objectif à terme est de créer des portefeuilles d’identité numérique décentralisés et auto-contrôlés et que les Anglo-saxons appellent le « Self-Sovereign Identity », un concept né avec la blockchain. Les attributs de votre identité n’appartiennent qu’à vous et vous êtes le seul à en avoir le contrôle. Dans cette logique, grâce à la blockchain, nous allons pouvoir redonner aux personnes et aux entreprises le contrôle sur leurs données qui sont trop souvent éparpillées dans différentes bases de données d’entreprises et qui risquent d’être piratées », précise Hervé Bonazzi.

Ce portefeuille d’identité numérique décentralisé permettrait de ne communiquer à une administration ou une banque que certains documents ou informations certifiés sur la blockchain par des émetteurs identifiés et autorisés.

« On pourrait imaginer que, dans le cadre d’un dossier d’ouverture d’un microcrédit, vous pourriez prouver très rapidement et simplement votre niveau de revenus en transmettant juste la preuve que vous rentrez bien dans les critères d’éligibilité sans transmettre votre avis d’impôt, vos bulletins de salaire… Il s’agit de minimiser les informations à transmettre aux tiers, de ne transmettre que ce qui est nécessaire », insiste le CEO d’Archipels.

Lundi 1er mars, devant la commission spéciale de l’Assemblée nationale sur le projet de loi Climat et résilience, le ministre de l’économie Bruno Le Maire a rappelé que l’État allait investir 7 milliards d’euros pour développer l’hydrogène décarboné d’ici 2030. Il a insisté sur le fait qu’il fallait veiller « à ce que la chaîne de valeur soit bien en France ». Tout en défendant l’idée qu’il est « indispensable de garder un temps d’adaptation » suffisamment long en matière de transition écologique pour ne pas favoriser les grandes entreprises au détriment des PME et des TPE.

France Hydrogène est l’association française réunissant les acteurs de la filière hydrogène. Elle comprend près de 280 adhérents, avec notamment 52 grands groupes, institutions financières et ETI et 120 PME-PMI. Philippe Boucly, son président, salue un plan complet qui va enfin donner l’impulsion nécessaire à la structuration de l’hydrogène décarboné. Entretien.

Philippe Boucly : France Hydrogène a publié en juillet dernier un manifeste pour un plan national hydrogène ambitieux et cohérent. Pour atteindre les objectifs de l’Article 1 de la Loi énergie-climat, à savoir atteindre une part entre 20 % et 40 % d’hydrogène décarboné en 2030, nous estimons qu’il faut investir 24 milliards d’euros. Sur ce total, nous évaluons le soutien financier nécessaire à environ 10 milliards d’euros. Ce montant comprend 6,7 milliards d’euros d’aides à l’investissement et 3,6 milliards d’euros d’aides à la production. Ces aides peuvent venir de l’État, de l’Europe, mais aussi des régions.

Philippe Boucly : France Hydrogène a publié en juillet dernier un manifeste pour un plan national hydrogène ambitieux et cohérent. Pour atteindre les objectifs de l’Article 1 de la Loi énergie-climat, à savoir atteindre une part entre 20 % et 40 % d’hydrogène décarboné en 2030, nous estimons qu’il faut investir 24 milliards d’euros. Sur ce total, nous évaluons le soutien financier nécessaire à environ 10 milliards d’euros. Ce montant comprend 6,7 milliards d’euros d’aides à l’investissement et 3,6 milliards d’euros d’aides à la production. Ces aides peuvent venir de l’État, de l’Europe, mais aussi des régions.

Les aides aux OPEX partent du constat que l’hydrogène produit par électrolyse à partir d’énergie renouvelable, ou d’électricité bas carbone, reste relativement cher, de l’ordre de 4 à 6 € le kilo. Or, pour décarboner l’hydrogène industriel, il faut arriver à un prix de l’ordre de 1,5 € le kilo. En attendant que cet écart de prix se réduise, ces 3,6 milliards d’euros de soutien permettront de rendre l’hydrogène décarboné compétitif.

Notre manifeste retient comme objectifs de déployer 300 000 véhicules utilitaires légers, 5 000 poids lourds, 1 000 bateaux et 250 trains fonctionnant à l’hydrogène en 2030. Ces véhicules consommeraient de l’ordre de 340 000 tonnes d’hydrogène chaque année. Nous décarbonerions en plus un volume équivalent d’hydrogène dans l’industrie pour atteindre un total de 680 000 tonnes d’hydrogène décarboné chaque année.

Le 9 septembre, le gouvernement a présenté la stratégie nationale pour le développement de l’hydrogène décarboné. Elle suit trois axes : décarboner l’industrie, développer une mobilité hydrogène et construire une filière française de l’électrolyse compétitive en installant 6,5 gigawatts (GW) d’électrolyseurs d’ici 2030 pour produire 600.000 tonnes d’hydrogène décarboné. Dans notre manifeste, pour produire les 680 000 tonnes d’hydrogène, nous parlions de 7 GW. Ces chiffres sont donc très proches. L’État accorde 7,2 milliards d’euros d’aides : 2 milliards d’euros sur les deux ans qui viennent, 3,4 milliards d’euros d’ici 2023 et le reste jusqu’en 2030.

Il reste donc 2,8 milliards d’euros de soutiens à trouver auprès des régions et de l’Europe. L’Occitanie a déjà un plan de 150 millions d’euros, la Bourgogne-Franche-Comté de 90 millions, les Pays-de-la-Loire de 100 millions. Si chaque région accordait en moyenne 100 millions d’euros, nous serions presque à la moitié du chemin. Nous sommes donc satisfaits de l’impulsion donnée. Le plan Hulot consacré à l’hydrogène en 2018 avait de faibles moyens financiers : 100 millions d’euros pour l’année 2019. La stratégie ici propose à la fois une vision, les moyens financiers associés et une gouvernance avec le Conseil national de l’hydrogène.

Le Conseil National de l’Hydrogène est l’instance qui va suivre la mise en œuvre de cette stratégie. Il fera office de tour de contrôle du plan. Il s’agira avant tout d’un organe de dialogue entre les industriels, le pouvoir politique et les régions pour s’assurer du bon déploiement du plan. En ce sens, il suit le déploiement des projets et des financements. France Hydrogène a par exemple déjà dénombré 4 projets d’usines en France de fabrication d’électrolyseurs et a identifié des installations d’électrolyse projetées d’une puissance totale de 3,2 GW. Cela correspond déjà à près de 50 % de l’objectif fixé par la stratégie nationale.

Du 1er au 14 mars 2021 a lieu la 8e édition des Journées Nationales de l’Ingénieur. Pour l’occasion, IESF organise le 4 mars, date qui concorde avec le World Engineering Day, un colloque national sur le thème « Ingénieurs, acteurs de la relance ». Il sera composé de différentes tables rondes auxquelles le public peut s’inscrire. Philippe Boucly participera à la conférence « L’hydrogène vert, une réalité industrielle, un champ de développement durable, partie prenante du plan de relance ».

Du 1er au 14 mars 2021 a lieu la 8e édition des Journées Nationales de l’Ingénieur. Pour l’occasion, IESF organise le 4 mars, date qui concorde avec le World Engineering Day, un colloque national sur le thème « Ingénieurs, acteurs de la relance ». Il sera composé de différentes tables rondes auxquelles le public peut s’inscrire.

Olivier Gibaru, enseignant-chercheur au campus Arts & Métiers de Lille et référent en matière de cobotique, sera intervenant lors de la conférence « Les formateurs, l’amont ». Pour Techniques de l’Ingénieur, il se penche davantage sur son domaine de spécialisation : la cobotique.

Olivier Gibaru : La cobotique se développe en parallèle de la robotique usuelle et industrielle qui a plutôt recours à de gros robots. Autrement appelée « robotique collaborative », la cobotique déploie des robots plus petits, qui portent des charges plus faibles et travaillent en coactivité avec l’humain. Cette nouvelle forme de robotique permet de repenser la relation homme-machine. De mon point de vue, le défi est réellement de simplifier la relation entre les systèmes automatisés et l’homme. Il faut considérer le robot comme un apprenti qui doit être capable d’apprendre pour nous aider. Le système doit donc être capable d’intégrer de l’information de l’opérateur qui lui apprend les tâches à réaliser. Celles-ci sont généralement à faible valeur ajoutée et peu ergonomiques pour les opérateurs, et entraînent des risques de troubles musculosquelettiques importants. En ce sens, la cobotique permettra d’assurer la compétence dans les usines en ayant des opérateurs qui restent plus longtemps, et en les maintenant en meilleure santé.

Le plan de relance soutient les technologies de l’industrie 4.0, mais plutôt pour avoir des résultats assez rapides et concrets pour l’industrie. Il prévoit aussi le soutien à la formation des ingénieurs déjà en poste. La cobotique doit atteindre sa maturité et nécessite encore du développement. Je pense que la cobotique sera bien développée d’ici 5 ans si un effort important est déployé. L’environnement industriel se développe bien en France, mais il faut que les grands donneurs d’ordre s’emparent encore plus du sujet.

J’ai initié la cobotique il y a une dizaine d’années sur le campus de Lille. Tout l’enjeu, et c’est sur quoi nous travaillons, est de développer des interfaces cognitives qui intègrent des outils d’intelligence artificielle, de deep learning ou d’apprentissage renforcé. Il faut que le système sache demander des solutions à l’opérateur lorsqu’il ne comprend pas un concept. Le bon modèle sera celui qui trouvera le bon effet de levier dans l’interaction homme-machine.

Les cobots se développent principalement dans l’automobile et l’aéronautique en France. Nous avons aussi eu des opérations dans le packaging et la parfumerie. Le principal frein demeure la vitesse de déplacement des robots en cobotique. La norme impose une vitesse maximale de 250 millimètres par seconde, là où des robots classiques peuvent se déplacer à 1 mètre par seconde ! Cela n’est donc pas toujours compatible avec les contraintes de temps de cycle des chaînes de montage, comme en automobile. Ces chaînes n’allouent qu’un temps très court à chaque opération. Dans l’automobile, les robots collaboratifs sont pour l’instant principalement réduits au « pick and place », qui sont assez faciles à programmer.

Nous avons reçu le Prix de l’Open Innovation aux Safran Innovation Awards 2019 pour avoir développé un robot de contrôle d’armoires électriques de l’A350. Ces vérifications imposent des milliers de points de contrôle, ce qui est très fatigant pour un humain. Ainsi, le cobot se déplace via une base mobile tout autour du cœur électrique pour vérifier son bon état. Il est déployé sur le site Zodiac Aerospace de Niort.

La formation est aussi un enjeu majeur. Sur le campus de Lille des Arts et Métiers, nous avons une plateforme robotique cofinancée par la Fondation Arts & Métiers où les élèves-ingénieurs sont mis en situation opérationnelle. Ils réalisent des travaux pratiques et des préprojets industriels avec des systèmes robotiques collaboratifs.

L’écosystème de formation national a pris conscience de l’introduction de la robotique sur le territoire. Les pays les plus robotisés n’ont pas un taux de chômage important. Dans l’industrie, on constate que la robotisation et l’automatisation des chaînes de production ne réduisent pas le nombre d’emplois. Au contraire, elles favorisent le maintien des usines sur le territoire. Pour attirer les jeunes, il faut faire la promotion de la technologie au sein des usines.

Produire 3,6 millions de tonnes d’hydrogène vert en Europe chaque année à l’horizon 2030, tel est l’objectif du projet « HyDeal Ambition » qui regroupe à ce jour une quarantaine d’industriels européens de l’énergie. Au-delà de cet important volume, représentant l’équivalent d’un mois et demi de consommation de pétrole en France, son ambition est de le vendre à un coût très compétitif de 1,5 € le kg livré et ainsi venir concurrencer le marché des énergies fossiles.

Thierry Lepercq, ancien directeur général adjoint d’Engie, est à l’origine de la création de cette future filière et son porte-parole. « Dès la fin de l’année 2018, nous avons commencé à faire des travaux de modélisation, déclare-t-il. L’originalité fondamentale de notre démarche est non pas de déposer un dossier pour obtenir des subventions, ce qui est pratiquement le cas de tous les projets aujourd’hui, mais de réunir l’ensemble des acteurs de la chaîne de valeur afin d’étudier comment on peut conclure des contrats d’ingénierie de construction, de développement, de vente d’hydrogène, de raccordement au réseau et de financement. »

Pour vendre cet hydrogène au prix du marché, il sera d’abord produit à partir de centrales solaires en Espagne et au Portugal, deux pays où l’ensoleillement est élevé et qui sont capables de produire de l’électricité à un coût inférieur à 15 € le MWh. Cette dernière sera ensuite transformée en hydrogène grâce à l’électrolyse de l’eau avec un rendement de 70 %. Pour atteindre une capacité installée de 95 GW, les panneaux solaires nécessiteront une surface de 78 000 hectares. Thierry Lepercq modère ce chiffre : « cela représente 0,1 % de la surface de l’Espagne et du Portugal. Au niveau local, la consommation d’eau sera aussi non négligeable, mais à l’échelle des deux pays cela correspond à 0,1 % du volume consommé. »

En moyenne, chaque site de production solaire aura une capacité comprise entre 500 et 1 000 MW et s’étendra sur environ 500 hectares. « La production d’hydrogène décarboné au prix du marché ne peut fonctionner qu’avec du solaire, car le coût de production de cette électricité est très compétitif, analyse Thierry Lepercq. Ceux qui disent qu’on va installer un électrolyseur sur le réseau électrique se trompent, car le coût d’acheminement de cette électricité grâce au réseau représente déjà entre 7 et 10 euros du MWh. »

Pour le transport, le bateau et la route ont rapidement été écartés ; ces deux solutions étant jugées trop coûteuses. C’est donc à travers un réseau de pipelines que l’hydrogène sera uniquement livré. Plusieurs dizaines de térawatt-heures de stockage souterrain seront également nécessaires car les quantités produites seront irrégulières avec des volumes plus importants au printemps et l’été que l’hiver. Au total, le transport et le stockage ne devront pas peser plus 0,3 € par kg d’hydrogène.

Le budget global de ce projet est estimé à environ 120 milliards d’euros. En amont de la filière, il regroupe des développeurs solaires parmi lesquels le Franco-Espagnol DH2/Dhamma Energy et l’Italien Falck Renewables. Des producteurs d’électrolyseurs et des groupes d’ensembliers sont aussi présents comme les Français McPhy Energy et Vinci Construction. À l’aval, des opérateurs de transport et de stockage de gaz sont associés, avec entre autres, les Français GRTgaz et Teréga, mais aussi Snam en Italie et OGE en Allemagne. Pour le financement, des banques ont rejoint le projet tel que la Deutsche Bank, Natixis et la Banque européenne d’investissement.

Grâce à son prix attractif, cet hydrogène vise ni plus ni moins à remplacer le pétrole, le gaz et le charbon dans tous leurs usages. Il servira par exemple à produire de la chaleur pour remplacer le gaz naturel dans la production d’ammoniac et autres produits chimiques ou alors à remplacer le charbon à coke dans l’industrie de la sidérurgie. « Il pourra aussi être retransformé afin d’offrir cette électricité 100 % renouvelable en temps réel dont tout le monde rêve, ajoute Thierry Lepercq. Il pourra aussi remplacer le diesel consommé par les camions, car les poids lourds vont, à partir de 2025, basculer vers cette nouvelle énergie. »

Dès 2022, les premières livraisons au prix de 1,5 € par kg doivent commencer. Avec des capacités de production des électrolyseurs encore très modestes, les volumes seront limités jusqu’en 2024. Des gigafactory d’électrolyseurs doivent sortir de terre, mais les demandes de permis de construire et les autorisations demandent du temps.

Selon Thierry Lepercq, cet hydrogène va servir à reconvertir les centrales à charbon qui jouent un rôle essentiel dans la stabilisation du réseau électrique. « Nous travaillons avec plusieurs acteurs européens sur cette reconversion, explique-t-il. Les sites de ces centrales à charbon ainsi que les salariés pourront être conservés. Des régions charbonnières en difficulté comme la Lorraine ont une opportunité importante grâce à cette transformation. Le charbon vivra sous une autre forme car il sera remplacé par l’hydrogène. »

À terme, le volume annoncé de 3,6 millions de tonnes d’hydrogène à l’horizon 2030 pourrait se révéler plus important, car depuis son lancement officiel, d’autres pays comme le Maroc et la Tunisie pourraient aussi rejoindre ce projet et accueillir sur leurs terres des centrales solaires pour produire de l’électricité transformée ensuite en hydrogène.

La température est descendue jusqu’à -20°C à Dallas, à -25°C dans certaines autres villes, et est demeurée autour de -15°C pendant plusieurs jours. Les chutes de neige ont atteint jusqu’à 30 cm en 24 heures dans certaines cités texanes, comme à San Antonio. Les infrastructures énergétiques, d’adduction d’eau et même de transports du Texas ont été endommagées.

Le gestionnaire du réseau électrique de l’Etat, Electric Reliability Council of Texas (Ercot) est intervenu à plusieurs reprises, coupant d’abord les grands contrats interruptibles (les industriels), puis réclamant des délestages, plongeant dans le noir d’abord des centaines de milliers de foyers, puis dans le froid. Car environ 60 % des Texans se chauffent à l’électricité. Ercot a évité de justesse la grande panne redoutée de tous les GRT du monde au prix de réactions difficiles à organiser, tant l’organisation du marché texan de l’énergie a été bousculée en 20 ans.

Historiquement, le Texas, l’un des derniers Etats à rejoindre les États-Unis (1845) avant de plonger côté Sud dans la guerre de Sécession, a toujours souhaité garder une certaine forme d’indépendance vis-à-vis de l’État fédéral. Pour l’électricité, le réseau est très peu interconnecté aux autres États, notamment pour échapper au régulateur fédéral, la FERC (Federal Energy Regulatory Commission). Ce qui implique qu’hormis dans certaines parties de l’Etat (El Paso notamment qui est relié au réseau du Nouveau-Mexique), en cas de problème, il n’est pas possible d’importer du courant des Etats voisins.

En outre, la dérégulation des marchés de l’énergie a laissé libre cours au mix électrique. Les gisements gaziers favorisant les centrales au gaz ainsi que les aides en faveur des renouvelables ont « fait » ledit mix. Au final, la répartition des capacités installées repose sur environ 20 % d’éolien, un peu plus de 50 % de gaz, quelques 10 % de charbon, du solaire, et du nucléaire (un réacteur sur les quatre que compte le Lone Star State a décroché suite à des problèmes d’alimentation de refroidissement !), etc. Si les éoliennes, non conçues dans cet État du Sud pour être anti-gel, ont logiquement décroché (3 GW à peine produits sur les 6 GW attendus pour la période, pour plus de 30 GW en termes de capacité installée), c’est surtout les centrales au gaz qui ont achevé le travail pour conduire au bord de la rupture. Sans oublier le nombre d’acteurs de production du marché libéralisé (quelque 650) rendant complexe la gestion du système.

En cas de pointe de consommation, comme cela s’est produit au Texas le 15 février dernier, le GRT aurait dû pouvoir se tourner vers les moyens de productions activables, donc essentiellement les centrales au gaz. Or le Texas n’a pas préparé ses centrales électriques au froid, et surtout pas ses canalisations. Bilan, une vingtaine de GW ont manqué à l’appel (sur 55 GW habituellement disponibles l’hiver) au moment où elles auraient dû délivrer le courant. Dans l’ensemble du Sud-Est américain, environ 20 % des installations gazières ont été touchées et ont freiné la production injectée directement sur les gazoducs.

Ainsi, après avoir activé les moyens classiques pour maintenir la fréquence (60 Hz outre-Atlantique), et donc la stabilité du réseau – baisse légère de fréquence, appel aux interruptibles –, Ercot s’est retrouvé dans une situation où la pointe (demande la plus forte) atteignait 74,5 GW, alors qu’un tiers des capacités de production était à l’arrêt, et sans pouvoir faire appel aux Etats voisins. Le GRT a dû procéder à des coupures tournantes chez les particuliers. Insuffisant, car plusieurs centrales (au gaz) sont à leur tour tombées en panne faute d’approvisionnement en gaz…

A 13h51, le 15 février, faute de puissance disponible, la fréquence du réseau est descendue à 59,4 hertz, en-deçà du seuil de stabilité, contraignant Ercot à procéder à de nouvelles coupures, plus amplement, et non tournantes cette fois. Conséquence, la fréquence a commencé à remonter, mais une partie du Texas était sans courant. Et comme la situation de froid a perduré, ces coupures ont également perduré… jusqu’à ce que les centrales arrêtées puissent redémarrer !

Comme le signale l’Agence internationale de l’énergie (AIE) dans une première analyse rendue publique, Ercot a déclaré que 16,5 GW de la demande des clients ont été interrompus en raison de délestages pendant la majeure partie du 15 février et sont restés proches de ce niveau jusqu’à midi le 17 février, avant de retomber à 6 GW au début du 18 février. Sur la base de ces chiffres, le délestage du système pour les 15 et 16 février est estimé de manière prudente à environ 800 GWh, signale l’AIE. La différence entre la charge prévue et la charge réelle est une autre estimation approximative du délestage et d’autres mesures extrêmes prises par les clients. Ce chiffre a atteint 27 GW à 21 heures le 15 février et a totalisé 500 GWh pour la journée.

En comparaison, les coupures de courant en Californie l’été dernier (pour cause d’incendies) ont duré environ deux heures et ont entraîné une perte de charge d’environ 1,5 GWh. En utilisant ces chiffres comme estimations approximatives, le niveau de coupure au Texas les 15 et 16 février a été plus de 500 fois supérieur à celui de la Californie lors du délestage de l’été dernier, souligne l’Agence de l’OCDE.

Cinq membres du conseil d’administration d’Ercot sur 16, dont la présidente Sally Talberg, ont annoncé leur démission et un autre candidat au conseil a retiré sa candidature. Les six habitant dans un autre Etat que le Texas, ils ont déclenché la colère de certains législateurs de l’État. Le gouverneur du Texas, Greg Abbott, entend lancer une enquête sur ces « événements désastreux »… loin d’être achevés.

En effet, comme la fourniture d’électricité est, elle aussi, déréglementée, certains consommateurs ont opté pour des prix du courant en fonction du prix du marché (comme cela se pratique aussi dans certains pays nordiques en Europe d’ailleurs, mais souvent pour des résidences secondaires).

Bilan : certains consommateurs ont vu leur facture hebdomadaire passer la barre des 10 000 dollars… avec une certaine logique, puisque, la demande dépassant l’offre sur plusieurs heures, les prix du marché topaient au plafond, fixé à 9 000 $/MWh, et y demeuraient pour plusieurs heures/jours… Plusieurs consommateurs ont ainsi d’ores et déjà annoncé vouloir déposer des recours et poursuivre les électriciens. Une habitante du comté de Chambers a ainsi déposé une « class-action » contre son fournisseur, l’accusant de se « gaver » à cette occasion. Un fournisseur au nom prédestiné (avec l’homophonie) de… Griddy ! Griddy (pour grid, donc réseau), mais Greedy (pour vorace).

Le régulateur (la Public Utilities Commission) du Texas a passé en début de semaine dernière un amendement réclamant aux fournisseurs de ne pas couper leurs clients, malgré les impayés, voire de retenir leurs envois de factures jusqu’à ce que la crise soit terminée.

Depuis des années, la question de la rémunération des droits d’auteurs oppose les GAFAM aux éditeurs de presse dans différents pays, dont l’Australie, où un projet de loi porté par le gouvernement vise à contraindre les géants de la tech à rémunérer les médias pour la reprise de leurs contenus. Il s’agit d’établir un « code de conduite contraignant » qui vise le « fil d’actualité » de Facebook et les recherches sur Google.

Opposé à ce projet, Facebook a décidé de bloquer l’accès aux informations aux internautes australiens. Le 23 février, le réseau social aurait décidé de lever ses restrictions après avoir trouvé un accord avec le gouvernement.

Cette situation pourrait-elle se produire en France ou en Europe ? « Il y a un parallèle très fort entre ce qui passe actuellement en Australie et la situation en France. La problématique est que la méga revue de presse faite par Google et les autres GAFAM leur permet de générer des revenus dont ne bénéficient pas ceux qui ont investi dans la matière grise », déclare maître Christiane Féral-Schuhl, avocate aux barreaux de Paris et du Québec.

Lundi 22 février, le commissaire européen en charge de la régulation des services numériques, Thierry Breton, a déclaré que « c’est aux plateformes de s’adapter aux régulateurs et pas l’inverse. Il y a des lois, et les plateformes doivent s’adapter. »

« En 2019, la Commission européenne a publié une directive sur le droit d’auteur et les droits voisins dans le marché numérique. Il y a eu ensuite la loi de transposition française du 24 juillet 2019 sur les droits voisins des éditeurs de presse. Cette loi a pour but un rééquilibrage du rapport de force et un partage de la valeur des ressources liées à l’information entre d’un côté les plateformes en ligne et de l’autre les agences et les éditeurs de presse », explique maître Christiane Féral-Schuhl, spécialisée depuis plus de 30 ans dans le secteur du droit de l’informatique, des nouvelles technologies et de la propriété intellectuelle.

Maître Christiane Féral-Schuhl rappelle que depuis 2012, les médias français réclament le paiement de redevance pour l’exploitation de liens hypertextes indexés par les moteurs de recherche et les agrégateurs.

Résultat, un bras de fer a opposé Google et les éditeurs de presse, car le moteur de recherche n’entendait pas les rémunérer pour cette reprise de contenus. Il avait indiqué que, dès que la loi entrerait en vigueur, il n’afficherait plus d’aperçu sauf si un éditeur acceptait de lui conférer une licence à titre gratuit.

« Cette affaire a été portée devant l’autorité de la concurrence pour abus de position dominante et de dépendance économique. En avril 2020, cette autorité avait indiqué que le comportement de Google était susceptible de constituer un abus de position dominante. Elle avait invité le moteur de recherche à trouver un accord pour déterminer la rémunération associée. Un accord-cadre a été signé le 21 janvier 2021 entre Google et l’APIG [Alliance de la presse d’information générale, NDLR]. Il préfigure sans doute d’autres accords », précise maître Christiane Féral-Schuhl.

Pour maître Jean-Philippe Hugot, avocat au barreau de Paris depuis 1998, « c’est l’un des chantiers législatifs et judiciaires des dix prochaines années. La question de la propriété intellectuelle n’a pas encore été réglée avec les GAFAM. Aujourd’hui, des contenus protégés par la propriété intellectuelle sont diffusés de manière massive, relayés par l’intermédiaire de ces entreprises sans que cela génère un contrôle du droit d’auteur. Or, ce sont des activités commerciales ».

Pour ce spécialiste en droit de la communication et de la propriété intellectuelle, ce bras de fer entre GAFAM et éditeurs de presse durera tant qu’il n’y a pas un procès. « Il s’agit d’un rapport de force. Ces entreprises ne prendront jamais spontanément des mesures qui vont les contraindre à payer des droits d’auteur. À un moment, il y a des ayants droit qui vont s’énerver et cela va déclencher un procès qui entraînera peut-être ensuite une règlementation. Pour l’instant, à ma connaissance, il n’y a pas d’engagement de procédures dans quelque pays que ce soit ».

Pourtant, l’arsenal juridique est parfaitement capable de s’attaquer à cette problématique. Comparée à l’Europe, la France n’est ni en avance ni en retard dans ce domaine. « La notion de droit d’auteur n’a pas à être revue. Elle peut être adaptée aux nouveaux mediums sans grande difficulté. Dans l’arsenal juridique français, nous avons les moyens d’agir. Si des ayants droit veulent attaquer ces entreprises, ils peuvent d’ores et déjà le faire », déclare Jean-Philippe Hugot.

Reste le plus dur, avoir les reins suffisamment solides pour s’attaquer à ces monopoles.