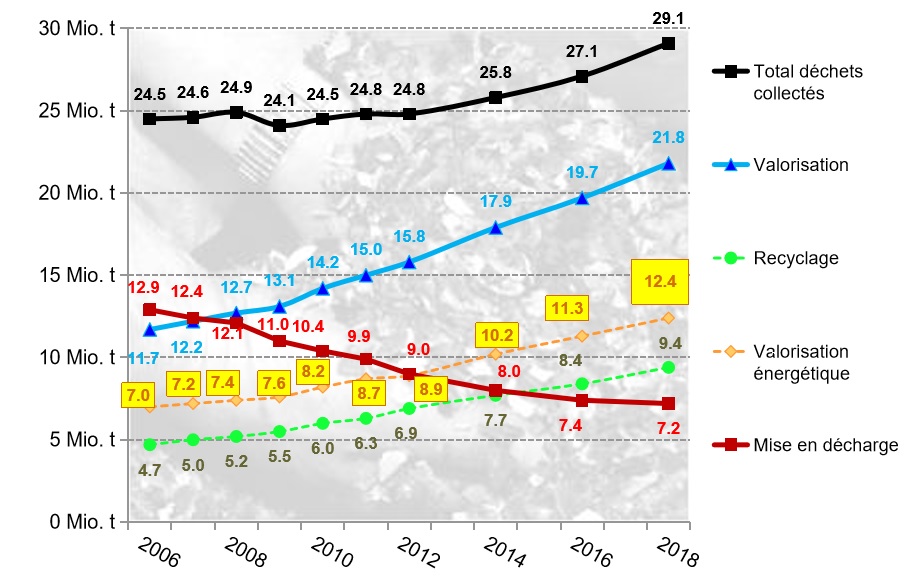

En 2018, le taux de recyclage des déchets plastique atteint 32,5% (+1,4 point par rapport à 2016) en Europe, et la valorisation énergétique 42,6% (+0,9 point). Si le recyclage augmente aussi en France, les déchets plastiques n’y sont encore recyclés qu’à hauteur de 24,2% (+1,3 point). Dans l’Hexagone, 43,4% des déchets plastiques sont valorisés énergétiquement (-1,1 point). La Norvège remporte la palme d’or européenne avec un taux de recyclage de 45%.

Encore 24,9% des déchets plastiques finissent en décharge en Europe (-2,4 point) et 32,5% en France (-0,2 point). Comparativement, la mise en décharge baisse beaucoup plus rapidement au niveau européen qu’en France. Sur les 12 dernières années, la mise en décharge a ainsi reculé de 44% en Europe, contre seulement 18% en France.

Des efforts particuliers sur les emballages

Les politiques européennes de recyclage portent particulièrement sur les emballages. Représentant près des deux tiers des déchets plastiques européens, le taux de recyclage des emballages plastiques est de dix points supérieur à celui de l’ensemble des déchets plastique. Il atteint 42% en Europe, contre seulement 26,4% en France. La République Tchèque remporte ici la palme d’or européenne avec un taux de recyclage des emballages plastique de 52 %. Le recyclage des emballages s’accélère toutefois en France sur les deux dernières années : il a progressé de 4,2% par an entre 2016 et 2018, contre 2,9% par an en moyenne sur les 12 dernières années.

PlasticsEurope trouve tout de même quelques bonnes nouvelles pour le recyclage français. «Alors que le taux de recyclage des emballages en France reste toujours inférieur à la moyenne européenne, la France affiche de meilleures performances dans les autres secteurs, en particulier ceux de l’automobile (26,7% contre 19%) et de l’électrique et l’électronique (35% contre 24%)», relève l’organisme.

Généraliser la collecte séparée des plastiques

«Les chiffres parlent d’eux-mêmes : les 48% de déchets plastique issus de collectes séparées sont recyclés à hauteur de 62% alors que les 52% de déchets collectés en mélange en Europe, ne sont recyclés qu’à hauteur de 6%», note PlasticsEurope. L’association appelle donc à la généralisation de la collecte séparée pour atteindre des taux élevés de recyclage.

La France est particulièrement concernée. En 2018, seulement 32% des déchets plastiques générés dans le pays ont été collectés séparément. «Il faut absolument basculer de la collecte en mélange à la collecte séparée», analyse Hervé Millet, directeur des affaires techniques et réglementaires de PlasticsEurope. L’extension des consignes de tri d’ici 2022 et un meilleur respect du tri 5 flux (papier/carton, métal, plastique, verre, bois) devraient améliorer la situation. 25 millions de français sont concernés par l’extension des consignes de tri début 2020 avec un objectif à 34 millions fin 2020. Par ailleurs, le projet de loi économie circulaire prévoit la généralisation de la collecte séparée des déchets d’emballages consommés hors foyers d’ici 2025 et une obligation plus stricte d’une collecte séparée par les acteurs économiques.

Augmenter la circularité des plastiques

Les plasturgistes européens utilisent près de 4 millions de tonnes de plastiques recyclés issus de déchets post-consommation. 46% sont utilisés dans le BTP, 24% dans l’emballage, 13% dans l’agriculture. D’autres secteurs peinent à intégrer des plastiques recyclés. C’est notamment le cas de l’automobile, des articles ménagers, de sport et de loisirs, de l’électrique et de l’électronique.

Selon les secteurs, le contenu en matières recyclées des produits varie de 2 à 20%. Par exemple, les emballages contiennent en moyenne 5% de plastiques recyclés, contre 14% pour les plastiques du bâtiment et 20% pour les plastiques agricoles.