Ces ondes peuvent être de natures différentes : électromagnétiques, acoustiques, sismiques par exemple.

Stéphane Brûlé est ingénieur chercheur collaborant avec l’institut Fresnel de Marseille, spécialisé en réponse dynamique des sols et des bâtiments. Il étudie notamment l’impact que pourrait avoir toute forme de structures urbaines en surface et en souterrain. Cette structuration revêt parfois un caractère périodique dense et nous interpelle alors sur les conditions pouvant nous amener à les assimiler à des métamatériaux, sous sollicitation sismique.

Le but premier est de comprendre les phénomènes d’onde au sein de ces matériaux structurés complexes et de capitaliser sur le couplage des ondes avec les sols structurés et les oscillateurs de surface (les bâtiments). Pour l’ingénieur en génie parasismique, l’objectif est de s’assurer que ces phénomènes peuvent avoir un intérêt pour limiter les effets destructeurs des ondes sur les constructions de surface.

Il a accepté d’expliquer aux Techniques de l’Ingénieur les enjeux autour de ces recherches et du développement d’applications autour des métamatériaux et de leurs propriétés.

Techniques de l’Ingénieur : Quels sont aujourd’hui les métamatériaux sur lesquels la recherche est la plus aboutie ?

Stéphane Brûlé : Les métamatériaux acoustiques sont ceux qui se développent le plus rapidement. En tout cas, ce sont ceux pour lesquels la possibilité de mise en œuvre est la plus aboutie. Comme ces métamatériaux ont une taille similaire à ce que l’on utilise aujourd’hui pour les problématiques d’acoustique, la transposition se ferait assez vite.

Cela peut consister à isoler une salle avec du bruit, ou rendre plus furtifs des équipements sous-marins, par exemple. Pour ce dernier exemple, les travaux cités dans l’article explorent des « peaux spécifiques » limitant la signature acoustique d’un sous-marin.

Sur le domaine de l’acoustique, les traitements sont relativement rapides à mettre en œuvre et sont la transcription d’une physique assez simple, c’est aussi pour cela qu’il s’agit du domaine qui progresse le plus vite sur le développement de métamatériaux.

Quelles sont les propriétés des métamatériaux qui intéressent la recherche ?

La physique des ondes et vibrations décrit des phénomènes physiques dans les milieux complexes. Pour des effets remarquables comme la réfraction négative dans un métamatériau, des propriétés effectives du milieu peuvent être décrites. Il s’agit ensuite de savoir si ces propriétés physiques et mécaniques effectives peuvent être obtenues à l’aide de matériaux présents dans la nature.

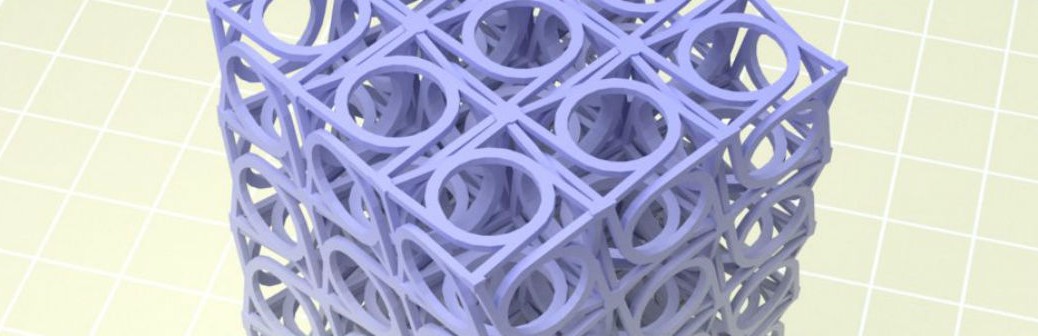

C’est la structuration du matériau, ajoutée à des résonances locales, qui va proférer au matériaux ses propriétés. Cette structuration de la matière en petits éléments va avoir la capacité de vibrer localement différemment par rapport à l’ensemble de la matière concernée. Ces phénomènes conjugués de passage dans un matériau qui est constitué de petits éléments, plus leur capacité à vibrer localement et spécifiquement va donner une propriété effective.

L’idée derrière les métamatériaux va être de donner au matériau des propriétés équivalentes quand les ondes vont interagir avec la matière. Pour le cas des ondes électromagnétiques par exemple, le défi consiste à obtenir des indices de réfractions qui vont être équivalents tout en étant négatifs, c’est-à-dire que les ondes vont adopter un comportement différent de celui attendu.

Tout cela grâce à la structuration de la matière ?

Oui, et un exemple remarquable de l’interaction des ondes et de la matière s’observe par exemple quand on éclaire un cristal avec des rayons X, de longueur d’onde très petite, en étude cristallographique. Un cristal est constitué d’un arrangement périodiques des ions dans les trois directions à l’échelle nanométrique. C’est la répétition d’un motif élémentaire (la maille). Ce cas illustre bien le phénomène spécifique de la diffraction que l’on retrouver aussi avec des sols structurés à l’échelle métrique et traversés par des ondes sismiques.

Par extension de la notion de cristal, matériau naturel, on peut parler de « cristal photonique », appelé aussi matériau à bandes interdites photoniques, possédant un profil diélectrique périodique, pouvant empêcher la lumière (de longueur d’onde plus de 100 fois supérieure à celle des rayons X) de se propager pour certaines fréquences ou longueurs d’onde selon une, deux ou plusieurs directions de polarisation de l’onde entrante.

Avec des longueurs d’onde encore plus importantes, centimétriques à métrique, un « cristal phononique » est une structure artificielle anisotrope constituée d’une distribution périodique d’au moins deux matériaux aux propriétés élastiques distinctes ou d’un matériau avec perforations, pouvant présenter des bandes de fréquences dans lesquelles la propagation des ondes acoustiques ou élastiques est évanescente (onde plane dont l’amplitude diminue exponentiellement avec la distance à la source) ou autorisée/guidée. Des propriétés effectives négatives, peuvent être obtenues avec un cristal phononique, par exemple la masse ou l’indice de réfraction.

Les métamatériaux sismiques ont, de par la nature des ondes avec lesquels ils interagissent, des tailles plus importantes…

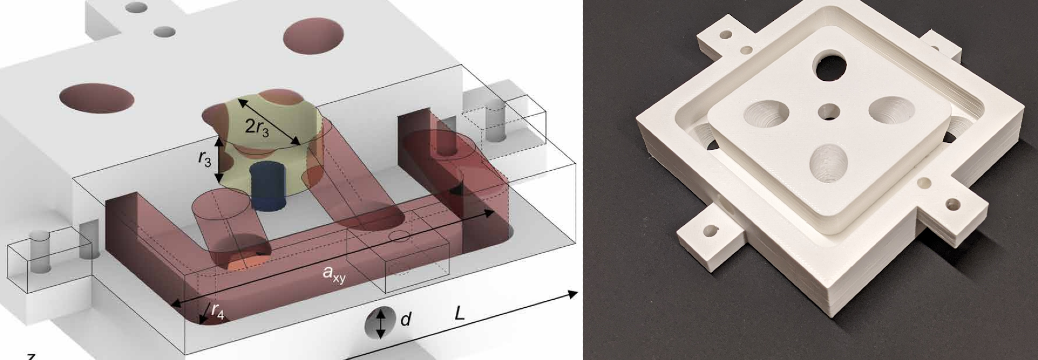

Dans le cas des ondes sismiques, une application originale consisterait à contraindre l’énergie des ondes à suivre un autre chemin, pour protéger une zone spécifique. Pour que l’application soit envisageable économiquement, il est préférable que la taille des motifs utilisés pour interagir avec ces ondes soit inférieure aux longueurs d’ondes propagées. Cela est intéressant dans le cas des ondes sismiques, car leur vitesse de propagation, qui est liée à leur longueur d’onde, devient plus faible dans les sols meubles peu consolidés, propices à amplifier le signal en surface. Ces longueurs d’ondes, de l’ordre de quelques dizaines de mètres, nous permettent de mettre au point des dispositifs concrets, ce qui serait plus compliqué à imaginer avec des longueurs d’ondes beaucoup plus grandes.

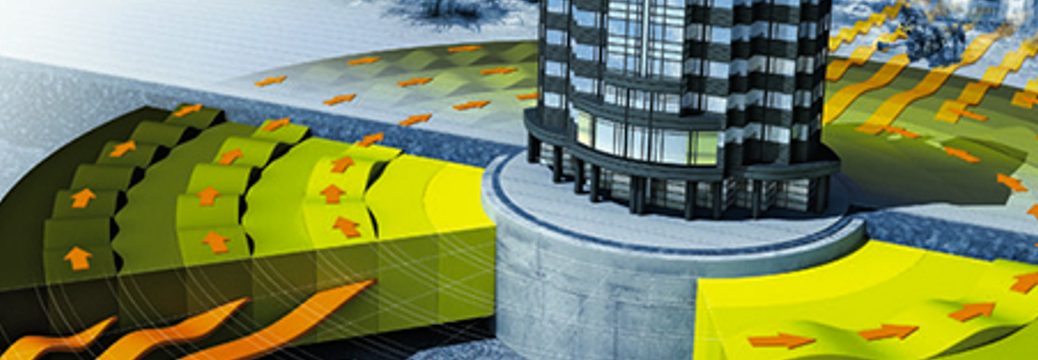

Les sols urbains sont déjà très structurés, avec aujourd’hui quasiment autant de constructions en surface (les quartiers successifs d’une ville) que celles en souterrain (métro, parking, etc.) dans certaines villes. Si on regarde bien, cette structure souterraine est relativement répétitive, à l’échelle d’un quartier ou d’une ville. On a donc là déjà une potentielle modification du signal. Il faut donc déjà parvenir à comprendre ces modifications. Dans la pratique, le design souterrain d’une ville pourrait être imaginé en amont, pour construire un réseau souterrain structuré, qui serait alors à même d’interagir avec les ondes sismiques, pour limiter leurs effets en surface.

Ce qui est également intéressant, c’est que les villes sont amenées à se développer de plus en plus de manière souterraine dans le futur, pour des raisons de place, mais aussi d’énergie par exemple. Il serait intéressant que le développement de ce réseau souterrain soit développé de manière à obtenir une structure périodique. Une partie de notre travail consiste à faire tourner des modèles numériques pour évaluer quelles structures pourraient être mises en place, selon la spécificité du sous-sol, pour limiter les effets des ondes sismiques en surface.

Expliquez-nous en quoi consiste le projet Meta-forêt, qui se base sur la structure répétitive que constitue une forêt et ses arbres pour créer des métamatériaux ?

Le projet ANR Metaforêt a consisté notamment à étudier les effets de couplage des arbres d’une forêt, identifiés comme des oscillateurs libres, vibrant localement, avec les ondes se propageant dans le sol. On recommande la lecture du rapport de projet pour plus de détail.

Solidement ancrés au sol et répartis de manière régulière, ce qui est en général le cas dans une forêt, ces éléments vont jouer le rôle de résonateurs. La propagation d’une vibration dans le sol, couplée aux vibrations spécifiques des arbres ou des pylônes, va modifier le signal global qui intervient dans cet ensemble.

Ce qui est montré in fine, c’est par exemple la possibilité de modifier la direction de propagation du signal. Concrètement, l’effet effectif de ce dispositif permettrait de rediriger un signal dans une direction, en profondeur par exemple. Ce qui dans le cas des phénomènes sismiques permettrait d’évacuer l’énergie loin des structures en surface.

Le projet Meta-forêt a également montré qu’il était possible de changer la polarisation des ondes. Concrètement, il faut imaginer qu’on arrive à transposer une partie de l’énergie de propagation horizontale d’une onde vers la propagation verticale. Cela permettrait, toujours dans le cas de la protection des structures, de rediriger une onde pour qu’elle soit la moins impactante possible sur la structure à protéger.

Votre travail de recherche actuel consiste à analyser le bruit de fond sismique. Quels sont les enjeux derrière ces recherches ?

C’est aujourd’hui un axe de recherche important. Au-delà des phénomènes occasionnels et intenses en énergie que sont les séismes, il y a une vibration permanente dans le milieu terrestre, et mesurable à la surface de la Terre. Imaginer un métamatériau capable d’amplifier cette vibration et y accoler un capteur d’énergie, pour récupérer une partie de l’énergie produite, est un sujet sur lequel nous travaillons à l’heure actuelle.

Le bruit de fond sismique est un bruit permanent, faible, qui interagit avec les structures urbaines telles que les immeubles, qui vibrent également. Ces structures distribuent dans le sol, en fonction de leur disposition, une énergie non négligeable.

Nous essayons de caractériser cette énergie distribuée dans le sol, à différentes échelles. En effet, la structuration d’un quartier va aboutir à une redistribution particulière de l’énergie. Mais la composition des matériaux constituant les bâtiments, va, elle aussi avoir un impact sur la redistribution de cette énergie. C’est ce sur quoi nous travaillons actuellement, tout en sachant que dans un premier temps, il est fondamental de pouvoir caractériser cette énergie libre à différentes échelles, pour évaluer le potentiel réel de ce types de dispositifs.

Pour les matériaux de structures rigides comme le béton par exemple, on pourrait imaginer interagir avec les ondes issues de la circulation des véhicules en ville par exemple. Ce type de dispositif existe d’ailleurs déjà dans certaines villes, pour récupérer l’énergie des piétons quand ils marchent sur les passages pour piétons.

Ces dispositifs et leurs performances sont très liés aux progrès réalisés sur les capteurs et les accumulateurs d’énergie. C’est d’ailleurs ces progrès qui ont amené au développement des métamatériaux en zones sismiques.

Propos recueillis par Pierre Thouverez

Image de Une : ©Institut-Fresnel