Leader mondial des spécialités minérales pour l’industrie, le groupe industriel Imerys offre des solutions fonctionnelles à haute valeur ajoutée pour un grand nombre de secteurs, de l’industrie des procédés, jusqu’aux biens de consommation. L’activité d’Imerys est divisée en deux pôles. Le premier concerne les minéraux de performances, au sein duquel évolue Guillaume Delacroix. Le segment des Minéraux de Performance rassemble trois domaines d’activités géographiques – l’Europe, le Moyen-Orient et l’Afrique, l’Amérique et l’Asie-Pacifique – et sert les industries de l’alimentation (humaine et animale), de la cosmétique, du plastique, de la peinture et des revêtements, de la filtration, des matériaux céramiques, des énergies renouvelables, du papier et du carton.

Le second pôle regroupe les activités Matériaux et Solutions de haute température. Ce segment rassemble deux domaines d’activité – solution haute température, et réfractaires, abrasif et construction – et sert les marchés des réfractaires de la fonderie, des métaux, des abrasifs et de la chimie du bâtiment.

Alors que la crise sanitaire mondiale fait encore l’actualité, le groupe Imerys, qui a une activité internationale, n’a pas été trop touché par ce contexte inédit. Au-delà, la problématique écologique de plus en plus pressante oblige Imerys à s’adapter, autant en termes d’organisation que de R&D. C’est ce qu’a expliqué Guillaume Delacroix à Techniques de l’Ingénieur.

Techniques de l’Ingénieur : Comment définir l’activité d’Imerys ?

Guillaume Delacroix : Imerys est un groupe minier dont les origines remontent au 19ème siècle. Au tournant des années 2000, nous avons pris un virage stratégique pour nous concentrer sur les minéraux industriels, en nous focalisant sur l’activité minière et en abandonnant la métallurgie. Progressivement, nous nous sommes également développés sur les activités minérales aval.

Nous ne faisons pas de chimie de spécialité, puisque nous possédons notre amont (les mines). Cela se traduit pour nous par l’emploi d’ingénieurs avec des spécialités multiples : mécanique, électrique, thermique, science des matériaux, géologues, ingénieurs miniers, qui vont nous permettre de maîtriser la mine et la valeur ajoutée que nous apportons aux minéraux que nous commercialisons.

Au final, nous sommes à la croisée des chemins entre les grandes entreprises minières et les industries type « chimie de spécialité » comme Solvay ou BASF. C’est un monde que nous avons un peu inventé, dans lequel nous nous développons aujourd’hui et sur lequel nous sommes leader. Nous travaillons essentiellement en B to B, en apportant des solutions minérales ayant des valeurs d’usage, elles-mêmes attachées aux propriétés des minéraux que nous avons transformés.

Vous êtes en charge du Domaine d’Activité des Minéraux de Performance EMEA au sein du groupe Imerys. Quelle est son importance par rapport à l’ensemble de l’activité du groupe ?

En année normale, nous faisons en moyenne 4,5 milliards d’euros de chiffre d’affaires et nous employons 16 000 collaborateurs. Le domaine d’activité dont je m’occupe représente environ un quart du business d’Imerys et fait partie d’un segment appelé Minéraux de Performance, qui représente à peu de choses près 60% de l’activité du groupe. Cette partie de l’activité du groupe est intégrée à la mine.

L’activité sur les mines comprend bien sûr la maximisation de la ressource, mais également le respect de la biodiversité, les relations avec les parties prenantes locales, le travail de réhabilitation des sites, des enjeux qui deviennent capitaux aujourd’hui.

Imerys est aujourd’hui un groupe d’envergure mondiale. Comment s’est opérée cette croissance ?

Nous avons beaucoup grandi par acquisition, en acquérant souvent des entités spécialisées sur un minéral donné. Pendant plusieurs années c’est comme cela que le groupe s’est développé, en intégrant à son activité de nouveaux minéraux, les uns après les autres.

Notre stratégie a depuis évolué, et nous sommes concentrés aujourd’hui sur les synergies entre les différents minéraux servant une même industrie. Nous avons réorganisé le groupe il y a deux ans, qui était traditionnellement orienté par ligne de produits, en l’organisant par marché. Maintenant, nous gérons notre business et notre R&D par segments applicatifs et non plus par ligne de produits.

Nous avons quatre marchés principaux, que sont :

- les peintures, plastiques, caoutchoucs, adhésifs ;

- la céramique et les matériaux de construction ;

- la filtration et les sciences de la vie

- le papier et carton.

Ces quatre segments de marchés vendent l’ensemble de notre gamme aux clients qui les composent. Cette organisation va guider le travail de nos forces de vente et de notre marketing, mais aussi de notre R&D, avec une connaissance très fine des applications de nos clients.

Cette organisation influe-t-elle sur le recrutement ?

En termes d’embauches, cela se traduit par le recrutement de collaborateurs qui connaissent très finement les métiers de nos clients. Il est en effet capital pour nous de comprendre les activités de nos clients, afin d’améliorer la valeur des minéraux que nous transformons, et d’anticiper au mieux les besoins futurs de nos clients pour les satisfaire.

Quelles sont les thématiques qui orientent le travail de votre R&D ?

Les sujets sur lesquels nous faisons de la recherche sont nombreux : légèreté, mobilité électrique, solution naturelles, minéraux circulaires… les tendances du développement durable, notamment la réduction de l’empreinte carbone, sont très importantes pour nous car les parties prenantes avec lesquelles nous collaborons ont des exigences de plus en plus précises à ce niveau. Cela est un facteur de motivation pour l’ensemble des salariés de l’entreprise, et une boussole supplémentaire pour orienter nos recrutements.

Pouvez-vous nous parler de l’organisation de vos centres de production ?

Nos centres de production sont organisés par groupements géographiques. Au sein de ces groupements, nous allons retrouver des sites qui n’opèrent pas forcément les mêmes minéraux, mais qui créent des synergies entre eux en termes d’achats, de politique environnementale, d’ingénieurs process… Nous créons des synergies locales à ce niveau là, et ensuite les vendeurs, le marketing et la R&D s’adressent à nos clients par marchés.

Votre métier s’est transformé : de fournisseur de matières premières, vous êtes devenus fournisseurs de solutions. Pourquoi cette mutation ?

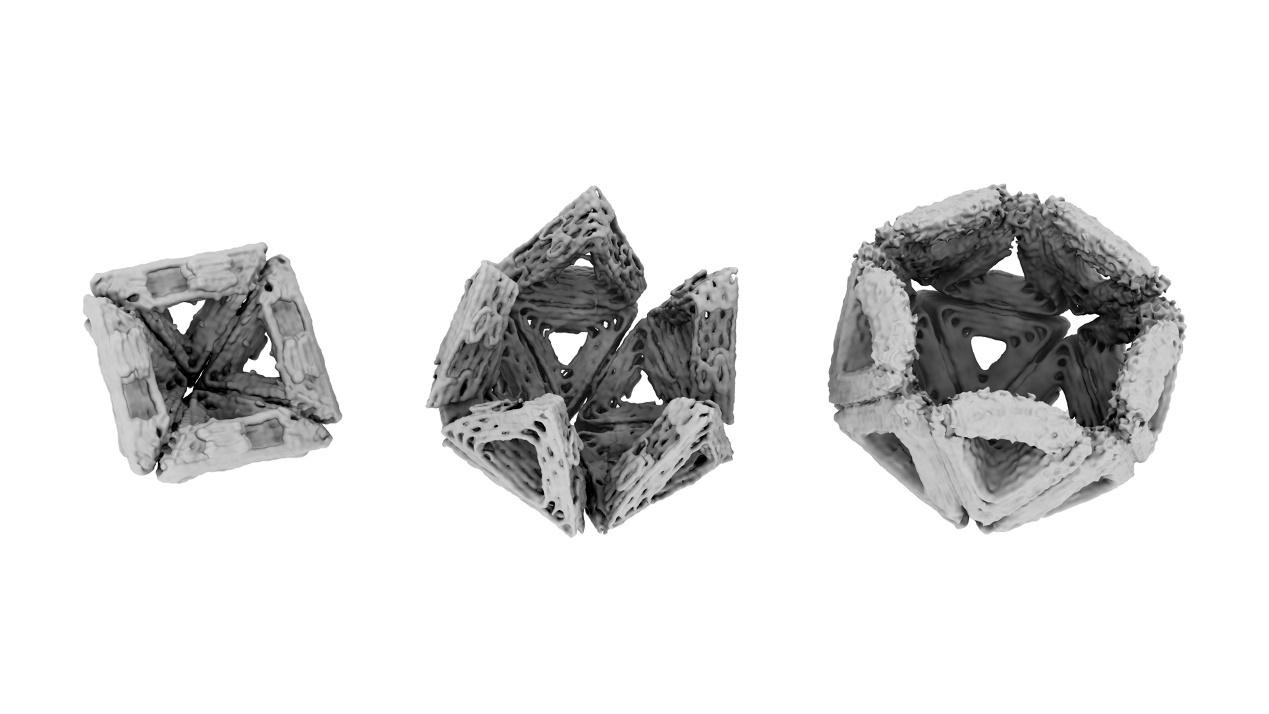

Effectivement. Par exemple, sur la céramique, nous proposons à nos clients des pâtes céramiques, dont nous allons faire la formulation pour nos clients. Il y a là un aspect recettage, qui nous permet de fournir au client une solution qui va répondre à ces besoins précis émis par les clients.

Ensuite, en période de forte inflation comme nous le vivons actuellement, nous sommes notre propre fournisseur puisque nous sommes propriétaires de nos mines (en fonction du droit local). Cela constitue une garantie très importante pour nos clients.

Vos clients ont-ils tendance à vous solliciter très tôt dans leurs phases de R&D ?

Exactement. L’avantage, pour nous et donc pour nos clients, est que nous possédons un portefeuille de minéraux très large. Cela nous permet, quand nous sommes face à un client voulant développer une solution minérale innovante, de lui proposer plusieurs minéraux, voire une combinaison de minéraux.

Encore une fois, il s’agit pour nous d’aller au plus proche des applications de nos clients, pour trouver les formulations les plus adaptées.

Est-ce que vous collaborez avec des startups ?

C’est une question que nous nous posons actuellement. Nous suivons beaucoup de startups qui pourraient avoir des idées que nous n’avons pas encore développées, notamment en termes de circularité et d’innovation. C’est une branche d’activité que nous voulons développer et sur laquelle nous ne sommes pas assez présents pour le moment.

Revenons sur la R&D. Au sein de votre pôle d’activité, qu’est-ce qui a guidé le choix pour l’installation des sites de R&D ?

Le Segment des Minéraux de Performance du groupe possède six centres de R&D.

A Toulouse tout d’abord, car c’est une ville très universitaire et où sont présentes beaucoup d’industries de pointe ; en Grande-Bretagne et en Suisse, qui sont des sites historiques du groupe ; en Chine, nous nous sommes installés sur un green field, pour développer entre autres des activités autour de la peinture et des plastiques. A Atlanta, car c’est le siège historique du groupe aux Etats-Unis. Il s’agit également d’un hub intéressant car il est très bien connecté. Enfin, nous avons également un site au Japon, orienté sur le carbone.

On parle beaucoup des usines 4.0. Qu’en est-il pour l’activité minière ?

Sur la mine, il s’agit de mieux collecter les données, notamment pour limiter au maximum notre impact écologique. A ce niveau, l’utilisation de drones et de l’intelligence artificielle pour le pilotage de nos engins de chantier permet de beaucoup mieux cartographier nos stocks et de réduire notre empreinte carbone.

C’est la même chose avec les usines. Pour une empreinte industrielle donnée, nous allons pouvoir augmenter notre rendement en améliorant certains process.

Et en termes de sécurité ?

La sécurité est une préoccupation cardinale, qui ne se résout pas, selon moi, par l’automatisation. On peut se blesser dans un environnement entièrement automatisé.

Pour assurer la sécurité de tous, il faut veiller les uns sur les autres, et instaurer une culture de la sécurité, plutôt que d’essayer d’automatiser les processus au maximum.

Vous parliez à l’instant d’empreinte écologique. Les exigences sur ce point vont être de plus en plus importantes. Comment anticiper vous cela ?

Les changements de paradigmes ne vont faire que s’accélérer. Il va donc falloir, pour Imerys comme pour toutes les entreprises, s’adapter. Les entreprises qui ne s’adapteront pas seront en grande difficulté, je le crois. Chez Imerys, nous nous sommes fixés des ambitions importantes, avec la volonté de réduire de 36 % notre empreinte carbone d’ici 2030, en respect des accords de Paris.

Aussi, nous privilégions aujourd’hui les process les moins polluants qui existent pour exploiter les minéraux. Ainsi, nous quantifions l’impact sur l’environnement de la production des solutions que nous proposons, pour évaluer leur impact environnemental réel et ainsi classer les minéraux, en faisant une balance entre leur valeur d’usage et leur impact sur l’environnement.

Cette méthodologie et le classement qui en découle sont des informations que nous allons commencer à communiquer à nos clients, qui sont très demandeurs de ce type de données.

Nous sommes également conscients que pour avoir un réel impact sur les pratiques environnementales, il faut que les parties prenantes agissent toutes en même temps : l’analyse du cycle de vie de la production de nos produits n’est qu’une partie du cycle de minéraux que nous produisons. Il faut également considérer l’utilisation qu’en font nos clients, pour développer une analyse complète du cycle et réellement comprendre l’impact global de notre activité.

Propos recueillis par Yves Valentin, directeur de Techniques de l’Ingénieur, et Pierre Thouverez, journaliste.